多模态深度学习及其在眼科人工智能的应用展望

2021-10-12李锡荣

李锡荣

中国人民大学 1数据工程与知识工程教育部重点实验室 2信息学院人工智能与媒体计算实验室,北京 100872 3北京致远慧图科技有限公司人工智能实验室,北京 100872

以深度学习为代表的新一代人工智能(artificial intelligence, AI)技术对各行各业的影响是前所未有的。例如美国科学家利用AI辅助新型冠状病毒疫苗研发[1],训练深度卷积网络根据咳嗽声音筛查新型冠状病毒肺炎患者[2];日本农民利用深度学习模型根据黄瓜品相对其进行自动分类[3],等等。这种影响的形成,与深度学习自身的技术特点密不可分。

深度学习是一种以深层人工神经网络为架构,以原始数据为输入,以目标任务为输出,具备端到端(end-to-end)学习能力的机器学习算法[4- 5]。相比传统机器学习算法,深度学习具有强学习能力和高易用性的特殊优势。以图像分类任务为例,传统方法分为特征提取(feature extraction)和分类器训练(classifier training)两个阶段。前者负责从原始图像样本中提取与当前指定任务相关的向量化的视觉特征,而后者基于视觉特征和样本所对应的类别标签,寻找最优分类决策边界。这两个阶段之间并不存在反馈机制。分类器训练只能在既定特征空间进行,即使不同类别的样本在该特征空间缺乏区分性。与之相反,深度学习将特征提取和分类器训练纳入一个神经网络框架中,输入数据经过多层神经网络,逐次提取表达能力更强的视觉特征,最后经任务层给出分类结果。任务层获得的错分信息经后向传播(back propagation)反馈给特征层,使其不断调整、优化特征提取过程,从而实现特征提取和分类器训练的联合优化。值得进一步指出的是,由于传统方法天然缺乏联合优化能力,因此特征提取[一些文献称之为特征工程(feature engineering)[6]]非常关键,往往需要密集的领域知识和大量的经验式设计。相比之下,深度学习的特征提取过程更为精简,相同或相似的神经网络架构可用于解决传统意义上完全不同的两个任务(如图像分类和文本分类)。

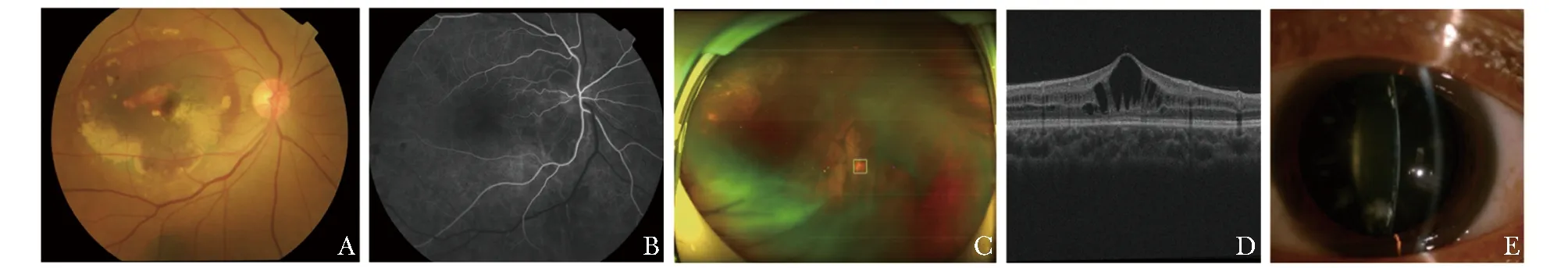

鉴于医学影像在健康筛查、疾病诊断、精准治疗、预后评估等诸多任务中的关键作用,用于医学影像结构分析与语义理解的深度学习正成为重要的交叉学科研究方向。由于眼睛是全身唯一活体能够直接观察到血管和神经的部位,关于该部位的多种类型医学影像如眼底彩照 (color fundus photography, CFP)、超广角眼底图像 (ultra-wide-field fundus images, UWF)、光学相干断层成像(optical coherence tomography, OCT)、裂隙灯照片等(图1)具有无创、非侵入、经济等优点,因此发展眼科AI对于在不同年龄段开展大规模眼健康筛查具有重要意义。

图1 不同类型眼科影像示例

以CFP为例,眼科AI涉及结构分析(左右眼识别、黄斑定位、视杯视盘分割、血管提取等)和语义理解(图像质量评估、眼底病灶分割、眼底疾病识别等)两大类任务。近年来关于特定子任务的代表性研究案例逐年增多(表1)。例如,谷歌2016年发表于JAMA的研究[7],首次证实了利用深度卷积网络从单张后极部CFP中识别糖尿病视网膜病变(diabetic retinopathy, DR)的可行性。谷歌下属的DeepMind公司于2018年在Cell发文表明,以OCT图像序列作为输入的AI模型在多个病种的转诊判断上,有望达到临床专家的水平[9]。北京协和医院的新近研究证实,基于单张CFP,AI模型在10余种常见眼底疾病的识别精度上已可媲美住院医师[19]。

表1 单模态深度学习在眼科领域的应用举例

上述眼科AI方向的工作均以单一类型影像(如CFP、OCT、UWF等)作为AI模型的输入。而在临床实践中,医生为了实现更精准的诊断,往往需同时参考不同类型、不同模态的影像样本进行综合分析、交叉验证和判断。以CFP和OCT为例,考量二者成像部位的物理位置关系可以发现,CFP反映的是视网膜平面,而OCT图像反映的是视网膜切面,两种不同模态的影像包含的信息存在互补性。为充分利用不同模态影像之间的互补性,需要从单模态深度学习转向多模态深度学习。

1 多模态深度学习的原理

关于模态(modality)一词,既往文献为了覆盖尽可能多的研究领域,其定义要么语焉不详,要么过于抽象[21- 22]。考虑到AI辅助诊断的背景,本文给出如下定义:模态是对由一种特定类型装置采集的具有相同表达形式的数据的总称。根据该定义,CFP是一种模态,而OCT是另外一种模态,因此图1亦可视为不同模态的眼科影像。上述定义也区分了数据本身的多样性(diversity)和模态在概念上的根本差异。因个体因素(如具体设备型号、拍摄者、被拍摄者、拍摄条件等)导致的影像上的差异,不能形成一个单独的模态。同一模态的样本因数据采集过程中的系统性偏差形成的风格各异的数据集合,称为域 (domain)[23]。

相比单模态深度学习,多模态深度学习架构的一个重要特性是其数据层要具备同时接受不同模态输入的能力。在其学习过程中,不但要充分提取和利用各个模态内部的有用信息,同时要挖掘各模态之间的互补性并进行有效的多模态信息融合,以实现较单模态网络更优的性能。根据融合发生的位置,多模态深度学习包括数据层、特征层和任务层融合3种范式(图2)。

图2 多模态深度学习的3种范式(虚线方框)A.数据层融合;B.特征层融合;C.任务层融合

数据层融合将不同模态的样本混在一起作为“单模态”输入,强制神经网络在训练过程中提取与模态无关的特征[24](图2A)。这种范式的优点是可以直接使用现有的单模态架构,缺点是对模态之间的空间关联性要求较高,不适用于类似CFP和OCT这两种空间上正交的模态。

特征层融合尝试在各个模态的特征提取过程中融合不同模态的信息(图2B)。浅层特征仍保留相当多的原始数据信息,而深层次的特征包含更多与任务相关的语义特征,因此一般选择在深层特征上进行融合。常见的融合算法有简单的特征向量拼接[25]和旨在获取高阶关联信息的双线性池化 (bilinear pooling)、张量融合 (tensor fusion)等[26]。

任务层融合是将基于各个模态分别给出的预测结果进行融合[27](图2C),因此,在概念上可以看成是多个单模态网络的集成。各个网络既可以独立并行训练,也可以联合训练。对比3种范式,数据层融合实现最简单,但适用范围较窄;特征层融合的适用范围广、模型学习能力强,但对融合模块的设计和训练数据量也提出了更高要求;任务层融合则介于二者之间。在实践中选取何种范式,需具体问题具体分析。目前,第2种范式是研究者采用的主流方案。

2 多模态深度学习在医学领域的应用

多模态深度学习在医学领域的最新应用主要集中于各类肿瘤/癌症的辅助诊断和预后预测方面(表2)。例如,针对乳腺癌分类任务,Wang等[28]提出了一种多模态分类网络。该网络以普通超声、彩色多普勒超声、剪切波弹性成像、应变弹性成像4种不同模态的图像同时作为输入,并在特征层以特征拼接的形式实现多模态信息融合。

表2 多模态深度学习在医学领域的应用举例

针对脑肿瘤患者的总生存期预测任务,Zhou等[29]将总生存期分为短期(<10个月)、中期(10~15个月)、长期(>15个月)3类,从而将一个连续值的回归问题简化为三分类问题。研究者提出了一种多模态、多通道分类网络,接受4种模态的MR影像作为输入;为降低计算复杂度,引入了预处理模块,将三维MR立体图像投影得到不同方向的二维平面图。与Wang等[28]的研究类似,该研究从不同模态图像提取的特征以及肿瘤大小、患者年龄等辅助信息,也是通过特征拼接的形式实现了多模态信息的融合。

鉴于特征拼接的局限性,研究者们尝试探索更复杂、表达能力更强的多模态融合策略。Chen等[26]以组织病理学图像和基因组特征为多模态输入,构建了针对癌症诊断与预后预测任务的模型。该模型采用张量融合(tensor fusion)提取组织病理学图像特征和基因组特征之间的关联关系。Jiang等[30]尝试利用静脉期CT和动脉期CT图像的互补性以实现更准确的胰腺分割。神经网络先分别从静脉期CT和动脉期CT图像中提取不同层次的深度特征,之后进行多层次、选择性特征融合。

上述特征融合策略,无论是简单的特征拼接还是相对复杂的具备学习能力的融合,均是由研究者根据其经验人工设计。为了克服人工设计的局限性,Peng等[31]针对癌细胞远端转移预测任务,尝试通过网络结构搜索(network architecture search, NAS)在训练过程中动态确定对于融合PET和CT特征最有效的特征融合网络。尽管该 研究表明了NAS在性能上的优势,由于其本身需要额外的训练数据,这种动态生成的网络结构存在过拟合的风险。此外,NAS以性能为导向,由此获得的网络结构较之前人工设计的网络的可解释性较差。

3 眼科AI的多模态深度学习

3.1 探索

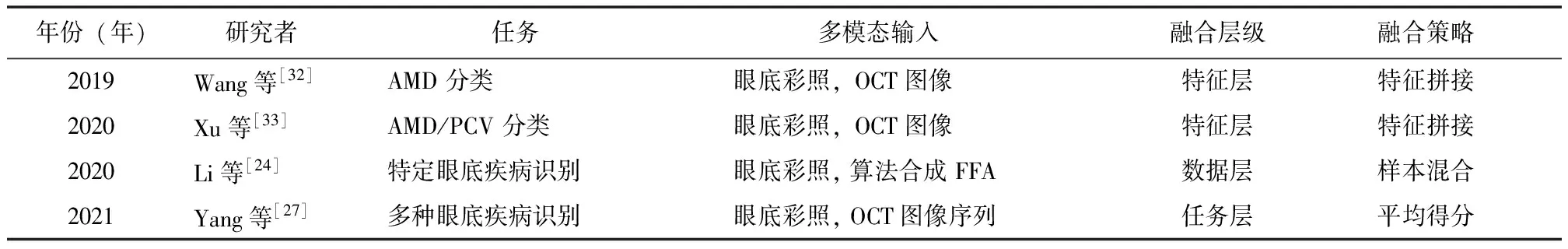

相较于其他医学领域,眼科AI的多模态深度学习应用目前仍处于起步阶段(表3)。笔者在主流期刊检索到该方向的首篇应用成果发表于2019年[32],内容为多模态年龄相关性黄斑变性(age-related macular degeneration,AMD)分类问题。研究者采用了一种双流(two-stream)网络架构,分别从CFP和OCT B-scan图像中提取相关特征,之后将不同模态特征进行拼接,再输入到后续的分类任务层,实现正常眼底/干性AMD/湿性AMD的三分类。Xu等[33]采用了类似的网络架构,并将任务进一步细分为四分类问题(正常眼底/干性AMD/湿性AMD/息肉状脉络膜血管病变)。上述研究结果均表明,相比仅采用CFP或OCT图像的单模态网络,多模态网络在分类准确率方面明显提升,初步显示了多模态深度学习在眼科AI上的应用潜力。

表3 多模态深度学习在眼科领域的应用举例

不同于以CFP和OCT图像作为多模态输入,Li 等[24]尝试将CFP和经生成对抗网络[34]合成的荧光素眼底血管造影(fluorescein fundus angiography, FFA)混在一起,通过数据层融合,引导神经网络在训练过程中学习模态无关而与任务相关的视觉特征。因此,该技术方案在本质上可以视为一种比基于传统底层图像处理技术更为复杂的数据增强。

北京协和医院在国际视觉与眼科研究协会2021年会上报告的一项工作[27]表明,以CFP和OCT图像序列为输入的多模态深度学习模型也可用于同时检测多种常见致盲性眼底疾病,如DR、AMD、视网膜前膜、病理性近视等。相比之前的工作,除检测病种数量增加外,在OCT分支网络中引入了一种深度多示例学习模块[18],可直接接受整个OCT图像序列,无须人工选择OCT B-scan图像作为多模态网络的输入。

3.2 挑战

虽然上述探索得出了令人鼓舞的研究结果,但眼科AI的多模态深度学习仍存在相当多的技术挑战需要攻克,主要集中于数据和算法两个层面。

数据层面,相比单模态场景,多模态数据存在配对要求,其前期原始数据采集和后期人工标注的难度及成本显著增加。因此,需加强各相关单位合作机制创新,以获得更多的多模态研发数据;此外,在数据高效深度学习 (data-efficient deep learning)方面需进行技术创新,以在训练数据规模受限的条件下实现有效的多模态学习。

算法层面,尽管现有的研究结果表明,多模态模型总体性能优于单模态模型,但在特定病种中,多模态模型并不总能超过在该病种上表现最优的单模态模型。单一模态影像并不能覆盖所有疾病特征。比如DR作为血管病,特征表现面积较大, CFP相比OCT可反映更多的疾病信息;而黄斑水肿的特征反映在视网膜层次厚度和结构的变化上,OCT的优势则更明显。如何设计更加智能的、具有自主选择能力的多模态信息融合机制是值得深入探索的研究课题[35]。

3.3 前景

需要指出的是,由于现有关于多模态眼科AI的研究相对较少,多模态深度学习在病种亚型分类、分期和相应的处置建议推荐等方面,较单模态的优势尚未充分体现。以干性AMD为例,玻璃膜疣是干性AMD的特征性临床表现,在早期阶段,玻璃膜疣较小,OCT相比CFP更容易观察到这一表现。理论上可以利用不同模态影像在病种不同阶段的不同适应性,实现更细粒度的分类,从而推荐更恰当的处置建议。

在数据形态上,现有研究主要考虑融合不同模态的影像,而在临床实践中,患者信息除影像数据外,还有非影像数据,比如定性的病史、定量的视光检查结果等。当前,这些非影像数据存在记录不准确或不完整等问题。随着电子病历系统的普及和建设水平的提高,能够有效融合影像和非影像数据的多模态AI有望在青少年近视综合防控、成人慢病管理、个性化医疗保健等多个应用场景发挥关键作用。

4 小结

深度学习是当前医学人工智能的核心技术。现有研究结果表明,在眼底疾病辅助诊断方面,多模态深度学习较基于单一模态的技术方案在识别性能上存在明显优势。发展面向眼科的多模态深度学习技术具有广阔的应用前景。由于多模态影像对于眼底疾病诊断的高效性和必要性,眼底成像设备已呈现“一体化”和“低成本化”的趋势,多模态AI辅助诊断具有巨大的普及空间。此外,眼底作为非侵入式观察全身健康状况的“窗口”,对于慢性病进展的检测和管理起着重要提示作用。我们有理由相信,多模态眼底分析在眼科以外的医疗健康领域也有着巨大的需求和应用潜力。

利益冲突:无

志谢:感谢北京致远慧图科技有限公司丁大勇博士对本文的建议,中国人民大学博士生林海斓在本文修订方面提供的帮助。