如何走出人工智能教育风险的困局:现象、成因及应对

2021-09-27李世瑾胡艺龄顾小清

李世瑾 胡艺龄 顾小清

[摘 要] 对新兴技术应用的追问从来都是停留在技术中性论层面。教育创新虽需技术支持,但不能只是管中窥豹,必须采用前瞻目光澄清模糊认识和错误做法,主动走出技术应用的风险困局。为推进智能教育生态的健康发展,本研究從管控视角廓清了四类典型现象:忽视智能技术还原教育世界的本体风险、遮蔽智能技术表征教育生态的认识风险、轻视智能技术违背教育初心的价值风险、滥用智能技术导致教育治理的伦理风险。研究发现,风险成因关键在于:过度掩盖技术应用的内生复杂性机理,尚未厘清技术介入教育生态的普遍性规律;盲目弱化技术重塑教育的脆弱性机理,滋生技术介入教育生态的负向效应;高度忽视教育生态的测不准性机理,缺少风险治理的科学方法与适切路径。鉴于此,提出应对智能教育风险的关键出路:共创复杂性治理范式,揭示教育生态的内生规律;厘清主体的协同机制,提升教育生态的抗逆基因;构建多元创新方法论,适应教育生态的动态平衡。

[关键词] 人工智能; 教育应用; 生态风险; 内生机理; 因应策略

[中图分类号] G434 [文献标志码] A

[作者简介] 李世瑾(1993—),女,河南安阳人。博士研究生,主要从事学习科学与技术设计、智能教育研究。E-mail:shijinliEdu@163.com。

一、问题的提出

面对二元智能时代的到来,教育已被卷入这场声势浩大的技术革命中。尽管人工智能教育实践的热情与野心日趋高涨,但当技术直接参与人本身的改写和塑造时,教育工作者产生前所未有的慌乱,甚至动摇了教育初心及育人使命。技术是建立在流沙之上的双刃剑,对新兴技术的追问从来都是停留在技术中性论层面[1]。教育创新虽需技术支持,但不能只是管中窥豹,必须采用前瞻目光澄清若干模糊认识和错误做法,主动走出技术应用的风险困局。

已有学者对这一问题进行深刻省思。舍恩伯格等指出,人工智能技术不是解决一切教育问题的“灵丹妙药”,亟须理性探索人本人工智能的路径和边界[2]。安涛从海德格尔技术哲学观检省了“人—技术—教育”一体化的存在论结构[3]。李芒等从人工智能教育应用的盲区、禁区和误区出发,强调人工智能教育必须重视人本性和完整性[4]。Jim[5]、Williamson[6]等依据教育治理原则探索数据服务的未来趋势。邓国民等提出福祉、公平正义、责任和问责等人工智能伦理原则[7]。由此看来,学界对人工智能教育的理性抉择已达成共识,但鲜有针对风险管控的突围路径,这无疑将制约教育生态的健康发展。正如英国著名社会学家大卫·科林格里奇所言:“一旦技术应用的风险后果发生时,它已成为经济和社会结构的一部分,对其管控将十分困难。”[8]因此,本研究从管控视角廓清智能教育的技术风险阈,进一步透析其内生机理,主动突围技术风险的困局,以期为智能技术与教育生态的深度融合觅求镜鉴。

二、解构:智能教育的技术陷阱

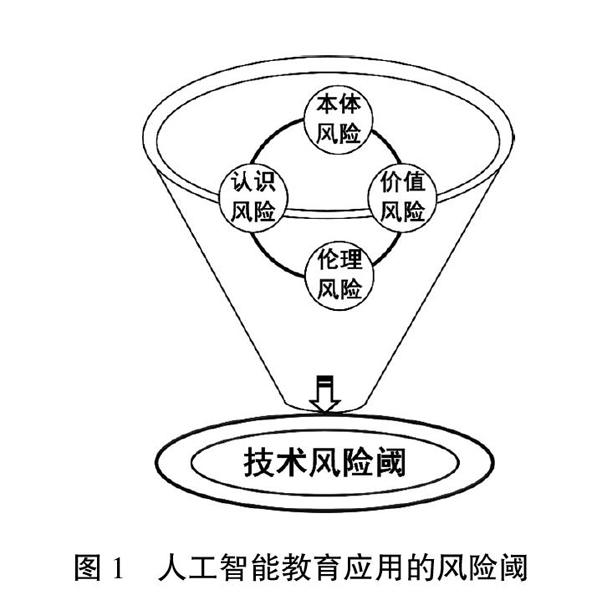

智能技术内蕴“造客之术”和“塑主之术”[9]。所谓造客之术,即主体在智能场域中无法理性感知到客观环境的存在,对其本原认识存在偏颇。所谓塑主之术,即过于强调智能技术的应用价值,无法保持主体思维、意识和情感等方面的主观能动性。如何消解智能技术的周边定律、“过滤气泡”等偏见效应[10],脱离技术奴役的牢笼尤为关键。因此,研究重新审视智能教育的边界和限度(如图1所示),为教育治理与管控指引科学方向。

(一)忽视智能技术还原教育世界的本体风险

人工智能通过多重意涵指向,试图探索教育世界的奥秘,彰显出更多的“趣悦性”和“个性化”[11]。例如,基于深度学习挖掘学习者的交互行为和情感特征[12]、采用人脸识别技术监测学习者的学习质量[13]、基于Spring Cloud的“微课堂”推送个性化学习资源[14]。但是,当撕下技术虚伪的“乐观面目”时,其现实应用效果并不尽如人意。一项关于智能导学系统的元分析结果表明,其对学业成就的提升效果非常有限(ES=0.09)[15]。另有研究结果表明,智能教学干预会让表现不佳的学习者感到不适应[16],甚至加剧了学习者的同质化倾向[17]。

教育复杂而不可控,人性神秘而不可测[18]。人工智能技术虽能汇聚规模化的教育数据,但始终无法全部还原真实的教育世界,这正是技术本体风险的现实映射。具体地,一是算法和数据的表征阈值远远小于教育生态范畴,其“样本<总体”的可视化表征显露出人工智能的局限性。二是表征形式的节点化和简约化,背离了教育生态的复杂性和系统性。试想,当高高竖起的能力标杆被量化为可复制的标准时,恐怕早已遗忘“好的教育”的规范性问题[19]。因此,从本体意义上来看,一味忽视“暗箱知识”“缄默知识”以及人的生命成长和价值观等内在品质,无疑将与育人初心相悖。此外,算法偏好往往固化甚至放大教育世界的“噪音数据”或“干扰数据”,抹杀教育的整全性和人本性,甚至成为教育质量测评的“杀伤性武器”。由此看来,技术工具的肆意狂妄,导致了教育人工智能的本体风险。

(二)遮蔽智能技术表征教育生态的认识风险

人工智能具有溢出带动性很强的“头雁”效应[20],为教育工作者勾勒未来教育图景打开了新视角。然而,正是遵循“主体—数据—客体”的表征路径,造成了技术还原教育实践的局限与割裂。其一,人工智能技术企图通过动态的数据链打开教育世界的“黑匣子”,但由于数字计算缺乏对因果关系这一隐性态势的挖掘和解释,很容易造成技术应用偏离教育实践的本原路径。其二,人工智能技术打破了“本我”与“非我”的平衡感。这是因为,技术的趣悦化促使个体认知、情感和意志等沉浸在智适应的世界里,进而产生一种“非我”的错觉。一旦“非我”表征形态无法适配“本我”精神意志时,两者之间的张力将会失衡,自我由此陷入技术异化的困境之中。其三,个体对技术过度迷恋容易导致主体话语权的缺失,从而遮蔽甚至割裂人的情感表征以及价值观[21]。诚然,这些缺失主体内在品质和生命价值的二进制数据,实质上是对教育情境、教育生命、教育价值的荒谬表征。因此,面对人工智能教育的认识风险,教育工作者亟须“知其然,知其所以然”。

(三)轻视智能技术违背教育初心的价值风险

教育是一项具有时代感的伟大事业[22],始终承载着育人这一亘古不变的责任与使命[23]。然而,伴随技术潜在的功效增强,其违背育人初心的现象愈发凸显,这恰是技术价值风险的真实寫照。一方面,人工智能技术是一种客观手段的存在,一旦未能充分考量教育的终极目标时,其弊端将显而易见。比如,当大脑几乎24小时置于智能世界时,由于缄默性知识的缺失以及认知结构的固化,人的思维和意识很容易陷入西西弗斯式状态[24]。另一方面,当过度依赖技术桎梏时,主我与客我之间的互动交流将视为数据与数据之间的较量,进而造成形式化和表层化的教学事故愈发频繁,学习共同体也呈现同质化发展倾向。显然,这些初见端倪的价值风险正如“普罗克拉斯提斯铁床”,逼迫学习者经过“铁床”的考验终打上“标准产品”标签[25]。但是,教育不是工厂流水线上的产品[26],无论人工智能技术如何发展,动之以情、导之以行的教育始终是育人的根基。因此,坦然面对人工智能技术“有计算而无算计、有智能而无智慧、有感知而无认知”的现实,以及“技术服务于人”的理性认知,是突围教育人工智能价值风险的关键。

(四)滥用智能技术导致教育治理的伦理风险

人类总会对技术的进步勾勒善意的幻想。然则,人是伦理性的存在,其价值取向或精神观念无疑将受到技术伦理风险的规约。其一,技术服务的异化以及数据隐私的泄露,正在侵蚀学习者的幸福感[27]。比如,赋思头环所导致的信息泄露、学习证据的标签化、异质数据的杂糅化……可以说,教育人工智能正在通过程序和规则构建一所福柯式“全景式监狱”,释放出诸多“现代性信任风险”[28]。正如德雷福斯所言:“人类理性和智能的独特性需要积聚智力、社会以及文化的熏陶,而这种独特性是很难被人工智能表征和程序化的。”[29]其二,学习者由于长期使用智能技术,很容易养成“技术心流”的陋习。所谓技术心流,即学习者过度迷恋技术交互而进入忘我的状态,甚至抗拒技术之外的任何事物感知[30]。也就是说,一旦学习者脱离技术牢笼,将会逃避同侪之间的合作交流,进而产生性情孤僻、情感疏离等不良症状。其三,在人工智能技术的倒逼下,教育内容具有更大的密度和吞吐量,这让学习者经常感到无所适从,且当教育内容愈发满足学习者的个性化需求时,同伴之间的竞争力将会明显弱化,这会阻碍学习者持续努力的信念与动力。

三、审思:风险形态的内生机理

人工智能技术拥有变革教育的伟力,但“技术之于教育”的自反性力量消弭了人的主动性和生长性。正如著名风险社会学家乌尔里希·贝克所言:“技术宛如达摩克利斯之剑,应用进程中必将面临随时坠落的风险。”[31]无论是智能教育裹挟下的何种风险,实则正是技术风险范式的现实映射。因此,从根源上透析风险背后的复杂机理,助力智能教育的理性蜕变。

(一)过度掩盖技术应用的内生复杂性机理

教育生态是一个不以人的意志为转移的内生复杂系统。当人工智能技术介入教育生态系统时,教育边界被打开,性质迥异的要素和行为耦合在一起,冲突、协同、吞噬、更新等现象纷纷涌现,教育系统也更加错综复杂[32]。正如技术风险范式所证实,一旦教育工作者无法掌控教育生态系统时,其复杂性要素将以风险形式释放出来。具体来说,人工智能教育应用的内生与外源制约着风险产生的情境和场域,也决定着风险发生的频率以及现实条件(如图2所示)。从内源风险来看,人工智能教育的不确定性、不可知性、非线性以及局限性扩大了风险发生场域。从外源风险来看,由于尚未厘清技术介入教育生态的基础机制、普遍性规律以及特殊情境,使得原本复杂的生态系统衍生出更多新的风险,并将特殊化的内生风险转化为普遍风险。显然,这种因技术交互所引发的外源风险、内生风险以及与教育生态系统本身的复杂性耦合,加之饱受理性异化、认知冲突、监管失范和利益驱动等“多重陷阱”的烦恼和诟病,加剧了人工智能教育风险发生的可能,进而影响教育风险的监控与治理进程。

(二)盲目弱化技术重塑教育的脆弱性机理

脆弱性作为教育生态系统内生属性的客观存在,是技术变革教育所呈现的不强韧状态。人工智能教育应用遵循“起步→应用→融合→创新”的变革路径,虽不断尝试在教育创新方面作出改革,但由于技术的脆弱性具有强大的潜在性或隐蔽性,只有当风险发生时才会涌现出来。依据技术风险范式的意涵可知,技术本身的脆弱性将会滋生教育生态的负向效应(如图3所示)。首先是动机性,动机是行为意向的发端和持续方向,由于教育生态系统的复杂性表征和模糊边界转换加大了动机权重赋值的难度,迫使人工智能计算陷入尴尬局面。其次是常识,它是时间、空间和文化熏陶的经验产物,包括大量技术规约。但由于人工智能技术无法自主产生常识这一脆弱性,成为滞缓技术与教育生态深度融合的“绊脚石”。最后是决策,由于智能决策与人类决策之间存在天然的鸿沟,如何让智能系统如同人脑一般,采用更加综合化、智能化的行动干预,这是突围教育人工智能走向人机协同、群智开放、跨界融合的关键。显然,人工智能教育系统中脆弱性的存在无疑会放大教师、学习者和资源之间的不良互动,一旦发生较小“扰动”时,教育生态系统就会将“扰动”放大甚至变异[33]。但是,这并不意味着应该排斥技术应用的脆弱性,相反,高度警醒技术的脆弱性机理,掌握其变化规律和发生机制,是管控人工智能教育风险的科学方法。

(三)高度忽视教育生态的测不准性机理

人工智能在教育中的应用是一个动态演化过程,其风险发生机制和作用过程通常无法预测。比如,这些风险形态源于何种场域,其风险扩散路径和机制又是如何?这恰是技术风险理论“测不准性”的直观表现。测不准性表明教育系统的主观意识与其客观存在具有一定差距,只有当教育系统处于动态平衡或脱离“扰动”的影响时,才能够正确刻画和精准预测人工智能教育应用的发展情势。在此情境下,我们需要高度重视教育生态的整体性和完备性,即不仅透视人工智能教育应用的潜在风险和发生过程,也亟须关注“风险为何发生”以及“为何如此认知”等问题。层次分析法(Analytic Hierarchy Process,简称AHP)是监控与治理技术应用成效的典型工具[34]。具体地,可将人工智能技术介入教育生态分为三个层次:目标层、准则层以及方案层。其中,目标层是风险治理的科学方法与适应性路径。准则层是对风险原点、风险场域以及风险过程的具体探索,把控风险成因的背后机理以及内生规律。方案层是具体的治理措施,即从风险认知、监控过程、作用机制等层面提供系统的应对方案。

四、突围:风险治理的应对之策

科学管控智能技术风险,提升技术赋能教育生态的实效性,其根本出路在于共创复杂性治理范式,揭示教育生态的内生规律;关键在于厘清多元主体协同的机制,提升教育生态的抗逆基因;最终落脚点在于构建多元创新方法论,适应教育生态的动态平衡。

(一)共创复杂性治理范式,揭示教育生态的内生规律

技术对人的奴役实质上是教育愿景无限扩张的体现,正如恩格斯所言:“人有限的认识能力往往给技术应用的长期目标埋下潜在威胁。”[35]若要实现对技术的驯服,必须厘清人工智能教育风险的本质、风险演化的内生规律以及博弈机制。尽管脑科学、心理学、教育神经科学等领域针对教育风险管控已经沉淀了些许可靠结论。但是,由于人工智能介入教育生态的复杂性和动态性,带有“经验色彩”的举措始终无法灵活地应对人工智能教育风险。因此,构建复杂性治理范式以揭示教育生态的内生规律,是突围人工智能教育风险的根本出路。

所谓范式,即科学共同体信念、价值以及方法的扬弃与组合[36]。复杂性范式则脱离二元线性的“简单思维”,强调通过动态的、非线性的思维方式,平等关注技术与人性、理性与非理性、机制与规律等内生机理[37]。也就是说,复杂性范式的理性洞见突围了技术外力主导的路径依赖,为监控教育生态的异质性、演化性和涌现性等提供了安全屏障。一方面,强调风险治理的“管”,即需要多元主体自觉形塑基于证据的科学精神,不仅是风险识别、分析、评估、处理、监控和审查等过程需要基于证据,同样技术介入教育系统的问题诊断、策略选择以及效果评估等进程也需符合科学的证据线索。另一方面,强调风险治理的“控”,即基于问题的求真精神,确保编写算法时不引入性别、种族、经济能力、技术文化等偏好。比如,可通过元分析或实验研究法识别风险形态并筛选出关键要素,或是通过大规模实验探索风险发生的作用机制。总之,运用复杂性范式形塑人工智能教育生态的科学与透明化,依据内生规律脱离风险场域的“囚徒困境”,致力于技术与教育生态的和谐共生以及深度融合。

(二)厘清主体的协同机制,提升教育生态的抗逆基因

技术与教育都是“人”的所有物,两者在依附对象上是一体化的存在,这也决定了技术与教育是互惠共生的关系。然而,由于人工智能技术在教育实践中往往充斥着技术算计、算法偏见、信息茧房等离心现象,加之原本教育生态的脆弱性,加剧了人工智能教育风险的“涌现效应”。正如马克斯·霍克海默等所言:“技术最终实现了‘负催化剂的夙愿。”[38]因此,治理人工智能教育的潜在风险,关键在于厘清多元主体协同机制,提升教育生态的抗逆基因。同时,需要强调的是,管理者、研究者以及教育实践者等多元主体需要采用指数思维以及协同创新的交互模式[39],预测技术融入教育生态的临界点,基于理性的系统思维勾勒人工智能教育生态的发展愿景,维持技术与教育的动态平衡与良性互构。

对于管理者来说,人工智能教育风险管控智慧源于对风险规律的理性认识和科学把控,当教育生态面临具有风险性、波动性、不透明性的因素时,必须切实完备地探索教育风险的作用机制和内生规律。换言之,科学可行的管控措施有助于增强教育生态系统的抗脆弱性。一方面,应详尽分析人工智能教育应用的真实情况,对现存的、潜在的风险进行预判并归类。另一方面,合理调适“人—技术—环境”三者之间的依存与联结,尝试激活彼此之间的主观能动性,增强教育生态抗脆弱的生命力。比如,圣母大学商业智能项目通过雇佣数据治理管家,协调多元主体的数据共识,建立了利益相关者的数据权限规约以及数据流通机制。对于研究者来说,需要解答人工智能教育风险的本质规律以及作用机理。这个问题一方面需要研究者以重复性实验梳理人工智能教育风险的一般类型和内生规律,另一方面也需要研究者采用小规模实验针对性地解答特殊风险。比如,佐治亚大学采用数据分析工具GPS(Graduation Progression Success)探索动态数据的变化规律以及发生机理,同时结合学习风格和兴趣偏好,帮助学习者建立学习预警系统以及反馈机制。对于教学实践者来说,需要充分利用自身的教育敏感性和实践智慧等优势,不断提升人工智能教育生态脆弱性的认知,努力将风险意识内化为应对行为,突围技术所引发的教师角色“脱嵌”与“消匿”等危机。

(三)构建多元创新方法论,适应教育生态的动态平衡

人工智能加剧了教育生态的“测不准性”,一旦技术方法无法洞见或表征过去、现在以及未来的深刻变化时,将会失去数据赋能以及科学预见的功效[40]。因此,构建适应教育生态平衡的复杂方法论,反思技术驱动的合理性与创新性,弥合技术与教育深度融合的沟壑,缩小理论与现实之间的差距,这是治理人工智能教育风险的落脚点。需要强调的是,尽管人工智能技术介入教育生态的侧重方向不一致,但有关风险治理路径却存在若干共同法则。

首先,建立真实透明的方法论体系,涵盖人工智能算法偏好、学习者文化表征与内在价值,以及人工智能技术“包容性”“公平性”“鲁棒性”“可解释性”等规约,保障规模化教育数据挖掘和诊断进程的科学性。例如,有学者基于“相关利益者的跨领域协作→兼顾群体的一般性和特殊性→识别风险作用机理→增加公众评议”等过程弱化了技术算法偏见[41]。也有学者尝试采用弱信号、场景构建等未来方法论洞察教育发展范式。其次,架构局部与整体相统一的方法论体系,即确保方法论与风险治理的逻辑自洽,使其在“时间—过程—空间”一致性链条中审查风险源及其变化规律。教育社会实验研究法是一种局部通向整体的科学范式,通过循证手段、证据表征、背景分析和表达传递等过程[42],直面教育生态风险非线性、不确定性、不可知等因素,努力平衡现實与可能、实然与应然之间的鸿沟。最后,强调方法论的复杂性系统思维。其一,注重教育生态的联动性、开放性与系统性,将风险结构、发生机制和变化规律等模块化或结构化,有序演化人工智能教育风险的变化轨迹,这也符合贝塔朗菲“整体之和大于部分之和”的观点。其二,强调风险演化的协同性和因果性,理性辩证地看待风险要素、序参量以及环境之间的非线性机制、上向和下向因果作用。其三,关注适应的、生成的突现性思维,即不仅从要素或系统的可能状态把控风险的生成过程,同时也应充分考量“剩余风险”或“缄默风险”的客观存在,预测以及治理突现性风险的侵袭。

五、结 语

尽管人工智能教育应用的热情与野心日趋强烈,但要时刻警醒技术始终无法还原教育世界的面目。唯有坚守教育的育人初心,打造人与技术和谐共生的教育生态体系,才能从根本上发挥人工智能技术赋能教育的作用。因此,理性看待技术应用的价值与限度,主动建立风险意识和担当意识,紧扣风险发生的内生规律与作用机制,持续推动教育人工智能的健康发展。同时,建立公正透明的风险反馈与预警机制,形塑信仰同一的权力共同体。未来,如何应用人工智能技术提供个性化的学习支持、如何应用人工智能技术提高教学效率和质量、如何应用人工智能技术开展精准化的教育决策与干预等应是人工智能教育生态研究的重点。

[参考文献]

[1] 卡尔·波普尔. 推想与反驳[M]. 傅季重,纪树立,周昌忠,蒋弋为,译. 杭州:中国美术学院出版社,2010:39.

[2] 维克托·迈尔·舍恩伯格,肯尼斯·库克耶. 大数据时代:生活、工作与思维的大变革[M]. 盛杨燕,周涛,译. 杭州:浙江人民出版社,2013:105.

[3] 安涛.“算计”与“解蔽”:人工智能教育应用的本质与价值批判[J].现代远程教育研究,2020,32(6):9-15.

[4] 李芒,张华阳.对人工智能在教育中应用的批判与主张[J].电化教育研究,2020,41(3):29-39.

[5] JIM C K, CHANG H C. The current state of data governance in higher education[J]. Proceedings of the association for information science and technology, 2018, 55(1):198-206.

[6] WILLIAMSON B. Digital education governance: data visualization, predictive analytics, and "real-time" policy instruments[J]. Journal of education policy, 2016, 31(2):123-141.

[7] 鄧国民,李梅.教育人工智能伦理问题与伦理原则探讨[J].电化教育研究,2020,41(6):39-45.

[8] MAYNE A J. The social control of technology[J]. Journal of the operational research society, 1982, 33(8):771-772.

[9] 徐英瑾.虚拟现实:比人工智能更深层次的纠结[J].人民论坛·学术前沿,2016(24):8-26.

[10] MELVIN K. Technology and history: "kranzberg's laws"[J]. Bulletin of science, technology & society, 1995, 15(1):5-13.

[11] 李栋.人工智能时代的教师发展:特质定位与行动哲学[J].电化教育研究,2020,41(12):5-11.

[12] 徐振国,张冠文,孟祥增,党同桐,孔玺.基于深度学习的学习者情感识别与应用[J].电化教育研究,2019,40(2):87-94.

[13] 王慧. 基于人脸识别的智能教育管理平台的设计与实现[D].北京:北京交通大学,2019:18-41.

[14] 洪传旺. 基于Spring Cloud的“微课堂”知识考核系统的设计与实现[D].南京:南京大学,2019:49-69.

[15] STEENBERGEN H S, COOPER H. A meta-analysis of the effectiveness of intelligent tutoring systems on K-12 students' mathematical learning[J]. Journal of educational psychology, 2013, 105(4):970-987.

[16] CHANG H Y, HSU Y S, WU H K. A comparison study of augmented reality versus interactive simulation technology to support student learning of a socio-scientific issue[J]. Interactive learning environments, 2014, 24(6):1148-1161.

[17] LIN H C K, CHEN M C, CHANG C K. Assessing the effectiveness of learning solid geometry by using an augmented reality-assisted learning system[J]. Interactive learning environments, 2013, 23(6):799-810.

[18] 金生鈜.大数据教育测评的规训隐忧——对教育工具化的哲学审视[J].教育研究,2019,40(8):33-41.

[19] BIESTA G. Good education in the age of measurement—ethics, politics, democracy[M]. London: Routledge, 2016: 26.

[20] 习近平.确保人工智能关键核心技术牢牢掌握在自己手里[N].人民日报 (海外版),2018-11-01.

[21] BURTON E, GOLDSMITH J, KOENIG S, KUIPERS B, MATTEI N, WALSH T. Ethical considerations in artificial intelligence courses[J]. AI magazine, 2017, 38(2):22-34.

[22] 顧明远.教育大辞典(上卷)[M].上海:上海教育出版社,1990: 726.

[23] 赫尔巴特.普通教育学[M].李其龙,译.南京:江苏教育出版社,1990: 6.

[24] 德克劳斯·施瓦布. 第四次工业革命——转型的力量[M].林毅夫,姜建清,董明珠,等译.北京:中信出版社,2016: 104.

[25] 高德胜.论标准化对教育公平的伤害[J].教育科学研究,2019(2):5-12.

[26] 宋灵青,许林.“AI”时代未来教师专业发展途径探究[J].中国电化教育,2018(7):73-80.

[27] 张治.教育信息化——走进自适应学习时代[M].上海:上海教育出版社,2018: 2.

[28] 安东尼·吉登斯.现代性的后果[M].田禾,译.南京:译林出版社,2011: 27.

[29] 徐献军.德雷福斯对人工智能的批判仍然成立吗?[J].自然辩证法研究,2019,35(1):15-20.

[30] CSIKSZENTMIHALYI M. The psychology of optimal experience[M]. New York: Harper Collins, 1990: 76.

[31] 乌尔里希·贝克.风险社会[M].何博闻,译.南京:译林出版社,2004:5.

[32] 阿兰·柯林斯,理查德·哈尔弗森.技术时代重新思考教育[M].陈家刚,程佳铭,译.上海:华东师范大学出版社,2013:109.

[33] WOOLF B P, LANE H C, CHAUDHRI V K, KOLODNER J L. AI grand challenges for education[J]. AI magazine, 2013, 34(4):66-84.

[34] 张炳江.层次分析法及其应用案例[M].北京:电子工业出版社,2014:30-61.

[35] 许良.劳动、技术与人类解放——恩格斯技术哲学思想探析[J].自然辩证法研究,2006(4):45-47,60.

[36] 托马斯·库恩.科学革命的结构[M].金吾伦,胡新和,译.北京:北京大学出版社,2003:11.

[37] 刘佳.复杂性范式:混合方法研究的哲学立场[J].自然辩证法通讯,2015,37(6):85-91.

[38] 马克斯·霍克海默,西奥多·阿道尔诺.启蒙辩证法[M].渠敬东,曹卫东,译.上海:上海人民出版社,2003:27.

[39] 祝智庭,俞建慧,韩中美,黄昌勤.以指数思维引领智慧教育创新发展[J].电化教育研究,2019,40(1):5-16,32.

[40] 蔡中宏.教育与社会发展研究——基于文化和人的视角[M].北京:中国社会科学出版社,2013:12-20.

[41] KUSNER M J, LOFTUS J R. The long road to fairer algorithms[J]. Nature: international weekly journal of science, 2020, 578 (7793):34-36.

[42] 黄荣怀,王欢欢,张慕华,等.面向智能时代的教育社会实验研究[J].电化教育研究,2020,41(10):5-14.