基于生成对抗网络的抗阴影树木检测方法

2021-09-02沈冰雁沈毓琦

叶 阳,沈冰雁,沈毓琦

·农业信息与电气技术·

基于生成对抗网络的抗阴影树木检测方法

叶 阳,沈冰雁,沈毓琦

(浙江工业大学计算机科学与技术学院,杭州 310023)

森林遥感影像数据在采集过程中会因为光照的影响产生阴影区域,为了解决这些阴影区域对单棵树木检测的干扰问题,该研究在快速区域卷积神经网络(Faster Region Convolutional Neural Networks,Faster RCNN)目标检测框架基础上,提出基于生成对抗网络的抗阴影树木检测方法(Generative Adversarial Based Faster Region Convolutional Neural Networks,GA-Faster RCNN),通过采用基于对抗生成策略的树木生成器,提高分类网络对树木信息的敏感度,降低阴影的干扰。该研究对3块树木阴影与郁闭度各不相同的测试样地高分遥感影像进行了树木检测试验,并与现存的3种算法进行了对比。结果显示,基于生成对抗网络的抗阴影干扰树木检测方法在3块样地的综合性能指标1值分别达到了78.4%、91.6%和81.7%,均高于另外3种算法,并且树木识别准确率比现有方法有了明显的提高,漏检数和误检数也均明显减少。此外,在采用不同特征提取网络时该算法依然能保持其检测的稳定性。研究结果表明通过对抗生成训练策略学习表征树木的最少特征信息可有效降低阴影对树木检测的干扰。

遥感;算法;树木;检测;影像;阴影干扰;深度学习

0 引 言

森林资源是国家建设可持续发展经济和生态文明中不可缺少的重要物质资源。而中国森林资源数量较少,森林覆盖率低[1],所以亟待采取科学高效的森林资源管理手段来有效平衡开发与保护森林资源。此外,随着生态无人农场的兴起,高分遥感技术也可以应用到农场中种植的果树、苗木等经济作物的检测和管理中[2-4],有助于实现绿色生态农业生产的精准化种植和可视化管理。

近年来,国内外的研究人员提出了一些基于遥感影像的单棵树木检测方法。传统树木检测算法[5-8]一般采用数字图像处理方法,例如局部最大值结合区域生长法、分水岭方法、模板匹配法等。Novotný等[9]基于区域生长方法,提出了采用可变窗口大小的局部最大值法提取种子点。郭昱杉等[10]利用面向对象的方法分类林地和非林地,并以林地为掩模提取树冠的分布范围,最后再基于标记控制分水岭分割方法对不同疏密林区进行树冠提取。Malek[11]等基于模板匹配方法,使用尺度不变特征变换(Scale Invariant Feature Transform,SIFT)算法提取棕榈树的关键点特征,并经过极限学习机(Extreme Learning Machine,ELM)学习分类达到检测目的。

点云(Lidar)数据作为遥感数据的一种,不少研究也基于该数据提出了相应的树木检测算法[12-15]。这些算法一般不直接使用点云数据,而是在由点云数据转换为栅格化图像的基础上实现树木检测。因为点云数据是通过使用激光直接获得的,所以一般不会受到阴影干扰。

从2012年以来,深度学习中的卷积神经网络在计算机视觉中的目标检测领域被广泛使用,且取得了巨大进步,也促使相关学者将卷积神经网络应用到遥感影像的单棵树木检测中[16-20]。卷积神经网络可以有效降低传统树木检测方法中采用手动选取种子点,或者专家先验知识指定参数等造成的鲁棒性低的问题。卷积神经网络不依赖手工选择特征,而是通过海量影像数据,按照设定的标签自动地学习相关特征,将图像的低维纹理颜色特征抽象为高维语义特征,具有良好的分类性能。Li等[21]提出了基于卷积神经网络的马来西亚油棕榈树检测算法,并正确识别出96%的样本。Guirado等[22]基于卷积神经网络,以Google Earth影像作为数据实现了灌木检测。Culman等[23]基于卷积神经网络,提出了从高分辨率RGB图像中对单棵棕榈树进行定位和分类的检测方法。

在通用目标检测领域也有一些基于卷积神经网络的算法,例如快速区域卷积神经网络(Faster Region Convolutional Neural Networks,Faster RCNN)[24]和统一定位与分类的实时检测器(You Only Look Once,YOLO)[25]等,但是这些方法的检测结果经常会受到遥感影像中的光照、阴影等因素影响。例如在遥感图像中,树木或山脉等会遮挡住光线从而造成一些阴影区域,这些阴影区域不仅会让树木的图像特征严重退化失真,还会产生大量的噪声,使得现有的树木检测方法受阴影干扰难以获得令人满意的检测效果。在面对有阴影干扰的高噪音影像时,这些方法需要在训练阶段大批量标定受到阴影干扰的树木,并且在缺少优质标定数据的情况下非常容易出现误识别和漏识别,进而造成检测精度低的问题。

目前基于遥感影像的树木检测方法中没有特别针对阴影进行处理的抗阴影检测方法,常见的树木检测方法中处理阴影的方式都是先检测出阴影,去除后再检测树木。而现有的阴影检测算法[26-27]主要针对多通道的遥感影像进行处理,将其应用在三通道影像数据的树木检测中具有局限性,应用范围有限。另外,这些处理算法通常存在大量需要手工调整的参数,自动化程度难以提高。

现有的数据集中存在的阴影样本较少,从训练角度难以提升树木检测器对阴影的抗干扰效果,本文借鉴Wang等[28]为解决数据集无法涵盖所有的变形与遮挡情况,使用对抗生成网络生成形变与遮挡的对抗样本的思路,提出了一种基于生成对抗网络的抗阴影树木检测方法(Generative Adversarial Based Faster Region Convolutional Neural Networks,GA-Faster RCNN)。该方法从待检测树木的局部特征出发,通过引入对抗生成策略构建树木生成器,保留区域提议网络(Region Proposal Network,RPN)提取特征图中的树木特征信息,削弱阴影等背景特征信息的干扰,强化网络分类器对树木特征的敏感度,最终达到提高树木检测精度的目标。

1 算法结构及训练

基于生成对抗网络的抗阴影树木检测方法首先引入一个树木生成器,该生成器采取对抗生成训练的策略来学习表征树木的最少特征信息,然后利用这些特征信息来训练分类网络,增强网络对树木特征的敏感性,降低阴影干扰对网络的影响,从而提升算法的检测能力。

1.1 总体流程

基于生成对抗网络的抗阴影树木检测方法总体流程如图1所示,具体步骤包括数据采集与标记,树木生成器训练,网络的端到端训练和最后的树木检测。

1)数据的采集和标记:本文选取Google Earth上位于美国佛罗里达州和阿肯色州的30块样地作为训练集以及9块样地作为测试集,这些样地兼顾各种类型的树木种类和阴影量。在30块训练样地中标记4 000余棵参考树,而在9块测试样地中,标记1 200余棵参考树。其中30块训练样地和9块测试样地被分为3类,即树木树冠清晰且树木阴影干扰较少、树木郁闭度中等且有部分树木阴影干扰和树木郁闭度较大且树木阴影干扰严重。

2)树木生成器训练:生成器通过产生不同的黑色掩膜来模拟树木在阳光下生成的阴影以及其他较高树木对该树木的遮挡,之后将这些生成的树木影像交由判别器识别,直至产生一个最佳的树木生成器。

3)网络的端到端训练:将训练好的生成器加入到整个检测网络中,通过对整个网络进行端到端的训练,让整体网络的参数迭代优化,直至获得一个最佳的抗阴影树木检测模型。

4)树木检测:将测试样地的影像数据放入基于生成对抗网络的抗阴影树木检测模型,返回树木检测信息。

1.2 网络设计

基于生成对抗网络的抗阴影树木检测网络由一个Faster RCNN网络和树木生成器组成,其网络结构设计如图2所示。Faster RCNN网络负责主要特征提取和检测任务,但由于数据中存在阴影,所以在RPN网络获得的感兴趣区域(Region of Interest,ROI)中阴影干扰严重,使得传递给检测网络的树木特征表征不明显,从而影响后续识别。

本文引入树木生成器,它共享Faster RCNN的卷积层和ROI池化层,连接在Faster RCNN的RPN网络之后,再连接两个单独的全连接层,然后连接一个分类网络。树木生成器能将ROI区域进行删减修改,保留最少的表示树木特征的信息,减少阴影干扰问题。该生成器需要先单独训练,通过训练后,将训练后的树木生成器放入到Faster RCNN网络中,锁定其参数后再进行端到端训练,进一步提高Faster RCNN网络的树木识别能力。

1.3 树木生成器训练

进行树木生成器训练前,首先要训练一个具有识别能力的分类器。本文使用从30块训练样地中采集的1 000棵参考树正样本和1 000个背景负样本,共2 000个训练样本训练该分类器。分类器的目标函数为

在训练完分类器后,使用该分类器获得一些用于树木生成器训练的正样本。由于树木生成器的目的是获取最少表征树木的特征信息,增强总体网络对树木的表征分辨能力,所以在训练该树木生成器时,需要确定表征树木的最少特征是多少。在这里,本文将阴影作为树木检测过程中的遮挡问题进行处理,也就是树木特征的流失。通过对树木图像添加掩模的方式,模拟因阴影等光照因素对树木特征产生的干扰,即模拟一些树木信息丢失的过程。具体的操作如图3所示。

在确定目标函数后,本文首先训练没有树木生成器的Faster RCNN检测器进行10 000次迭代,再通过固定检测器中的所有层来交替训练生成器和判别器,直至将生成器的生成数据拟合到真实数据的概率分布上。树木生成器训练时的学习率为0.001,学习率的权重衰减为10-4,训练60 000轮次。训练结束后获得的树木生成器用于生成原检测网络难以检测的对抗样本,该生成器生成的信息在因阴影造成的信息丢失后仍能表征树木特征。

1.4 端到端训练

在树木生成器训练结束后,就可以将该网络整合进基于生成对抗网络的抗阴影树木检测网络中进行端到端训练。树木生成器位于RPN网络之后,可以直接接受RPN网络返回的ROI数据,无需映射回原图再做特征提取,大大减少了网络训练的计算量。

在选取由RPN网络生成的ROI放入树木生成器生成处理数据的步骤中,本文只选取与正样本之间的交并比(Intersection over Union,IOU)超过50%的ROI中的1/4区域,这么做是因为树木生成器生成的数据质量高低取决于传入的数据包含真实样本像素数量的多少。真实样本的像素数量越高,生成的样本质量也越高。而选取IOU超过50%的区域则意味着该ROI区域包含正样本的像素数量比较多,其包含用以表征树木信息的特征也比较完整,也就能在训练中提高分类器的分类性能。此外,随机选取25%的样本,而不是将全部样本进行处理,目的是为了减少网络计算量;而所有样本都经处理后,信息丢失过于严重,反而不利于提高分类器的分类性能。其执行过程如图4所示。

在第一次树木生成器训练后,保存并锁定该网络的状态参数,放入第二次训练中,端到端训练时的学习率为0.002,学习率的权重衰减为10-4,训练轮次为60 000。完整训练一次的时间在3 h左右。

本文提出的抗阴影树木检测算法在Pytorch框架上实现,运行的系统环境为AMD Ryzen R9 3900X CPU,图形处理器(Graphic Processing Unit,GPU)为NVIDIA GeForce RTX 2080 Super。

2 案例分析

2.1 试验区域

由于传统遥感数据保密性强、获取复杂且价格昂贵,本文使用了相对容易获取的Google Earth影像数据。本文总共筛选了3个测试区域,它们位于美国佛罗里达州和阿肯色州。3块试验样地都是自然环境下的森林场景,包含大量树木的同时也有阴影的干扰。其中试验样地一中有大量树木阴影,且树木的郁闭度很高,单棵树木检测难度较高;试验样地二包含树木阴影较少的同时树木的郁闭度也不高,单棵树木之间的分界较为清晰,因此单棵树木检测的难度相对较低;试验样地三中包含的树木阴影和树木的郁闭度介于样地一和样地二之间,树木有紧密相连的,也有间距较大的;既有被少量阴影干扰的树木,也有被大块阴影干扰的树木。添加该样地作为测试样地,有助于研究算法在各个场景下的性能表现。图5显示了3个试验样地及其阴影区域。

2.2 评价指标

本文试验的数据均来自Google Earth,由于缺少实测参考数据,本文采用目视结果进行精度评价。很多文献中都有使用目视解释结果作为精度评价指标的方法。Gougeon等[29]通过多人多次目视解释判断遥感影像中的单棵树木的位置信息,统计树木的总数。Erikson[30-31]等也使用目视解释方式获取参考数据。本文根据识别框和目视解释获得的参考树木标记框之间的重叠程度来判断识别结果是否属于分类正确(True Positive,TP)、分类错误(False Positive,FP;False Negative,FN)。分类结果及其依据如下所示:

1)准确识别结果:算法得到的单树识别框与目视解释获得的标记框重叠的区域超过50%,记该单树识别框为准确识别结果,计入TP。

2)错误识别结果:算法得到的单树识别框与目视解释获得的标记框重叠的区域少于50%,记该单树识别框为错误识别结果,计入FP。

3)遗漏识别结果:目视解释获得的标记框与任一单树识别框都没有超过50%的重叠,则该目视解释的标记框为遗漏识别结果,计入FN。

本文采用用户精度UA、生产者精度PA和1[32]这3个定量的评价指标作为树木检测的精度评价指标,其计算公式如下

1引入自统计学评价方法,是用以平衡PA和UA两者的结果,其计算公式如下

为了探讨掩模对树木识别的影响,本文对阴影误识别率进行分析。采用人工目视解释统计算法结果FP中包含的阴影区域数量,并计算该值在所有检出树木中的百分比,阴影误识别率SR计算公式可以表示为

2.3 与其他方法对比

为了验证本文提出的算法能有效解决阴影干扰下的树木检测问题,与其他方法进行了对比。对比方法包括区域生长法(Region-Growing)[9]、递进式级联卷积神经网络(Progressive Cascaded CNN)[33]和Faster RCNN[24]。

由于不同场景下树木的形态大小不等,所以要对不同测试样地设置不同的滑动窗口参数。对于3块样地,本文对区域生长方法和递进式级联卷积神经网络设置了不同的滑动窗口参数。参考Dong等[33]对区域生长方法参数的设置,将区域生长方法在样地一、样地二和样地三的滑动窗口参数分别设置为3、5和2;递进式级联卷积神经网络通过尺寸为3,步长为2的滑动窗口生成不同尺寸的预设检测框,在3块样地设置的预设检测框尺寸分别为32、34和32。Faster RCNN则在3块样地都采用默认的预设检测框。另外,Faster RCNN和递进式级联卷积神经网络都使用了现有的模型,即加载了PyTorch上提供的官方模型权重,不需要再进行其他人为设定。

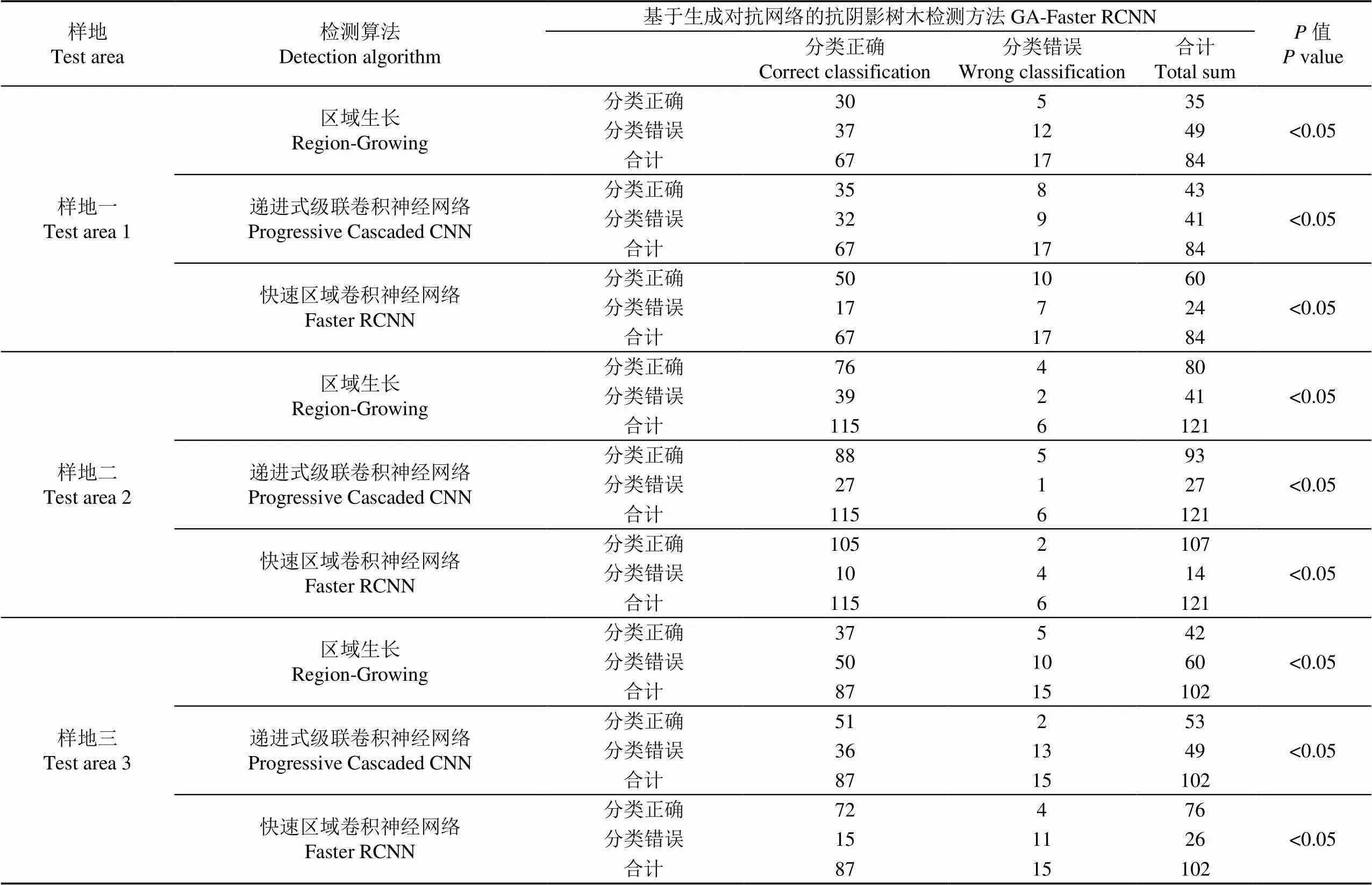

另外,本文还对试验结果进行了显著性分析排除试验误差等因素的干扰,以验证提出的算法与其他方法具有统计学上的差异,从而更好地表明本文提出的方法具有更好的性能。在该研究中,样本不是独立的。因此,两两之间是否存在统计学意义上的差异可以通过McNemar检验证明[34]。这是一个基于2×2混淆矩阵的非参数测试。McNemar的测试基于标准化的正常测试统计

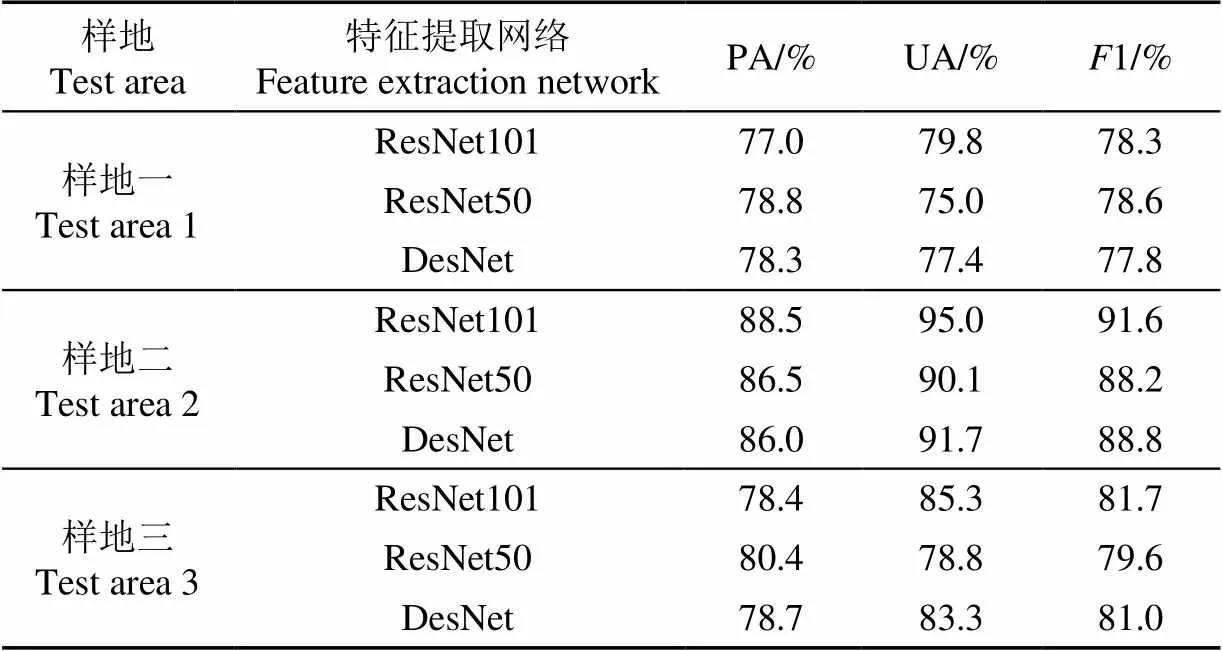

2.4 不同特征提取网络对算法的影响

在基于深度学习的图像算法中,不同特征提取网络对于整体网络的性能会产生较大的影响。为了验证本文提出的抗阴影树木检测算法在使用不同的特征提取网络的情况下,依然能有较好的稳定性和性能,通过修改算法结构中的特征提取网络,将其分别替换为ResNet101、ResNet50和DenseNet来测试算法的结果。

3 结果与分析

图6显示了样地一、二和三使用不同方法得到的树木检测结果。图中蓝色矩形框表示检测成功的树木;红色框是树木的误识别结果,即将其他对象检测为树木;绿色框表示算法漏识别的树木。

3.1 与其他方法对比结果与分析

结合图6a和表1可以看到,在样地一中,区域生长方法的漏检和误检是最多的,识别准确率(生产者精度)也最低,主要原因是它无法有效规避大量阴影的干扰,选取了很多错误的种子点,导致识别准确率较低;递进式级联卷积神经网络的漏检和误检也很多,用户精度和生产精度也不高,这是因为需要通过一个滑动窗口遍历整个图像获得采样样本,经过特征提取后交由分类网络分类识别。而在样地一中,树木郁闭度较高且有相当多的阴影干扰,在前期获得的训练样本不足以覆盖所有阴影干扰的树木种类,所以导致很多树木的特征提取结果与模型不符合;而Faster RCNN和GA-Faster RCNN中ROI区域由RPN网络提出,对检测树木的特征感知能力更强,漏检和误检相对前两种方法明显降低,并且由于GA-Faster RCNN采用了树木生成器进行优化训练,所以对树木的分类能力更强,漏检数量也最少,PA、UA和1值在四个方法中均为最高,分别达到了77.0%,79.8%和78.4%,比第二高的Faster RCNN分别高了2.2,8.4和5.7个百分点。

在样地二中(图6b,表2),可以看到4种方法的检测结果都比在样地一中的有了明显提高,漏检数和误检数也都明显下降。这是因为在样地二树木的郁闭度较低,树木树冠纹理清晰,阴影干扰也不明显。在该样地中,由于递进式级联卷积神经网络通个滑动窗口获得要分类的样本,但其大小无法覆盖所有大小的树木,因此对一些较大的树木样本检测结果较差。对于Faster RCNN,因为缺少GA-Faster RCNN中对树木特征的再提取过程,所以对于阴影干扰的排除不明显,1值为83.9%,比GA-Faster RCNN 91.6%的1值低了7.7个百分点。综合来看,在该样地中各方法的1均比样地一高,但是GA-Faster RCNN仍然是效果最好的。

在样地三中(图6c,表1),区域生长34.0%的1值是最低的,漏检和误检问题十分严重,这表明区域生长方法受到阴影干扰等因素的影响较大,以至于检测效果不佳。类似于样地一,递进式级联卷积神经网络在树木郁闭度较高且有相当多的阴影干扰情况下,漏检和误检数相当多,仅优于区域生长方法,PA和UA也不高,仅为55.8%和52.0%。在Faster RCNN中,因为缺少GA-Faster RCNN中对树木特征的再提取过程,所以对于阴影干扰的排除仍不明显,所以比GA-Faster RCNN方法81.7%的1值低了5.3个百分点。

3块样地的综合检测结果中(表1),GA-Faster RCNN的PA和UA都较高,分别为82.0%和87.6%,1值也达到了84.7%,比性能第二的Faster RCNN高了6.2个百分点,在不同数量的树木阴影和不同树木郁闭度的干扰下,都有良好的检测效果,这对于树木的自动检测精度以及单棵树木的树冠信息等提取都有较好的促进作用。

表1 三块样地中采用不同方法的检测结果

注:TP是准确识别数,FP是错误识别数,FN是漏识别数,PA是生产者精度,UA用户精度,1是精确率和召回率的调和平均数。

Note: TP is True Positive, FP is False Positive, FN is False Negative, PA is Producer Accuracy, UA is User Accuracy, and1 is the harmonic average of precision and recall.

在显著性分析试验中,设定当<0.05时,两种方法所得结果有显著性差异。分别在3块测试样地,设GA-Faster RCNN所得到的结果和区域生长、递进式级联卷积神经网络和Faster RCNN所获得的结果在统计学上没有显著性差异,然后计算在该假设上的值,表2显示了GA-Faster RCNN与其他方法在3块样地检测结果上的显著性检验结果,所得的值均小于0.05,故原假设不成立,即它们之间的差异具有统计学意义。而在这3块样地上,GA-Faster RCNN具有最高的1值,所以可以认为本文提出的方法比另外3种方法更好。

表2 三块样地中采用不同方法的McNemar校验结果

为了探讨掩模对树木识别的影响,本文对GA-Faster RCNN的阴影误识别率,即将阴影区域误识别为树木的数量占所有检出树木数量的百分比,进行了分析,并与上文分析中除GA-Faster RCNN外表现最好的Faster RCNN进行了对比。由于样地一的光照影响严重,并且有大量的阴影区域干扰,对树木检测的影响较大,因此,本文选择样地一为试验对象。从表3可知,GA-Faster RCNN的阴影误识别率SR略高于Faster RCNN。这是由于GA-Faster RCNN将一些与树木外形相似、具有独立的形状的阴影区域识别为树木(图7)。尽管如此,由于树木生成器能够获取最少表征树木的特征信息,GA-Faster RCNN的生产者精度(识别准确率)和漏识别数量等指标均优于Faster RCNN(表3)。因此,综合来看,GA-Faster RCNN仍具有显著的优越性。

表3 样地一中采用不同方法的阴影误识别率结果

注:num是将阴影区域误识别为树木的数量,SR是阴影误识别率。

Note:numis the number of shadow areas misrecognized as trees, and SR is the misrecognition rate of shadows.

3.2 采用不同特征提取网络的算法结果分析

表4和图8是在样地一、样地二和样地三中GA-Faster RCNN分别采用不同的特征提取网络后得到的试验结果。从表4中可以看出采用ResNet101、ResNet50和DenseNet的GA-Faster RCNN的PA、UA以及1三个评价指标数值差异不大,证明本文提出的方法在使用不同的特征提取网络时依然能保持其检测的稳定性。

表4 三块样地中采用不同特征提取网络的检测结果

4 结 论

1)针对现有单树检测算法在复杂阴影条件下检测能力不足,无法很好应用到通用的树木检测场景中的问题,提出了基于生成对抗网络的抗阴影树木检测算法(Generative Adversarial Based Faster Region Convolutional Neural Networks,GA-Faster RCNN)。该算法通过加入一个能最小表征树木特征的树木生成器,通过将区域提议网络(Region Proposal Network,RPN)生成的感兴趣区域(Region of Interest,ROI)进行特征优化,提高检测器在树木阴影干扰下对树木的识别能力。

2)本文在Google Earth中选取了高分辨率遥感影像,通过标记训练区域和测试区域,将其应用到网络的训练中,同时选择了3块包含不同程度的阴影干扰的测试样地用以测试本文提出方法在不同阴影干扰下的性能。试验结果表明基于生成对抗网络的抗阴影树木检测算法在三块测试样地的1值均为最高,分别为78.4%、91.6%和81.7%,其平均1值为84.7%,比性能第二的Faster RCNN高了6.2个百分点,树木识别率相比现有方法有了明显的提高,另外,本文提出的方法在采用不同特征提取网络时依然能够保持树木检测的稳定性。

3)本文重点对GA-Faster RCNN中掩模对树木检测的影响进行了研究,结果表明虽然阴影区域被误识别为树木的数量占所有检出树木数量的百分比有所提升,但树木的识别准确率仍比其他方法高,漏识别的树木数量也远低于其他方法。未来研究中,可对与树木外形接近的阴影被误识别为树木的问题做进一步研究。

[1] 国家林业和草原局. 中国森林资源报告[M]. 北京:中国林业出版社,2019.

[2] 王维刚,史海滨,李仙岳,等. 遥感订正作物种植结构数据对提高灌区SWAT模型精度的影响[J]. 农业工程学报,2020,36(17):158-166.

Wang Weigang, Shi Haibin, Li Xianyue, et al. Effects of correcting crop planting structure data to improve simulation accuracy of SWAT model in irrigation district based on remote sensing[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(17): 158-166. (in Chinese with English abstract)

[3] 李宇宸,张军,薛宇飞,等. 基于Google Earth Engine的中老缅交界区橡胶林分布遥感提取[J]. 农业工程学报,2020,36(8):174-181.

Li Yuchen, Zhang Jun, Xue Yufei, et al. Remote sensing image extraction for rubber forest distribution in the border regions of China, Laos and Myanmar based on google earth engine platform[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(8): 174-181. (in Chinese with English abstract)

[4] 赵晋陵,金玉,叶回春,等. 基于无人机多光谱影像的槟榔黄化病遥感监测[J]. 农业工程学报,2020,36(8):54-61.

Zhao Jinling, Jin Yu, Ye Huichun, et al. Remote sensing monitoring of areca yellow leaf disease based on UAV multi-spectral images[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(8): 54-61. (in Chinese with English abstract)

[5] Hellesen T, Matikainen L. An object-based approach for mapping shrub and tree cover on grassland habitats by use of LiDAR and CIR orthoimages[J]. Remote Sensing, 2013, 5(2): 558-583.

[6] Yang L, Wu X, Praun E, et al. Tree detection from aerial imagery[C]//Proceedings of the 17th ACM SIGSPATIAL International Conference on Advances in Geographic Information Systems, Seattle, USA, 2009: 131-137.

[7] Pollock R J. The Automatic Recognition of Individual Trees in Aerial Images of Forests Based on a Synthetic Tree Crown Image Model[D]. Vancouver: The University of British Colombia, 1996: 172.

[8] Larsen M, Rudemo M. Optimizing templates for finding trees in aerial photographs[J]. Pattern Recognition Let, 1998, 19(12): 1153-1162.

[9] Novotný J, Hanuš J, Lukeš P, et al. Individual tree crowns delineation using local maxima approach and seeded region-growing technique[C]//Proceedings of Symposium GIS Ostrava, Ostrava, Czech Republic, 2011: 27-39.

[10] 郭昱杉,刘庆生,刘高焕,等. 基于标记控制分水岭分割方法的高分辨率遥感影像单木树冠提取[J]. 地球信息科学学报,2016,18(9):1259-1266.

Guo Yushan, Liu Qingsheng, Liu Gaohuan, et al. Individual tree crown extraction of high resolution image based on marker-controlled watershed segmentation method[J]. Journal of Geo-information Science, 2016, 18(9): 1259-1266. (in Chinese with English abstract)

[11] Malek S, Bazi Y, Alajlan N, et al. Efficient framework for palm tree detection in UAV images[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2014, 7(12): 4692-4703.

[12] Windrim L, Bryson M. Detection, segmentation, and model fitting of individual tree stems from airborne laser scanning of forests using deep learning[J]. Remote Sensing, 2020, 12(9): 1469.

[13] Dai W, Yang B, Dong Z, et al. A new method for 3D individual tree extraction using multispectral airborne LiDAR point clouds[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2018, 144: 400-411.

[14] Marinelli D, Paris C, Bruzzone L. An approach to tree detection based on the fusion of multitemporal LiDAR data[J]. IEEE Geoscience and Remote Sensing Letters, 2019, 16(11): 1771-1775.

[15] Marselis S M, Tang H, Armston J, et al. Exploring the relation between remotely sensed vertical canopy structure and tree species diversity in Gabon[J]. Environmental Research Letters, 2019, 14(9): 1748-9326.

[16] Sainath T N, Mohamed A, Kingsbury B, et al. Deep convolutional neural networks for LVCSR[C]//IEEE International Conference on Acoustics, Speech and Signal Processing, Vancouver, Canada, 2013: 8614-8618.

[17] Le Q V, Ranzato M A, Monga R, et al. Building high-level features using large scale unsupervised learning[C]//In Proceedings of the 2013 IEEE International Conference on Acoustics, Speech and Signal Processing, Vancouver, Canada, 2013: 8595–8598.

[18] Zhu X, Tuia D, Mou L, et al. Deep learning in remote sensing: a comprehensive review and list of resources[J]. IEEE Geoscience and Remote Sensing Magazine, 2017, 5(4): 8-36.

[19] Neupane B, Horanont T, Hung N D. Deep learning based banana plant detection and counting using high-resolution red-green-blue (RGB) images collected from unmanned aerial vehicle (UAV)[J]. PLoS ONE, 2019, 14(10): e0223906.

[20] Torres D L, Feitosa R Q, Happ P N, et al. Applying fully convolutional architectures for semantic segmentation of a single tree species in urban environment on high resolution UAV optical imagery[J]. Sensors, 2020, 20(2): 563.

[21] Li W, Fu H, Yu L, et al. Deep learning-based oil palm tree detection and counting for high-resolution remote sensing images[J]. Remote Sensing, 2016, 9(1): 22.

[22] Guirado E, Tabik S, Alcaraz-Segura D, et al. Deep-learning versus OBIA for scattered shrub detection with google earth imagery: ziziphus lotus as case study[J]. Remote Sensing, 2017, 9(12): 1220.

[23] Culman M, Delalieux S, Tricht K V. Individual palm tree detection using deep learning on RGB imagery to support tree inventory[J]. Remote Sensing, 2020, 12(21): 3476.

[24] Ren S, He K, Girshick R, et al. Faster RCNN: towards real-time object detection with region proposal networks[C]//Advances in Neural Information Processing System, Vancouver, BC, Canada, 2015: 91-99.

[25] Redmon J, Divvala S, Girshick R, et al. You only look once: unified, real-time object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas, USA, 2016: 779-788.

[26] Ding B, Long C, Zhang L, et al. ARGAN: Attentive recurrent generative adversarial network for shadow detection and removal[C]//International Conference on Computer Vision (ICCV), Venice, Italy, 2020: 10212-10221.

[27] Zheng Q, Qiao X, Cao Y, et al. Distraction-aware shadow detection[C]//Conference on Computer Vision and Pattern Recognition (CVPR), California, USA, 2019: 5162-5171.

[28] Wang X, Shrivastava A, Gupta A. A-Fast-RCNN: hard positive generation via adversary for object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Honolulu, Hawaii, 2017: 2606-2615.

[29] Gougeon F. A crown-following approach to the automatic delineation of individual tree crowns in high spatial resolution images[J]. Canadian Journal of Remote Sensing, 1995, 21(3): 274-288.

[30] Erikson M. Segmentation of individual tree crowns in colour aerial photographs using region growing supported by fuzzy rules[J]. Canadian Journal of Forest Research, 2003, 33(8): 1557-1563.

[31] Lamar W R, McGraw J B, Warner T A. Multi-temporal censuring of a population of eastern hemlock (. ) from remotely sensed imagery using an automated segmentation and reconciliation procedure[J]. Remote Sensing of Environment, 2005, 94(1): 133-143.

[32] Larsen M, Eriksson M, Descombes X, et al. Comparison of six individual tree crown detection algorithms evaluated under varying forest conditions[J]. International Journal of Remote Sensing, 2011, 32(20): 5827-5852.

[33] Dong T, Shen Y, Zhang J, et al. Progressive cascaded convolutional neural networks for single tree detection with google earth imagery[J]. Remote Sensing, 2019, 11(15): 1786.

[34] Foody G M. Thematic map comparison: Evaluating the statistical significance of differences in classification accuracy[J]. Remote Sensing, 2004, 70: 627–633.

Research on anti-shadow tree detection method based on generative adversarial network

Ye Yang, Shen Bingyan, Shen Yuqi

(,,310023,)

High-scoring remote sensing imaging has widely been applied in most management of agriculture and forestry, especially to monitor and evaluate crops and forest resources on a large scale. Nevertheless, there is a great challenge to the accuracy of single tree identification and detection during the image acquisition, due mainly to the fact that the shadow area is inevitably formed by the light. The shadow areas in the remote sensing images can be assumed as a kind of noise in the image sampling. As such, the degradation of high-resolution parameters can cause image distortion after post-processing. In this study, an anti-shadow tree detection method was proposed to detect the single tree with shadow interference using a generative adversarial network (GA-Faster RCNN). This framework consisted of a Faster RCNN network and a tree generator. The Faster RCNN network was mainly used for the tasks of feature extraction and detection. The tree generator was utilized to process the shadows in tree detection. The adversarial generation strategy was adopted by the tree generator to learn generating the minimum feature information characterizing trees. The generator was first trained separately and then put into the Faster RCNN network to finally lock its parameters. Two parts were then trained end-to-end to further improve the tree recognition ability of the network. The GA-Faster RCNN was also compared with 3 state-of-the-art methods, including region-growing, progressive cascaded convolutional neural network, and Faster RCNN on three test areas with shadows. Test area 1 presented a lot of shadows of trees, where the canopy density of trees was very high. Test area 2 showed fewer tree shadows and lower canopy closure, compared with test area 1. The shades of trees and the canopy density of trees in test area 3 were between those in test area 1 and 2. Results demonstrated that the GA-Faster RCNN achieved the highest harmonic average of precision and recall (1) on the test area 1, 2, and 3, which were 78.4%, 91.6%, and 81.7%, respectively. The average1 of three test areas was 84.7% for the GA-Faster RCNN, 6.2 percentage point higher than that of Faster RCNN. The user accuracy (UA) and producer accuracy (PA) of GA-Faster RCNN were also the highest among four methods, where UA was 79.8%, 95.0%, 85.3%, and PA was 77.0%, 88.5%, and 78.4% on test area 1, 2, 3, respectively. Moreover, a significance analysis, McNemar, was performed to eliminate the interference of experimental errors and other factors. It was found that there was a statistically significant difference between the three comparison methods and GA-Faster RCNN. The shadow misrecognition rate SR (proportion of the count of shadows misrecognized as trees to the count of total recognized trees) of GA-Faster RCNN was compared with that of Faster RCNN on test area 1, in order to clarify the effect of the mask on tree identification. Although the SR of GA-Faster RCNN was 13.8%, higher than that of Faster RCNN (8.6%), the UA and the number of missed tree identification were both better than those of Faster RCNN. Therefore, the GA-Faster RCNN behaved significant advantages over the other identification. In addition, the GA-Faster RCNN can still maintain the detection stability, when using different feature extraction networks, including ResNet101, ResNet50, and DenseNet. Consequently, the adversarial generative training strategy is highly suitable for learning the minimum feature information characterizing trees, while effectively reducing the interference of shadows, indicating the promising practical value for higher accuracy of tree detection.

remote sensing; algorithm; tree; detection; image; shadow interference; deep learning

10.11975/j.issn.1002-6819.2021.10.014

TP391

A

1002-6819(2021)-10-0118-09

叶阳,沈冰雁,沈毓琦. 基于生成对抗网络的抗阴影树木检测方法[J]. 农业工程学报,2021,37(10):118-126.doi:10.11975/j.issn.1002-6819.2021.10.014 http://www.tcsae.org

Ye Yang, Shen Bingyan, Shen Yuqi. Research on anti-shadow tree detection method based on generative adversarial network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(10): 118-126. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.10.014 http://www.tcsae.org

2020-03-12

2021-04-13

国家自然科学基金资助项目(No. 61672464)

叶阳,实验师,主要研究方向为图像处理。Email:yeyang80@zjut.edu.cn