基于局部相似的红外小目标跟踪算法

2021-06-21李鑫隆艾斯卡尔艾木都拉

李鑫隆,艾斯卡尔·艾木都拉

(新疆大学信息科学与工程学院,新疆 乌鲁木齐 830046)

1 引 言

红外图像的典型特点是分辨率较低,对比度较差。红外图像中的小目标视觉强度微弱,边界模糊,跟踪时容易丢失。实际应用中对跟踪算法的精度要求很高[1-2]。相关文献中,红外小目标又被称为红外弱小目标[3]、小目标[4]、红外点目标[5],弱点目标[6]等。为避免累赘,本文统一使用小目标作为指代。红外小目标跟踪算法主要划分有特征匹配,图像滤波和目标建模三大方向。特征匹配是将目标分解为局部特征的集合,根据特征点匹配实现跟踪,特征方法的优点在于特征点在发生部分遮挡或者尺度变化时仍能够被检测到。在视觉目标跟踪中,SIFT[7]、FAST[8]、BRISK[9]等方法常被用于提取目标的局部特征。滤波类方法将关注目标的运动特性,将目标的状态变化纳入考虑,利用合适的滤波方法提取目标位置。典型的有时空滤波[10]、粒子滤波(Particle filtering,PF)[11-12]等。不足之处在于这些方法对变化场景中的运动对象处理能力很差,实际跟踪效果并不理想。建模类算法通常先建立跟踪对象的理论模型,通过计算模型相似度估计目标位置,如均值漂移法[13-14]、光流法[15-16]、模板匹配法[17-18]等。缺点在于对分布稳定性具有要求,跟踪轮廓模糊的小目标时容易丢失。总而言之,以上算法并不能够满足实际应用中红外探测系统的要求。

基于时空上下文(Spatial-Temporal Context,STC)学习的跟踪方法将对象的局部背景纳入算法模型,具有稳定高效跟踪的优点。将该方法应用到红外小目标跟踪时发现STC算法无法准确跟踪杂波干扰的模糊对象。红外小目标像素面积小,和背景对比差异小,跟踪时受边缘杂波干扰易导致跟踪失败。针对小目标跟踪中的变化场景和模糊轮廓问题,本文提出了一种基于小目标梯度分布的局部相似度(Local Similarity Measure,LSM)特征。该特征学习当前目标的梯度分布并在下一帧获取响应。LSM特征能够有效增强目标响应,降低边缘杂波干扰。然后基于局部相似和运动估计,提出了本文的跟踪框架。

2 时空上下文跟踪算法分析

2.1 STC跟踪算法

STC算法的实质是在搜索空间内计算目标似然函数的响应,并将响应最高点确定为跟踪对象的中心。引用文献[19]的部分内容描述STC算法的算法流程。文中,目标的响应矩阵描述为:

c(x)=p(x|o)=∑v(z)∈XcP(x|v(z),o)P(v(z)|o)

(1)

其中,XC表征目标邻域像素集合;v(z)是目标邻域内任意点z的坐标和像素值;o说明跟踪对象存在;x表示跟踪对象某一像素;P(x|v(z),o)描述了目标像素分布与其邻域信息的整体关联;P(v(z)|o)描述了局部区域跟踪对象o存在时任意点z与o的关联。在当前帧,响应矩阵c(x)可表示为:

c(x)=b·exp(-(|(x-x*)/α|)β)

(2)

式中,α、β是公式参数,和对象的尺度和形状有关;b为归一化常数;x*代表已知目标的中心坐标。当前帧,式(1)中c(x)和P(v(z)|o)按照相应公式计算获得,跟踪任务转化为上下文模型P(x|v(z),o)的构建问题,用htSC(x)表示,由此可得:

式中,F表示傅里叶变换。

基于第t帧的上下文模型htSC(x),就可以计算出(t+1)帧的函数响应矩阵ct+1(x),ct+1(x)中响应最高的坐标被认为跟踪到的对象。关于响应矩阵c(x)的详细计算,推导公式参考文献[20]。

2.2 “偏移”分析

普遍情况下,目标上下文的关联分布依赖颜色通道或灰度特征描述。在灰度特征中,杂波干扰和跟踪目标分布高度相似。当杂波和目标足够接近或者目标轮廓足够模糊时,算法建立的上下文模型无法区分杂波干扰导致偏移。红外小目标跟踪容错性低,跟踪框的微小偏移就可能丢失目标。同时目标和杂波相似性高导致建模过程中易受上下文区域的杂波影响,产生偏移。由式(3)可知目标的上下文模型仅与其分布算法有关。在使用时空上下文算法跟踪红外小目标时,模糊轮廓和背景杂波混淆使得跟踪算法产生偏移。由此分析,提升跟踪性能的关键在于增强目标响应并抑制杂波干扰,提升目标与杂波的区分度,避免偏移。因此本文的解决思路是设计了一种使用梯度分布描述目标上下文信息的特征算法。该特征能够显著降低干扰,增强目标强度,有助于建立理想的目标模型,提升算法的抗干扰能力。

3 本文算法

3.1 局部相似度(LSM)

本文设计的LSM特征通过对当前帧的目标区域灰度梯度特性进行学习,产生相应的权值矩阵,再利用权值矩阵在下一帧区域提取LSM特征。LSM特征可表示如下:

LSM(x,t+1)=λβ(X)·G(X)·W(x*,t)

(4)

LSM(x,t+1)表示第(t+1)帧点x处的特征响应;λ是归一化参数;G(X)表示第(t+1)帧中点X处大小为d*d的邻域梯度矩阵,d为第t帧跟踪目标的直径均值。对于如图1(a)所示邻域矩阵g(X),根据公式(5)可以计算图1(b)所示的矩阵G(X)的每一个成员G(x,y)的值:

(a)领域矩阵g(X) (b)梯度矩阵G(X)

(5)

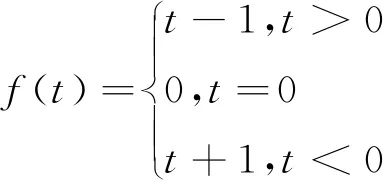

X(x,y)是矩阵g(X)中对应坐标点的灰度f(t)表示如下:

(6)

W(x*,t)表示第t帧目标x*的目标权值矩阵。该矩阵首先在第t帧图像点x*的邻域产生邻域梯度矩阵G(x*),然后对每个方向上R个梯度值G1,G2,…,GR有如下公式计算梯度比例:

(7)

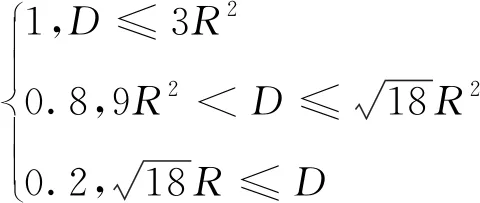

即可得到相应的权值矩阵W(x*,t),其中R为目标半径;β(X)是相似度衡量因子,表示如下:

gray(t,x*)是第t帧x*处的灰度;D是点X和点x*的欧式距离;引入LSM,第t帧图像的上下文分布概率可表示如下:

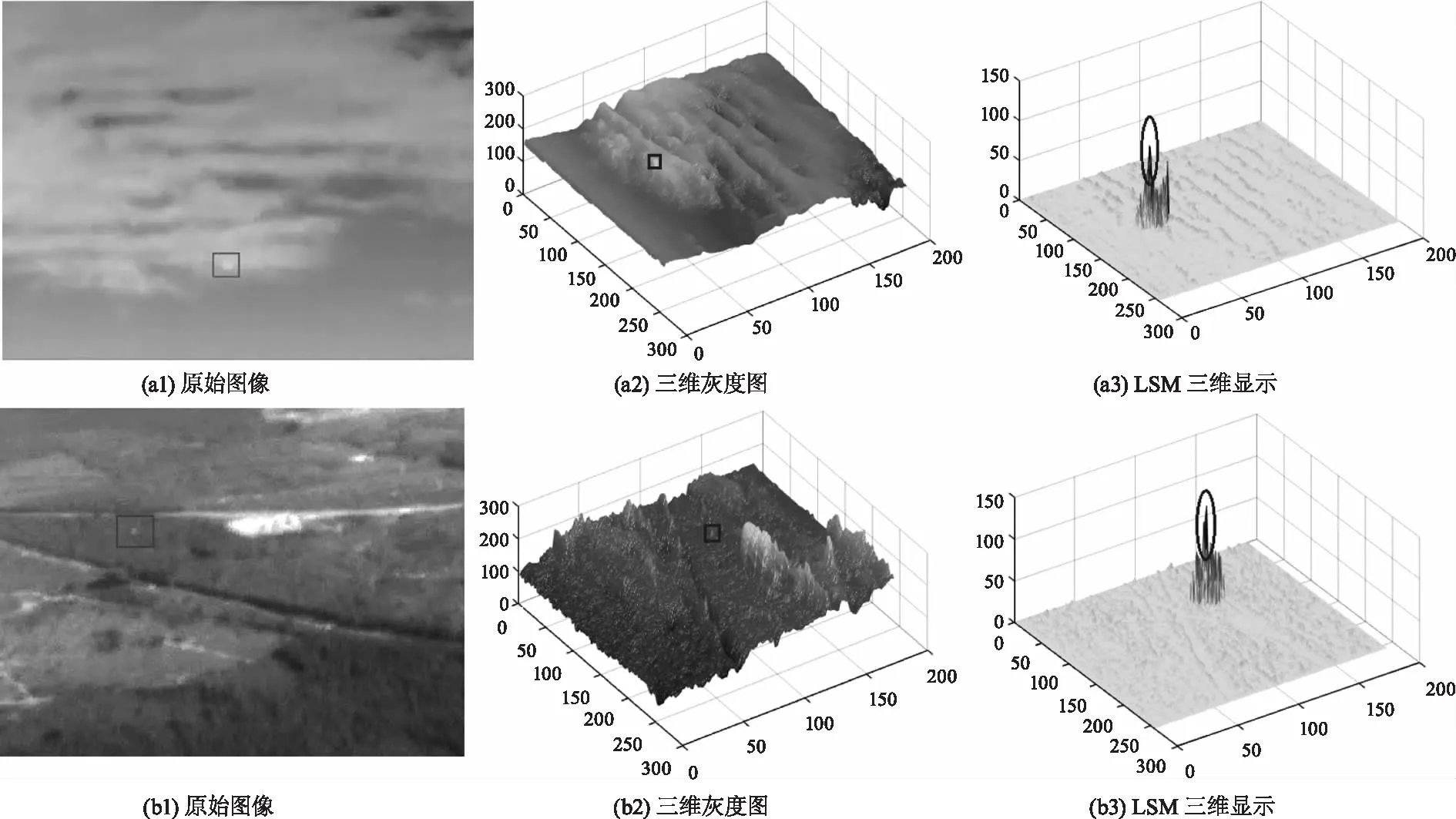

p(v(z)|o)=LSM(z,t)ωσ(z-x*)

ωσ是一个高斯权重函数;x*是已知的对象坐标。图2显示了LSM响应三维图,其中(a1)和(b1)是处理之前的红外图像,(a2)和(b2)是对应图像的三维显示,(a3)和(b3)相应的LSM特征响应。图中目标位置已经用黑色边框标出。观察图2可以发现,三维灰度图中红外小目标和背景的差异很小,难以直观地区分。这是采用灰度特征作为上下文描述符的STC算法容易受边缘杂波和模糊轮廓影响产生偏移的原因。相反,在LSM特征响应图中,目标和背景差异较大,具有很强的辨识度。引入LSM特征可有效抑制杂波干扰。

图2 LSM响应三维视图

3.2 运动估计

基于时空稳定性,在相邻的两帧间,小目标的位置变化不会很大。为了降低算法耗时,引入了运动估计机制。给定当前帧目标位置x*,当前帧目标相对于前一帧目标位移Δx,跟踪框半径R以及运动估计因子M。则跟踪算法搜索域可表示成点(x*+Δx)为中心的方形区域,区域边长为2F。F的计算公式,运动估计因子M1初始值以及更新公式表示如下:

F=M+k·2R

(10)

M1=0.5·max(h,w)-k·2R

(11)

Mt+1=δMt+(1-δ)|Δx|

(12)

式中,k和δ是可调参数;h和w是第一帧图像的尺寸。采用该机制,能有效缩小图像搜索域,进而提升处理速度。

3.3 跟踪模型

在引入上述LSM特征结合运动估计提出了本文方法,算法流程如下:

跟踪模型:输入:待跟踪视频,初始标注框输出:图像序列跟踪框列表T1:初始化,读入序列总长L,序列第一帧以及第一帧标注框坐标x*i;根据公式(5)、(6)、(7)计算当前图像帧目标区域梯度权值W(x*,1);2)根据权值W(x*,1)和(4)式构建当前帧LSM响应;3)根据(2)式对目标x*1的邻域构造目标似然c(z);4)根据式(9)获取分布概率P(v(z)|o);5)根据式(3)计算上下文模型h1SC(z)。2:For i=2,3,…,L1)如下式更新Ht+1SC,ρ表示学习因子:HSCi(x)=(1-ρ)HSCi-1(x)+ρhSCi-1(13) 2)读入当前帧,根据(10)(11)式划分搜索域;3)根据权值W(x*,i-1)和4式构建当前帧LSM响应LSM(x,i);4)计算当前帧目标似然:ci(x)=F-1(F(HSCi(x))·F(LSM(x,i)ωσ(x-x*)))(14)5)获取图ci(x)响应值最大的点坐标构造当前图像跟踪框x*i;6)更新权值W(x*,i),计算目标位移(x*i-x*i-1),并根据式(12)更新运动估计因子Mi;7)根据式(2)(9)(3)计算当前帧上下文模型hiSC(z)。3:跟踪框列表:T=(x*1,x*2,…,x*L)(15)

4 实验与结果分析

4.1 数据集和实验设置

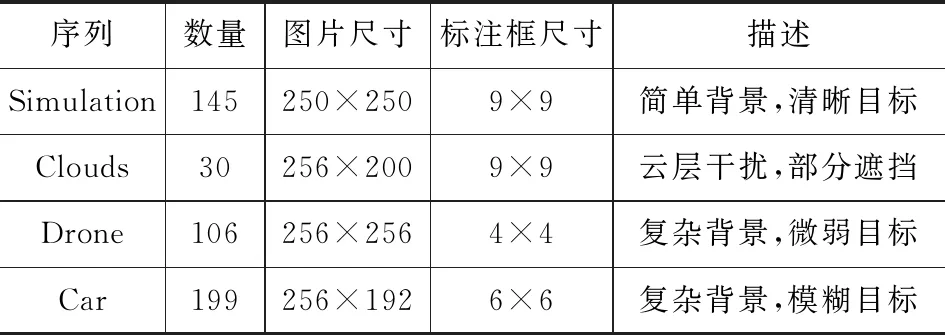

对比实验在VS2017和matlab 2017b环境下进行,计算机配置为3.6 GHz Intel Core i7 CPU,8G内存。实验数据集由不同背景和目标特性的4段测试视频序列组成,视频特性如表1所示。其中Drone序列来源于公开数据集[21]。式(4)中归一化参数设为32,STC算法参数参照文献[20]设为默认值,运动估计因子式(10)中,k设为3,式(12)中学习因子δ设为0.5 。

表1 视频序列的不同特性

4.2 跟踪算法实验分析

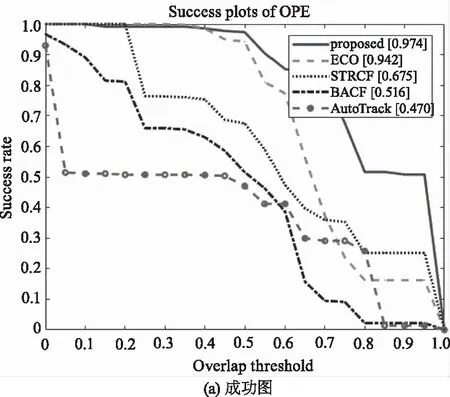

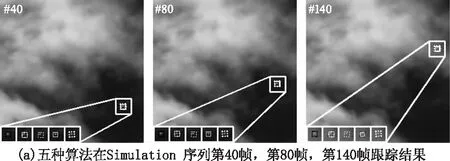

将本文方法和最新发表的4种方法:高效卷积算子(Efficient Convolution Operator,ECO)跟踪算法[22],时空正则化相关滤波(Spatial-Temporal Regularized Correlation Filters,STRCF)跟踪算法[23],背景感知相关过滤(Background-Aware Correlation Filter,BACF)跟踪算法[24],自动时空正则化跟踪(Tracking with Automatic Spatio-Temporal Regularization,AutoTrack)算法[25]进行对比分析。采用CVPR 2013[26]提出的基准工具tracker_benchmark_v1.0比较跟踪算法的性能,结果如图3所示。五种算法在本文视频序列的实验结果如图4所示。

基于tracker_benchmark_v1.0实验平台,使用该实验平台的单次评估(one-pass evaluation,OPE)指标:成功图(Success Plot)和精确图(Precision Plot)对比实验性能。分析成功图(见图3(a))可知,本文方法具有五种实验算法中最高的跟踪成功率,取平均重叠率(Average Overlap Rate,AOR)阈值为0.5,此时本文方法(实线)的成功率比次优的ECO算法高约3 %。分析精确图(见图3(b)),在平均距离误差(Average Location Error,ALE)阈值小于5的阶段时,本文方法(点线)具有最高精确率。

图3 五种算法跟踪性能分析

在图4的每个跟踪结果中利用目标区域的投影分别给出了五种算法跟踪框和标注框(黑色虚线框)的对比。Simulation序列(见图4(a))是一个仿真合成序列,目标清晰,背景变化小。在该序列中五种实验方法都能准确跟踪到目标。在Clouds序列中(见图4(b)),第五帧(图4(b)#5)时目标被云层部分遮挡,目标轮廓相对模糊。在该序列上,STRCF算法和BACF算法发生了漂移,偏离了跟踪对象。Car序列(见图4(c))的特点是目标较模糊,背景干扰较强。Drone序列(见图4(d))的特点是目标格外微弱,与背景对比度较低。AutoTrack算法(见图4(c)#20,图4(d)#30)发生错误,偏移较大。在Car序列和Drone序列中,STRCF算法(BACF算法)的问题是无法实现对目标尺度的准确估计,跟踪过程中跟踪框退化为一个细小的白点(见图4(c)#140,图4(d)#90),和实际标注情况不符合。从图4可以看出,ECO算法和本文方法跟踪过程比较稳定,能够有效应对运动模糊和杂波干扰情况。

图4 五种算法跟踪结果

表2给出了五种算法在这四个视频序列上的跟踪速度(加粗代表最优性能),以每秒能够跟踪的帧数(Frame Per Second,FPS)表示,最后一行是四个数据集的平均速度。由表2可知,本文方法具有五种算法中最优的处理速度,是次优的BACF算法的两倍,这是因为算法采用运动估计方法有效地降低了每一帧图像的搜索区域,从而提升了算法的处理速度。

表2 五种算法跟踪速度

5 结 论

提出一种基于相似性的小目标增强方法处理红外小目标跟踪过程中杂波干扰和运动模糊问题,提升了小目标跟踪过程中算法抗干扰能力。采用运动估计方法缩小跟踪算法的处理区域,提升了算法单帧图像处理速度。将本文算法与多种现有跟踪算法比较,实验表明,本文方法对杂波干扰环境下的模糊红外小目标具备很强的跟踪能力和突出的实时处理能力。但当小目标外观在短时间内发生较大变化时,算法可能会丢失目标,接下来将在本文的基础上,研究结合重检测机制的小目标跟踪问题。