基于深度学习的广告布局图片美学属性评价

2021-04-06沈佳敏鲍秉坤

沈佳敏,鲍秉坤

(南京邮电大学 通信与信息工程学院,江苏 南京 210000)

0 引 言

随着互联网技术的发展,广告业务有了新的展现形式:在线广告,而线上线下服务的打通,使得在线广告的需求越来越大。因此,准确高效地评价一张广告图片是很有必要的。为了简化工作,文中并不关注广告图片中广告语的具体内容,即文中对广告布局图片进行美学属性评价。

对于一个人类艺术家来说,当他/她展示一张照片或一幅图画时,他/她不仅会从不同的美学属性方面给出一个数字分数,而且还会说出一个段落来描述不同的美学属性[1]。一张图片的美学属性包括构图、灯光、颜色、图片的焦点等。在这项工作中,对于广告布局图片的评分标准[2],该文主要考虑构图、色彩照明、图片的焦点以及总体印象。

构图主要考虑的是整张图片的稳定性[3]。所谓稳定,是人类在长期观察中自然形成的一种视觉习惯和审美观念。因此,凡符合这种审美观念的造型艺术才能产生美感,违背这个原则的,看起来就不舒服。但是,稳定不意味着图片的元素在图片中平均分配,而是所有的元素在图片中存在一种合乎逻辑的比例关系,例如对称分布。事实上,对称的稳定感特别强,对称能使图片有庄严、肃穆、和谐的感觉,像中国古代的建筑就是对称的典范。

颜色是通过眼、脑和生活经验所产生的对光的视觉感受[4],肉眼所见到的光线,是由波长范围很窄的电磁波产生的,不同波长的电磁波表现为不同的颜色,对色彩的辨认是肉眼受到电磁波辐射能刺激后所引起的视觉神经感觉。颜色具有三个特性,即色相、明度和饱和度。

图片的焦点是图片中的重要组成部分[5],如果没有固定的兴趣点,图片就会显得杂乱无章。没有什么能吸引观众的注意力或引起他们的兴趣,也没有什么线索能说明图片的目的是什么。但另一方面,具有强烈兴趣点的照片会立即向观众展示照片的全部内容。它们引起了人们的注意,并把观众吸引到一个构图中,让他们的眼睛停留片刻。在这项工作中,广告图片的焦点即是突出广告的主体。

图片的总体印象,即对整张图片的感受,主要考虑整张图片各个组成部分放在一起是否适宜,以及组合到一起后整体的美学印象。

图像字幕,大多数图像字幕工作遵循CNN-RNN框架,取得了很好的效果[6]。近年来关于图像字幕[7-8]的文献大多介绍了注意方案[9]。该文遵循这一趋势,在网络中添加注意力模式。

为了得到广告布局图片有关上述四个方面的美学属性评价,文中设计了美学多属性网络,包括多属性特征网络、注意网络以及语言生成网络,然后根据图像字幕的评价标准,比较文中模型和其他模型。

1 数据集

由于没有适合该文场景的公开数据集,因此选择5名专业的广告设计师以及10名广告从业人员对广告布局图片进行了美学属性评价,数据集中包含各美学属性的数值评分和语言评价。该文将这个数据集称为ALID数据集,该数据集的美学属性包括色彩照明、构图、景深、焦点和总体印象。数据集中总共有大约200 000张广告布局图片,对于每个属性,选择2 000张图片进行验证,2 000张图片进行测试,剩下的图片用于训练。

2 系统模型

在本节中将详细介绍整个模型的系统框架。如图1所示,所提出的美学多属性网络(AMAN)分为三个部分:多属性特征网络(multi-attribute feature network,MAFN)、注意网络和语言生成网络(language generation network,LGN)。MAFN通过4个属性得分的多任务回归计算不同属性的特征矩阵。注意网络动态地调整所获得特征的通道维度和空间维度的注意权重。最后,LGN通过长短期记忆网络(long short-term memory,LSTM)[10]生成字幕,LSTM网络需要数据集中关于美学语言评价的真实内容和注意网络调整后的特征映射。

2.1 多属性特征网络

(1)

(2)

MAFN如图1上部所示,GFN和AFN使用Desnet161来提取密集的特征图。所有先前图层的参数都是共享的。GFN和AFN的输出分为5个部分:一般特征和4个审美属性的特征。GFN对全局美学分数的输出执行全连接操作。

对于最终结果,执行均方误差(MSE)[4]的计算,并将其作为模型损失参数返回到之前的层。AFN对属性特征映射进行卷积运算,得到4个不同的属性特征映射。与GFN一样,通过全连接层和均方误差损失得到最终属性得分。

MAFN可以同时提取图像的不同属性特征映射。因此,该模型不再局限于输出一个句子的注释。图像的美学特征可以从多个属性进行评价,更好地指导图像的综合评价。多任务网络得到的具体结果还可以直接利用知识迁移扩展ALID字幕数据集的属性评估,从而提供更广泛的审美评估能力。

图1 系统框图

2.2 注意力网络

注意力网络包含两种模式[11],一是空间注意在信道注意之后,二是信道注意在空间注意之后。通过实验,该文采用第一种结构作为注意力网络。给定特定的N-1层特征映射MN-1,根据信道注意计算fc,得到信道注意权重wc。然后将加权wc和N-1层特征映射线性融合,得到新的N层信道感知特征映射MN。之后,将信道感知特征图MN发送到空间感知注意模块计算fs,得到了空间注意权重ws。最后,对前一步得到的信道感知特征图MN进行空间感知,即CNN输出的特征。合并的过程可以用下面的公式表示:

fc=tanh((wc⊗MN-1+bc)⊕whcht-1)

(3)

MN=softmax(WNfc+bN)

(4)

fs=tanh((ws⊗MN-1+bs)⊕whsht-1)

(5)

MN+1=softmax(WNfs+bN)

(6)

在上面的公式中,t表示时间状态,h表示LSTM隐藏状态,⊕表示矩阵和向量相加,⊗表示向量的外积,b表示偏移量。

2.3 语言生成网络

长短期记忆网络是学习长期依赖信息的一种特殊类型的RNN。在许多问题上,LSTM已经取得了相当大的成功,并得到了广泛的应用。通过将多个属性的信息输入LSTM单元,可以根据图像特征和时序信息进行下一个单词的预测。具体来说,如果美学评估的两个子任务和生成的注释是统一的,则训练过程可以描述为这样的形式:对于训练集的图片I,对应的描述是序列S={S1,S2,…,SN}(其中Si表示句子)。对于语言生成模型θ和属性∂,给定输入图片I,为每个属性生成序列Si的概率如下:

(7)

该模型利用通道和空间注意模型来提高图像有效区域的利用率。因此,可以在解码阶段更有效地利用图像的特定区域的特征。语言生成网络的损失可以用下面的公式来表示:

(8)

该模型利用图像的语义信息来指导解码阶段的词序生成,避免了仅在解码开始时使用图像信息的问题,从而导致图像信息随着时间的推移逐渐丢失。为了更好地获取图像的高层语义信息,该模型对原有的卷积神经网络进行了改进,包括多任务学习方法,该方法可以提取图像的高层语义信息,增强编码阶段图像特征的提取。

3 实验结果展示及分析

3.1 基准网络

CNN-LSTM:该模型基于Google的NIC模型[12]。Resnet-152[13]提取不同属性的特征,LSTM进行编码。该基线与文中方法的区别在于:(1)没有引入注意机制来增强特征提取过程;(2)没有使用多任务网络来提取不同属性的特征。相反,每个属性分别训练一个网络。它没有充分利用CNNs的美学特征,在提取CNNs特征时会进行简单的知识转移。

SCA-Model:该模型基于SCA-CNN[12]模型,ResNet-152为不同的属性提取特征。LSTM在提取特征后进行空间和通道注意增强。此基线与文中基线的区别在于:(1)SCA模型不使用多任务网络来提取不同属性的特征。每个属性分别训练一个网络;(2)SCA模型没有充分利用美学特征。在提取CNNs的特征时,会发生一个简单的知识迁移。

3.2 实验细节

文中实验基于该框架,LSTM单元数为1 000个,发送到LSTM单元的特征包括2 048维全局特征和512维属性特征。单词向量维数设置为50。基础学习率为0.01。注意模块的尺寸为512。在训练的过程中采用dropout,以防止过度拟合。采用随机梯度下降优化策略对网络进行优化。

3.3 结果展示

模型的测试结果如图2所示。可以发现,结果不仅具有丰富的句子结构,而且对特征的把握也非常准确。评论和属性的相关性很高。在得分方面,平均属性得分非常接近地面真相得分。通过评分和点评,形象评价生动。

图2 结果展示

3.4 比较分析

3.4.1 与基准网络比较

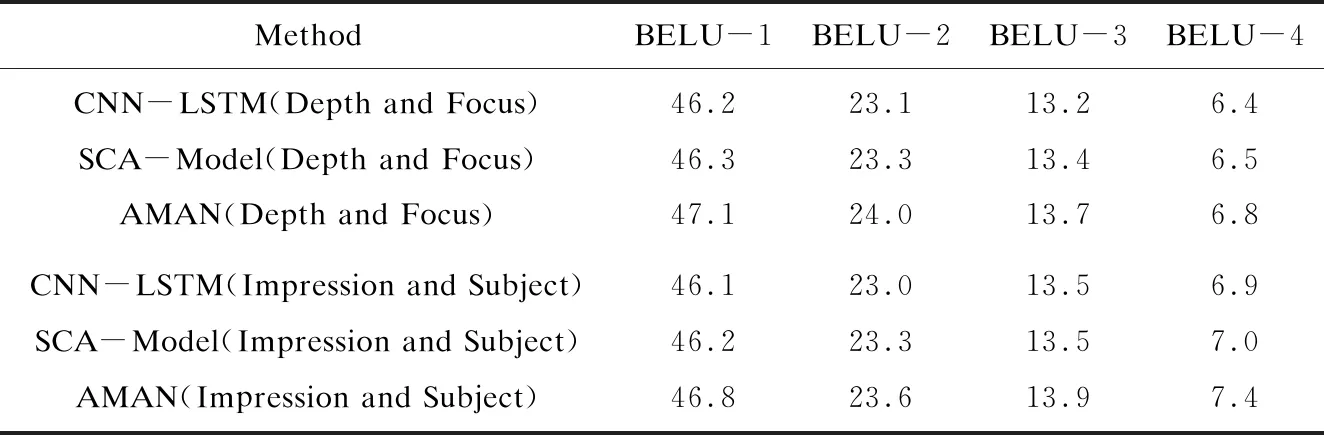

比较文中模型和基准网络,性能的评估标准包括RLEU-1、2、3、4、METEOR、ROUGE和CIDEr。表1和表2所示的比较结果表明,文中模型在所有标准中都优于基线模型。

表1 文中模型和基准网络关于BELU准则的比较结果

续表1

表2 文中模型和基准网络关于其他准则的比较结果

3.4.2 与其他方法比较

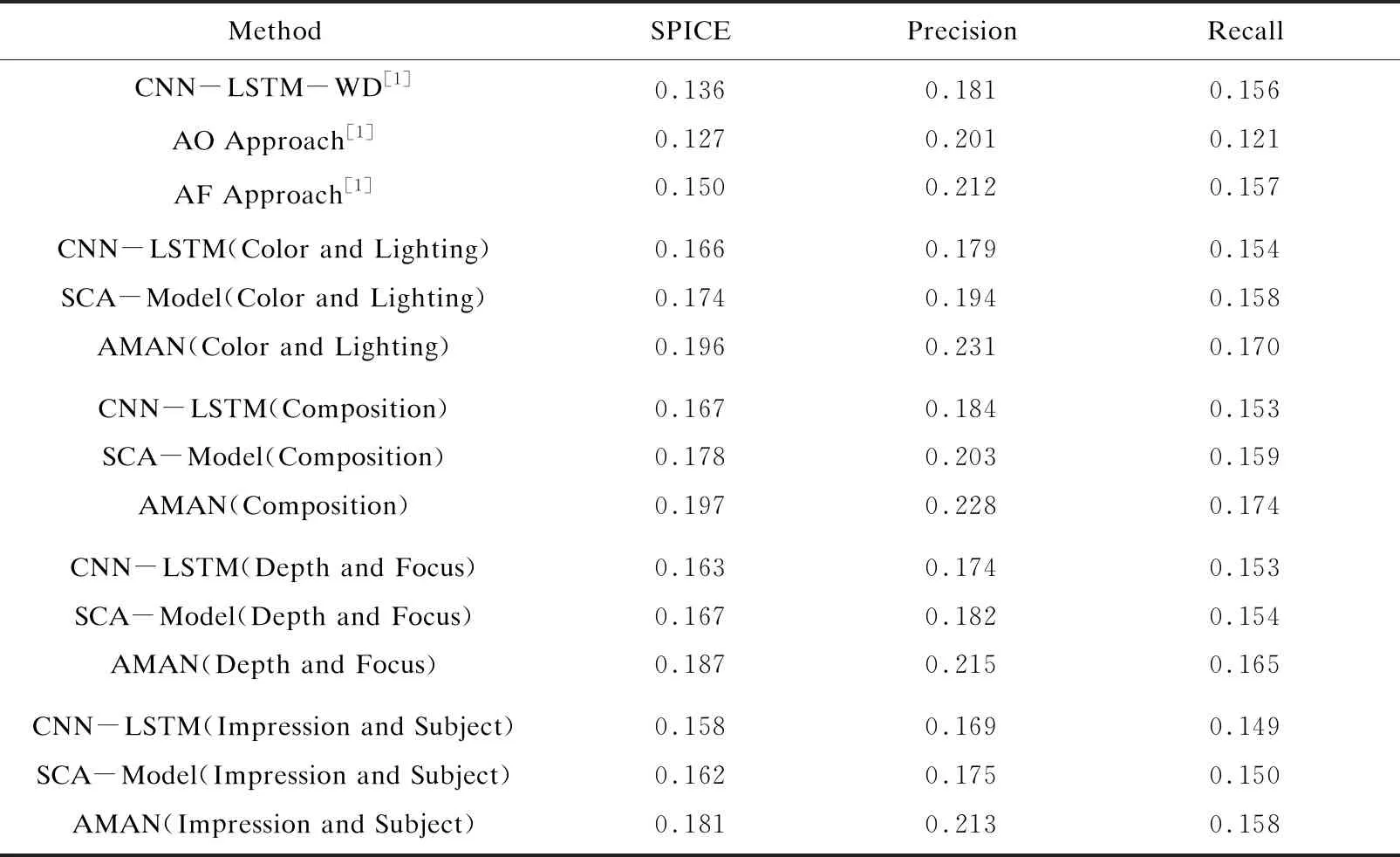

使用SPICE[14]来比较方法[1]和文中模型之间的性能。SPICE是自动评估生成的图像标题的标准。它通过将句子解析成一个图来解决结果和生成的标题之间的相似性。计算公式如下:

(9)

如表3所示,该模型在各种属性上都优于文献[9]提出的方法。方法[1]采用属性融合训练方法,将构图、色彩和光照、主题三个属性结合起来。但是,通过对比可以发现,文中在这三个属性中生成的注释比前面的注释具有更好的注释。

表3 结果在测试集上通过SPICE准则的比较

3.5 结 论

提出了一个新的问题:广告布局图片的美学质量评价,建立了一个新的数据集ALID,提出了一种新的网络AMAN,该网络可以生成美学标题和美学属性数值评分。

4 结束语

图像美学质量评价是比较热门的研究问题,该文研究了广告布局图片的美学质量属性评价。为了研究这个问题,邀请了5名专业的广告设计师以及10名广告从业人员对广告布局图片进行美学属性评价,从而构造了包含各美学属性的数值评分和语言评价的新的数据集ALID,提出了美学评价模型AMAN。该模型包含了多属性特征网络(MAFN)、注意网络和语言生成网络(LGN)。通过实验分析,该模型在各个评价标准下都表现得比较优异。当然,该方法仍有需要完善的地方,例如可以考虑利用强化学习来生成语言评价。