多模态学习分析:理解与评价真实学习的新路向

2021-02-21汪维富毛美娟

汪维富 毛美娟

[摘 要] 随着物联网、可穿戴传感设备、人工智能的快速发展,多种模态数据的连续抓取与融合分析成为可能,促成了多模态學习分析研究的诞生,并成为学习分析领域的一个重要新兴分支。多模态学习分析关注真实的学习情境与本真的学习交流方式,“返璞归真”地聚焦更普遍的物理学习情境,克服了主流学习分析过度关注数字化学习环境的局限。研究主要采用文献归纳法,阐述了多模态学习分析的发展动因、概念理解,重点从身体、生理视角概述了多模态的数据类型,并对多模态学习分析的过程模型进行了详细描述。研究认为,未来要充分借助人工智能处理多模态数据,借鉴认知带理论融合不同模态数据的意义,借力学习理论来理解真实的多模态学习交互过程,以进一步完善基于多模态数据的学习评价方法。

[关键词] 多模态学习分析; 物理学习环境; 可穿戴设备; 生理数据; 数据融合; 学习评价; 认知带

[中图分类号] G434 [文献标志码] A

[作者简介] 汪维富(1986—),男,江西鄱阳人。博士研究生,主要从事远程开放教育、教师教育信息化研究。E-mail:wwf860127@163.com。

一、引 言

转向建构主义学习范式是当下课程改革的主流方向,但是仍有不少学者对建构性学习的有效性提出质疑[1],其潜在原因是建构性学习支持的高阶学习结果是极难衡量的,在学校情境中难以实现规模化评估,特别是在小组协作、任务复杂的开放学习环境中,传统纸笔支持的标准化测量方法往往无法展现其积极的学习影响。《深化新时代教育评价改革总体方案》提出,要“充分利用信息技术,提高教育评价的科学性、专业性、客观性”[2],寻求新技术支持的学习评价方法正成为教育评价改革的重要方向之一。

二、多模态学习分析的发展动因

基于大数据的教育评价是教育现代化的重要特征。近年来,大数据驱动的学习分析方法拓展了传统标准化学习评估方法,如使用来自学习管理系统、MOOC、社交媒体环境、教育游戏等的大数据,对学习过程与结果有了更细致全面的刻画方法。学习分析通过自动化、全样本的大数据收集和分析,开创了一种大数据支持的非标准化学习评估形式,扩大了建构性学习评价的规模化实施范围,使原来复杂和费力的形成性评价与个性化反馈成为可能。然而,目前大部分学习分析都集中在以计算机为中介的结构化任务上,反而忽略了更经常发生学习活动的物理学习空间。因此,如何从现实世界或混合世界的学习环境中收集多种来源的学习痕迹,成为学习分析领域亟须开拓的研究领域。

随着物联网技术的发展和创客运动的兴起,一股新的技术创新浪潮正在发生。生物传感器、全息摄像系统、手势感应、红外成像、眼动跟踪等多模态数据收集方法正在迅速发展,特别是可穿戴传感器的便携性、微型化、非侵入性与低价格趋势,让收集高频、细粒度、全样本的多层次、多模态学习数据成为可能。将物理学习活动、身体运动、生理数据与数字化日志、自我报告数据结合起来,获取更为接近学习者与群体真实表现的细颗粒数据,使研究人员能够洞察学习者或学习群体每分每秒的发展,对复杂的认知、行为、情绪、动机等进行更全面的评估,从而促进21世纪技能与核心素养的发展。

三、多模态学习分析的概念理解

每一种知觉来源或者媒介形式,都可以称为一种模态。例如:人有触觉、听觉、视觉、嗅觉;从媒介表征形式看,有声音、视频、文字、手势、姿势、眼动、表情、生理信号等。多模态融合了至少两种模态及以上的数据来源。

(一)多模态学习分析的概念内涵

作为学习分析的一个新兴分支,多模态学习分析(Multimodal Learning Analytics)于2012年在多模态交互国际会议上正式被提出[3],旨在通过捕获、融合和分析多种来源的数据,尤其是自然交流过程中产生的多源数据,如讲话、凝视、手势、姿势、眼动、面部表情、皮肤电、脑电图、心率等,以实现对学习行为、认知、信念、动机与情绪等多方面的客观理解与深刻洞察。Worsley发现,学习研究中最常用的五种模态是语音、视频、生理、眼动跟踪和数字化日志[4],其中超过一半的多模态学习分析实证研究使用了至少三种模态。

(二)多模态学习分析有利于克服当下学习分析的研究局限

目前,主流学习分析聚焦计算机支持的学习系统环境,交互数据主要来自数字化空间,学习者通常坐在电脑屏幕的正前方,数据的噪音比较少,任务的结构化和脚本化程度较高,推断学生行为和学习构念之间的关联较为容易。然而,多模态也是人类与计算机交互时的典型特征,人类通过面部表情、语音语调或身体动作等多种方式来表达自己的意图和情感,如与智能导师系统交互时也可能紧锁眉头、打哈欠、东张西望,但现在还很少将这些因素纳入学习分析。另一方面,多数学习发生在面对面的开放式物理环境中,只聚焦数字化环境明显损害了学习分析对一般性学习的适用性。不管是基于项目的学习、具身化互动、开放式的实践活动和协作学习活动,还是更传统的课堂教学,都蕴含着对于学习分析来说具有重要价值的多模态数据。当下,研究人员开始尝试对数字化学习环境之外的学习和教学经验进行建模和分析,有学者甚至提出了“物理学习分析”(Physical Learning Analytics)概念,将学习分析引入真实的物理学习空间,并试图利用物理空间数据来帮助改进教学实践和学习过程[5]。因此,将研究情境转向更加真实、复杂、开放的学习环境是多模态学习分析的主要焦点。

(三)多模态更符合人类交流与学习的现实与本质

“盲人摸象”的故事启发人们,仅凭一种感官信息只可能获得对事物的局部认识。人类在正常情况下感知信息时一般都会同时利用多种感官,并经过大脑整合处理之后才能形成完整的认识。在传统的课堂上,教师会采取多种方式来传达不同的教学意义,例如:当教师询问是否听懂了知识点时,学生会点头;在强调某个主题时,教师会提高自己的声音。同样,学生利用多种方式来展示其对知识技能的掌握程度,如流畅的口头阐述、持续的眼神交流、更快的答题速度、有节奏的全身运动等。此外,学生也经常通过语言、面部表情和身体姿势参与交流互动,而教师通常会监控这些线索,并实时做出相应的回应。当然,与人类感知能力相比,计算设备感知的信号颗粒度可能会更细致、更全面。因此,多模态学习交互更符合人类交流现实的本质与需求,为了获得更广泛、更正式的整体学习图景,可以把从一种模态中收集的学习证据与从其他模态中收集的学习证据进行相互补充或验证。

(四)多模态学习分析与传统多模态教育实验研究的区别和联系

在传统的教育实验研究中,利用不同模态数据进行学习研究比较常见,如脑电图常用于情绪识别、大脑自我调节、动作技能习得、深度学习、联想学习等实验研究[6]。然而,传统多模态教育实验研究与多模态学习分析有很大区别。前者采用的是实验对比研究范式,其主要问题是数据收集成本很高,只能在实验室层面开展受控研究,不利于扩展到常态化课堂、开放式学习情境,而且研究成果一般无法直接为学生提供及时的学习反馈。多模态学习分析主张采用大数据驱动的第四研究实证范式,直接从不同数据源提取多模态特征,利用机器学习自动分析数据,试图提供连续的、嵌入的实时反馈,以理解、改进正在或将要发生的学习。当然,传统多模态教育实验研究能为多模态学习分析提供重要的分析线索与理论依据。如生理低唤醒表示学习的消极状态,而生理高唤醒则表示学习的积极或反应状态。因此,推动多模态学习分析研究,除了要借助传感器、人工智能、大数据等技术,也要充分借鉴学习科学、认知心理、神经科学和行为科学等理论,以启发不同模态特征与关键学习构念之间建立对应关系,以及验证通过使用多模态数据源推断认知发展和社交进步的可能性。

四、多模态学习分析的数据分类

得益于智能化、便携式传感器的发展,多模态数据采集与分析才成为可能。Schneider等人分析了大量传感器原型,并将可用于学习领域的传感器分为24种,每个传感器可以感知一种或多种数据类型,主要涉及活动数据、情境数据、环境数据、身体生理数据等四种[7]。类似地,牟智佳基于多模态学习分析的空间结构对数据源进行了分类,包括人机交互、学习资源、学习情境与学习体征等四种[8]。他们分类中的前三种都在教育技术领域中涉及较多,本研究重点对第四种数据(即身体生理或学习体征数据)进行阐述。

与自我报告、数字化日志、访谈、任务绩效等常用数据模态相比,身体生理数据是一种更加客观、连续的信息来源,通常要借助专业设备或传感器来采集。例如:麦克风可以对语音信息通道进行采样,眼动仪可以跟踪眼睛的注视范围和持续时间,多功能专业摄像机可以同时跟踪语音、手势、位置、动作和面部等多源信号,而皮肤电设备(如Empatica智能手环)可以获取皮肤电反应信号。基于Di Mitri 等人的分析[9],我们将身体生理数据模态分为两种:自主可控的动作型数据模态、伴随生成的生理型数据模态,如图1所示。

(一)动作型数据模态

动作型数据模态可以分为身躯、头部,这属于自主性的信号模态,具有一定可控、外显的观察特征。身躯又分为躯干、腿、手臂和手。通过躯干的全身运动能捕捉个体的大动作技能娴熟程度信息,也能为评估其他认知信息提供重要线索。例如:Raca和Dillenbourg使用多功能摄像系统来观察全身运动(Gross Body Movements,GBM)[10],利用身体姿势、手势等线索来评估课堂中的学生注意力;Botha和Africa发现,小学生的全身运动和字母识字能力呈正相关,全身运动在一定程度上是观察儿童识字能力的有效指标[11]。计步器可以跟踪腿部的运动,并为身体活动提供良好的指示,而手臂和手是语义更丰富的身体部位。摄像机可以检测到手臂的运动,如微软Kinect可以识别手势和身体姿势,已经被用于演讲表达技巧的自动化训练[12]。另一种手臂运动和手势的检测可以通过肌电图(Electromyography,EMG)实现。例如:Hussain等人在情感检测的研究中使用了脸部EMG、心电图(Electrocardiogram,ECG)、皮肤电反应(Galvanic Skin Response,GSR)和呼吸率等不同模态数据[13];Ekaterina等人将前臂肌电图用于支持卫生教育,对医学生的手部清洁过程进行评估[14]。通过手部运动数据可以洞察学习者的认知发展,而手部运动可以通过搜索特定的手势、跟踪对物体的处理以及笔画或绘画草图来检测。例如:将笔画与视频、语音等模态结合起来,可从学生群体中发现高绩效的专家型学生[15];还有学者根据具身认知理论,利用触摸屏辅助学生使用双手来探索数学比例的概念[16],将学习视为学生身体动态协调模式的过程,以引发直接性或隐喻性的抽象概念化,促进学习者在手部运动与抽象概念之间建立牢固的关系。

头部动作型模态主要包括脸部表情、眼动和语音。脸部表情是非常微妙的身体反应状态,在学习分析中得到广泛应用。例如:Alyuz等人用摄像机采集大量的学生表情,用于構建学生使用智能导师系统时的情感投入检测器[17];Chikersa等人探索了群体面部表情等生理同步性与群体的集体智力、互动满意度的关系[18];Spikol等人结合学生手势、面部表情、音频、视频以及与物理计算平台的交互模式,预测项目解决方案的质量和正确性[19]。眼动跟踪是评价注意力的关键指标,如Li等人探究了不同空间视觉选择题之间的眼动差异,并根据眼动追踪数据预测问题难度,发现通过眼球运动(尤其是注视时间)可以很好地预测题目难度[20]。语音分析涵盖了从副语言分析(如说话时长、关键词或韵律特征)到对话情境中口语词汇的识别[21],具有多层次的多模态学习分析特征。语音可以从信号(如声调)、活动(如对话轮换)、内容(如对话内容)、人际(如社会性调节)和其他层面进行融合分析。

(二)生理型数据模态

生理型数据模态属于被动性的信号数据,是机体在活动中伴随产生的,是当人受到某种刺激时所表现出来的潜在反应,这些反应来自中枢和自主神经系统的信号能自动地激活、调节身体机能。其中,大脑、心脏、皮肤、呼吸系统是能够获得生理信号的主要器官。考察大脑活跃程度的方法是使用脑电图(EEG),可以测量大脑内部的电位差。如Dikker等人将EEG用于跟踪正常课堂活动中小组互动的脑部信号变化,发现学生脑脑同步程度可以预测学生在课堂中的投入度和社交关系,说明脑脑同步性可能是动态社会互动的神经标记[22]。此外,多种技术可以用来计算心率和心率变异性等心脏活动的指标,包括血容脉冲(Blood Volume Pulse,BVP)、光学体积描记(Photoplethysmography,PPG)、心电图(ECG)等。皮肤电反应(GSR)的变化被称为皮肤电活动(Electrodermal Activity,EDA),是通过测量皮肤导电性变化来了解身体唤醒程度。例如:Alzoubi等人使用脑电图、心电图和皮肤电反应来检测情感的自然表达[23];Grafsgaard等人使用EDA和从视频、手势和姿势中获得的面部表情来预测情绪[24]。呼吸量(Respiratory Volume)的测定包括呼吸的深度和速率,当呼吸速率变得不规则时,可能有更多的特定情绪,如愤怒[25]。

可以看出,通过身体生理数据可以更加客观、深刻地洞察真实的学习状态,特别是已有研究发现了如唤醒度、同步性、传染性、规律性等诸多具身性的学习体征指标,为完善学习评价方法提供了重要的客观性中介变量。

五、多模态学习分析的过程模型

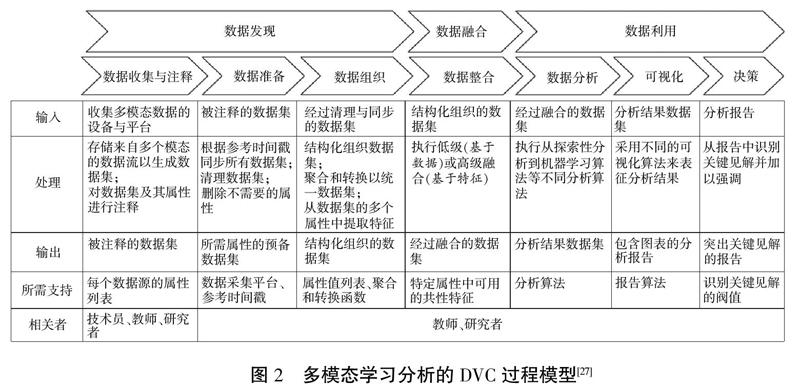

过程模型对于大数据驱动的学习研究具有重要的规范性与指导性价值。构建多模态学习分析的过程模型可以帮助研究人员理解多模态支持的学习分析过程,形成多模态学习分析的操作规范。田阳等人在研究混合学习时,将多模态交互分析的主要流程总结为数据采集、加工与筛选、数据分析、数据表征可视化、反馈调节等[26]。Di Mitri等人提出了一个操作化的过程模型,主要包括传感器捕获多模态数据、人工注释标签、机器学习预测结果、反馈解释与行为转变四个步骤[9],突出了人工注释与反馈、机器建模与预测的协同机制。然而,这些过程模型并未突出多模态学习分析与主流学习分析的不同之处。Shankar等人在考察多个典型多模态学习分析应用场景之后,利用数据价值链(Data Value Chain,DVC)概念抽象出了多模态学习数据的过程模型[27],具有普适性价值,如图2所示。

DVC过程模型将多模态学习分析分为三个步骤:数据发现旨在完成不同数据的收集、注释、清理、同步、转换和结构化工作;数据融合旨在根据关键特征来集成两个及以上的数据集,生成基于多模态数据的连贯性、对齐性与互证性的证据图景;数据利用旨在分析与应用融合之后的多模态数据集,可视化分析报告并突出显示关键发现以做出决策。从具体数据处理活动来说,多模态学习分析过程包括:(1)数据收集与注释。需要技术人员共同部署数据收集平台、工具与传感器,从数字化空间、物理学习空间等情境中收集多种模态的数据,如身体姿态、脑电信号、讨论文本、行为日志等。生成数据集后,对需要再处理的属性进行人工注释,将不同模态(如信号、动作、文本)转换为数字化表征,因为原始的多模态数据通常非常嘈杂,具有大量属性和低语义值。(2)数据准备。在同一参考时间下同步来自不同平台、不同模态的数据集,并根据需要删除无效数据(如删除缺失值)或特定的数据属性。(3)数据组织。对数据集进行转换、结构化和汇总,并从中提取选择性特征,这需要教师或研究人员提供相应的数据汇总和转换方法,如根据平均成绩来生成每个小组的观察结果。(4)数据整合。根据一定的规则与关系对多个数据集进行重新融合,如基于多个数据属性的时间戳,将人工观测结果与生理信号、数字化日志集成起来,其中,多模态数据融合的方法主要有数据级、特征级与决策级。(5)数据分析。使用从基本的统计函数到高级的机器学习算法对数据集进行探索分析,包括对多模态数据进行统计分析、相关性分析、聚类和预测分析、模式识别等。(6)可视化。将分析结果以可视化的方式呈现给教师,需要选择表现力较强的表征方式,或者直接显示在相应的学习仪表盘中,以作出下一步的教学决策。(7)决策。对可视化分析结果中突出的关键发现进行合理解释,结合学习理论、任务情境提出改进策略,或者直接将分析结果用于学习者建模,以更好地适应学习者的个性化学习需求。

六、多模态学习分析的研究趋势

近年来,多模态学习分析研究聚焦建构性教学法而生成了一些独特的基础性结论。例如:非言语互动特征(同步性、个体责任感、平等性和个体动态性)可以有效地解释协作问题解决的复杂学习过程[28];基于口头表达质量数据语料库,Chen等人验证了使用多模态评估公共演讲技能的可行性[29];从程序员的身体动作和手势可以评估协作编程的质量[30]。另一方面,多模态学习分析通常还能以师生可观察、可操作的具体特征(如姿势、手势、音量、头歪、俯身、眼神、表情等)来建模、预测非可观察性的潜在表现(如动机、信念、情绪等),有利于克服学习分析、教育数据挖掘中普遍存在的理解黑箱问题,及时开展形成性评估,以不引人注目的透明方式实时改进课堂教学、提供学习支持。可以说,现有探索性研究说明了多模态学习分析具有与主流学习分析不同的重要价值与现实意义,但未来还需要推进以下几方面的研究:

(一)利用人工智能推动多模态数据处理水平

多模态数据的复杂性和多样性是一项重要挑战。当数据属性大量增加时,研究人员就很难对数据进行系统可视化和充分性解释。Lahat等人描述了多模态数据处理所面对的一些挑战,包括数据的多维度、不同模态分辨率、数据噪声、数据缺失、数据融合和计算模型的选择[31]。相比之下,人工智能能够更有效地处理多模态数据,如智能语音识别、表情识别等,可以被用于规模化处理大量数据。因此,多模态机器学习逐渐成为一个潜力巨大的研究方向,旨在建立能够处理和关联多种模态信息的模型[32],主要内容包括:(1)表征数据,学习如何利用多模态的互补性和冗余性来表征和汇集数据,数据异构性使得构造这种表征极具挑战性。例如:语言通常是文字符号,视频通常是视觉符号,生理数据通常是信号,而交流互动采用的是社交信号解释系统。(2)转换数据,模态之间的关系往往是開放的或主观的,需要将数据从一种模态转换到另一种模态来分析。(3)对齐数据,确定两种或两种以上不同模态属性之间的直接对应关系,找出不同模态之间的关联性。(4)融合数据,结合两个或更多模态的信息来执行预测。(5)协同学习,在不同模态、数据表征及其预测模型之间实现泛在迁移,当其中一种模态的数据有限时,这一点尤其重要。

(二)借助认知带理论促进多模态数据的融合

从不同模态中提取的学习痕迹必然具有不同的特征,在时间粒度、确定程度上都可能有很大的差异,数据融合以及融合后的数据意义成为多模态学习分析中的核心问题,而认知带理论具有很好的指导价值。按照Newell的认知带理论(Bands of Cognition),人类行为可以在生物带、认知带、理性带和社会带等多个时间尺度上得到解释,每个带可以捕获三个数量级的数据,从100微秒(10-4秒)开始,一直到数月(107秒)[33]。具体来说,生物带集中在微秒(10-4~10-2)的时间尺度上,认知带集中在秒(10-1~10)的时间尺度上,理性带集中在数分钟(102~104)的时间尺度上,社会带集中在数周(105~107)的时间尺度上。该理论描述了每个时间尺度如何与不同的意图层面、不同类型的活动相关联。例如:生物带发生的行为有时被解释为无意识、非故意的,而任务完成通常与理性带的人类行为相关。Anderson讨论了构建跨越认知带的融合策略,并提出了三个重要论点[34]:分解论(Decomposition Thesis)认为,发生在较长时间尺度上的行为可以分解为发生在较短时间尺度上的行为集合;关联论(Relevance Thesis) 认为,通过改进较短时间尺度的行为可以提高较长时间尺度上的教学效果,这意味着短时间尺度行为对于诊断更长时间尺度的认知发展具有重要意义;建模论(Modeling Thesis)认为,通过对短时间尺度行为的微细颗粒数据进行建模可以直接影响教学反馈,如使用生物带上的微秒级信号可以获得更高层次的结果,所以建模论为短时间尺度行为和长时间尺度预期结果之间的衔接提供了基础。借助传感器、人类观察、计算机,现在几乎能获得所有认知带上的生理数据、认知数据、理性数据与社会数据,而每个模态均为其他模态提供了一定的信息,各模态之间存在着一定的关联性[35]。有效融合这些来自不同时间尺度的多模态数据、构建不同认知带之间的桥梁、挖掘不同模态之间的关键联系,对于多模态学习分析研究具有重要的基础性意义。

(三)多模态学习分析更依赖学习理论的指导

如今研究者所能抓取的大数据达到前所未有的规模,但是足够的大数据对于理解学习的复杂性还是不够的。事实上,数据量如此之大,数据模态如此多样,以至于很多无关或影响很小的特征或变量汇集起来可能会产生较大的影响,那什么才算是有意义的教育发现?理论此时就扮演着十分重要的角色,譬如公认的心理构念,可以指引研究者思考关于模型中应包含哪些有意义的变量,有哪些噪音、亚组或协变量,关注哪些研究结果,解释结果时使用什么框架,如何使结果具有泛化性和迁移性。多模态学习分析必须有一定的理论或构念作为基础,否则将跌入沙尘暴式实证论(Dustbowl Empiricism)[36],即侧重于经验观察的偶然积累和研究变量之间的关系,而不关注实际逻辑或真实意义。另一方面,如何让多模态学习分析结论具有干预可行性也很重要。例如:性别、年龄等属性经常被用于建模预测,但问题是它们多数时候难以解释相关结果发生的机制,或者很难指导人们设计相关干预措施。Van Der Maas和Wagenmakers发现,棋手的移动速度可以预测出棋手的专业水平[37],但告诉新手更快地移动并不能直接帮助其改进棋艺。因此,为了确保特征变量与分析结论具有教育性意义与操作化价值,已有理论(或构念)是一个关键桥梁,可以指导研究者应该关注哪些学习变量并为解释结果提供框架。

多模态学习分析侧重以贴近人类本真的交流方式来研究学习,完善了大数据驱动的学习科学研究范式,为评估建构性的高阶学习提供了更全面、精准、客观的方法。然而,目前自动收集与处理不同模态数据的方法和工具仍然不成熟,可用于表征学习的显著性特征还没有形成体系,不同学习场景中如何有效地组合不同模态数据还缺乏基础性探索。不过,在新一轮人工智能、教育评价改革的推动下,多模态学习分析势必会成为驱动学习科学发展的重要力量。

[参考文献]

[1] KIRSCHNER P A, SWELLER J, CLARK R E. Why minimal guidance during instruction does not work: an analysis of the failure of constructivist, discovery, problem-based, experiential, and inquiry-based teaching[J]. Educational psychologist,2006,41(2):75-86.

[2] 中共中央国务院.《深化新时代教育评价改革总体方案》[EB/OL].(2020-10-13)[2020-11-05].http://www.xinhuanet.com/politics/zywj/2020-10/13/c_1126601551.htm.

[3] WORSLEY M. Multimodal learning analytics: enabling the future of learning through multimodal data analysis and interfaces[C]// Proceedings of the 14th ACM International Conference on Multimodal Interaction. New York:ACM,2012:353-356.

[4] WORSLEY M. Multimodal learning analytics' past, present, and, potential futures[C]//Proceedings of the Second Multimodal Learning Analytics Across (Physical and Digital) Spaces. Sidney,Australia: CEUR,2018: 1-16.

[5] MARTINEZ-MALDONADO R,ECHEVERRIA V,SANTOS O C,et al. Physical learning analytics: a multimodal perspective[C]//Proceedings of the 8th International Conference on Learning Analytics & Knowledge. New York:ACM,2018:375-379.

[6] 郑旭东,马云飞.脑电图技术的教育研究图景与趋势——基于2000—2019年国际文献的知识图谱分析[J].现代远程教育研究,2020,32(4):36-47.

[7] SCHNEIDER J,BRNER D,ROSMALEN P V,et al. Augmenting the senses: a review on sensor-based learning support[J]. Sensors,2015,15(2):4097-4133.

[8] 牟智佳.多模态學习分析:学习分析研究新生长点[J].电化教育研究,2020,41(5):27-32,51.

[9] DI MITRI D,SCHNEIDER J,SPECHT M,et al. From signals to knowledge: a conceptual model for multimodal learning analytics[J]. Journal of computer assisted learning,2018,34(4): 338-349.

[10] RACA M, DILLENBOURG P. Holistic analysis of the classroom[C]//Proceedings of the 2014 ACM Workshop on Multimodal Learning Analytics Workshop and Grand Challenge. New York:ACM,2014:13-20.

[11] BOTHA S, AFRICA E K. The effect of a perceptual-motor intervention on the relationship between motor proficiency and letter knowledge[J]. Early childhood education journal,2020,48(6):727-737.

[12] ECHEVERRA V, AVENDAO A, CHILUIZA K, et al. Presentation skills estimation based on video and kinect data analysis[C]//Proceedings of the 2014 ACM Workshop on Multimodal Learning Analytics. New York:ACM,2014:53-60.

[13] HUSSAIN M. S, MONKARESI H, CALVO R A. Categorical vs. dimensional representations in multimodal affect detection during learning[M]//CERRI S A, CLANCEY W J, PAPADOURAKIS G, PANOURGIA K.ITS 2012: intelligent tutoring systems. Berlin, Heidelberg: Springer, 2012:78-83.

[14] EKATERINA K, DAVID L, STEPHAN M J. Wearable sensors in medical education: supporting hand hygiene training with a forearm EMG[C]//Proceedings of the 12th International Conference on Wearable Micro and Nano Technologies for Personalized Health. Amsterdam:IOS Press,2015:286-291.

[15] OVIATT S, COHEN A, HANG K, et al. Multimodal learning analytics data resources: description of math data corpus and coded documents[C]// Proceedings of the 15th ACM on International Conference on Multimodal Interaction. New York:ACM,2013:1-47.

[16] LU O, ANDRADE A, ALBERTO R, et al. Using a cluster-based regime-switching dynamic model to understand embodied mathematical learning[C]//Proceedings of the 10th International Conference on Learning Analytics and Knowledge. New York:ACM,2020: 496-501.

[17] ALYUZ N, OKUR E, OKTAY E, et al. Semi-supervised model personalization for improved detection of learner's emotional engagement[C]//Proceedings of the 18th ACM International Conference on Multimodal Interaction. New York:ACM,2016:100-107.

[18] CHIKERSA P, TOMPROU M, KIM Y J, et al. Deep structures of collaboration: physiological correlates of collective intelligence and group satisfaction[C]// Proceedings of the 2017 ACM Conference on Computer Supported Cooperative Work and Social Computing. New York:ACM,2017:873-888.

[19] SPIKOL D, RUFFALDI E, DABISIAS G, et al. Supervised machine learning in multimodal learning analytics for estimating success in project-based learning[J]. Journal of computer assisted learning,2018,34(4):366-377.

[20] LI X,YOUNES R, BAIRAKTAROVA D, et al. Predicting spatial visualization problems' difficulty level from eye-tracking data[J]. Sensors,2020,20(7):1949-1964.

[21] D'MELLO S K, OLNEY A M, BLANCHARD N, et al. Multimodal capture of teacher-student interactions for automated dialogic analysis in live classrooms[C]// Proceedings of the 2015 ACM on International Conference on Multimodal Interaction. New York:ACM,2015:557-566.

[22] DIKKER S, WAN L, DAVIDESCO L, et al. Brain-to-brain synchrony tracks real-world dynamic group interactions in the classroom[J]. Current biology,2017,27(9):1375-1380.

[23] ALZOUBI O, D'MELLO S K, CALVO R A. Detecting naturalistic expressions of nonbasic affect using physiological signals[J]. IEEE transactions on affective computing,2012,3(3):298-310.

[24] GRAFSGAARD J F, WIGGINS J B, BOYER K E, et al. Predicting learning and affect from multimodal data streams in task-oriented tutorial dialogue[C]// Proceedings of the 7th International Conference on Educational Data Mining. London,UK: CEUR,2014:122-129.

[25] SOLEYMANI M J, LICHTENAUER T P, PANTIC M. A multimodal database for affect recognition and implicit tagging[J].IEEE transactions on affective computing,2012,3(1):42-55.

[26] 田阳,陈鹏,黄荣怀,曾海军.面向混合学习的多模态交互分析机制及优化策略[J].电化教育研究,2019,40(9):67-74.

[27] SHANKAR S K, RUIZ-CALLEJA A, SERRANO-IGLESIAS S, et al. A data value chain to model the processing of multimodal evidence in authentic learning scenarios[C]// Proceedings of CEUR Workshop LASI Spain. Vigo,Spain: CEUR,2019:71-83.

[28] CUKUROVA M, LUCKIN R, MILLAN E, et al. The NISPI framework: analysing collaborative problem-solving from students' physical interactions[J]. Computers & education,2018(116): 93-109.

[29] CHEN L, FENG G, JOE J, et al. Towards automated assessment of public speaking skills using multimodal cues[C]//Proceedings of the 16th International Conference on Multimodal Interaction. New York:ACM,2014:200-203.

[30] GROVER S, BIENKOWSKI M, TAMRAKAR A, et al. Multimodal analytics to study collaborative problem solving in pair programming[C]//Proceedings of the Sixth International Conference on Learning Analytics & Knowledge. New York:ACM,2016:516-517.

[31] LAHAT D, ADAL T, JUTTEN C. Multimodal data fusion: an overview of methods, challenges, and prospects[J]. Proceedings of the IEEE,2015,103(9):1449-1477.

[32] BALTRUAITIS T, AHUJA C, MORENCY L P. Multimodal machine learning: a survey and taxonomy[J]. IEEE transactions on pattern analysis and machine intelligence,2019,41(2):423-443.

[33] NEWELL A. Unified theories of cognition[M]. Cambridge,MA:Harvard University Press,1994.

[34] ANDERSON J. Spanning seven orders of magnitude: a challenge for cognitive modeling[J]. Cognitive science,2002,26(1):85-112.

[35] 王萍.人工智能在教育視频中的应用分析与设计[J].电化教育研究,2020,41(3):93-100,121.

[36] WISE A F, SHAFFER D W. Why theory matters more than ever in the age of big data[J]. Journal of learning analytics,2015,2(2): 5-13.

[37] VAN DER MAAS H L, WAGENMAKERS E J. A psychometric analysis of chess expertise[J]. The American journal of psychology, 2005,118(1):29-60.