基于改进的长短期记忆网络的调制识别算法

2021-02-05任思睿

任思睿,黄 铭

(云南大学 信息学院,云南 昆明 650500)

随着无线通信技术的发展,无线电资源逐渐成为一种重要的国家战略资源. 为了保证无线通信安全运作,无线通信调制识别技术越来越重要[1]. 然而传统的无线通信调制识别技术主要基于操作员的部分先验知识进行人工监测与分类,在通讯环境愈发复杂的今天,传统的调制识别技术已经很难满足实际应用的需要.

自动调制分类(Automatic Modulation Classification,AMC)技术在这样的背景下应运而生,且在军民领域都有了许多的实际应用[1-7]. 在军事领域上,准确识别通信信号的调制类型往往意味着能通过估计参数来设计解调模型,截获关键信息,从而可以有针对性地进行军事行动规划和部署. 在民用领域中,常有不法分子通过黑广播等方式传播有害信息,相关部门可以利用通信信号调制识别技术区分正常信号和非法信号,从而打击非法无线电活动,保障无线通信安全. 在实际运用中,自动调制分类技术可以设计一个自动区分识别调制方式的分类器,通过调制方式来确定信号种类,监测无线信号是否存在自然干扰与人为干扰.

AMC技术可以分为两类[1],基于决策论和基于特征. 基于决策论的AMC技术主要以最大似然准则为依据来分类调制方式,理论上这类方法有着最低的误判率,然而在处理大量数据时计算复杂度过大是这类方法的一个严重缺陷,同时由于设计或选择似然函数时需要足够的先验知识,该类算法在信道状况未知或信道存在时偏、频偏等误差时识别精度会明显下降[8-9]. 基于特征的AMC技术由于近年来机器学习的迅速发展而逐渐成为主流,主要是针对调制方式的一些特征量,通过监督或非监督学习的方式训练神经网络,最后进行分类与识别[10-11]. 当算法选择适当时,基于特征的AMC技术具有易于实施且准确率比较理想的优势,然而现有的一些基于神经网络的调制识别算法也存在一些问题. 文献[12]将数字调制信号通过连续波多普勒(Continuous Wave Doppler,CWD)架构进行时频域的转换,生成信号对应的二维灰度图,再以这些灰度图为数据集使用一种有自适应性的卷积神经网络进行训练并分类信号,该方法需要生成信号的灰度图,这在实际应用中会增加系统结构的复杂度. 文献[13]采用了一种基于双层卷积神经网络(Convolution Neural Network,CNN)的分类器,该模型的输入为时域的同相正交(I/Q)信号,可以识别不同信噪比下的调制信号,由于CNN模型对长时间依赖序列的分类任务表现不佳,其识别精度很难达到最优. 文献[14]设计了一种基于双层长短期记忆(Long Short-Term Memory,LSTM)网络的自动调制分类模型,经过参数调优与对比实验,该模型与支持向量机 (Support Vector Machine,SVM)、随机森林、K近邻和浅层CNN等多种算法相比,对信噪比为−20~20 dB的多种数字调制信号有着更高的识别准确率,对比发现使用双层LSTM结构网络可以达到最优分类性能,但该算法时间代价较高.

以上分析可以看出,在基于深度学习的自动调制识别中,使用CNN模型需要将信号原始特征转换为图形特征再进行训练,而LSTM模型是一种递归网络,常用的图形处理器(Graphic Process Unit ,GPU)并行加速方法无法有效提高其训练效率,导致随着输入数据量的增大与层数的加深,训练时间会大大增加. 在自然语言处理领域中,常用注意力(Attention)机制让模型能在训练中更加关注那些比较重要的特征,减少模型中的参数量. 为了充分利用LSTM网络在处理长时间依赖序列的优势,同时改善LSTM网络在处理大数据集时较低的训练效率,本文设计了一种基于LSTM网络与Attention机制的无线通信信号调制识别算法. 该算法可以有效学习信号的原始特征,避免实际应用中无谓的系统资源浪费;同时Attention机制的引入使本文设计的算法相较于其他基于LSTM网络的调制识别算法在训练效率与准确率上都有明显地提升.

1 LSTM 网络以及 Attention 机制原理

1.1 LSTM 网络基本原理LSTM 网络通过引入一种自循环的机制,使梯度可以随时间变化而变化,从而让自循环过程中的权重根据输入信息动态地变化. 通过门控该种自循环的权重,累积的时间尺度也能进行动态变化. 这种特性让LSTM网络即使在固定参数的情况下,其累积的时间尺度也会随着输入序列的变化而改变[15].

与传统的循环神经网络在每个时间步都重写记忆不同,LSTM会将其学习到的重要特征保存为长期记忆,并根据学习的进行选择性的保留、更新或者遗忘已保存的长期记忆,而在多次迭代中权重始终很小的特征则会被网络视为短期记忆并最终被遗忘. 这种机制使得重要的特征信息会随着迭代的进行一直传递,让网络在处理样本具有长时间依赖性的分类任务中有着更好的性能表现[16-17].

LSTM与普通循环网络类似,每个单元具有相同的输入与输出,但同时LSTM也有更多的参数和控制信息流动的门控单元系统. LSTM最重要的组成部分是状态单元其自环的权重由遗忘门控制(其中t代表时刻,i代表第i个神经元),由sigmoid单元设置为0和1之间的值. 相应的前向传播公式为

其中,x(t)是当前输入向量,h(t)是当前隐藏层输出向量分别是偏置、输入权重和遗忘门的循环权重.

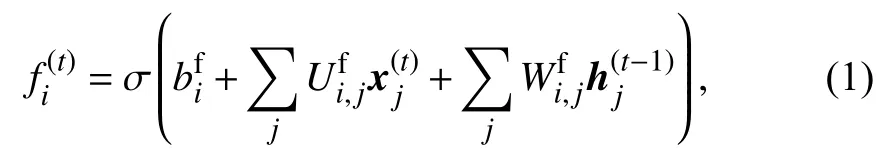

1.2 Attention 机制Ashish Vaswani等于 2017 年提出了在深度学习中加入Attention机制以提升模型性能[18],Attention借鉴了人脑鉴别事物的特点,即专注于事物的某些显著特征,模糊一些不重要的细节,这使人将有限的注意力放在大脑认为重要的地方,提高工作效率,因此Attention机制最初主要被应用于图像识别的领域. 经过一段时间的研究发现,Attention机制与常见于自然语言处理领域的Encoder-Decoder模型能很好地结合,Encoder-Decoder模型具有较强的通用性,Attention机制开始在不同的领域流行[19-20]. Attention模型一般结构如图1[21]所示.

图 1 Attention 模型一般结构Fig. 1 Standard structure of Attention model

图1中X1、X2、X3、X4由原始数据A、B、C、D经过编码得到,经过Z0的Attention权值向量加权后再归一化产生C0并将其输入到解码器,其中通过一种对齐概率的计算方式得到,这种函数一般称为评分函数. 文中使用最常用的乘积矩阵,其公式为[20]

2 算法与模型设计

在基于特征的AMC技术中常用的深度学习主要是CNN模型与LSTM模型. CNN模型由于对长时间依赖序列处理能力不佳,基于CNN模型的调制识别技术一般需要先将信号原始特征转换为图像特征再传入CNN进行学习,这在实际应用中往往会大幅增加系统架构的复杂程度. 而基于LSTM的调制识别技术在输入数据量增加或者网络层数增加时训练的时间代价会迅速增长.

近年来开始将Attention机制运用于信号识别邻域的应用[22],深层网络在学习调制信号频谱经过图像编码产生的灰度图特征后对MPSK、FSK、AM、QPSK信号进行了分类,其对信噪比为−20 dB的信号分类准确率为48%,对信噪比为20 dB的信号分类准确率为98%.

本文设计了一种带有Attention机制的LSTM网络无线通信调制分类算法. 首先通过LSTM网络提取信号的原始特征,再利用Attention机制为经过LSTM提取的特征向量分配注意力权重,将那些较为“显著”的特征集合进行高度总结后输入分类器产生分类结果. Attention机制的引入可以使模型在训练时始终关注那些较为“显著”的特征,不仅可以降低训练时的参数从而提升训练效率,还能提升模型的分类准确率.

本文设计的算法的结构框图如图2所示.

图 2 结合 Attention 机制的 LSTM 网络结构Fig. 2 LSTM network structure combined with Attention mechanism

输入层读取数据集中的数据向量并将其传入网络.

LSTM层主要负责接收样本数据并从样本数据中学习特征信息. 其神经元个数为128,采用L2正则化,L2范数为0.001,同时设置网络为双向网络,即后一个神经元的状态值也会反向传回前一个节点.

Attention层主要负责对LSTM层中学习到的特征集合分配相应的注意力权重. 该层采用sigmoid激活函数,评分函数为乘积矩阵. 由于数据集中向量个数也是输入向量的一个维度,我们希望这一维的每一个向量单独拥有一个Attention权重,即每一个输入都对应Attention层的一个输出,因此需要将Attention层放在LSTM层之后.

全连接层将得到的特征向量经过softmax分类器归一化产生分类概率并将其输出.

本文训练模型时损失函数为交叉熵损失函数,优化器采用AdamOptimizer,具体的训练过程如下所示:

步骤 1初始化模型中的超参数,其中学习率设定为 0.000 1;

步骤 2将训练集中的154 000个样本用大小为256的batch进行切分;

步骤 3随机选取一个生成的batch送入神经网络进行训练;

步骤 4LSTM层对输入网络的batch中的数据进行特征提取,再由Attention层为提取后的特征图设置注意力权重,最终全连接层根据注意力加权后的特征图生成分类向量并由softmax分类器输出分类结果;

步骤 5根据交叉熵损失函数计算本次训练的损失;

步骤 6Adam优化器根据本次训练结果更新网络的超参数;

步骤 7将步骤3~6定义为模型的一次迭代过程,重复这种迭代直至模型的分类准确率在多次迭代后已不再发生明显的改变.

3 实验与结果分析

3.1 数据集选择本文使用 RadioML2016.10a 数据集[23]来验证本文所设计的算法,该数据集的具体参数见表1.

表 1 RadioML2016.10a 数据集的参数Tab. 1 The parameters of RadioML2016.10a dataset

该数据集通过GNU Radio生成,数据为涵盖了各种被广泛使用的调制方式的正交同相(I/Q)信号,同时该数据集中的数据也存在如多径衰落产生的高斯白噪声、频率偏移等常见的信道误差,信噪比范围广,能较为真实地模拟各种情况的信号.

3.2 实验与分析为了验证LSTM网络在学习信号原始特征时是否较CNN具有优势,使用RadioML2016.10a数据集分别训练文献[13]提出的双层CNN模型以及文献[14]提出的双层LSTM模型,并比较它们对不同信噪比信号的分类准确率. 本文的实验平台为:Intel Corei7-8700 CPU@ 3.20GHz 的处理器; NVIDIA Geforce GTX 1070;内存16GB.

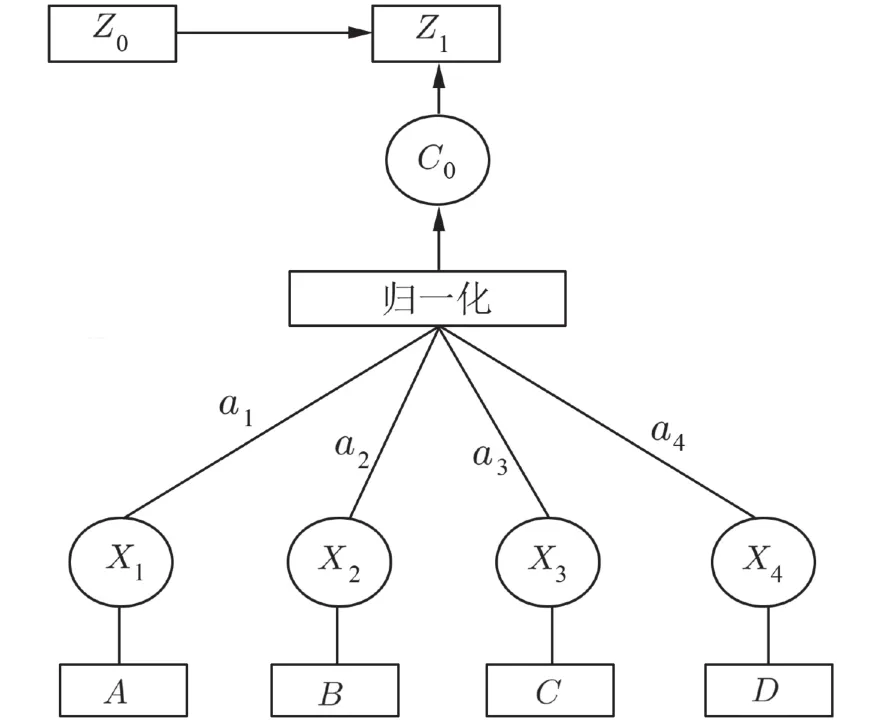

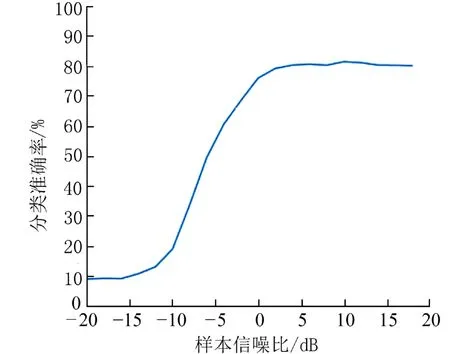

其实验结果分别如图3、图4所示. 图 3中CNN2模型的分类准确率在样本信噪比为18dB时为81%,而图4中双层LSTM网络模型在相同信噪比下的识别准确率达到了89%.

图 3 双层CNN网络在不同信噪比下的分类准确率Fig. 3 Classification accuracy of 2-layers CNN on different SNRs

图 4 双层LSTM网络在不同信噪比下的分类准确率Fig. 4 Classification accuracy of 2-layers LSTM on different SNRs

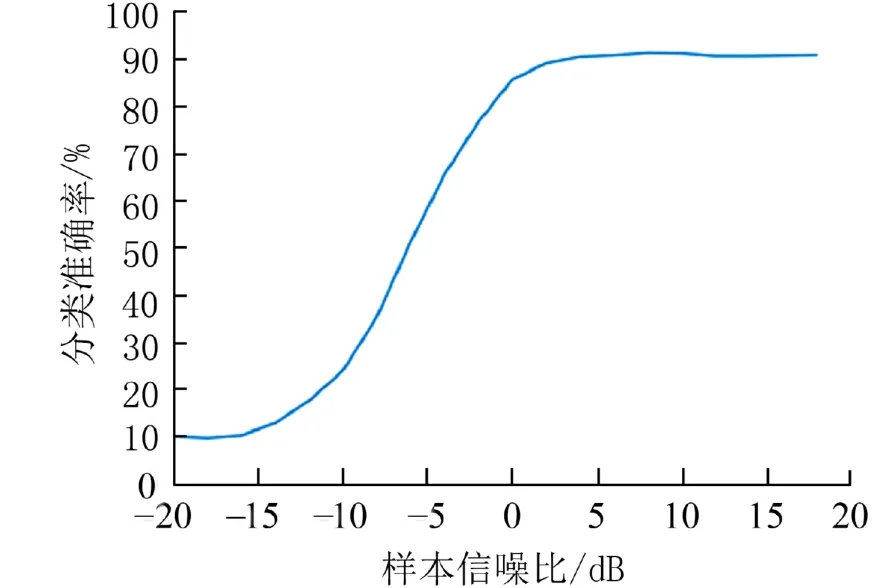

可以看出双层LSTM网络模型的总体识别准确率比双层CNN模型有较大优势,证实了本文选用LSTM模型作为学习信号原始特征的基准模型的正确性. 接着对比双层LSTM模型与本文设计算法的总体准确率如图5所示,可以看出在引入注意力机制后LSTM网络的分类准确率在信号信噪比为18 dB时可以达到92%,可见本文提出的算法具有较高的分类准确率.

图 5 带有注意力机制的LSTM网络在不同信噪比下的准确率Fig. 5 Classification accuracy of Attention-based LSTM network on different SNRs

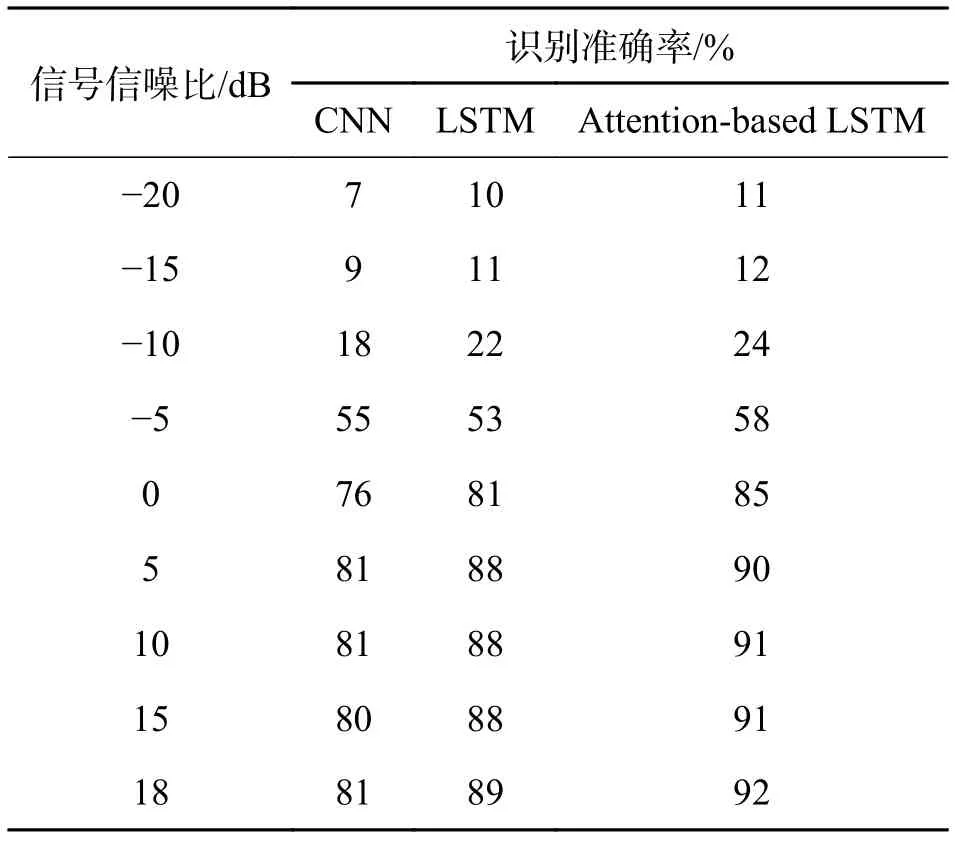

双层CNN模型、双层LSTM模型与本文设计模型的具体准确率如表2所示,对信噪比范围−20~18 dB的信号本文提出算法的识别准确率都高于传统的CNN网络以及LSTM网络的识别准确率.

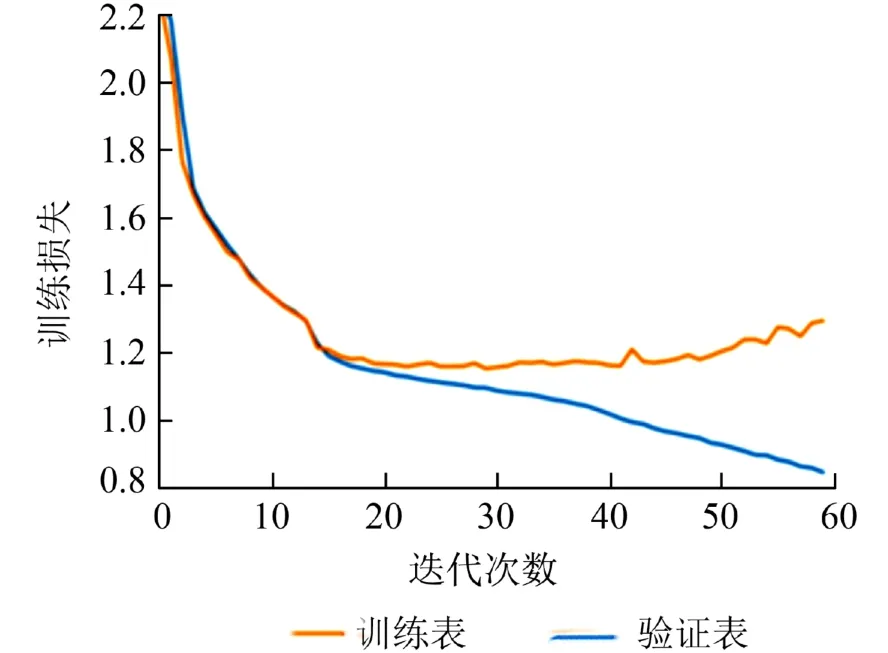

接着对双层LSTM网络与本文设计算法的训练表现进行了对比(图6、图7),可以看出在引入Attention机制后模型的泛化性能也有了一定的提升. 双层LSTM网络在迭代20次之后就出现了过拟合的现象,而带有Attention机制的LSTM网络在训练过程中训练集与测试集的拟合程度始终较好.

表 2 3 种算法在不同信噪比下的识别准确率Tab. 2 Recognition accuracy of three algorithms on different SNR

图 6 双层 LSTM 网络的训练表现Fig. 6 Training performance of 2-layers LSTM

图 7 带有注意力机制的LSTM网络的训练表现Fig. 7 Training performance of Attention-based LSTM network

进一步对比分析Attention机制对网络训练效率的影响,上述3种调制识别算法的平均单次迭代时间如表3所示,可以看出Attention机制的引入减少了训练过程中的参数数量,降低了训练中的时间消耗,带有Attention机制的LSTM网络的单次迭代时间平均仅为232 s,仅为双层LSTM模型平均单次迭代时间的一半,而双层CNN模型由于能使用GPU有效并行加速其平均单次迭代时间最短,但准确率与另外两种算法差距较大.

表 3 3 种算法的平均单次迭代时间Tab. 3 Average single epoch time of three algorithm

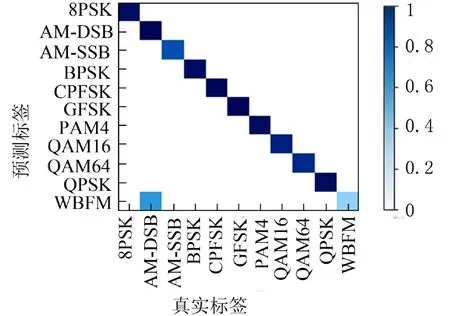

综上可以看出本文所设计的算法通过引入Attention机制,有效解决了传统了基于LSTM网络的调制识别技术的训练效率不佳的问题,同时在识别准确率上也有一定的优势. 最后通过本文设计算法的混淆矩阵(图8)分析其对各类调制信号的分类准确率.可以看出在信噪比为18 dB时,本文所提出的算法在区分WBFM和AM-DSB这两种信号时比较困难,这主要是由于原始数据集中,这两种调制方式的样本是由实际音频流生成,在这个过程中有一段音频流的中断期,导致这两种调制方式的有许多相似的样本,影响了识别的准确率. 而对于AM-DSB与AM-SSB以及QAM16和QAM64这两组信号,由于调制方式较为相似,模型很难学习到能有效区分它们的特征,导致分类结果存在一些误判的情况,但本文所设计的算法对这两组信号的总体识别准确率依然在90%以上.

图 8 信噪比为 18 dB 时带有注意力机制的 LSTM 网络的混淆矩阵Fig. 8 Confusion matrix of Attention-based LSTM with 18 dB SNR

4 总结与展望

本文旨在利用常用于图像识别与自然语言处理中的Attention模型,针对性地解决调制识别中由于输入数据维度大而造成的计算时间增长和准确率下降的问题,实验结果表明,本文所设计算法准确率对信噪比为−20~18 dB的信号识别准确率较高,且本文提出的算法的时间代价与传统的LSTM网络模型相比较小.

由于实验条件限制,本文中用于实验的信号数据均为软件仿真产生,未来应采集真实无线电通信环境中的调制信号进行进一步实验以更好的验证本文提出的算法的有效性. 本文设计的算法源码可于https://github.com/desolating/-att-lstm_mod-rec查看.