基于Lab颜色空间的非监督GMM水稻无人机图像分割

2021-02-01曹英丽林明童郭忠辉马殿荣许童羽

曹英丽 林明童 郭忠辉 肖 文 马殿荣 许童羽

(1.沈阳农业大学信息与电气工程学院, 沈阳 110866; 2.辽宁省农业信息化工程技术中心, 沈阳 110866;3.沈阳农业大学农业农村部东北水稻生物学与遗传育种重点实验室, 沈阳 110866)

0 引言

农田作物信息的快速获取与解析是开展精准农业实践的前提和基础,是突破制约中国精准农业应用发展瓶颈的关键。作物生长期预测[1]、作物品系检测[2]、覆盖作物识别[3]、叶病检测[4-5]和作物生物量监测[6]都高度依赖于作物分割算法的性能。作物分割在农业信息自动化中起到基础性的作用[7]。

文献[8-9]提出了基于多色彩空间和支持向量机的Multi-SVM分割方法,将支持向量机(SVM)和最大类间方差法(OTSU)相结合,用于水稻冠层图像分割。文献[10]采用卷积神经网络和超像素优化的深度学习方法,提出稻穗分割算法Panicle-SEG。文献[11]综合考虑分割性能和计算速度,提出基于SegNet的PanicleNet算法,其精度远优于Panicle-SEG算法,且计算速度约为Panicle-SEG算法的35倍。有研究者将改进的全卷积神经网络应用于云杉图像分割[12]、柑橘分割[13]、牧草识别[14]和棉田分割[15]。文献[16]提出一种弱监督深度学习方法,可以使用少量的弱监督标签对农田图像进行分割。

以上研究均基于监督学习,需要大量的标记训练数据,消耗大量的人力和物力。监督学习算法的性能在很大程度上依赖于训练数据集的质量。由于作物种植环境复杂,不同图像的像素具有不同的统计特性。例如,光照和天气条件对不同图像稻穗像素的统计分布有极大的影响。即使采用大量不同环境下拍摄的图像对监督算法进行训练,单一训练模型也难以捕捉到不同图像间的巨大差异。在一个图像集上训练的算法,在其他不同环境下拍摄的图像集上可能会表现不佳。因此,迫切需要开发一种非监督学习算法,能够学习、识别和适应每个图像的潜在统计特性,从而在多种情况下能够取得很好的表现,且不需要对大量图像进行标记。

近年来,非监督的作物图像分割方法取得了一些进展。文献[17]将K-means聚类与图分割相结合(KCG),从背景图象中分离出水稻籽粒,从而预测水稻产量。针对背景和杂草干扰下的果树图像冠层提取问题,文献[18]提出了一种基于M-LP特征加权K-means聚类的冠层分割算法。文献[19]研究了一种基于自适应聚类数的改进K-means算法,对番茄叶片图像进行分割。文献[20]提出一种非监督贝叶斯学习方法,基于RGB图像对水稻穗图像进行分割,该算法通过识别同一图像中穗像素和非穗像素统计分布的内在差异实现穗检测,不需要训练。在该非监督学习方法中,用一个多元高斯混合模型(GMM)代表一个图像的像素强度,GMM的每个分量对应一个可能的类别。模型参数从每个独立、未标记的无人机RGB图像直接学习获得。不同的图像会有不同的模型参数,该算法能够适应各种不同环境拍摄的图像。但是,在田间作业条件下,水稻冠层图像的RGB颜色特征显著受光强影响,基于RGB颜色空间的分割方法的稳健性和精确度较低[21]。Lab颜色空间将颜色属性从光强属性中独立出来,可以在一定程度上降低野外多变光强环境的影响[22]。

为解决以上问题,本文提出一种基于Lab颜色空间的非监督贝叶斯GMM田间水稻无人机图像分割方法,自动分析未标记图像像素的统计特性,无需训练,降低田间多变光照强度的影响,以期为精准农业航空研究提供支持。

1 材料与方法

1.1 试验设计与数据采集

田间试验于2019年在沈阳市沈阳农业大学(SYAU)路南试验田(123°57′44″ E,41°83′36″ N)进行。沈阳市属温带半湿润大陆性气候,地势平坦,年平均气温6.2~9.7℃,降雨量600~800 mm。

试验设置4个氮处理梯度和5个水稻品种,共20个小区,如图1所示。4个氮肥水平为:N0(0 kg/hm2)、N1(50 kg/hm2)、N2(100 kg/hm2)、N3(150 kg/hm2)。选取辽宁地区5个主栽水稻品种:V1(399)、V2(盐丰47)、V3(桥润粳)、V4(美丰稻)、V5(盐粳糯66)。每小区种植10行,行距0.25 m,列距0.2 m,不同氮肥小区间用土埂隔离,粳稻生长过程中其他试验条件保持一致。

于2019年6月25日(水稻分蘖后期)使用无人机拍摄正射影像。图像采集时间在10:00—12:00,飞行高度分别设置为10 m和15 m。试验期间天气晴朗,无风或微风。采用大疆精灵4(PHANTOM4)型无人机作为遥感平台,最大可承受风速为10 m/s,悬停精度为垂直-0.1~0.1 m、水平-0.3~0.3 m。高清数码相机焦距为35 mm,图像尺寸为4 000像素×3 000像素。共得到拍摄高度10 m图像259幅,拍摄高度15 m图像178幅。使用Pix4DMapper软件分别对10 m和15 m图像进行拼接处理,获取水稻试验田高度10 m和15 m全景图。在高度10 m试验田全景图中,利用Photoshop软件随机截取5幅300像素×300像素的图像;在高度15 m试验田全景图中,随机截取5幅200像素×200像素的图像,共截取10幅图像。

1.2 关键颜色特征集构建

田间多变光强条件显著影响拍摄图像的RGB颜色空间像素值,从而影响图像分割算法的精确性和稳定性。Lab颜色空间能在一定程度上降低光强变化的影响。对于彩色图像处理,颜色空间的建立及选择非常重要,颜色空间是彩色图像处理、分析和理解的基础,颜色空间的选取将直接影响彩色图像的处理方法及效果。

计算无人机图像的颜色特征L、a、b,另外获取其R、G、B和H、S、V颜色特征。获取的无人机图像以RGB颜色空间存储,将RGB颜色空间图像转换为HSV和Lab颜色空间图像,得到H、S、V、L、a、b以及R、G、B共9个颜色特征子空间,即原始RGB彩色图像被分解为9个灰度图像。其中颜色特征H、S、V与R、G、B的转换关系为

(1)

(2)

(3)

其中

(4)

另外,颜色特征L、a、b与R、G、B的转换关系可表示为

L=116f(Y)-16

(5)

(6)

(7)

其中

(8)

(9)

本文分别选取颜色特征L、a、b用于非监督贝叶斯方法的图像分割,另外将R、G、B,H、S、V和全部9个颜色特征的分割结果进行比较。分割方法分别记为Lab-GMM和RGB-GMM、HSV-GMM、All-GMM。

1.3 贝叶斯框架下的图像分割模型

监督学习算法需要大量的标记训练图像,这需要极大的人工成本。且单一的训练模型难以捕捉不同图像间的巨大差异。在一个图像集上训练的算法,在其他不同环境下拍摄的图像集上可能效果不佳。本文采用非监督贝叶斯方法进行图像分割,不需要标记训练数据。在贝叶斯框架下,用一个多元高斯混合模型(GMM)代表一个图像的像素强度,GMM的每个分量对应一个可能的类别。在该非监督学习方法中,模型的参数直接从每个独立的未标记图像获得,不同的图像对应不同的模型参数,这使得该算法能够适应不同环境下拍摄的图像。

假设每个无人机图像包含N个像素,则可将图像表示为

X=[x1x2…xi…xN]

(10)

其中

xi=[xi1xi2…xip]T

(11)

式中p——颜色特征数

若选取颜色特征L、a、b,则p=3,且xi1、xi2、xi3分别对应第i个像素的颜色特征L的值、颜色特征a的值和颜色特征b的值。

图像中的每个像素都被分为K个类别之一,如水稻、泥土等。K由人为给定,在本文中K为2。定义隐变量Z指示图像像素的类别

Z=[z1z2…zi…zN]

(12)

式中zi——像素i所属类别

假设观测数据X由高斯混合模型生成

(13)

其中Θ={{q1,q2,…,qk},{μ1,μ2,…,μk},

{Φ1,Φ2,…,Φk}}

(14)

式中qi——像素属于第i类的概率

μi——第i类对应多元高斯分布的均值向量

Φi——第i类对应多元高斯分布的协方差矩阵

本文的目标是基于无人机数码图像X,通过非监督贝叶斯分类器识别所有像素的类别Z。最大后验概率(MAP)决策方法能够最大化zi的后验概率

(15)

式中,Θ通过EM算法进行估计。

1.4 期望最大化算法

EM(Expectation-Maximization)算法是一种迭代优化算法,常用于包含隐变量的概率模型的参数估计。本文采用EM算法,最大化高斯混合模型参数的对数似然函数L(Θ)来估计模型参数,具体步骤如下:

(2)E步

(16)

(3)M步

(17)

(18)

(19)

(20)

(4)重复步骤(2)和步骤(3),直到参数收敛。

(21)

(22)

(23)

(24)

(25)

1.5 精度评价

为评估该非监督贝叶斯学习方法的精度,将无人机图像像素人工标记为植被和非植被。通过软件分析发现,图像中不存在纯红像素(R=255,G=0,B=0),故在Photoshop软件将水稻像素标记为纯红色,则未标记部分即为非水稻像素。人工标记的结果作为评估的基准,通过逐个像素比较人工标记结果和自动分割图像来定量评估算法的结果。

根据分割结果和人工标记结果计算查全率R(Recall)、查准率P(Precision)和F1值,另外绘制ROC曲线并计算ROC曲线下的面积AUC值,全面分析算法精度。

2 结果与分析

2.1 非监督贝叶斯方法分割结果

将原始RGB无人机图像进行颜色空间转换得到颜色特征向量集,包含R、G、B、H、S、V、L、a、b共9个颜色特征向量。建立基于Lab颜色空间、RGB颜色空间、HSV颜色空间以及全部9个颜色特征的贝叶斯模型(Lab-GMM、RGB-GMM、HSV-GMM和All-GMM)。高度10、15 m不同植被覆盖度梯度的图像分割结果如图2、3所示。

图2、3的视觉比较表明自动检测结果和人工标记结果有很强的相关性。HSV-GMM和All-GMM仅大致分辨出植被像素和非植被像素,效果一般;RGB-GMM和Lab-GMM均能较准确地对图像进行分割,分割结果与人工标记结果有很强的相关性。

2.2 水稻冠层图像分割结果定量评价

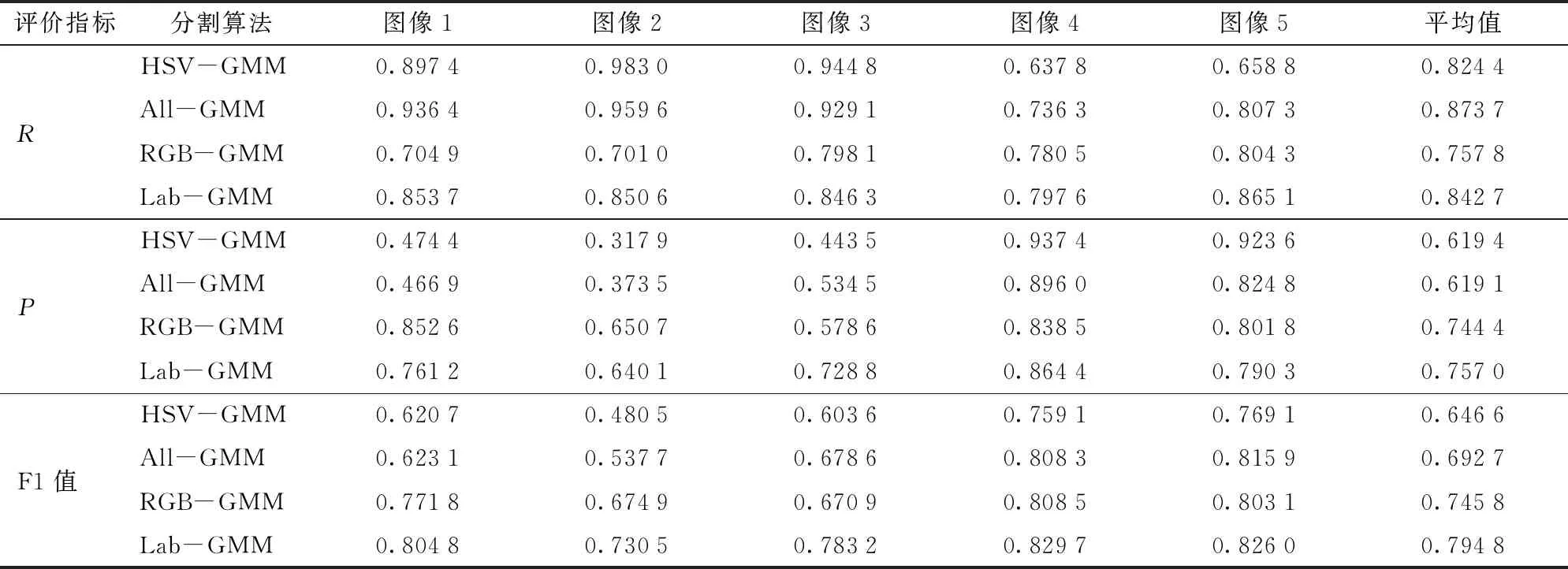

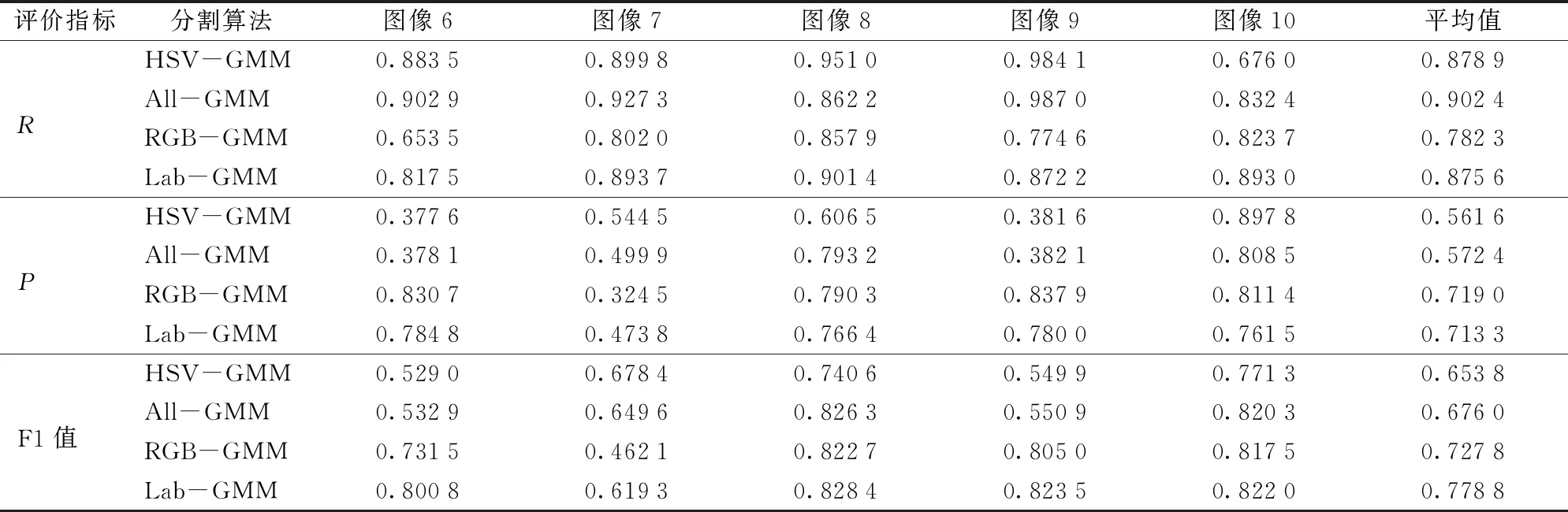

为验证基于不同颜色特征集的高斯混合模型对获取的水稻冠层无人机图像的分割效果,以人工分割的水稻冠层图像作为基准,计算Lab-GMM和RGB-GMM、HSV-GMM、All-GMM分割方法的查全率R、查准率P和F1值,其结果如表1和表2所示。

HSV-GMM和All-GMM的查全率较高,对于高度10 m图像,HSV-GMM的平均查全率达到0.824 4,All-GMM的平均查全率达到0.873 7;对于高度15 m图像,HSV-GMM的平均查全率达到了0.878 9,All-GMM的达到了0.902 4。然而,这2种算法的查准率偏低,对于高度10 m图像,平均查准率仅为0.619 4和0.619 1;对于高度15 m图像,仅为0.561 6和0.572 4。HSV-GMM和All-GMM查全率高而查准率低的情况导致了较低的F1值,对于高度10 m图像,2种算法的平均F1值仅为0.646 6和0.692 7;对于高度15 m图像,为0.653 8和0.676 0。HSV-GMM和All-GMM的分割效果不太理想。

表1 高度10 m图像分割结果对比Tab.1 Comparing results of images segmentation at 10 m height

表2 高度15 m图像分割结果对比Tab.2 Comparing results of images segmentation at 15 m height

RGB-GMM能较准确地识别出水稻像素,对于高度10 m图像,RGB-GMM的平均查全率、平均查准率和平均F1值分别为0.757 8、0.744 4和0.745 8;对于高度15 m图像,分别为0.782 3、0.719 0和0.727 8。RGB-GMM的查全率和查准率均较高,这使得F1值也较高。RGB-GMM的分割效果较好,明显优于HSV-GMM和All-GMM。

Lab-GMM算法能够准确分割图像。对于高度10 m图像,Lab-GMM的平均查全率、平均查准率和平均F1值分别为0.842 7、0.757 0和0.794 8,分别比RGB-GMM高0.084 9、0.012 6和0.049;对于高度15 m图像,Lab-GMM的平均查全率、平均查准率和平均F1值分别为0.875 6、0.713 3和0.778 8,平均查全率比RGB-GMM高0.093 3,平均查准率比RGB-GMM低0.005 7,平均F1值比RGB-GMM高0.051。显然,Lab-GMM的性能显著优于RGB-GMM,能够准确识别无人机图像中的水稻像素,具有良好的鲁棒性。

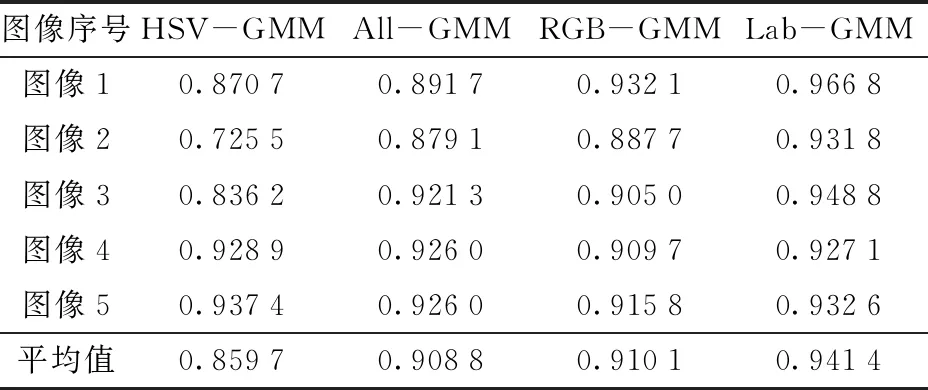

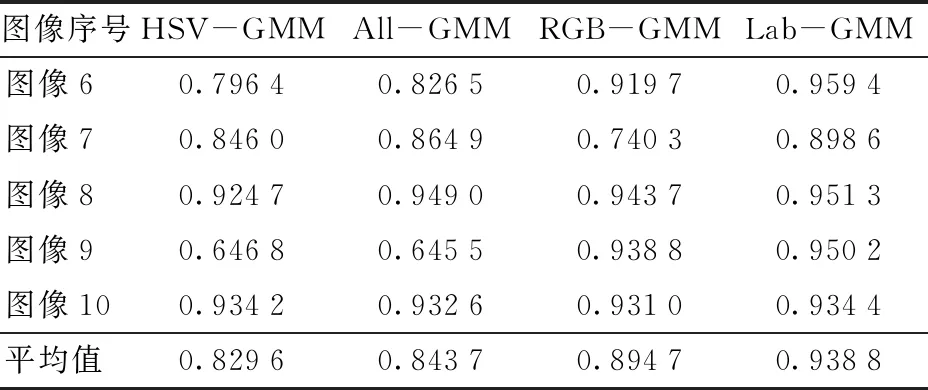

为了更加直观地比较算法之间的性能差异,以FPR(假正例率)为横轴,TPR(真正例率)为纵轴,绘制受试者工作特征曲线(ROC曲线),如图4和图5所示。另外计算了各ROC曲线下的面积,即AUC值,如表3、4所示。

算法在图像4、5、8、10上的表现基本一致。

HSV-GMM和All-GMM算法在图像1、2、3、6、9上的识别效果较差,性能波动大。在高度10 m图像上,HSV-GMM的AUC值最小为0.725 5,平均值为0.859 7;All-GMM的AUC值最小为0.879 1,平均值为0.908 8。在高度15 m图像上,HSV-GMM的AUC值最小为0.646 8,平均值为0.829 6;All-GMM的AUC值最小为0.645 5,平均值为0.843 7。RGB-GMM算法的性能较好,在高度10 m图像上的平均AUC值达到了0.910 1,在高度15 m图像上为0.894 7,优于HSV-GMM和All-GMM算法。

表3 高度10 m图像分割结果的AUC值Tab.3 AUC value of 10 m images segmentation result

表4 高度15 m图像分割结果的AUC值Tab.4 AUC value of 15 m images segmentation result

但是RGB-GMM在图像7上的性能显著下降,AUC值只有0.740 3,这可能是图像7的光照强度不均匀造成的。Lab-GMM算法在全部10幅图像上均表现出良好的性能,在高度10 m和15 m图像上的最小AUC值分别达到0.927 1和0.898 6,平均AUC值达到了0.941 4和0.938 8,比RGB-GMM分别高0.031 3和0.044 1。

Lab-GMM和RGB-GMM算法在10幅图像中的ROC曲线变化较小,性能较稳定,且Lab-GMM始终优于RGB-GMM。这是由于RGB颜色空间易受到光照强度的影响,而光照强度对Lab颜色空间的影响较小。HSV-GMM和All-GMM的ROC曲线基本一致,这是因为在All-GMM中H、S、V颜色特征起主要作用。另外,HSV-GMM和All-GMM在图像4、5、8、10上的ROC曲线与Lab-GMM基本一致,而在其余图像中HSV-GMM和All-GMM的ROC曲线明显在Lab-GMM下方。比较10幅无人机图像,图像4、5、8、10的水稻生长状况明显优于其余图像,使得图像的植被覆盖度较高,其他图像植被覆盖度较低且存在较多水稻阴影。HSV-GMM和All-GMM易将水稻阴影区域分割到水稻类别中,导致图像分割效果不佳。

显然,Lab-GMM算法优于RGB-GMM、HSV-GMM和All-GMM算法,对不同高度和植被覆盖度下获取的水稻冠层图像的分割效果均最佳,具有优越的分割精确度和稳定性,能够准确地识别水稻像素,适用于本文中的无人机图像分割。

2.3 类别区分

本文提出的非监督贝叶斯方法,能够自动分割水稻无人机图像,无需标记训练数据。该算法通过分析像素统计特性的差异,将每个图像的像素分为2类,即水稻和非水稻,但并不能区分k=1为水稻或k=2为水稻。

定义mi表示第i类像素在颜色通道G上的均值,其中i∈{1,2}。基于试验结果,水稻像素在颜色通道G上的均值总是最大,如图6所示。因此,水稻类别可以检测为

(26)

3 结论

(1)研究了基于Lab颜色空间的非监督贝叶斯GMM田间水稻无人机图像分割方法。Lab颜色空间将颜色属性从光强属性中独立出来,在一定程度上可以降低野外多变光强环境的影响。本文采用的非监督学习方法可以对未标记图像直接进行分割,无需训练,这在处理复杂多样的环境和不同高度拍摄的图像时非常有用。试验表明,该算法能够精确识别水稻像素,对不同图像的识别精度稳定,优于现有的基于RGB颜色空间的非监督分割方法。

(2)所提出的算法在高度10 m图像中的平均查全率、平均查准率和平均F1值分别为0.842 7、0.757 0和0.794 8,在高度15 m图像中分别为0.875 6、0.713 3和0.778 8,优于RGB-GMM、HSV-GMM和All-GMM算法。