基于卷积神经网络的农业害虫图像匹配点识别方法

2020-11-02王彤,倪懿

王 彤,倪 懿

1.苏州高博软件技术职业学院,江苏 苏州 215163

2.苏州农业职业技术学院,江苏 苏州 215000

农业害虫为导致全球农业经济损失的主要因素,其依靠不同种类的植物与农作物存活,为农业带来了不同损害[1,2]。农业害虫产生的经济影响是世界范围内的,欧美农业经济损失为30%左右,而亚洲与非洲农业经济损失超过50%[3-5]。从20 世纪60 年代之后,病虫害综合防治变成被广泛应用的虫害防治方式,而农业害虫图像匹配点识别对病虫害综合防治而言非常重要[6]。

传统匹配点识别方法通常是在提取图像局部特征的基础上完成的,如SURF 方法和SIFT 方法等,局部特征主要突出图像细节,有很好的转换鲁棒性,然而对图像中光照等外界环境较为敏感[7,8],可应用场景被限制,在很大程度上会导致图像信息缺失,对农业害虫图像匹配点识别结果产生不好的影响。卷积神经网络从大规模数据中对学习特征进行描述,其逐层提取的特征较为抽象,但有大量语义信息,可提高匹配准确度。提出一种基于卷积神经网络的农业害虫图像匹配点识别方法,卷积神经网络提取的特征有一定的语义信息,并且通过视觉词袋模型构造索引,提高匹配点识别准确性。经实验验证,所提方法在外界环境改变的状态下匹配点识别鲁棒性更优。

1 基于卷积神经网络的农业害虫图像匹配点识别方法

1.1 样本选择和预处理

当前我国常见的农业害虫主要有稻飞虱、白粉病、玉米螟、棉铃虫、小麦锈病、棉蚜、稻纹枯病、稻瘟病、麦蚜、麦红蜘蛛、蝗虫、麦类赤霉病等[9,10],危害相对严重,所以将上述害虫当成研究对象。训练集与测试集是害虫标本与活体图片,图片源于网络。

在采用卷积神经网络方法对农业害虫图像进行处理前,需对其进行去均值处理[11],公式描述如下:

其中,用于描述训练集样本的平均值。通过去均值处理令数据点平均分布于0 点附近,从而方便后续卷积神经网络训练。

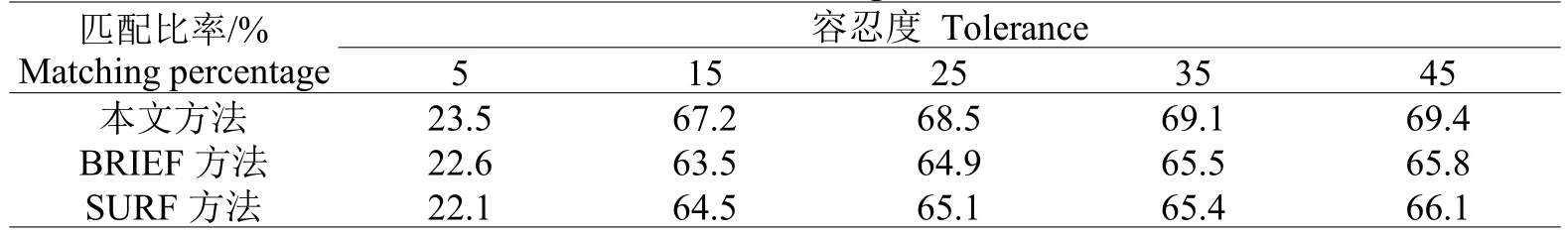

1.2 卷积神经网络提取农业害虫图像

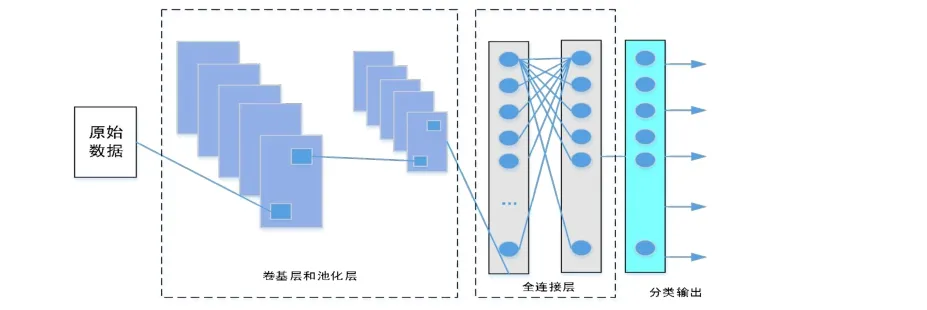

卷积神经网络基本结构主要由输入层、卷积层、池化层、全连接层和学习层等构成[12,13](图1)。

图1 卷积神经网络基本结构Fig.1 The basic structure of the convolution neural network

式中,δ用于描述动量变量;β用于描述动量因子;γ用于描述权重延时;ε用于描述学习率。代表目标函数针对ɷ在第i次迭代过程中产生的批量样本Ci平均梯度。在目标函数趋近于最小值的情况下,因为曲率相对较小,梯度的改变也相对较小,尤其在深度网络中,最后一层梯度通过反向传播方式传输至前面若干层的情况下,梯度将逐渐变小,造成随机梯度下降法收敛速度变慢。梯度下降主要用于对整体样本进行更新[15],随机梯度下降主要用于对样本进行更新,批量随机梯度下降法处于上述二者之间,可对其中一些样本进行更新。

为了提高整个过程的收敛速度,防止随机梯度下降陷于局部最优,针对目标函数,通过Momentum 动量法进行处理。

1.3 通过视觉词袋模型训练卷积神经网络

本节采用建立的数据集对卷积神经网络特征视觉词袋模型进行训练。为了和人工选择特征产生对比,依据通过卷积神经网络提取的农业害虫图像特征,利用k-means 分类计数对全部训练农业害虫图像进行聚类处理,获取六层树形结构,其中除了叶子节点,所有节点均含8 个子节点。

在对位置进行识别的过程中,可通过视觉词袋模型对和目前农业害虫图像类似的候选图像进行训练,防止出现大量匹配点识别过程,提高识别精度。这主要是由于训练完成的词袋模型属于树形结构,这种结构中所有叶子节点通过离线训练获取该节点的离线权重,用于描述该叶子节点的判断性能,离线权重值越高,节点对农业害虫图像匹配点的区分性能越好。

其中,s(i)描述离线权重,M描述全部虫害图像的数量,mi描述出现叶子节点的虫害图像的数量。

在进行测试的过程中,输入一幅农业害虫图像,通过卷积神经网络对其特征进行提取,在所有特征均达到词袋模型的叶子节点的情况下,把所有叶子节点在农业害虫图像中出现的频率与离线权重之间的乘积当成该叶子节点在农业害虫图像中的最终权重,同时把农业害虫图像的位置与权重保存于叶子节点中,当成反向索引。叶子节点在该虫害图像中的权重可通过下式求出:

式中,f(i,I)用于描述叶子节点i在虫害图像I中出现的频率;miI用于描述叶子节点i在农业害虫图像中出现的次数;∑yi用于描述农业害虫图像总特征。

对一幅农业害虫图像中全部特征进行提取并参与计算,能够获取所有叶子节点对该图像的权重,同时把得到的权重组成该农业害虫图像的描述性向量Ji。在对农业害虫图像匹配点进行识别的过程中,仅需对处于同一叶子节点上的匹配点进行相似度计算,即可完成对匹配点的识别,相似度可通过下式计算:

分析上式可以看出,虫害图像匹配点相似程度越高,那么公式分数值就越大,经大量实验设定阈值,将相似度高于阈值匹配点当成识别匹配点。

1.4 防止过拟合

卷积神经网络有很多模型参数,其拟合函数存在很高的非凸性,在进行模型训练的过程中,模型会逐渐变得复杂,训练误差也会逐渐降低,在模型足够复杂的情况下,测试集上的误差反倒会提升,即网络模型在训练的过程中误差较低,然而在测试的过程中误差很大,即为过拟合现象,这样的模型泛化能力相对较差。为了提升卷积神经网络的泛化能力,本节采用数据集扩增以及正则化技术进行处理。数据扩增技术即将农业害虫图像样本xi分割为k个图像块,组成图像块数据袋,从而获取更多图像块,扩增了训练集。在训练过程中的全连接层引入Dropout 技术,Dropout 技术的基本思想为在网络的全连接层,每次向前传播时任意把部分隐藏节点设置成0,这些节点在迭代时停止工作,在进行反向传播的过程中也不更新上述节点的权值。在下次迭代的过程中,以同样的比例任意设置部分节点不工作,进行误差反向传播的过程中也不更新。对参数进行合理设定,从而令迭代过程中不工作比例保持稳定,该参数即为Dropout 率。

另一种避免模型过拟合的技术为针对模型目标函数或代价函数添加正则项。正则项是为了减少模型复杂程度,防止模型区分过拟合训练数据。从别的角度进行分析,正则化也就是假设模型参数满足先验概率,即为模型参数加入先验知识,而不同正则化方式先验分布是存在差异的,据此设定参数分布情况,令模型复杂程度减少,提高对噪声的抑制能力,提高模型泛化能力。

2 结果及分析

将本文提出的基于卷积神经网络的虫害图像特征点匹配方法与基于SURF 的虫害图像特征点匹配方法及基于BRIEF 的虫害图像特征点匹配方法进行比较。

实验环境如下:Intel Xeon E5 处理器,在Ubuntu 环境下开展实验,选用C++编程语言,卷积神经网络程序选用Caffe 框架。

2.1 实验数据集

训练数据集包含Image 数据集与Place 数据集,Image 数据集为农业害虫图像数据集,有1150个类别,Place 数据集代表场景数据集,共有1220 个场景种类,训练集共有260 万张图像。

为了对三种方法的性能进行比较,实验将三个数据集当成测试数据集,依次对视角发生改变、温度环境发生改变与光照发生改变的条件下,匹配点识别效果。

A 数据集为大场景数据集,通过双目摄像头对农业害虫图像与其他场景图像进行拍摄,划分成左视图与右视图两个部分。

B 数据集在春夏秋冬四个季节对相同区域内农业害虫及其它场景图像进行采集。为了对不同季节农业害虫图像匹配点进行识别,实验选择场景温度与外观差异最大的冬季与夏季对应的图像。

C 数据集采用单目摄像头对农业害虫图像与其它场景图像进行采集。在进行实验时,测试数据集C 依次在清晨、中午、下午与傍晚进行。

2.2 性能测试指标

各个数据集均有两组不同环境下位置相应的农业害虫图像,采用任意一组数据构造数据库,将另一组数据当成相应匹配点,在数据库中农业害虫图像匹配点和搜索农业害虫图像匹配点位置对应的情况下,即认为得到识别结果。因为数据集中相邻帧有很高的相似度,所以在进行实验的过程中引入容忍度,也就是和实际匹配点间的间隔,在设定容忍度区间中,都认为识别成功。

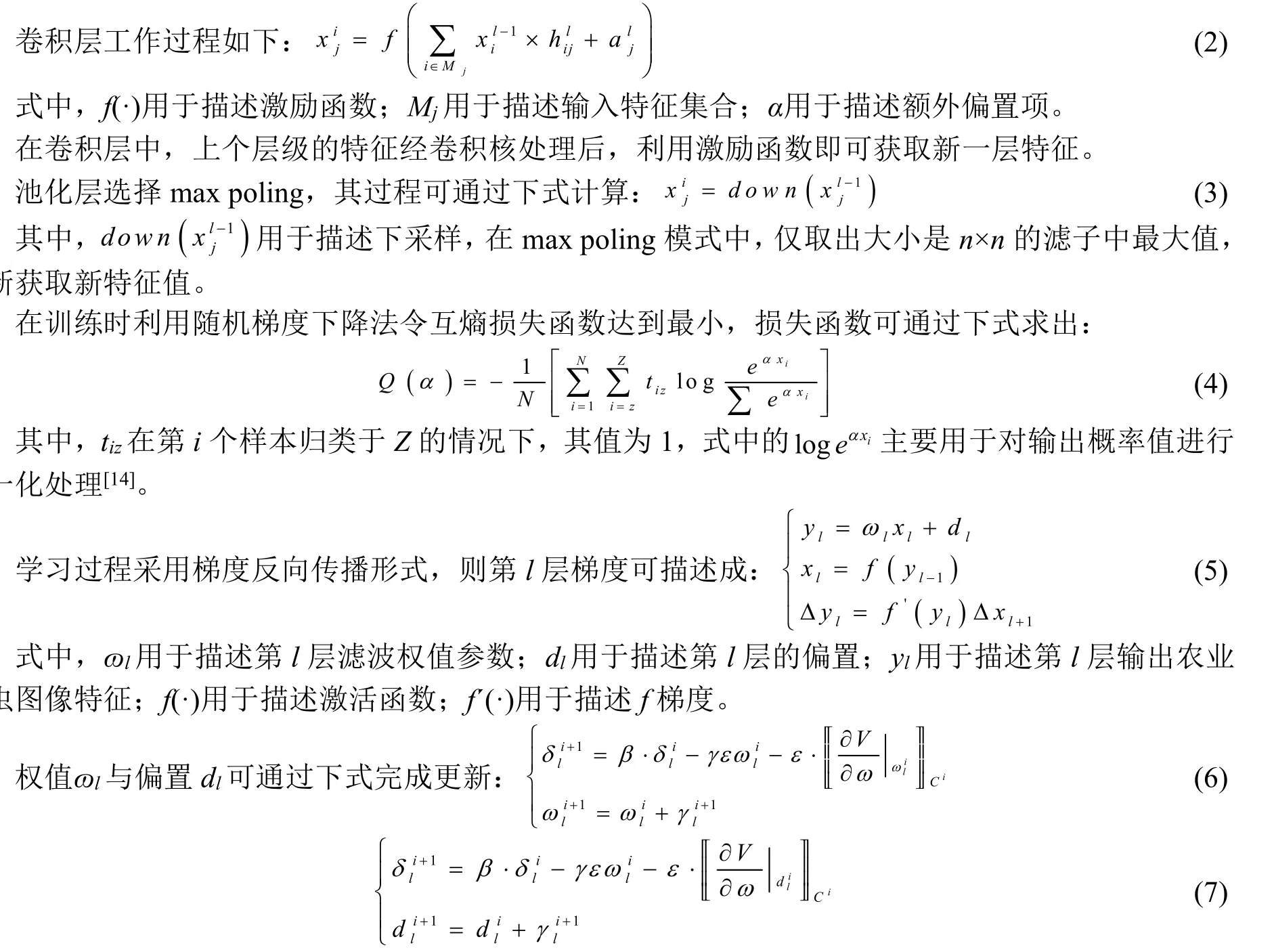

本节把匹配比率当成不同方法识别性能测试指标,公式描述如下:

式中,n用于描述数据库中的图像数量,h用于描述搜寻获取的匹配度最高的匹配点相应图像数量,v用于描述容忍度,gij用于描述第i幅农业害虫图像相应数据库识别结果中分数第j大的图像,Wi(u)用于描述在第i幅待匹配农业害虫图像与容忍度u情况下相应数据库中农业害虫图像集合,xi用于描述第j幅数据库中农业害虫图像。

图2 病虫图像匹配效果图Fig.2 Matching effect of diseases and insects images

本文把得到的实验结果通过数据的形式描述出来,取前4 幅匹配分数最高的农业害虫图像,在不同容忍度下匹配比率的改变情况。

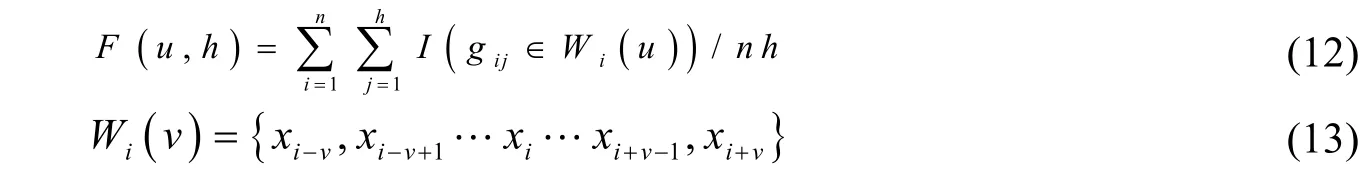

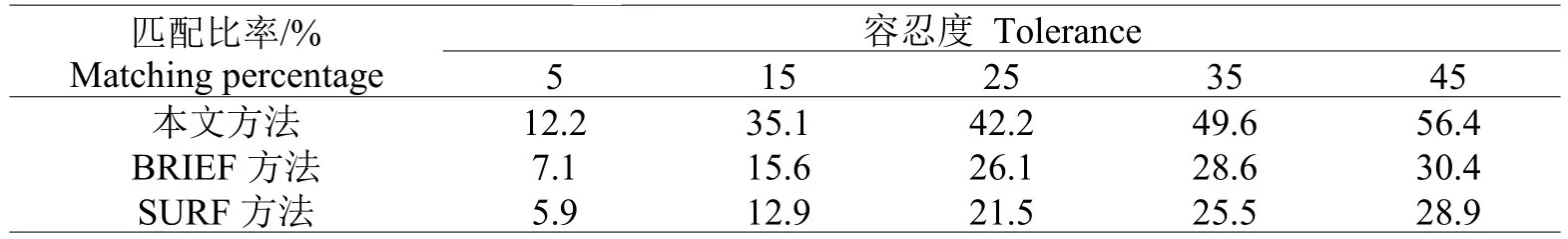

为了验证本文方法的识别精度,将本文方法识别结果和SURF 方法、BRIEF 方法进行比较。在A 数据集下,三种方法的实验结果用表1 进行描述。

表1 数据集A 下三种方法匹配比率Table 1 Three method matching ratios in data set A

分析表1 可知,在视角出现改变的情况下,本文方法和SURF 方法、BRIEF 方法的匹配效果较为类似,都有很好的位置识别性能。这主要是由于在视角出现改变的情况下,两幅农业害虫图像在外观上很接近,并且,SURF 方法、BRIEF 方法都属于依据局部特征完成特征点识别,对视角改变情况下的匹配有一定的鲁棒性。

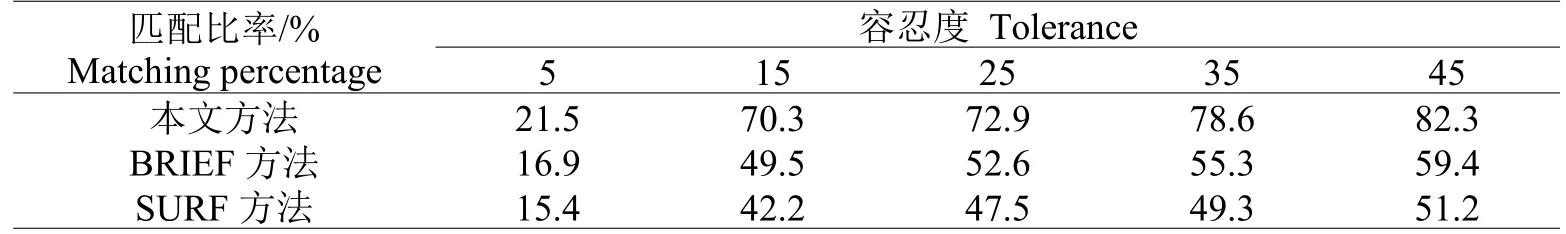

针对B 数据集,三种方法匹配结果用表2 进行描述。分析表2 可知,本文方法匹配比率与SURF方法、BRIEF 方法相比有较大程度的提升,在容忍度相对较大的情况下,本文方法匹配率基本上是其它两种方法的两倍左右,表明本文采用卷积神经网络的方法更优。这主要是因为冬季与夏季,农业害虫图像受季节影响场景差异相对较大,SURF 方法、BRIEF 方法受农业害虫图像中物体颜色等影响匹配性能明显降低,而本文方法尽管也在一定程度上受季节环境的影响,然而本文方法提取特征有一定的语义信息,和SURF 方法、BRIEF 方法相比有更高的匹配精度。

表2 数据集B 下三种方法匹配比率Table 2 Matching ratios of three methods under data set B

针对C 数据集,三种方法的匹配结果用表3 进行描述。分析表3 可知,本文方法匹配比率和SURF方法、BRIEF 方法相比提高了9%~42%,这主要是因为SURF 方法、BRIEF 方法在光照改变的条件下非常敏感,而本文卷积神经网络属于特征描述,更能体现整个虫害图像的整体属性,并且和语义信息结合在一起,在光照发生改变的情况下,对匹配点的识别能力仍旧很高。

表3 数据集C 下三种方法匹配比率Table 3 Matching ratios of three methods under data set C

综合上述实验结果可知,在视角发生改变的情况下,三种方法的匹配比率没有很大的差异,而在季节改变与光照改变的情况下,本文方法的匹配比率明显优于SURF 方法、BRIEF 方法,这主要是因为这两种方法以局部特征为依据,同时对环境的改变非常敏感,而本文方法识别精度很好。

3 结论

本文提出一种基于卷积神经网络的虫害图像匹配点识别方法,通过公开农业害虫数据集训练好的卷积神经网络模型对虫害图像特征进行提取,对视角变化情况下的虫害图像匹配点识别有很好的鲁棒性,提取的特征含语义信息,所以对外观的改变也有很高的鲁棒性。除此之外,通过视觉词袋模型为虫害图像构建索引,提高识别准确性。

实验时,选择数据集A、B、C,在视角、季节与光照发生改变时,对本文方法、SURF 方法、BRIEF 方法的匹配比率进行比较,发现在视角发生改变的情况下,三种方法的匹配比率没有很大的差异,而在季节改变与光照改变的情况下,本文方法的匹配比率明显优于SURF 方法、BRIEF 方法。