基于HOG特征和SVM的棉花行数动态计数方法

2020-09-20梁习卉子陈兵旗李民赞魏超杰

梁习卉子,陈兵旗,李民赞,魏超杰,冯 杰

基于HOG特征和SVM的棉花行数动态计数方法

梁习卉子1,3,陈兵旗1※,李民赞2,魏超杰1,冯 杰1

(1. 中国农业大学工学院,北京 100083;2. 中国农业大学现代精细农业系统集成研究教育部重点实验室,北京 100083;3. 石河子大学机械电气工程学院,石河子 832003)

正确地进行棉花行数的动态计数是保证视觉植保车在田端横移过程中实现准确定位的前提。该研究以植保期间的棉花作物为研究对象,提出通过方向梯度直方图(Histogram of Oriented Gradient,HOG)和支持向量机(Support Vector Machine,SVM)实现棉田的棉花行动态计数方法。为了减少棉花行之间的粘连,以及缺苗和倒伏对棉花行识别造成的影响,设置图像的感兴趣区域(Region of Interest,ROI);为了减小相机抖动、光照变化以及刮风对动态数行造成的影响,使用HOG-SVM模型在视频序列图像ROI区域内窗口滑动检测,将棉花行和行间背景分别设置正、负样本,通过提取二者HOG特征、多次训练获得SVM分类器参数,固化HOG-SVM模型,再使用非极大值抑制(Non-Maximum Suppression,NMS)进行窗口的归一,通过归一化互相关(Normalized Cross Correlation,NCC)模板匹配实现棉花行的动态跟踪和计数。结果表明,该方法可以准确地对棉花行实现动态计数,有很好的泛化能力,识别率高于90%,平均每帧检测时间为32 ms,满足实际田间作业要求,可作为视觉植保车在地头横移的距离依据。

机器视觉;棉花;识别;苗列行计数;HOG特征;SVM分类器;NCC模板匹配

0 引 言

基于视觉导航的无人植保车(简称植保车)可以在保证不压苗的前提下,通过识别作物苗列确定行走路线,完成植保作业的全覆盖无人作业[1-2]。由于植保车在整个农田作业过程中一直保持车体方向不变,在其行驶到地头转向和掉头过程中,避免了喷药杆的展开与收起动作,极大地提高了植保喷药的作业效率。植保车的全覆盖作业导航路径包括2个方面:1)植保车在农田内部作业过程中沿着作物行进行直线行驶作业;2)植保车在地头的横向移动[3]。其中,植保车在地头横移的距离由所跨越的作物行数决定,而行数由喷药杆的翼展以及作物的实际种植模式2个因素决定[4-5]。准确地进行作物行动态计数能够保证植保车精确跨行,也是精准确定植保车在地头横移距离的重要依据。

在农田视觉导航的苗列线检测方面,常用的导航线检测方法有Hough变换、最小二乘法以及水平条带等。Hough变换适合检测单行作物,Rovira-Más等[6]将Hough结合连通域的分析,从所有可能的选择中确定最合适的路径,能够在室内和田间进行导航线检测。Søgaard等[7]针对图像中同时覆盖的五行作物,通过加权线性回归计算行中心线的方向和横向位置,估计出导航路径。Choi等[8]利用水稻的形态特征,计算弯曲叶片各分段直线的平均斜率,利用水稻叶片的方向与水稻行中心区域的收敛性,利用Hough变换获得导航线。Zhang等[9]利用自适应灰度化算法提取水田图像的灰度特征,提取水稻SUSAN角点作为特征点,应用改进的序贯聚类算法和Hough变换检测导航线。陈娇等[10]在获得各垄行所在区域后,根据摄像机标定原理与透视变换原理,结合垄线基本平行的特征,使用改进Hough变换识别出农田中的多个垄线。最小二乘法可用于检测多行作物,Jiang等[11-12]基于行间距近似相等的几何约束,将多行特征融合到一次优化过程中估计候选点,利用聚类方法确定作物行的真实中心点,采用线性回归方法对作物行进行拟合。Zhang[13]针对杂草干扰和作物行距的影响,通过设定双阈值进行图像分割,结合大津法和粒子群优化算法分离杂草与农作物,采用位置聚类算法和最短路径法确定最终的聚类特征点集,通过最小二乘法的线性回归方法拟合作物行。韩永华等[14]通过作物行的交替及最大类间方差法、颜色模型分量变换,结合小波多分辨率分解后构建的频率总量指标,识别出多行作物。周雅文等[15]在大尺度低分辨率下凸显导航路径宏观轮廓,结合小波变换和改进随机抽样一致性,针对获取的特征点集合运用结合预检验和后处理校正的改进随机抽样一致性算法,用最小二乘法拟合导航路径直线拟合。翟志强等[16]针对基于双目视觉导航图像,通过最小核值相似算子检测作物行特征角点,识别出了多行作物。刁智华等[17]通过分割作物与背景,结合最大正方形准则提取了多行玉米的骨架。唐晶磊等[18]通过将农田视觉导航图像当前的感兴趣区域(Region of Interest,ROI)划分为预视导航和当前导航2个窗口,结合串行反向传播(Back Propagation,BP)神经网络训练,用最小二乘法检测出多行作物。孟庆宽等[19]通过先行约束关系提取了多行玉米种植行的基准线,用线性回归确定出玉米行所在直线。Vidović等[20]使用已知增量法和全局最优分割,结合直接全局优化算法,用最小二乘法检测出多行作物。水平条带方法由于可以补偿摄像机的横向运动(摇摆),在克服相机抖动方面有较大的优势,Sainz-Costa等[21]利用图像序列中某些作物行的中心作为跟踪特征,通过逆透视技术将所选区域转换为图像中心,通过水平条带检测作物行。农田视觉导航的研究主要集中于检测单幅图像中的多行作物,作物行数可以由此进行判断,但是这些研究的目的是检测出直线行走导航路径,都无法动态判断作物行数。

棉花的植保效果决定了棉花生长的生态营养环境与最终的产量,是棉花种植重要的一个环节[22]。本研究以植保期棉花为研究对象,利用经典的HOG-SVM方法,提取棉花行的方向梯度直方图(Histogram of Oriented Gradient,HOG)特征,通过支持向量机(Support Vector Machine,SVM)分类,以及归一化互相关(Normalized Cross Correlation,NCC)精确跟踪和定位棉花行,进一步实现视频序列图像中棉花行的动态计数。通过对比试验,讨论了光照条件和刮风天气对棉花行动态识别效果的影响,该棉花行动态计数方法作为视觉植保车在地头横移距离的确定依据,可用于其他半结构化行种植作物。

1 试验方法

1.1 硬件及图像采集

试验视频于2018年6月采集,试验田(44°22′N,86°02′E)平均海拔437 m,所在地区干旱少雨,光照时间长,年日照时长为2 721~2 818 h,年降水量为125.0~207.7 mm,平均风速1.5 m/s,属于典型的温带大陆性气候[23]。为验证算法对光照变化的适应性,视频采集时间在11:00—20:00之间,包含晴天的顺光、逆光、阳光直射,以及阴天,所有视频共10 376帧。为验证算法在复杂农田环境下的鲁棒性,视频采集了棉田中常见的地头缺苗及倒伏情况,以及刮风天气。

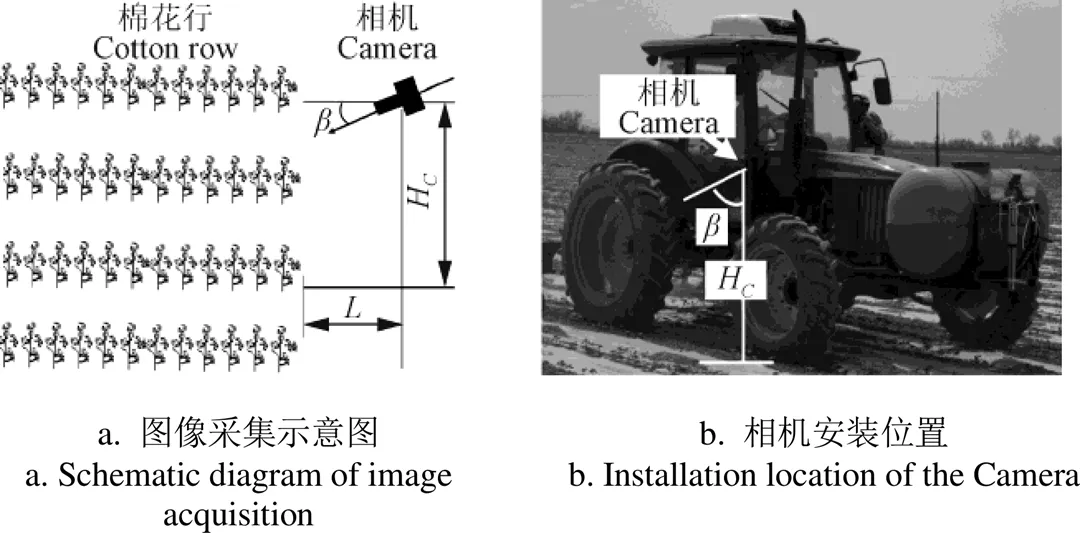

图像采集设备为奥尼Q718型USB数码相机,拍摄方式如图1所示。由于植保车尚在试制阶段,为了保证图像的拍摄角度和相机高度(图1a),将相机通过强磁块固定在拖拉机车身侧面,沿地头行走采集视频进行图像采集(图1b)。相机与棉花行行端的距离=(90±10) cm,相机高度H=(120±5) cm,相机光轴与铅垂线角度=60°。拖拉机在地头的行驶速度为1.62 km/h(约0.45 m/s)。采集的彩色视频图像每秒30帧,每帧图像大小为640×480 像素。

注:L为相机与棉花行之间的距离,cm;Hc为相机距地面高度,cm;β为相机俯角,(°)。

检测算法开发的硬件环境为Intel(R) Core(TM) i7-8 700,主频3.2GHz,内存16GB,处理软件环境为Microsoft Visual C++ 2010和OpenCV2.4.10,程序开发平台为北京现代富博科技有限公司的二维运动图像分析系统(Motion Image Analysis System,MIAS)。

1.2 样本图像的方向梯度直方图(HOG)特征提取

为了训练SVM分类器,需要提取棉花行以及行间背景的HOG特作为图像的特征描述子。通过OpenCV的ImageClipper获取96×96帧的正、负训练样本各7 000个,其中正样本在宽度上包含完整的棉花行轮廓,涵盖不同的光照条件;负样本包含行间土壤、薄膜以及不完整的棉花行轮廓等。另外准备用于优化HOG-SVM模型参数的正、负测试样本各1 000个。

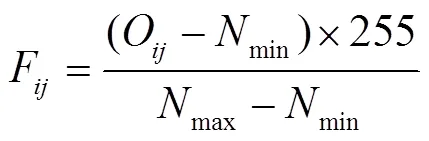

1.2.1 图像的灰度化及归一化处理

式中max和min分别为G的灰度最大值和最小值。

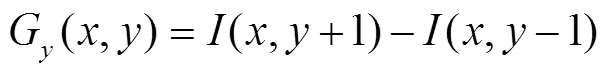

1.2.2 方向梯度直方图(HOG)特征的提取

将样本图像划分为8×8像素的胞元(图2a),其中每个方格表示一个像素点,计算每个胞元的方向梯度。将2×2个胞元组成一个16×16像素的块(图2b),将块内胞元的方向梯度串联,再将所有梯度向量求平方和的平方根进行L2范数归一,求出块的HOG特征。将2×2个块组成一个32×32像素的窗口,窗口以8像素为步长,在样本图像中以从上到下,从左到右的顺序滑动检测,得到样本图像的HOG特征(图2c)。

注:图2a为8×8像素组成的胞元,图2b为2×2个胞元组成的块,图2c为 96×96像素的样本图像,其中斜线阴影部分为2×2个块组成的滑动窗口。

Note: Fig. 2a shows a cell composed of 8 × 8 pixels, Fig. 2bshows a block of 2×2 cells,Fig. 2c shows a 96 × 96 pixels sample image, in which the diagonal shadow part is a sliding window composed of 2 × 2 blocks.

图2 棉花行HOG特征获取过程示意图

Fig.2 Schematic diagram of HOG feature acquisition process for cotton rows

式中(,)是像素点(,)的像素值,其梯度幅度(,)和方向(,)计算分别如式(5)和式(6)所示

1.3 SVM分类器的训练

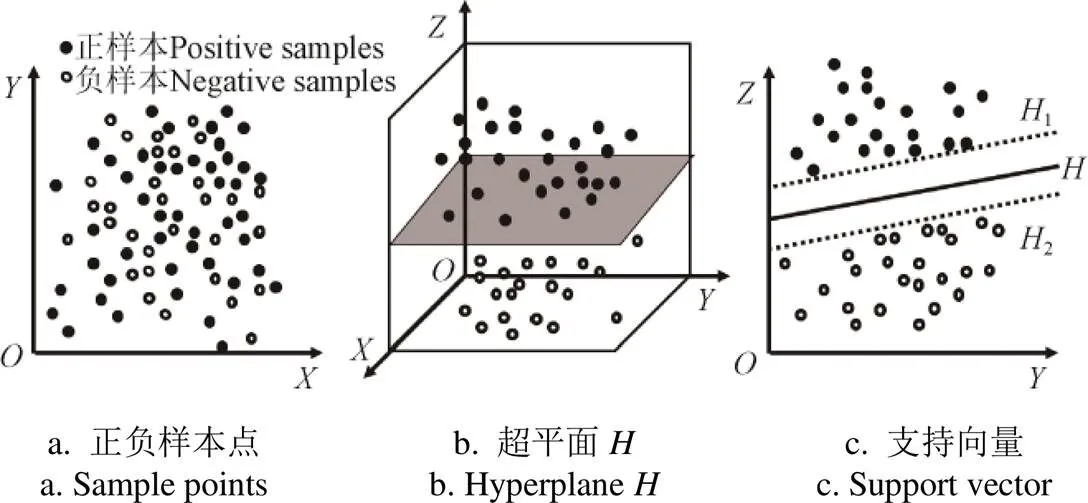

将棉花行与行间背景进行正确分类是有效识别棉花行的前提,使用非线性映射算法,通过径向基核函数(Radial Basis Function,RBF)在高维空间中构建最优超平面,使低维特征空间的样本在高维空间变得线性可分,实现复杂环境中棉花行与行间背景的正确分类。对所有的训练样本图像进行正、负样本标识,将正样本标识为1,负样本标识为-1,进行正、负样本的分类(图3)。

样本视频图像中的棉花行与行间背景分别作为正、负样本,正样本为实心圆点,负样本为空心圆点,二者在二维空间中分布杂乱,无法分类(图3a)。将正、负样本映射到三维的样本空间中,在欧式空间中寻找一个线性判别函数作为“超平面”分隔2类样本(图3b)。在三维空间中做二维映射(图3c),其中图3b三维空间中的超平面对应为图3c二维空间中的直线。

注:图3a中为二维空间内正、负样本的混和状态,图3b为三维空间内将正、负样本间隔开的超平面H,图3c为三维空间在另一个平面内映射中,超平面H将正、负样本间隔的结果,其中,H1和H2为分别为超平面H的支持向量。

为了得到训练SVM分类器的参数,保证分类效果,SVM的训练过程分为2个步骤:

1)初次训练。通过正、负训练样本的HOG特征,训练线性SVM分类器并保存分类器模型。

2)再次训练。将初次训练的SVM分类器对测试样本再次进行分类,将分类错误的样本重新进行手动标识,实现SVM参数的优化,重复再次训练的过程,直至分类结果完全正确,固化最终的HOG-SVM模型。

2 棉花行的识别

2.1 视频序列图像的预处理

对测试视频的序列图像进行灰度化,处理的方法同1.2.1小节。定义灰度图像的左上角为图像的坐标原点,向右为轴正方向,向下为轴正方向,size为图像方向宽度,size为图像方向高度,将视频序列图像的以(0,size/5)和(size,4·size/5)为对角的矩形区域设置为关注区域(Region of Interest,ROI),在ROI区域内部识别棉花行[25]。

2.2 棉花行的识别

在测试视频序列图像的ROI区域内,使用HOG-SVM模型以步长为8像素从上到下,从左到右进行窗口滑动检测。在检测的过程中,由于一行棉花可以被多次识别,得到多个候选目标窗口,使用非极大值抑制(Non-Maximum Suppression,NMS)将同一行棉花所对应的不同候选目标窗口进行窗口的归一,处理过程如下:

为所有候选目标窗口进行置信度打分,并按照从高到低进行排序,保留得分最高的候选目标窗口,将其余的候选目标窗口遍历该目标窗口,计算每2个窗口的交并比(Intersection Over Union,IOU),如果IOU > 0.4,则去除该候选目标窗口,保留置信度高的窗口,直至得到每一行棉花对应的最佳目标窗口。

2.3 棉花行的跟踪

求解前后帧目标窗口的归一化互相关(Normalized Cross Correlation,NCC)值,实现视频中棉花行的动态匹配跟踪,NCC的值计算如式(8)所示

目标窗口中的灰度像素值阵列为该窗口所对应样本数据的集合,若连续2帧图像目标窗口的NCC值越接近1,则2个目标窗口所对应数据集合的匹配度越高,2个目标窗口表示同一行作物的可能性越大;若二者的NCC值越接近-1,则表示2个目标窗口匹配度越低,二者表示同一行棉花的可能性越小。将非第一帧图像中所识别到的目标窗口遍历上1帧所有目标窗口,计算NCC的值并将其从大到小排列,保留最大值所对应的2个目标窗口进行关联,实现对视频中棉花行的动态跟踪。

3 试验结果与分析

3.1 棉花行数识别结果定量分析

蕾期的棉花行宽度在15 cm以内,在图1所示的拍摄距离与成像角度条件下,棉花行宽在图像中所占像素数<80,为了避免偶尔有枝叶延伸到行间,准确提取棉花行的HOG特征,本研究设定样本图像以及视频图像中的HOG-SVM滑动模板大小为96×96像素,将棉花行的轮廓严格包含在内。胞元所包含像素的行、列,以及窗口移动的步长为样本图像的10%能够更好的获得HOG特征[26],本研究将胞元的长、宽,以及窗口移动步长分别设为8像素。

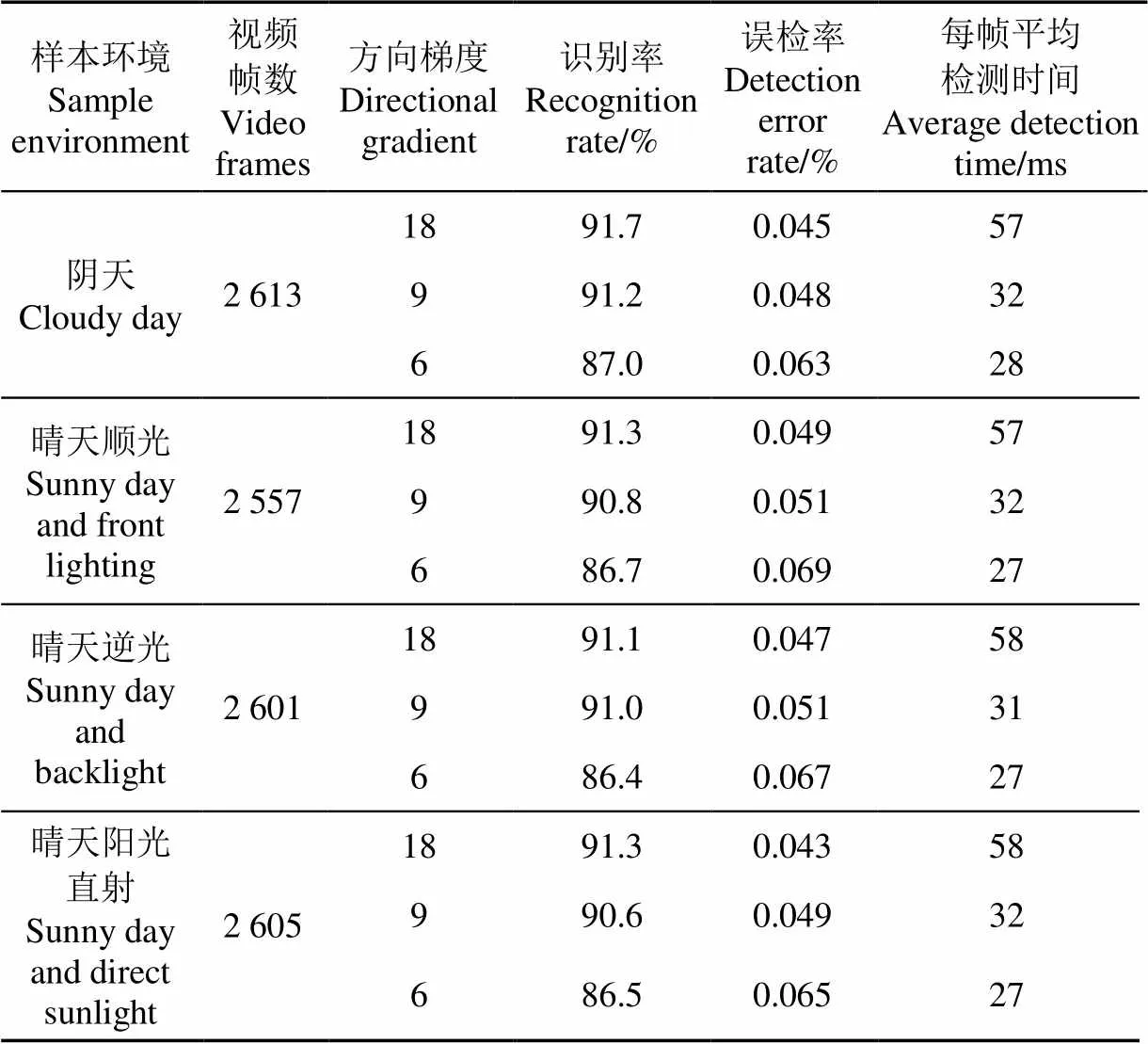

表1 不同光照条件下各方向梯度对识别效果的影响

注:晴天阳光直射为晴天正午,太阳垂直照射地面的情况。

Note: Sunny day and direct sunlight means that the sunshine vertically on the ground at noon on a clear day.

为测试刮风条件下,棉花枝叶摆动对图像信息检测结果造成的影响,图4a~图4d对比了不同天气情况下,不同风速下棉花动态数行效果的影响,当风力<3级时,不同光照条件下识别率均在90%以上,随着风力增大,识别率减小,误检率增大。

图4 风速对识别效果的影响对比图

3.2 棉花行数识别结果定性分析

灰度归一化可有效降低了不同光照条件下的绿色显著图像像素的亮度不均匀与对比度不足。棉花行与行间背景的差别明显,未受到图像局部的叶片阴影和光照变化的影响。在图像的纹理强度中,局部的表层曝光贡献的比重较大,减小了光照影响[27],将ROI区域设定在图像纵轴的中间部分,不仅减少了计算量,提高了计算速度,并且有效地避免了2个问题对棉花行识别造成的干扰:1)图像上端棉花行粘连,2)图像下端棉花的缺苗和倒伏。

棉花枝叶生长的随机性导致棉田的图像信息复杂、颜色杂乱,无法仅通过颜色分布规律进行棉花行数的动态判断。HOG特征提取轮廓外形数据是经典的特征提取方法,非常适合在像素点颜色不规律前提下提取物体的边缘轮廓信息。在田端视角下,棉花行在图像中自上而下贯穿,具有较明显的单一梯度方向特征,通过其在图像中的边缘特征的分布获取棉花行的HOG特征,在复杂的棉田环境中,能够在不同光照条件、车辆颠簸,以及刮风等实际的应用中有很好的鲁棒性。

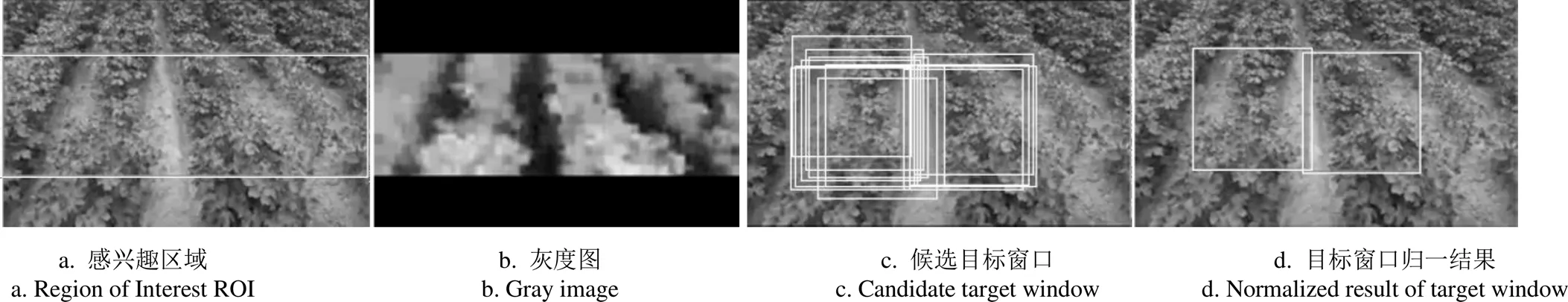

图5为植保期间棉花行的识别过程,对视频原图设置ROI区域(图5a),其内部图像进行灰度化,外部图像不进行处理(图5b)使用HOG-SVM模型进行窗口滑动进行检测(图5c),对于同一棉花行所检测到的多个窗口使用NMS进行窗口归一(图5d)。

注:图5a为原图,矩形框为感兴趣区域;图5b为感兴趣区域内灰度化效果,感兴趣区域外部的图像不进行计算;图5c中的矩形框为HOG-SVM模型所识别的中间两行棉花结果,每一行棉花被多次识别,对应多个矩形框;图5d中的矩形框为对中间两行棉花窗口归一的最终结果。

由于HOG-SVM模型滑动检测所得的候选目标窗口为一系列重叠度很高的方框,胞元的方向梯度直方图将所统计的局部图像梯度信息进行量化,局部图像区域的HOG特征描述了图像中棉花行的轮廓。由于每个胞元的梯度都会在窗口滑动的过程中被多次用于最终的HOG描述子的计算,这种冗余计算显著的提升了棉花行识别效果对视角变化、光照及刮风天气的鲁棒性。对于HOG-SVM的重叠目标窗口使用NMS进行归一,由于棉花行互相之间没有遮挡,棉花行中心的目标窗口为最佳目标窗口。

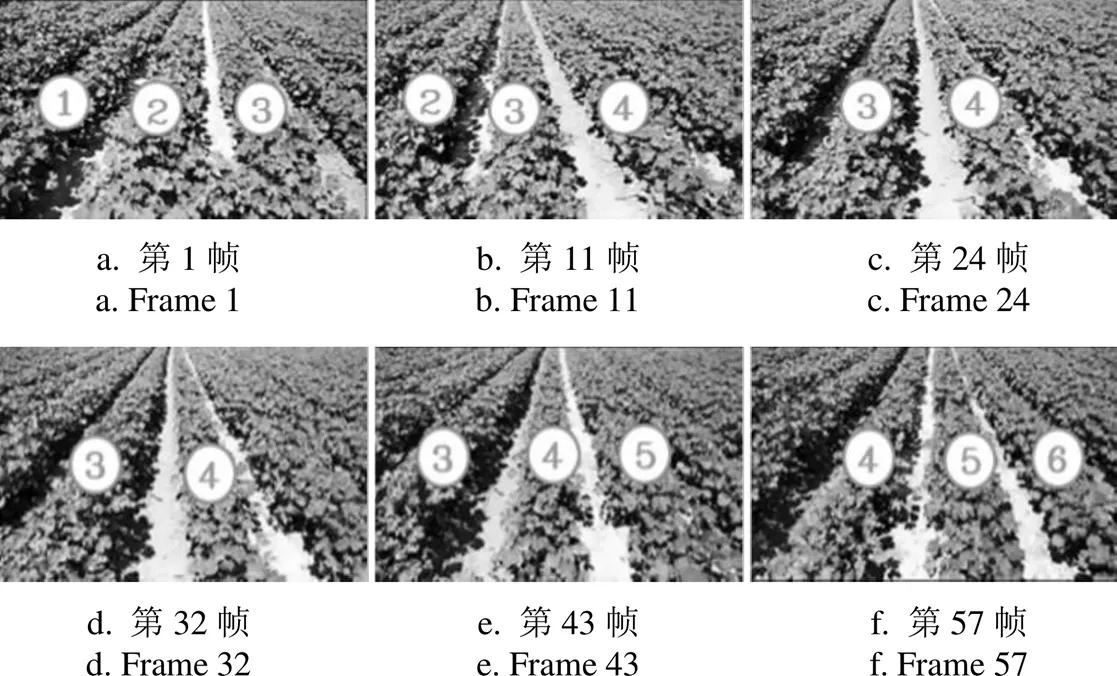

3.3 不同光照条件下棉花行动态计数结果

图6~图9为不同光照条件下的棉花行数动态计数结果,其中包含田端缺苗和倒伏的情况。研究所选视频均为棉花行向左移动,输出的ID为向右递增,反之亦然。其中,每行棉花的ID号显示在所对应目标窗口的几何中心。

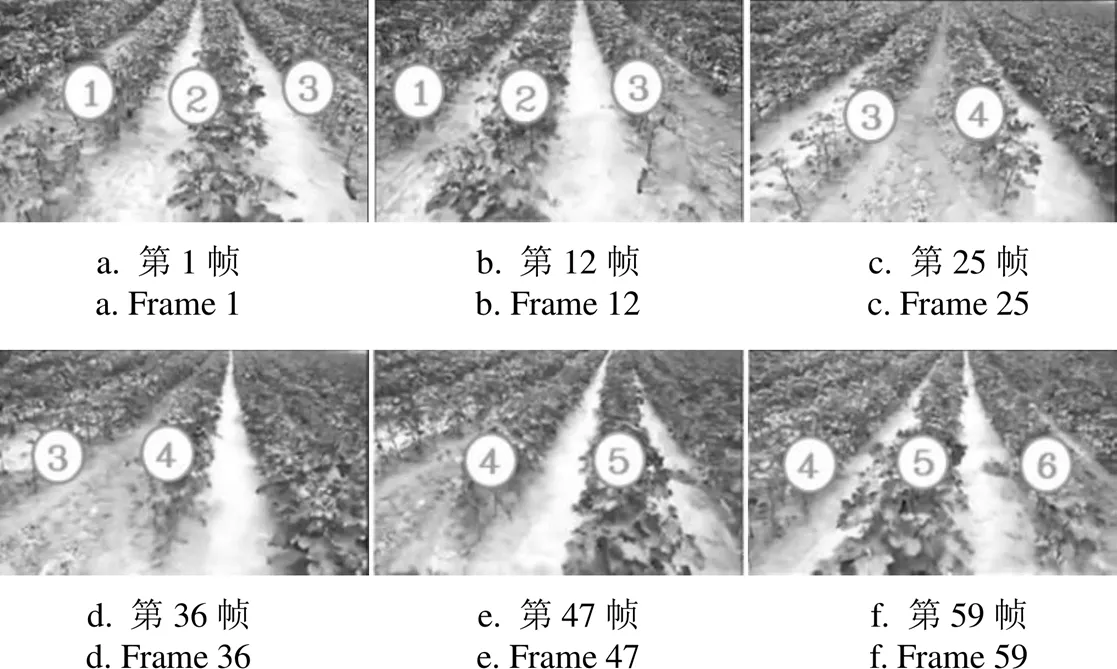

图6为阴天环境下的视频序列图像跟踪效果,视频中出现图像上端棉花行粘连,以及田端缺苗的现象。设定ROI区域,去除图像上方和下方的部分,避免了缺苗对棉花行识别效果的影响。由于阴天条件下的叶片反光效果不明显,棉花行的HOG特征反而更明显,识别效果好。

注:数字为当视频中的棉花行向右移动的过程中,所截取图像中的棉花行动态计数结果,即该行棉花的数值。下同。

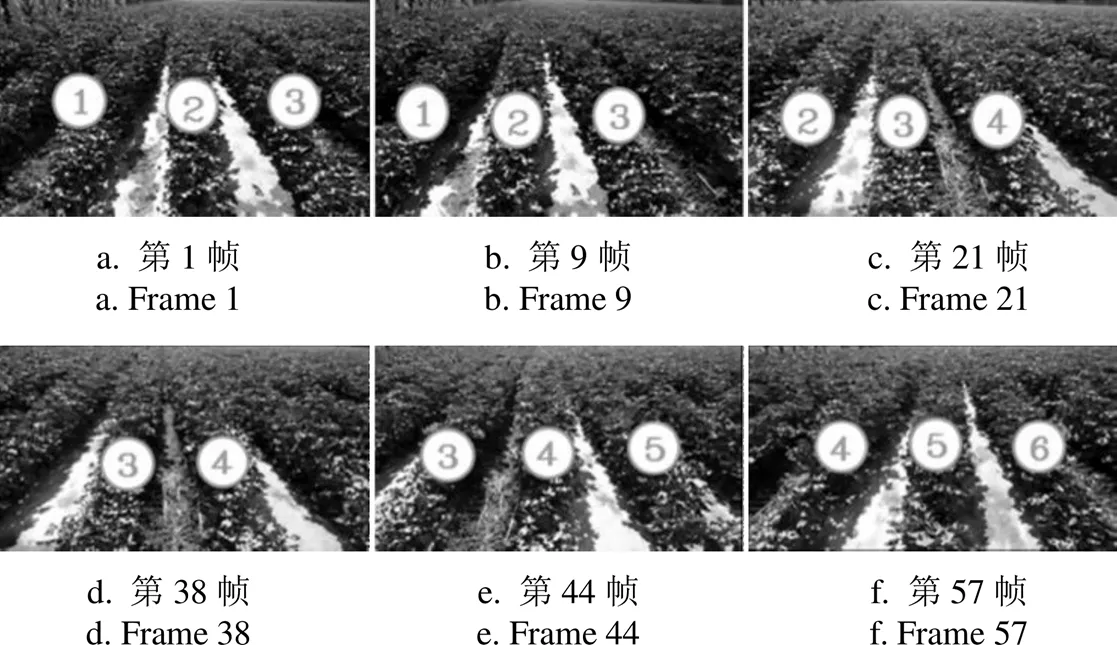

图7为晴天顺光环境下的棉花行数动态识别结果,在顺光条件下,阳光在棉花叶片的反射效果明显,行间薄膜对阳光的反射使得叶片变为深绿色。HOG特征不仅能够捕获轮廓和纹理信息,还可以弱化光照变化和小量的偏移的敏感程度,对于红(Red,R)、绿(Green,G)、蓝(Blue,B)3个颜色通道,使用2G-R-B进行灰度化运算,虽然在彩色图像灰度化的过程中降维丢失了色度和对比度信息,但是保留了图像主要的结构特征,棉花行HOG特征需要提取棉花行的边缘梯度,对颜色不敏感,即使顺光条件下的棉花叶片反光发亮,也并未影响到的棉花行的行数及识别结果。

图7 晴天顺光环境下棉花行数动态识别结果

图8为晴天逆光环境下的棉花行数动态识别结果,光线从相机的对面照射,图像上方出现曝光过度的现象,第61帧图像中的第5行棉花在ROI区域内部出现缺苗现象。HOG-SVM模型在ROI区域内的上端匹配出棉花行时,由于HOG-SVM模型对图像ROI区域进行滑动窗口检测的过程中,检测顺序为从上到下,从左到右,第5行棉花的ID值窗口在图像中高于其余正常棉花行的ID值窗口位置。

图8 晴天逆光环境下棉花行数动态识别结果

图9为晴天阳光直射环境下的棉花行数动态识别结果,第1帧中棉花倒伏,第2、3行棉花叶片在行间相连,由于ROI区域不包含图像最下端,虽然在图像两侧的棉花行阴影盖住了行间土壤,但是在ROI区域内,通过HOG检测到的棉花行轮廓信息并未受到阴影的干扰。

图9 晴天阳光直射环境下棉花行数动态识别结果

在实际的农田作业环境中,靠近地头的棉花植株不如棉田内部植株所获得的水分以及肥料均匀,容易出现缺苗和倒伏的现象,图6第4行棉花、图8第5行棉花均有缺苗,图9第2、3行棉花由于倒伏而粘在一起,本研究将图像的处理过程及计算限定在ROI区域内,有效地减小了地头棉花缺苗、倒伏现象对动态数行结果造成影响。从图6~图9的棉花行动态数行结果可以看出,不同强度及方向的阳光下动态数行结果均正确,本研究算法对棉田的复杂自然环境,以及光照变化均有较强的鲁棒性。

视频晃动是实际作业中需要考虑的一个重要因素[28-32],在视频采集的过程中,2个原因会造成固定在拖拉机上的相机抖动:一是拖拉机发动机的振动,这种抖动会造成视频图像的低频小幅度振动;二是棉田地头的土路平整程度有限,不仅如此,农田自然环境中的刮风造成图像中棉花枝叶无规则的摆动,相机抖动以及枝叶晃动都会导致视频清晰度明显下降。由于棉花行在图像内为上下贯穿,相机纵向方向的抖动对棉花行识别的影响很小,但是对于相机的横向抖动或者刮风造成的棉花行枝叶晃动却会产生较大影响,本研究使用HOG-SVM模型的滑动检测进行棉花行的识别,块内的胞元的方向梯度被多次重复统计,梯度方向直方图通过重叠区域的密集型描述符加权计算,棉花行HOG特征的多次冗余计算减小了相机抖动及枝叶摆动的影响。在小于2级风的刮风天气下,枝叶晃动不会影响到棉花行跟踪和计数效果,本研究所提出的方法对视频抖动以及刮风天气有较好的鲁棒性。

4 结 论

本研究以蕾期棉田的视觉导航图像作为研究对象,提出一种基于方向梯度直方图(Histogram of Oriented Gradient,HOG)和支持向量机(Support Vector Machine,SVM)的棉花行数动态计数方法,该方法对于光线的变化,相机抖动以及刮风天气有较好的鲁棒性。

1)通过对视频序列图像设定ROI区域,有效地避免了由于透视原理造成的图像上端棉花行粘连,以及图像下端棉花缺苗及倒伏现象对棉花行动态计数造成的影响。

2)通过提取样本的方向梯度直方图(Histogram of Oriented Gradient,HOG)特征,以及采用支持向量机(Support Vector Machine,SVM)进行分类,增强了棉花行识别的泛化能力,通过归一化互相关(Normalized Cross Correlation,NCC)模板匹配实现棉花行的跟踪,该方法对光照条件、相机抖动以及刮风环境具有较好的适应性。

3)试验结果证明,该方法对于棉花行的识别率在90%以上,平均每帧检测时间为32 ms,达到田间作业要求,该棉花行动态计数方法作为视觉植保车在地头横移的距离依据,可为其他半结构化的行种植低矮作物的植保作业提供理论依据。

[1] 司永胜,姜国权,刘刚,等. 基于最小二乘法的早期作物行中心线检测方法[J]. 农业机械学报,2010,41(7):163-167. Si Yongsheng, Jiang Guoquan, Liu Gang, et al. Early stage crop rows detection based on least square method[J]. Transactions of the Chinese Society for Agricultural Machinery, 2010, 41(7): 163-167. (in Chinese with English abstract)

[2] 孟庆宽,仇瑞承,张漫,等. 基于改进粒子群优化模糊控制的农业车辆导航系统[J]. 农业机械学报,2015,46(3):29-36. Meng Qingkuan, Chou Ruicheng, Zhang Man, et al. Navigation system of agricultural vehicle based on fuzzy logic controller with improved particle swarm optimization algorithm[J]. Transactions of the Chinese Society for Agricultural Machinery, 2015, 46(3): 29-36. (in Chinese with English abstract)

[3] 梁习卉子,陈兵旗,李民赞,等. 质心跟踪视频棉花行数动态计数方法[J]. 农业工程学报,2019,35(2):175-182. Liang Xihuizi, Chen Bingqi, Li Minzan, et al. Dynamic counting method of cotton rows in video based on centroid tracking[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(2): 175-182. (in Chinese with English abstract)

[4] 张波,翟长远,蔡吉晨,等. 喷杆式施药机对行喷雾控制系统设计与试验[J]. 农机化研究,2017,39(11):49-58. Zhang Bo, Zhai Zhangyuan, Cai Jichen, et al. Design and experiment of row-follow control system for boom sprayer[J]. Journal of Agricultural Mechanization Research, 2017, 39(11): 49-58. (in Chinese with English abstract)

[5] 宁松瑞,左强,石建初,等. 新疆典型膜下滴灌棉花种植模式的用水效率与效益[J]. 农业工程学报,2013,29(22):90-99. Ning Songrui, Zuo Qiang, Shi Jianchu, et al. Water use efficiency and benefit for typical planting modes of drip-irrigated cotton under film in Xinjiang[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2013, 29(22): 90-99. (in Chinese with English abstract)

[6] Rovira-Más F, Zhang Qin, Reid J F, et al. Hough-transform-based vision algorithm for crop row detection of an automated agricultural vehicle[J]. Proceedings of the Institution of Mechanical Engineers, Part D: Journal of Automobile Engineering, 2005, 219(8): 999-1010.

[7] Søgaard H T, Olsen H J. Determination of crop rows by image analysis without segmentation[J]. Computers and Electronics in Agriculture, 2003, 38(2): 141-158.

[8] Choi K H, Han S K, Han S H, et al. Morphology-based guidance line extraction for an autonomous weeding robot in paddy fields[J]. Computers and Electronics in Agriculture, 2015, 113(3): 266-274.

[9] Zhang Qin, Chen Shaojie, Li Bin, et al. A visual navigation algorithm for paddy field weeding robot based on image understanding[J]. Computers and Electronics in Agriculture, 2017, 143(12): 66-78.

[10] 陈娇,姜国权,杜尚丰,等. 基于垄线平行特征的视觉导航多垄线识别[J]. 农业工程学报,2009,25(12):107-113. Chen Jiao, Jiang Guoquan, Du Shangfeng, et al. Crop rows detection based on parallel characteristic of crop rows using visual navigation[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2009, 25(12): 107-113. (in Chinese with English abstract)

[11] Jiang Guoquan, Wang Zhiheng, Liu Hongmin. Automatic detection of crop rows based on multi-ROIs[J]. Expert Systems with Applications, 2015, 42(5): 2429-2441.

[12] 姜国权,杨小亚,王志衡,等. 基于图像特征点粒子群聚类算法的麦田作物行检测[J]. 农业工程学报,2017,33(11):165-170. Jiang Guoquan, Yang Xiaoya, Wang Zhiheng, et al. Crop rows detection based on image characteristic point and particle swarm optimization-clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(11): 165-170. (in Chinese with English abstract)

[13] Zhang Xiya, Li Xiaona, Zhang Baohua, et al. Automated robust crop-row detection in maize fields based on position clustering algorithm and shortest path method[J]. Computers and Electronics in Agriculture, 2018, 154(11): 165-175.

[14] 韩永华,汪亚明,孙麒,等. 基于小波变换及Otsu分割的农田作物行提取[J]. 电子与信息学报,2016,38(1):63-70. Han Yonghua, Wang Yaming, Sun Qi, et al. Crop row detection based on wavelet transformation and Otsu segmentation algorithm[J]. Journal of Electronics & Information Technology, 2016, 38(1): 63-70. (in Chinese with English abstract)

[15] 周雅文,丁幼春,杨军强,等. 油菜直播机导航路径识别方法研究[J]. 华中农业大学学报,2016,35(3):128-133. Zhou Yawen, Ding Youchun, Yang Junqiang, et al. A method of identifying the navigation path of rapeseed direct seeder[J]. Journal of Huazhong Agricultural University 2016, 35(3): 128-133. (in Chinese with English abstract)

[16] 翟志强,朱忠祥,杜岳峰,等. 基于Census变换的双目视觉作物行识别方法[J]. 农业工程学报,2016,32(11):205-213. Zhai Zhiqiang, Zhu Zhongxiang, Du Yuefeng, et al. Method for detecting crop rows based on binocular vision with Census transformation[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2016, 32(11): 205-213. (in Chinese with English abstract)

[17] 刁智华,吴贝贝,毋媛媛,等. 基于最大正方形的玉米作物行骨架提取算法[J]. 农业工程学报,2015,31(23):168-172. Diao Zhihua, Wu Beibei, Wu Yuanyuan, et al. Skeleton extraction algorithm of corn crop rows based on maximum square[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2015, 31(23): 168-172. (in Chinese with English abstract)

[18] 唐晶磊,景旭,何东健,等. 基于串行BP网络的农业机器人视觉导航控制(英文)[J]. 农业工程学报,2011,27(2):194-198. Tang Jinglei, Jing Xu, He Dongjian, et al. Visual navigation control for agricultural robot using serial BP neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2011, 27(2): 194-198. (in Chinese with English abstract)

[19] 孟庆宽,刘刚,张漫,等. 基于线性相关系数约束的作物行中心线检测方法[J]. 农业机械学报,2013,44(S1):216-223. Meng Qingkuan, Liu Gang, Zhang Man, et al. Crop rows detection based on constraint of liner correlation coefficient[J]. Transactions of the Chinese Society for Agricultural Machinery, 2013, 44(S1): 216-223. (in Chinese with English abstract)

[20] Vidović I, Scitovski R. Center-based clustering for line detection and application to crop rows detection[J]. Computers and Electronics in Agriculture, 2014, 109(11): 212-220.

[21] Sainz-Costa N, Ribeiro A, Burgos-Artizzu X P, et al. Mapping wide row crops with video sequences acquired from a tractor moving at treatment speed[J]. Sensors, 2011, 11(7): 7095-7109.

[22] 王刚,张鑫,陈兵,等. 影响棉花化学打顶施药机车喷雾效果与产量的多因素分析[J]. 中国棉花,2016,43(4):11-13. Wang Gang, Zhang Xin, Chen Bing, et al. Analysis of factors affecting the locomotive spraying effect of cotton topping chemicals and cotton yield[J]. China Cotton, 2016, 43(4): 11-13. (in Chinese with English abstract)

[23] 王萌萌,吕廷波,何新林,等. 气象要素对石河子地区参考作物蒸发蒸腾量的影响[J]. 石河子大学学报:自然科学版,2016,34(5):638-642. Wang Mengmeng, Lyu Tingbo, He Xinlin, et al. Research on reference evapotranspiration with meteorological factors in Shihezi[J]. Journal of Shihezi University: Natural Science, 2016, 34(5): 638-642. (in Chinese with English abstract)

[24] Nguyen T L V, Apopei B, Alameh K. Effective plant discrimination based on the combination of local binary pattern operators and multiclass support vector machine methods[J]. Information Processing in Agriculture, 2019, 6(1): 116-131.

[25] 梁习卉子,陈兵旗,姜秋慧,等. 基于图像处理的玉米收割机导航路线检测方法[J]. 农业工程学报,2016,32(22):43-49. Liang Xihuizi, Chen Bingqi, Jiang Qiuhui, et al. Detection method of navigation route of corn harvester based on image processing[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2016, 32(22): 43-49. (in Chinese with English abstract)

[26] Li Xing, Guo Xiaosong. A HOG feature and SVM based method for forward vehicle detection with single camera[C]// International Conference on Intelligent Human-machine Systems & Cybernetics-volume. Hangzhou, China. IEEE, 2013.

[27] 安秋,李志臣,姬长英,等. 基于光照无关图的农业机器人视觉导航算法[J]. 农业工程学报,2009,25(11):208-212. An Qiu, Li Zhichen, Ji Zhangying, et al. Agricultural robot vision navigation algorithm based on illumination invariant image[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2009, 25(11): 208-212. (in Chinese with English abstract)

[28] 方佳,何勇清,余敏芬,等. 植物生长素响应因子基因的研究进展[J]. 浙江农林大学学报,2012,29(4):611-616. Fang Jia, Heyongqing, Yu Minfen, et al. Recent advances with auxin response factors (ARFs): A review[J]. Journal of Zhejiang A & F University, 2012, 29(4): 611-616. (in Chinese with English abstract)

[29] Ji Ronghua, Qi Lijun. Crop-row detection algorithm based on random Hough transformation[J]. Mathematical & Computer Modelling, 2011, 54(3/4): 1016-1020.

[30] Zhai Zhiqiang, Zhu Zhongxiang, Du Yuefeng, et al. Multi-crop-row detection algorithm based on binocular vision[J], Biosystems Engineering, 2016, 150(10): 89-103

[31] Chen Gecheng, Ge Zhiqiang. SVM-tree and SVM-forest algorithms for imbalanced fault classification in industrial processes[J]. IFAC Journal of Systems and Control, 2019, 8(6): 100052.

[32] Campos-Herrera R, Blanco-Pérez R, Bueno-Pallero F Á, et al. Vegetation drives assemblages of entomopathogenic nematodes and other soil organisms: Evidence from the Algarve, Portugal[J]. Soil Biology and Biochemistry, 2019, 128(1): 150-163.

Method for dynamic counting of cotton rows based on HOG feature and SVM

Liang Xihuizi1,3, Chen Bingqi1※, Li Minzan2, Wei Chaojie1, Feng Jie1

(1.,,100083,; 2.,,,100083,; 3.,,832003,)

The counting of cotton rows is dynamically a premise of accurate positioning of a visual plant protection vehicle, which can ensure that the vehicle can traverse at the end of a field. In this study, cotton during plant protection periods was taken as the research object, which presented a dynamic counting method of cotton rows based on Histogram of Oriented Gradient (HOG) and Support Vector Machine (SVM). Hogs of cotton rows and inter-row background were extracted as feature descriptors of images, then they were classified by an SVM classifier. In this way, cotton rows could be identified through classifying cotton rows and inter-row backgrounds. 7 000 positive and negative training samples were respectively prepared for HOG characteristics of training samples. Among them, positive samples contained a complete outline of cotton lines in width, by contrast, negative samples contained soil among lines, plastic films and incomplete outline of cotton lines, etc. Besides, 1 000 positive and negative test samples were prepared to optimize parameters of the HOG-SVM model. By setting a sliding window to training samples, hog features of sample images were extracted, meanwhile positive and negative samples were marked for initial training on SVM classifier parameters. The initially trained SVM classifier was used to classify and test the samples, and those with wrong classifications were picked out for re-marking and re-training. Such retraining processes would continue until all test samples were correctly classified. Then the final HOG-SVM model was solidified for video detections. In recognizing processes, the model was used to slide the window in sequence images and to detect. In the sequence images, the HOG-SVM model built in the previous step was used by the sliding window. In this way, cotton rows in the video could be detected. The same rows of cotton could be detected for many times. To accurately identify cotton rows, Non-Maximum Suppression (NMS) was used to normalize target windows of detected cotton rows. All candidate target windows were scored with confidence and sorted from high to low, then the one with the highest score was retained. In two consecutive images, NCC (Normalized Cross-Correlation) values of target windows of front and back frames were solved to match the same rows of cotton, realized dynamic tracking of cotton rows, and further realized counting. Visual perspectives would have different effects on the upper and lower ends of images. There was an adhesion among cotton rows at the upper end of images, and those at the lower end of images were lack of seedlings and lodging. Such interferences had impacts on identifications of cotton rows. To solve this problem, the Region of Interest (ROI) was set for video sequence images in this study, and recognition processes of all cotton rows were within the ROI region with a very complex cotton field environment. This method had strong robustness to change in a camera's view angles and natural environment, such as to change in the light as well as shook of branches and leaves caused by winds, etc. In this algorithm, the recognition rate of cotton rows was higher than 90% under the condition in which winds were lower than level-2 and the average detection time per frame was lower than 32 ms, which met requirements of actual field operations. This dynamic counting method of cotton rows was used as a basis for determining transverse distances of visual plant protection vehicles at field ends, which could be used in other semi-structured rows to plant low and short crops.

machine vision; cotton; recognition; crop row counting; HOG feature; SVM classifier; NCC template matching

梁习卉子,陈兵旗,李民赞,等. 基于HOG特征和SVM的棉花行数动态计数方法[J]. 农业工程学报,2020,36(15):173-181.doi:10.11975/j.issn.1002-6819.2020.15.022 http://www.tcsae.org

Liang Xihuizi, Chen Bingqi, Li Minzan, et al. Method for dynamic counting of cotton rows based on HOG feature and SVM[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(15): 173-181. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2020.15.022 http://www.tcsae.org

2019-11-23

2020-03-13

国家重点研发计划项目(2017YFD0701000-2017YFD0701003)

梁习卉子,在职博士生,讲师,主要从事图像处理与机器视觉方面的研究。Email:liangxihuizi-lxhz@163.com

陈兵旗,博士,教授,主要从事图像处理与机器视觉方面的研究。Email:fbcbq@163.com

10.11975/j.issn.1002-6819.2020.15.022

TP391.41

A

1002-6819(2020)-15-0173-09