导盲机器人研究现状综述

2020-07-17武曌晗荣学文

武曌晗,荣学文,范 永

1.山东大学 控制科学与工程学院,济南 250061

2.山东交通学院 轨道交通学院,济南 250357

1 引言

视力障碍者是指视力下降到一定程度,无法用常规方法矫正视力、保障日常生活水平的人。视力障碍到一定程度的患者称为盲人。随着人口的增长和老龄化程度的加深,到2050年,全球预计会有7.03亿人面临中重度视力损害或失明[1]。根据中国残联的数据,目前我国至少有500万盲人,且盲人数量正在以每年45万的速度迅速增加。中国作为全球人口数量最多的发展中国家,为视力障碍人群提供医疗、教育、帮助就业等服务的任务巨大。

即使有盲道、导盲杖的帮助,当盲人独自来到陌生且复杂的环境,也会因为无法获取足够的视觉信息而寸步难行。盲人在陌生的户外环境中独自出行所需的信息主要有:(1)环境信息,包括路面状况、路面障碍物、行人、车辆等;(2)交通信息,包括斑马线、盲道和人行道的位置、交通灯及交通标志的指示信息等;(3)导向信息,包括自身位置、朝向、目的地位置及前往目的地的合理路径信息。现今多款辅助盲人出行的电子设备的基本原理都是将盲人无法获取的部分以上信息转换为其他感官信息。其中,触觉和听觉,或两者的组合是相对理想和常用的选择。

本文介绍了近年来科研人员为使用现代科技帮助盲人独立出行所做的尝试,比较、分析了各类导盲机器人的优缺点和适用范围,总结了导盲机器人多项共性关键技术的研究现状,展望了导盲机器人的未来发展趋势,以期为相关科研人员提供参考。

2 导盲机器人分类概述

根据联合国标准化组织所采纳的、美国机器人协会下的定义,机器人是:“一种可编程和多功能的操作机;或是为了执行不同任务而具有可用电脑改变和可编程动作的专门系统”。那么,以引导和帮助盲人出行为目的而设计的可编程操作机或专门系统,均可称为“导盲机器人”。

在这一定义的基础上,归纳了多种导盲机器人,并分类说明其研究现状。

2.1 导盲机器人研究现状

50多年来,全球科研人员不断尝试通过导盲机器人帮助盲人导航、提高盲人生活质量,多形式、多功能的导盲机器人不断进入公共视野。目前功能较为完善的导盲机器人可以分为智能导盲杖、穿戴式导盲设备、手持式导盲仪、基于智能终端的导盲系统和移动式导盲机器人五类。

2.1.1 智能导盲杖

智能导盲杖在传统导盲杖的基础上增加多种传感器和微控单片机,向盲人提供路面信息及导航信息。

美国Gao R X等人[2]研发的导盲杖利用超声波传感器专门检测用户头部前方5 m内的障碍物,印度Mohapatra S等人[3]则用3个超声波传感器同时检测正前方、前方地下、前方偏上区域的障碍物。同济大学马宏平等人[4]的红外探测导盲杖使用蜂鸣器和MP3模块的双语音报警系统引导盲人快速安全地行走。张克华等人[5]开发了基于单一kinect传感器的导盲系统(如图1),该系统能够运用深度图像翻转算法和障碍物识别算法同时检测盲人身高、1 m宽度、3 m距离内的所有地面障碍物、坑洞和悬空障碍物,并根据各障碍物的类型、距离规划出3 m内的最佳避障路线。

当盲人需要去某个确定的目的地时,需要更多的导航信息。在室内,可利用RFID射频识别技术精准定位,泰国Chumkamon S等人[6]在室内环境中布置RFID标签,导盲杖上安装RFID阅读器,当阅读器读到某个标签时,盲人正处于该标签记录的位置。在室外环境中,印度尼西亚共和国的Mutiara G A等人在导盲杖中使用罗盘告知用户8个基本方向[7],并加入GPS定位功能以通知盲人是否达到目的地[8],但暂时不能提供具体的导航信息。

2.1.2 穿戴式导盲设备

穿戴式导盲设备将导盲系统装配在盲人的外套、眼镜、背包、鞋子等装备上,解放盲人的双手,让盲人可以更自由地步行在大街上。设计穿戴式导盲设备不仅要考虑一般的导盲和安全需求,还要考虑装备的重量、穿戴舒适度和盲人群体的接受度。

韦中超等人[9]在用户头部前方配置一个超声波传感器、两侧各配置一个红外线传感器,探测方向随盲人的头部转动而改变。美国Ram S等人[10]在盲人胸前配置超声波和热电传感器,可分辨街头的行人和物体。

密歇根大学的Borenstein J及其团队[11]研发的导航腰带NavBelt装配了2排共16个超声波传感器探测前方120°范围,并利用左、右耳声音的相位差使人产生方向性的印象,以实现声音图像模式和声音导航模式。在声音图像模式下,环境信息被转化成虚拟的声学图像,用户可以“听到”从右到左的环境信息,根据声音的大小和方向在脑内建立虚拟环境地图。在声音导航模式下,NavBelt用立体声指导盲人跟随根据GPS和障碍物信息确定的导航路线:当行走方向与建议方向相差不超过5°时,立体声为250 Hz的低音;当盲人走错或距离障碍物过近时,立体声的振动频率增快、振幅增大[12]。

朱爱斌等人[13]用多图像传感器进行3D场景重建,配合用户腰部和脚腕处的超声波传感器检测障碍物。葡萄牙Filipe V等人[14]用盲人胸前的Microsoft Kinetic摄像机斜向下45°进行拍摄,使用神经网络对从图像中提取的6条竖直线上的深度信息进行分类,对比预先定义的环境模式,从而识别前方2 m范围内的障碍和楼梯。但Kinect摄像机尺寸太大,且需要连接电脑传输数据,尚不适合随身携带。Bai J等人[15]设计的导盲眼镜集成了超声波测距仪、深度摄像机和鱼眼摄像机,根据采集的信息利用A*算法生成感兴趣的点分布图,规划出全局最短路径,实现基于动态目标选择策略的虚拟盲道跟踪方案,在语音导航的同时还可通过眼镜上的显示屏向拥有部分视力的用户补充周围环境信息,如图2所示。德国Manuel Martinez等人[16]独具创意地将无人驾驶技术中使用的传感器、平台和Stixels算法移植到穿戴式导盲设备中,用户可背着处理器行走,胸前摄像头采集到的图像被划分为基于视差分割的垂直区域,从而判断出障碍物和地面,如图3所示。

图2 基于虚拟盲道跟踪技术设计的导盲眼镜

图3 使用无人驾驶技术的穿戴式导盲设备

2.1.3 手持式导盲仪

手持式导盲仪最大的特点就是轻巧方便、易携带。

印度Pravin M等人[17]用固定的白色LED灯作为发射器,用户手持PIN二极管接收器读取不同频率光线对应的信息以确定位置。该系统简易低价、不受电磁干扰的影响,但受遮挡物、反光物和其他光源的影响大,只适合简单、黑暗的室内环境。日本Amemiya T等人[18]开发的“伪吸引力”手持导盲设备利用人感知力的习惯,在扁圆柱型导航仪中产生一种特殊的振动,用2D平面内任意方向的“推/拉力”指导用户前进。

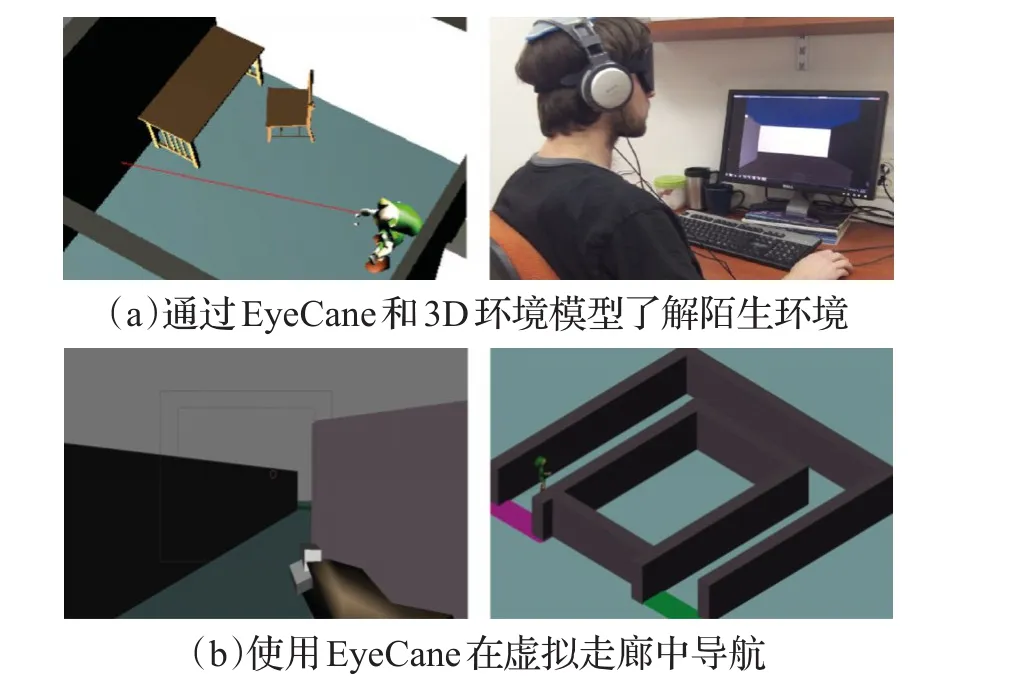

2014年,以色列Maidenbaum S等人[19]研发的手持导盲仪EyeCane使用多个窄光束红外线传感器同时向前方和斜下方精确测距,用盲人手腕处和拇指处的振动表示两处距离,距离越近振动越强。经过几分钟的学习,盲人可以通过不断转动手腕扫描周围环境来躲避障碍物,穿过含多个转角的走廊。如图4所示,该团队还结合谷歌3D地图设计了虚拟EyeCane导盲系统[20],方便盲人在出行前,通过电脑模拟行走,以熟悉陌生的室内环境。

图4 EyeCane手持导盲设备

在德国Hub A等人[21]提出的室内定位系统中,手持设备使用摄像头拍摄前方物体的同时使用WiFi定位确定设备位置、超声波测距仪测量设备距地高度、数字罗盘和3D倾斜传感器确定摄像头朝向,并在3D环境模型中利用上述信息确定虚拟摄像机的位置、高度和朝向进行拍摄,通过对比真实照片与虚拟照片识别被拍摄物体。

2.1.4 基于智能终端的导盲系统

基于智能终端的导盲系统充分利用了智能终端集成了大量传感器且自带导航功能的优势。胡浩明等人[22]以Google公司Project Tango平台下的深度感知技术为核心,调用移动设备的深度感知摄像头和点云传感器进行测距。英国Lock J等人[23]同样依靠Project Tango平台下的设备搭建导盲系统,学习用户随时间变化的行为,调整系统的反馈参数以提高性能,从而帮助盲人更快到达目的地。2019年,Li Bing等人[24]结合了Google Tango设备中的视觉定位服务和预先建立的语音地图,实现了室内环境的语音定位;利用RBG-D摄像头和基于时间戳图的卡尔曼滤波算法实现了高效的障碍物检测,如图5所示。用户可利用键盘选择目的地,Google Tango设备将规划好的路线通过无线蓝牙技术发送到智能手杖中,智能手杖利用语音和振动信息引导用户前往目的地。

图5 基于视觉的盲人室内移动辅助导航设备

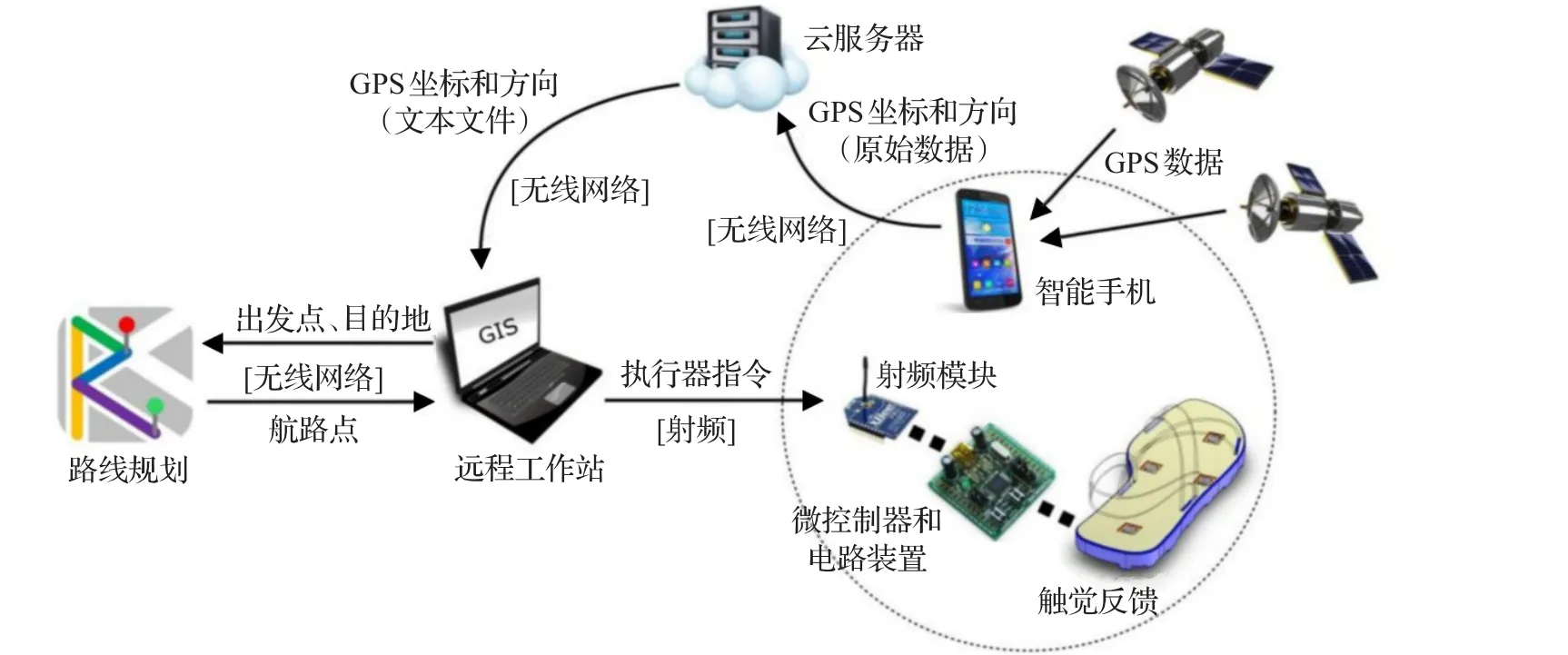

智能手机自带的导航功能也可服务于导盲系统,墨西哥Velázquez R等人[25]结合智能手机的导航功能和穿戴式设备提出了一种导航系统,如图6所示。手机从卫星接收GPS数据,将其同步到笔记本电脑进行路径规划,规划结果通过电磁波发送到盲人脚腕处的电子设备中,转化为导盲鞋底部的振动信号引导盲人前往目的地。该导盲装置可连续工作6 h,但电脑与穿戴设备的通信距离只有200 m。

美国卡耐基梅隆大学的研究团队设计了一款在室内、室外环境均适用的导盲软件NavCog[26],可配合安装在城市街头的蓝牙信标使用,如图7所示。该软件的手机界面图标位置固定、易记忆,盲人通过短暂学习便可自主下载标记了可行走区域、路口和电梯口等决策点、商店和挡路的柱子等值得关注的地点及蓝牙信标安装地点的地图并进行导航。为了提高用户体验,该团队继续根据用户步行速度调整交互的时间和内容、根据用户喜好调整导航技巧与风格[27]。2018年,该团队在日本的一个3座5层大型商场内部署蓝牙信标,用多元回归的方法从数学上分析了建筑墙壁、盲道布置、周围场景、路线、定位误差及导航指令类型对用户跟随计划路线情况的影响[28],并提出了一系列增强概率定位算法准确性的关键技术[29],将NavCog的平均定位误差从3 m降到1.7 m。针对室外地图复杂、手动标记工作量过大的问题,该团队进一步对NavCog进行了优化[30]:从OpenStreetMap线上地图中自主下载并处理地图,用点和线表示决策点和道路;从热门点评软件Yelp和FourSquare上获取商家地址、名称、评价等用户可能感兴趣的信息补充到地图中。考虑到现有较为完善的导盲系统大多需要长期维护、成本过高的问题,该团队又提出了基于众包的、非专家维护的导航系统LuzDeploy[31]:志愿者根据软件的指导了解商场内蓝牙信标的安装、校准方法及分布图,从而参与到系统维护中来。目前127位志愿者在几个月内,于一栋7层建筑完成了455项维护任务,这是进行长期有效的智能导航系统维护的有效尝试。

2.1.5 移动式导盲机器人

目前最常见的移动式导盲机器人为轮式小车和牵引杆的组合,最典型的例子是Borenstein J等人[32]推出移动式导盲机器人,使用时盲人将牵引杆推到身体前方,通过手柄感受到明显的牵引力作为转向命令。这种导盲方式不需要声音、振动等交互信息,即可轻松、安全地引导盲人。

图6 基于GPS和脚部触觉反馈的户外导航系统

图7 基于NavCog软件的智能导盲系统

如图8所示,加州理工学院的Siagian C等人[33]研发的轮式移动机器人在采集到画面中用一组线表示道路,通过确定其消失点判断道路的指向,实现自主导航。该移动机器人不是专门为导盲设置,可自行移动(在4个行人众多的大学校园内进行了测试,可独自前行5 km),也可引导盲人步行跟随。

移动式导盲机器人适合跟随轨迹或结合GPS、固定标签等方式协助盲人前往确定的目的地。2018年,中国台湾的Chuang T K等人[34]研发的循迹机器人同时对车身左30°、正前方、右30°进行拍摄,可识别黄蓝条带轨迹和美国波士顿的“自由轨迹”。如图9所示,系统可以通过两种方式训练深度CNN模型,其中,“行为反射”方式将输入图像直接映射为“左转”“直行”和“右转”三个运动指令;“直接感知”方式采集轨道距画面中心的横向距离和机器人航向,通过改进的滤波算法来指导机器人跟随轨迹。该团队不仅在现实中进行了测试,还在ROS平台上搭建了仿真地铁站,验证了来往行人造成的阴影不会影响机器人循迹。

图8 户外自主导航移动机器人Beobot 2.0

图9 深度循迹导盲机器人

虚弱或年老的盲人群体多数需要大型的导盲设备支撑其行走。爱尔兰的Lacey G等人[35]研制的大型移动助行器通过动力升降机调节高度,支撑盲人进行简单的散步。日本的Mori H等人[36]推出的大型移动导盲装置则可通过扶手支撑盲人在室外行走,且能够识别交通牌、斑马线和红路灯,并通过左、右扶手的振动提示盲人转向。

为了弥补视力不足给盲人出行带来的风险,印度Dr.Anand Kumar K M等人[37]另辟蹊径,推出的四轮移动小车搭配助盲软件:盲人在软件上选择目的地并提出援助请求,志愿者通过小车前端摄像头传来的画面判断盲人位置并远程遥控小车,盲人握住车把末端皮带以跟随小车;同时服务器远程监控,若盲人偏离路线便发出警告。为了进一步提升盲人用户使用体验,美国卡耐基梅隆大学的Kulkarni A等人[38]给移动机器人Pioneer 3DX安装了木质手柄设计成导盲机器人,放在商场供用户自行取用,它可以记录用户性别、年龄、目的地等信息,从而学习不同用户的使用习惯以改进导航系统。同校的Nanavati A等人[39]则专门研究了用户跟随移动小车接近目的地时,寻找目标房间门把手位置的习惯,并据此设计多种靠近目的地的方法,让用户能轻松、准确地打开房门。

2.2 导盲机器人对比与分析

各类导盲机器人基于独特的优势受到不同科研团队的关注,也因为自身结构类型而具有一定的局限性,现将各类导盲机器人的优缺点和适用范围归纳如表1。

智能导盲杖在结构上与传统导盲杖类似,在不大量增加导盲杖质量的前提下大大扩展障碍物检测的距离和范围,兼具轻巧、低价、好上手等优点,盲人群体的接受程度最高。但智能导盲杖对质量的要求限制了其硬件系统的可扩展性,往往存在功能单一的弱点,大部分智能导盲杖仅具备检测障碍的功能。此外,在智能导盲杖底端安装导轮即可构成简单的移动式导盲机器人,故可以将智能导盲杖看作去除动力系统的移动式导盲机器人;随着用户对导盲机器人功能多样性要求的增加,智能导盲杖将逐渐向移动式导盲机器人演化。

穿戴式导盲设备将负责智能探测的传感器固定在盲人周身,让盲人背着整套系统像正常人一样行走,是“隐形”程度最高的机器人,有利于提高盲人的自信心。穿戴式导盲设备可通过增加盲人携带的传感器数量和种类,实现全方位的危险预测,但会给盲人造成装备过重、信息过杂的负担。除了对盲人的行动造成干扰以外,穿戴式导盲设备最大的缺陷是难以向“空手”行走的盲人提供心理层面上足够的安全感。进行室外复杂街区处的导航时,穿戴式导盲设备需要与智能导盲杖或移动式导盲机器人相结合。

表1 导盲机器人分类对比

手持式导盲仪结构最简单、便于携带,但同智能导盲杖一样被质量限制了功能的丰富性。在使用过程中,手持式导盲仪需要不断地手动扫描识别定位标签、检测障碍物等,探测范围小,且用户必须经过长期训练才能熟练使用,只适合在较安全的室内场合使用。

基于智能终端的导盲系统构建于现有智能终端上,可以批量安装、跨平台使用、跨操作系统运行,具有极大的市场潜力。智能终端内置摄像头、罗盘、计步器、GPS模块等,基于智能终端的导盲系统定位和导航功能强大;但存在无法检测障碍物或检测效率低下的问题,盲人在单独使用智能终端的情况下,必须搭配普通导盲杖摸索前进。且因为智能终端常用的人机交互方式依赖于视觉通道,盲人使用时不仅存在大量资源浪费的情况,还需要经过长时间的学习才能记忆复杂的操作步骤。基于智能终端的导盲系统在现阶段发展较快,但在未来将会被专为盲人设计的、功能健全且成本更低的导盲机器人取代。

移动式导盲机器人建立在移动机器人的基础上,在硬件设计时不需考虑对用户造成的重量负担,一般都装备有多种传感器和计算能力强大的控制计算机,且方便在原配置的基础上直接扩充硬件,从而保证了其功能的实用性和丰富性。市面上已有多款成熟的在售移动式机器人具备了自主建模避障、定位导航等功能,加强恰当的人机接口设计后即可用于导盲领域。综合来说,移动式导盲机器人可实现的功能完全覆盖其他导盲机器人,且可扩展性强,是近年来广受关注、发展迅速的导盲机器人类型。此外,移动式导盲机器人采用机器人先行、盲人跟随的导航方式,大大降低了盲人受伤的概率,显著提高了盲人在室内外行走的效率和安全性。

目前限制移动式导盲机器人普及的最大问题是不能适应复杂地形以及硬件和开发成本高,前者可以通过优化机械结构来解决,后者随着移动机器人行业的发展将不再明显;因此,移动式导盲机器人将在未来进一步凸显优势,成为导盲机器人研发的主流方向。

3 导盲机器人的共性关键技术

为满足盲人独自出行的基本需要,导盲机器人的主要功能包括障碍物与路况识别、地图构建、精准定位、智能导航等。本章讨论了导盲机器人为实现上述功能,在环境检测、定位与导航和人机交互等方面所采取的共性关键技术。

3.1 环境检测技术

导盲机器人可提供的环境信息包括:四周障碍物大小与方位,地面凹陷情况,楼梯及电梯位置,其他行人方位,室内设施位置,室外斑马线、交通灯、交通指示牌等交通标志信息。目前导盲机器人领域在环境检测方面采用的关键技术概括于表2。

自20世纪70年代起,超声波测距技术和红外线测距技术因精度高、速度快、成本低等优点,被广泛应用于导盲领域,此时的导盲机器人只需具备简单的距离检测和报警功能[40]。碰撞传感器虽然检测范围极小,但可以用作保护导盲机器人和用户的最后一道防线。时至今日,超声波测距技术也未被淘汰,并通过不断地创新改进,大幅提高测距性能,如李姝颖等人[41]对医学检测领域的超声波相控阵进行改进,采用轮流激励发射探头防串扰、增加数据采集量,可检测大范围内多障碍物的尺寸和位置。

表2 导盲机器人环境检测领域关键技术

20世纪末至21世纪初,视觉传感器在导盲机器人环境检测领域越来越常用,配置了视觉传感器的系统能从环境中获取更丰富、全面的信息。普通摄像头拍摄的图案可以用于对比、识别常见物体,既能帮助盲人躲避障碍物,也可以帮助盲人寻找特定物体。深度相机拍摄的结果可用于快速确定物体的位置、尺寸及形状,能够描述坑洞、高台、楼梯等复杂的环境。视觉传感器的引入大大提高了导盲系统的智能性,尤其在室外环境中,机器人不仅要考虑到行人、车辆带来的危险,也要考虑十字路口、红路灯、斑马线、交通指示牌等交通信息,配备视觉传感器是保障导盲机器人及用户安全必须的选择。

21世纪后,科研人员开始使用固定标签技术补充环境信息,将标签阅读器用作环境传感器。巴西Simões W C S S等人[50]将视觉标签贴在地面上,用户通过智能眼镜识别标签以了解周围环境。陈超[48]给屋内所有设施配置RFID标签,机器人不需测距装置即可自行躲避已知障碍物。佛罗里达大学的Willis S等人[49]在室内网格状铺设RFID标签,向用户提供丰富的环境信息,比如房门处的标签记录了门的位置、开门方式和该门通向的房间信息。将固定标签放置在活动范围内,让盲人携带阅读器了解环境逐渐成为一种常见思路。

随着环境传感器种类的日渐丰富,以及环境检测算法的不断优化,导盲机器人的环境检测功能日趋完善、检测正确率和速度不断提高、检测的目标也从单一趋于多样。为了向盲人用户提供全面、可靠的环境信息,未来导盲机器人的设计势必会向多传感器信息融合的方向发展,以提供实时更新的精测检测结果。

3.2 定位与导航技术

当盲人进行有目的的远距离运动时,需要精确的自身位置信息、目的地位置信息及与目的地之间路线信息。导盲机器人实现精准定位和路径规划的关键技术如表3所示。

阿尔及利亚的Bousbia-Salah M等[51]提出了依靠“记忆”的、不需要定位的导盲方式,在视力正常的人陪同盲人携带导盲杖完成第一次导航路线时,盲人通过键盘记录路途中的每次决策(转弯、穿过人行道等),加速度仪记录步行距离;盲人可选择重放或倒放存储的路线信息来实现独自往返。但这种导航方式存在很大的不稳定性,路径长度计算失误会导致盲人迷失在危险的路口,为保障盲人出行安全,导盲系统必须引入实时定位功能。在室外环境中,最常用、经济的定位方式是借助民用GPS提供的信息。前文提到的各类导航设备中大多结合了GPS技术,基于智能终端设计的导盲系统则直接利用了内置的GPS定位导航功能,如马来西亚Akbar I等人[57]给智能机增加丰富的语音指导,生成了简单的导盲系统。但GPS导航系统并不是针对盲人设计的,实际应用时须补充大量通过视觉获取的交通信息,所以设计盲人专门地图是现今室外导盲系统的重要研究方向,如Balata J等人[52]在GPS和GIS数据库基础上补充信息,构建了强调马路、人行道、建筑等地标的盲人专用地图。

在室内环境中,由于建筑物的遮蔽,民用GPS系统定位精度明显下降,已不适用于实时导航。对于小型室内环境,可建立匹配的3D环境模型,再结合室内定位手段进行导航。例如,比较导盲机器人前端摄像头与3D环境地图中虚拟摄像头拍摄的画面进行物体识别,从而实现定位[21]。对于大型室内环境,如医院、校园、博物馆等,建立详细、仿真的3D模型成本太高,不如在地面铺设轨迹或大量布置固定标签进行平稳导航。

表3 导盲机器人定位与导航领域关键技术

各类固定标在室内导航领域应用广泛,在Ma J等人[58]设计的系统中,Android手机通过识别超宽带无线定位标签实现分米级别的导航,但盲人需与进行定位计算的电脑处于同一WiFi下。保加利亚的Ivanov R[59]在大型医院的各个房间门上粘贴RFID标签,用户可识别存储在其中的房间介绍信息和该房间与其他各房间之间的导航信息。陈超等人[60]用超高频RFID标签标记房间内的障碍物、低频RFID标签标记路口;系统可自主构建电子地图,并结合可视图法和A*算法规划出房间内任意点间的路径。葡萄牙的Gomes J P等人[54]根据不同地点的不同定位精度需求分别布置蓝牙低能信标、视觉标签和NFC标签,并配合WiFi定位构建了大型盲人友好超市,方便盲人自主寻找商品。

少数走在前沿的科研人员正在将室内、室外导航进行结合。佛罗里达大学Ran L等人[56]设计的穿戴式导盲设备在室外借助DGPS数据导航,在室内结合OME超声波定位系统和用ArcView制作的室内地图,提供详细的室内设施介绍。构建了适用于室外的盲人专用地图的团队进一步通过在盲人活动区域内布置尽可能少的蓝牙信标来提高定位精度,实现了室内、室外、公交车站导航模式的无缝切换[53]。

综合来看,GPS导航技术是导盲系统难以绕过的关键技术,但单纯依靠民用GPS进行导航是远不足以实现室内、室外安全导航的精度要求的。铺设可识别轨迹、布置固定标签和建立3D模型都是提高定位精度、实现精准导航的可用手段。另外,为提高更智能、更人性化的导盲服务,室内、室外导航的结合也是科研人员需要研究的方向。

3.3 人机交互技术

人机交互功能是衡量系统“友善性”的一个重要因素,在智能导盲系统中,盲人得到的反馈信息应该是丰富、实用的,盲人也可以向系统输入指令,以求更人性化的导盲服务。导盲机器人人机交互方面的关键技术概括于表4。

导盲系统采用的输入方式种类多样,其中,固定的按键易于记忆,操作方便;语音输入方式可表达详细的指令信息,这两种方式是导盲机器人最常选择的输入方式。此外,以色列Botzer A等人[61]的立体视觉导航设备中安装了眼球跟踪器,将用户眼球的转动作为输入指令,根据用户“看”的方向选择测距方向,更适合非全盲或非先天性失明的用户使用。盲人通过转动手腕[19]、头部[9]、躯干[13]等来改变与之固定的传感器扫描方向,向牵引杆施压以触发相连的压力传感器[62]来判断盲人与设备的相对速度,以及通过手势向机器人表述目的地[63]等行为都是对导盲系统的输入方式。

值得一提的是,按键输入方式不受周围环境的影响,稳定可靠、响应迅速,在紧急情况下通过按键制动能大大提高系统的安全性。而完善语音输入仍然是提高导盲系统智能性的重点之一,导盲系统人机输入方式将在按键搭配语音的基础上趋于多样化。导盲机器人应在不增加盲人负担的前提下获取更多指示信息,从而向盲人提供更全面、细致的服务。

除了移动机器人在盲人前方直接牵引盲人前进以外,导盲系统实用的反馈方式主要是振动、声音及两者组合。其中,振动信息不受环境噪音的影响,也不会干扰盲人获取环境中的声音,可通过多振动马达、多振动类型组合的方式表达丰富的信息。除了用振动强度表示障碍物距离这一常见方式以外,Johnson L A等人[65]研发的导盲腰带上配备了14个振动电机,用多种组合振动方式表示对应方向存在障碍物;王瑞荣等人[66]推出的导盲腰带则通过用16个振动马达表示推荐行走的方向;吴涓等人[67]用8×8的振动序列表示物体的简单轮廓;Bourbakis N等人[68]开发的Tyflos移动辅助装置只保留3D环境中的深度信息,将其经数模转换化为2D振动信息以帮助盲人理解3D环境。

表4 导盲机器人人机交互领域关键技术

声音输出包括语音形式的反馈和非语音形式的反馈。语音形式的信息输出可表示详细的导盲信息,尤其在室外导航中极为重要;非语音形式的声音,如嗡鸣声可通过两耳相位差、响度来表示物体的方向和距离,反馈效率高。加州大学Loomis J M等人[69]在预定轨迹中规划多个航路点,详细对比了用户对语音指示应转向角度、搭配罗盘采用立体音指示方向等多种导航方式的接受程度,验证了立体音导航的科学性。

声音反馈方式提供的信息丰富多样,但为保证嘈杂环境中的使用效果,需要求盲人携带耳机出行;耳机遮盖环境声音,会形成安全隐患。而振动反馈方式能够弥补这一缺陷,保证盲人在交通路口安全转向。总体来说,振动和声音的组合反馈方式足以满足盲人出行的需求,实现导盲功能不需要采用过于复杂的反馈方式。

4 导盲机器人发展趋势

随着人们生活水平的不断提高、社会信息化的快速发展,盲人对提高生活独立性、融入社会的愿望越来越强烈,从而对导盲机器人的更新迭代提出了更高的要求。适应复杂地形环境、构建更智能的导盲系统和与社会深入共融是导盲机器人的必然发展趋势。

4.1 机器人移动方式

除移动式导盲机器人,其他类型导盲机器人均由盲人用户携带移动,故本节探讨的是移动式导盲机器人未来适宜的移动方式。

机器人移动机构主要包括轮式、履带式和腿足式。轮式移动机器人只能在相对平坦地面移动,无法上下楼梯和适应其他复杂地形。履带式移动机器人为草地、松软地面及其他特殊地形而设计,在城市环境中优势不明显。腿足式移动机器人不仅适应所有人类可步行通过的砖铺路面、石子路、草地等复杂地形,且能够跨越障碍、上下楼梯,是理想的导盲机器人移动平台。此外,依现有导盲犬为仿生对象研制的四足导盲机器人具有仿生性强的优势,将更易被视力障碍者接受。

目前,国内外已研制出与导盲犬体形相当的多款四足机器人,能够适应多种室内、室外复杂地形环境,在实现环境感知、定位与导航、人机交互等多种功能并降低成本后即可用作导盲机器人。

4.2 高智能性机器人

高智能性的导盲机器人不仅能科学、高效地完成导盲任务,还能保证盲人群体优秀的使用体验。为了提高导盲机器人的智能性,除了依靠更全面且高精度的环境传感器、更成熟的环境分析和定位导航算法以及更强大的机器人核心计算能力,也要考虑将多模态人机交互、多机交互、人工智能等新兴技术与导盲机器人的设计相结合。

导盲系统中的多模态人机交互技术主要用于获取更全面的用户信息作为系统调整导航策略的输入指令,并给予用户多方面的反馈。盲人除了在视觉方面存在缺陷,在触觉、嗅觉和听觉方面往往拥有更大的优势。另外,特定情绪或状态引起的面部表情、身体动作、声音变化和生理反应,例如超负荷运动导致的呼吸急促、紧张激动导致的心跳加速等现象,也会出现在盲人身上。为导盲机器人设计人机交互方式时,不仅可以利用盲人的感官,还可以考虑盲人的体温、心率、脑电和肌电信号等生理数据,根据盲人的身体状况实时更换合理的导航模式。通过多模态人机交互提升机器人的“情绪智力”,可以使导盲机器人系统更人性化和智能化。

导盲机器人在城市中充分普及后,大量多种类、不同结构的导盲机器人之间必须通过统一的协议进行通信交互。在多机实时交互模式下,各导盲机器人在城市中工作时的位置和获取的环境信息都可以直接分享。例如,当任一个导盲机器人检测到临时出现的大型障碍物或交通堵塞的情况时,全城每一个导盲机器人都能够根据共享的信息重新规划路线,从而预防危险、及时绕路;当某个导盲机器人出现故障或无法满足用户的需求,可以分享实时位置请求其他机器人帮助等。在多导盲机器人实时交互基础上,可以快速构建盲人的专属城市地图。

人工智能领域的多项技术也将应用在导盲领域,例如,人脸识别技术用于识别用户、快速解锁机器人;表情、姿态识别技术用于判断用户的情绪和疲劳程度,调整移动速度;行为预测技术用于预判用户行动,防止用户因跟不上机器人速度引发摔倒事故;大数据分析技术用于处理机器人在导航过程中采集的大量用户反馈信息,帮助科研人员了解大多数用户的需求,从而进一步优化系统,设计出更具有普适性的导盲系统等等。此外,高智能性的导盲机器人还需要掌握用户特有的生活习惯、固定的出行规律、所在城市的天气信息等,从而向盲人用户提供个性化的服务,成为全面的个人出行助手。

4.3 协同、共融的导盲系统

车联网是物联网技术应用于智能交通领域的集中体现,在未来的盲人友好城市中,导盲机器人也会是车联网系统中的一员。如图10所示,加入了导盲机器人的车联网系统中需要考虑到导盲机器人相互之间、导盲机器人与车之间、导盲机器人与建筑物之间、导盲机器人与基础设施之间的信息交换,以及导盲机器人与行人、用户之间的交互。随着车联网内部成员的丰富化,整个系统模型的复杂程度大大增加,对各成员之间通讯和信息传输过程的连续性和可靠性要求也会提高。正在迅速发展的第五代移动通信技术(5G)和基于云计算技术建立的一体化时空信息云平台将为构建高度协同的、包含导盲机器人的智能车联网系统提供强有力的技术保障。

图10 协同、共融的城市导盲系统

导盲机器人采集的大量数据通过5G技术传送到云平台进行统一的存储和处理工作后,云平台再将结合了车联网其他成员的导航指示信息传输给机器人,大大缓解了单一导盲机器人有限的计算和存储能力难以负担的大量计算需求和低时延通信的压力。但单凭借云平台的集中式大数据处理技术并不能高效处理车联网边缘设备所产生的数据,需要通过边缘计算在靠近物或数据源头的一侧提供端服务。对于导盲机器人来说,采用边缘计算预先完成摄像头采集的深度点云信息的处理、用户语音输入信息中有效内容的提取、机器人周身障碍物的定位、红路灯信号的读取等操作后,再将处理后的数据传送到云端进行综合计算的方式可以显著减少延迟、提高响应时间,从而节省时间和成本,提高安全性。与纯粹的云端解决方案相比,采用包含边缘计算的混合方案是促进车联网发展,构建协同、共融的导盲系统的必然趋势。

5 总结

目前大多数导盲机器人均处于原型研发阶段,尚未对视力障碍者进行长时间的跟踪实验。但随着科研人员的努力,导盲机器人正朝着集成化、智能化、人性化的方向快速发展。长远来看,构建零歧视、无障碍的盲人友好城市,不仅要求导盲机器人具备完善的环境感知功能、实现精准定位与高效导航、采用智能贴心的人机交互方案,更离不开服务人员对导盲系统长期有效的维护。同时,导盲机器人将进一步优化本体结构,以提升运动水平、环境适应能力;还需要结合人工智能、高速移动通信、云平台及边缘计算等技术,提升导盲机器人的人机交互水平、应急处理能力、自学习功能,提供云端丰富的后台服务,构建协同共融的生态系统,从而提升导盲机器人的整体服务能力,使导盲机器人更好地服务于视力障碍者,更好地服务于社会。