基于超像素一致显著性的视频运动目标检测算法

2020-01-07于洪洋王晓曼崔循景文博董猛

于洪洋,王晓曼,崔循,景文博,董猛

(1.长春理工大学 电子信息工程学院,长春 130022;2.长春理工大学 光电工程学院,长春 130022)

在科技快速发展的今天,运动目标检测技术的应用已经成为了人们生活中必不可少的一部分。在运动目标检测领域,经典的检测方法包括帧差法、背景建模减除法和光流分析法[1],这些方法易受环境因素影响,在光照变化、镜头抖动、动态干扰下表现不佳。近年来,提出了一些基于视觉显著性的方法和基于深度学习的方法来解决此类问题。而深度学习往往需要大量的样本用于网络的训练,因此将显著性方法用于视频动态目标的检测成为了热门的研究话题。

Liu等[2]提出一种基于超像素的视频显著性模型,在每一个超像素内提取运动直方图和颜色直方图作为局部特征,级联获得全局特征,用于描述每一帧的图像信息。然后用超像素级的运动特征来预测和调整时间显著性,利用空间特征的全局对比度和稀疏性来计算空间显著性,最后通过自适应权重将二者融合获得最终的显著性结果。Wang等[3]结合帧内边界和帧间运动的两方面信息,提出运动边界(Motion Boundary)特征,并验证了光流梯度映射比运动显著性测度更加稳健可信。Singh等人[4]首先将像素聚类成块或时间超像素,提取如颜色、运动和边界等多元化特征,从不同侧面生成显著性模型,然后通过线性SVM对这些显著性图进行加权融合,进而检测出显著目标。Shen等[5]提出一种基于显著性改进的距离正则化水平集活动轮廓模型分析方法,显著减少了水平函数演化次数,提高了图像目标检测效率。Sun[6]用HSV色彩空间来完成颜色特征的检测和轮廓特征的检测,之后将两种特征相融合来对目标物进行检测。邓晨,刘峰等人[7-8]考虑到图像的上下文感知,通过局部和全局的特征检测显著目标。林晓等人[9-11]通过对图像进行稀疏编码来分析不同色彩空间中的显著特征;周强强等人[12]将先验和后验概率融入显著性检测方法中,通过对图像的前景和背景的分析,并利用贝叶斯准则计算目标在空间上的概率特性,从而检测出显著目标区域。目前基于显著性的视频运动目标检测的大多方法虽然检测精度较传统方法有所提高,但是针对背景纹理复杂以及多种环境因素干扰的情况,仍然存在着目标的检测准确性不高,鲁棒性较弱等问题。

本文结合视频单帧图像显著性,帧间运动目标匹配关系和超像素分割,提出一种检测准确度高、鲁棒性强的视频运动目标检测方法。

1 视频运动目标检测

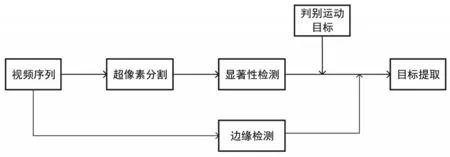

首先对视频图像进行超像素分割,在保留目标特征完整性的基础上降低图像后续处理的计算复杂度,有效的加快算法计算速度。接着通过视频单帧图像显著性确定目标区域,进而对比视频帧间一致性关系实现对运动目标的检测,并结合对原始视频图像的轮廓分析、引入协同判别因子提升对运动目标的检测精度,最后利用最大熵阈值分割得到显著图像的二值图,即检测出正确的运动目标,算法流程如图1所示。

图1 基于超像素一致显著性运动目标检测算法流程

1.1 超像素分割

本文采用SLIC算法,相对于Turbopixel、基于熵率等其它方法[13],该算法的运行速度,超像素的紧凑性和轮廓保持都具有较好的效果,较为符合人们期望的分割效果,并且使图像邻域的特征更容易表达,效果如图2所示,其中图2(a)和图2(b)分别为原图和分割处理后的图像。

图2 SLIC分割算法结果示例

1.2 显著性检测

显著性检测通过遗传算法,禁忌搜索,神经网络等智能算法模拟人的视觉特点,构建合理的计算模型,能够从视频图像中获取关键信息,更加有效地突出图像内容。显著性和重复性是计算视频显著性目标过程中的决定性因素,因此对于运动目标的显著性检测,需要考虑如何通过提取单幅图像有效特征用于计算图像的显著性区域以及如何通过对组内多幅图像间运动目标的一致信息对共同显著区域进行强化,实现对视频中的运动目标显著区域的定位。

本过程重点是在超像素分割的基础上结合图像的局部显著性、全局显著性以及一致显著性等三个方面对视频动态目标进行确定,如图3所示。

图3 本文显著性检测过程

1.2.1 图像特征提取

图像中区域的显著性大小受其自身的特征和周围环境影响,至少有一种特征与其周围环境有所差别才可成为目标的显著区域。对于不同场景下的视频图像,相同特征对视觉显著性的所起作用也是不尽相同的。有的图像中亮度对图像的显著性的影响较大,有的图像中颜色对图像显著性的影响较大,因而在不同图像的分析过程中提取目标需要不同的视觉特征。起初有学者曾提出提取图像亮度、颜色和方向等特征,但之后通过人们的研究表明,方向特征在提取图像过程中发挥的作用并不大,并且增加了算法计算的复杂程度,因此本文考虑图像亮度和颜色特征属性。

研究发现,人的视觉特性对HSI色彩空间更加敏感,本文将对原始输入图像进行从RGB到HSI颜色空间的处理,进而获得亮度和颜色特征图,计算公式为:

1.2.2 局部显著性分析

图像中像素的局部显著性大小受该像素相对于周围像素的对比度影响,对比度越大,该像素越显著。本文从频域的角度分析像素的局部显著性,实验证明,通过相位谱和幅度谱的重构结果截然不同,只有利用相位谱才能恢复出与原图像结构相似的结果。本文算法首先对图像进行傅里叶变换用于提取图像的幅度谱和相位谱;接下来通过相位谱实现图像重构,获得图像的局部显著性图,计算公式为:

图4 局部显著性生成示例图

1.2.3 全局显著性分析

分析视频序列图像的全局显著性,可以有效改善局部显著性检测中边缘变化比较剧烈、背景区域显著性偏高,而较为平滑的目标内部的显著性较低的情况,图像的全局显著性获得公式为:

式中,SGlobal(x,y)表示所得显著图像的全局显著性值。效果如图5所示,其中5(a)为原图,5(b)为全局显著性生成图。

图5 全局显著性生成示例图

1.2.4 一致显著性分析

对于视频图像序列运动目标的检测过程中,仅利用单幅图像的显著性方法不足以对运动目标进行区分,一致显著性分析为的就是在多幅图像中提取相似或共有的目标,通过空间相邻的相似区域显著性的一致性信息,实现对该组图像中的运动目标更加精确的判断。本文利用帧间超像素块间相似度权重wi,j作为匹配依据,之后通过图像间超像素显著性传播协同判别因子来保证对视频运动目标的检测精度。

(1)相似度度量

在视频图像序列匹配中,图像的区域特征属性不会受局部的偏差影响,并易于实现。因此,本文采用纹理与颜色特征有效准确地表征视频图像序列间超像素块之间的相似程度,计算公式为:

图6 一致显著性分析示意图

(2)图像间显著性协同判别因子

在视频序列图像中,对超像素rm来说,达到匹配条件的的匹配区域不仅包含所要检测的显著性目标,也存在其它部分(匹配误差)。如图6所示,中心图像内圆点标注区域为待匹配的超像素块,四周图像中圆点和方块标注部分均为满足匹配条件的图像间匹配区域。对于一致显著性分析而言,更希望超像素rm的显著值与圆点标注区域具有一致性。为了提高超像素块间的匹配精度,引入视频序列间显著性传播协同判别因子δm,n,表示为:

1.2.5 显著图生成

为了合理的表征显著区域,不同的显著图对显著区域的表征作用有所差别,最终的显著图需要通过对显著图有效的整合获得。本文从显著点个数、位置和视频帧间匹配程度等几个方面对特征进行动态的选择和加权。

首先,对各个显著图进行阈值计算,将大于图像阈值的像素点定义为该幅图像的显著点。根据稀少性原则,显著点越多的特征显著图在获取最终显著图的融合过程中所起作用越小,为此定义权值Wweight为显著点的个数的倒数,公式为:

根据中心-周边原理,通过中心-周边机制来对局部区域的对比度特征进行提取,在该机制中,视觉神经元通常容易对局部的中心区域敏感,当中心区域的视觉神经元受到刺激而产生兴奋的时候,中心周围的大区域会抑制这种兴奋。因此,人们面对一幅图像时,图像中心区域成为图像显著区域的几率更大,公式为:

式中,N为显著图中显著点总数;pi为显著点所在位置;center为图像像素的中心位置;Dist( ⋅)表示图像中显著点与图像像素中心位置距离。

为了保证图像序列间相似区域的显著性一致,将视频帧间匹配区域设为图像间初始匹配区域,并对每帧图像的匹配区域进行OBB包围盒处理,得到最后的动态目标匹配区域,将动态目标区域内匹配系数T设为1,区域外匹配系数设为0,公式为:

为了获得最终显著图,利用式(9)对多幅显著图进行融合,融合后效果如图7所示。

式中,Si为第i个显著图;T(x,y)为运动目标匹配系数;Sfi为匹配运动目标区域后第i个显著图;Wiweight、Widistance分别为第i个显著图的面积因素和位置因素的权值;Wfi为第i个显著图上述2个因素权值的综合;Wi为第i个显著图的对最终显著图生成所占权值;S为最终显著图。

图7 综合显著性生成示例图

1.3 目标提取

计算得到视频序列显著图像的同时,为进一步确定视频运动目标的匹配区域,需对原始视频图像序列进行Sobel边缘检测,将视频图像序列中具有完整闭合几何图形的动态目标匹配区域作为计算阈值的初始范围,并将该区域扩大二倍作为计算阈值的最终范围。本文在最终范围区域采用最大熵原理确定显著图像的分割阈值,这样保留了预测分割阈值过程中全部的不确定性,将风险降到最小。之后对显著图像使用该阈值进行阈值分割,得到二值化图像,即检测出了正确的运动目标,效果如图8所示,其中8(a)为综合显著图,8(b)为边缘检测后图像,8(c)为阈值分割后图像。

2 实验结果和分析

为了评价本文算法的综合性能,进行定性分析和定量比较两部分实验,实验中选取四种不同场景下连续20帧图像用于对视频运动目标的检测。

2.1 实验结果定性分析

为了验证本文提出的视频运动目标检测算法的有效性,在实验结果定性分析部分,将本文算法的检测结果与已有的运动目标检测算法对比。选取四种包含不同环境因素的视频进行测试,并对比了四种目前比较常见的运动目标检测算法的可视化结果。为确保对比实验的公平性,所有方法均未做形态学处理,视觉效果对比如图9所示,其中9(a)为原图,9(b),9(c),9(d),9(e)分别为三帧差分法、GMM、Vibe及本文算法的效果图。

从在图9中可以看出,通过帧间差分法检测到的目标完整性不好,内部含有“空洞”,不适合单独使用。Vibe虽然可以避免由于大面积的光照变化以及视频细微抖动导致的误判,但其也有一定的局限性,在检测过程中会因目标运动状态的改变出现虚假目标。GMM方法是目前使用最广泛的一种方法,但对背景图像实时更新困难,物体检测中常出现的Ghost区域。本文结合显著性检测和视频帧间超像素块的一致性可以有效的进行视频动态目标的检测,排除一些静止目标与背景物体的干扰。

图8 目标提取示意图

图9 四种视频运动目标检测算法检测结果

2.2 实验结果定量比较

通过定量分析证明本文算法的优越性,采用两种常用的评价指标对实验结果进行评估:P-R曲线(准确率-召回率),Fβ值。其中准确率P指被正确检测到的运动目标像素所占百分比,而召回率R是指检测到的运动目标像素所占百分比。计算公式如下:

式中,TP表示正确检测到的运动目标像素数;FP表示背景误判为运动目标的像素数;FN表示运动目标被误判为背景的像素数。考虑到精确度和召回率会出现矛盾的情况,需要引入Fβ值这一评价指标,该值有效表征了动态目标检测算法在提取运动目标的同时又抑制静态目标的能力,Fβ在数值上表示P和R的加权调和平均数,计算方法如下:

由于在算法的性能评估中更注重准确度的高低,故β<1,本文取权重系数β2=0.3。

表1 视频运动目标检测算法性能数据对比

由表1可以看出,本文算法在满足检测实时性的同时,准确率,召回率,Fβ均优于另外4种算法,显示出了本文算法对视频运动目标检测的良好效果。

3 结论

本文对基于显著性的视频运动目标检测算法进行了研究,结合单幅视频图像的显著性特征和多幅视频图像间超像素块匹配的一致程度,提出一种基于超像素一致显著性的视频运动目标检测算法,通过视频图像间超像素块间的相似性度量和协同判别机制的引入,解决了在不同复杂场景下视频运动目标检测准确率不高,鲁棒性较弱等问题,实现了对视频运动目标更有效、更准确的检测。