面向智能维护的通信机房机柜图像语义分割技术

2019-12-14刘桂雄

赵 迪,刘桂雄

(华南理工大学机械与汽车工程学院,广东 广州 510640)

0 引 言

电子设备、自动化装备智能维护是信息技术、人工智能技术与高端制造业的交叉应用领域,是实现设备无人化、智能化监管的发展趋势[1]。通信机房作为大规模通信网络的中继站,其电子设备安全性、可靠性十分重要,实现通信机房机柜的智能监管、维护、检修是保障通信系统安全运作的核心[2]。

视觉检测是实现设备智能维护的关键技术,设备图像识别、故障位置检测、检修操作点确定均可由视觉方法实现[3]。文献[4]通过视觉检测方法进行输电线路环境状态检测,设计研制一种输电线智能维护机器人,实现输电系统中断股补修维护。文献[5]通过分析机械手系统位姿偏差导致维修抓取过程误差,提出全局相机测量维修工具位姿方法、引入视觉伺服控制策略,完成机械手系统较高精度定位与维修工作。近年出现的CNN端到端语义分割方法可以在像素尺度上识别多个对象,输出无分辨率损失的多值图,融入机器视觉中将可以在精密测量分析场合下形成泛用性强的人工智能方法[6-7]。语义分割方法可分为CNN端到端语义分割方法、编-解码器架构语义分割方法、并联多孔卷积架构语义分割方法,其中CNN端到端语义分割方法结合具体领域评价规则,可形成专用领域的智能机器视觉系统[8]。华南理工大学[9]在机箱装配质量检测中引入CNN端到端语义分割方法方法,实现机箱上COM、USB等多类零部件的像素级检测,结合机箱装配质量评判规则,为机箱误装配、漏装配的检修、维护提供技术支撑。文献[10]针对传统桥梁裂缝图像检测算法难以准确提取裂缝的问题,提出一种基于语义分割的桥梁裂缝检测算法,实现裂缝位置高精度提取、桥梁状态准确监测。通信机房机柜的图像检测与维护的基础是大量重复的图像背景中目标板卡识别、操作点检测,语义分割技术的像素分割准确率是关键[11]。

本文将从深度学习语义分割技术入手,分析机房机柜图像检测与维护关注的关键特征,提出基于Mask R-CNN的机房机柜图像语义分割技术。通过设置机房机柜语义分割对比试验,验证本文所提出方法的语义分割效果。

1 面向智能维护机房机柜图像关键特征分析

机房设备包括电子设备、数据通信设备、信息技术设备及防护结构。设备通过内部的支撑、支架、螺丝、卡子、扳手等固定电源、主机板、各种扩展板卡,形成一个整体,并提供便于使用的面板开关。

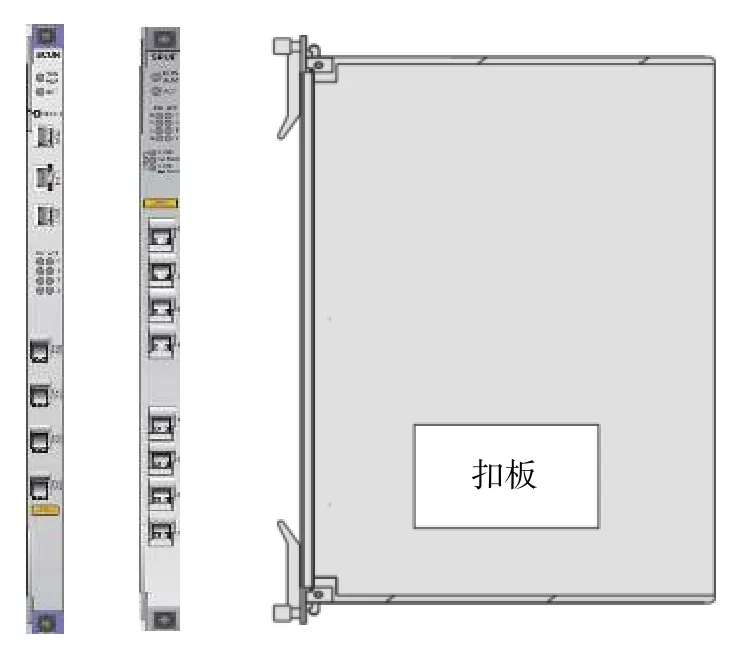

图1为SCU主控板卡、扩展板卡模型。作为板卡维护过程中的重点拆卸部件,松不脱螺钉、锁紧扳手在成像视野中的位置、开合状态是图像关键特征。同一机房设备不同类型板卡之间只存在结构参数差异,松不脱螺钉、锁紧扳手与板卡的相对位置固定,有效缩小上述关键特征在设备图像中的搜索范围。

图1 SCU主控板卡、扩展板卡模型

板卡在机箱中连接紧密,对特定故障板卡进行拆卸维护时,应对目标板卡进行精确定位,避免对其他板卡结构产生影响。因此,目标板卡在设备图像中的边界是图像中另一关键特征。

基于上述分析,结合视觉成像、语义分割方法识别机房设备图像关键特征是核心问题。1)在机房设备图像中分割目标板卡范围、确定操作边界;2)根据螺钉、紧固扳手与板卡相对位置缩小特征搜索范围;3)结合图像分割识别结果得到维护操作点精确位置。

2 基于Mask R-CNN机房机柜图像语义分割技术

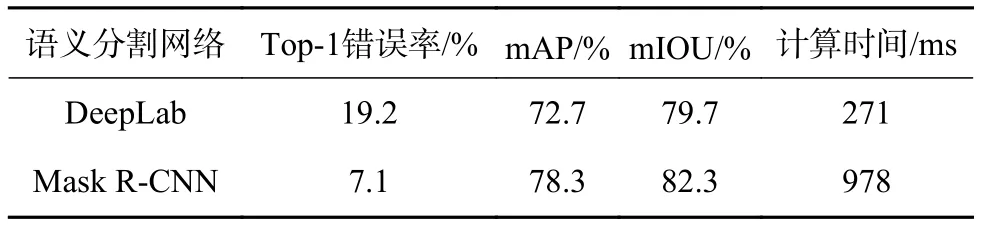

在执行机房机柜维护任务时,首先要确定维护对象。传统方案多采用经典图像处理算法,如通过CCD采集图像,基于OpenCV实现图像二值化、特征提取,根据目标面积、数量、位置、长度等特征信息完成目标识别。经典图像处理方法对光源、背景等环境因素要求高,难以适应照度多变、背景杂乱的通信机房设备识别。基于神经网络强大的图像表征能力、面对图像背景噪声的鲁棒性,本文提出采用深度学习语义分割方法实现机房设备图像识别与分割。表1为常用神经网络识别性能对比表,表中数据为相应网络模型在大型数据集上训练得到的识别结果,分析表中数据可知Mask R-CNN[12]具有优异的识别、分割性能。

表1 常用目标识别神经网络性能对比表

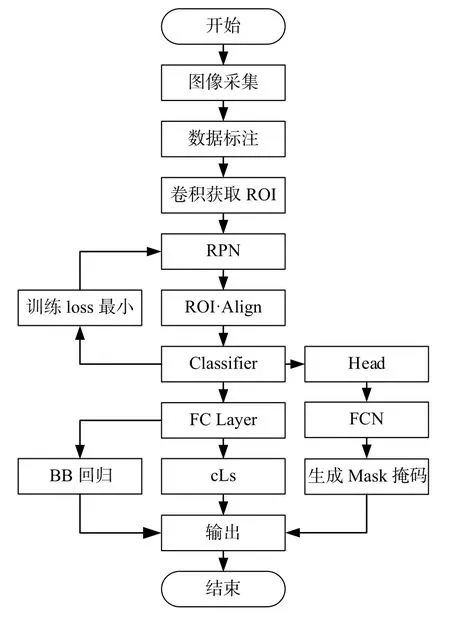

因此,本文采用Mask R-CNN语义分割模型对维护对象进行目标识别、语义分割,实现目标板卡、操作点的精准定位。图2为基于Mask R-CNN的机房设备图像语义分割技术流程,其详细步骤包括:

图2 机房设备图像语义分割技术流程

1)通过相机获取设备图像信息。

2)绘制图像目标矩形、多边形标注框,将图中目标点坐标信息保存为JSON文件。

3)将图片输入骨干网络 (backbone network)中提取特征,得到特征图(feature maps),以特征图中像素点为中心,设定若干个感兴趣区域(region of interest,ROI)。

4)候选区域生成网络 (region proposal network,RPN)利用滑动窗口在特征图上为每个像素点生成若干预设尺寸的锚点框(anchor),通过anchor、ground truth 间 的 IOU(intersection over union)数 值 判 断anchor为目标或为背景,并为目标anchor进行坐标修正,具体为在x、y方向上平移修正量tx、ty,在长、宽方向乘以放大倍数th、tw,以去掉判断为背景区域的ROI。

5)对RPN网络筛选剩下的ROI执行ROI Align操作,通过双线性插值法实现feature maps像素与原图像素对齐。

6)分类器(Classifier)则分为目标分类、边界框(bounding box,BB)回归、掩膜 (Mask)生成,目标分类、BB回归之前需经全连接层实现特征全连接计算;Mask生成分支则经图像维度扩展,经全卷积网络 (fully connection network,FCN)后完成目标像素级语义分割。

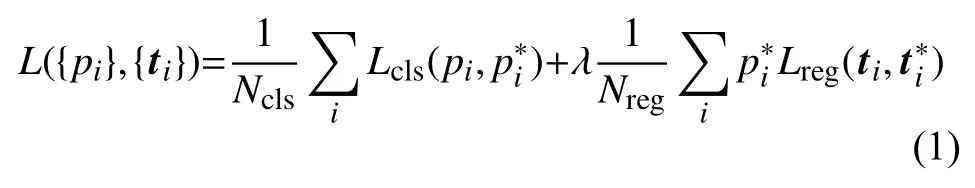

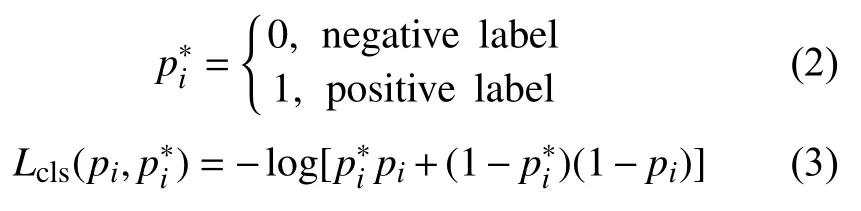

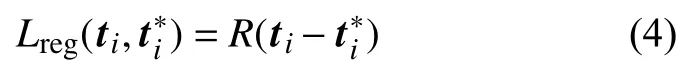

训练RPN网络的损失函数为

训练Classifier网络的损失函数为

式(6)分3个部分,Lc为 分类损失,Lb为边界框修正损失,Lm为Mask损失,其中第3部分损失函数二分类均值交叉熵损失Lm=Sigmoid(Cls_k),仅在其对应的第K类ROI计算时有定义,其他K-1个Mask对整个损失函数不做贡献;第一、第二部分字母含义与RPN网络中相同,即:

由上得出Mask R-CNN的损失函数Lfinal为:

当损失函数Lfinal经过N次迭代训练并收敛时,神经网络训练完成。此时,将测试图像输入神经网络,网络自动识别出图像中维护目标,完成语义分割。

3 实验与结果分析

实验采用Intel公司RealSense系列D435i深度相机 (分辨率 1 920×1 080、RGB 传感器 FOV 69.4°×42.5°×77°(±3°)、帧率 30 f/s),在日光灯光照条件下,分别于距机柜2.2 m、0.5 m处对机柜设备进行图像采集。为了验证模拟智能维护效果,利用视频图像进行测试,并分析视频每帧图像的检测效果。

图3为模拟不同视野维护实验结果,在距离较远、视野较大情况下,体积较大的机柜、服务器识别置信度较高,体积较小的面板识别置信度则相较稍低;当距离不断减小时,服务器的识别置信稍有降低、扳手面板的识别置信稍有提高,总体识别置信度均保持在0.99以上。

图3 机柜服务器不同视野识别效果

图4为模拟维护过程受玻璃、人体等遮挡试验结果。目标机柜、机箱、面板识别受玻璃遮挡影响不大,在有人体遮挡的情况下机柜识别受影响较小,服务器、面板的识别几乎不受影响,置信度保持在0.98以上。

图4 机柜服务器受玻璃、人体遮挡识别效果

可以看出,采用语义分割网络可以实现在背景、光源复杂环境下机柜设备准确识别、分割。

利用边缘检测网络HED[12]与语义分割网络DeepLab[13]、Mask R-CNN[14]进行对比实验,图5 为HED、DeepLab、Mask R-CNN 在模拟维护检测中的实验效果。HED能够识别出机柜设备边界及机箱,但检测精度较低且没有机柜标签、尺寸信息,无法为后续维护操作提供精确位置信息;DeepLab能够实现像素级分割,分割效果较好但存在分割边界信息缺失问题;Mask R-CNN识别分割效果能够达到检测要求,并且能够提取机柜、机箱及扳手等精确位置信息。

图5 HED、DeepLab、Mask R-CNN在模拟维护检测中的实验效果

表2为语义分割网络DeepLab与Mask R-CNN的模拟维护检测性能对比表。DeepLab平均精确度 (mean average precision,mAP)、平均交并比 (mean intersection over union,mIOU)均达到较好水平[6],虽然时间性能满足实时检测要求,但准确性略有不足;Mask R-CNN在满足实时检测要求时,识别准确性、分割效果均比DeepLab佳。

表2 语义分割网络DeepLab与Mask R-CNN的模拟维护检测性能对比表

4 结束语

1)从面向智能维护的机房设备图像关键特征分析入手,指出作为板卡维护过程中的重点拆卸部件,松不脱螺钉、锁紧扳手在机器人成像视野中的位置、开合状态、目标板卡在设备图像中边界是图像关键特征。

2)通过对比神经网络性能,提出基于Mask RCNN的机房设备图像语义分割技术,基于神经网络强大的图像表征能力、面对图像背景噪声的鲁棒性,弥补经典机器视觉方法对光源、背景、环境要求高的弱点,实现对机房设备图像的语义分割,为指导机房机柜设备智能维护提供技术支撑。

3)构建机柜机箱服务器检测试验装置,进行不同视野、不同遮挡条件试验,以及不同检测算法间对比实验,结果表明基于Mask R-CNN的语义分割技术在不同成像条件下分割效果鲁棒性佳、在分割准确性上具有较大优势。

机房设备图像语义分割技术是通信机房维护技术的核心,下一步将结合控制结构及算法、路径规划算法实现通信机房设备智能维护。