一种改进词袋模型的图像分类算法

2019-07-01李咏豪

李咏豪

摘 要:传统词袋模型易受视角、尺度和背景等因素干扰。本文对传统词袋模型进行了改进,提出一种基于角点检测和图论的感兴趣区域提取方法,以及结合高斯模糊隶属度函数选取视觉单词。首先,对图像进行角点检测,利用图论的方法划定ROI区域,然后对得到的ROI区域进行SIFT特征的提取并生成视觉词典,从而减少背景信息的影响。其次,引入高斯模糊隶属度函数改进图像视觉直方图的表示。在Caltech 100数据库上的实验结果表明,本文提出的方法相较于传统词袋模型,分类准确度提升了3%。

关键词: 词袋模型;角点提取;图论;高斯模糊隶属度函数

文章编号: 2095-2163(2019)03-0097-04 中图分类号: TP391.41 文献标志码: A

0 引 言

在计算机视觉领域中,图像分类是基础问题之一,被广泛应用于视频监控和图像分析等方面。图像分类中常用的方法是词袋模型[1-3]。词袋模型可以分为以下3个步骤:

(1)特征提取。利用SIFT算法[4]生成128維的特征描述子,这些描述子具有尺度、光照等的不变性。

(2)构造视觉词典。利用k-means聚类算法对SIFT描述子进行聚类,得到视觉单词,进一步构建视觉词典。

(3)利用支持向量机(SVM)完成分类。

词袋模型的分类效果易受视角、尺度、背景等因素干扰。针对这些问题,目前提出不少对于词袋模型的改进算法。Wang等人[5]提出空间金字塔匹配模型;Philbin等人[6]提出一种软分配的视觉词汇统计直方图的构建方法。同时,人类在识别图像时,往往只是对某一区域感兴趣,而不是整幅图像。研究时,就可以通过对ROI(感兴趣区域)进行特征提取,从而减少非感兴趣区域特征点的干扰。因此,本文通过对原图像进行角点检测,结合图论方法,确定ROI,然后对ROI进行SIFT特征点提取,这样可以使提取的SIFT特征描述子集中在物体上,排除背景上的干扰点。另外,在视觉词汇直方图生成过程中,本文引入模糊隶属度函数来提高分类准确率。对此可做研究阐述如下。

1 ROI区域定位

传统词袋模型是对整幅图像提取特征,如此一来,位于背景上的特征点也被提取出来,这将对视觉词典直方图产生一定影响。因此,本文采用角点和图论相结合的方法来减少背景特征点的影响。这里拟将探讨分述如下 。

1.1 角点提取

Shi等人[7]提出用于追踪的Shi-Tomasi角点特征,在视频跟踪领域有较好的效果。本文将Shi-Tomasi角点特征引入到图像分类中,和图论方法相结合,用于定位ROI区域。角点属于图像中的局部特征点,角点处的一阶导数为局部最大,并且图像的灰度值在水平与垂直方向上有一定变化。设图像在像素点(x,y)处的灰度值为I(x,y),以该点为中心构建一大小为n*n的窗口M,窗口平移(x,y)后的灰度变化如下:

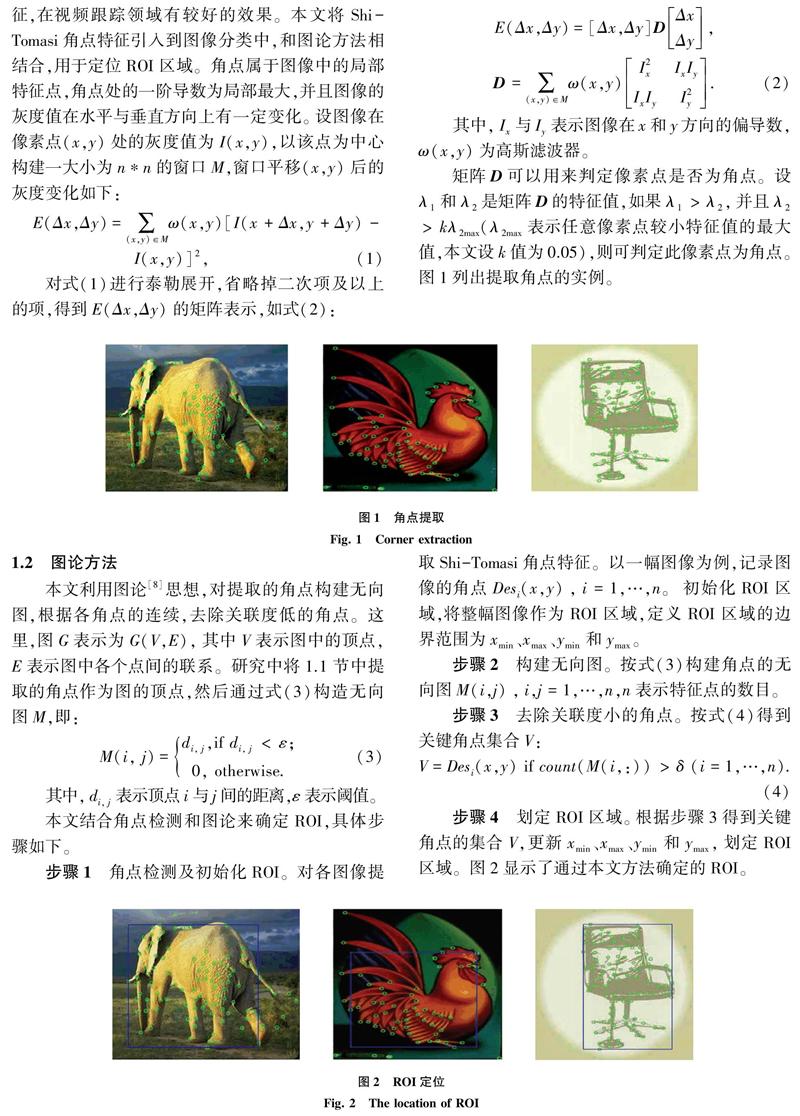

矩阵D可以用来判定像素点是否为角点。设λ1和λ2是矩阵D的特征值,如果λ1>λ2,并且λ2>kλ2max(λ2max表示任意像素点较小特征值的最大值,本文设k值为0.05),则可判定此像素点为角点。图1列出提取角点的实例。

1.2 图论方法

本文利用图论[8]思想,对提取的角点构建无向图,根据各角点的连续,去除关联度低的角点。这里,图G表示为G(V,E),其中V表示图中的顶点,E表示图中各个点间的联系。研究中将1.1节中提取的角点作为图的顶点,然后通过式(3)构造无向图M,即:

本文结合角点检测和图论来确定ROI,具体步骤如下。

步骤2 构建无向图。按式(3)构建角点的无向图M(i,j),i,j=1,…,n,n表示特征点的数目。

步骤3 去除关联度小的角点。按式(4)得到关键角点集合V:

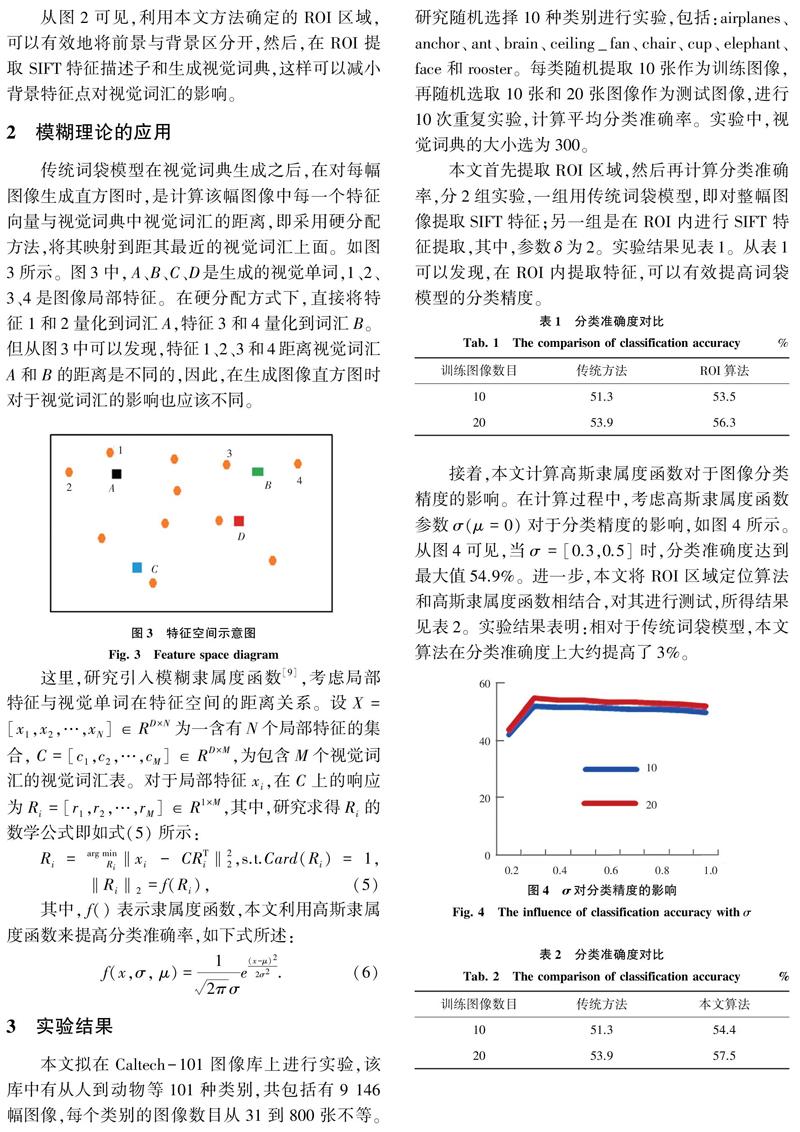

步骤4 划定ROI区域。根据步骤3得到关键角点的集合V,更新xmin、xmax、ymin和ymax,划定ROI区域。图2显示了通过本文方法确定的ROI。

从图2可见,利用本文方法确定的ROI区域,可以有效地将前景与背景区分开,然后,在ROI提取 SIFT特征描述子和生成视觉词典,这样可以减小背景特征点对视觉词汇的影响。

2 模糊理论的应用

传统词袋模型在视觉词典生成之后,在对每幅图像生成直方图时,是计算该幅图像中每一个特征向量与视觉词典中视觉词汇的距离,即采用硬分配方法,将其映射到距其最近的视觉词汇上面。如图3所示。图3中,A、B、C、D是生成的视觉单词,1、2、3、4是图像局部特征。在硬分配方式下,直接将特征1和2量化到词汇A,特征3和4量化到词汇B。但从图3中可以发现,特征1、2、3和4距离视觉词汇A和B的距离是不同的,因此,在生成图像直方图时对于视觉词汇的影响也应该不同。

其中,f()表示隶属度函数,本文利用高斯隶属度函数来提高分类准确率,如下式所述:

3 实验结果

本文拟在Caltech-101图像库上进行实验,该库中有从人到动物等101种类别,共包括有9 146幅图像,每个类别的图像数目从31到800张不等。研究随机选择10种类别进行实验,包括:airplanes、anchor、ant、brain、ceiling_fan、chair、cup、elephant、face和rooster。每类随机提取10张作为训练图像,再随机选取10张和20张图像作为测试图像,进行10次重复实验,计算平均分类准确率。实验中,视觉词典的大小选为300。

本文首先提取ROI区域,然后再计算分类准确率,分2组实验,一组用传统词袋模型,即对整幅图像提取SIFT特征;另一组是在ROI内进行SIFT特征提取,其中,参数δ为2。实验结果见表1。从表1可以发现,在ROI内提取特征,可以有效提高词袋模型的分类精度。

接着,本文计算高斯隶属度函数对于图像分类精度的影响。在计算过程中,考虑高斯隶属度函数参数σ(μ=0)对于分类精度的影响,如图4所示。从图4可见,当σ=[0.3,0.5]时,分类准确度达到最大值54.9%。进一步,本文将ROI区域定位算法和高斯隶属度函数相结合,对其进行测试,所得结果见表2。实验结果表明:相对于传统词袋模型,本文算法在分类准确度上大约提高了3%。

4 结束语

本文提出了角点检测和图论相结合的ROI定位方法,在一定程度上降低了背景、尺度、角度对图像分类的影响,使所提取的SIFT特征点集中在物体上,则能生成更具有代表性的视觉词汇。同时引入模糊隶属度函数,在图像直方图表示生成时融合空间信息,提高图像的分类精度。在Caltech-101数据集上的实验结果表明,本算法较传统词袋模型算法有更高的分类準确度。

参考文献

[1]WANG Chong, HUANG Kaiqi. How to use Bag-of-Words model better for image classification[J]. Image and Vision Computing, 2015, 38: 65-74.

[2] LI Feifei, FERGUS R , PERONA P. Learning generative visual models from few training examples: An incremental Bayesian approach tested on 101 object categories[J]. Computer Vision and Image Understanding,2007,106(1):59-70.

[3] GREGORY G, AlEX H, PIETRO P. Caltech-256 object category dataset [D]. California: California Institute of Technology, 2007.

[4] EVERINGHAM M, Van GOOL L, WILLIAMS C K, et al. The pascal visual object classes (voc) challenge[J]. International Journal of Computer Vision, 2010, 88(2): 303-338.

[5] WANG Junqiu,CIPOLLA R,ZHA Hongbin.Vision-based global localization using a visual vocabulary [C] //Proceedings of the 2015 IEEE International Conference on Robotics and Automation. Barcelona:IEEE,2005: 4230-4235.

[6] PHILBIN J,CHUM O,ISARD M,et al. Lost in quantization: Improving particular object retrieval in large scale image databases [C] // IEEE Conference on Computer Vision and Pattern Recognition, 2008( CVPR 2008). Anchorage, AK:IEEE, 2008:1-8.

[7] SHI J,TOMASI C, Good feature to track[C] // Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Seattle:IEEE Press, 1994: 593-600.

[8] JIANG Wen, GUO Fei, LIU Zheng. A graph theory method for determination of cryo-EM image focuses[J]. Journal of Structural Biology, 2012, 180(2): 343-351.

[9] KUMAR M, STOLL N, THUROW K, et al. Fuzzy memberships descriptors for images[J]. IEEE Transactions on Fuzzy Systems, 2016, 24(1): 195-207.