西方新闻传播学的算法研究综述

2019-05-15周祉含

周祉含

[摘要]机器和算法已广泛应用于新闻传播领域:在社会化媒体、搜索引擎、个性化新闻客户端等新兴媒体信息聚集与分发平台内部,正发生着把关权力从人工编辑向智能算法的让度和转移。首先对西方新闻传播学相关文献进行了梳理,勾勒出算法研究的核心命题和热点议题以及可能出现的问题和风险。算法的“黑箱”特性要求研究方法的创新,其次介绍了逆向工程研究法,通过对“输入一输出关系”的不断检验,可以部分推导出算法的设计逻辑。

[关键词]算法;大数据;逆向工程;人工智能;批判算法研究

2017年2月,美国皮尤研究中心发布了题为《代碼依赖:算法时代的利与弊》的报告。报告邀请了1300余名科技专家学者、从业者、政府人员等对算法未来十年的潜在影响发表看法和意见,并在此基础上归纳出算法时代的七大主题:一是算法的应用范围将继续扩大;二是好事情就在前方;三是数据、预测模型至上将带来人性、人类判断的缺失;四是算法组织系统中存在偏见;五是算法分类加深分歧;六是失业率将上升;七是需要提高算法素养、透明性和监管;算法也广泛地应用于新闻传播领域,以上:七大主题凸显了大数据背景下算法所发挥的越发重要的作用。

算法是一种编码程序,通过特定的运算把输入数据转化为想要得到的输出结果。从社会化媒体的热门话题排行到搜索引擎的结果页排名,从豆瓣的电影、书籍推荐再到新闻客户端的个性化资讯推送,算法主导信息聚集和分发,辅助甚至代替人工编辑进行信息的筛选和推荐。例如,个性化新闻客户端今日头条声称,它“没有采编人员,不生产内容,没有立场和价值观,运转核心是一套由代码搭建而成的算法”。

算法的渗透对于新闻生产、分发、消费乃至整个信息生态系统而言是全方位的、全环节的。算法——这一计算机科学领域的术语开始进入人文社会科学研究者的视野,一批从新闻传播学视域展开的研究也开始崭露头角。

一、聚焦算法:学术视角与理论框架

英国著名文化研究专家斯科特·拉什近年来关注后霸权时代的权力,并观察到权力运行方式从“外部施加”向“内在生命化”的转变。他指出,构成性法则和调整性法则一直以来是构建人类科学和人类社会的两大法则;然而,在后霸权时代需要格外关注第三种法则,即算法法则或生成性法则。他强调,“在一个媒体和代码无处不在的社会,权力越来越存在于算法之中”。

大数据时代,庞大的数据将带给算法庞大的权力,“算法权力”也成为学术界讨论的核心命题。研究指出,算法权力来自于其发挥的四个作用:优先、分类联合以及过滤;来自于其对可见度的影响和对拟态环境的建构;来自于其“黑箱”特征:“能够在审查他者的同时自己不受审查,是一种重要的权力形式。”还有学者从法令规章、规范和文化一认知三个层面分析由算法主导的媒介内容生产与消费,认为算法是一种制度,发挥着“构造用户行为,影响偏好形成以及引导消费”的功能。

“代码即法律”,劳伦斯·莱斯格使用这一著名论述,指出那些控制信息网络平台的程序开始成为规范用户行为的强大工具。四作为代码决策部分的算法也发挥着界定用户行为的功能。

西方的新闻传播学院、研究机构等围绕算法开展了丰富的学术活动(见表1),包括学术会议、工作坊、研讨会等。此外,包括《信息、传播与社会》和《国际传播杂志》在内的国际权威学术期刊都做了有关算法的专题研讨,题目分别是(算法的社会权力》以及《自动化算法和政治:政治传播、计算机宣传和自主行动者》。学者在不同理论之间的角力中探讨新的分析路径,相关研究在西方新闻传播学界日渐丰厚。

与国外相比,国内新闻与传播学界的算法研究起步较晚,大致兴起于2016年。学者较多采用“自动化新闻”“机器新闻”等概念来分析人工智能技术给新闻业(尤其是新闻生产)带来的机遇和挑战,而智能算法所承载的重要角色和意义直到近几年才引起学界重视。目前,国内学界已经涌现出了一批有价值的研究,然而多数研究是有关宏观趋势(如智媒时代、人机共生)的讨论,而较少进行中微观考察。西方学界所进行的有关算法权力、算法与公共领域、算法的公众认知等研究,提供了一个研究大数据背景下中国信息环境的新视角;与此同时,也有助于我们对算法盛行背后的问题与风险展开思考。

二、审视算法:问题与风险

算法所具有的“黑箱”特性以及与此相伴随而来的问题和风险引发了学界的关注。学者郝雨和李林霞提出了算法推送带来的四个弊端,包括用户自主意识的丧失、隐私侵犯、信息茧房和价值迷失。本文尝试做出补充和进一步讨论。

正如学者所指出的,针对智媒体的“冷思考”并非是技术悲观主义者对媒介技术简单的否定,也不是重回“技术还原论”的窠臼,而是新媒体创新发展的必由之路。

(一)算法歧视与偏见

算法分发过程可能存在着方式更加隐蔽的偏见和歧视。和人类偏见所不同的是,内嵌于算法设计之中的偏见像病毒一样,能够将偏见快速、大范围地传播出去。例如,假设某公司的一位人力资源经理对未婚先孕女性存在偏见,可能会影响几十人或上百人的就业机会;然而,如果对未婚先孕女性的偏见被内嵌于一套算法系统,那么,它影响的人数可能成千上万,且往往难以被人们所察觉。

笔者采用相似方法,通过“百度图片”搜索“教授”“医生”“CEO”等词汇,发现排在前列的搜索结果几乎全部是男性的图片,这暗含了有关职业分类的性别偏见。因此,搜索引擎并不是对现实世界镜子式的“反映”和“再现”,它所采用的算法将影响人们对客观世界的认知。

除搜索引擎之外,个性化新闻客户端运行过程中可能存在的算法歧视问题也值得关注。例如判断农村地区的贫穷青年不需要财经新闻,从而减少甚至过滤掉相关的资讯推送。

(二)算法短视

脸书创始人马克·扎克伯格曾说,比起非洲那些挣扎在死亡线上的人们,此刻你前院奄奄一息的一只松鼠可能与你的兴趣更加“相关”。在这一理念的指导下,资讯的重要性让位于相关性,而公共利益也常常让位于个人兴趣。研究指出,资讯客户端对用户兴趣的一味迎合,打造的是一个舒适的不利于用户进行深度思考的信息环境。算法分发重“迎合”轻“引导”,倾向于提供更多“用户想看到的内容”,而非“用户应该看的内容”,这在某种程度上削弱了新闻业的公共服务属性。

有学者指出,算法关注当下掌握的数据,而这些数据通常与短期结果相关,这就造成了算法本身具有短视倾向。社交网站如果在设计算法时过于侧重击量,那么骗点击量的内容就会充斥网站。学者建议,在设计算法时除了考虑短期目标,还要把长远目标(例如用户满意度、社会效益)纳入考量。

搜索引擎、社会化媒体、聚合类新闻客户端等平台型媒体倾向于把流行度、易消费性作为优先推荐资讯的指南。例如,脸书所采用的是“喜欢”按钮,而不是“重要”或“具有启发性”等设计。这种设计逻辑体现了公司的价值偏向。《人民日报》2017年10月发表的社论《不能让算法决定内容》,对“一切围着流量转,唯点击量、转发量马首是瞻”进行了抨击,呼吁将更多有价值的评价标准引入新闻分发过程。

以上研究指出了算法背后的设计逻辑和价值偏向问题。这里的设计逻辑并不是指具体的技术细节,而是指算法所蕴含的设计价值及所遵循的原则。随着把关权力日益从记者、人工编辑向机器智能算法让渡,从传统新闻机构向科技公司让渡,后者能够承担起约瑟夫·普利策所说的“船头的嘹望者”的角色吗?算法的设计者——算法工程师、程序员等,需要遵守新闻职业规范和新闻伦理吗?算法若出现问题(例如上文提到的性别歧视),应该由谁来承担责任?这些问题都有待进一步考察。

(三)算法操纵

媒体操纵并不是一个新鲜话题,然而算法操纵之所以值得特别关注和讨论,原因在于其运作方式更加隐蔽、影响范围也更广泛。伴随着近几年涌现出的案例,算法运作过程中的人工干预问题开始进入学者视野。例如,新英格兰微软研究院首席研究员塔尔顿·吉莱斯皮观察发现,占领华尔街运动虽然在美国各地都开展得如火如茶,然而相关话题却自始至终都未登上推特热门话题榜。吉莱斯皮推测,该话题很有可能是被刻意排除在了榜单之外,且“人们对算法的期待和它们真实呈现出来的结果发生了严重的偏离”。

吉莱斯皮的博文让算法操纵问题开始进入公众视野,而脸书所进行的一项“情绪感染”实验则引发了更大范围的争议和讨论:在未被告知的情况下,689003名脸书拥户的信息流在为期一周的时间内被心理学家操纵,首页呈现具有特定情绪倾向(正面或者负面)的内容。实验结果表明,当信息流中的正面信息减少时,用户发布的正面信息也会减少,反之亦然。

大数据时代,用户数据的使用权和控制权不断让渡给以社会化媒体为代表的第三方网站,新型信息聚集与分发机构所掌握的关于用户媒介消费习惯和偏好的数据不断扩大。除基本信息以外,机构所搜集的数据还包括用户的心理特征和思想状态,其中,脸书所开展的争议性实验就验证了情绪操纵的可行性。可以预见的是,未来有关算法运作机制不透明性的指责和争议仍将继续,对算法所预设的参数或价值偏向进行檢验变得必要且重要。

三、剖析算法:逆向工程研究法

由于算法的“黑箱”特性,学者尼古拉斯·迪尔科普洛斯提出,可以采用逆向工程研究法来剖析内嵌于算法的设计逻辑和价值偏向。逆向工程是指“根据专业知识、观察和推理来发掘系统运作机制的过程”。目前,该方法已被应用于谷歌“自动完成搜索算法”分析、个性化信息搜索、调查性新闻报道等领域。

例如,已经四次斩获普利策新闻奖的美国非营利性新闻网站ProPublica在“逆向工程奥巴马的信息机器”这则新闻报道中,调查分析了奧巴马竞选团队如何通过微观追踪选民来调整其发送邮件的内容和募捐要求。调查发现,奥巴马竞选团队至少针对不同选民发送了6个不同的邮件版本,募捐要求从3美元到25元不等。选民的募捐历史是影响邮件内容呈现和募捐要求的最主要因素。

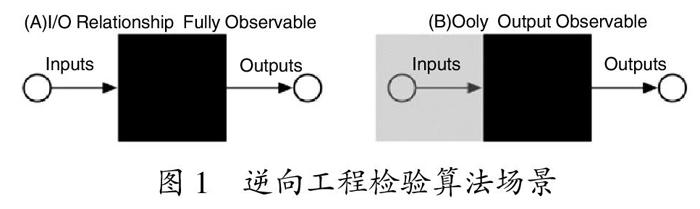

如图1所示,迪尔科普洛斯展现了两种通过逆向工程推导算法运作机制的场景。场景A,算法的输入及输出都是可观测的,主要通过应用程序接口来获得。然而在大多数情况下,研究者遇到的是场景B所描绘的情况:仅输出可见输入是不可见的。以个性化新闻客户端为例,可见的是新闻推送的结果,而究竟哪些因素影响推送过程我们则不得而知。通过对“输入—输出关系”的不断检验,研究者可以部分推导出算法的设计逻辑,这一过程常常需要依赖众包来实现。

四、结论和讨论

学者陈力丹等提出,以以联网为代表的新媒体在新技术下已经形成了以云计算、大数据、智能终端、多元传播介质为基础的新传播生态链。算法也是这一新传播生态链的重要一环。通过介绍和梳理西方新闻传播学界近年来的研究成果,本文厘清了有关算法研究的核心命题和热点议题,并提供了一个思考当前大数据背景下中国信息环境的新视角。本文还强调,算法偏见与歧视、算法操纵、算法短视等问题值得学界和业界关注。

目前,微博的信息流广告、热门话题排行榜,新闻客户端的个性化资讯推送、机器新闻写作搜索引擎的结果页排名、输入框词语联想等均是通过机器和算法来实现的。在算法得以广泛应用和推广的大势所趋之下,有必要对其运作机制和潜在影响做进一步的审视和考察。美国皮尤研究中心“新闻卓越计划”的报告显示,数字化时代的媒体创新都是在新闻机构以外的领域产生,以谷歌、苹果脸书、亚马逊为代表的高科技公司已经在很大程度上掌握了新闻业的未来。而在中国,走在媒体创新前沿的高科技公司主要以百度、阿里巴巴、腾讯和后起之秀今日头条等为代表。因此,未来研究在吸纳借鉴西方新闻传播学研究成果的同时,需要特别考虑中国的制度背景和现实。

[本文为教育部人文社会科学研究青年项目“智能算法驱动下的新闻分发变革研究”(项目编号:18YJC860031);河南省哲学社会科学规划项目“平台型媒体的算法推荐机制与治理研究”(项目编号:2018CXW017)的前期成果]

参考文献:

[1]Lash,Scott.2007.“Power after Hegemony:Cultural Studies in Mutation?”Theory,Culture & Society24(3):55—78.

[2]Diakopoulos,Diakopoulos.2013.“Algorithmic Accountability Reporting:On the Investigation of Black Boxes,.”Tow Center for Digital Journalism A Tow/Knight Brief,1—33.Retrieved from

http://towvcenter.org/wp-content/uploads/2014/02/78524_Tow-Center-Report-WEB-1.pdf.

[3]Bucher,Taina.2012.“Want to Be on the Top?Algorithmic Powerand the Threat of Invisibility on Facebook.“New Media & Society 14(7):1164—1180.

[4]Just,Natascha,&Michael Latzer.2017.“Governance by Algorithms:Reality Construction by Algorithmic Selection on the Internet.”Media,Culture & Society39(2):238—258.

[5]Pasquale,Frank.2015.“The black Box society:The secret algorithms that contro money and information.”Cambridge,MA:Harvard University Press,p.76—77.

[6]Napoli,Philip M.2014.“Automated Media:An Institutional Theory Perspective on Algorithmic Media Production and Consumption.”Communication Theory24(3):340—360.

[7]Lessig,Lawrence.2006.Code and other laws of cyberspace2.0.New York,NY:Basic Books.

[8]郝雨,李林霞.算法推送:信息私人定制的“個性化”圈套[J].新闻记者,2017(2):35—39.

[9]刘千才,张淑华.从工具依赖到本能隐抑:智媒时代的“反向驯化”现象[J].新闻爱好者,2018(4):5—8.

[10]王茜.论个性化信息推荐系统的运作逻辑及影响[J].郑州大学学报(哲学社会科学版),2017(1):46—49.

[11]Luca,Michael,Jon Kleinberg&Sendhil Mullainathan.2016.“Algorithms Need Managers,Too.”Harvard Business Review (January-February):3—7.

[12]Gillespie,Tarleton.2012.“Can an Algorithm be Wrong?.”Limn,2.retrieved from https://escholarship.org/uc/item/0jk9k4hj.

[13]Adam,Kramer,Jamie Guillory&Jeffrey Hancock.2014.“Experimental evidence of massivescale emotional contagion through social networks.”Proceedings of the National Academy of Sciences of the UnitedStates of America 111(24):8788—8790.

[14]Diakopoulos,Diakopoulos.2013.”Algorithmic Accountability Re-porting:On the Investigation of Black Boxes,.”Tow Center for Digital Journalism A Tow/Knight Brief,1—33.Retrieved from

http://towcenter.org/wp-content/uploads/2014/02/78524.Tow-Cen-ter-Report-WEB-1.pdf.

[15]陈力丹,丁文凤,胡天圆.沉浸传播:处处是中心无处是边缘一对世界互联网大会的总结与思考[J].新闻爱好者,2015(1):5—8.