SU—GA—SVM在网络入侵检测中的应用

2018-08-29张宝华赵莹

张宝华 赵莹

摘要:随着网络技术的迅速发展,网络信息安全成为一个极具挑战性的研究领域。入侵检测系统(IDS)作为网络防御的一个重要角色,它对网络中流量进行实时监视,以识别各种网络安全漏洞。本文提出了基于对称不确定性特征提取和遗传算法优化参数组合的支持向量机(SU-GA-SVM)模型,并将其应用于KDDCUP99数据集进行入侵检测仿真实验,实验结果表明该分类器能够有效地提高IDS的分类检测精度,误警率也明显降低。

Abstract: With the rapid development of network technology, the security of network information has become a very challenging research field. As an important role of network defense, IDS monitors the traffic in the network in real time in order to identify various intrusions. This paper presents SU-GA-SVM model and uses it in KDDCUP'99 data set for intrusion detection simulation experiments. The experimental results show that the accuracy of the classifier can be effectively improved, and the false alarm rate is significantly reduced.

关键词:入侵检测;分类器;对称不确定性;遗传算法

Key words: intrusion detection;classifier;SU;GA

中图分类号:TP393.0 文献标识码:A 文章编号:1006-4311(2018)19-0227-04

0 引言

近年来,随着网络技术和规模的高速发展,人们越来越关注网络信息安全。入侵检测系统(Intrusion Detection System,IDS)是一种主动的网络安全防御工具,它通过收集和分析网络行为、安全日志、审计数据以及计算机系统中若干关键点的信息,检查网络或者系统中是否存在被攻击的迹象或者是否存在违法安全策略的行为。入侵检测系统作为防火墙之后的第二道安全闸门,它能够实时保护网络系统,让其在受到各类内部攻击、外部攻击和误操作危害之前拦截和响应入侵[1]。

近些年来,将机器学习的方法引入到入侵检测系统中是一种趋势。目前,出现了许多基于神经网络、支持向量机、朴素贝叶斯、决策树等机器学习方法的入侵检测系统。这些入侵检测系统的功能是对网络和计算机系统进行实时监测,发现和识别系统中的入侵行为,并做出响应[2]。

支持向量机(Support Vector Machine,SVM)是一种基于统计学习理论的采用结构风险最小化原则的机器学习方法,它通过构造最优分类面,将未知样本的分类误差降到最小,且具备较强的泛化能力。有效解决了传统学习方法中存在的非线性、小样本、过拟合等问题。将支持向量机应用于入侵检测中,能够充分发挥SVM的优势,有效地实现了IDS的检测功能。但是,目前的网络数据中存在大量冗余和噪声变量,并且网络环境中的正常样本和入侵样本是极度不平衡的,这些势必会影响检测模型的检测性能[3]。另外,网络连接数据是动态的,用单一的分类器参数对其分类,存在很大的不确定因素。因此,在本文中提出了基于對称不确定性特征提取和遗传算法优化参数组合的支持向量机(SU-GA-SVM)模型,并利用KDDCUP99数据集对该模型进行模拟实验。实验表明,该方法能够有效地提高检测精度,降低误警率。

1 相关工作

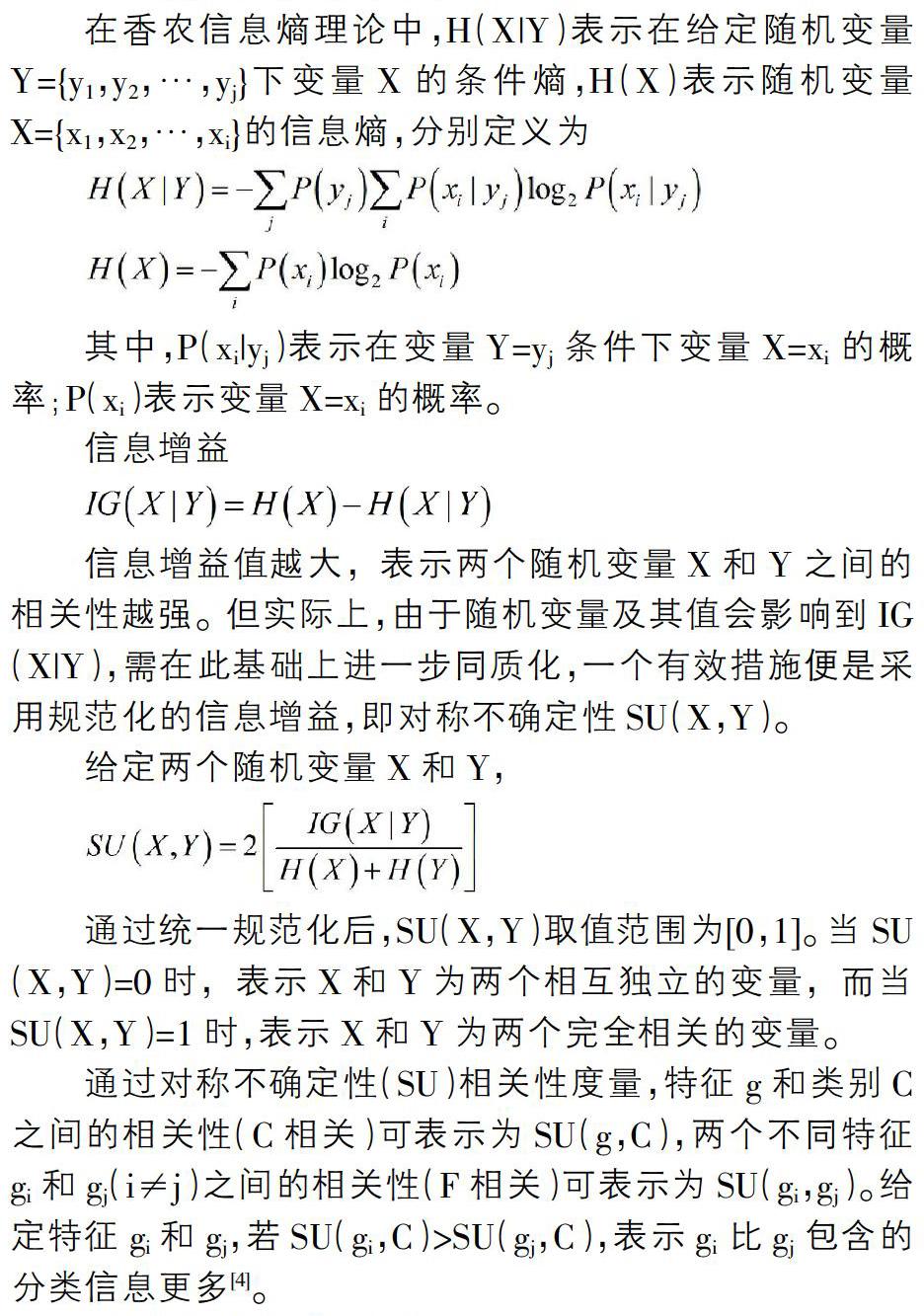

1.1 对称不确定性(SU)

在香农信息熵理论中,H(X|Y)表示在给定随机变量Y={y1,y2,…,yj}下变量X的条件熵,H(X)表示随机变量X={x1,x2,…,xi}的信息熵,分别定义为

信息增益值越大,表示两个随机变量X和Y之间的相关性越强。但实际上,由于随机变量及其值会影响到IG(X|Y),需在此基础上进一步同质化,一个有效措施便是采用规范化的信息增益,即对称不确定性SU(X,Y)。

给定两个随机变量X和Y,

通过统一规范化后,SU(X,Y)取值范围为[0,1]。当SU(X,Y)=0时,表示X和Y为两个相互独立的变量,而当SU(X,Y)=1时,表示X和Y为两个完全相关的变量。

通过对称不确定性(SU)相关性度量,特征g和类别C之间的相关性(C相关)可表示为SU(g,C),两个不同特征gi和gj(i≠j)之间的相关性(F相关)可表示为SU(gi,gj)。给定特征gi和gj,若SU(gi,C)>SU(gj,C),表示gi比gj包含的分类信息更多[4]。

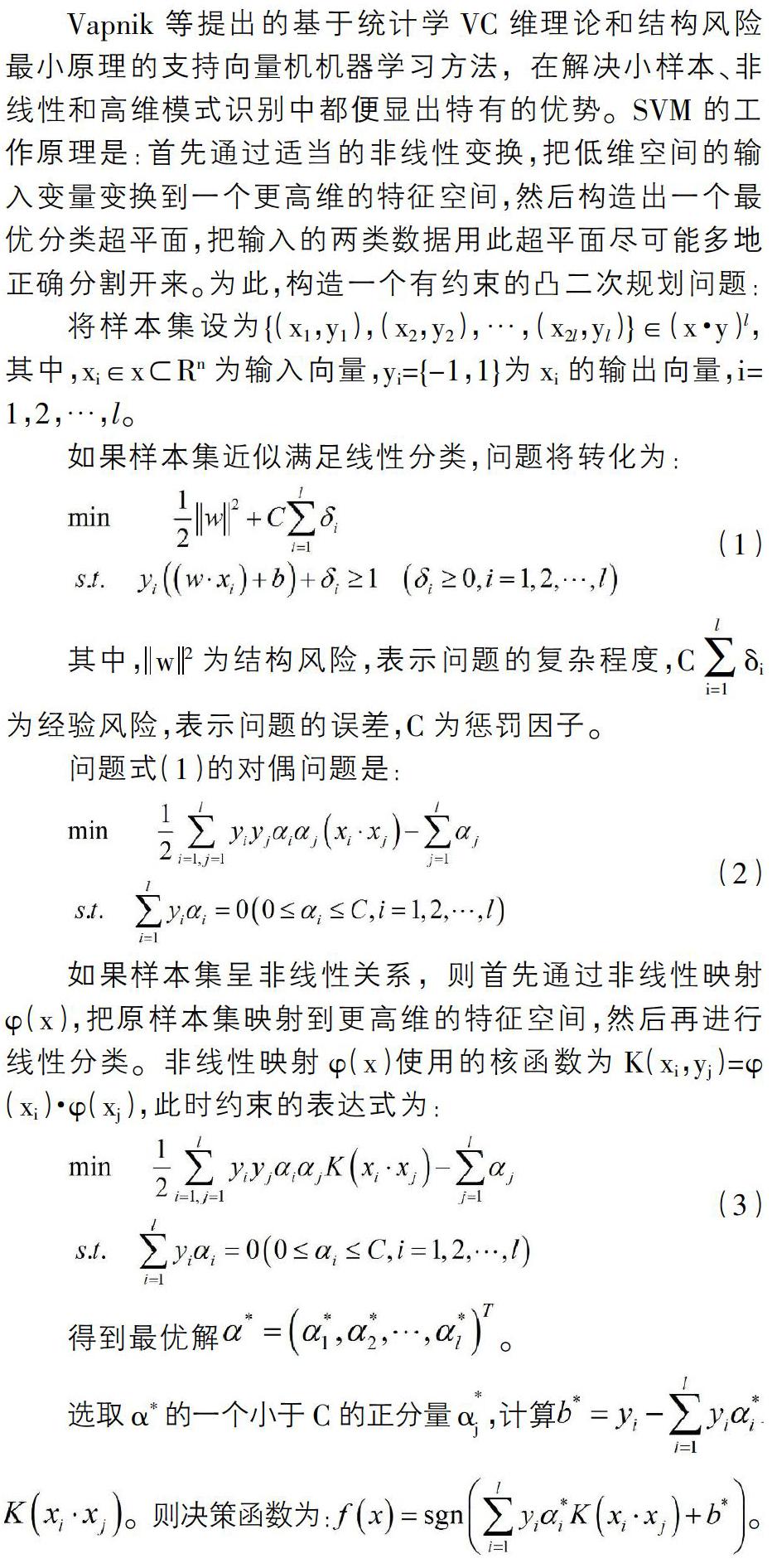

1.2 支持向量机(SVM)

Vapnik等提出的基于统计学VC维理论和结构风险最小原理的支持向量机机器学习方法,在解决小样本、非线性和高维模式识别中都便显出特有的优势。SVM的工作原理是:首先通过适当的非线性变换,把低维空间的输入变量变换到一个更高维的特征空间,然后构造出一个最优分类超平面,把输入的两类数据用此超平面尽可能多地正确分割开来。为此,构造一个有约束的凸二次规划问题:

将样本集设为{(x1,y1),(x2,y2),…,(x2l,yl)}∈(x·y)l,其中,xi∈x?奂Rn为输入向量,yi={-1,1}为xi的输出向量,i=1,2,…,l。

如果样本集近似满足线性分类,问题将转化为: