改进卷积神经网络在遥感图像分类中的应用

2018-06-20刘雨桐李志清杨晓玲

刘雨桐,李志清,杨晓玲

0 引言

在遥感技术研究中,不论是专业信息的提取、动态变化预测,还是专题地图制作以及遥感数据库的建立都离不开遥感图像的分类。如何高效、准确地对遥感图像进行分类成为该领域的重要研究内容。场景分类是学习将图像映射到语义内容标签的过程。遥感图像分类根据不同的统计方法,可划分为随机统计法和模糊数学方法;根据不同层次的特征提取一般可分为低层特征处理和中层特征处理两大主要方法;根据事先是否需要训练样本,又可分为监督学习、半监督学习[1]和无监督学习[2]三大类。低层的特征通常采用场景图像的颜色[3]、方向梯度[4]、密度特征[5]、特征点[6]、变换域的纹理[7]等来描述。由于低层特征泛化性差,目前场景分类方法主要基于中层语义[8]建模。中层特征指基于统计分布的低层特征与语义的联系,包括语义的属性、对象和局部语义概念(如稀疏表示[9]和语义概率主题模型[10])等。目前采用中层语义来进行分类最为广泛的是基于视觉词袋(Bag of Visual Words, BOVW)模型的方法[11],它将图像视为文档,即若干个没有顺序的“视觉词汇”集合,根据场景的低层特征来提取出互相独立的视觉词汇,然后利用K-Means[12]等聚类算法合并词义相近的视觉词,构成一个单词表。中层语义场景分类能一定程度地缓解语义鸿沟问题,但基于语义对象组合变换的中层语义对于场景尺度的变化、传感器的拍摄时空和角度的差异缺乏有效的处理措施。

近年来,卷积神经网络(Convolutional Neural Network, CNN)模型[13-14]在图像分类任务上的应用,大大提高了图像分类精度。随着ReLU(Rectified Linear Units)和dropout操作的出现,以及大数据和GPU(Graphics Processing Unit)带来的机遇,Alex在ImageNet图像分类挑战上提出的AlexNet网络结构模型[15]赢得了2012届ImageNet大规模视觉识别挑战赛冠军。与传统的统计学方法相比,神经网络无需对概率模型作出假设,具有极强的学习能力和容错能力,适用于空间模式识别的各种问题。CNN是针对图像分类及识别任务而特别设计的多层神经网络,是一种深度学习方法。CNN具有的局部感受野和权值共享特点,能够有效减少训练参数数目,子采样(池化)特点能聚合对不同位置的特征,在降低特征维度的同时还能改善结果(不容易过拟合)。在识别位移、缩放以及其他形式扭曲不变性的二维图像时,CNN在同一特征映射面上进行权值共享的特点使其能隐式地从训练数据中进行并行学习,这也成为CNN相对于神经元全连接网络的一大优势。

本文提出一种改进卷积神经网络的遥感图像分类方法:1)嵌入Inception模块,在较高层使用不同尺度的卷积核进行操作,通过扩展网络的宽度来加强网络的特征提取能力。2)采用Maxout网络,并结合dropout操作来拟合不同的激活函数,使模型在提高图像分类精度的同时,一定程度上降低过拟合的影响。在美国土地使用分类数据集(UCM_LandUse_21)上进行的实验结果表明,与当今前沿遥感图像分类方法相比,本文方法能取得更高的分类精度。

1 卷积神经网络

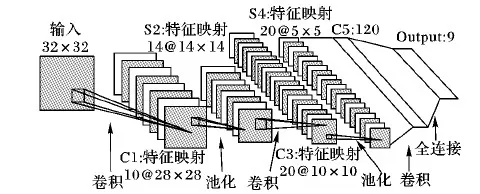

CNN是一个多层的神经网络,一般由输入、特征提取层(多层)以及分类器组成,每层由多个二维相互独立神经元组成。网络通过逐层的特征提取学习输入图像的高层特征,然后将其输入到分类器中对结果进行分类。图1为一个对手写体图像进行识别的CNN结构LeNet-5的模型。

图1 手写体识别CNN结构LeNet-5

卷积层是CNN的特征映射层,具有局部连接和权值共享的特征。这两种特征降低了模型的复杂度,并使参数数量大幅减少。

下采样(池化)层是CNN的特征提取层,它将输入中的连续范围作为池化区域,并且只对重复的隐藏单元输出特征进行池化,该操作使CNN具有平移不变性。实际上每个用来求局部平均和二次提取的卷积层后都紧跟一个下采样层,这种两次特征提取的结构使CNN在对输入样本进行识别时具有较高畸变容忍力。

全连接层将之前提取到的特征进行综合,使图像特征信息由二维降为一维。

输出层(Softmax神经元层)解决线性多类的分类问题,使用Softmax方法进行分类能在一定程度上提升网络学习速度。Softmax函数中引入了K组参数(w,b),相当于引入K个分隔超平面, maxP(Y=j|x(i),θ,b)为最终分类结果(其中:θ表示模型的可学习参数)。假设函数如下:

(1)

K项概率密度分布为:

(2)

2 改进CNN遥感图像分类方法

2.1 改进CNN的结构

本文方法的结构分为三个模块。首先是图片预处理,利用图片生成器在训练时生成大量规定批次的数据来实时进行数据提升。然后,其CNN用对每幅图像进行卷积操作,提取该图像的特征。本文方法的卷积操作由三个卷积层(后接最大池化层)以及一个Inception模块(后接最大池化层)组成,既有纵向的延伸,又有横向的扩展;而传统CNN只有纵向到底加深。最后由Maxout网络对卷积操作提取到的特征进行全连接的处理后由分类器对遥感图像进行分类。改进CNN整体模型如图2所示。

2.2 Inception结构

传统CNN改进方法只强调通过加深网络层数来提高网络特征处理能力,然而单一尺度卷积核无法实现对多尺度特征的利用。本文方法在传统CNN中嵌入结合Network in Network[15]思想的Inception结构。该模块先聚合输入特征,然后利用其非线性变换能力对特征进行再加工和滤波处理,以此实现多尺度特征的利用。

Inception结构通过并联不同尺度卷积核来增加网络宽度,获取遥感图像中多种尺度特征,从而提高网络特征提取能力。

本文方法嵌入的Inception结构如图3所示。值得一提的是只有当Inception结构所在层数越高、通道数越多时,该方法才能取得更高的效率。因为当使用图3中Inception模型结构时,其中的1×1卷积核将信息进行压缩后再聚合会带来一定程度的信息损失,而模型底层主要提取的是细节特征,细节信息的细微损失很可能给整个模型的图像特征学习带来极大的影响。在对特征进行3×3或5×5卷积前引入1×1卷积核则是为了与上一层的神经元进行全连接,使原本特征图数量的连接数降低到1×1卷积的数量,从而提高模型的计算效率。

2.3 Maxout模型

Maxout模型实际上是一个使用激活函数的简单前馈网络结构,网络结构上在传统多层感知机(Multi-Layer Perceptron,MLP)网络隐含层前添加了一个隐隐含层,网络结构如图4所示。与常用激活函数(Sigmoid[16]、tanh[17]等)不同的是,Maxout网络不仅可以学到隐层节点间的关系,还能学到每个隐层节点的激活函数。

图2 改进CNN结构整体模型

图3 Inception结构

图4 传统MLP网络模型和Maxout网络模型

对于给定输入x∈Rd(x表示上一层的状态),Maxout函数在隐藏层实现功能为:

hi(x)=max(zij);j∈[1,k]

(3)

zij=xTW…ij+bij;W∈Rd×m×k,b∈Rm×k

(4)

其中:W和b是需要学习的参数矩阵;d表示输入层节点的个数;m表示隐含层节点数量;k指每个隐含层节点对应的“隐隐含层”节点数。隐含层的Maxout节点输入值为k个“隐隐含层”节点中的最大输出值。

任意凸函数能被以任意精度的分段线性函数拟合,而“隐隐含层”的k个节点在不同取值范围的最大输出值有局部线性特征,可判定Maxout网络能拟合任意凸函数。结合dropout操作可促进Maxout网络优化,因为在Maxout网络中每个“隐隐含层”节点都对输出进行预测,但每个Maxout单元只学习该网络预测的最大值,这使网络每次都只能学到相同的预测。改变dropout操作的参数能决定输入被映射在分段线性函数的哪一段,让Maxout网络在输入处有更大的线性区域,从而保证Maxout单元学习到不同的输出特征,同时减少Maxout单元最大化滤波器的变化。

3 实验

3.1 实验数据集

UCM_LandUse_21数据集[18]为美国土地使用分类数据集,它包含21种土地使用场景类型,每种类型中有256×256×3尺寸的100幅场景图(见图5)。高光谱遥感图像维数高、训练样本有限以及场景混合度大等特点给该数据集的分类带来了巨大的困难。遥感图像的场景是以其使用功能定义来分类的,也就是说一幅图像中存在多种土地覆盖类型,所以分类难度比一般场景分类大。例如:图5(t)中有图5(f)、图5(r),以及图5(n)这三种土地覆盖。

图5 UCM_LandUse_21类遥感图像场景示例

3.2 图像预处理

在用CNN对图像进行训练前,先对图像进行归一化等预处理,将数据映射到输出层的激活函数值域(0,1)区间内。由于遥感图像获取难,训练数据有限,本文方法对归一化后的数据进行一系列的随机变换(旋转、移动、缩放、翻转等方式)来对模型训练样本进行扩展。每次训练时数据生成器会无限生成数据,直到达到规定的次数epoch为止。每个epoch将生成一个批次的图像数据。进行扩展后的图像数据有利于抑制过拟合,提高模型的泛化能力。

实验过程中随机选取每类场景图像数据的80%作为训练数据,其余20%为测试数据。

3.3 CNN结构参数设置及卷积操作可视化

本文方法所改进的CNN网络层结构参数如表1所示。

表1 改进CNN网络参数

CNN在网络中对从在底层提取到的线、角等特征进行传递,并在网络的高层开始识别更复杂的特征,该特性使CNN更擅长识别图像中的物体。图6为一张机场遥感图像在本文方法所提模型中经过各个卷积层特征处理后的部分结果,展示CNN在各个阶段进行图像处理的情况。由图6可见,在卷积操作下,图像的背景激活度逐渐变小,模型在C1和C2层中提取到的基本上是颜色、边缘等底层特征,在I3层呈现更多的是飞机等地标性纹理特征,而在C4层卷积处理后所呈现的特征则已经无法通过肉眼辨认。

3.4 改进CNN分类能力分析

为分析本文方法的Inception模块和Maxout模块对分类效果的影响,本文对传统CNN、加入Inception模块的方法(In_CNN)、同时结合Inception模块和Maxout网络的方法(InM_CNN)以及在InM_CNN加入dropout操作后的本文方法在同样的数据集UCM_LandUse_21进行分类实验。图7展现了这四种方法的正确率随epoch的增加而变化,可见:传统CNN的分类正确率最低;加入Inception模块后的In_CNN正确率在一定程度上得到了提升;加入Maxout层后的InM_CNN,正确率虽然在epoch为400之前有明显提高,但之后震荡较大(过拟合),正确率下降了近6%;而本文方法一定程度上抑制了过拟合的影响,分类正确率在后期也能稳步增长,达到了最好的分类效果。

由此可见,本文对CNN进行的所有改进都是合理有效的。

图6 卷积层操作可视化

图7 本文方法与另三种方法分类正确率对比

3.5 实验与分析

图8的分类结果混淆矩阵直观展现了在本文方法下每类场景的分类正确率以及该场景错判为其他场景的情况。图8中的分类正确率为5次独立重复实验后所得的平均值,总体分类正确率达到了93.45%。

由图8可见本文方法对UCM_LandUse_21数据集中耕地、机场、丛林、高尔夫球场、立交桥等纹理差异小的场景分类准确率较高,对建筑、港口、中等密集住宅区等分类准确率较低,说明本文方法对存在二义性,即对纹理差异较小的图像分类效果还有待改善。

为验证本文方法分类优势,通过UCM_LandUse_21数据集,将本文方法与近几年具有代表性的几种方法作对比。其分类结果如表2所示。

由表2可见,中层视觉词典学习方法所得分类正确率高于以低层特征进行学习的BOVW和支持向量机算法。基于神经网络的算法(ConvNet、MNCC、基于多尺度深度卷积神经网络(Multi-Scale Deep CNN, MS_DCNN)、本文方法)的分类正确率均较高,而中层特征混合了稀疏编码后其分类正确率也得到了一定的提升,分类效果甚至超过了部分神经网络算法,但本文方法分类正确率明显高于其他文献所提方法,因此本文对传统CNN的改进使其图像分类能力得到了显著提升。

表2 不同方法对UCM_LandUse_21数据集的平均分类精度

图8 UCM_LandUse_21场景分类混淆矩阵

表2中的MS_DCNN方法[24]同样也以深度卷积神经网络为框架并且都利用了多尺度特征,不过该方法是在图像预处理阶段利用controlet变换对图像进行多尺度分解来获得多尺度特征的,并未改变传统卷积神经网络的结构,而且MS_DCNN的分类精度最为接近本文方法,因此本文将该方法与本文方法训练过程中分类精度曲线的变化进行对比。分类正确率的对比如图9所示。

图9 本文方法与MS_DCNN方法的分类正确率对比

可见,本文方法经过较少的迭代次数就能达到80%以上的正确率,而MS_DCNN相对较慢;因此,从正确率的提升速度和最后的正确率来说,本文方法都优于该方法。

4 结语

本文方法通过改进CNN模型直接对图片进行特征提取,通过Inception模块的不同尺度卷积核来增加CNN网络的宽度,从而提高网络特征提取的能力,实现对多尺度特征的利用。Maxout网络结合dropout操作可消除激活函数选择的不确定性,减少参数确定带来的计算步骤和抑制过拟合的影响。实验结果表明,本文对CNN的每项改进都合理有效,并且本文在UCM_LandUse_21数据集上取得了较好的分类效果。如何减少本文方法对存在二义性的图像的误分率是下一步的研究方向。

参考文献(References)

[1] 蔡月红,朱倩, 孙萍, 等. 基于属性选择的半监督短文本分类算法[J]. 计算机应用, 2010, 30(4): 1015-1018.(CAI Y H, ZHU Q, SUN P, et al. Semi supervised short text categorization based on attribute selection [J]. Journal of Computer Applications, 2010, 30(4): 1015-1018.)

[2] 修驰, 宋柔. 基于无监督学习的专业领域分词歧义消解方法[J]. 计算机应用, 2013, 33(3): 780-783.(XIU C, SONG R. Disambiguation of domain word segmentation based on unsupervised learning[J]. Journal of Computer Applications, 2013, 33(3): 780-783.)

[3] 张永库, 李云峰, 孙劲光. 综合颜色和形状特征聚类的图像检索[J]. 计算机应用, 2014, 34(12): 3549-3553.(ZHANG Y K, LI Y F, SUN J G. Image retrieval based on clustering according to color and shape features [J]. Journal of Computer Applications, 2014, 34(12): 3549-3553.)

[4] LI Z, HU D W, ZHOU Z T. Scene recognition combining structural and textural features[J]. Science China Information Sciences, 2013, 56(7): 1-14.

[5] ZHANG F, DU B, ZHANG L. Saliency-guided unsupervised feature learning for scene classification[J]. IEEE Transactions on Geoscience & Remote Sensing, 2014, 53(4): 2175-2184.

[6] ZHU X, MA C, LIU B, et al. Target classification using SIFT sequence scale invariants [J]. Journal of Systems Engineering and Electronics, 2012, 23(5): 633-639.

[7] AKOGLU L, TONG H, KOUTRA D. Graph based anomaly detection and description: a survey[J]. Data Mining and Knowledge Discovery, 2015, 29(3): 626-688.

[8] 吴航, 刘保真, 苏卫华, 等. 视觉地形分类的词袋框架综述[J]. 中国图象图形报, 2016, 21(10): 1276-1288.(WU H, LIU B Z, SU W H, et al. Bag of words for visual terrain classification: a comprehensive study[J]. Journal of Image and Graphics, 2016, 21(10): 1276-1288.)

[9] LI E, DU P, SAMAT A, et al. Mid-level feature representation via sparse autoencoder for remotely sensed scene classification[J]. IEEE Journal of Selected Topics in Applied Earth Observations & Remote Sensing, 2016, 10(3): 1068-1081.

[10] SINGH A, PARMANAND, SAURABH. Survey on pLSA based scene classification techniques[C]// Proceedings of the 2014 5th International Conference on Confluence the Next Generation Information Technology Summit. Piscataway, NJ: IEEE, 2014: 555-560.

[11] ZHAO L J, TANG P, HUO L Z. Land-use scene classification using a concentric circle-structured multiscale bag-of-visual-words model[J]. IEEE Journal of Selected Topics in Applied Earth Observations & Remote Sensing, 2015, 7(12): 4620-4631.

[12] 傅德胜, 周辰. 基于密度的改进K均值算法及实现[J]. 计算机应用, 2011, 31(2): 432-434.(FU D S, ZHOU C. ImprovedK-means algorithm and its implementation based on density [J]. Journal of Computer Applications, 2011, 31(2): 432-434.)

[13] TURAGA S C, MURRAY J F, JAIN V, et al. Convolutional networks can learn to generate affinity graphs for image segmentation[J]. Neural Computation, 2010, 22(2): 511-538.

[14] PINTO N, DOUKHAN D, DICARLO J J, et al. A high-throughput screening approach to discovering good forms of biologically inspired visual representation[J]. PLoS Computational Biology, 2009, 5(11): e1000579.

[15] PANG Y, SUN M, JIANG X, et al. Convolution in convolution for network in network[J]. IEEE Transactions on Neural Networks & Learning Systems, 2016, PP(99): 1-11.

[16] 王朔琛, 汪西莉. 参数自适应的半监督复合核支持向量机图像分类[J]. 计算机应用, 2015, 35(10): 2974-2979.(WANG S C, WANG X L. Semi-supervised composite kernel support vector machine image classification with adaptive parameters[J]. Journal of Computer Applications, 2015, 35(10): 2974-2979.)

[17] 柴瑞敏, 曹振基. 基于改进的稀疏深度信念网络的人脸识别方法[J]. 计算机应用研究, 2015, 32(7): 2179-2183.(CAI R M, CAO Z J. Face recognition algorithm based on improved sparse deep belief networks[J]. Application Research of Computers, 2015, 32(7): 2179-2183.)

[18] YANG Y, NEWSAM S. Bag-of-visual-words and spatial extensions for land-use classification[C]// GIS 2010: Proceedings of the 18th SIGSPATIAL International Conference on Advances in Geographic Information Systems. New York: ACM, 2010: 270-279.

[19] LU F X, HUANG J. Beyond bag of latent topics: spatial pyramid matching for scene category recognition[J]. Frontiers of Information Technology & Electronic Engineering, 2015, 16(10): 817-829.

[20] ZHANG F, DU B, ZHANG L. Saliency-guided unsupervised feature learning for scene classification[J]. IEEE Transactions on Geoscience & Remote Sensing, 2014, 53(4): 2175-2184.

[21] 刘扬, 付征叶, 郑逢斌. 基于神经认知计算模型的高分辨率遥感图像场景分类[J]. 系统工程与电子技术, 2015, 37(11): 2623-2633.(LIU Y, FU Z Y, ZHENG F B. Scene classification of high-resolution remote sensing image based on multimedia neural cognitive computing[J]. Systems Engineering and Electronics, 2015, 37(11): 2623-2633.)

[22] NOGUEIRA K, MIRANDA W O, SANTOS J A D. Improving spatial feature representation from aerial scenes by using convolutional networks[C]// Proceedings of the 2015 28th SIBGRAPI Conference on Graphics, Patterns and Images. Piscataway, NJ: IEEE, 2015: 289-296.

[23] LI E, DU P, SAMAT A, et al. Mid-level feature representation via sparse autoencoder for remotely sensed scene classification[J]. IEEE Journal of Selected Topics in Applied Earth Observations & Remote Sensing, 2016, PP(99): 1-14.

[24] 许夙晖, 慕晓冬, 赵鹏, 等. 利用多尺度特征与深度网络对遥感影像进行场景分类[J]. 测绘学报, 2016, 45(7): 834-840.(XU S H, MU X D, ZHAO P, et al. Scene classification of remote sensing image based on multi-scale feature and deep neural network[J]. Acta Geodaetica et Cartographica Sinica, 2016, 45(7): 834-840.)