智能战争时代,谁来开火?

2017-11-23张敏

张敏

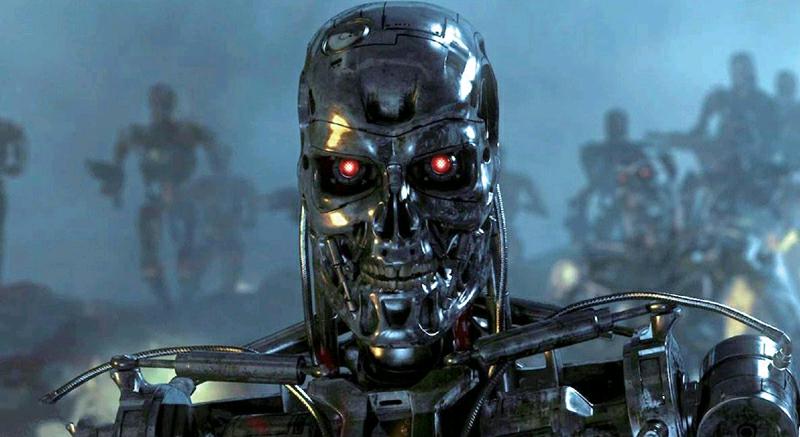

科幻电影《终结者》中,原本作为军方作战网络的“天网”在强人工智能推动下逐渐具备了自我意识,因而演变成未来世界机器人的领袖,带领着掌握“开火权”的机器人肆意残害人类。场景虽然科幻,但也表现出人们对于智能化战争时代,对拥有高度智能的无人作战系统的深切担忧。

人与武器的关系是军事领域亘古不变的重要话题。随着被誉为“人类智慧最后堡垒”的围棋领域被人工智能攻破,有理由相信人工智能技术及无人自主作战平台将成为新型颠覆性作战样式,以战斗机器人为代表的人工智能无人武器系统或将主宰未来战场。美国早在其《21世纪战略技术》中就直言:“20世纪的核心武器是坦克,21世纪的核心武器是无人系统。”然而,如果赋予智能无人作战系统“生杀大权”,甚至实施完全是机器人士兵的“机器代理人战争”,拥有高度智能的无人作战系统或将把《终结者》等电影中的场景变为现实。除禁止使用“攻击性自主武器”外,避免无人作战系统拥有“开火权”,或将成为智能战争时代人类可行的“救赎”方式。

人工智能叩开智能化战争之门

早在2011年,白俄罗斯就曾推出过一款无人驾驶遥控武器平台,这种拥有履带系统的无人作战平台,可在遥控指令控制下使用配备的机枪和榴弹发射器攻击800米距离内的目标。当然,这并不是目前惟一一款可“开火”的无人作战平台:美国海军陆战队正在测试的模块化先进武装机器人系统,可借助人工智能控制持枪机器人;俄罗斯战略导弹部队研制的狼-2式移动机器人系统,可在5千米范围内通过无线电频道控制,能在时速35千米的情况下使用武器精确击中目标;以色列研制的多戈武装作战机器人,自带格洛克26型9毫米口径手枪;还有诸如美国海军陆战队角斗士作战机器人、以色列守护者无人驾驶战车等,类似的攻击型无人作战平台近年来不断涌现。

目前,人工智能已经被作为战争史上的“第三次战争革命”,正加速叩开未来智能化战争的大门。曾几何时,火药的出现是“第一次战争革命”,枪支与火炮等“热兵器”的实用化对军队组成结构和作战方式产生了颠覆性变革;“第二次战争革命”伴随着热核武器实用化而来,意味着战争已经达到以破坏整个国家为前提的战略对峙,战争方式再次发生巨大变化。人工智能的出现同样具备从根本上改变战争方式的潜力,未来战争或将演变成“机器VS人”乃至“机器杀人”的“机器人代理战争”。

本来,人们对于人工智能无人作战装备的需求合情合理。战争不可避免会引发流血、伤残与死亡,无人作战系统由于“平台无人”,既能打仗,又不存在人员伤亡,因而适用于执行各类高危险和高烈度战争任务,甚至可以完全取代士兵去冲锋陷阵。因此,近年来无人作战系统愈发得到各军事大国研究投入,各类无人作战系统的数量与规模也是越来越大。

在当前军事斗争需求的刺激下,无人作战系统正向着陆海空天等多维度快速拓展,任务领域也已覆盖到包括电子干扰、侦察预警、通信中继、排雷排爆和火力打击等传统有人作战领域,尤其是其精确化、智能化水平的不断提升,已经成为各军事大国武器装备发展的重点方向。毕竟,目前公开亮相的人工智能系统只是基于神经网络的深度学习弱人工智能,即将到来的强人工智能或将加速走向未来战场,在智能化感知与信息处理、智能化指挥控制辅助决策、无人军用平台及军用机器人、人体体能技能及智能辅助系统等领域发挥重要作用,推动着智能化战争时代的加速到来。

智能武器正面临诸多风险挑战

未来战争,随着人工智能越來越多走上战场,战争形态将从信息化战争向着智能化战争加速推进。但人工智能机器人“大兵”真的在战场上冲锋陷阵之时,可别高兴得太早,这些高度智能化武器也会对人类带来诸多风险挑战。

2005年的伊拉克战场上,美军的剑战斗机器人就曾无故将枪口指向指挥官;2015年7月,美国一台“发疯”的机器人也曾“失手”将一名装配工人杀死,俄罗斯也出现了机器人莫名“越狱”的故事。可以说,在复杂战场环境下,拥有高度智能的无人作战系统极有可能出现识别错误、通信降级甚至被敌电磁、网络攻击后“倒戈反击”等问题,而诸如滥杀无辜、系统失控等更是给智能武器的军事应用带来了无穷隐忧。

其实,人们对于智能武器系统的担忧,从命名伊始就初见端倪。机器人的英文名为“Robot”,最早是由捷克作家卡雷尔·恰佩克在科幻作品中首创,其原意就是“农奴式被强迫的劳动者”,并借此称呼那些造反的机器仆人。1991年出版的《无人战争—未来战场上的机器人》,也对军用机器人使用后的伦理问题提出了严肃的思考。未来的智能化战争,战场上的绝大多数作战任务都将交由战斗机器人来完成,一旦人类授予了智能武器“开火权”,这群毫无感情、不知疲倦杀人的机器走上战场,会不会滥杀无辜,会不会出现失控,甚至会不会调转枪口成为“人类终结者”,都是我们必须思考的问题。

一方面,谁能为智能武器的“滥杀无辜”来买单。随着相关技术的不断发展,人工智能在某些领域超越人类已是不争的事实,完全脱离人类控制而实现自主攻击或将成为人工智能在未来战争中的终极作战形式。但人工智能武器的智能化一旦超过一定程度,极有可能出现自作主张甚至滥杀无辜的行为。另一方面,智能武器的战场失控程度难以估计。理论上讲,武器的智能化程度越高,其内部电脑控制软件的规模就越庞大且复杂,出现故障的概率也就相应的越高。早在2005年,美国空军的一架战斗机突然自动向地面重要设施发射了一枚导弹,事故原因是飞机的火控系统电脑出了故障。

事实上,智能武器在战场复杂电磁环境下也会因干扰而失控。同时,战场上的敌我识别对智能武器而言同样并非易事,伊拉克战争期间美军的导弹系统就曾把己方飞机击落,原因就在于无法准确判断而产生的战场失控。