基于飞行时间法的红外相机研究综述

2017-04-05郭宁博陈向宁薛俊诗

郭宁博,陈向宁,薛俊诗

(解放军装备学院,北京 101416)

【光学工程与电子技术】

基于飞行时间法的红外相机研究综述

郭宁博,陈向宁,薛俊诗

(解放军装备学院,北京 101416)

基于飞行时间法(Time-of-Flight,TOF)的红外相机是一种新型的、结构小巧、可提取目标3D数据的立体成像设备;它可以高效实时的捕获运动或静止目标的深度信息和灰度信息,目前已经成为测量成像领域的研究热点;对TOF的发展做了系统的阐述,并且分析了该相机的成像原理,相机标定以及测量误差;归纳了TOF红外相机的特点以及应用情况,阐述了TOF红外相机发展趋势。

红外脉冲;飞行时间法;深度相机;三维重建;ICP

飞行时间法,即TOF技术。基于飞行时间法的深度相机是一种新型化、结构小巧、可获取目标点云的立体成像设备。它可以高效实时捕获动态或静态目标的深度与亮度数据。这种相机一次拍摄即可获取包含2D和3D数据的多维图像的结合,并且不会损失2D图像画质。它操作方便、获取信息可靠,发展潜力与市场前景不容小觑,在丰富人类精神生活的影视动漫、物联网、自然人机交互等领域将带来巨大的贡献。

最早提出用光来测量距离的是伽利略。但是基于当时的技术条件,尽管伽利略尝试测量光速,却并未取得成功,没有取得任何实验结果。1676年,Roemer经过长期观测,大致算出了光穿过地球的时间。这也是人类首次粗略的推算出光的传播速度。

200多年后,法国物理学家Fizeau和Foucault设计了世界上第一个可以测量光飞行时间的实验装置。在确定的距离上,求取光的飞行速度,该实验刚好是TOF技术的反运用。

1903年德国工程师克里斯琴·休斯梅尔利用雷达电磁波,结合TOF技术,进行舰船检测实验,结果并不十分精确。直到1968年,Walter Koechner设计了第一台有使用价值的TOF测量系统,该系统只能获取一维距离信息。19世纪初,科学家发现了光电效应。1939年,第一个电子摄像管横空出世。1969年Willard S.Boyle和George E.Smith提出了生产的固态图像传感器的CCD 技术。随着传感器的发展,CMOS/CCD性能不断提升,这都为TOF红外相机的出现铺平了道路。

20世纪90年代,TOF测量技术和图像传感器成为光电子学的两大热门领域。通过将两者结合,第一代 TOF 摄像机应运而生[1]。从此以后,CCD和CMOS技术等不断革新,推动了TOF红外相机的进步和发展,也使得TOF红外相机在3D相机中占有一席之地。

目前,市场上应用比较广泛的TOF红外相机基本都是由德国、日本等外国生产,国内对TOF红外相机的设计生产不是很多,杭州光珀智能科技有限公司对TOF红外相机的设计进行了初步尝试,现在还在探索阶段。国内外对TOF红外相机的研究主要集中在两个方面:一是对TOF相机的理论研究,涉及成像原理、相机标定、弱化误差等;二是对TOF红外相机应用的研究,包括机器人领域、车辆洗涤与安全、医疗领域、工业自动化领域等。本文结合TOF红外相机的研究现状,从以上两方面展开综述。

1 TOF红外成像原理分析

基于飞行时间法的三维扫描成像设备正在3D视觉科研邻域大范围兴起,它和激光扫描成像不同,它是以面的形式实时获取被测物对应点到相机感光元件上每个像素点的距离(图1)。

图1 TOF红外相机成像示意图

现在主流的TOF相机使用的感光元件是CMOS 或 CCD 芯片,TOF相机灰度图像成像原理与传统相机相类似,主要区别在于3D数据的获取。如图1所示,开始成像时,通过LED阵列(SICK 3Vistor-T)向目标对象发出经调制的红外信号,反射信号经过透镜进入相机的分束镜后分为两部分,一部分到达光电二极管阵列成深度图像,另一部分到达CMOS或CCD成灰度图像。另外,还有一路红外测量信号开始时由驱动电路直接到达光电二极管阵列(PD2)用来作计时初始值。其中PD1和PD2是按照差频鉴相原理计算延迟相位求出红外信号的飞行时间,再利用光速,测量像点与空间对应点之间的距离d。然后将得到的距离信息转化成用伪色彩表示的距离图像显示。

(1)

其中,Δφ为相位差,n为波长数目,t为传播时间,f为发射光频率,λ为波长,c为光速。

如图2所示,基于TOF技术的SICK 3Vistor-T三维扫描系统发出经过调制的正弦、红外信号,到达测量目标,并发生反射。假设发射信号开始时相位φ0=0,幅度为A,反射回时信号的相位φ1=2π/3,延迟相位为,Δφ=2π/3反射信号此时幅度为a。通过式(1)可以计算出距离d=5 m。为了保证成像系统的鲁棒性,由于红外发射器功率和CMOS精度的限制,目前TOF红外相机探测距离普遍都比较短(一般d≤λ/2)。德国Basler公司2016年新出的TOF深度相机最远也只能达到13 m的测量范围。

图2 TOF红外相机测距示意图

德国ARTTS早在2007年就开始将HDTV技术与TOF相机结合,研发新一代结构紧凑、成本低廉的TOF红外相机;Lynkeus一直在面向工业领域,开发具有较高分辨率和鲁棒性较好的TOF工业相机;3D4YOU致力于场景重建和3D建模,并且将TOF相机实时采集的三维点云数据进行处理呈现到家庭电视中;MOSES在2010年研究开发了面向科研实验人员多方面应用的TOF红外相机;Imaging New Modalities在2014年设计出可用于安保监控领域的TOF相机;SICK公司在2015年设计出面向工业领域的TOF红外相机;但是分辨率一般为176×144,普遍不高。2016年Basler和Odos Imaging公司分别推出新一代具有高分辨率的TOF红外相机。国内对于TOF红外相机的设计生产不多,主要是因为CMOS和CCD芯片技术的落后,杭州光珀智能科技有限公司进行了初步设计,但是目前还没有产品推向市场。

2 TOF红外相机测量误差分析

TOF红外相机是主动光成像,可以同时得到整幅图像的3D数据,其获取的光学信号是由阳光、照明光线以及从不同方向上返回的信号集合而成的。如果发出的调制信号是s(t),则经反射后得到的信号为r(t),可表示为

(2)

其中,k为衰减干扰参数[2],n为外界添加的噪声[3]。TOF红外相机在使用过程中,误差来源比较复杂。

2.1 系统误差

这类误差主要来自于TOF红外相机本身。与传统相机不同,TOF红外相机的传感器由PD阵列和传统的CMOS或CCD组成[4],在传感器表面存在个别红外信号重复发生“反射”和“散射”,这些信号没有按照计划路径飞行,而是与正常信号相融合,被原像素周围的像素吸收,影响了正常的相位测量,造成误差。这种误差从本质上去不掉,只能从提高硬件上降低[5]。另外,由于相机结构的特殊性,曝光误差的重要来源有两个:一是测量信号亮度过高。针对这一误差,PMD®公司设计时增加了背景光抑制系统(SBI),有效降低了该方面的误差,MesaImaging®通过软件控制测量信号的亮度。二是曝光时间过长。TOF相机的光圈和焦距是固定不变的,分析曝光量的影响因素可以发现,曝光时间是影响曝光误差的另一因素。丁津津等[6]研究发现曝光时间越短,噪点越少、目标物体的深度图像越清晰。

除此之外,还有温度和波形变化造成的误差。由于传感设备对于TOF相机温度的波动特别敏感,所以持续测量后相机温度发生剧烈变化,每个像素测量的距离值也随之变化。SICK公司采用散热块降低由温度造成的热噪声取得了较好的效果。通过相位差计算正弦信号飞行时间是一种理想化的模型,实际波形并不是标准的正弦信号,因此深度数据存在误差,这种误差称为“摆动误差”。

2.2 非系统误差

这类误差主要来源于目标物体和环境以及它们之间的距离。由于不同目标物体自身材质对光的反射率不同,当发生漫反射时,目标表面对光有较好的吸收,而发生镜反射时,反射信号要么都回到相机导致光饱和,要么都没有返回相机,使得接收到的信号产生“接收误差”。另外,物体表面粗糙并且凹凸不平,相邻像素接收到的信号相位差别大,测量误差也就较大。调制信号的幅度A与距离d的关系为A∝1/d2。d越大,A就越低,对应测量精度也随之降低[7]。

针对TOF红外相机获取数据中不同来源的误差噪声,研究者们采取了相应的解决办法。May[8]使用中值滤波处理深度点云数据中的大量噪声,利用相邻像素间的相关性来提高数据质量;Fuchs[9]设计了一个误差校正模型,这个误差模型由若干个样条曲线构成,每一个样条的参数都是由它们的初始位置进行估计,通过采集的距离数据和灰度数据校正深度图像中的误差。

综上所述,系统误差出现频率较高,由TOF相机的设计原理、部件精度等决定,误差特征比较单一,可以采用固定的补偿算法降低误差。非系统误差是随机的,不同场景、目标对象以及测量距离造成的误差大小不同,因而应该具体问题具体分析,需要使用具有自适应性的补偿算法降噪。两类误差的关系用公式表达[10]为

(3)

dtof是相机测得的距离值;d是实际距离值;正态分布δ2(d)表示非系统误差;m(d)是系统误差。

3 TOF红外相机的标定

TOF红外相机的特色就是在进行摄像时可以同时采集到距离信息和灰度信息。但是距离信息容易受到场景中的光线、物体的反射率、实际距离等影响造成误差,因此与灰度图像的标定原因不同,并且畸变类型也不一样,需要用不同的方法分别标定。

3.1 灰度图像标定

如图3所示,TOF红外相机获取的灰度图像[11]存在畸变,o为图像坐标系原点,Ow-XwYwZw为世界坐标系,Otof为TOF相机中心坐标。根据小孔成像原理,任一被测点M在TOF相机坐标系下的坐标为M=(Mx,My,MZ)T,投影点为m坐标为m=(xm,ym,w)T,两坐标的函数关系如式(4)所示。

(4)

其中,N是投影模型,px,py表示u,v方向以像素为单位的焦距,ux,vy是o在u,v轴向以像素为单位的坐标。(u0,v0)是图像的真实中心坐标,由于存在畸变,M的投影点由m变到m1。

因此,通过对标定来求解相机的内外参数以及畸变系数,校正灰度图像的径向和切向畸变,其结果直接影响TOF成像的准确性。按照标定方法的区别,灰度图像标定可以分为传统方法、自标定方法和基于主动视觉的标定。

图3 TOF红外相机畸变示意图

传统方法要求已知参考物上的高精度三维信息,然后通过优化算法解出建立在参考物的空间点和TOF红外相机像素之间的函数关系。它包括两步标定法、最优化标定法、张正友法3种。R.Y Tsai提出了两步法,他利用线性方程首先求出大部分相机外参数,再求内参数,然后利用迭代方法算出少部分参数。这种方法迭代较少,运算速度较快,但是只能处理简单畸变的模型。最优化标定法是通过对各种非线性因素最优化进行解算,它可以把相机成像的数学模型建立的比较详细,兼顾了成像过程中的多种因素,使得标定精度较高。但是,该算法对相机初始值的要求较高,初始值设定的准确度将影响标定结果的精确度。张友正法采用在不同方向和位置获取的平面棋盘格的特征点与相机内像素的对应关系进行标定。它首先建立对应关系的数学模型,然后对模型进行优化,这种标定颠覆了以往对于高精度参考物的要求,操作简单,鲁棒性好,实用性强。陈超等[]采用该方法标定后效果如图4所示,可以明显发现边缘的畸变得到有效校正。

自标定方法是利用多幅图像中对应像素点之间的极线约束关系,通过基础矩阵关联图像坐标,然后建立方程直接标定。该方法使用灵活、应用范围广,但是标定精度较低。基于主动视觉的方法使用相机运动信息与图像之间的相互关系标定。由于相机在拍摄过程中的运动已知,所以可以线性求解模型参数,使得标定计算简单可靠,但是该方法需要利用精度较高的平台进行标定,标定成本较高。

图4 标定矫正前后对比

3.2 距离图像补偿

由于成像方法的不同,TOF红外相机距离图像的标定目前研究并不多。影响TOF距离图像精度的因素比较多,当前针对各种影响因素还没有一个通用的方法进行补偿,所以得到的补偿效果也不尽相同。

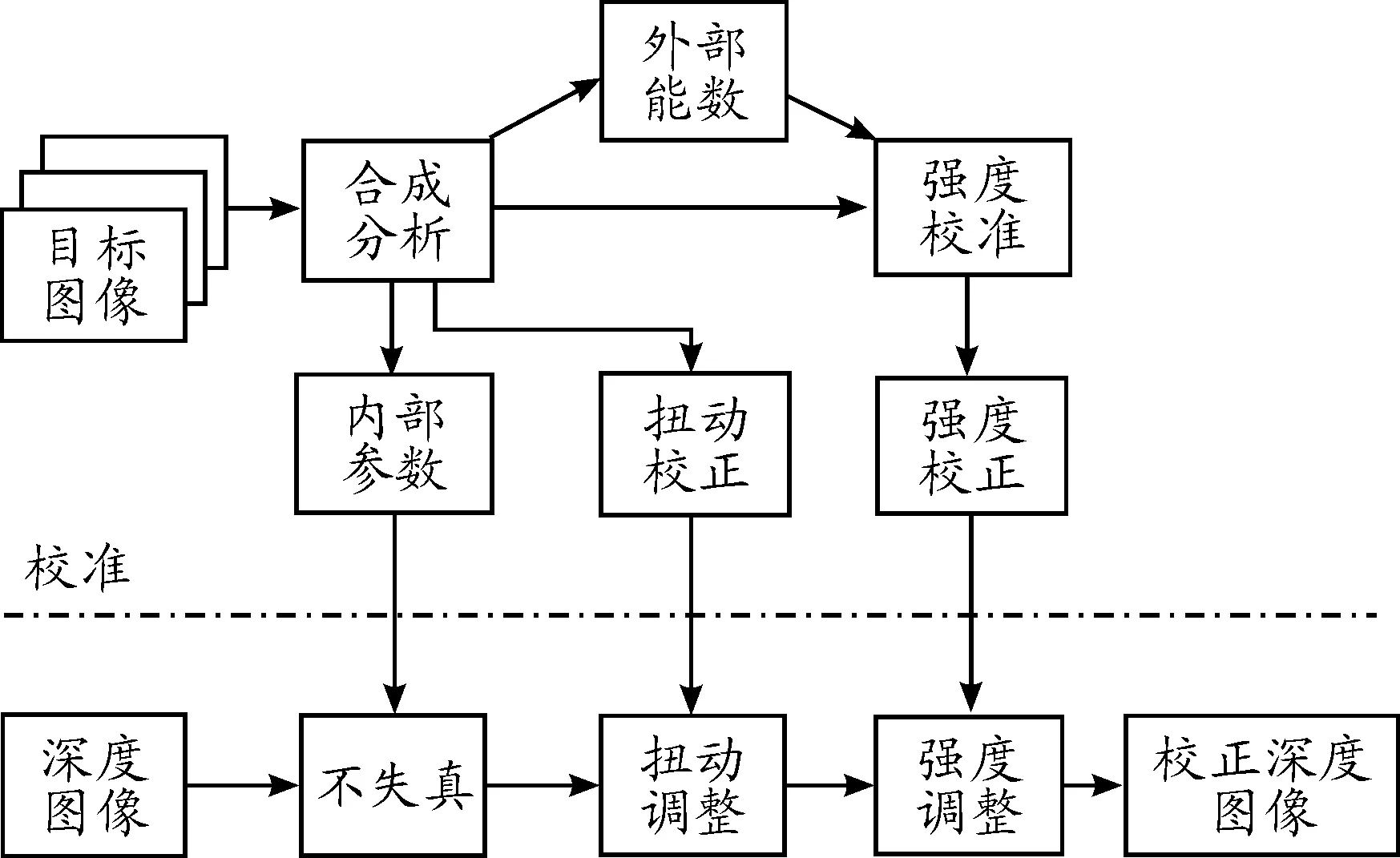

“摆动误差”是TOF相机的主要系统误差,针对这种误差,Lichti[13]将自标定方法用在SR4000相机中,同时调整图像坐标系和相机到目标物体的距离,采集了目标物体的灰度数据以及与之正交的距离数据,然后应用误差模型补偿,使得误差标准差减小了54%。Boehm和Pattinson[14]在2010年提出通过分析平面棋盘格数据估计TOF相机内外参数。首先利用集束调整法获得摄像机三维坐标,然后确定每个目标的几何距离,通过比较实际距离和测得的距离得到误差,建立误差模型。但是TOF测量的结果相比实际距离差0.3 m,使得实验效果不理想。Kahlmann等[15]提出对TOF相机中心像素采用具有不同反射特性的平板和用于距离测量的高精度轨迹线直接确定距离误差,并建立误差表进行距离数据补偿,没有误差表可查的像素结合曝光时间和测量的距离数据通过线性插值确定。Ringbeck等[16]应用精度高价格昂贵的线性定位台确定TOF相机和目标之间的参考距离,补偿了摆动误差,也提供了曝光时间引起的误差模型。如图5所示,M.Linder[17]和Kolb用B样条函数对误差建模,首先对一整幅目标图像进行全局范围的标定,接着对每个像素的距离信息采用直线拟合方式进行小范围调整,使得误差少于0.02 m。该方法虽然能够有效校正距离图像的畸变缺陷,但是算法操作比较复杂,对于标定的设备要求也比较高,而且限制了TOF红外相机的实时性优势。

图5 TOF距离图像标定流程

国内对于TOF红外相机获取距离信息的补偿研究不多,浙江大学、合肥工业大学、西北工业大学等少数机构做过距离误差补偿的研究,所采用的TOF相机也不同,这里就不一一论述。

4 TOF红外相机特性分析

随着硬件的发展,PMD® Technologies,Mesa Imaging,SICK、Basler,StarForm等相继开发出多型号的TOF相机。表1给出了目前几款主流TOF红外相机的参数和外观图片。可以看出,TOF红外相机分辨率普遍较低,只是近几年在传感器的发展基础上分辨率有所改善。

4.1 对比分析

获取目标3D数据的计算机视觉方法中,常见的有立体视觉法、结构光法、相位莫尔法、扫描激光测距、TOF法,每种方法都有与之对应的相机。

立体视觉法需要两个或者多个GRB相机,并且相机间基线距离越大,成像深度分辨率越高。这种方法完成三维重建需要经过大量的算法去匹配,而且通过立体视觉法获得的深度信息一般稀疏性较高[19]。而TOF相机不同,可以同时输出目标的稠密深度信息与强度信息,并且它测量的数据精度取决于光飞行时间的测量精度。TOF相机一般的测量距离在0.3~7 m,比较短,但改变发射光的调制频率可以对测量距离的范围延长[20]。立体视觉则需要改变基线才能对有限的测量距离进行调整。

与TOF红外相机相比,结构光法缺少深度数据,需要较高的功率和聚焦的光线,并且在扫描场景时帧率低。它由相机和结构光发生器[21]构成,因为需要控制光源,所以在室内外机器人的应用中受到极大的限制。

表1 主流TOF红外相机参数

相位莫尔法是一种采用光栅发生干涉生成莫尔条纹图的成像方法。Inspeck成像扫描仪就是利用被调制栅线的相位变化信息,通过相位距离对应关系进行测量。虽然可以同时捕捉深度和颜色信息,但获取数据丢失严重并且成像精度较低。

扫描激光测距系统虽然目前可以用来同时定位与制图,但它的缺陷在于视角过窄[22]。尽管激光测距系统测量距离远、精确度高、可靠性强,可是由于它体积重量过于庞大、功率消耗高,需要增加其他的移动配件,使得它的应用范围受到限制。TOF相机则不同,TOF相机结构小巧,方便携带,能轻易移动,功耗也比较低,它与扫描激光测距系统最不同的一点是,它是以面扫描,被称为“快照”成像,大大减少了数据获取时间。

经过上述对比可以发现,TOF红外相机不用扫描就可以同时得到目标物体的二维和三维信息,具有结构小巧,精度较高,功耗较低而且获取数据的实时性好等优点,具体见表2。

5 TOF红外相机应用研究

纵观TOF红外相机的产生发展历程,其在机器人、车辆洗涤与安全、医疗领域和工业自动化邻域等发挥了显著的作用。

5.1 机器人领域

Stefan May等[22]率先提出将TOF红外相机用在室内三维地图构建上。他们通过对TOF相机校准,然后对获取的深度数据进行不同程度的过滤去噪,再采用改进的ICP算法对不同视点获取的点云进行有效匹配。剩余的匹配误差通过环路闭合和表面平滑处理。该方法保证了实验室地面实况的3D重构,为较大的室内环境简单、快速生成的立体重构提供了理论支持,但缺乏更高测量精度和更好的鲁棒性。

Alenyà G[23]使用结合TOF和RGBD相机进行机器人三维环境感知,RGBD相机有效抵消了TOF相机分辨率低的缺陷,TOF相机也相应抵消了RGBD相机测量深度信息误差大的特点。该方法提高了机器人对目标对象的识别能力,可迅速、精确的完成机器人路障识别和货物抓取。

表2 获取3D数据的设备性能对比结果

5.2 车辆洗涤与安全

Hoegg T[24]提出了一种与传统方法不同的汽车清洗系统。能够实时自动采集车辆的三维模型,优化洗涤过程,提高了洗车系统的整体性能。该方法使用多相机设置,通过合并与同步不同视点的3台TOF相机获取点云数据,然后进行数据预处理、配准、融合以及几何提取,数据处理模块主要是利用CUDA实现,最终得到汽车的三维模型。该方法快速、高效。但是,由于汽车各部分反光度不同,存在曝光过度误差,该成像需要处理大量噪声,给汽车模型重建带来一定挑战。Oggier T[25]提出将TOF相机安装在汽车内部,以便在紧急情况下控制安全气囊。该动态监测系统具有前瞻性,可有效减少车内人员伤亡,但需优化验证其安全性和可靠性。

5.3 医疗领域

Soutschek S[26]在医疗成像应用中使用TOF相机进行三维手势姿态成像。通过内窥镜上多个TOF三维图像导航传感器提供的数据影像,展示给医生一个可视化界面,避免了物理交互输入设备对人体不必要的伤害。该系统提供了一种在帧频为11 fps时识别率为94.3%,满足了医疗成像设备必备的基本要求。

Falie D[27]提出一种新的非侵入性方法诊断睡眠呼吸暂停,用壁装的TOF相机连接到便携式电脑,实时记录视频处理结果,然后通过无线网络传输给医生。这种诊断方法是基于TOF相机的呼吸运动可视化。用TOF相机的三维视频对病人睡觉时呼吸运动进行可视化处理,然后提取特征、分析和实时显示病人情况。该方法还可用于在运动医学或瑜伽练习。这种低成本的非侵入性方法可以用于睡眠呼吸暂停的诊断评估,帮助病人和医生为疑似临界病例做进一步的调查。这个新的监测技术非常简便、高效,它可以广泛应用于医院,也可以用来对司机和飞行员进行监测,防止出现事故。

5.4 工业自动化领域

Ahmad R等[28]使用3D TOF传感器生成2.5D铣削/钻削机床的安全刀具路径。由于多轴、铣削和钻孔CNC机床的复杂性以及对复杂零件生产的高精度需求,增加了在制造期间安全和有效的刀具路径生成的重要性。在这些机器中,在相同区域中的多工具工作可能引起碰撞,重要的是在生产过程中提前知道碰撞风险,以避免意外的生产停止和机械损坏。基于3D视觉的TOF传感器提供关于制造场景的深度信息,所述深度信息有TOF相机自动检测和避免碰撞,以便在生产期间实现安全的工具路径。提出的概念为在CNC制造环境中的TOF摄像机的研究和应用开辟了新的领域,用于工具路径规划。所获得的结果是用于静态环境中的安全刀具路径,通过将其与STEP-NC技术集成来适应更复杂和动态的实际加工情况。

5.5 其他领域

Hansen D W[29]提出了一种基于飞行时间传感器增强面部分类检测的方法。当使用TOF的深度和灰度图像时,可以有效增强面部检测能力,准确率相对较高。但是相机自动调整发射光时,对于快速迎来的目标可能会曝光过度,影响检测效果。后来,Ruiz-Sarmiento J R等[30]进行了改进,通过使用Viola-Jones算法检测面部,然后分析深度图像中检测点,大大提高了面部检测能力。梁斌等[31]探讨了将TOF相机应用在空间飞行器近距离测量中。Jain和Subramanian[32]提出一个检测及计算人体的位姿的方法。Bohme M[33]提出,如果反射特性面已知,用shading constraint模型可以将TOF相机的亮度图像和获取的3D数据连接起来,用这种方法可以迅速、精确的实现人脸三维模型匹配、检测。韩郁翀等[34]提出了用TOF红外相机来进行火灾探测,实验中对火焰的识准率大于91.5%,误识率小于3.8%,能有效识别火焰,但目前还没有投入到实际应用中。

6 结论

目前,TOF红外相机操作简单,处理速度快,可以达到几十到100 fps,并且具有较高的精度,基本能稳定在cm级,其优势还在于将逐像素的测量与常规的图像深度信息相结合。但由于硬件发展的制约,目前市场上TOF相机分辨率普遍较低,易受噪声的干扰,因此在实际应用中有一定的限制,具体特性如表3所示。

表3 TOF红外相机的特性

由本文分析可看出,TOF红外相机的应用越来越广,结合它的特性,该相机技术改进以及未来的发展趋势主要在以下方面:

1) 提高TOF红外相机的分辨率。传统TOF深度相机分辨率过低,使得获取的二维图像不清晰,不能精确还原复杂物体,阻碍了TOF红外相机的进一步发展。目前世界上OI-VS-1000虽然是TOF相机中分辨率最高的,可以达到1 280×1 024,但是价格特别昂贵。

2) 延长TOF红外相机的测量距离。目前有效探测距离一般都在10 m以内,限制了TOF相机的应用范围。

3) 优化TOF红外相机获取数据的方法。从硬件和软件两个方面不断加强,消除或者降低TOF相机的噪声影响,提高数据精确度。

4) 提高TOF红外相机获取高分辨率RGB信息的能力。给只能获取灰度和深度信息的TOF相机增加彩色信息,使TOF相机获取更高品质的3D成像效果,应用范围更加广阔。

综上所述,改进TOF测距技术、升级TOF深度相机硬件性能、提高通过TOF红外相机实时获取场景高分辨率的2D/3D信息及其应用拓展的能力,是当前国内外研究方向和热点。目前TOF红外相机存在一些制约因素,使得它的大规模应用还比较少,但是考虑它实时性强、精度高、能同时获取2D/3D信息的优点,经过不懈努力,TOF相机一定能成为新一代多用途的三维测量红外成像设备,引领我国走进全新的3D时代并助力工业4.0。

[1] OGGIER T,LEHMANN M,KAUFMANN R,et al.An All-Solid-State Optical Range Camera for 3D Real-Time Imaging with Sub-Centimeter Depth Resolution (Swiss Ranger)[C]//Optical Systems Design.International Society for Optics and Photonics,2004:534-545.

[2] 王莹.基于相位的ToF测距方法避免了背景光影响[J].电子产品世界,2016,23(4):78-79.

[3] HANSEN D W,LARSEN R,LAUZE F.Improving Face Detection with TOF Cameras[C]//International Symposium on Signals,Circuits and Systems.IEEE,2007:1-4.

[4] SILVA F M,CENTENO J A,SILVA F M,et al.Modelling of Error Due to Background Lighting in Measurements Obtained from Range Camera[J].Bol.ciênc.geod,2016,22.

[5] FRANK M,PLAUE M,HAMPRECHT F A.Denoising of Continuous-Wave Time-of-Flight Depth Images Using Confidence Measures[J].Optical Engineering,2009,48(7):453-459.

[6] 丁津津.TOF三维摄像机的误差分析及补偿方法研究[D].合肥:合肥工业大学,2011.

[7] KOSTKA P M.Faculty of Physics and Astronomy[J].Mpp mpg de,2013(5):15-19.

[8] MAY S,WERNER B,SURMANN H,et al.3D Time-of-Flight Cameras for Mobile Robotics[C]//Ieee/rsj International Conference on Intelligent Robots and Systems.2006:790-795.

[9] FUCHS S,HIRZINGER G.Extrinsic and Depth Calibration of ToF-Cameras[C]//Computer Vision and Pattern Recognition,2008.CVPR 2008.IEEE Conference on.IEEE,2008:1-6.

[10]KIM Y M,THEOBALT C,DIEBEL J,et al.Multi-View Image and ToF Sensor Fusion for Dense 3D Reconstruction[C]//IEEE International Conference on Computer Vision Workshops.2009:1542-1549.

[11]BELHEDI A,BOURGEOIS S,GAY-BELLILE V,et al.Non-parametric depth calibration of a TOF camera[C]//2012:549-552.

[12]陈超.基于TOF摄相机的三维点云地图构建研究[D].哈尔滨:哈尔滨工业大学,2013.

[13]LICHTI D D,KIM C,JAMTSHO S.An Integrated Bundle Adjustment Approach to Range Camera Geometric Self-Calibration[J].Isprs Journal of Photogrammetry & Remote Sensing,2010,65(4):360-368.

[14]BOEHM J,PATTINSON T.Accuracy of Exterior Orientation for a Range Camera[J].International Archives of the Photogrammetry Remote Sensing & Spatial Information Sciences,2010,38(5):103-108.

[15]CRABB R,TRACEY C,PURANIK A,et al.Real-Time Foreground Segmentation Via Range and Color Imaging[J].Optional Engineering,2008(6):1-5.

[16]RINGBECK I T.A 3D Time of Flight Camera for Object Detection[J].Optional Engineering,2007(10):72-75.

[17]LINDNER M,SCHILLER I,KOLB A,et al.Time-of-Flight Sensor Calibration for Accurate Range Sensing[J].Computer Vision & Image Understanding,2010,114(12):1318-1328.

[18]HARTLEY R,ZISSERMAN A.Multiple View Geometry in Computer Vision[M].2nd edition.With foreword by Olivier Faugeras,2003.

[19]FOIX S,ALENYA G,TORRAS C.Lock-in Time-of-Flight (ToF) Cameras:A Survey[J].IEEE Sensors Journal,2011,11(9):1917-1926.

[20]高学海,梁斌,潘乐,等.非合作大目标位姿测量的线结构光视觉方法[J].宇航学报,2012,33(6):728-735.

[21]WEINGARTEN J W,GRUENER G,SIEGWART R.A State-of-the-Art 3D Sensor for Robot Navigation[C]//Ieee/rsj International Conference on Intelligent Robots and Systems,2004(3):2155-2160.

[22]MAY S,DROESCHEL D,FUCHS S,et al.Robust 3D-Mapping with Time-of-Flight Cameras[J].Proceedings,2009(10):1673 - 1678.

[23]ALENY G,FOIX S,TORRAS C.Using ToF and RGBD Cameras for 3D Robot Perception and Manipulation in Human Environments[J].Intelligent Service Robotics,2014,7(4):211-220.

[24]HOEGG T,LEFLOCH D,KOLB A.Time-of-Flight Camera Based 3D Point Cloud Reconstruction of a Car[J].Computers in Industry,2013,64(9):1099-1114.

[25]OGGIER T,BUETTGEN B,ZAMOFING T.Adaptive Neighborhood Filtering (ANF) System and Method for 3D Time of Flight Cameras: EP,US8223215[P].2012.

[26]SOUTSCHEK S,PENNE J,HORNEGGER J,et al.3-D Gesture-Based Scene Navigation in Medical Imaging Applications Using Time-of-Flight Cameras[J].Workshop on Time of Flight Camera Based Computer Vision,2008(10):1-6.

[27]FALIE D,ICHIM M,DAVID L.Respiratory Motion Visualization and the Sleep Apnea Diagnosis with the Time of Flight (ToF) Camera[C]//Wseas International Conference on Visualization,Imaging and Simulation.2008:179-184.

[28]AHMAD R,PLAPPER P.Generation of Safe Tool-Path for 2.5D Milling/drilling Machine-Tool Using 3D ToF Sensor[J].Cirp Journal of Manufacturing Science & Technology,2015(10):84-91.

[29]HANSEN D W,LARSEN R,LAUZE F.Improving Face Detection with TOF Cameras[J].International Symposium on Signals,Circuits and Systems,IEEE,2007(7):1-4.

[30]RUIZ-SARMIENTO J R,GALINDO C,GONZALEZ J.Improving Human Face Detection through TOF Cameras for Ambient Intelligence Applications[M].Ambient Intelligence - Software and Applications.Springer Berlin Heidelberg,2011:125-132.

[31]梁斌,何英,邹瑜,等.ToF相机在空间非合作目标近距离测量中的应用[J].宇航学报,2016,37(9).

[32]JAIN H P,SUBRAMANIAN A,DAS S,et al.Real-Time Upper-Body Human Pose Estimation Using a Depth Camera[C]// Computer Vision/computer Graphics Collaboration Techniques -,International Conference,Mirage 2011,Rocquencourt,France,October 10-11,2011.Proceedings,2011:227-238.

[33]BOHME M,HAKER M,MARTINETZ T,et al.A Facial Feature Tracker for Human-Computer Interaction Based on 3D Time-Of-Flight Cameras[J].International Journal of Intelligent Systems Technologies & Applications,2008,5(3/4):264-273.

[34]韩郁翀,秦俊,马兴鸣,等.基于飞行时间深度图像变化率的火焰识别方法[J].红外与激光工程,2014,43(1):338-344.

(责任编辑 杨继森)

Research Overview of Infrared Camera Based on Time of Flight

GUO Ning-bo, CHEN Xiang-ning, XUE Jun-shi

(Equipment Academy of PLA, Beijing 101416,China)

Infrared camera based on Time-of-Flight (TOF) method is a new kind of stereo imaging device with compact structure and three-dimensional data acquisition. It can capture the depth information and gray-level information of motion or static targets in real time and has become a hot research field in the field of measurement imaging. The development of TOF system was expatiated, and the imaging principle, image calibration and measurement error of the depth camera were analyzed. Finally, the advantages and disadvantages of TOF infrared camera and the application were summarized, and the development of TOF infrared camera was discussed.

infrared pulse; time flight method; depth camera; 3D reconstruction; ICP

2016-11-01;

2016-11-29 基金项目:国家863计划项目(2014AAxxx1072E)

郭宁博(1992—),男,硕士,主要从事机器视觉研究。

陈向宁(1962—),男,教授,博士生导师,主要从事信息处理研究。

10.11809/scbgxb2017.03.035

郭宁博,陈向宁,薛俊诗.基于飞行时间法的红外相机研究综述[J].兵器装备工程学报,2017(3):152-159.

format:GUO Ning-bo, CHEN Xiang-ning, XUE Jun-shi.Research Overview of Infrared Camera Based on Time of Flight[J].Journal of Ordnance Equipment Engineering,2017(3):152-159.

TH745

A

2096-2304(2017)03-0152-08