基于机器视觉的玉米根茎导航基准线提取方法

2017-03-02刘永博朱德泉陈黎卿

宋 宇 刘永博 刘 路 朱德泉 焦 俊 陈黎卿

(1.安徽农业大学工学院, 合肥 230036; 2.中国科学技术大学工程科学学院, 合肥 230026)

基于机器视觉的玉米根茎导航基准线提取方法

宋 宇1刘永博1刘 路2朱德泉1焦 俊1陈黎卿1

(1.安徽农业大学工学院, 合肥 230036; 2.中国科学技术大学工程科学学院, 合肥 230026)

提出一种在大田环境下快速、精确提取中晚期玉米行中心线作为农业机器人导航基准线的新方法。改进了传统的2G-R-B算法,实时地获取植株绿色特征。根据玉米垂直投影图生成根茎轮廓特点并采用峰值点检测算法生成玉米根茎候补定位点,再对候补定位点进行二次判别,提取玉米根茎定位点。利用最小二乘法对已知特征点进行拟合,得到作物行线。求取左右行斜率后,计算出实际需要的导航基准线。实验结果表明,与其它算法相比,处理一幅700像素×350像素的彩色图像平均耗时小于185 ms,实时性好。在多种环境下生成的导航基准线准确率在90%以上,有较强的鲁棒性,为农业自动导引车(Automated guided vehicle,AGV)在中后期玉米大田中的自主行走提供了一种可靠的导航方法。

农业自动导引车; 机器视觉; 导航基准线; 峰值点检测; 玉米根茎

引言

随着精准农业的迅速发展,农业机械自主导航在农田耕作、农药喷洒、水稻插秧和作物收割等方面被广泛应用。目前玉米中后期病虫害防治主要依靠人工喷洒农药,对人危害较大。如何能有效避免人工防治,实现自动作业受到越来越多的关注。农机自主导航早在20世纪20年代就被提出[1],直到80年代末和90年代初才将相关的视觉处理算法应用到农业机械导航上[2-3]。期间,农机导航的方式也从早期的预埋电缆导航和机械触杆导航发展到电磁导航、激光导航、惯性导航、GPS导航和机器视觉导航等[4],不同导航方式具有各自的特点。其中视觉导航系统主要是利用相机采集农田环境信息,处理和分析后提取感兴趣区域(ROI),然后对ROI提取定位点和拟合,获取导航参数。通过获取的导航参数,调整农业机械的行驶状态,使机器能够沿着导航目标行走[5-6]。相对于其他几种导航方式,视觉导航具有成本低、准确度高、信息采集范围广和适应性强等特点,正逐渐成为农机导航的研究热点。

根据农田的结构和作物种植特点,依据农田图像提取导航基准线主要是利用作物行边缘、垄沟或者是具有明显区分特征的边缘或中心线,很多学者对此进行了卓有成效的研究[7~18]。目前的研究成果主要集中在大田环境中相机位置高于农作物的情况,很少关注玉米中后期行间行驶的农业自动导引车(AGV)导航算法。本文提出一种针对成熟的中后期玉米根茎部识别的视觉处理方法,该方法在前期预处理过程中,改进传统的2G-R-B算法,以解决传统超绿特征法实时性差和鲁棒性差的缺点。经过预处理和垂直投影图变换,显示像素在纵坐标水平方向的累加值,这些累加值能够反映出玉米的轮廓特征,对轮廓特征点求取峰值点,得到玉米根茎的候补定位,再通过二次的检测和判断规则,筛选出玉米根茎定位点。最后采用最小二乘法拟合定位点,生成玉米根茎线,然后以两行玉米根茎线斜率为参数计算出导航中心线,并以此作为导航基准线,从而为农业AGV应用于玉米中后期虫害防治提供一种有效的导航方法。

1 机器视觉系统设计

1.1 实验设备

机器视觉系统图像采集设备如图1所示。在农业AGV上安装DFK22AUC03型相机,相机图像尺寸为750像素×350像素,拍摄帧率为87 Hz。图像处理硬件采用Intel Core i3处理器,主频2 GHz,内存容量4 GB,软件开发环境为Visual C++ 6.0。实验中的农业AGV宽60 cm、长110 cm,相机安装在农业AGV纵轴中心线最前方,相机中心线相对轮式小车纵轴中心线向下倾斜5°,采集前方路径信息和玉米植株的根部特征。

图1 图像采集设备Fig.1 Equipment of image acquisition

1.2 相机标定模型

为获得小车在田间的位置坐标,需要对相机位置进行标定。视觉导航中需要标定4个坐标系,分别是图像坐标系、图像物理坐标系、相机坐标系和世界坐标系。世界坐标系的坐标原点以车身中心为坐标原点,记为OXwYwZw;相机坐标系以安装在小车纵向中心线位置的相机光心为相机坐标原点,记为O1XcYcZc;图像坐标系则以图像左上角为坐标原点,建立Obxbyb坐标系;图像物理坐标系以图像的中心为坐标原点,建立Odxdyd坐标系[19]。

利用相机成像原理,将地面上的对象特征坐标全部投影到图像上,根据坐标系转换关系

(1)

式中xi、yi——图像坐标中第i个坐标点的值Xwi、Ywi、Zwi——世界坐标中第i个坐标点的值

将图像坐标系转换为世界坐标系。令mij构成的4×3矩阵为转换矩阵H,相机标定过程就是要先获得转换矩阵H。H仅与相机内部参数和外部参数有关,其中内部参数是与相机自身参数有关的3×4矩阵,外部参数是相机坐标系在世界坐标系中经旋转和平移得到的矩阵参数。利用最小二乘法求解线性方程组,便可求出转换矩阵H。因此根据式(1),知道图像像素坐标即可求出世界坐标系中的小车位置。

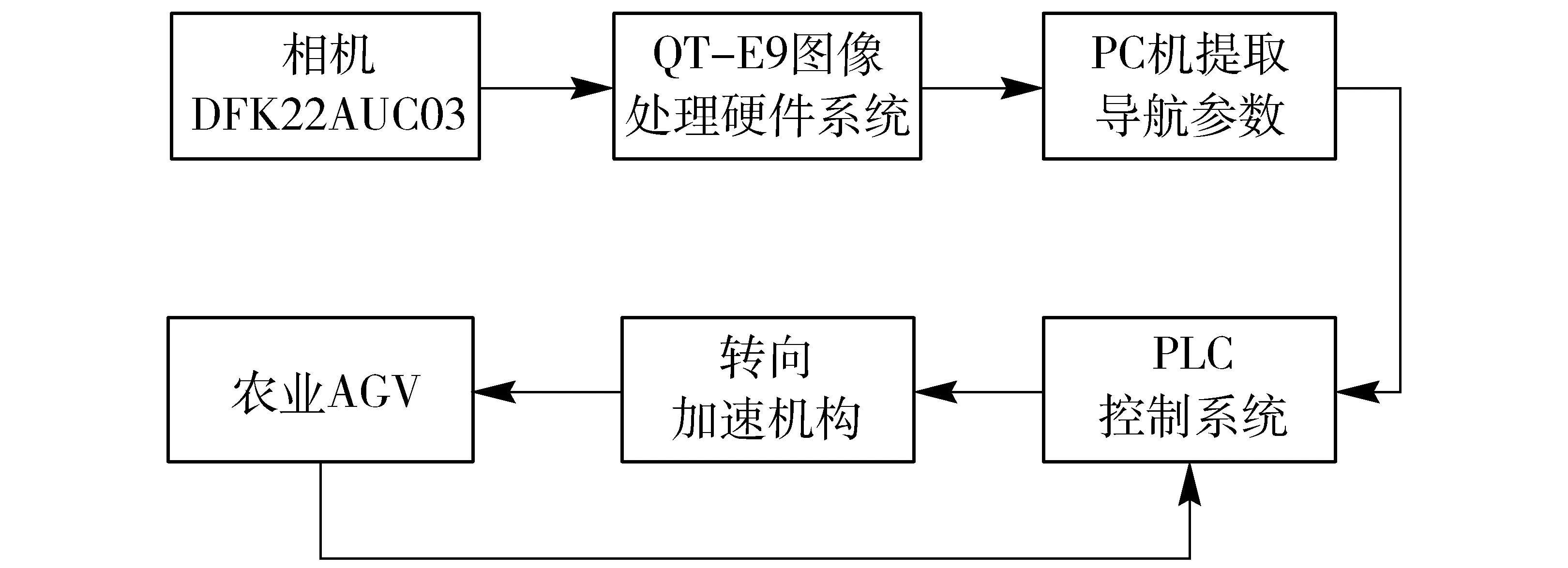

1.3 导航系统设计

实验平台为农业AGV,集成相机等数据采集装备。CCD相机采集行走路线上前方的左右两侧玉米根茎图像信息,传送到QT-E9型开发板进行分析和处理,开发板通过RS232串口与PC上位机进行通信,将获得的导航参数信息传输到控制系统模块,控制系统模块根据接收到的指令,控制农业AGV行走和转向,完成导航任务。

图2 视觉导航系统示意图Fig.2 Schematic diagram of visual navigation system

2 玉米根茎导航基准线的提取方法

2.1 绿色特征的提取

图像预处理包括图像灰度化、滤波去噪和图像二值化等。农田环境中,利用土壤和植株颜色差别较大的特点,在图像灰度化处理之前,提取玉米绿色特征将可大大降低后期灰度化的计算量,提高实时性。αG-R-B也称为超绿特征算法,WOEBBECKE等[20]在1995年根据作物行之间绿色特征较为明显这一特点,用2G-R-B提取出了绿色特征分量。

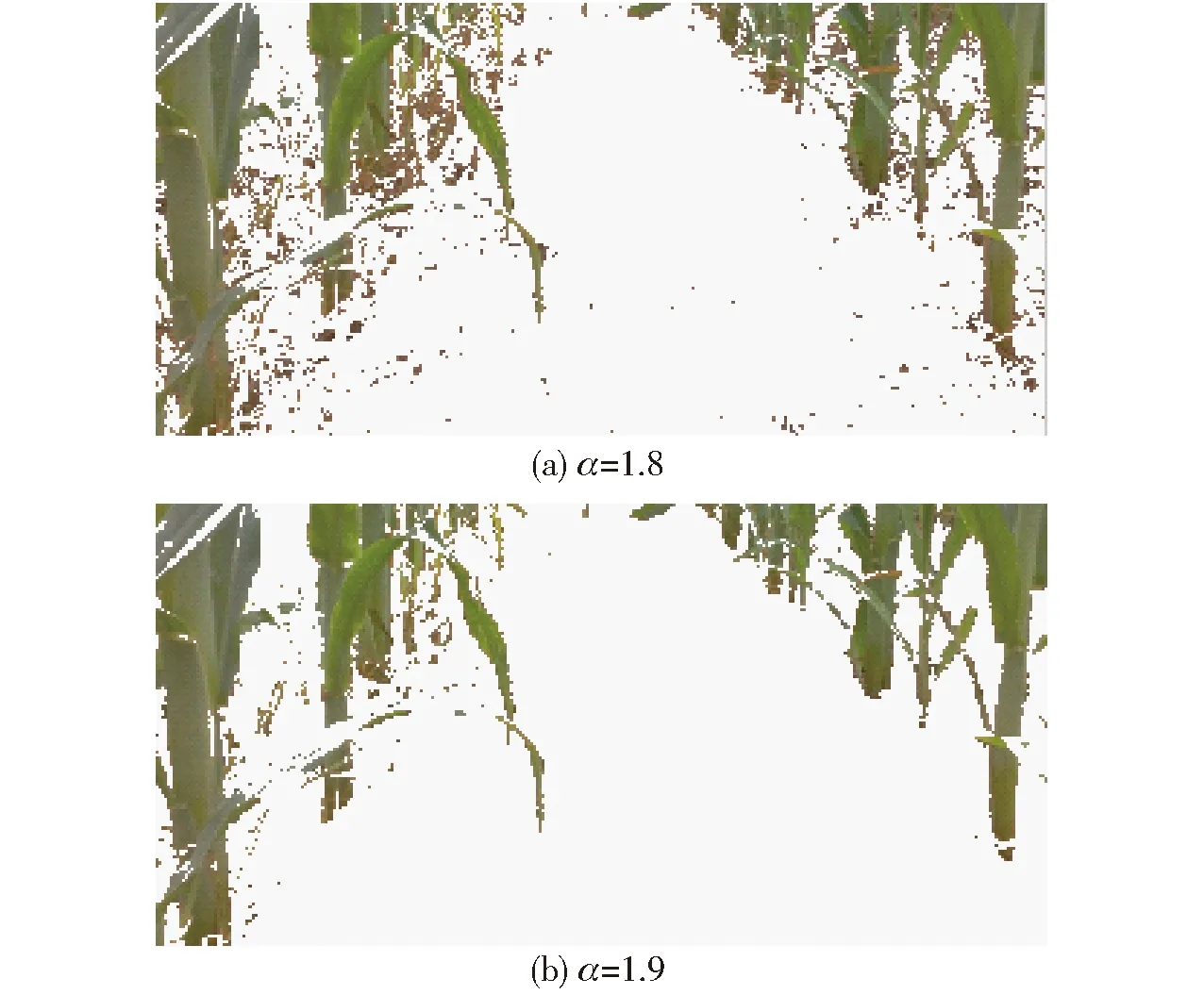

机器视觉系统采集的图像为RGB真彩色图像(图3),通过提取G分量,淡化R、B分量可以去除土壤等噪声的影响。当前大多数学者仍然直接设定G值系数为2.0,部分学者通过加大G的倍数并减去R和G分量的值,重新设定新阈值提取目标的绿色特征分量。这种方式需要不断人工设定阈值,实时性较差。为得到较为准确的G值系数,用Matlab对大量玉米根茎作物行的样本图片进行G-R-B分量的关系分析。

(2)

式中α——系数

Gr(x,y)new——(x,y)处R、G、B分量值

图3 原始图像Fig.3 Original image

利用式(2)计算每张样本图像,当αG(x,y)的值大于或等于R(x,y)和B(x,y)之和时,说明此处像素的G分量显著,保留G分量值。当αG(x,y)的值小于或等于R(x,y)和B(x,y)之和时,则认为此处的G值分量不显著,并将该处的R-G-B值设置为白色。田间观察发现,玉米大田环境整体相对均衡,实验前拍摄一定数量的图片并取α的均值,可以大幅提高导航的鲁棒性。实验处理了多幅样本图片后,计算出α的均值为1.9。以图3为研究对象,图4a和图4b分别是G值系数α为1.8和1.9时的图像噪声检测效果图。从图中看出,当α=1.9时效果最好。如果继续令G值系数α=2.0,会造成过度提取,腐蚀玉米根茎区域。

图4 图像噪声检测结果Fig.4 Results of image noise detection

2.2 图像分割和去噪

图像经过超绿特征算法处理之后,仍为三维向量数组,因此需要对图像进行灰度化处理,降低维度,减少计算量。OTSU法(最大类间方差法)按灰度级把图像的灰度数分成两部分,使每部分之间的灰度差异最小,而两部分之间灰度值差异最大,通过计算方差自动选取阈值,寻找合适的灰度级别来分割图像。以图4b为例,对于存在的噪声,用6×6的滤波窗口对图像进行中值滤波。处理后的结果如图5所示,玉米植株清晰可见。

图5 OTSU处理结果Fig.5 Result of OTSU processing

滤波之后仍有杂草和枯枝等噪声。如果这些噪声不去除,直接对其进行边缘检测和Hough变换将占据较多的内存量和计算时间,影响整个导航系统的实时性,采用形态学运算中的开运算可以去除部分小面积噪声[21],不会影响植株的茎秆部分。用圆形结构元素为100的结构因子对图像进行先腐蚀后膨胀处理,最终可以得到较为理想的处理效果。采用开运算处理图5,结果如图6所示。从图中可以看出玉米根部附近外伸叶子的折弯处腐蚀较好,并剔除了大部分的小噪声,耗时47 ms。

图6 形态学处理的图像Fig.6 Image of morphology processing

2.3 对感兴趣区域(ROI)的提取

去除小面积噪声后,图像依然存在大量的小斑块。由于整个玉米植株的根部和上枝叶有连接,从而形成大面积区域。伸展出来的叶片经过腐蚀后,依然保留小部分的斑块。如果采用全局形态学处理,可能会腐蚀玉米的根部等感兴趣区域。而采用8邻域结构因子对二值图形中的小斑块进行标记,可剔除叶子尖端和边缘的大面积噪声,保留玉米植株的根部特征。8邻域是指像素位置的上、下、左、右、左上、右上、左下、右下8个方向紧邻的位置。8连通定则[22]为

N8(p)=N4∪(x+1,y+1),(x+1,y-1),

(x-1,y-1),(x-1,y+1)

(3)

其中N4=(x,y)∪(x,y-1),(x+1,y),

(x,y+1),(x-1,y)

式中N8(p)——p点的8邻域N4——p点的4邻域

8连通区域可通过对图像中1个像素点进行8个方向的移动组合,更加全面地搜索标定图像中多个连通区域的面积。从图像中发现,图像噪声以区域面积斑块为主。首先对全局所有图像斑块进行面积标记(以图6为例),当标记阈值面积大于200时保留该斑块,并视之为感兴趣区域,同时将小于该阈值的小斑块噪声去除,处理后的结果如图7所示,斑块噪声明显得到抑制,耗时为25 ms。对于伸展到行间的玉米叶片等更大的噪声,通过后期的垂直投影进行弱化和消除其影响。

图7 8邻域去噪Fig.7 Denoising of eight neighborhood

2.4 根茎轮廓点提取

根据玉米根茎部位的生长特点可知,根茎较为笔直,相邻根茎之间有间隙,易于区分。把玉米根茎区域的轮廓提取出来,可以为后期玉米根茎尖端定位减少计算量。

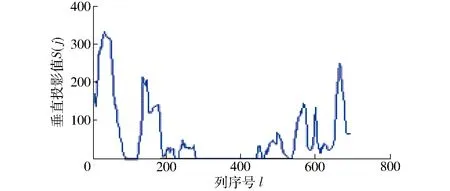

(4)

式中M、N——图像像素的水平和纵向尺寸l、j——图像像素的列号和行号I(l,j)——以图像左上角为坐标原点,沿着图像l列方向,取每列的像素之和作为新的纵坐标,图像j方向为行坐标

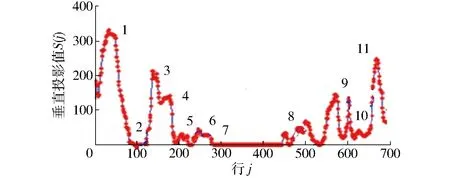

在图像计算中,黑色像素是0,白色为1。经过式(4)进行垂直投影变换后,从图8(坐标原点在左下方)可以明显观察到玉米植株的根茎轮廓区域,将结果放在图9中,峰值点正好落在玉米根茎的外轮廓。另外,经过前期预处理后的图像仍然可能会有部分叶片噪声伸向行间,而经过垂直投影变换后,基本不会影响根茎轮廓和定位。原因在于玉米叶片与根茎相连处沿列纵向像素较少(图9),假如产生的噪声较大,如果大于一定阈值,可以运用特征点值比较法剔除,舍去伪值。

图8 垂直投影图Fig.8 Image of vertical projection

图9 玉米茎秆轮廓Fig.9 Profile of corn stalks

2.5 根茎定位点提取

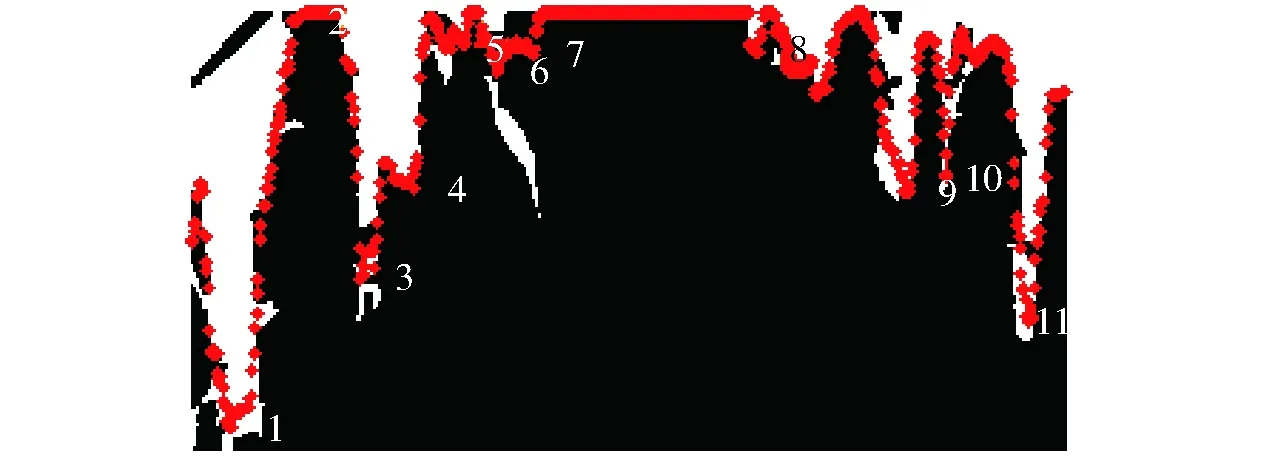

定位点的提取非常关键,根茎定位点是否准确,直接影响后期的直线拟合精度。从图8和图9中不难发现,玉米根茎连续的曲线形成了许多大小不同的峰值点。峰值点的特性表现为,峰值点的数值大于其相邻的左边和右边的数值,即S(j)大于S(j+1)和S(j)大于S(j-1)。由前文可知,峰值点是由垂直投影关系计算出的,峰值点最大的点,也是根茎主干和地面相交的底端,称为定位特征点。玉米根茎成圆柱状,因此定位特征点可能有若干个,而只要取一个即可定位玉米的根茎位置。根据玉米根茎底端相邻峰值点较为密集的特性,用如下算法获取定位特征点,具体步骤为:

(1)沿j方向,从左到右对根茎轮廓点进行扫描,设定相邻峰值点距离的阈值,目的是得到较为分散的离散点簇和玉米根茎的定位点,同时去除玉米根茎皮等引起的小波峰噪声,如图10所示,其中数字标记为玉米根茎特征定位点,存储到特征点矩阵Smax中。

图10 离散点簇图Fig.10 Image of discrete points cluster

(2)以图像中心的1/2处为分割线,分别建立左右两个空矩阵,左边记为L,右边记为R。

(3)由相机成像特点可知,距离相机镜头焦距较近的成像尺寸较大,反之较小,而垂直投影变换正好符合此原则。将距离镜头近而投影值非常小的伪特征点舍去。以L矩阵为例,对L和R矩阵进行二次特征点判断。将图像左上角设定为坐标原点,沿j方向从左向右,依次扫描各个特征点,对Smax中的特征点进行判别,当出现两个特征点符合Smax(j)小于Smax(j+1)时,将Smax(j+1)设定为空。对R矩阵的处理正好相反,坐标原点在图像的右上方,沿j从右往左扫描,当Smax(j)小于Smax(j+1)时,将Smax(j)设定为空,即可剔除明显偏离较大的伪特征点。如图11中标记的2点、5点和10点。其中,图11中的10点虽为玉米根茎定位点,但是玉米植株相对于正常中后期的其它玉米植株根茎非常细小,且茎秆也并非竖直状,当其作垂直投影变换时,在垂直方向白色区域较少,黑色较多(即1少,0多),因此投影值相对于8特征点较低。在大田环境中,这种情况的玉米根茎相对较少,不影响整体的特征点判断和识别。剔除噪声特征点后的图像如图12所示。

图11 候补定位点图Fig.11 Image of alternate location points

图12 剔除噪声定位点Fig.12 Eliminating of noise location points

2.6 导航基准线拟合

对获取的植株根茎定位点采用最小二乘法进行拟合,获取AGV左右两侧的植株根茎行线,作为导航基准线,提取导航参数。利用夹角的正切公式,设导航基准线的斜率为k,根据k和k1之间的夹角正切值等于k和k2夹角正切值的关系,可计算出导航基准线斜率。如式(5),已知两作物行直线斜率k1、k2后,即可求出两条根茎行线的角平分线。

(5)

以图12为例,实际求得k1=-1.361 0,k2=1.014 7,图13中的虚线即为导航基准线。

图13 导航基准线图Fig.13 Diagram of navigation baseline

3 田间实验及可靠性分析

3.1 实验结果

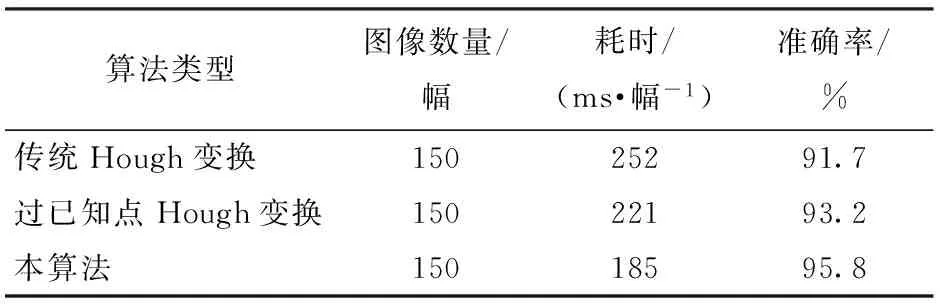

田间实验于2015年7月在河南省鹤壁市浚县玉米示范区进行,大田作物中玉米行距65~80 cm。为判断提取导航基准线的准确性,人工拟合出导航基准线作为衡量基准,以判断该算法提取出的导航基准线的准确率。人工拟合是在农业AGV行走之前,以小车出发点为坐标原点,现场建立人工坐标系,测量行间的玉米根茎坐标,并计算出斜率,最后解算出基准线方程,从而得到人工拟合的导航基准线。人工拟合的导航基准线与农业AGV前进方向之间的夹角为导航角,该导航角大小用以衡量机器视觉算法获取导航基准线的准确率。实验当天为阴天,玉米行间部分地段存在少量低矮杂草,光线较暗。小车以0.8 m/s速度行驶,每隔2 s提取一帧图像,共采集150帧图像,此时小车行走约245 m。为分析小型农业AGV拍摄的图像处理效果,提取小车拍摄的图像。在Matlab 2010b中进行仿真。将本算法分别与传统Hough变换和过已知点Hough算法提取的导航基准线进行比较和分析,结果见表1。

表1 不同算法耗时和准确率比较Tab.1 Comparison of time-consuming and accuracy for different algorithms

由于经传统Hough变换转换后的坐标参数ρ和θ是对全局的图像进行检索,信息量较大,因此耗时较长。过已知点的Hough变换需按行对图像划分水平带,寻找玉米根茎定位点,增加了循环次数,处理时间也相对偏长。而且过已知点Hough变换需要人工选择合适的已知点,实时性较差。此外,由于玉米植株根茎的离散生长,在使用Hough变换拟合前,通过Meanshift法对作物行进行边缘检测,虽然更好地解决了玉米植株间隙大、光照不均等问题,但导航精度下降。而本算法主要通过识别玉米根茎定位点对玉米植株进行定位,具有计算量小、定位精度高的优势。同时将提取的导航参数与上位机建立通信,对其进行处理。

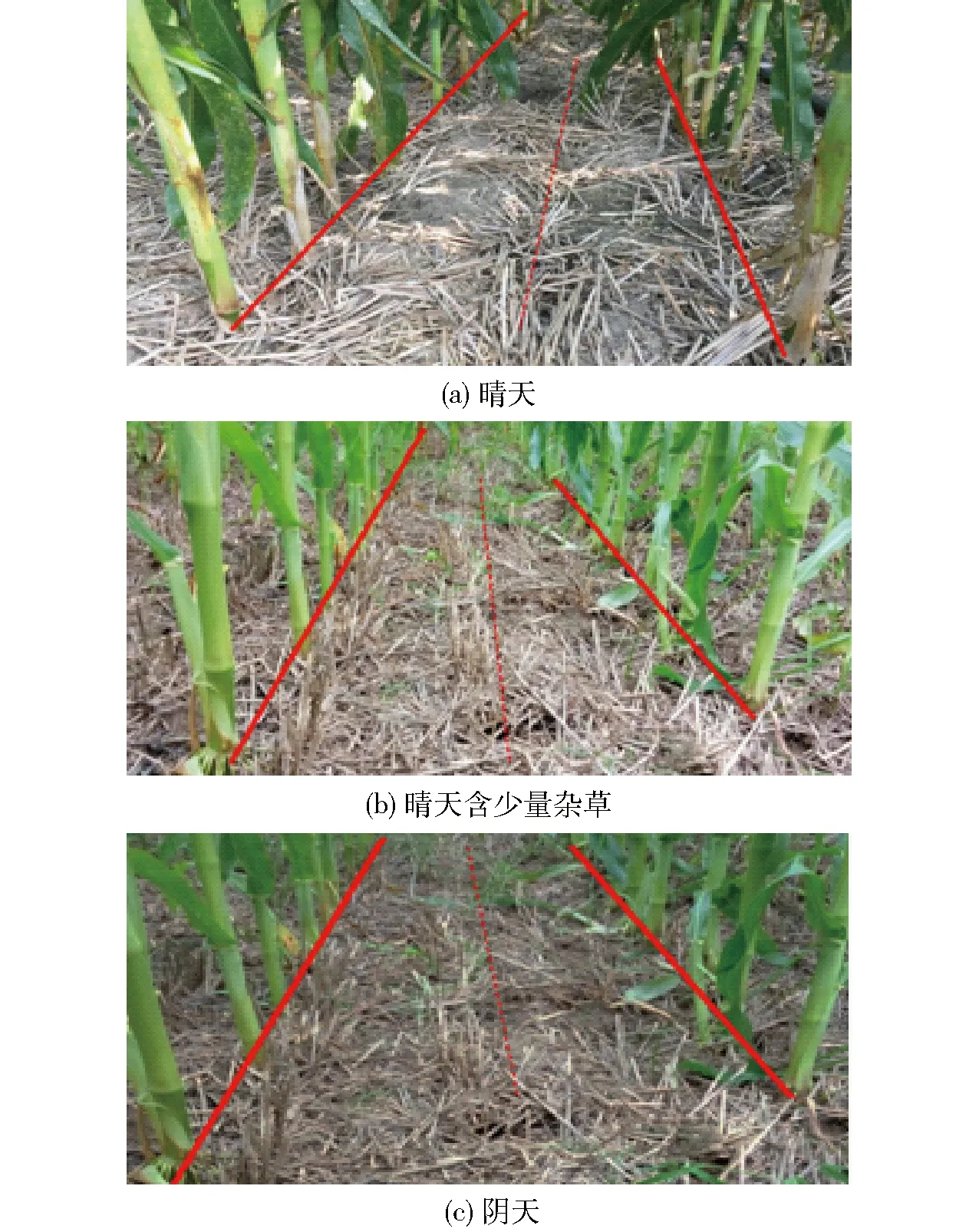

3.2 不同环境下的可靠性分析

为判断该算法在不同环境下的可靠性,分析不同场景下提取导航中心线的耗时和准确率。分别在3种不同环境下采集若干数量的图片,在Matlab中进行仿真分析,以上文提到的人工拟合导航线为基准,判别仿真的准确率。3种环境条件分为:晴天条件,叶片较多;晴天条件,存在少量杂草;阴天条件,叶片较少。

通过表2可知,该算法可以适应玉米田间多种情况下的导航中心线提取,且图像处理平均耗时为200 ms左右,当玉米行间存在较少量杂草的情况下,准确率可达90%,为小型农业AGV在大田玉米环境中的自主导航提供了一种综合性能较好的导航方法。

图14 不同环境下导航中心线Fig.14 Navigation centerline in different environments

环境条件图像数量/幅平均耗时/(ms·幅-1)准确率/%晴天3019791.3晴天含少量杂草3020990.4阴天3018992.9

4 结论

(1)对传统的超绿特征算法中的G值系数先求样本平均值,可实时地将玉米植株根茎部绿色特征提取出来,提高了算法的鲁棒性。

(2)基于垂直投影图,找出玉米根茎峰值点,仅对峰值点数据进行筛选处理,可准确提取出玉米根茎定位点,并剔除大块的玉米叶片噪声的影响,降低了运算量,缩短了运行时间。

(3)采用基于已知点的最小二乘法拟合提取作物行特征点,减少了计算量和占用内存,不仅提高了实时性,而且降低了算法的复杂度。

(4)相对基于玉米垄沟特征提取基准线的方法,省去了作物行边界提取等步骤,本算法简单易行。另外针对不同场景条件,具有较好的鲁棒性,导航基准线准确率和耗时都处于优势地位。

1 WILLRODT F L. Steering attachment for tractors: US, 1,506,706[P]. 1924-08-26.

2 REID J, SEARCY S. Vision-based guidance of an agriculture tractor[J]. IEEE Control Systems Magazine,1987,7(2):39-43.

3 FEHR B W, GERRISH J B. Vision-guided row-crop follower[J]. Applied Engineering in Agriculture, 1995,11(4):613-620.

4 刘阳,高国琴.农业机械视觉导航基准线识别研究进展[J].农机化研究,2015,37(5):7-13. LIU Yang, GAO Guoqin. Research development of vision-based guidance directrix recognition for agriculture vehicles[J]. Journal of Agricultural Mechanization Research,2015,37(5):7-13. (in Chinese)

5 陈艳,张漫,马文强,等.基于GPS和机器视觉的组合导航定位方法[J].农业工程学报,2011,27(3):126-130. CHEN Yan, ZHANG Man, MA Wenqiang, et al. Positioning method of integrated navigation based on GPS and machine vision[J]. Transactions of the CSAE, 2011,27(3):126-130. (in Chinese)

6 张红霞.基于机器视觉的旱田多目标直线检测方法的研究[D].北京:中国农业大学,2007.

7 MONTALVO M, PAJARES G, GUERRERO J M, et al. Automatic detection of crop rows in maize fields with high weeds pressure[J]. Expert Systems with Applications, 2012, 39(15): 11889-11897.

8 MORIMOTO E, SUGURI M, UMEDA M. Vision-based navigation system for autonomous transportation vehicle[J]. Precision Agriculture, 2005, 6(3): 239-254.

10 BAKKER T, WOUTERS H, VAN ASSELT K, et al. A vision based row detection system for sugar beet[J]. Computers and Electronics in Agriculture, 2008, 60(1): 87-95.

11 刘占.基于双目视觉的农田路径导航信息获取研究[D].呼和浩特:内蒙古大学,2014.

12 刁智华,赵明珍,宋寅卯,等.基于机器视觉的玉米精准施药系统作物行识别算法及系统实现[J].农业工程学报,2015,31(7):47-52. DIAO Zhihua, ZHAO Mingzhen, SONG Yinmao, et al. Crop line recognition algorithm and realization in precision pesticide system based on machine vision[J]. Transactions of the CSAE, 2015,31(7):47-52. (in Chinese)

13 金海龙,喻擎苍,周志宇,等.基于Meanshift和Hough变换的秧苗行中心线提取[J].浙江理工大学学报,2015,33(3):405-409. JIN Hailong, YU Qingcang, ZHOU Zhiyu, et al. Extraction of center line of rice seedling row based on Meanshift and Hough transform[J]. Journal of Zhejiang Sci-Tech University, 2015,33(3):405-409. (in Chinese)

14 马红霞,马明建,马娜,等.基于Hough变换的农业机械视觉导航基准线识别[J].农机化研究,2013,35(4):37-39,43. MA Hongxia, MA Mingjian, MA Na, et al. Baseline recognition based on Hough transform in the vision navigation of agricultural vehicles[J]. Journal of Agricultural Mechanization Research,2013,35(4):37-39,43. (in Chinese)

15 赵颖,陈兵旗,王书茂,等.基于机器视觉的耕作机器人行走目标直线检测[J].农业机械学报,2006,37(4):83-86. ZHAO Ying, CHEN Bingqi, WANG Shumao, et al. Fast detection of furrows based on machine vision on autonomous mobile robot[J]. Transactions of the Chinese Society for Agricultural Machinery, 2006,37(4):83-86. (in Chinese)

16 张磊,王书茂,陈兵旗,等.基于机器视觉的麦田边界检测[J].农业机械学报,2007,38(2):111-114. ZHANG Lei, WANG Shumao, CHEN Bingqi, et al. Edge detection for wheat field based on machine vision[J]. Transactions of the Chinese Society for Agricultural Machinery, 2007,38(2):111-114. (in Chinese)

17 马红霞.基于机器视觉的农业车辆导航基准线提取方法的研究[D].淄博:山东理工大学,2012.

18 冯娟,刘刚,司永胜,等.果园视觉导航基准线生成算法[J/OL].农业机械学报,2012,43(7):185-189,184. http:∥www.j-csam.org/jcsam/ch/reader/view_abstract.aspx?file_no=20120734&flag=1. DOI:10.6041/j.issn.1000-1298.2012.07.034. FENG Juan, LIU Gang, SI Yongsheng, et al. Algorithm based on image processing technology to generate navigation directrix in orchard[J/OL]. Transactions of the Chinese Society for Agricultural Machinery, 2012,43(7):185-189,184. (in Chinese)

19 王明昕, 赵东标, 邵泽明. CCD摄像机内外参数标定技术研究[J]. 机械与电子, 2004, 22(3):12-14. WANG Mingxin, ZHAO Dongbiao, SHAO Zeming. Research of calibration technology of intrinsic and extrinsic parameters of CCD camera[J]. Machinery & Electronics, 2004, 22(3):12-14. (in Chinese)

20 WOEBBECKE D M, MEYER G E, VON BARGEN K, et al. Color indices for weed identification under various soil, residue, and lighting conditions[J]. Transactions of the ASAE, 1995, 38(1):259-269.

21 MONTALVO M, PAJARES G, GUERRERO J M, et al. Automatic detection of crop rows in maize fields with high weeds pressure[J]. Expert Systems with Applications, 2012,39(15):11889-11897.

22 刘钢钦,晏明辉.二值图象邻域寻找的一种快速方法[J].计算机应用与软件,1997,14(5):32-36. LIU Gangqin, YAN Minghui. Neighbor finding techniques for binary image[J]. Computer Applications and Software,1997,14(5):32-36. (in Chinese)

Extraction Method of Navigation Baseline of Corn Roots Based on Machine Vision

SONG Yu1LIU Yongbo1LIU Lu2ZHU Dequan1JIAO Jun1CHEN Liqing1

(1.SchoolofEngineering,AnhuiAgriculturalUniversity,Hefei230036,China2.SchoolofEngineeringScience,UniversityofScienceandTechnologyofChina,Hefei230026,China)

In order to achieve small agricultural automated guided vehicle (AGV) which could navigate autonomously between corn rows, a method was proposed which could quickly and accurately extract the centerlines of middle-late corn rows as the innovative methods of navigation baseline of agricultural robot in field environment. The algorithm was improved by the traditional 2G-R-Balgorithm so that it could obtain the characteristics of green plants in real-time and also improve the robustness of image pre-processing. According to the vertical projection of corn crop’s line, points of profile features of corn roots were generated. Using the detection algorithm of peak points, the backup location points of corn roots were obtained and then the location points of corn roots were got after the second judgment and detection. The least square method was used for fitting the location points of corn roots and two lines of crop rows were generated. The actual navigation baseline was calculated based on the formula angle bisector after the line slopes of two crop rows were generated respectively. In addition, the camera calibration process was simplified so that the image pixel coordinates could be converted into world coordinates quickly. The extracted angle and lateral deviation of navigation baselines were used as input parameters of navigation to control agriculture AGV. The experimental results showed that the method had strong robustness which could adapt to different environments and the accuracy of navigation baselines by detecting was more than 90%. The average processing time of a 700 pixels × 350 pixels color image was less than 185 ms which had a better real-time. The results provided a reliable reference method for autonomous navigation of the agricultural AGV in middle-late corn field.

agricultural AGV; machine vision; navigation baseline; detection of peak points; corn root

10.6041/j.issn.1000-1298.2017.02.005

2016-03-15

2016-05-12

国家自然科学基金项目(31671589)、农业部公益性行业专项(201503136-2)、安徽省科技攻关计划项目(1501031104)、安徽省教育厅自然科学研究重点项目(KJ2013A107)、安徽农业大学稳定和引进人才基金项目(WD2013-11)和安徽农业大学学科骨干培育项目(2014XKPY-49)

宋宇(1971—),男,副教授,主要从事作物生产智能技术与装备研究,E-mail: songyu@ahau.edu.cn

S224.3

A

1000-1298(2017)02-0038-07