基于RBF神经网络的集成增量学习算法

2016-07-19彭玉青赵翠翠高晴晴

彭玉青 赵翠翠 高晴晴

(河北工业大学计算机科学与软件学院 天津 300401)

基于RBF神经网络的集成增量学习算法

彭玉青赵翠翠高晴晴

(河北工业大学计算机科学与软件学院天津 300401)

摘要针对增量学习的遗忘性问题和集成增量学习的网络增长过快问题,提出基于径向基神经网络(RBF)的集成增量学习方法。为了避免网络的遗忘性,每次学习新类别知识时都训练一个RBF神经网络,把新训练的RBF神经网络加入到集成系统中,从而组建成一个大的神经网络系统。分别采用最近中心法、最大概率法、最近中心与最大概率相结合的方法进行确定获胜子网络,最终结果由获胜子网络进行输出。在最大概率法中引入自组织映(SOM)的原型向量来解决类中心相近问题。为了验证网络的增量学习,用UCI 机器学习库中Statlog(Landsat Satellite)数据集做实验,结果显示该网络在学习新类别知识后,既获得了新类别的知识也没有遗忘已学知识。

关键词RBFSOM增量学习

0引言

传统神经网络只能进行一次学习,不能在第一次学习的基础上实现二次学习。现实生活中不可能一次性获得所有的神经网络训练数据,所以很多学者提出了增量学习的神经网络。但是设计增量学习网络必须要面对网络的稳定性和可塑性这个难题[1]。所谓稳定性就是为了记住已学过的知识,网络结构和参数不能发生改变;可塑性就是为了学习新的知识,要对已有网络的结构和参数进行调整,不能完全保持网络结构和参数不变。但是网络结构和参数一旦发生改变,网络就会产生遗忘性,这样的增量学习网络是没有意义的,所以要实现增量学习就必须建立在稳定性的基础之上。

神经网络集成就是保持稳定性和可塑性之间很好的折中方法。Learn++算法[2]和负相关算法[3]都是神经网络集成的增量学习算法。通过对新知识的学习产生多个弱分类器,加入到增量学习系统中。这种网络能够很好地保留已学知识,但是网络增长的速度非常快,使得网络过于庞大,不具有实用性。虽然有些学者又提出了选择性负相关的增量学习[4],但是在进行网络选择的过程中,会使得网络产生一定的遗忘性。

RBF神经网络和模糊规则相结合的增量学习[5,6],通过规则增长条件判断是否增加RBF的核函数来进行增量学习。选用高斯函数作为RBF的核函数,该函数能够对输入矢量产生局部响应,输出节点对隐层节点的输出进行线性加权,从而实现输入空间到输出空间的映射,使整个网络达到分类和函数逼近的目的[7]。但是这种增量学习网络在学习的过程中会修改已学规则的参数,从而产生遗忘性。

自组织映射与概率神经网络相结合的增量学习网络(IMSOMPNN)[13],通过SOM对每一个类别的训练数据进行学习并得到原型向量,用原型向量构建PNN。这种增量学习在没有遗忘已学知识的前提下实现了增量学习。但是IMSOMPNN每次只能学习一个类别的知识,不能实现知识的多类别学习,会使得网络的学习过于繁琐。

针对以上问题本文提出了基于RBF集成增量的学习方法。当新知识到来时通过RBF神经网络进行学习,在RBF神经网络学习的过程中,采用k-均值聚类算法找中心和相应的宽度,用伪逆法[8]求子网络权值和偏置权值,将得到的子网络加入到神经网络集成系统中,通过最近中心确定获胜子网络,最终结果由获胜子网络输出。

由于RBF神经网络学习不能去除噪声数据,也不能包含所有的特征信息,所以本文又提出了RBF与SOM相结合的集成增量学习方法。与上述方法不同之处在于:该方法采用SOM对子网络的训练数据进行学习,子网络的训练数据有可能是一个类别的训练数据,也可能是多个类别的训练数据。用SOM训练后的原型向量构建概率神经网络,用于求出每个子网络的最大概率,通过最大概率准则确定获胜子网络,而不是通过最近中心确定获胜子网络。

结合以上两种方法,本文又提出了最近中心与最大概率相结合的方法来确定获胜子网络。最后分别采用这三种方法进行实验。实验结果表明了这三种集成的增量学习方法没有改变已学知识的子网络结构和参数,不会对已学知识产生遗忘性,所以本文提出的增量学习网络可以在对已学知识不产生遗忘的基础上,进行增量学习,而且增量学习后的网络识别率很高;与其他集成增量学习相比,本文的方法每次增量学习只增加一个子网络,避免了网络系统过于庞大的问题;每次增量学习可以实现多类别知识的学习,避免了逐个类别知识学习的繁琐性。

1网络结构

如图1所示本网络分为四层。第一层为网络输入层,输入为xi(i=1,2,…,n)。第二层为核函数层,本网络采用高斯函数作为核函数,核函数为:

(1)

(2)

图1 RBF增量学习网络结构图

第三层为子网络输出层,期望输出公式为:

(3)

第四层为集成系统的输出,输出公式为:

(4)

其中,bj为第j个子网络与系统输出之间的输出权值,j的取值为:j=1,…,u,y为集成系统的总输出。

2增量学习过程

本文的RBF神经网络采用K-均值聚类算法得到中心,用伪逆法求得权值和偏置。分别用最近中心法、最大概率法、最近中心与最大概率相结合的方法确定获胜子网络。获胜子网络的输出权值为1,非获胜子网络的输出权值为0,网络的最终结果由获胜子网络进行输出。最大概率法中用SOM已学过的原型向量通过PNN(概率神经网络)得到子网络的最大概率。

本文每次增量学习只增加一个子网络,避免了网络系统过于庞大的问题;每次增量学习可以实现多类别知识的学习,避免了逐个类别知识学习的繁琐性。

2.1K-均值算法选取网络中心

K-均值聚类算法[9,10]是一种模式聚类算法,聚类分析是根据数据空间的内在性质将其分成一些聚合类,它是在不对数据作任何假设的条件下进行的,是完全非监督的学习过程。其原理是首先初始化中心,中心的个数主观确定。然后将输入样本按最邻近规则分组。

假设初始中心的个数为m,即将xi(i=1,2,…,n)按最邻近规则分配给中心m个初始中心,得到m个输入样本聚类集合θk(k=1,…,m)。要求满足:

(5)

中心确定以后,相应的计算宽度σk,本文的宽度为:

σk=λ×dk

(6)

经过多次实验,本文取λ为2。

2.2伪逆求子网络的权值和偏置

在中心和宽度已知的情况下,用伪逆法可直接求解核函数层与子网络输出层的输出权值和偏置权值。

用k-均值聚类法计算出中心并求出相应的宽度,根据中心和宽度求出核函数层输出矩阵R。由于加了一个偏置神经元,并且偏置神经元的取值为1,所以要扩展核函数输出矩阵为:

(7)

其中,G比R增加了一维偏置神经元的输出,期望输出矩阵D,权值矩阵W的输出公式为:

W=DG+

(8)

其中G+为G的伪逆:

G+=(GTG)GT

(9)

2.3确定获胜子网络

本文采用三种方法确定获胜子网络,分别是用最近中心确定获胜子网络、最大概率确定获胜子网络、最近中心与最大概率相结合的方法确定获胜子网络。

2.3.1最近中心确定获胜子网络

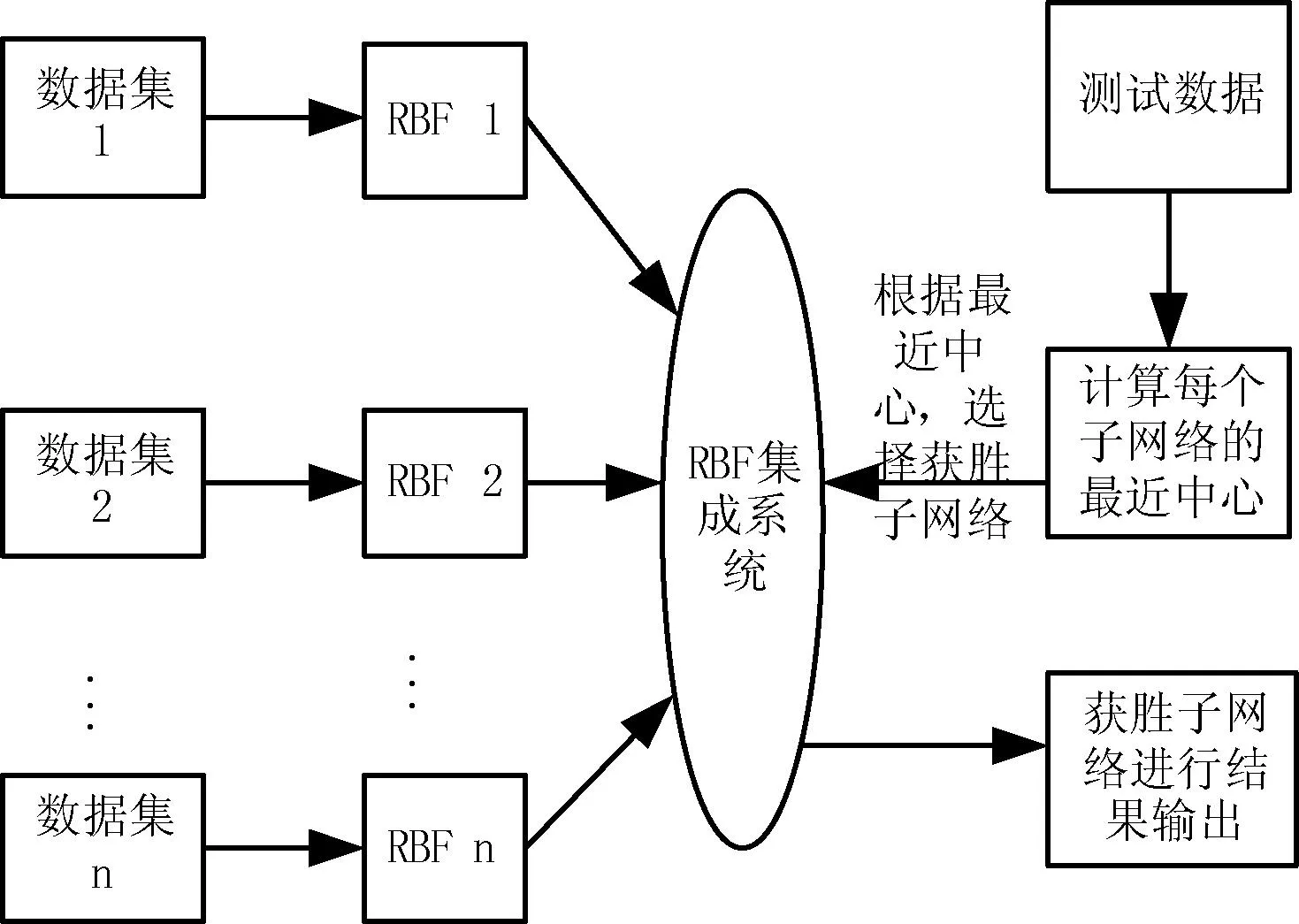

RBF是一种局部分布的、中心对称衰减的非负非线性函数[11]。局部分布是指仅当输入落在输入空间一个很小的指定区域时,隐单元的径向基函数才做出有意义的非零响应。中心径向对称衰减是指与基函数中心径向距离相同的输入,隐节点中的径向基函数都产生相同的输出[12]。并且输入与RBF的中心越近,核函数的响应越大,所以本论文中子网络与集成系统输出之间的权值由测试数据与RBF的最近中心决定,所谓最近中心就是指输入数据与RBF所有中心的径向距离中最小的一个中心。图2为最近中心确定获胜子网络增量学习方法。

图2 最近中心法确定获胜子网络方法

具体算法如下:

(1) 计算测试数据与网络集成中心的径向距离,找出径向距离最小的中心,即为最近中心。

(2) 判断最近中心所属子网络,即为获胜子网络;获胜子网络的输出权值为1,非获胜子网络的输出权值为0。

RBF训练过程中不能去除噪声数据,而且网络的中心个数是有限的,如果中心太多RBF的训练会出现过拟合现象。由于RBF中心个数的限制,每个中心都包含了一部分特征信息,导致网络中心不能完全包含所有的特征信息。如果两个子网络的训练数据特别相似,就会出现部分中心相似性,当用最近中心确定获胜子网时,很有可能选错子网络。而通过SOM学习得到的原型向量包含了训练数据更多的特征信息,同时也会去除噪声数据,所以本文考虑采用SOM的原型向量进一步确定获胜子网络。

2.3.2最大概率确定获胜子网络

SOM是无导师学习的方法,具有良好的自组织能力。通过SOM学习可以去除含有噪声的特征数据,得到更为紧凑的原型向量,并且原型向量的维数和输入数据的维数相同,用得到的原型向量来构建PNN。SOM[12,13]训练时,采用批量处理的训练方式,邻域函数为高斯函数。

具体算法如下:

(2) 根据划分到Voronoi区域Vj中的样本个数nj,计算这些样本的均值,公式如下:

(10)

其中,xp∈Vj,1≤p≤nj。

(3) 更新原型向量:

(11)

其中,hjk(t)为邻域函数,hjk(t)依赖于获胜神经元k和兴奋神经元j在输出空间的侧向距离,本文中邻域函数为高斯函数。

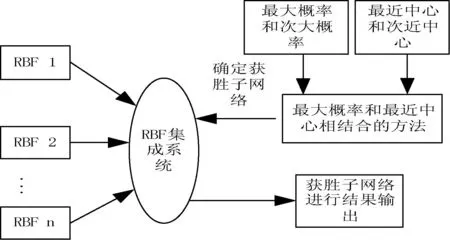

由于k-均值聚类法没有对训练数据进行去除噪声,不同网络的相似性高的训练数据会得到相似的中心,从而在选择获胜子网络时发生错误,所以增加了子网络的最大概率这个判定条件,图3为最大概率确定获胜网络的整体增量学习过程图。

图3 增量学习过程

最大概率确定获胜子网络具体算法如下:

(12)

p(x|ωj)=max(pl(x|ωj))

(13)

式中,第j个子网络的概率p(x|ωj)为pl(x|ωj)中最大的一个。其中δ为平滑因子,公式如下:

(14)

其中‖χu,l-χu,j‖为两个原型向量的径向距离。

2.3.3最近中心与最大概率确定获胜子网络

经过多次的实验发现,最近中心和次近中心如果属于同一个子网络,那么仅根据最近中心确定的获胜子网络输出的结果正确率很高,所谓最近中心就是指输入数据与RBF所有中心的径向距离中最小的一个中心,输入数据与RBF所有中心的径向距离中第二小的中心为次近中心;如果最近中心和次近中心所属的子网络不同,那么仅根据最近中心确定的获胜子网络对结果的输出,有少部分会出现错误。这就说明当最近中心和次近中心所属子网络不同时,它们所属的子网络都有可能为真正的获胜子网络,仅凭借最近中心确定的获胜的正确率显然要低。

最大概率法确定获胜子网络也存在上述问题,所以想结合以上两种方法来解决该问题。本文又提出了最近中心与最大概率相结合的方法来确定获胜子网络。

该方法的主要思想是:如果最近中心和次近中心所属的子网络是同一个网络,那么它们所在的网络为获胜子网络;如果最近中心和次近中心的所属的网络不同,并且最近中心所在子网络的最大概率大于次近中心所在网络的最大概率,那么最近中心所在子网络为获胜子网络;如果最近中心和次近中心所属子网络不同,而且最近中心所在子网络的最大概率小于次近中心所在网络的最大概率,就要考虑最近中心和次近中心距离了,假设最近中心、次近中心的径向距离分别为d1和d2,并且d1≤d2,离中心越近,核函数的响应越大,所以d1/(d1+d2)的取值越小,代表最近中心的重要性越大。最近中心和次近中心所在子网的最大概率为pj和pg,j=1,2,…,u;g=1,2,…,u,图4为最近中心与最大概率确定获胜子网络方法。

图4 最近中心与最大概率确定获胜子网络方法

具体算法如下:

(1) 计算出测试数据与最近中心、次近中心的径向距离d1和d2,并用PNN求出最近中心和次近中心所在子网络的最大概率pj和pg。

(2) 如果最近中心和次近中心属于相同的网络,则最近中心和次近中心所在的网络为获胜子网络,输出权值为1;其他网络为非获胜子网络,输出权值为0。

(3) 如果最近中心和次近中心属于不同的网络yj和yg,pj大于等于pg,则yj为获胜子网,输出权值为1;其他网络为非获胜子网络,输出权值为0。

(4) 如果最近中心和次近中心属于不同的子网络yj和yg,pj小于pg,d1/(d1+d2)大于阈值T,则yg为获胜子网络,输出权值为1;其他网络为非获胜子网络,输出权值为0。

(5) 如果最近中心和次近中心属于不同的子网络yj和yg,pj小于pg,d1/(d1+d2)小于阈值T,则yj为获胜子网络,输出权值为1;其他网络为非获胜子网络,输出权值为0。

3实验结果分析

本文采用自组织映射与概率神经网络的增量式学习算法(IMSOMPNN)的实验数据[13]。该实验数据为UCI机器学习库中Statlog(LandsatSatellite)数据集。该数据集共有36个属性,6个类别 ,6435个样本,其中4435个是训练样本,2000个为测试样本。T1∪T2∪…∪T6,分别代表6个类别的训练数据,6个类别的测试数据为E1∪E2∪…∪E6。

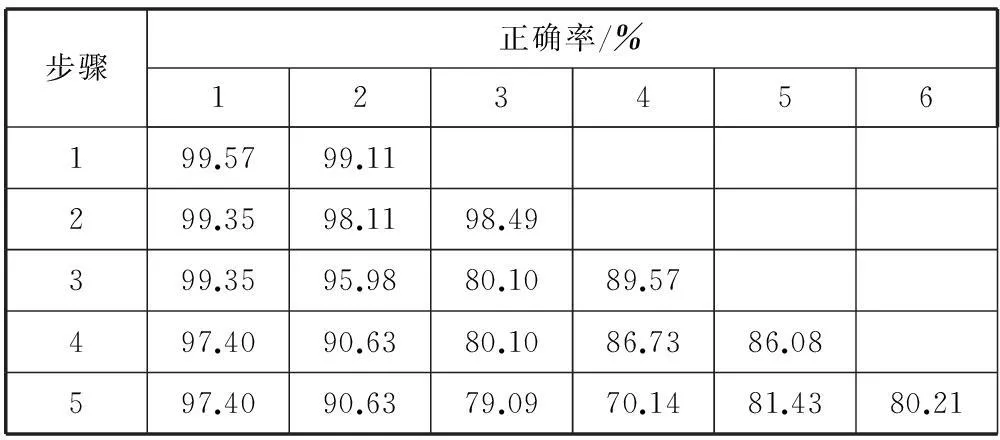

3.1最近中心确定获胜子网络的单类别增量学习

首先使用T1∪T2来训练一个初始的RBF网络集成系统,然后使用E1∪E2来对模型进行测试;在第t步(2≤t≤5)时,用Tt+1训练一个RBF网络,并把新训练的RBF加入到RBF集成系统中,然后使用E1∪E2∪…∪Et+1测试模型。表1为最近中心确定获胜子网络的单类别增量学习结果。

表1 最近中心确定获胜子网络的增量学习

3.2最大概率确定获胜子网络的单类别增量学习

首先使用T1∪T2来训练一个初始的RBF网络集成系统,训练一个SOM神经网络,从而得到SOM的原型向量。然后使用E1∪E2来对模型进行测试;在第t步(2≤t≤5)时,用Tt+1训练一个RBF网络和一个SOM,并把新训练的RBF加入到RBF集成系统中,把新的SOM原型向量加入到神经网络集成系统中,然后使用E1∪E2∪…∪Et+1测试模型。如表2所示。

表2 最大概率确定获胜子网络的单类别增量学习

3.3最近中心与最大概率确定获胜子网络的单类别增量学习

首先使用T1∪T2来训练一个初始的RBF网络集成系统,训练一个SOM神经网络,从而得到SOM的原型向量。然后使用E1∪E2来对模型进行测试;在第t步(2≤t≤5)时,用Tt+1训练一个RBF网络和一个SOM,并把新训练的RBF加入到RBF集成系统中,把新的SOM原型向量加入到神经网络集成系统中,然后使用E1∪E2∪…∪Et+1测试模型。表3为最近中心与最大概率确定获胜子网络的单类别增量学习结果。

表3 最近中心与最大概率确定获胜子网络的单类别增量学习

3.4IMSOMPNN

首先,使用T1∪T2来训练一个初始的IMSOMPNN,然后使用E1∪E2来对模型行进行测试;在第t步2≤t≤5时,将Tt+1提交至IMSOMPNN进行增量学习,然后使用E1∪E2∪…∪Et+1测试模型。表4给出了增量学习的每一步中,模型分类性能的变化。表4为自组织映射与概率神经网络相结合的单类别增量学习结果。

表4 自组织映射与概率神经网络相结合的增量学习

3.5最大概率确定获胜子网络的多类别增量学习

为了体现每次增量学习可以实现多个类别的学习,本次实验第一步使用T1∪T2训练一个初始的RBF网络集成系统和SOM,然后使用E1∪E2来对模型进行测试;第二步使用T3训练一个RBF和SOM,并把新训练的RBF加入RBF网络集成系统中,用E3对模型进行测试;第三步使用T4∪T5训练一个RBF和SOM,并把新训练的RBF加入到RBF集成系统中,用E4∪E5对模型进行测试;第四步使用T6训练一个RBF和SOM,并把新训练的RBF加入到RBF集成系统中,用E6对模型进行测试。表5为最大概率确定获胜子网络的多类别增量学习结果。

表5 最大概率确定获胜子网络的多类别增量学习

3.6实验分析

图6为四种方法的性能对比图。从结果和性能对比图上可以看出最近中心确定获胜子网络的性能比较低,其他三种方法的性能相差不多,都没有遗忘已学知识,同时也可以学习新类别的知识,每次增量学习只增加一个子网络,避免了网络系统过于庞大的问题。

图6 单类别学习性能对比图

IMSOMPNN对六类知识学习需要学习六次,也就是每次只能学习一个类别的知识,不能进行多个类别知识的学习,会使得学习过程很繁琐,不具有实用性。多类别增量学习实验证实了该网络可以进行多个类别的增量学习,表5给出了实验结果。通过实验表明了本文的方法既可以单个类别的增量学习,也可以进行多类别的增量学习,即在第3步增量学习中,同时学习了类别4和类别5的知识,这是IMSOMPNN所不能实现的,在现实生活中多类别的增量学习更具有使用价值。

从以上实验可知,本文方法每次增量学习只增加了一个子网络,避免了网络系统过于庞大的问题,同时在保证性能基本不变的基础上实现了多个类别的学习,具有实用意义。

4结语

本文提出了一种基于RBF的集成增量学习的神经网络。这种增量学习模型主要是通过最近中心法、最大概率法以及以上两种方法相结合的方法来决定获胜子网络,通过获胜网络进而得到最终输出。这种增量学习系统是建立在系统稳定的基础上进行增量学习的,所以对已学知识没有遗忘,同时避免了逐个类别训练的繁琐性和网络系统过于庞大的问题。该算法通过确定获胜子网络的方法进行确定获胜子网络,最终结果由获胜子网络进行输出。获胜子网络中可能包含单类别信息,也可能包含多个类别的信息,从而既可以实现单类别增量学习,也可以实现多个类别的增量学习,通过实验论证了该方法的有效性。

参考文献

[1]GrossbergS.Nonlinearneuralnetworks:Principles,mechanismsandarchitectures[J].NeuralNetworks,1988,1(1):17-61.

[2]PolikarR,UpdaL,UpdaSS,etal.Learn++:Anincrementallearningalgorithmforsupervisedneuralnetworks[J].Systems,Man,andCybernetics,PartC:ApplicationsandReviews,IEEETransactionson,2001,31(4):497-508.

[3]MinkuFL,InoueH,YaoX.Negativecorrelationinincrementallearning[J].NaturalComputing,2009,8(2):289-320.

[4] 林民龙.基于神经网络集成的增量式学习[D].中国科学技术大学,2012.

[5]WangN,ErMJ,MengX.Afastandaccurateonlineself-organizingschemeforparsimoniousfuzzyneuralnetworks[J].Neurocomputing,2009,72(16):3818-3829.

[6] 胡蓉,徐蔚鸿,甘岚.一种连续增量学习模糊神经网络[J].模式识别与人工智能,2013,26(8):794-799.

[7] 夏长亮,王明超.基于RBF神经网络的开关磁阻电机单神经元PID控制[J].中国电机工程学报,2005,25(15):161-165.

[8] 邓继雄,李志舜,梁红.确定RBF神经网络参数的新方法[J].微处理机,2006,27(4):48-49.

[9] 刘小华,刘沛,张步涵,等.逐级均值聚类算法的RBFN模型在负荷预测中的应用[J].中国电机工程学报,2004,24(2):17-21.

[10] 李鑫滨,杨景明,丁喜峰.基于递推k-均值聚类算法的RBF神经网络及其在系统辨识中的应用[J].燕山大学学报,1999,23(4):363-366.

[11] 王永骥,涂健.神经元网络控制[M].北京:机械工业出版社,1998:68.

[12]YuDJ,ShenHB,YangJY.SOMPNN:anefficientnon-parametricmodelforpredictingtransmembranehelices[J].Aminoacids,2012,42(6):2195-2205.

[13] 戚湧,胡俊,於东军.基于自组织映射与概率神经网络的增量式学习算法[J].南京理工大学学报:自然科学版,2013(1):1-6.

RESEARCH ON RBF NEURAL NETWORK-BASED ENSEMBLE INCREMENTALLEARNINGALGORITHM

Peng YuqingZhao CuicuiGao Qingqing

(School of Computer Science and Engineering,Hebei University of Technology,Tianjin 300401,China)

AbstractAiming at the forgetfulness problem of incremental learning and the excessive network growth problem of the integrated incremental learning, this paper proposes an integrated incremental learning method which is based on the radial basis function (RBF) neural network. In order to avoid the forgetfulness of the network, for each knowledge learning of new category we all trained an RBF neural network, and added the newly trained RBF neural network to the integrated system so as to form a large system of neural networks. To determine the winning sub-network, we adopted the nearest centre method, the maximum probability method and the combination of these two methods, and the final result was outputted by the winning sub-network. Moreover, we introduced the prototype vectors of self-organising map to maximum probability method for solving the problem of class centre similarity. For verifying the proposed network incremental learning, we made the experiments using the Statlog (Landsat Satellite) dataset in UCI machine learning library. Experimental results showed that after learning the knowledge of new category, this network could accept the new without forgetting the learned knowledge.

KeywordsRBFSOMIncremental learning

收稿日期:2015-01-13。国家自然科学基金项目(51175145);天津市自然科学基金项目(13JCYBJC15400);河北省高等学校科学技术研究项目(ZD2014030)。彭玉青,教授,主研领域:计算机视觉,数据库,智能信息处理。赵翠翠,硕士生。高晴晴,硕士生。

中图分类号TP183

文献标识码A

DOI:10.3969/j.issn.1000-386x.2016.06.059