基于多类别特征信息融合的车牌检测

2015-12-20牛常勇

张 勇,宁 蒙,牛常勇

(郑州大学 信息工程学院,河南 郑州450001)

0 引 言

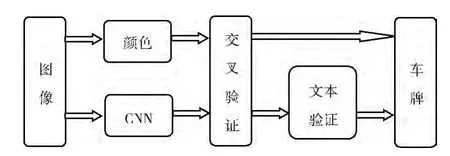

当前车牌检测方法[1,2]可分为以下两类:第一类是基于人工设计特征提取,如颜色特征、边缘特征、对称性、文本[3-5]等。基于文本分析的gabor滤波器、小波变换、哈夫变换等被广泛应用于车牌检测中。第二类是基于机器学习特征提取,包括神经网络 (NN)、Adaboost[6,7]等。人工设计特征方法简单易于实现和理解,在某一受限场景下可以达到很好的检测效果,但是这些特征过于单一且鲁棒性差。基于学习特征的方法克服了这些局限,丰富的特征空间使得这些算法具有很强的鲁棒性。然而有限的训练样本和冗余的特征空间,使得这些算法有较高的误警率和训练集依赖度。通过借助不同类特征提取克服机器学习算法对训练集的依赖度,降低漏检率提高场景鲁棒性,同时结合信息融合技术降低整体误警率。系统由CNN 模块、颜色检测模块、交叉验证模块和文本验证模块4大模块组成。在两种不同场景测试集上测试均取得不错的效果,同比另外两种算法有较大程度的提升。实验结果表明多阶段信息融合和多类特征提取对车牌检测算法性能的改善有显著影响。

1 单尺度卷积神经网络

CNN (convolutional neural networks)是一种特殊的深层神经网络模型,它的神经元是非全连接的并且同层神经元可以共享权值。这种网络结构对平移、比例缩放、倾斜和其它形式的变形具有高度的不变性。这些使得卷积神经网络近年来发展成一种高效的分类方法[8]。

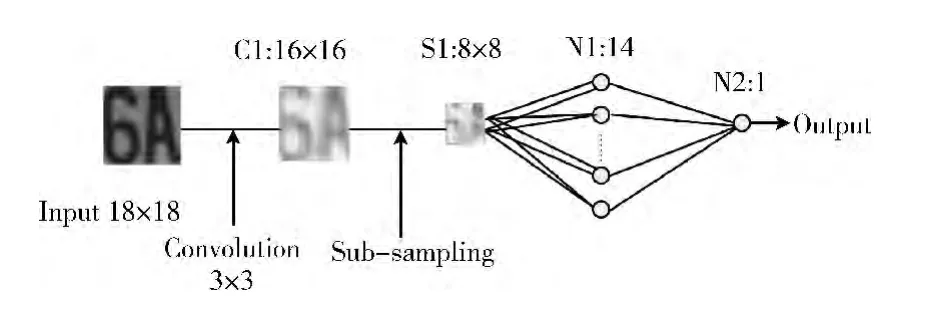

文献 [9]中YingNong Chen使用卷积神经用于检测人脸和车牌。如图1所示网络仅包含一个特征提取阶段和一个全连接分类器,其中特征提取阶段只有一个特征图。共需训练调节937个权值。该算法从文本检测的角度出发解决车牌检测问题,使用两个相邻号牌字符图像作为训练样本。通过训练得到一个二分类卷积网络,基于滑动窗口技术对输入图像进行检测,对网络输出超过阈值的区域标记成候选字符区域,进而融合字符区域得到车牌区域。算法在Hsieh使用的测试集中达98%的检测率。

图1 Chen等人提出的用于车牌检测的网络结构

1.1 单尺度卷积神经网络结构

多阶段单尺度卷积神经网络是逐阶段提取高层特征,然后把最后一个阶段的高层特征输入给分类器。每一个特征提取阶段先后由一个卷积层和子采样层组成。卷积层的输入与前一层的局部接受域相连,并提取该局部的特征。然后经子采样层过滤相邻相似特征,减少前一层特征图的分辨率增强局部特征的不变性。最后将这些局部特征输入给分类器完成分类,这种结构使得网络在识别输入样本时具有较强的鲁棒性。

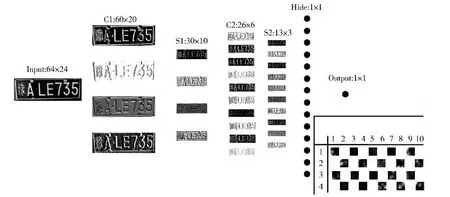

如图2所示:实验CNN 模块是一个由两个特征提取阶段和一个分类器组成的卷积神经网络,输入图像经过两个特征提取阶段逐层提取得到到高层特征表示,然后输入给分类器。其中,第一个特征提取层有卷积层C1和子采样层S1组成,C1中4个特征图分别通过4个尺寸为5×5的卷积核与输入图像相连,S1中的4个特征图通过对应的4个2×2的子采样核与C1中的一个对应特征图相连;第二个特征提取阶段由C2和S2组成,C2层的10个特征图通过连接表1与S1层的4个特征图相连;分类器采用一个两层的全连接神经网络分类器,Hide层的每个特征图通过10个13×3的卷积核分别与S2层每个特征图相连。整个网络共需要训练 [5×5×4+4]+8+ [5×5×20+10]+20+[13×3×10×14+14]+ [14+1]=6131个权值。

图2 训练模型和连接

定义1 C3(i,x,y)为C3层第i个特征图中 (x,y)处坐标点值,则

其中sig (X)=1.7159×tanh (2/3×X),bi是第i个特征图的偏置,gij是连接Hide层第i个神经元与S2层中第j个特征图的卷积核,其中卷积核的尺寸与S2中特征图的尺寸(R=13、C=3)相同。Output把实际输出值大于阈值的点标记响应点,进而反方向投影到输入图像中得到潜在车牌区域。这种检测方式等同于在水平和垂直方向做步长为4像素区域大小为64×24的二分类判定。

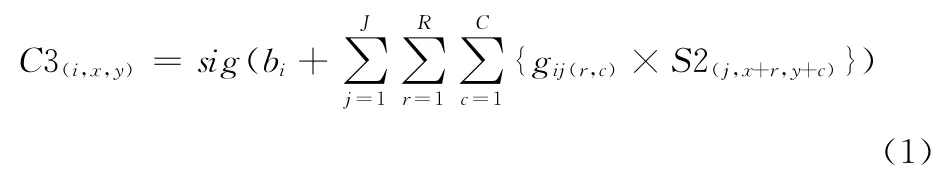

1.2 训练单尺度卷积神经网络

训练样本部分如图3 (a)所示,样本来自自然场景下的车辆图像,通过手工分割提取车牌和非车牌区域,训练集由65856个64×24大小的车牌和非车牌样本组成,1500个车牌和非车牌样本组成验证集[7]。使用灰度化的训练样本图像输入网络,经过预处理归一化到 [-1,1]。采用监督训练,标记车牌样本期望输出为1,非车牌样本期望输出为-1。卷积网络模型通过随机梯度下降的学习算法进行训练,误差函数为最小均方差。学习率曲线如图3 (b)所示,error为错误个数/样本个数。

车牌检测时输入待检测图像的灰度图,通过比例缩放产生图像金字塔。用预训练的分类器基于滑动窗口技术对各层图像进行检测,把实际输出特征图中大于阈值的响应点反向映射到输入图像中得到候选区域。候选区域经过区域融合最终产生车牌候选集。

2 多类别特征信息融合的车牌检测

图3 学习率和样本

CNN 有 着 广 泛 的 应 用 研 究[10,11]。在 文 献 [7]中,CNN 检测器表现着良好的性能。然而,在降低误警率、漏检率和增强不同类型场景下算法的鲁棒性方面,还有很大的改进空间。新算法引入了颜色、文本两种特征信息,如图4所示:颜色信息不仅参与了检测车牌区域同时也借助交叉验证参与了车牌验证。同时验证阶段又加入了文本信息,进一步降低误警率。

图4 车牌检测流程

2.1 颜色检测

利用颜色特征检测车牌的方法[12,13]对车牌的倾斜和变形具有很强的鲁棒性,但是它也存在在一些不足。在光照复杂情况下,通过设定RGB阈值范围来确定车牌区域是非常困难的。作为RGB模型的替代模型HSV 模型减弱了光照的影响,但是却对噪点有着很差的鲁棒性。RGB颜色空间中有红、绿、蓝3个颜色分量。本文利用RGB值间关系来提取车牌候选集。算法如下:

定义变量D=E=F=BW=0,k1=0.3,k2=0.7为:

(1)D(x,y)=B(x,y)-R(x,y),E(x,y)=B(x,y)-G(x,y)

(2)if(D(x,y)>0&&E(x,y)>0)

then F(x,y)=k1D(x,y)+k2E(x,y)

(3)N=Count(F(x,y)>0),m=sum(F(x,y))/N

(4)P=Count(F(x,y)>m)/N

(5)if F(x,y)>m× (k2+k1/p)

then BW(x,y)=1

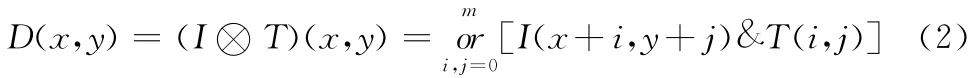

为了更好的获取候选区域,进一步使用形态学方法对得到的二值化图像 (BW)进行处理。适度的膨胀操作,可以填补物体中的空洞有助于候选区域的定位。利用菱形结构算子S(5×5)对二值化图像BW 进行膨胀运算,以融合图像中的空洞。清洗图像并标记连通区域,产生候选区域集合。膨胀运算定为

2.2 车牌验证阶段

车牌验证包含交叉验证和文本验证。两个检测器并行产生候选区域,首先进行交叉验证,通过验证的潜在区域加入车牌集合。未通过验证的潜在区域流向文本验证模块。交叉验证依据两个检测器产生的潜在区域位置关系进行判定,若区域重合度大于0.5则判断为车牌且为同一个车牌,选取颜色检测器所产生的的候选区域作为此车牌的代表区域加入车牌集合同时删除CNN 检测器所产生的的候选区域。交叉验证使得颜色检测器不仅在信息融合阶段作出验证并且在检测阶段提供了候选区域,降低了误警率、提高检测率。交叉验证处理后的潜在区域流向文本验证进行最后的信息融合产生最终的车牌集。

算法如下:

预处理:二值化灰度增强的图像,清洗连通域小于25个像素、高度小于车牌区域1/3、宽度大于车牌宽度1/2的连通域记为SC。

定义2 N:连通域个数;Ci:第i个连通域: [hi,wi];Si:记录和Ci相似连通域个数;Di:Ci与其它连通域的距离和;Td=0.2%相似度阈;1≤i≤N。

(1)for(Ci,Cj)in Sc%Sc中每对连通域

dij=sqrt((hi-hj)2+ (wi-wj)2)%距离

if dij≤Tdthen Si=Si+1;Di=Di+dij;

(2)[~,K]=max(S+0.5/ (1+D))

(3)for j=1:N

if dkj≤Tdthen U= [U;cj]%Cj加入新簇U

(4)Hm=mean(U(:,1));Wm=mean(U(:,2))%计算簇U 中所有连通域的高均值Hm和宽均值Wm

(5)for Ciin Sc

ri=wi/Wm-floor(wi/Wm)

Pj=abs(wi/Wm-ri)

Qj=1-min (Hm/hi,hi/Hm)

if Pi≤Td&&Qi≤Td

Nc=Nc+1;

Return Nc%字符个数

3 实验结果

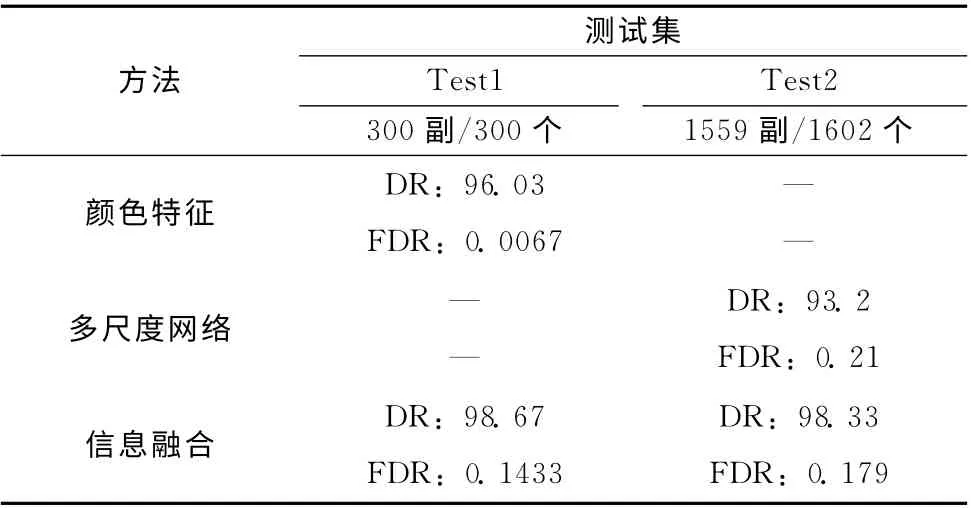

实验使用了两组测试集。测试集1由300副586×720大小图像组成,共包含300个车牌。代表受限环境,来源小区出入口监控和手机拍摄。测试集2[7]由1559 副352×288大小的图像组成,共包含1602个车牌。代表自然场景,来源于城市道路监控系统在自然场景下所拍摄。测试集1较于测试集2具有清晰度高、背景复杂度低、拍摄角度不固定、视距近的特点。

CNN 模块选取图3 (a)中第15趟的网络模型,在验证集上的误分类个数为19 个,误分类率为19/3000=0.63%。检测阶段采用1.1 的子采样率缩放原始图像12次,产生图像金字塔。每层图像预处理后传入训练得到的网络中做基于滑动窗口的检测,Output层的响应阈值为0.6。交叉验证的重合度阈值为0.5,文本验证的字符个数阈值为3。多类别特征信息融合模型以下简称信息融合。文献 [7]提供了多尺度网络在Test2中的测试结果,颜色特征提取是根据特征提取模块扩展编写而成在Test1 中有着不错的检测率。3种算法的测试结果见表1,通过对比我们很容易发现结合了信息融合和多类别特征提取的检测方法在两种不同场景下的测试集上的检测率均超过了单一算法。

表1 3种方法的检测率/%

4 结束语

本文提出一种多类别特征信息融合的车牌检测方法。实验使用多类别特征提取方法和多阶段信息融合技术得到一种新的检测方法。通过比较新方法与单一方法在两种不同场景测试集上的测试效果,得出多类别特征提取方法和多阶段信息融合技术对提高车牌检测效果有显著影响。模块化的设计也使得系统后续改进方便易行。计划引入车体检测模块、替换字符验证模块并借助并行化技术进一步优化算法,使得系统的性能得到更进一步的提高。

[1]Du S,Lbrahim M,Shehata M,et al.Automatic license plate recognition (ALPR):A state-of-the-art review [J].IEEE Transaction on Circuits and Systems for Video Technology,2013,23 (2):311-325.

[2]Anagnostopoulos CNE,Anagnostopoulos IE,Psoroulas ID,et al.License plate recognition from still images and video sequences:A survey [J].IEEE Transactions on Intelligent Transportation Systems,2008,9 (3):377-391.

[3]Faradji F,Rezaie AH,Ziaratban M.A morphological-based license plate location [C]//IEEE International Conference on Image Processing,2007:57-60.

[4]Wu P,Chen RJ,Shen DF.License plate extraction in low resolution video [C]//IEEE Pattern Recognition,2006:824-827.

[5]Canner H,Gecim HS,Alkar AZ.Efficient embedded neuralnetwork-based license plate recognition system [J].IEEE Transactions on Vehicular,2008,57 (5):2675-2683.

[6]Wen Ying,Lu Yue,Zhou Zhenyu,et al.An algorithm for license plate recognition applied to intelligent transportation system [J].IEEE Transactions on Intelligent Transportation Systems,2011,12 (3):830-845.

[7]Li Jia,Niu Changyong,Fan Ming.Multi-scale convolutional neural networks for natural scene license plate detection [G].LNCS 7368:Advances in Neural Networks.Springer,2012:110-119.

[8]Cecotti H,Graser A.Convolutional neural networks for P300 detection with application to brain-computer interfaces [J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2011,33 (3):433-445.

[9]Chen YN,Han CC,Wang CT,et al.The application of a convolution neural network on face and license plate detection[C]//18th International Conference on Pattern Recognition.IEEE,2006:552-555.

[10]Szarvas M,Sakai U,Ogata J.Real-time pedestrian detection using LIDAR and convolutional neural networks[C]//IEEE Intelligent Vehicles Symposium,2006:213-218.

[11]Fabian Nasse,Christian Thurau,Gernot A Fink.Face detection using GPU-based convolutional neural networks [G].LNCS 5702:Computer Analysisi of Image and Patterns.Springer,2009:83-90.

[12]Vahid Abolghasemi,Alireza Ahmadyfard.An edge-based color-aided method for license plate detection [J].Elsevier Image and Vision Computing,2009,27 (8):1134-1142.

[13]Kaushik Deb,SukJu Kang,KangHyun Jo.Statistical characteristics in HSI color model and position histogram based vehicle license plate detection [J].Springer Intelligent Service Robotics,2009,2 (3):173-186.