大区域无人机图像序列全局配准方法

2015-11-09周行等

周行等

摘 要: 由于无人机搭载的摄相机视角有限,在进行大区域航拍作业的后期数据处理中不可避免地要进行大量无人机图像的拼接。这里提出一种基于图像分布估计的多图像全局配准技术,首先通过运动估计和运动分解对图像序列的链式分布进行估计,然后通过精确SURF特征匹配对图像分布进行优化。得到的分布估计图的每一条边表征了一个图像对的匹配关系,根据这些匹配关系进行捆绑调整,求解每幅图像到最终拼接平面的最优变换矩阵,从而实现大区域多图像的全局配准。实验所得的拼接结果表明该技术配准效率高、效果良好。

关键词: 分布估计; 无人机; 全局配准; 捆绑调整

中图分类号: TN911.73?34; TP391.4 文献标识码: A 文章编号: 1004?373X(2015)21?0014?06

Global registration method of image sequence taken by UAV in large region

ZHOU Xing, ZHOU Dongxiang, PENG Keju, GUO Ruibin, FAN Weihong

(School of Electronic Science and Engineering, National University of Defense Technology, Changsha 410073, China)

Abstract: For the limited visual angle of the camera carried by UAV, a large number of mosaicing of images taken by UAV is inevitable in the later processing of the large region aerial photo mission. A multi?image global registration technology based on image distribution estimation is proposed. The chain distribution of the image sequence is estimated by using motion estimation and motion decomposition, and then the image distribution is optimized by precise SURF feature matching. Each edge of the obtained distribution estimation images characters the matching relation of an image pair. The binding adjustment is conducted according to the matching relation to solve the optimal transformation matrix from each image to the final mosaic plane, and achieve the multi?image global registration in the large region. The mosaic results from the experiment show that the method has high registration efficiency, and better registration result.

Keywords: distribution estimation; UAV; global registration; binding adjustment

0 引 言

图像拼接是指将多幅来自同一场景的具有一定重叠区域的小尺寸图像合成为一幅大尺寸、大视角的图像,是当前图像处理技术的一个重要分支。图像的拼接可以突破镜头拍摄角度的局限性,被广泛应用于遥感图像处理、医学图像分析、绘图学、计算机视觉、视频监控、虚拟现实和超分辨率重构等领域,是当前研究的一个热点。根据拍摄点的固定与否,图像拼接可以分为定点拍摄全景图拼接和多视点拍摄碎片图像拼接。定点拍摄全景图拼接的研究已经比较成熟,国内外都有不少的研究成果[1?4],并且有了许多产品,如Hugin,Autopano和微软的ICE等。多视点碎片图像拼接的研究相对较少,主要为医学图像拼接[5],多摄像头监控[6]和航空拍摄作业等。多视点与定点相比,模型更复杂、模型参数更多。

目前对于无人航拍序列的拼接方法中,最基础的就是采用时间相邻的图像两两配准[7?8],然后通过串联的方式,即变换相乘,可以得到序列中任意两幅子图像之间的变换,这种方式将会产生累积误差。随着图像数量的增加,变换相乘的次数也增加, 累积误差急剧增加,将使得拼接结果质量下降甚至导致拼接失败。该种方式忽略了非时间连续的图像对的空间场景相关性,忽略该多重限制难以得到视觉效果良好的拼接图。全局配准即能通过求解多图像之间的多重限制消除累积误差。目前已有对2D碎片图像的拼接研究[8?10],这些方法通常都是在两两配准的基础上得到图像群的匹配关系。在文献[1,9]中,无位置传感器信息时,通过对任意两幅图进行特征匹配得到重叠及匹配关系。通过多次迭代可以得到所有的匹配信息。无指导的两两匹配无视了图像群的序列特性,大大增加了算法的复杂度。

本文提出一种有效的通过时间相邻的两两匹配进行运动估计和运动分解从而得到图像群的大致分布估计的算法。首先根据图像分布预判重叠关系;然后通过精确的SURF特征匹配验证非时间连续图像对的重叠关系并获取全局配准所需要的特征点对应关系;最后通过捆绑调整求解一组最优变换,最终实现多视点图像的全局配准。该方法大大减少了非时间连续图像的尝试匹配次数,提高了全局配准的效率。在得到配准结果后,运用图割法求解最佳拼接缝并利用多带融合算法得到视觉效果良好的航拍拼接图。

1 无人机航拍视觉分析

1.1 重叠图像之间的运动表示

无人机航拍摄像机离地面较高,可以将目标景物(即地面地貌)视为平面。无人机航拍示意图如图1所示。无人机在飞行过程中,其高度、俯仰角、滚转角和偏航角的变化均会影响其成像。高度影响成像范围,俯仰角和滚转角都将产生一定量的“斜视”,偏航角将产生相邻图像之间的旋转关系。

相邻图像之间存在着平移[t、]旋转[R。][R]又可以分为:绕[X]轴旋转的角度为滚转角,绕[Y]轴的为俯仰角,绕[Z]轴的为偏航角。

设地面上有一点[P(x,y)],从空中两个视点[O]和[O]处分别拍得图像[I1]和[I2,][P]在[I1]中的对应点为[P1,]其齐次坐标为[(x1,y1,1)T;]在[I2]中的对应点为[P2,]其齐次坐标为[(x2,y2,1)T。][P1]到[P2]的变换可以通过一个8自由度的变换矩阵[H]进行表示。即:

是一种最通用的二维变换矩阵,它能够表示两幅图像之间的平移、旋转和缩放。8参数模型具有较强的适用性,但也有一定的约束条件,它要求图像之间不能有较大的视差。在两种情况下能够用[H]对运动进行很好的表示:当景物平面为近似平面时,如本文中所描述的无人机航拍情形;当摄像机在某点上纯旋转运动(比如使用三脚架)进行拍摄,这种情形Brown M在文献[1]中已有深入的研究。

1.2 重叠图像之间的运动分解

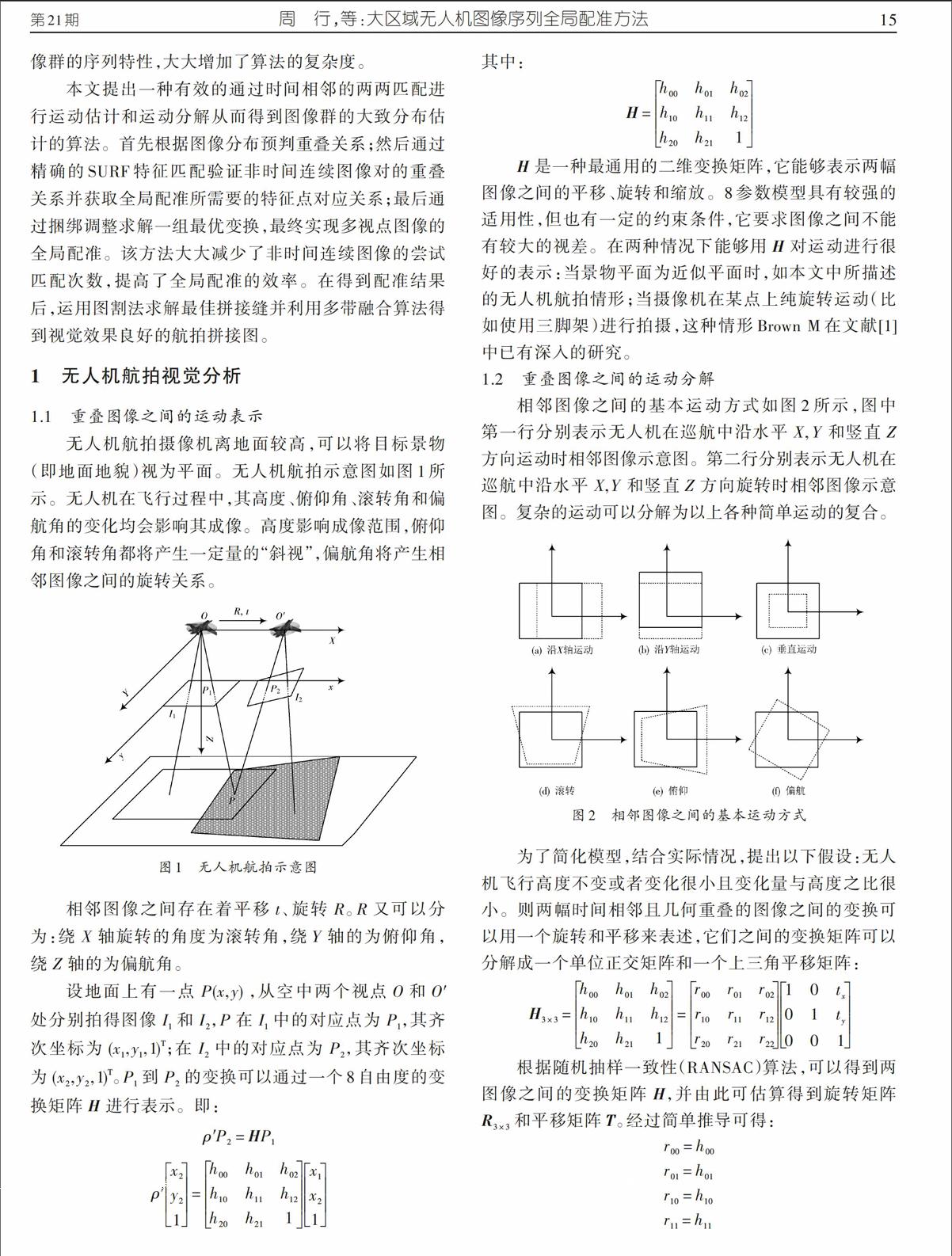

相邻图像之间的基本运动方式如图2所示,图中第一行分别表示无人机在巡航中沿水平[X,][Y]和竖直[Z]方向运动时相邻图像示意图。第二行分别表示无人机在巡航中沿水平[X,Y]和竖直[Z]方向旋转时相邻图像示意图。复杂的运动可以分解为以上各种简单运动的复合。

为了简化模型,结合实际情况,提出以下假设:无人机飞行高度不变或者变化很小且变化量与高度之比很小。则两幅时间相邻且几何重叠的图像之间的变换可以用一个旋转和平移来表述,它们之间的变换矩阵可以分解成一个单位正交矩阵和一个上三角平移矩阵:

[T]可以用来确定图像之间的位置关系,结合图像大小可以判断重叠率。

2 基于SURF特征匹配的分布估计

无人机在目标区域巡航拍摄时,得到的数据为时间序列图像。通过对拍摄间隔和飞行速度的控制,可以确保时间相邻的两幅图像之间必然存在视野重叠。当缺少每幅图像拍摄的位置信息时,只能先通过相邻图像之间的匹配来估计相机运动。分别对相邻的图像提取SURF特征点,并进行特征匹配,通过随机抽样一致性算法可以估算出它们之间的变换关系。但是对于非时间相邻的图像之间是否存在几何重叠,需要通过精确的特征匹配才能确定。简单地通过串联的方法估计所有图像之间的变换关系,其累积误差将随着图像数量的增加而增加;另一方面,无指导的两两匹配运算量大。本文通过对图像集的分布估计,从而指导匹配,大大减少了尝试匹配的次数。

2.1 SURF特征

图像拼接使用的特征,可以是点特征、线特征,也可以是面特征。SIFT特征是一种非常经典的特征,而SURF特征是对SIFT特征的改进,是H.Bay等人在SIFT特征的基础上提出的鲁棒且加速的特征。SURF算法的原理是利用积分图像和Hessian矩阵加速图像卷积,并用盒状滤波模板近似替代高斯二阶导数图像。

用不同的方向和尺度的盒状滤波模板与图像卷积即可得到图像的尺度空间。在尺度空间中确定极值,筛选所需特征点,并为每个特征点添加64维或者128维的描述符。SURF算法允许尺度空间多层图像同时被处理,不需对图像进行二次抽样,从而提高算法性能。特别是在多图像大量特征点处理中,提升的性能更加明显。考虑到应用的实际情况,本文采用SURF特征进行多图像配准。

本文采用1NN方法进行特征点匹配,即为最近邻距离比次近邻距离。设图像[i]中某特征点到图像[j]中特征点的最近距离为[ND,] 次近距离为[NND,] 当[NDNND≤]

[Threshold]时确定一个匹配特征点对。阈值选取越小,匹配的可信度越高。在匹配实验中,本文经过多次比较选取0.666 7作为阈值。

2.2 基于运动估计和分解的分布估计图初始化

基于特征拼接的第一步就是提取所有图像的特征点,本文中采取SURF特征。通过估算时间相邻的两幅图像之间的变换矩阵[H,]再根据上文所述的运动分解,可以大致估算出两幅图像在水平面上的平移。

在这一步,只是对时间相邻图像进行特征匹配。设序列图像集的数量为[n],则匹配次数为[n-1]。以第一幅图像为起点,依次计算下一幅图像与前一幅图像间的平移关系。52幅航拍序列图像通过估算得到的初始分布链式图如图3所示。

2.3 分布估计图优化

多图像配准与两图像的配准相比,表现在待配准图像数量的增加而导致更多重的限制,难度在于多重限制的获取和最优结果的求解。上一步分布估计的初始化是[n-1]对两两匹配的简单叠加,仍缺少了非时间连续图像之间的限制。

在本节中,采用预判和特征匹配验证相结合的方法获取非连续图像间的重叠关系及配准信息。一般情况下,每幅图像的邻居图像集的数量不超过8。本节分布估计的优化即是找出每幅图像的非时间连续的邻居图像及其配准信息。在上一步得到的链式图中,每个点表示了一幅图像,其邻居图像必然在该点的某个邻域中。以每幅图像的中心点为中心,[r]为邻域半径,定义一个邻域。对每幅图像,遍历其邻域中的其他图像表示点,并与之进行精确的特征匹配。精确匹配的结果可以用来验证两图像是否确实有几何重叠。若通过验证,则在上一步得到的初始链式图上添加一条连接这两幅图像的边。对每幅图像执行该操作之后,可以得到多图像配准所需要的所有信息:包括每幅图像的邻居图像及其之间的特征点对应关系。图4为经过求解后的分布估计图,红线代表新添加的节点连接线。

若图像集的数量为[n,]无指导的匹配尝试次数为[n?(n-1)2。]通过求解分布估计图,匹配尝试次数将大大减少。假设待拼接图像序列的重叠率不超过50%,无人机在作业时以S形扫描拍摄,则任意一幅图像在同一航带中只和前一幅、后一幅图像存在重叠,同时与序列中后面的航带中至多与3幅图像重叠。由此在该情形下其尝试匹配次数将不超过[4n](当无人机飞行中出现掉头或航线交叉时不适用)。本文以52幅图像组成的序列选取不同长度进行实验,当估计得到的两图像之间的相对位移在[x]方向和[y]方向分别小于图像尺寸的宽和高时则进行一次尝试匹配。从表1中可以看出匹配次数大大减少,特别是随着图像序列变长,效果提升越明显。

3 捆绑调整求解最优变换

为了将所有的子图像融合为一幅大视角、高分辨率的全景图,需要求解一组使得所有的特征点对的匹配总误差最小的全局一致性最优解。各种不同的全局配准方法,一般都是通过最小化某个误差项来求解每幅图像到最终拼接平面的变换参数。

序列图像的各种拼接中,如果只是依赖其序列特性,通过串联的形式逐步求解配准参数,必然导致累积误差。特别是在图像数量大的时候,串联计算的次数越多,累积误差越大,最终可能会导致拼接失败。通过基于Levenberg?Marquardt算法的捆绑调整,可以同步地求解所有的配准参数,有效地避免累积误差和局部最优解。在本文中,采用的是8参数模型,对于[n]幅图像则共有[8n]个参数。对于大区域拼接作业,该捆绑调整求解最优变换的过程即为一个大规模非线性最优解问题。

图5显示了捆绑调整这一过程。假设[ixk]表示第[i]幅图像中的第[k]个特征点,第[j]幅图像中的第[l]个特征点[jxl]与之对应。[Hi]和[Hj]分别表示第[i,][j]幅图像到拼接平面的变换矩阵。这对匹配特征之间的关系可以用[Hi]和[Hj]进行表示。优化算法通过计算现有的匹配误差,进而指导变换矩阵[H]的调整。以[rsi,j]表示图像[i]和图像[j]的第[s]对匹配点的误差,则优化目标函数为:

3.1 误差函数定义

匹配点对的误差函数可以有多种定义方式。文献[2]中运用了如下定义:

其中:[xtr,xtl,xbr,xbl]分别表示图像的右上角,左上角,右下角和左下角的坐标。将以上两种定义方式结合作为目标误差函数。

3.2 拼接平面的选取

本文采用了Sawhney对误差的定义方式,但是选择了其他的尺度约束方法。这种定义方式在无约束条件下存在尺度缩小问题。因为目标平面越小,则两个点分别投影到目标平面之间的距离也越小。考虑极端情况,所有的点都被投影到拼接平面的原点,则误差和为零,但这个最优解没有实际意义。为了加入尺度限制,可以选取图像集中的某一幅图像所在平面为拼接平面,则该图像到拼接平面的变换矩阵为单位矩阵。在该变换矩阵确定的情况下可以起到尺度约束作用。

关于拼接平面的选取,最直观的方式就是选取分布估计图中的中心节点所代表图像所在平面,即为图像集的覆盖区域的几何中心,本文采取了该方式。另外,也可以尝试使用第一部分中分解得到的旋转矩阵,得出时间相邻图像之间的角度关系,再从中选择法向量最接近一致性方向的图像作为拼接平面,该方法有待下一步试验。

3.3 迭代求最优变换矩阵组

在非线性最小二乘问题中:

(2) 迭代终止条件

① 迭代次数达到预设上限;

② 两次连续迭代之间的误差差值小于某个阈值[τ],即[Error(k)-Error(k+1)≤τ;]

③ 两次连续迭代之间的参数[x]差值小于某个阈值[ε,]即[(x(k)1,x(k)2,…,x(k)n)-(x(k+1)1,x(k+1)2,…,x(k+1)n)2<ε。]

4 多图像融合结果

得到了拼接所需的最优变换矩阵组,还需要通过图像融合技术获取最终的无缝拼接结果。本文在全局配准后端先进行曝光补偿,然后基于图割算法[11]求解最佳拼接缝,最后采用多带融合[1]得到最终拼接结果。实验以图4中右上角18幅840×420的图像为源数据(部分源图像如图6所示),以S形序列作为输入,拼接得到4 435×1 034的高分辨率图像。该实验在装有64位win7操作系统的PC机上进行,处理器为Pentium?双核CPU,主频为2.93 GHz,RAM为2 GB。如图7所示,拼接图视觉效果良好,无拼接缝及灰度跳变,无累积误差影响。在该实验中共使用了1 337对匹配点,捆绑调整后这些点对的残差平方和为21.630 2,可见其配准误差很小。图8是通过帧到平面的方式拼接得到的,以第一幅图像作为参考平面,可以明显看出其受到累积误差的影响,存在拼接边界模糊和错误拼接。

5 结 论

本文介绍了一种基于分布估计的大区域无人机航拍图像的有效拼接方法。首先通过对时间连续的图像进行SURF特征匹配得到基本分布信息,再通过预判加精确验证的方式补充分布信息。所得的分布信息和匹配信息用于下一步的捆绑调整,求得一组最优变换解,最终实现了大区域无人机航拍多图像的配准。总体过程大大减少了无效的图像匹配次数,使系统具有较高的效率。从最终的拼接结果中可以看出,该配准精度可靠,结合后端融合能实现多航拍图像的无缝拼接。

参考文献

[1] BROWN M, LOWE D G. Automatic panoramic image stitching using invariant features [J]. International Journal of Computer Vision, 2007, 74(1): 59?73.

[2] SHUM H Y, SZELISKI R. Systems and experiment paper: construction of panoramic image mosaics with global and local alignment [J]. International Journal of Computer Vision, 2000, 36(2): 101?130.

[3] SZELISKI R. Image alignment and stitching: a tutorial [J]. Foundations and Trends in Computer Graphics and Vision, 2006, 2(1): 1?14.

[4] SAKHARKAR M V S, GUPTA S R. Image stitching techniques: an overview [J]. International Journal of Computer Science and Applications, 2013, 6(2): 324?330.

[5] 杨帆.生物医学图像自动拼接关键技术研究[D].长沙:中南大学,2012.

[6] 刘畅,金立左,费树岷,等.固定多摄像头的视频拼接技术[J].数据采集与处理,2014,29(1):126?133.

[7] SAWHNEY H S, HSU S, KUMAR R. Robust video mosaicing through topology inference and local to global alignment [C]// Proceedings of 1998 the 5th European Conference on Computer Vision. Freiburg: Springer Berlin Heidelberg, 1998: 103?119.

[8] KANG E Y, COHEN I, MEDIONI G. A graph?based global registration for 2D mosaics [C]// Proceedings of 2000 the 15th IEEE International Conference on Pattern Recognition. Barcelrona: IEEE, 2000, 1: 257?260.

[9] FERRER J, ELIBOL A, DELAUNOY O, et al. Large?area photo?mosaics using global alignment and navigation data [C]// Proceedings of 2007 MTS/IEEE OCEANS Conference. Vancouver: IEEE, 2007: 1?9.

[10] HSU S, SAWHNEY H S, KUMAR R. Automated mosaics via topology inference [J]. IEEE Computer Graphics and Applications, 2002, 22(2): 44?54.

[11] 方贤勇,张明敏,潘志庚,等.基于图切割的图像拼接技术研究[J].中国图象图形学报,2007,12(12):2050?2056.

[12] 李庆忠,耿晓玲,王冰.大视场视频全景图快速生成方法[J].计算机工程,2009,35(22):170?172.

[13] MARZOTTO R, FUSIELLO A, MURINO V. High resolution video mosaicing with global alignment [C]// Proceedings of 2004 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. [S.l.]: IEEE, 2004, 1: 692?698.

[14] MADSEN K, NIELSEN H B, TINGLEFF O. Methods for non?linear least squares problems [J]. Society for Industrial Applied Mathematics, 1999, 21(3): 56?62.

[15] PRADOS R, GARCIA R, NEUMANN L. Underwater 2D mosaicing [M]. Berlin: Springer International Publishing, 2014.