基于改进的均值漂移视频目标跟踪算法

2015-09-19陈德凯郝禄国张文忠

陈德凯,原 玲,郝禄国,张文忠

(广东工业大学 信息工程学院,广东 广州510006)

图像目标跟踪一直是计算机视觉领域研究的热门课题,在人机交流、医疗诊查、智能交通、视频监控、视频检索和压缩等方面都有重要应用。均值漂移(Mean Shift)理论用于目标跟踪是由Comaniciu 在2000 年CVPR(Computer Vision Pattern Recognition)会议上第一次提出来的,自提出以来众多研究者由于它的计算开销小、跟踪性能好对它格外关注[1]。

针对以单一特征进行跟踪的MS(Mean Shift)算法存在的不足[2-3],本文提出了一种改进的基于帧间差分法多特征联合MS 算法。算法第一步提取出目标的颜色和边缘特征,同时利用帧间差分法[4-5]提取目标的运动特征,用运动特征分别与这两个特征联合,从而得到新的运动-颜色和运动-边缘特征;第二步,基于加权求和的思想提出一种多特征融合方法,自适应将以上两种新的特征嵌入到MS 跟踪算法框架中[6-7]。为了进一步提高搜索的效率,算法最后利用Kalman 滤波器预测目标在下一帧中出现的位置[8]。实验结果表明,本文提出的算法提高了经典MS 算法对复杂背景、目标变形、光照变化以及遮挡等多种情况的抗干扰性。

1 新的目标模型

1.1 帧间差分法原理

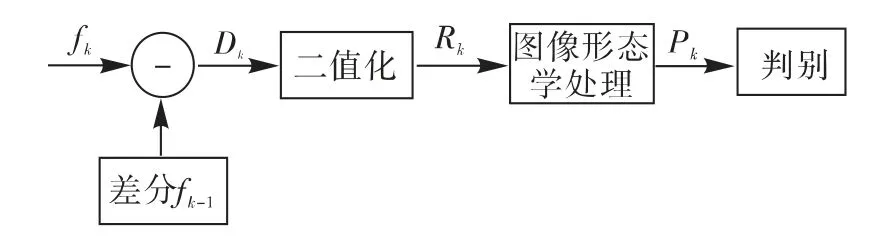

两帧图像的差可以反映出图像中运动物体边缘轮廓像素的运动信息,利用这一原理将连续两帧图像对应位置的像素相减,就可以将图像中移动的目标检测并提取出来。两帧差法基本的过程如图1 所示[9]。

图1 帧间差分法原理图

帧间差分法的计算表达式为式(1)和(2)

式中:Dk为差别图像;Rk为二值化的差别图像;fk和fk-1分别为当前帧和上一帧图像;T 为判断阈值;帧间差分法实验如图2 所示。

图2 帧间差分法实验

1.2 颜色特征模型

假设目标在图像序列上一帧的估计位置为y,{x }

i i=1,…,n 表示y 周围目标候选区域的像素位置,目标的颜色直方图可以通过下式建立其中,δ(·)为Kronecker delta 函数;b(xi)是统计像素点到相应颜色区间的函数;Bc为颜色映射级数;C 为归一化常数,使得=1;u 为直方图的颜色索引。

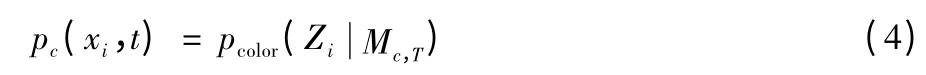

通过统计目标颜色直方图各颜色区间的像素点的个数,可以得到目标颜色概率密度分布Mc,T,假设对应的颜色特征观测概率模型为pcolor(ZiMc,T),令

其中:Zi表示xi处的观测值表示时间t 像素xi是目标图像中一点的概率,那么一帧图像对应的颜色概率密度分布图就可以通过图像中每个像素的值求得。

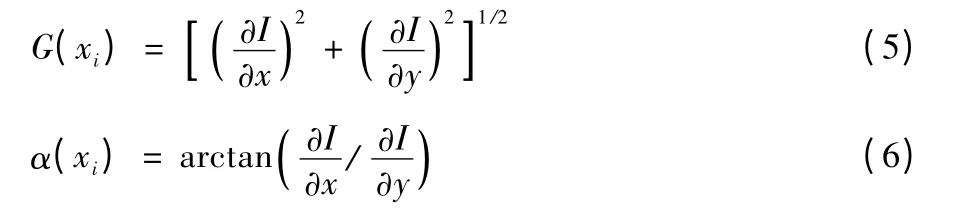

1.3 边缘特征模型

由于受光照、颜色影响较小,边缘是视频图像中物体的重要特征。使用sobel 算子计算该像素点在x 方向和y 方向上的梯度值∂I/∂x 和∂I/∂y,则该边缘点的梯度幅值G(x)和方向α 分别为

其中,α ∈[0° ,360°]。

目标的边缘特征直方图he= { he(v})Bev=1通过下式建立

其中:b*(xi)是统计像素点到相应颜色区间的函数;C*是使得归一化常数;Be为边缘映射级数。

通过统计目标边缘直方图各颜色区间的像素点的个数,可以得到目标边缘概率密度分布Me,T,假设对应的边缘特征观测概率模型为,令

其中,Zi表示xi处的观测值,pe(xi,t)表示时间t 像素xi为目标图像中一点的概率,那么一帧图像对应的边缘概率密度分布图就可以通过图像中每个像素的值求得。

1.4 新的运动-颜色和运动-边缘特征模型

为了增加嘈杂环境下目标跟踪的稳定性,提出采用帧间差分法提取目标的运动特征,然后利用它分别与颜色或边缘特征联合,得到新的运动-颜色和运动-边缘特征。具体计算方法如下

其中,pm-c(xi,t)为当前帧运动-颜色概率分布图;pm-e(xi,t)为运动-边缘概率分布图;Rk为差分二值图像。

2 目标跟踪算法

2.1 基于加权求和的多特征自适应融合算法

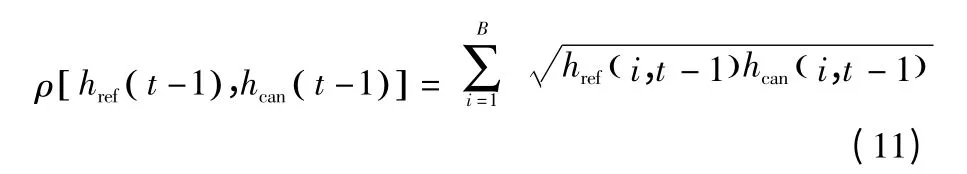

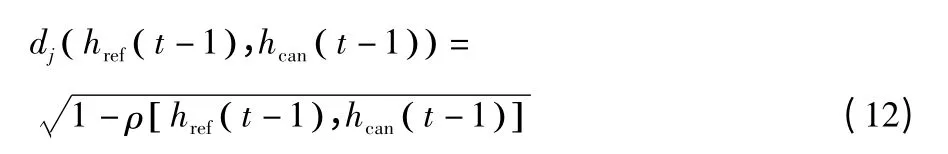

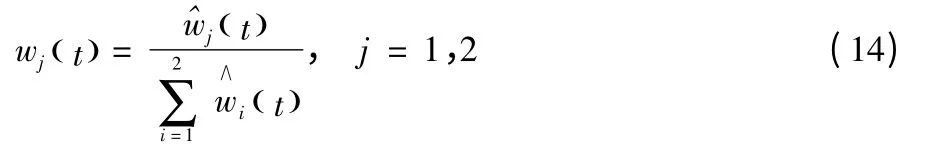

本文提出一种基于加权求和的多特征自适应融合算法。该算法依据前一帧目标的状态,分析各个特征信息的重要性,然后基于该重要性在当前帧中为这些特征分配相应的权值。其优点在于可以自适应调整各个特征的权重,充分发挥在不同跟踪环境下各个特征的互补优势,为跟踪增加稳定性。设第t 帧为当前帧,则其中各个特征的权重计算方法如下:

1)计算第t-1 帧中目标参考模型各个特征的直方图href(t )

-1,并计算目标候选模型各个特征所对应的直方图hcan(t )

-1。然后通过计算Bhattacharyya 系数来衡量这两个直方图之间的相似程度

2)假设参考模型与候选模型中第j 个特征的直方图的Bhattacharyya 距离为,则当前帧中第j 个特征的权重为

t 越大;相反,当两直方图越不相似时,^wj( )

t 的值越小。也可以这样描述为,若第t-1 帧中第j 个特征起的重要性越大,特征j 的权重就变大,那么下一帧中该特征的权重就可以自动准确的分配出来。

图3 多特征自适应融合过程图

2.2 跟踪算法

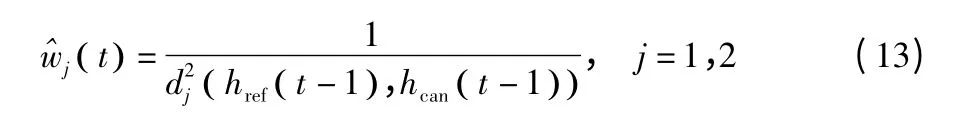

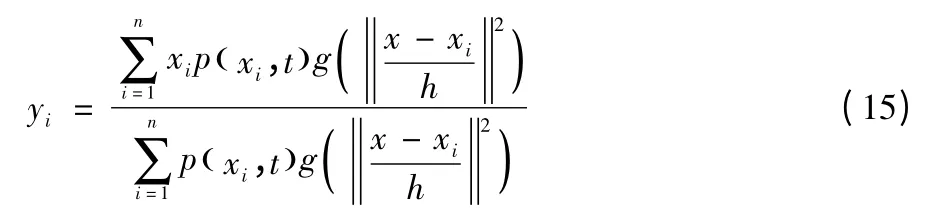

得到概率密度分布图后,在当前帧中以前一帧目标所在位置为中心,在其周围位置寻找概率密度最大区域,从而搜索目标新位置。满足一定条件下,MS 算法会收敛到概率密度分布的稳定点,这个稳定点就是搜索窗内密度峰值的峰值点,即

当g(x)为常数时,式(15)为MS 算法求搜索窗口质心的函数,则搜索窗口的零阶和一阶矩分别为[10]

搜索窗的质心为

基于帧间差分多特征融合的Mean Shift 跟踪算法流程用以下步骤描述:

步骤1,选择跟踪目标,以选择区域作为初始搜索窗口,并初始化Kalman 预测器;

步骤2,计算目标模型的pc(xi,t)和pe(xi,t);

步骤3,在后续帧中,以Kalman 预测器在下一帧图像中预测的目标位置为中心确定MS 算法进行目标跟踪的搜索区域;

步骤4,通过帧间差分法获得运动特征,计算pm-c(xi,t)和pm-e(xi,t);

步骤5,利用式(11)~(14),即新的多特征自适应融合算法将融合,得到整体的概率密度分布图p(xi,t);

步骤6,在融合后的概率密度分布图上,通过式(17)计算目标的新位置y1,如果迭代次数小于阈值且,其中ε 是允许最小误差,则,返回步骤5。否则,迭代结束,转至步骤7;

步骤7,利用目标匹配时的Bhattacharyya 系数来判断遮挡严重程度。当目标没有遮挡或遮挡不严重时,则利用MS 算法得到的目标位置来更新Kalman 预测器中的参数;当目标被遮挡严重时,则利用Kalman 预测器得到的预测值更新其参数,并用该预测值作为目标当前位置[11]。返回步骤2,直至视频结束。

3 实验结果与分析

为了测试本文算法的性能,在配置为Intel Core i3-3110M、2.40 GHz 主频、4 Gbyte 内存、独立显卡的计算机上进行算法仿真实验。软件开发环境为Visual Studio 2010,其中算法的实现借助了开放源代码的计算机视觉库OpenCV 中的部分函数。表1 列出了实验所用视频的参数。

表1 视频参数

3.1 相邻相似颜色背景干扰、旋转、光照变化发生时的目标跟踪

实验对象Video 1 为一群舞者在复杂的灯光条件下跳舞的视频序列,如图4 所示。舞者穿的上衣与黑色背景相似,第30 ~80 帧其中一个舞者转了一个圈,第80 ~100 帧这个舞者受到舞台灯光的强烈照射。利用文献[12]算法,当舞者突然旋转时(第33 帧),跟踪结果出现误差,到第54 帧时,跟踪目标丢失。这是因为当相似背景颜色干扰了颜色直方图的分布时,可以利用边缘特征对颜色变化不敏感的优点来弥补这一不足,但是当目标同时发生旋转时,基于颜色特征和边缘特征融合的MS 算法结果出现误差,甚至丢失目标。而本文算法利用帧间差分法提取运动特征,继而用运动特征分别与颜色和边缘特征联合来跟踪目标,有效弥补了颜色特征和边缘特征的优点都不能发挥时的跟踪短板,准确跟踪到了目标。

图4 相邻相似颜色背景、光照变化、旋转下的跟踪

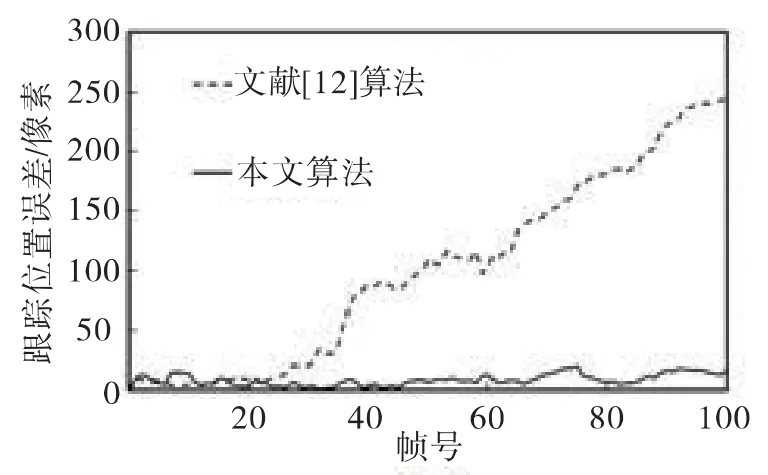

图5 显示了两种算法的跟踪位置误差,即跟踪窗口的质心位置与目标实际质心位置的误差绝对值。其中,对目标的实际质心的位置采用逐帧手工标定得到。由图可以看到,相比于算法[12],本文提出的算法所得到的跟踪位置误差更小。

图5 跟踪位置误差对比

3.2 被遮挡时的目标跟踪

实验对象Video 2 来自PETS2009[13]图像数据集,如图6所示。一个穿白颜色衣服的女人穿过人群时被一块路牌遮挡。在文献[14]算法下,由于目标被行人和路牌遮挡,从第33 帧开始跟踪出现误差,并在后续帧中将目标错误的锁定在灯杆上,丢失了目标。而本文算法利用Kalman 预测器对目标运动轨迹进行预测,圆形跟踪窗口为Kalman 预测器的预测值,当白衣女人被行人和路牌严重遮挡甚至完全遮挡时,仍能实现对白衣女人的准确跟踪。图7 显示了算法[14]和本文提出的算法的跟踪位置误差对比。

图6 被遮挡时的目标跟踪

图7 跟踪位置误差对比

文章最后通过图像序列平均跟踪位置误差和跟踪时间这2 个指标对所提算法的性能进行了定量分析,见表2。可以看出,本文算法的平均跟踪位置误差显著低于文献[12]、[14]的算法,显示了优越性。在跟踪时间方面,虽然本文算法增加了运动特征引导颜色特征和边缘特征,以及利用Kalman 预测器对遮挡进行预测,增加了平均跟踪时间,但增加的时间并不明显。

表2 平均跟踪位置误差与跟踪时间

4 结语

提出了一种基于帧间差分多特征融合的MS 跟踪算法,与只使用颜色特征和边缘特征融合的MS 跟踪算法相比,本文算法在颜色特征和边缘特征均不能有效跟踪的复杂情景中仍能进行准确的跟踪。采用Kalman 预测器对目标在下一帧中的轨迹进行预测,对目标被严重遮挡时具有一定的抗遮挡能力。从直观跟踪效果和定量分析两方面可以看出,本文算法能够在相邻相似颜色背景、旋转和光照变化以及遮挡发生条件下实现准确跟踪,提高了MS 目标跟踪算法的鲁棒性。

[1]COMANICIU D,RAMESH V,MEER P.Real-time tracking of nonrigid objects using mean shift[C]//Proc.IEEE Conf.Computer Vision and Pattern Recognition.[S.l.]:IEEE Press,2000:142-149.

[2]COMANICIU D,RAMESH V,MEER P.Kernel-based object tracking[J].IEEE Trans. Pattern Analysis and Machine Intelligence,2003,25(5):564-575.

[3]刘惟锦,章毓晋.基于Kalman 滤波和边缘直方图的实时目标跟踪[J].清华大学学报:自然科学版,2008,48(7):1104-1107.

[4]张春林,李小坚. 基于帧间差分和背景差分结合的Camshift 目标跟踪算法[J].工业控制计算机,2014(6):118-120.

[5]邬大鹏,程卫平,于盛林. 基于帧间差分和运动估计的Camshift目标跟踪算法[J].光电工程,2010,37(1):55-60.

[6]王鑫,徐立军. 图像目标跟踪技术[M]. 北京:人民邮电出版社,2012.

[7]刘晴,唐林波,赵保军,等. 基于自适应多特征融合的均值迁移红外目标跟踪[J].电子与信息学报,2012,34(5):1137-1141.

[8]BRADSKI G,KAEBLER A.学习OpenCV(中文版)[M]. 于仕琪,刘瑞祯,译.北京:清华大学出版社,2009.

[9]初红霞,宋起超,王希凤,等.基于帧间差分与Camshift 相结合的目标跟踪算法[J].弹箭与制导学报,2008,28(3):85-88.

[10]丁业兵,王年,唐俊,等.基于颜色和边缘特征CAMShift 目标跟踪算法[J]. 华东理工大学学报:自然科学版,2012,38(1):69-74.

[11]闫钧华,陈少华,艾淑芳,等. 基于Kalman 预测器的改进的CAMShift 目标跟踪[J].中国惯性技术学报,2014(4):536-542.[12]郑玉凤,马秀荣,赵晓琳,等. 基于颜色和边缘特征的均值迁移目标跟踪算法[J].光电子·激光,2011,22(8):1231-1235.

[13]FERRYMAN J. Eleventh IEEE International workshop on performance evaluation of tracking and surveillance[EB/OL].[2015-04-15]. http://www. cvg. rdg. ac. uk/PETS2009/a. html,June 25,2009.

[14]袁广林,薛模根,韩裕生,等.基于自适应多特征融合的mean shift目标跟踪[J].计算机研究与发展,2010,47(9):1663-1671.