基于可见光和红外图像融合的汽车抗晕光方法

2015-04-03郭全民李晓玲

郭全民,李晓玲

基于可见光和红外图像融合的汽车抗晕光方法

郭全民,李晓玲

(西安工业大学 电子信息工程学院,陕西 西安 710021)

针对夜间汽车行车因前大灯使用不当而产生的晕光问题,提出了一种基于可见光与红外图像融合的汽车抗晕光方法,以提高夜间行车的安全性能。该方法通过对可见光图像做IHS变换,将提取到的亮度分量与红外图像进行小波变换,获得新的亮度分量后,再与原始可见光图像的色度分量和饱和度分量进行IHS逆变换,实现既能消除晕光现象又能保留图像细节的目的。对可见光和红外图像融合算法处理结果的主观评价与客观数据分析,表明本文提出的方法可以有效消除夜间汽车行车时的晕光现象,改善传统IHS变换的光谱扭曲性,提高小波变换的速度。

汽车抗晕光;图像融合;IHS变换;小波变换

0 引言

汽车夜间行车时,前大灯的使用不当会造成对面来车的司机产生晕光现象,短时看不清道路而产生交通事故。根据美国国家公路交通安全管理局(NHTSA)的数据统计,夜间行车虽然只占整个公路交通的1/4,但1/2的交通事故发生在夜间,其事故发生率占了近70%[1],而车灯晕光是除了酒驾、疲劳驾驶之外另一个造成夜间事故高发的重要原因。为了消除因晕光现象引起的交通事故,通常在高速公路或城市快速主干道之间的隔离带种植植物或安装防晕光板,这种方法简单可行,效果好,但目前大部分公路受各种条件所限,并没有采取相应的措施。

为提高车辆夜间的行车安全性能,汽车抗晕光技术引起国内外学者和工程界的广泛关注。国外汽车厂商在凯迪拉克帝威、奥迪A8L等一些高档轿车上安装了夜视红外仪[2]来消除汽车晕光现象。根据红外热成像原理,温度越高的地方,辐射出的红外线越多越容易成像,并且其对可见光不敏感,因此红外图像能保证驾驶员不受对面行驶车辆的前大灯影响;但它存在颜色单一、图像重要细节信息缺失严重(如:车辆颜色、车牌号码、道路环境等)的问题。国内学者通过两路CCD摄像机,采用不同的光积分时间同步采集同一景物,用积分时间短的通道获取图像景物中光线较亮部分的图像信息,而用长积分时间的通道获取光线较暗部分的图像信息,通过像素亮度置换或线性权值合成等算法处理获得一路宽动态范围的视频图像信号,取得了较好的抗晕光的效果,但却不能彻底消除[3-4]。由此可见,现有的抗晕光方法各有优缺点,无法获得理想的抗晕光效果。因此,可利用现有抗晕光技术、方法的优点,采用多种方法相互融合以取得较好的抗晕光效果。

本文针对现有抗晕光方法效果不佳的问题,提出了一种将可见光图像与红外图像相融合的抗晕光方法。可见光传感器获得的图像色彩逼真,细节清晰,有利于人眼观察,但抗干扰性差,在夜间成像能力较差;红外传感器通过探测汽车与背景之间的温度差异来识别场景中的热目标,在夜视环境下虽不能清晰观察目标,却能够将目标轮廓显示出来,但对图像的细节信息缺失严重,影响成像效果[5]。因此利用可见光图像与红外图像不同成像特性的互补性,采用IHS变换和小波变换融合的处理算法合成一路视频图像,提高视频图像的宽动态范围,以达到消除晕光现象。

1 可见光和红外图像融合的抗晕光原理

在保证融合结果不失真的情况下,根据可见光传感器与红外传感器的夜间成像特点,利用IHS变换可以将图像分解成、、三个相关性低的分量的特性[6-7],对可见光图像做IHS变换,将饱和的亮度分量进行单独处理,保留图像原始的色彩和纹理。利用小波变换可将图像分解为:包含了原图像轮廓信息的低频分量;水平方向、垂直方向和对角方向3个包含图像细节信息的高频分量。对低频分量进行平均值法融合规则,高频分量进行绝对值取大融合规则。将可见光中提取的亮度分量与红外图像进行小波融合,得到既消除晕光又提高融合图细节的融合结果。

2 可见光和红外图像融合的抗晕光实现过程

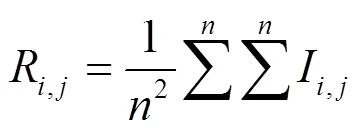

2.1 图像预处理

2.2 基于IHS小波变换的可见光与红外图像的融合

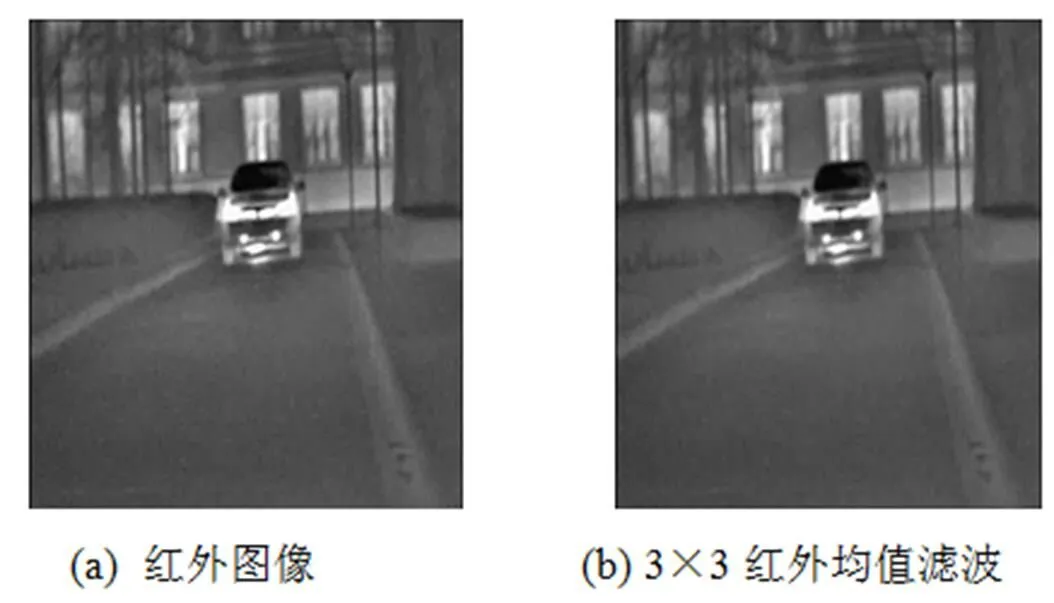

对可见光图像做IHS变换将亮度分量提取出来,红外图像与可见光源图像中的亮度分量进行小波融合,得到新的¢亮度分量,再将亮度分量¢和原始可见光图像的色度分量和饱和度分量进行小波重构形成新的图像[8-9],这个图像就是结合了可见光和红外抗晕光的图像融合过程。具体实现框图如图2所示。

图2 图像融合过程

具体的算法实现过程如下步骤:

1)对可见光图像做3个通道的分离:得到它的亮度分量、色度分量和饱和度分量。

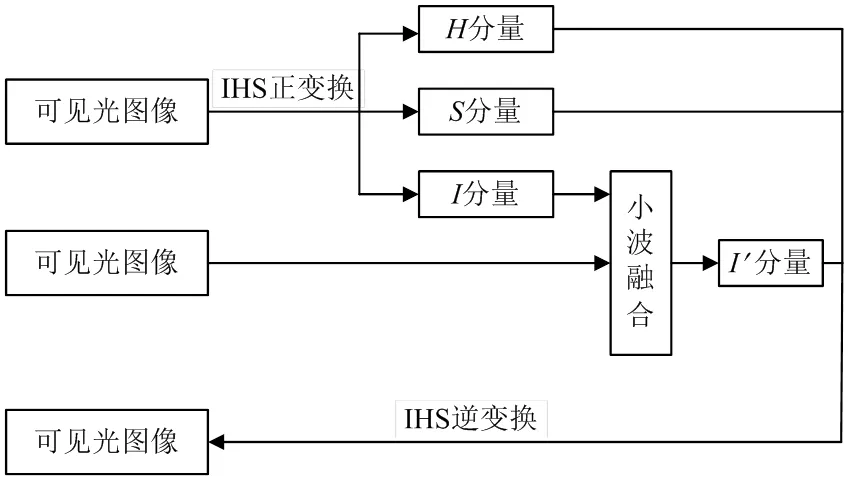

IHS正变换公式为:

2)传统的IHS变换后,图像会有光谱扭曲性,将得到的可见光图像的亮度分量与红外图像进行小波变换,对得到的低频分量采用平均值法;高频分量采用绝对值取大;改善光谱扭曲性,也可在消除晕光的同时,更好地保留原图像在不同频率下的特征信息。

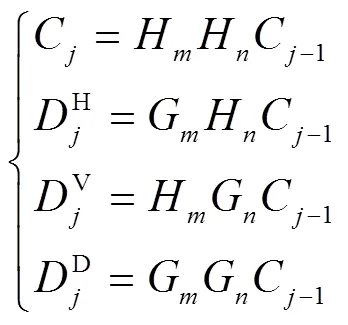

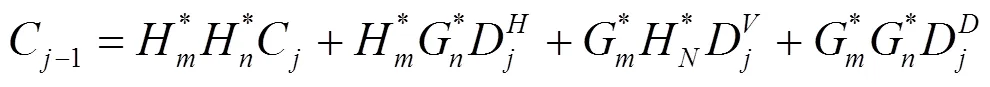

对可见光图像的分量和红外图像分别进行层小波分解,其分解公式如下[10-11]:

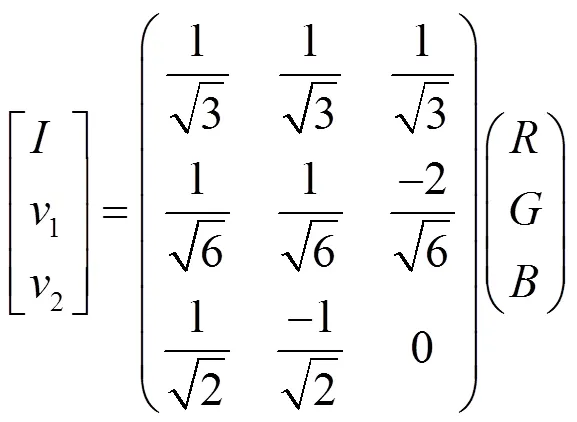

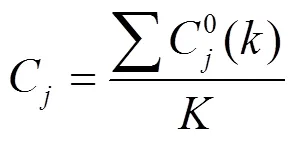

消除晕光的过程中,低频分量代表源图像的近似特性,在一定尺度下它相当于原始信号的近似[12]。对同一景物的不同传感器所获得的图像,其低频近似部分差别不是很大,故采用低频分量平均融合方法。

式中:为源图像数;C是融合图像的低频系数。

高频信息代表了图像的显著特征,比如:边缘、纹理、细节等信息,对同一景物的不同传感器所获得的图像高频部分差异较大[13]。在对高频信息处理过程中主要目的是增强融合图像的细节信息。

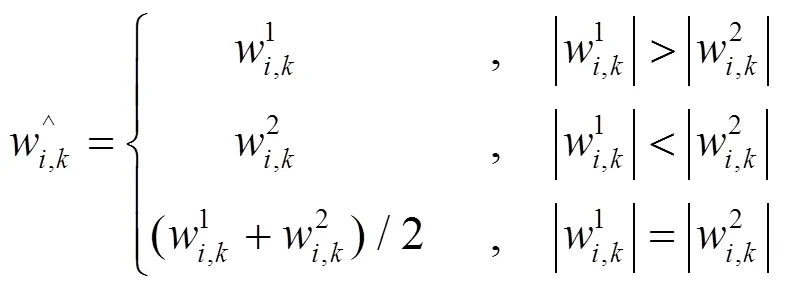

式中:w,k1和w,k2分别表示两幅图像的在各尺度上的各分量的小波系数。

通过了上述不同的融合规则处理后,得到了新的高低频分量,图像中的亮度分量有所减小,进行小波重构即就可以得到新的亮度分量¢。

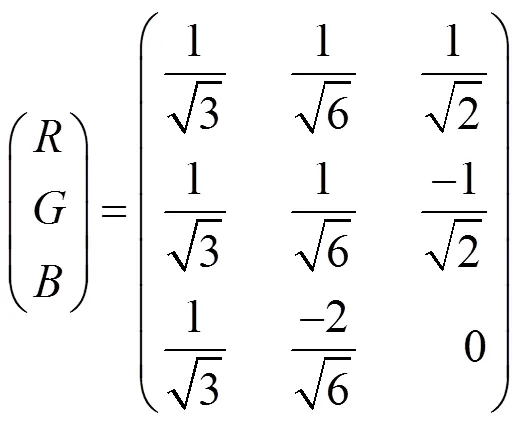

3)显示器目前采用的都是RGB色彩标准,因此需要将上述重构得到图像进行IHS逆变换转换为RGB图像[14-15]。

IHS逆变换公式为:

最终所得到图像即为基于可见光和红外的抗晕光融合图像。

3 实验结果及分析

为了验证算法的有效性,通过对传统的IHS变换、小波变换以及本文中提出的基于IHS和小波相结合的算法进行图像融合处理,结果如图3所示。

图3(a)中,IHS变换消除了晕光现象,但出现了明显的颜色干扰;图3(b)中的小波变换消除晕光现象虽然不是很彻底,但是没有光谱扭曲;图3(c)中IHS变换和小波变换结合后,既可以消除晕光现象、降低图像颜色的扭曲现象,又同时可以较好地保留图像的光谱信息。

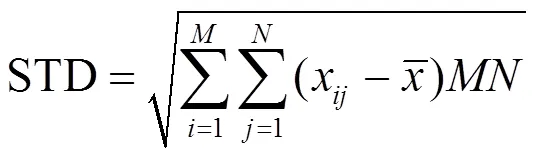

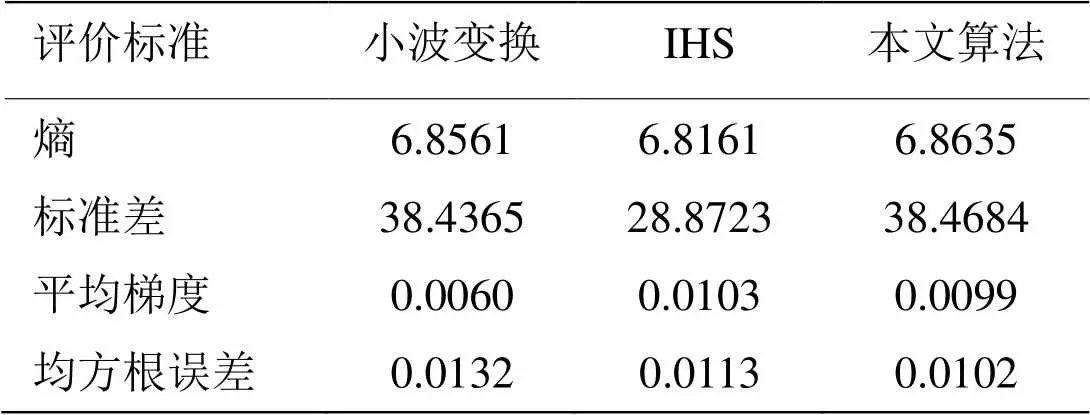

为客观分析图像处理结果,引入图像评价指标:熵、平均梯度、标准差、均方根误差[16-18],做进一步的评价。

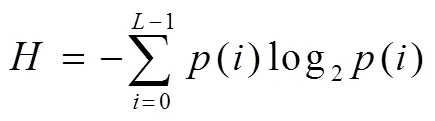

1)熵。融合图像的熵值大小反映了其包含的信息量的多少,熵值越大说明融合效果越好,其计算如下式:

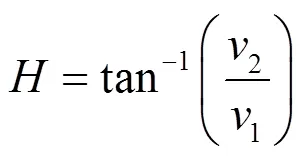

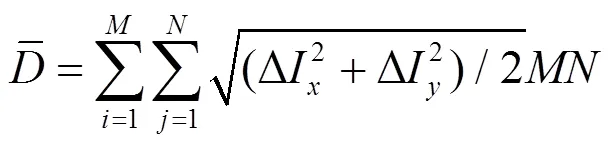

2)平均梯度。平均梯度反映了图像中的微小细节反差与纹理变化,同时也反映了图像的清晰度,它的值越大说明融合后的图像纹理越清楚,其计算公式如下:

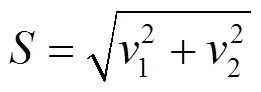

3)标准差。图像的标准差反映了各像素灰度相对于该图像灰度均值的离散情况,标准差越大,则灰度级分布越分散,而灰度级的起伏和梯度反映了图像的细节、纹理和边缘信息,其计算公式为:

4)均方根误差。反映了融合结果图像和待融合图像的近似程度,当均方根误差值越小,说明两幅图像越相似,结果图像越接近原图像,这也表明了原图信息被大部分保留下来,图像融合效果好,其计算公式为:

根据上述客观评价标准,对IHS变换、小波变换和基于IHS小波变换相结合的图像融合结果进行客观数据评价。评价结果如表1所示。

表1 融合图像的客观评价

通过对小波变换、IHS变换以及基于IHS变换与小波变换的算法处理结果分析,本文算法比IHS变换后图像的熵提高了0.6%,表明融合后的图像包含信息量略有提高;比IHS变换后图像的标准差提高了33%,表明融合后的图像细节纹理信息有很大的提高;比小波变换后图像的均方根误差降低了22%,表明较多的图像信息被保留下来。从算法运行时间复杂度分析,小波变换需要对图像的每一个色彩通道均进行变换,而小波变换与IHS变换结合后,只需对可见光图像的亮度分量与红外图像进行小波变换,从而大大减少了算法的运算时间,提高了图像处理速度。通过对图像处理的数据分析进一步验证了本文提出的基于IHS变换与小波变换的汽车抗晕光方法的有效性。

4 结束语

为了克服汽车夜间行车时的晕光现象,利用可见光传感器采集车辆颜色、车牌号码、道路环境等细节信息,红外传感器识别汽车前大灯晕光区域,提出了对可见光图像和红外图像进行IHS和小波变换相融合的抗晕光算法。通过对图像算法处理结果的主观评价与客观数据分析,基于IHS小波变换相融合的图像处理算法克服了夜间行车中的晕光问题,提高了图像的空间分辨率,保留了图像的细节信息。

[1] 韩宝玲, 黄贞华, 何炜. 新型汽车红外夜视系统的研究与开发[J]. 计算机测量与控制, 2004(9): 874-876.

[2] 芦雅静, 宋宝安, 董伟, 等. 硫系玻璃在汽车夜视系统中的应用[J]. 红外与激光工程, 2014(9): 2815-2818.

[3] Jian Wang, Zhe Yang, Quanmin Guo. Research on video anti-blooming[C]// 2010 3: 491-494.

[4] Wang Jian, GaoYong. Research of anti-blooming array CCD image sensor[C]//,.,, 2007, 6829: 682912-1-7.

[5] 宋敏, 张蓉竹, 孙年春. 基于红外与微光融合图像的夜视仪设计[J]. 红外技术, 2014, 36(11): 885-889.

[6] Zhang Yun, Hong Gang. An IHS and wavelet integrated approach to improve pan-sharpening visual quality of natural color IKONOS and Quickbird images[J]., 2005, 6(3): 225-234.

[7] Tu TeMing, Su ShunChi, Shyu HsuenChyun, et al. A new look at IHS-like image fusion methods[J]., 2001, 2:177-186.

[8] Hong Gang, Zhang Yun, Bryan Mercer. A wavelet and IHS integration method to fuse high resolution SAR with moderate resolution multispectral images[J]., 2009, 75(10): 1213-1223.

[9] 刘建伟, 宋梦馨, 郭平. 一种基于HSI和小波变换的遥感图像融合方法[J]. 北京师范大学学报: 自然科学版, 2008, 44(6): 595-598.

[10] 孙永明, 吴谨, 刘劲, 等. 基于DWT的高频系数压缩感知图像融合[J]红外技术, 2014, 36(9): 714-718.

[11] 梁苏苏, 张鹤鸣, 段彩梅. 一种基于IHS变换和小波变换的多源遥感影像融合新方法[J]. 现代测绘, 2013, 36(3): 16-18, 29.

[12] Stephen R Schnelle, Alex Lipchen Chan. Enhanced target tracking through infrared-visible image fusion[C]//14,,, 2011.

[13] 刘贵喜, 杨万海. 一种像素级多算子红外与可见光图像融合方法[J]. 红外与毫米波学报, 2001(3): 207-210.

[14] 柴奇, 杨伟, 管怡, 等. 一种改进的可见光与红外图像融合算法[J]. 红外技术, 2008, 30(2): 87-90.

[15] 常化文, 陈春香. 基于HSV变换与小波变换的遥感图像融合[J]. 计算机工程与设计, 2007, 28 (23): 5682-5684.

[16] 杨晓慧, 金海燕, 焦李成. 基于DT-CWT的红外与可见光图像自适应融合[J]. 红外与毫米波学报, 2007(6): 419-424.

[17] 赵辽英, 马启良, 厉小润. 基于IHS小波变换和MOPSO的全色与多光谱图像融合[J]. 物理学报, 2012, 61(19): 185-193.

[18] 王宇庆, 王索建. 红外与可见光融合图像的质量评价[J]. 中国光学, 2014, 7(3): 396-401.

Vehicles¢Anti-blooming Method Based on Visible and Infrared Images Fusion

GUO Quan-min,LI Xiao-ling

(,,710021,)

To eliminate halation phenomenon caused by vehicles¢headlights when driving at night and improve night driving safety, this paper proposes a vehicle anti-halation method based on visible light and infrared images fusion. The method extracts intensity component on visible light image by IHS transform, which is used to process wavelet transform with infrared image to obtain a new intensity component. To achieve the goals of eliminating halation phenomenon and containing image details, the new component, is processed with hue component and saturation component by inverse IHS transform to get a fusion image. Subjective evaluation and objective data analysis of the results on visible light and infrared images fusion algorithm show this method improves anti-halation effect efficiently when driving at night, decreases the spectrum distortion of traditional IHS transform and increases the speed of wavelet transform.

vehicles¢anti-halation,image fusion,IHS transformation,wavelet transformation

TP391

A

1001-8891(2015)06-0475-04

2015-01-23;

2015-03-16.

郭全民(1974-),男,副教授,主要研究方向为智能传感与信息融合、图像处理及机器视觉。E-mail:guoqm@163.com。

陕西省教育厅科研计划项目,编号:11JK0989。