基于多聚焦红外图像的温度测量及三维重构

2015-04-03刘中意胡志宇

刘中意,张 春,胡志宇,3

基于多聚焦红外图像的温度测量及三维重构

刘中意1,2,张 春2,胡志宇1,2,3

(1.上海大学 机电工程与自动化学院,上海 200072;2.上海大学 纳微能源研究所,上海 200444;3.上海交通大学 微米/纳米加工技术国家重点实验室,上海 200240)

由于红外镜头景深小,测量表面超过景深范围的样品不能得到所有位置均清晰聚焦的红外图像。提出了基于多聚焦图像融合的曲面温度测量及被测物体三维重构的方法。该方法采集同一视场不同聚焦深度的红外图像,利用多聚焦图像融合算法,获取所有位置均清晰聚焦的红外图像,即准确的红外信息。再查温度标定表,根据灰度值可得准确的温度值。最后,利用多聚焦图像系列附带的深度信息重构出表面三维高度图。实验表明,应用此方法可以准确测量物体表面温度信息,三维重构图与全聚焦图像形成信息互补。

红外热像;多聚焦图像融合;温度测量;三维重构

0 引言

在成像系统里,视野范围内的物体处于聚焦区域时,物体才会形成清晰聚焦的图像;不在聚焦区域的物体,成像模糊。当视野范围内的物体表面起伏超过镜头的景深大小时,总有某些区域不能清晰成像。红外热成像系统利用物体的清晰成像反映物体的温度信息。为了准确测量物体表面温度,获取全聚焦的红外图像非常重要。当物体表面起伏超过景深时,利用多聚焦图像融合技术获取全聚焦红外图像。

图像融合技术目前已被广泛应用于整合多幅图像的互补和冗余信息,得到一幅复合图像,方便人或机器的理解以便进一步的工作[1]。

图像融合在很多领域发挥着重要作用,如遥感、生物医学成像、计算机视觉和防御系统[2-4]。然而这些领域主要研究的是可见光波段(300~700nm),比较少有关于红外热光谱(3~14mm)的图像融合的研究。除了文献[1],关于红外热光谱的多聚焦图像融合的研究少之又少。在我们的研究工作中,多聚焦图像融合用来实现比单幅红外图像更为准确的温度测量。

1 平台和方法

1.1 温度测量平台

本课题组研发的红外显微热像系统,集成了红外热成像功能和显微放大功能,可以测量微小区域的温度。它用红外图像的灰度信息映射温度信息。不同材质的物体的红外辐射不一样,所以利用黑体辐射源来标定不同材质的温度值和红外图像灰度值的映射关系。

红外相机采用的是昆明北方红外公司的YF-1001型号的非制冷相机。相关参数:敏感光谱为7~14mm、图像分辨率为320×240像素、温度敏感度为0.1℃、测温范围为0~300℃、空间分辨率为40mm、视野大小为11.5mm×8.5mm、聚焦距离为12mm、景深为0.3mm。

1.2 聚焦对温度测量的影响

在红外图像中,像素的灰度值对应着测量物体的温度值。如果测量物体处在聚焦状态,则红外图像可以准确地反映温度信息[1]。

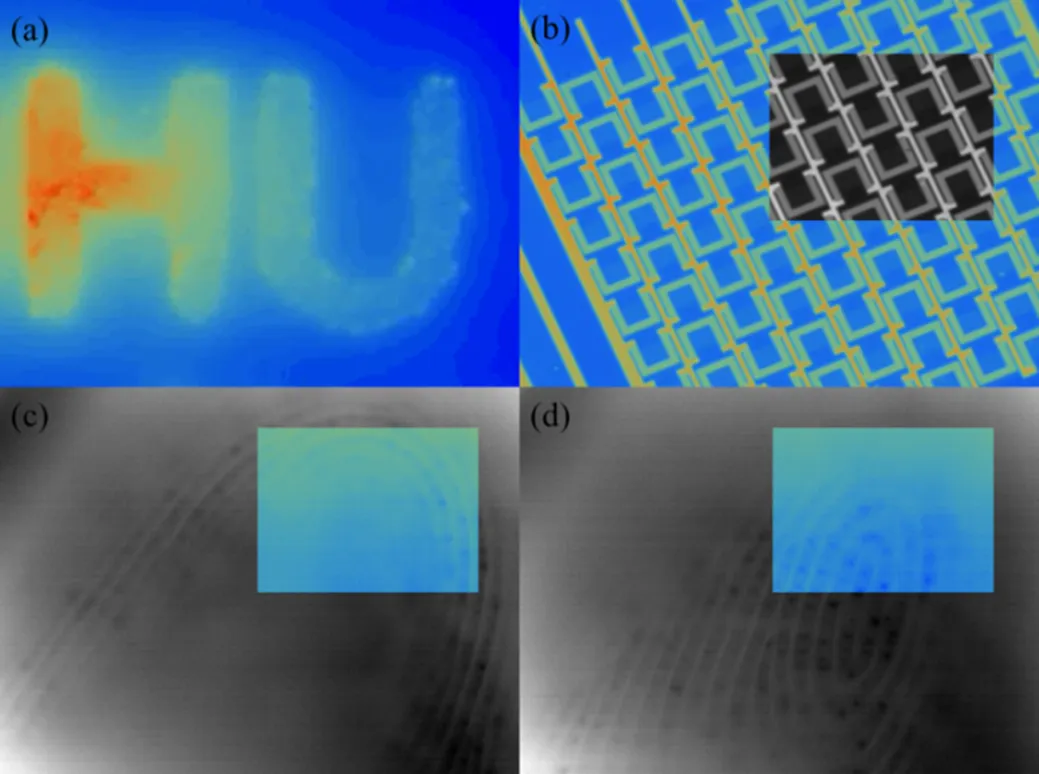

受到景深限制,只有测量物体表面在一个景深大小范围内变化时,红外相机才能获取一幅全聚焦的红外图像。如果测量物体表面变化超过一个景深大小,则红外图像中总有某些位置处于非聚焦状态,这些位置是模糊的,它们的灰度值不能准确地反映被测物体在该位置处的温度值。图1是测量物体的红外图像,黑白图像是红外图像,彩色图像是对应的伪彩色图像。图1(a)是带有图形催化剂的薄膜在通入可燃性气体时发生氧化反应的状态,图1(b)是通电情况下的电阻丝。薄膜和电阻丝均具有较为平坦的表面,即在一个景深范围内,故可以得到全聚焦状态的红外图像,因而测量的温度也是准确的。图1(c)和(d)是手指分别在不同位置聚焦的红外图像。由于手指表面变化超过一个景深大小,所以红外图像中总有一部分处于模糊状态,这部分就不能准确反映手指表面的温度。(手指红外图像中,较大的黑点是汗腺位置,由于散热,故温度较低。)

图1 测量物体的红外图像

1.3 多聚焦图像序列采集原理

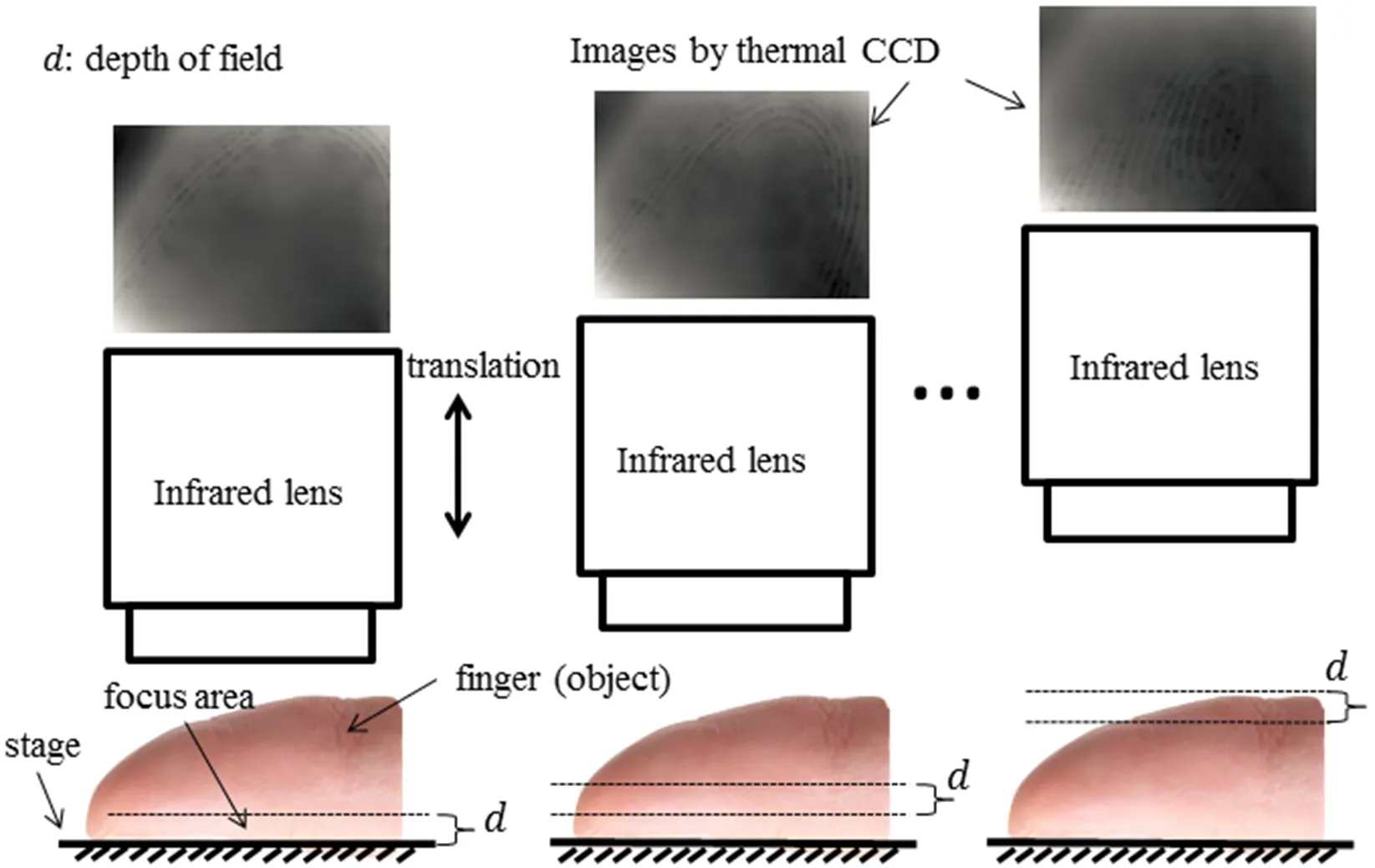

为了获取测量物体的准确温度信息,必须获取一幅全聚焦的红外图像。对于表面变化超过景深大小的测量物体,不可能单从一幅红外图像中得到全聚焦红外图像。因此,多聚焦图像融合技术被选择用以获取全聚焦红外图像。运用多聚焦图像融合,首先需要获取多聚焦图像序列。实验中,在竖直方向上移动红外相机,并有规律地采集一系列红外图像。如图2所示,红外相机从下往上移动的过程中,每隔一定距离采集一幅红外图像,距离间隔不超过一个景深大小。图中测量物体是手指,从采集的红外图像可以看出,聚焦位置向中心移动,因为中心位置较高。

2 多聚焦图像融合

获取多聚焦红外图像序列之后,再运用多聚焦图像融合技术获取一幅全聚焦图像。小波变换提供图像的双正交基的多分辨率分解,已经被广泛应用于图像处理领域。本文选用基于小波变换的多聚焦图像融合方法。

由于涉及的是数字图像,故相应地选择二维离散小波变换。二维离散小波变换将多聚焦图像分解成图像的低频信息(近似部分)和图像的高频信息(细节部分),分别叫做低频系数和高频系数[5-7]。每幅图像都对应着高频系数和低频系数,将所有图像的高频系数和低频系数按照一定的融合法则分别进行融合,将最后得到的高频系数和低频系数进行二维离散小波逆变换,得到一幅融合图像。

本文中需要得到全聚焦的红外图像,全聚焦位置包含着更多的高频信息,而模糊位置包含着更多的低频信息,故本文的融合规则为选择较大的高频系数和较大的低频系数。为了获取更好的融合效果,需要将图像进行更多层次的小波分解,本文选择了5层小波分解。下式表示基于小波的图像融合过程:

f(,)=IDWT{[DWT(1(,),2(,))]} (1)

式中:为融合规则;DWT表示离散小波变换;IDWT表示离散小波逆变换;表示红外图像;f表示融合图像;(,)表示图像中像素坐标。

图2 多聚焦图像采集原理

3 实验结果和评价

本文针对多聚焦融合图像和单一图像的测温比较,重点在于比较测温准确度的提高。在多聚焦图像采集中,每相邻两幅图像的位置间隔是一个重要变量,本文也探讨了位置间隔大小对图像融合效果的影响。本文选用了工作中的芯片和手指作为两组实验对象。

3.1 评价指标

图像融合性能评价指标包括带有参考图像的评价指标和不带参考图像的评价指标。在红外成像中,受限于景深,很难获取一幅全聚焦的图像作为参考图像。文献[1]中,红外相机视野里只有两个相互分离的物体,聚焦位置相差大于一个景深,故其参考图像可以直接从两幅各自聚焦一个物体的图像裁剪后拼接而成。实际应用中,测量物体可能包含不止两个物体甚至相互交叠,并且处于不同的聚焦位置。如本文中测量物体为芯片和手指,具有复杂变化且超过一个景深范围,较难获取参考图像,因此本文采用不带参考图像的评价指标。评价指标如下[6]:

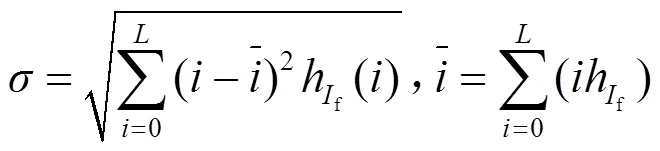

1)标准差[8]:

式中:Hf()是融合图像;f(,)的标准化直方图;是图像的灰度级。

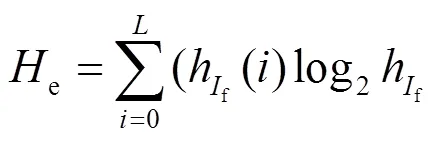

2)熵[9]:

3)空域频率[10]:

4)融合互信息[11]:

FMI=MI1f+MI2f(7)

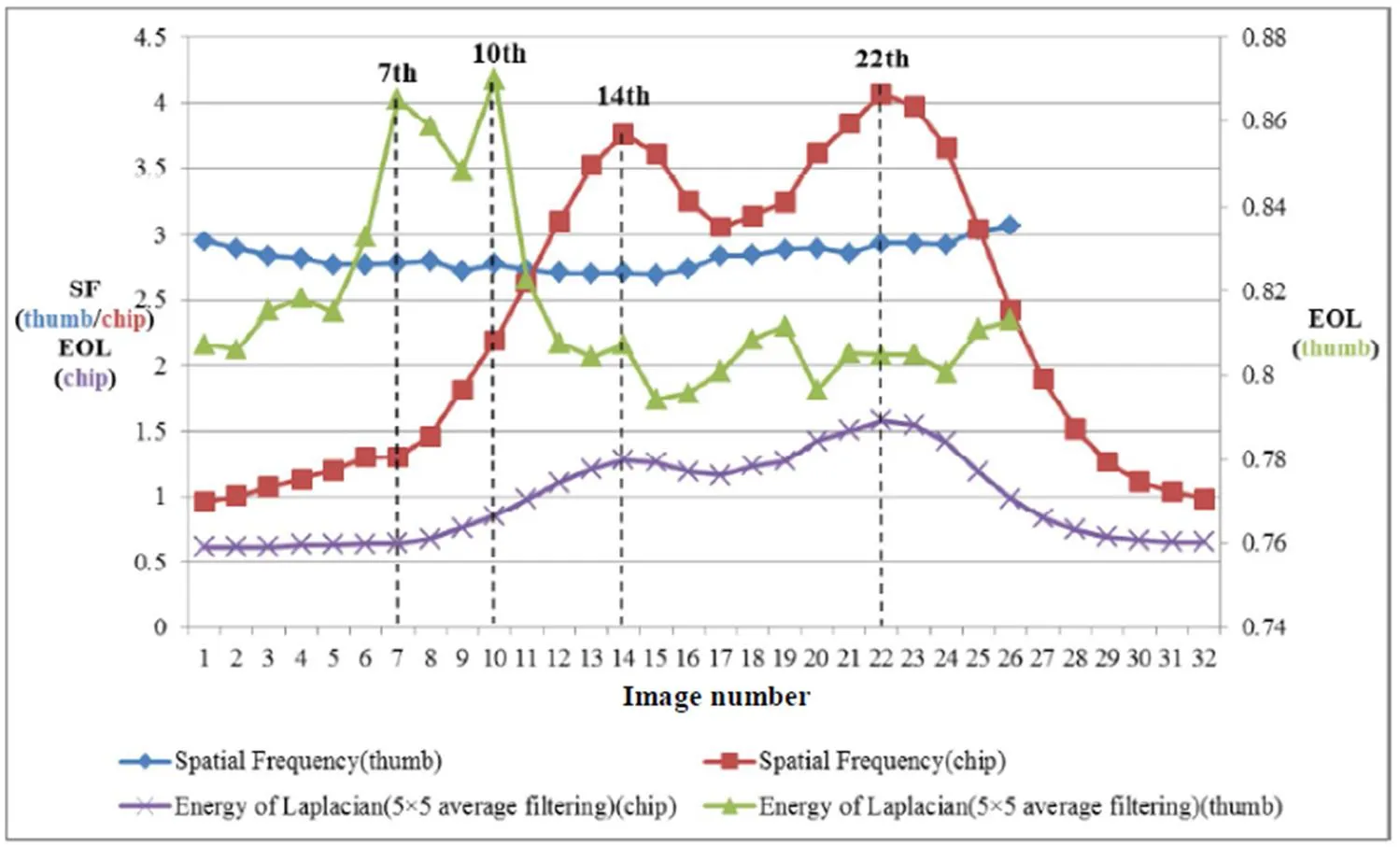

5)拉普拉斯能级[12]:

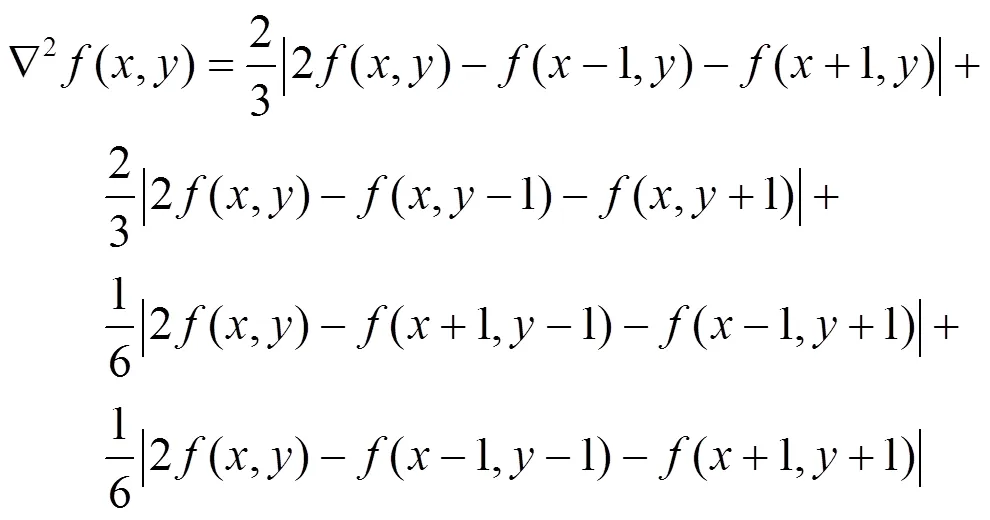

3.2 融合效果评价

本文采集了两组多聚焦红外图像:工作中的芯片和手指。

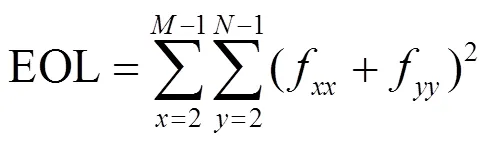

图像序列1:工作中的芯片。采集过程中,竖直向下移动红外相机,芯片中心较周围位置高,故最先聚焦的位置在芯片中心,随着相机移动,聚焦位置逐渐向周围移动。图像采集的位置间隔为0.1mm,共采集了32幅红外图像。如图3所示,图3(a)~(f)分别是32幅红外图像中的第6、10、14、18、22和26幅,聚焦位置由中心向周围移动。图3(g)~(i)是融合图像,分别取自32幅图像中的2幅、8幅和32幅融合而成,位置间隔依次为1.6mm、0.4mm和0.1mm。可以看出图3(i)是聚焦区域最多的融合图像。

图像采集的位置间隔的选取要小于等于一个景深大小,我们比较了不同位置间隔下的融合图像的各种评价指标,如表1所示。这些评价指标是标准差、熵、空域频率、融合互信息和拉普拉斯能级。位置间隔为0.1mm、0.2mm、0.3mm、0.4mm、0.8mm和1.6mm。表1中,标准差、熵、空域频率和拉普拉斯能级都可以表明:位置间隔越小,融合图像具有更清晰的细节信息,即更能准确的反映温度信息。但图像融合的处理时间也会越长,同时随着位置间隔的变小,相邻图像差异变小,各评价指标也会趋于饱和。

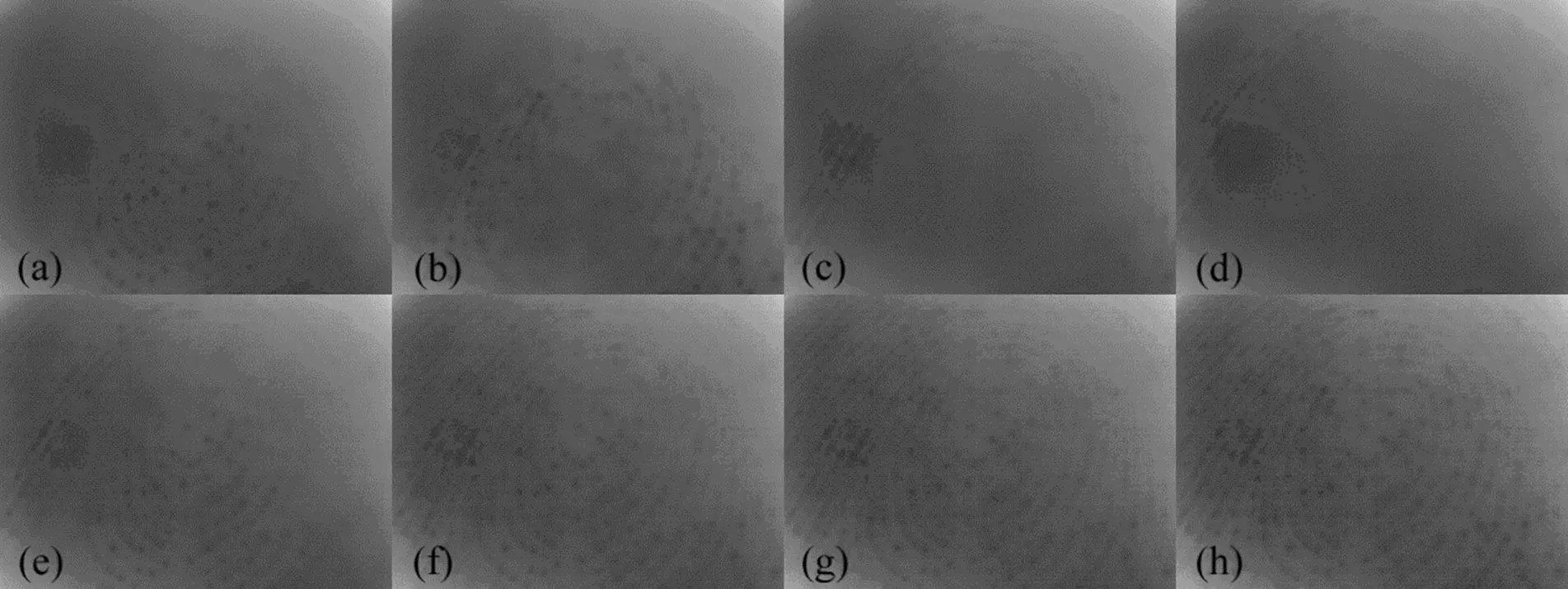

图像序列2:手指。每隔0.2mm采集一幅红外图像,共采集26幅。如图4所示,图4(a)~(d)是26幅红外图像中的第5、9、13和17幅,聚焦位置由中心向周围移动。图4(e)~(h)是融合图像,分别取自26幅图像中的3幅、6幅、13幅和26幅融合而成,位置间隔依次为1.6mm、0.8mm、0.4mm和0.2mm。可以看出图4(h)是聚焦位置最多的融合图像。

如表2所示,标准差、熵、空域频率和拉普拉斯能级同样都可以表明:位置间隔越小,融合图像具有更清晰的细节信息,即更能准确地反映温度信息。

图3 工作中的芯片的红外图像

表1 不同位置间隔的融合图像的评价指标(图像序列1)

The 14th and 22th images are calculated as comparison.

图4 手指的红外图像

表2 不同位置间隔的融合图像的评价指标(图像序列2)

The 7th and 10th images are calculated as comparison.

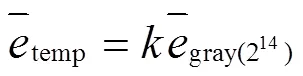

4 温度和误差

获取红外图像后,可以通过像素点的灰度值查表,映射出对应的温度值。映射表是灰度和温度的映射关系,是通过黑体辐射标定的,因此可以作为一个标准。下面对实验中被测物体在使用单一图像和多聚焦融合图像测量温度时二者之间的误差进行计算。因为位置间隔非常小(如0.1mm,小于景深0.3mm)的多聚焦融合图像是全聚焦图像,因而可以认为测量的温度是准确的。故将二者之间的误差作为测量温度时提高的测量精度。

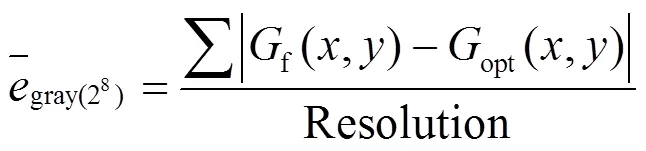

4.1 单一图像的选取

最优图像包含聚焦区域最多,故通常具有最大的活动能级[1]。本文从多聚焦图像序列中选择活动能级最大的图像作为单一图像测量时的最优图像。作为活动能级的计算指标,空域频率和拉普拉斯能级被用来计算两组图像的活动能级,如图5所示。空域频率能反映出图像序列1(芯片)中各图像的活动能级差别,但不能反映图像序列2(手指)中各图像的活动能级差别。拉普拉斯能级可以反映图像序列1和图像序列2中各图像的活动能级差别。从图中可以看出,图像序列1中的第14和第22幅图像、图像序列2中的第7和第10幅图像被分别选为各自的最优图像。

4.2 误差计算

单一图像和多聚焦融合图像之间的误差图像如图6所示。图6(a)和(b)分别是图像序列1(芯片)中第14幅、第22幅图像与融合图像之间的误差图像。图6(c)和(d)分别是图像序列2(手指)中第7幅、第10幅图像与融合图像之间的误差图像。

按照公式10、11和12可以计算出单一图像测温与多聚焦图像测温之间的误差。如表3所示,在测量工作中的芯片温度时,平均温度误差至少为0.68℃,即采用多聚焦图像融合技术时,测量准确度至少提高了0.68℃(平均到每个像素点);在手指的温度测量中,平均温度误差至少为0.11℃,即采用多聚焦图像融合技术时,测量准确度至少提高了0.11℃(平均到每个像素点)。

5 三维重构

由于采用多聚焦图像融合测温时,所采集的每幅图像都具有对应的采集位置信息,即图像中聚焦区域具有对应的深度信息。通过聚焦评价函数获取每一区域对应的最清晰位置(即深度),重构出一幅表面三维结构图。

图5 按照空域频率和拉普拉斯能级选取图像

图6 误差图像

因为聚焦区域包含较多的高频分量,类似与单一最优图像选取中用到的拉普拉斯活动能级,三维重构中的聚焦评价函数选用改进的拉普拉斯算子[13-14],如下式:

数字图像处理中,用差分代替微分进行计算。采用改进的窗口大小为3×3的拉普拉斯算子。如下式:

在进行聚焦评价之前,采用窗口大小为2×2的平滑滤波器削弱噪声影响。获取高度图之后,采用了6×6的中值滤波器使重构出的表面更加平滑。图7所示为不同视角的三维重构高度图。

在获取了多聚焦融合图像和三维重构的高度图之后,使用融合的全聚焦红外图像渲染到三维高度图的表面,使测试物体表面深度信息与红外信息形成互补。图8所示为三种不同视角下的用红外融合图像渲染的三维高度图。

图7 三维重构高度图

6 结论

本文提出了基于多聚焦图像融合的曲面温度测量及被测物体三维重构的方法。该方法采集同一视场不同聚焦深度的红外图像序列,利用多聚焦图像融合,获取所有位置均处于聚焦状态的红外图像。再查温度标定表,可得准确的温度信息,同时,与单一图像测温进行了误差对比分析。最后,利用多聚焦图像系列附带深度信息的特点,通过聚焦评价函数重构出被测物体表面的三维深度信息,并将全聚焦红外图像渲染到三维深度图。实验表明,应用此方法,可以准确测量物体表面温度信息,三维重构图可以辅助测量分析。

表3 平均灰度误差和平均温度误差

图8 红外融合图像渲染高度图

[1] Benes R, Dvorak P, Faundez-Zanuy M, et al. Multi-focus thermal image fusion[J]., 2013, 34(5): 536-544.

[2] 宋敏, 张蓉竹, 孙年春. 基于红外与微光融合图像的夜视仪设计[J]. 红外技术, 2014, 36(11): 885-889.

[3] 韦道知, 黄树彩, 夏训辉, 等. 基于时空域融合滤波的小目标检测算法[J]. 红外技术, 2014, 36(11): 905-908.

[4] 许廷发, 李俊涛, 张一舟, 等. 真彩色传递双波段图像融合[J]. 中国光学, 2014, 7(3): 402-410.

[5] Pajares G, J Manuel de la Cruz. A wavelet-based image fusion tutorial[J]., 2004, 37(9): 1855-1872.

[6] Naidu V, Raol J. Pixel-level image fusion using wavelets and principal component analysis[J]., 2008, 58(3): 338-353.

[7] Nikolov S, Hill P, Bull D, et al. Wavelets for image fusion[J]., 2001, 19: 213-241.

[8] Blum, Rick S, Zheng Liu, et al.[M]. Boca Raton, FL: CRC press, 2005.

[9] Bruce King, Leung Lau Wai, Comparison of image data fusion techniques using entropy and INI[C]//22, 2001: 15-20.

[10] Eskicioglu A M, Fisher P S. Image quality measures and their performance[J]., 1995, 43(12): 2959-2965.

[11] Cvejic N, Loza A, Bull D, et al. A similarity metric for assessment of image fusion algorithms[J]., 2005, 2(3): 178-182.

[12] Faundez-Zanuy M, Mekyska J, Espinosa-Duró V. On the focusing of thermal images[J]., 2011, 32(11): 1548- 1557.

[13] 王金岩, 史文华, 敬忠良. 基于Depth from Focus的图像三维重建[J]. 南京航空航天大学学报, 2007, 39(2): 181-186.

[14] 王娜, 周权. 光学显微镜下微小物体的三维重构[J]. 光电工程, 2010, 37(11): 84-90.

Temperature Measurement and 3D Reconstruction Based on Multifocus Thermal Images

LIU Zhong-yi1,ZHANG Chun2,HU Zhi-yu1,2,3

(1.,,200072,; 2.,,200444,;3.,,200240,)

Because of the short depth of field of thermal camera, it is hard to get a thermal image of all-focus, especially the objects whose surface fluctuation is out of the depth of field. Points which are not focused in thermal image can’t reflect the temperature information accurately. This paper proposes a method based on multifocus image fusion to resolve the problem. The method gets an all-focus image from multifocus images. The method improves the object temperature measurement error up to 0.68 degrees Celsius (average sharing to every pixel of thermal image) in working chip and 0.11 degrees Celsius in the skin of thumb. By the way, 3D surface reconstructed by depth form focus is achieved to give more information about test objects.

infrared image,multifocus image fusion,temperature measurement,3D reconstruction

TP391.41

A

1001-8891(2015)06-0449-08

2014-12-17;

2015-01-25.

刘中意(1988-),男,硕士研究生,主要研究方向为图像处理和模式识别。

胡志宇(1965-),男,博士,教授,主要研究方向是纳米量级高效低污染能量转换元器件及其应用、薄膜纳米结构功能材料等。

上海市科委科技攻关项目,编号:11DZ1111200;云南省科技厅省院省校科技合作专项,编号:2010AD003。