遮挡情况下多尺度压缩感知跟踪

2015-04-02张丽娟李泽仁

张丽娟,纪 峰,常 霞,李泽仁

遮挡情况下多尺度压缩感知跟踪

张丽娟,纪 峰,常 霞,李泽仁

(北方民族大学数学与信息科学学院,宁夏 银川 750021)

针对现有在线学习跟踪算法中目标在线模型更新错误导致跟踪漂移的问题,提出一种在线模型自适应更新的目标跟踪算法:首先利用压缩感知技术的高效性,对多尺度图像特征进行降维,并提取多尺度样本来实现目标尺度自适应更新,再由提取的正负样本低维图像特征训练朴素贝叶斯分类器,利用分类器输出置信度最大处目标样本完成目标跟踪,并依据当前目标置信度来自适应在线模型更新速率,减少了遮挡带来的目标错误更新。实验表明:该方法在尺度变化、局部和全局遮挡、光照变化等情况下均能完成鲁棒跟踪,平均跟踪成功率较原始压缩感知跟踪算法提高了20.3%。

目标跟踪;在线学习;压缩感知

0 引言

目标跟踪是当前计算机视觉领域内的一个重要研究方向,在视频监控、运动分析、目标识别等方面得到了广泛应用[1],为了完成鲁棒的目标跟踪任务,目标在线模型受到了广泛关注,而基于目标在线模型,当前跟踪算法可分为生成式跟踪算法[2-4]和判别式跟踪算法[5-8]。

生成式跟踪算法通过提取目标信息来完成目标表示,然后利用在线学习到的目标模型在当前帧中基于最小重构误差完成目标定位,但该类方法忽略了判别性较强的背景信息。判别式跟踪算法将目标跟踪构建为一个二元分类问题,同时提取目标与背景信息来训练一个分类器,由分类器决定当前帧目标位置,因此也称为基于检测的跟踪算法(tracking by detection)。Grabner等[5]提出了一种在线半监督boosting跟踪算法,利用未标签样本克服了分类器错误更新而导致的跟踪漂移问题;Babenko等[6]将多示例学习的思想引入目标跟踪,利用包含有正负样本的“样本袋”来代替单一样本送入分类器训练,提高了分类器的判别能力;近来Kalal等[7]提出了一种结构化约束准则来提升分类器对正负样本的选择,提升了分类器的抗背景干扰能力。然而这类算法普遍复杂度较高,为此限制了它们的实时应用。

文献[8]在充分利用上述两类算法的各自优势的基础上,提出了一种实时跟踪算法——压缩感知跟踪(Compressive Tracking,CT),通过建立一个随机投影矩阵对多尺度图像特征进行降维,并通过朴素贝叶斯分类器进行分类,其高效性引起了学者的广泛关注:文献[9]通过过饱和分块提升了CT的抗局部遮挡能力,但计算复杂度也随之增高;文献[10]利用模板匹配策略提升了分类器的判别能力,文献[11]用互补的多个矩阵代替CT中的投影矩阵。然而上述算法依然存在以下问题:第一,缺乏对目标尺度的自适应更新;第二,缺乏对遮挡的有效判断,进而导致目标在线模型错误更新。

针对以上两个问题,本文在利用压缩感知理论提取图像特征的高效性的基础上,采取多尺度样本来实现目标尺度自适应更新,在由分类器得到当前帧目标位置后,依据当前目标置信度来自适应在线模型更新速率,减少了遮挡带来的目标错误更新,进而能够完成鲁棒的跟踪任务。

1 压缩感知跟踪算法

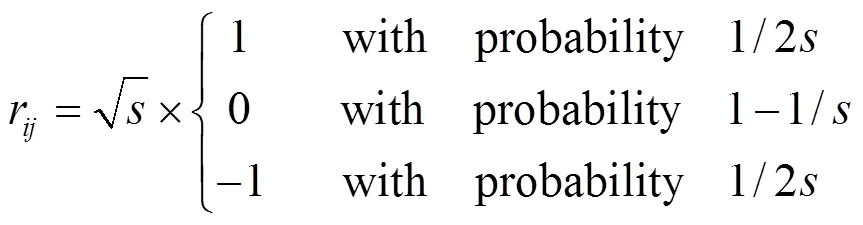

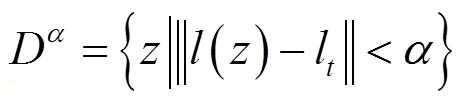

随机投影矩阵是压缩感知理论中的重要概念,其作用是将高维图像特征压缩成低维特征,如下式:

=(1)

式中:r~(0,1),在2或3之间随机选择,因此随机投影矩阵中的大量元素为零,大大减少了计算量。

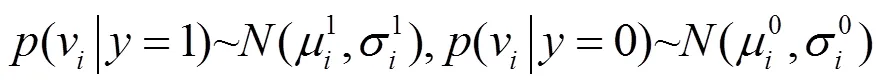

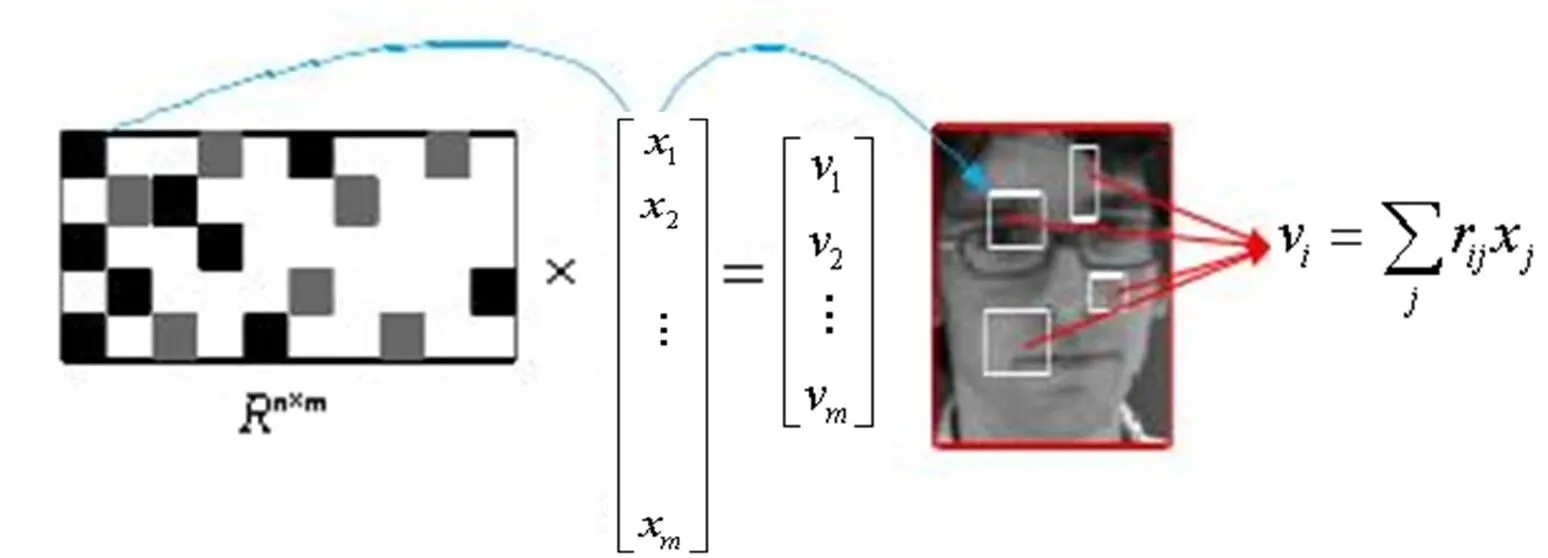

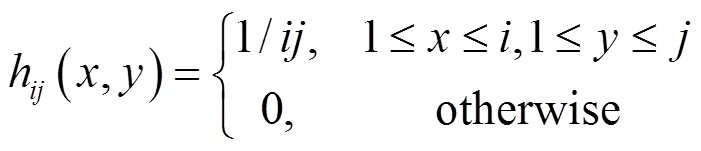

式中:和是矩形滤波器的宽和高;和是样本窗口的宽和高。通过公式(1)高维特征将被压缩成低维特征,文献[8]中采取类Haar特征的加权组合并采取积分图像加速,如图1所示。

其中:

对所有采样样本计算其()值,选择最大的候选样本作为最终跟踪结果,再在其周围采样新的正样本,计算其特征值对公式(5)进行更新:

式(6)中:1,1分别是正样本图像特征的均值和方差;为学习率,原始算法中固定为0.85。

2 本文算法

从以上的分析可以发现CT算法存在两大问题:一是式(3)中多尺度滤波器采用固定大小,一旦目标尺度发生变化将无法提取到正确的特征信息;二是在线模型中采用固定学习速率,当目标受到遮挡或光照变化等因素影响时模型将产生更新错误。为此本文提出改进策略:采取多尺度样本来实现目标尺度自适应更新;依据当前目标置信度来自适应在线模型更新速率。

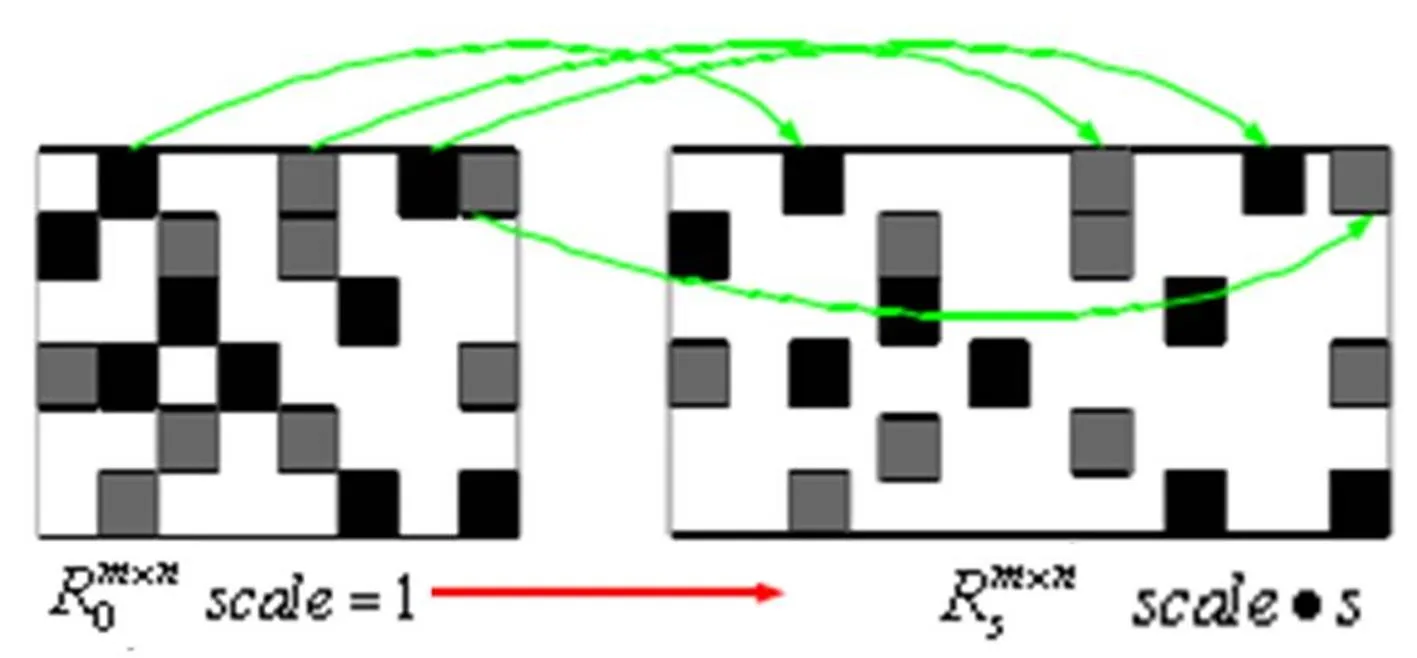

2.1 多尺度更新机制

CT算法式(3)中多尺度滤波器(即图像特征)的位置和大小固定不变,当目标尺度发生变化时将不再适用,而为了自适应目标尺度变化,本文首先将图像特征根据滤波器窗口大小归一化,如下式:

图1 随机投影矩阵提取特征

0×中的每一个元素表示为0×(r,r,r,h),其中r、r、r、h分别代表矩形滤波器的位置、宽和高。在尺度下,R×的每一个元素则表示为((round(rs),(round(rs),(round(rs), (round(hs))。

2.2 学习率自适应更新机制

从式(6)可以发现CT算法采用固定学习率更新在线模型,当目标受到遮挡或光照变化等因素影响时模型将产生更新错误,容易导致跟踪漂移。实验表明由分类器()得到的每一帧目标置信度值是不一样的,因此可以采用当前帧目标置信度值来决定式(6)中学习率的大小,如下式:

式中:H()代表第帧的目标置信度值;max()代表当前所有帧目标置信度值中的最大值;代表第帧学习率的大小,当目标被局部遮挡或受光照变化影响时,目标置信度值较小,所以取较小值,而当H()<0时,则说明样本被分类器判定为负样本,当前目标处于被完全遮挡状态,学习率应当置为0,目标在线模型不再更新。

2.3 目标定位

3 实验与结果分析

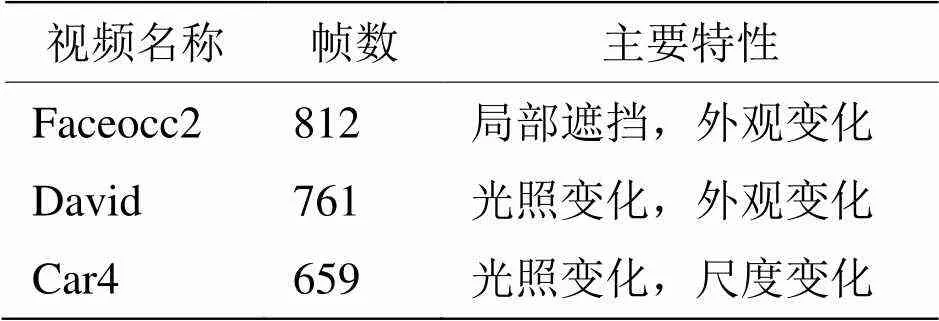

实验采用常见的具有3段不同挑战性的视频,并与原始CT算法[8]以及多示例学习MIL算法[6]进行对比分析,实验利用OpenCV2.4.9在VS2010上进行调试。视频主要特性如表1所示。

表1 实验视频的不同特性

3.1 参数设置

分类器学习率初始化为1=0.85,搜索窗口半径=25,正样本采样半径=4,负样本内外采样半径=8和=30,尺度更新机制中=1.02,=1,也即尺度空间共3个尺度。

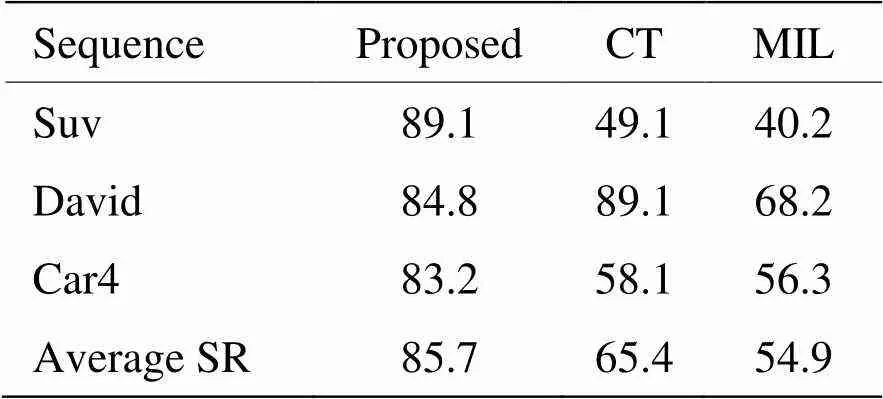

3.2 结果分析

图2 多尺度随机投影矩阵

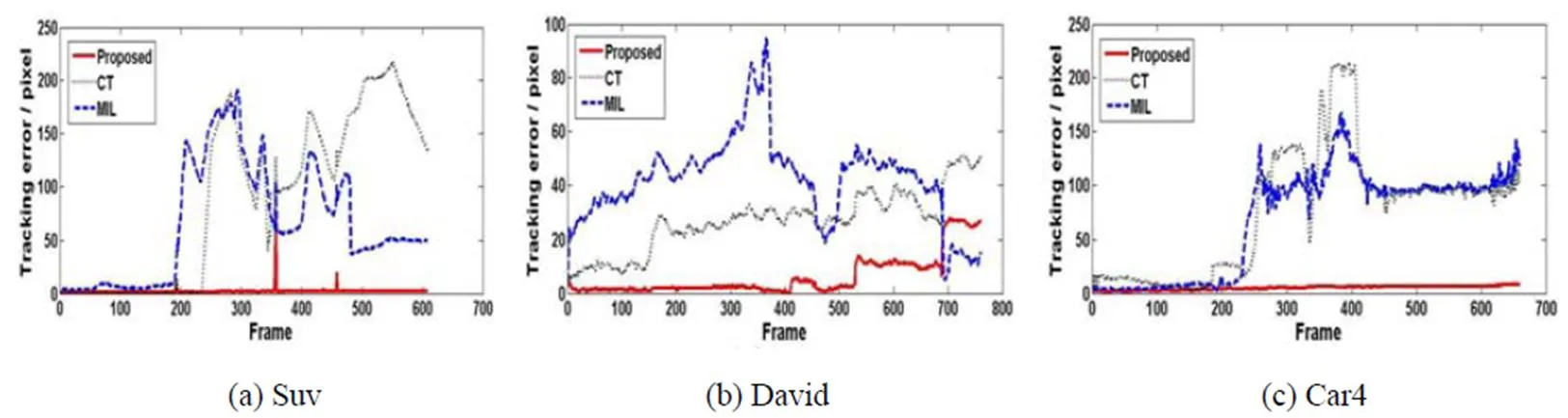

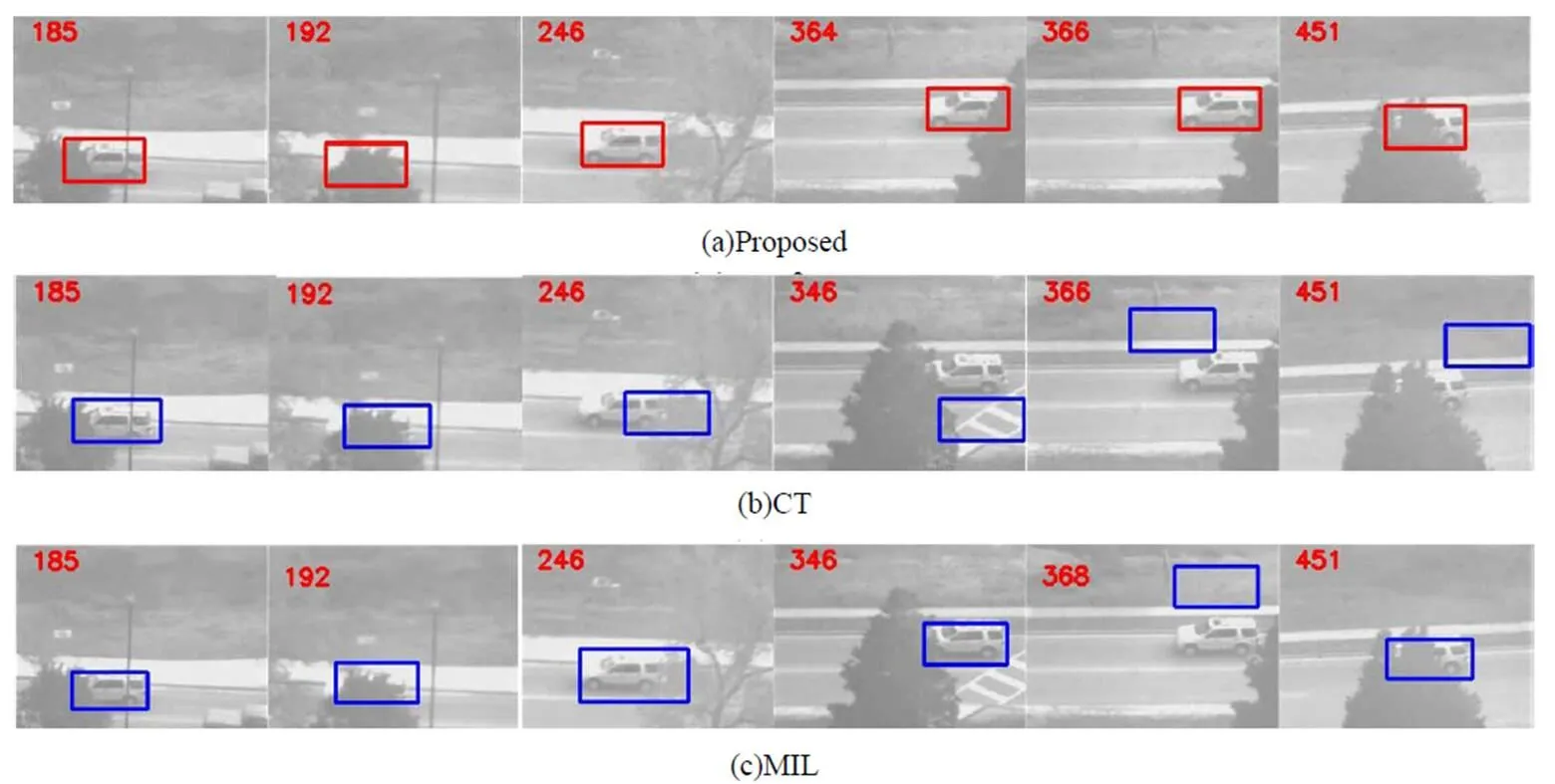

图4显示了本文算法的抗遮挡能力,Suv序列在第185帧左右目标逐步被树木遮挡,CT算法由于采用固定学习率不断将错误信息更新到在线模型而逐渐丢失目标,MIL算法在第350帧左右目标被遮挡后也出现了同样的问题,而本文算法一旦判定完全遮挡则不再更新在线模型,全程完成了鲁棒跟踪任务。

表2 算法跟踪成功率对比

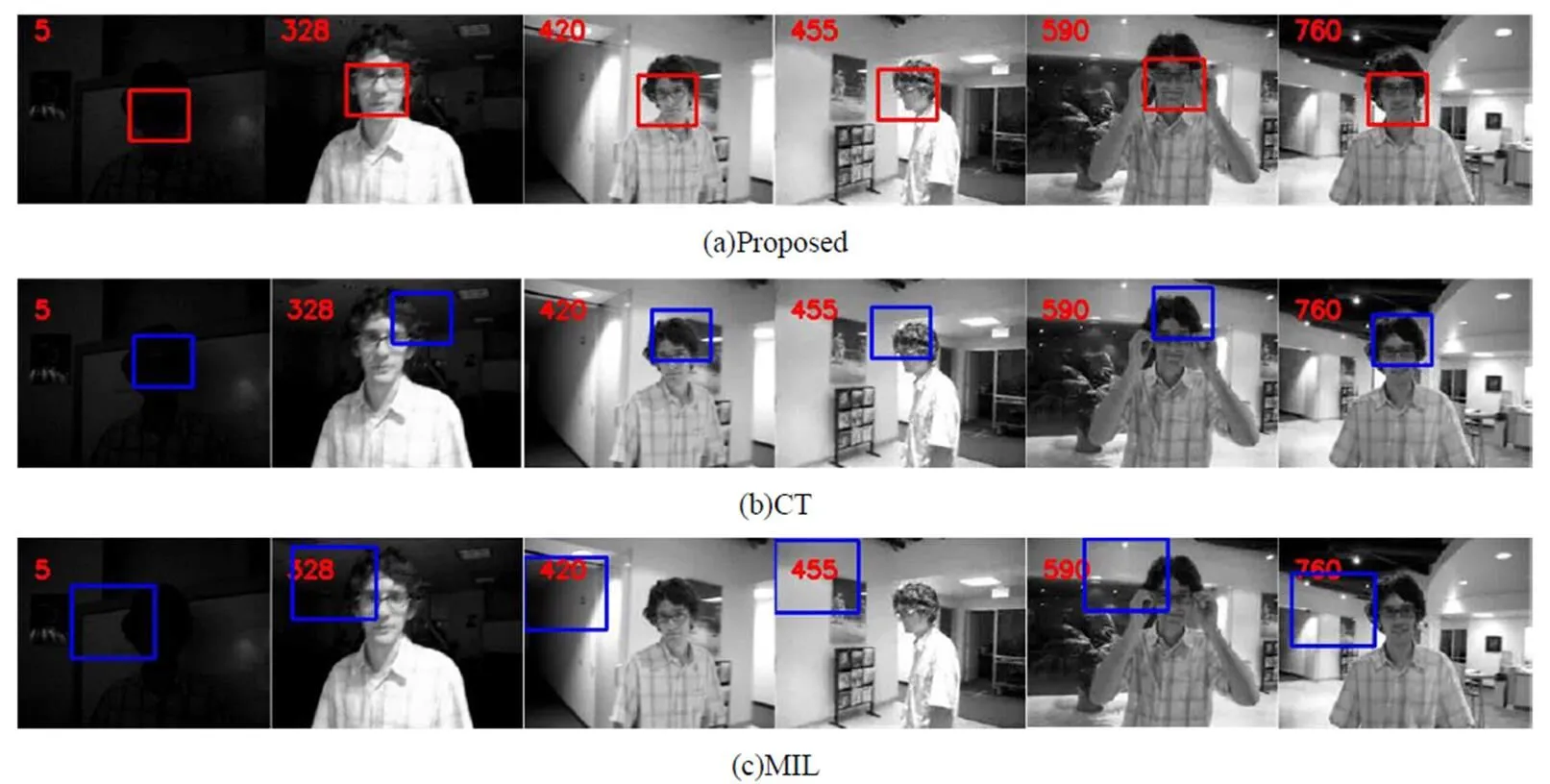

图5显示了本文算法的抗光照变化能力,David序列中目标从暗处走向亮处,且目标多次出现形变,CT算法和MIL算法由于缺乏对目标信息的有效判断,跟踪框逐渐偏移目标,而本文算法的全程鲁棒跟踪显示了本文算法的抗光照变化能力。

图3 视频序列跟踪误差

Fig.3 Video sequence tracking error

图4 Suv序列跟踪结果

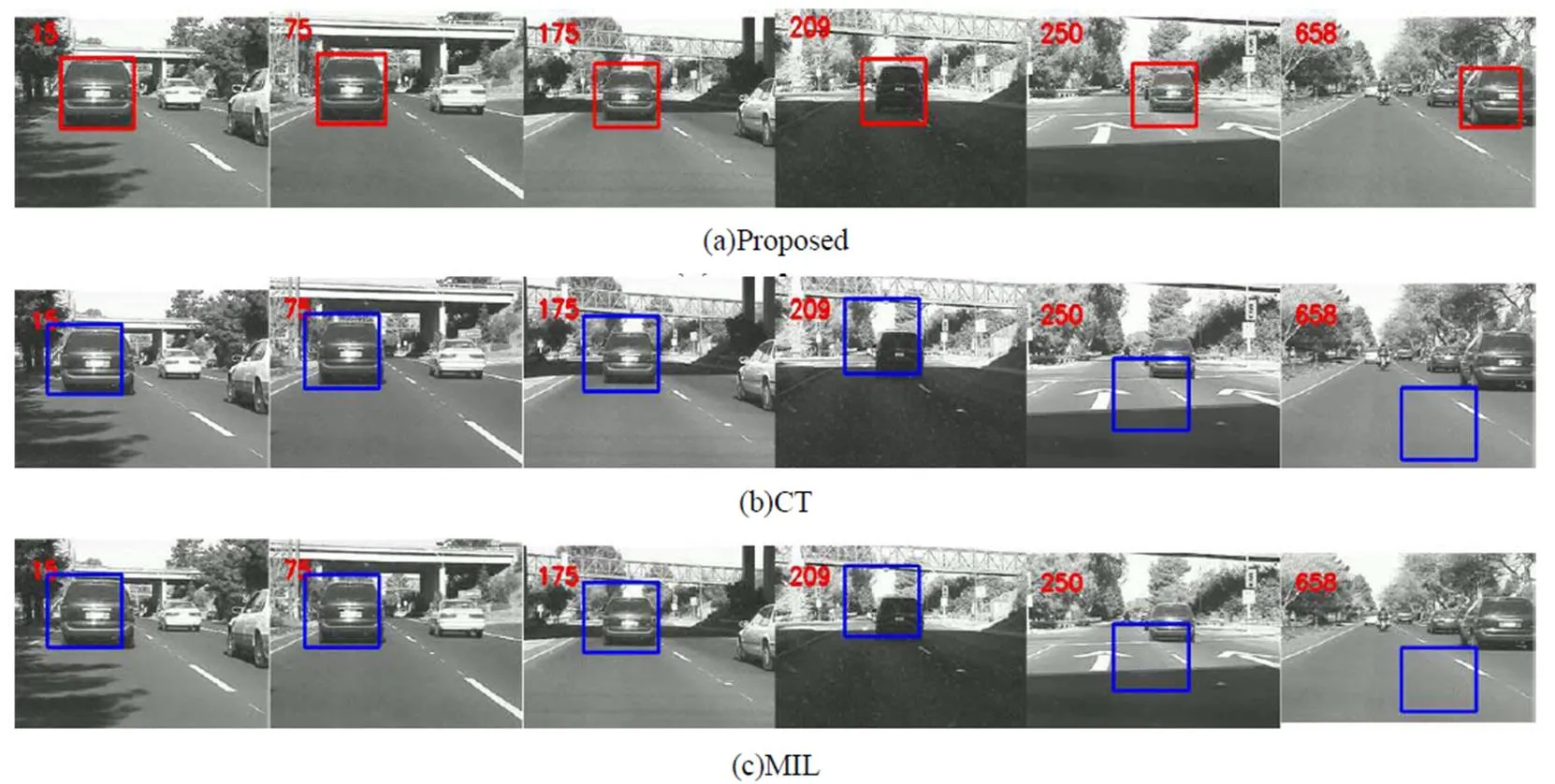

图6显示了本文算法的抗尺度变化能力,Car4序列中的目标尺度越来越小,本文算法的多尺度机制能够不断捕捉到这种尺度变化,因此跟踪框随着目标减小而减小,且能对目标进行很好的定位,而CT算法和MIL算法缺乏尺度更新机制在目标从桥下走出时丢失了目标。

4 结论

针对现有在线学习跟踪算法中存在的跟踪漂移问题,本文在压缩感知跟踪算法的基础上,采用在线模型自适应更新机制以及目标尺度自适应更新机制,提出了一种简单且高效的目标跟踪算法。三组不同挑战性的实验表明:本文方法在目标被长时或短时遮挡、光照变化及尺度变化等情况下均能完成鲁棒跟踪,跟踪成功率较原始压缩感知算法提高了20.3%。

图5 David序列跟踪结果

图6 Car4序列跟踪结果

[1] Wu Y, Lim J, Yang M H. Online object tracking: a benchmark[C]//, 2013: 2411-2418(doi: 10.1109/CVPR.2013.312).

[2] Ross D, Lim J, Lin R, et al. Incremental learning for robust visual tracking[C]//, 2008, 77(1-3): 125-141.

[3] Mei X, Ling H. Robust visual tracking and vehicle classification via sparse representation[J]., 2011, 33(11): 2259-2272.

[4] Li H, Shen C, Shi Q. Real- time visual tracking using compressive sensing[C]//, 2011: 1305- 1312 (doi: http: //doi. ieeecomputersociety. org/ 10.1109/ CVPR. 2011. 5995483).

[5] Grabner H, Leistner C, Bischof H. Semi- supervised on-line boosting for robust tracking[C]//, 2008, Part I: 234-247.

[6] Babenko B, Yang M H, Belongie S. Robust object tracking with online multiple instance learning[J]., 2011, 33: 1619-1632.

[7] Kalal Z, Matas J, Mikolajczyk K. Tracking -learning-detection[J]., 2012, 34: 1409-1422.

[8] Zhang K H, Zhang L, Yang M H. Real time compressive tracking [C]//, 2012, 7574: 864 - 877.

[9] Zhu Qiuping, Yan Jia, Deng Dexiang. Compressive tracking via over- saturated sub-region classifiers[J]., 2013, 17(6): 448-455.

[10] Jing Jing, Xu Guangzhu, Lei Bangjun. Using appearance rematching to improve compressive tracking[C]//, 2013: 28-33(doi: 10.1145/ 2499788. 2499825).

[11] 朱秋平, 颜佳, 张虎, 等. 基于压缩感知的多特征实时跟踪[J]. 光学精密工程, 2013, 21(2): 437-444.

Zhu Qiuping, Yan Jia, Zhang Hu, et al. Real-time tracking using multiple features based on compressive sensing[J]., 2013, 21(2): 437-444.

Multi-scale Compression Perception Tracking under Occlusion

ZHANG Li-juan,JI feng,CHANG Xia,LI Ze-ren

(,750021,)

In order to deal with the drift problem by updating error in current online learning tracking algorithms, a new adaptive update tracking algorithm is proposed. First of all, based on the efficiency of compressed sensing, the multi-scale image feature space is decreased, and multi-scale samples are exacted to update the target scale. Secondly, a naive Bayes classifier is trained by low dimension image features from positive and negative samples. Experimental results show that the proposed algorithm can complete the robust tracking under the condition of scale changes, partial and full occlusion, illumination changes, etc. Tracking successful rate is improved by 20.3% compared with the original compressive tracking.

object tracking,online learning,compressive sensing

TP391

A

1001-8891(2015)12-1052-06

2015-07-20;

2015-10-05.

张丽娟,女,河北省沧州人。硕士研究生,主要研究方向为图形图像处理。E-mail:372160407@qq.com。

国家自然科学基金项目,编号:61440044,61102008,61462002,61163017;宁夏自然科学基金项目,编号:NZ13097,国家民委科研项目,编号:14BFZ003。