职前教师情绪复杂性对情绪面孔加工的影响

——来自行为、ERP和眼动的证据*

2015-01-24汪海彬卢家楣姚本先桑青松唐晓晨

汪海彬 卢家楣 姚本先 桑青松 陈 宁 唐晓晨

1 问题的提出

想象一个人是“情绪复杂的”, 那么他们可能具有以下特征:能同时看到所有事物好的一面和坏的一面; 能精确并详细描述情感的能力; 能明确得到情境所要诱发的情绪; 能记住所体验到的情绪(Lindquist & Barrett, 2008)。然而, 国内外研究者对情绪复杂性(emotional complexity)的概念界定和测量并未达成一致, 主要有情绪体验自我报告的复杂性(complexity in self-reported experiences of emotion)、命题性情绪知识的复杂性(complexity in propositional knowledge of emotion)和自我描述的复杂性(self-characterizations of complexity)三种, 但一致的是, 情绪复杂性高低的本质在于情感图式(Torrado, Ouakinin, & Lane, 2012)或情绪概念系统(Lindquist & Barrett, 2008)的分化和整合程度不同,并且其还有利于个体的身心健康和社会适应:高情绪体验自我报告的复杂性与高复原力呈正相关(Davis, Zautra, & Smith, 2004), 并且还有助于他们采用更灵活的情绪调节策略(Tugade, Fredrickson,& Barrett, 2004); 命题性情绪知识复杂性与心理幸福感呈显著正相关(Beaman, 2008), 并且可以作为病人疗后效果评估的指标(Torrado, Ouakinin, &Bacelar-Nicolau, 2013); 自我描述复杂性也与人际适应呈正相关(Kang & Shaver, 2004)。

在三种取向的情绪复杂性研究中, 最为丰富是命题性情绪知识的复杂性(complexity in propositional knowledge of emotion), 又被称之为情绪觉察(emotional awareness), 指的是“识别与描述自己和他人情绪的能力” (Lane & Schwartz, 1987), 其被视为情绪智力的先决条件和重要基础(Lane, 2000),对个体的身心健康具有重要意义(Gençoğlu & Yılmaz,2014):高情绪觉察能力不仅有助于个体建立起良好的亲子关系(Fantini-Hauwel, Boudoukha, & Arcisze-wski, 2012; Maliken & Katz, 2013), 从容应对压力事件(Jobe-Shields, Parra, & Buckholdt, 2013)、采用更优的情绪调节策略(Eastabrook, Flynn, & Hollenstein, 2014; Szczygieł, Buczny, & Bazińska, 2012)和情绪表达策略(Kim & Cha, 2013)、进而有助于提高其工作效率(Boroş & Curşeu, 2013)、满意度(Downey,2003)和幸福感(Beaman, 2008); 而低情绪觉察能力不仅容易导致个体产生不合理信念(Boden, Gala, &Berenbaum, 2013)、深受焦虑(Kerns, Comer, & Zeman,2014)、抑郁(Subic-Wrana et al., 2014)等消极情绪的困扰, 甚至还容易诱发诸如进食障碍(Parling, Mortazavi, & Ghaderi, 2010; Raucher-Chéné, et al., 2013)和物质依赖(Torrado et al.,2013)等疾病。

鉴于命题性情绪知识中的复杂性的重要性, 研究者们已就情绪觉察能力的概念、测量、神经基础、相关变量和干预策略等五个方面展开了大量研究(Subic-Wrana et al., 2014; Torrado et al., 2013; 汪海彬, 卢家楣, 陈宁, 2013), 但尚存有一些不足, 主要体现在神经基础研究较少和研究对象局限两个方面:首先在情绪觉察的神经基础研究方面, Lane(2006)认为不同的情绪觉察能力有不同的神经基础,并建构了情绪觉察的神经解剖学模型。实证研究也的确发现正常群体的情绪觉察能力得分与右半球优势度(Lane, Kivley, Du Bois, & Shamasundara,1995)以及 ACC (Lane et al., 1998)、dACC (McRae,Reiman, Fort, Chen, & Lane, 2008)的激活呈正相关(Gu, Hof, Friston, & Fan, 2013), 而特殊群体(如自闭症患者)的情绪觉察能力得分则与VACC和AI的激活呈负相关(Frewen et al., 2008; Silani et al., 2008),然而以往研究仅采用时间分辨率不高的 PET或fMRI技术, 但情绪觉察作为一种认知技能(正如Lane等人的界定), 探索不同情绪觉察水平个体在情绪信息加工的时程特点可能更有意义。第二, 研究对象以身心疾患为主, 文献计量学结果显示该领域的研究对象中有 65.71%是诸如焦虑障碍(Kerns et al., 2014)、厌食症(Racine & Wildes, 2013)、PTSD(Frewen, Dozois, Neufeld, & Lanius, 2012)、边缘性人格(Cole, Llera, & Pemberton, 2009)、心境障碍和精神分裂症病人(Baslet, Termini, & Herbener, 2009;Kamel, 2013)、进食障碍病人(Shouse & Nilsson, 2011;Parling et al., 2010)、述情障碍(Herbert, Herbert, &Pollatos, 2011; Lichev et al., 2013)、自闭症(Pimpas,2013)等身心疾患群体(汪海彬, 卢家楣,陈宁,2013), 但对正常群体的研究则较少, 实证方面的研究则更是少之又少。因此, 有必要针对以往研究存在的不足, 在国内开展亟需情绪觉察能力的正常群体的研究, 而这恰是情绪觉察研究领域得以进一步深化和拓展的内在需求。

《国家中长期教育改革和发展规划纲要(2010-2020年)》中明确指出“教育大计, 教师为本, 努力造就一支高素质专业化教师队伍”; 2012年2月10日, 教育部下发“关于印发《幼儿园教师专业标准(试行)》《小学教师专业标准(试行)》和《中学教师专业标准(试行)》的通知”中增添教师情性素质方面的要求, 诸如“学会观察学生并激励、自我情绪调节”等。可见亟需教师情性素质的培养, 尤其是对其情绪智力基础——情绪觉察的培养, 正如研究者呼吁情绪觉察对教师群体尤其重要(Lane et al.,1987)。但令人担忧的是, 教师情性方面的素质却不尽如人意:1978~2012年我国中小学教师心理健康的横断历史研究表明教师在抑郁、焦虑、恐怖等情绪方面因子得分逐年升高(汪海彬, 陈宁, 陈锋,2013), 这也致使有关教师体罚、虐待学生的报道屡见报端, 甚至一些自杀、杀人的例子也不罕见。在这样的背景下, 教师自身素质的发展, 尤其是其情性素质的发展和培养亟需人们的关注和思考。为此,在“如何在 21世纪培养教师”成为东西方教师教育领域共同议题和国家日益重视培养教师情性素质的背景下、教师情性素质着实令人担忧的教育现实下, 从教师培养的起源——职前培养入手, 培养职前教师的情性素质, 这无论对“十二五”教育规划纲要精神和教师专业标准中显现出的情性素质要求的践行, 还是对教师自身专业化的发展都具有重要的理论意义和实践价值。然而, 当前对于职前教师情性素质培养的研究尚处于重要性探讨或初步探索阶段(Koçoğlu, 2011; 倪小敏, 2010; 桑国元,2011)。因此, 有必要进一步丰富职前教师情性素质的研究, 尤其是实证方面的研究, 这是由教师情性素质令人担忧的现状引发我们对培养职前教师情性素质现实需求的思考。

基于上述两个需求(即情绪复杂性研究领域得以拓展的内在需求和职前教师情性素质培养的现实需求)以及情绪复杂性在情绪智力中的重要基础作用, 本研究拟以职前教师为研究对象, 以情绪复杂性作为情性素质培养的切入口, 开展以教育应用为导向的基础研究:即采用时间分辨率较高的ERP技术和眼动技术探索不同情绪觉察能力职前教师在情绪加工过程中的时空特点和眼动特点, 这不仅有助于丰富情绪复杂性的生理心理特点研究, 而且还可以为设计有针对性的提升职前教师情绪复杂性的措施提供科学依据。

2 研究 1:职前教师情绪复杂性对情绪面孔加工的影响——来自行为和ERP的证据

2.1 方法

2.1.1 被试

采用情绪觉察水平问卷(Levels of Emotional Awareness Scale, LEAS) (Lane, Quinlan, Schwartz,Walker, & Zeitlin, 1990)对400名职前教师进行测查,然后依据被试的问卷总得分按由高到低的顺序排列, 将得分在前 27%的被试作为高分组, 得分在后27%的被试作为低分组, 在兼顾男女的前提下, 最后得到高低组各20人, 男女各半, 40名被试平均年龄为21.73±1.98岁。所有被试均身心健康, 右利手,视力正常或矫正后达到正常水平, 实验前均签署了被试知情同意书。因其中3名被试(其中男生2人)记录数据的伪迹过大, 予以删除, 高低分组的LEAS得分差异显著(t(35) = ‒53.89, p < 0.001, d =0.56), 高分组的LEAS得分(M = 3.40, SD = 0.41, n =19)显著高于低分组(M = 2.30, SD = 0.59, n = 18 )。

2.1.2 测量工具

采用 Lane等人编制的情绪觉察水平问卷(LEAS) (Lane et al., 1990)。问卷包括20个涉及两人(自己和他人)的情境, 用于诱发4种情绪(愤怒、恐惧、幸福和悲伤)中的一种。对于每个题项, 被试需要回答两个问题:“你是什么感受?”和“你认为另一个人是什么感受?”, 随后主试根据《情绪觉察水平问卷计分手册》(LEAS scoring manual)对被试的回答进行 0~5级的评定, 以计算情绪觉察在自己、他人和总分三个方面的得分。量表由5名心理学专业硕士研究生和3名英语硕士研究生进行翻译—回译, 并在咨询有关专家(Lane的助手 Carolyn)和参考日本版情绪觉察水平问卷(LEAS-J)中考虑到的中西方文化差异的基础上, 对部分情境的描述进行了修改, 以适合中国文化特点, 然后对 525名职前教师进行应用, 结果显示量表的评分者间信度均大于0.80, α系数均大于0.90。

2.1.3 实验材料

从中国化面孔情绪图片系统(CFAPS) (王妍,罗跃嘉, 2005)中挑选出愉悦、愤怒、悲伤和恐惧图片各40张(男女各半), 4类情绪的唤醒度一致(平均值:愉悦 = 5.83, 愤怒 = 5.83, 悲伤 = 5.78, 恐惧 =5.82; F(3,156) = 0.05, p > 0.05)。

2.1.4 实验任务和程序

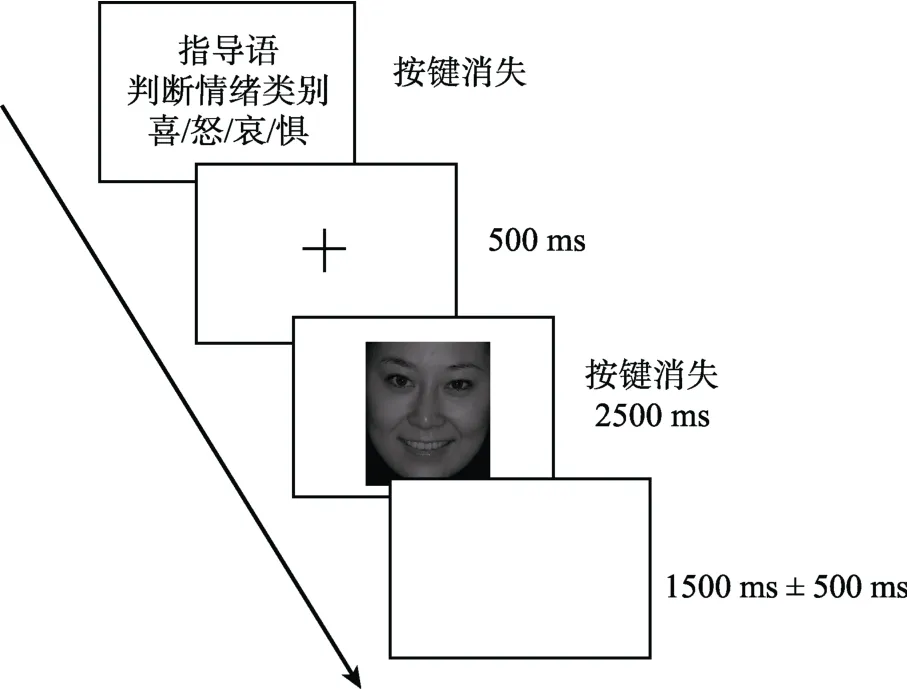

本研究使用 E-prime 2.0来控制和呈现所用刺激。采用 2(被试间变量:情绪觉察能力:高/低)×4(被试内变量:情绪类别:愉悦/愤怒/悲伤/恐惧)设计。实验分为4个 block, 每个 block包含 80个trail。要求被试判断呈现面孔的情绪类别(愉悦/愤怒/悲伤/恐惧)。每个 trail中, 首先呈现 500 ms “+”注视点, 随后呈现面孔, 呈现同时开始计时, 要求被试对面孔的情绪类别作既准又快的判断, 随后按键消失, 如果没有按键, 则在显示2500 ms后消失。如果被试在2500 ms内没有做出反应, 则认为其反应错误。一个trail完成, 1500 ms ± 500 ms空屏后开始下一个 trail。每个 block中间有休息, 休息长度由被试自行按键控制(见图 1)。被试以按键做出反应, 如面孔为“愉悦”按R键、“愤怒”按F键、“悲伤”按 I键、“恐惧”按 J键。4种情绪类别对应的按键在被试间进行拉丁方平衡。

图1 实验中一个trial流程图

2.1.5 ERP记录和数据处理

实验仪器为美国NeuroScan公司的64导ERP脑电记录仪(NeuroScan, Inc., US), 采用64导电极帽记录脑电, 同时记录水平眼电和垂直眼电。左侧乳突参考, AC采集, 采样率为1000 Hz, 滤波带通为0.01~100 Hz, 所有电极的头皮电阻均小于5 kΩ。离线分析时, 首先将单侧乳突参考转换为双侧乳突平均参考, 自动矫正眨眼伪迹, 波幅在±100 μV 之外的脑电记录被视为伪迹, 并自动剔除, 滤波低通为30 Hz (24 dB/octave)。分段为刺激前200 ms到刺激后800 ms。

分别对实验中的4类情绪面孔引发的EEG进行叠加和平均。ERP分段为1000 ms, 包括刺激呈现前200 ms的基线。在本研究中, 主要测量和分析N100、P100、VPP、N170、P200、N200和 LPP 等成分的峰值潜伏期和波幅。依据以往研究(Luo,Feng, He, Wang, & Luo, 2010), 对于上述不同成分选择不同电极。P100 (130~200 ms)选择了Pz、P3、P4、POz、PO3 和 PO4; N100 (60~140 ms)和 N170(140~200 ms)选择 P7、P8、PO7和 PO8; VPP(140~200 ms)选择 Fz、F3、F4、FCz、FC3、FC4; N200(200~300 ms)选择 T7、T8、FT7和 FT8; P200(200~300 ms)选择 P7、P8、PO7和 PO8; LPP (300 ms~800 ms)选择了 FCz、FC3、FC4、Cz、C3、C4、CPz、CP3、CP4、Pz、P3、P4、POz、PO7 和 PO8等 15个电极。采用重复测量方差分析分析各成分的峰值潜伏期和幅值, 其中组别(两个水平:高分组、低分组)为组间变量, 情绪类别(4个水平:愉悦、愤怒、恐惧和悲伤)和电极为组内变量。所有数据分析采用SPSS 16.0完成, 采用Greenhouse-Geisser法矫正P值。

2.2 结果

2.2.1 行为数据分析

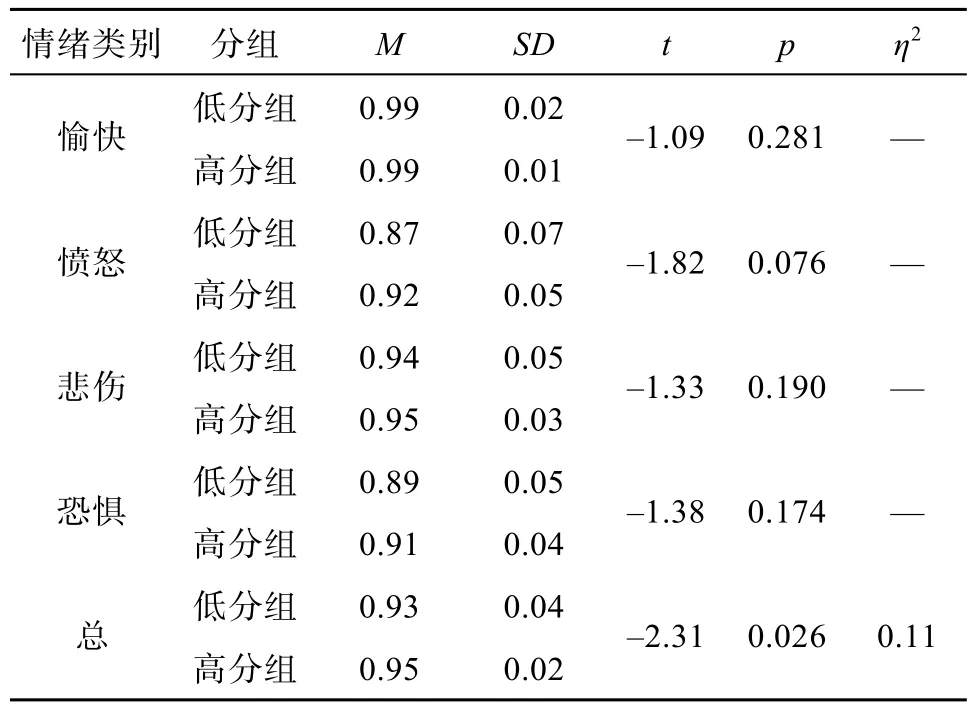

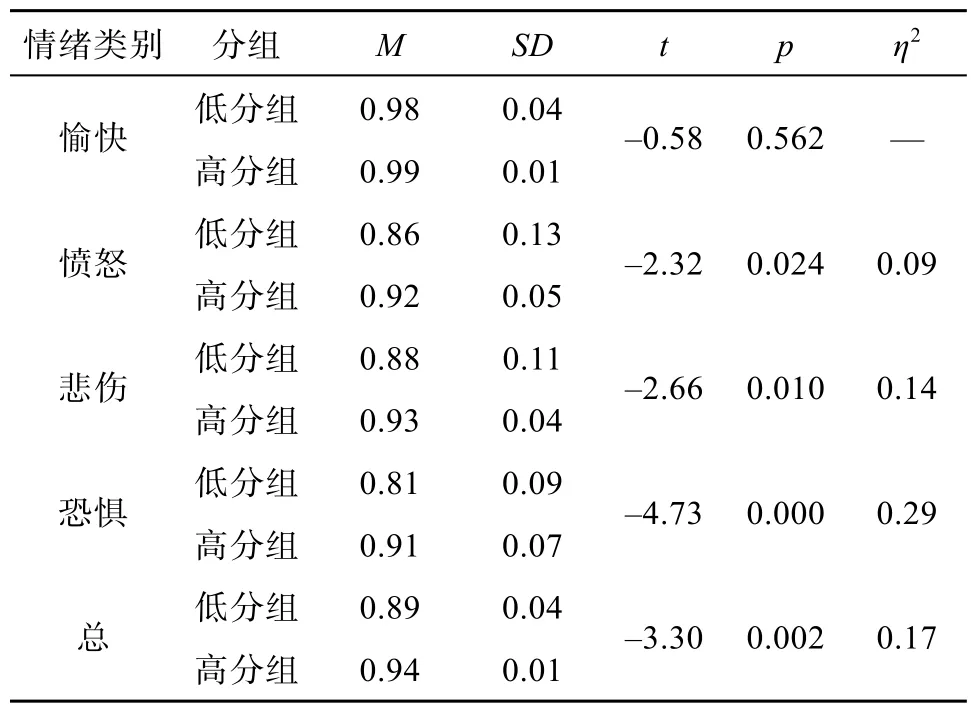

(1) 正确率

结果显示, 情绪类别和组别的主效应显著[F(3,105) = 38.23, p < 0.001, η= 0.45; F(1,35) =5.33, p = 0.026, η= 0.11], 但情绪类别和组别的交互效应则不显著(p > 0.05)。事后多重比较发现, 4种情绪类别正确率从高到低依次为愉快、悲伤、愤怒和恐惧, 且愉快的正确率显著高于其他三种情绪类别(p < 0.001), 悲伤显著高于愤怒和恐惧(p <0.001), 而愤怒和恐惧之间差异不显著(p > 0.05)。高情绪觉察能力组在4类情绪上的正确率均高于低情绪觉察能力组, 但仅总的正确率差异显著[t(35) =2.31, p = 0.026, η= 0.11], 而在具体情绪上的正确率差异则不显著(p > 0.05) (见表1)。

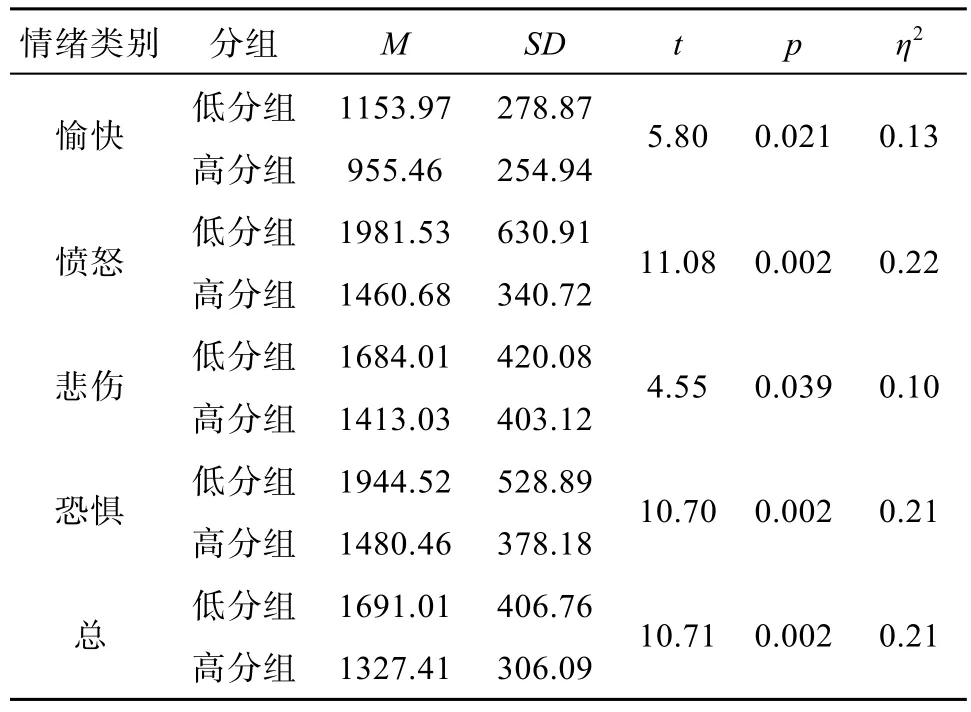

(2) 反应时

结果显示, 情绪类别和组别的主效应以及情绪类别和组别的交互效应均显著[F(3,105) = 64.72, p <0.001, η= 0.62; F(1,35) = 10.71, p = 0.002, η=0.21; F(3,105) = 3.88, p = 0.01, η= 0.09]。事后多重比较发现, 不同情绪觉察能力组在4种情绪类别反应时从低到高依次为愉快、悲伤、恐惧和愤怒, 但高低分组对4种情绪的反应时的差异不同, 低分组表现为:愉快的反应时显著短于其他三种情绪类别(p < 0.001), 悲伤显著高于愤怒和恐惧(p < 0.001),但愤怒和恐惧之间差异不显著(p > 0.05)。而高分组则表现为:愉快的反应时显著短于其他三种情绪类别(p < 0.001), 但其他三种情绪类别的反应时之间的差异则不显著(p > 0.05)。低分组在4类情绪图片上的反应时均显著长于高分组(p < 0.001或p < 0.05)(见表 2)。

表1 不同情绪觉察能力分组在4类情绪上的正确率比较

表2 不同情绪觉察能力分组在4类情绪上的反应时比较

2.2.2 ERP数据分析

(1) N100

关于 N100的幅值, 结果显示电极、情绪类别和组别的主效应及各自的交互效应都不显著(p >0.05)。关于 N100的潜伏期, 仅电极的主效应显著[F(3,105) = 5.17, p = 0.002, η= 0.12], P7 的潜伏期(92.15 ms)显著长于PO7 (82.75 ms) (p < 0.05), P8的潜伏期(94.12 ms)显著长于PO8 (84.14 ms) (p <0.05)。

(2) P100

关于 P100的幅值, 结果显示电极和组别的主效应以及情绪类别和组别的交互效应显著[F(5,175) =5.52, p = 0.004, η= 0.14; F(1,35) = 11.04, p = 0.002,η= 0.25; F(3,105) = 3.50, p = 0.02, η= 0.10]。事后多重比较发现, PO3的幅值(5.49 μV)显著高于 P3(4.39 μV)和 P4 (4.78 μV), PO4 的幅值(5.59 μV)显著高于P4 (4.78 μV) (p < 0.05); 情绪觉察能力高分组的幅值(5.97 μV)显著高于情绪觉察能力低分组(4.21 μV)(p < 0.01); 情绪类别和组别的交互作用表现为:在愤怒、恐惧和悲伤三种情绪下, 高低情绪觉察能力组在POZ、P3和P4三个电极上的幅值差异不显著(p > 0.05)。关于P100的潜伏期, 结果显示电极、组别和情绪类别各自的主效应及交互效应均不显著(p > 0.05)。

(3) VPP

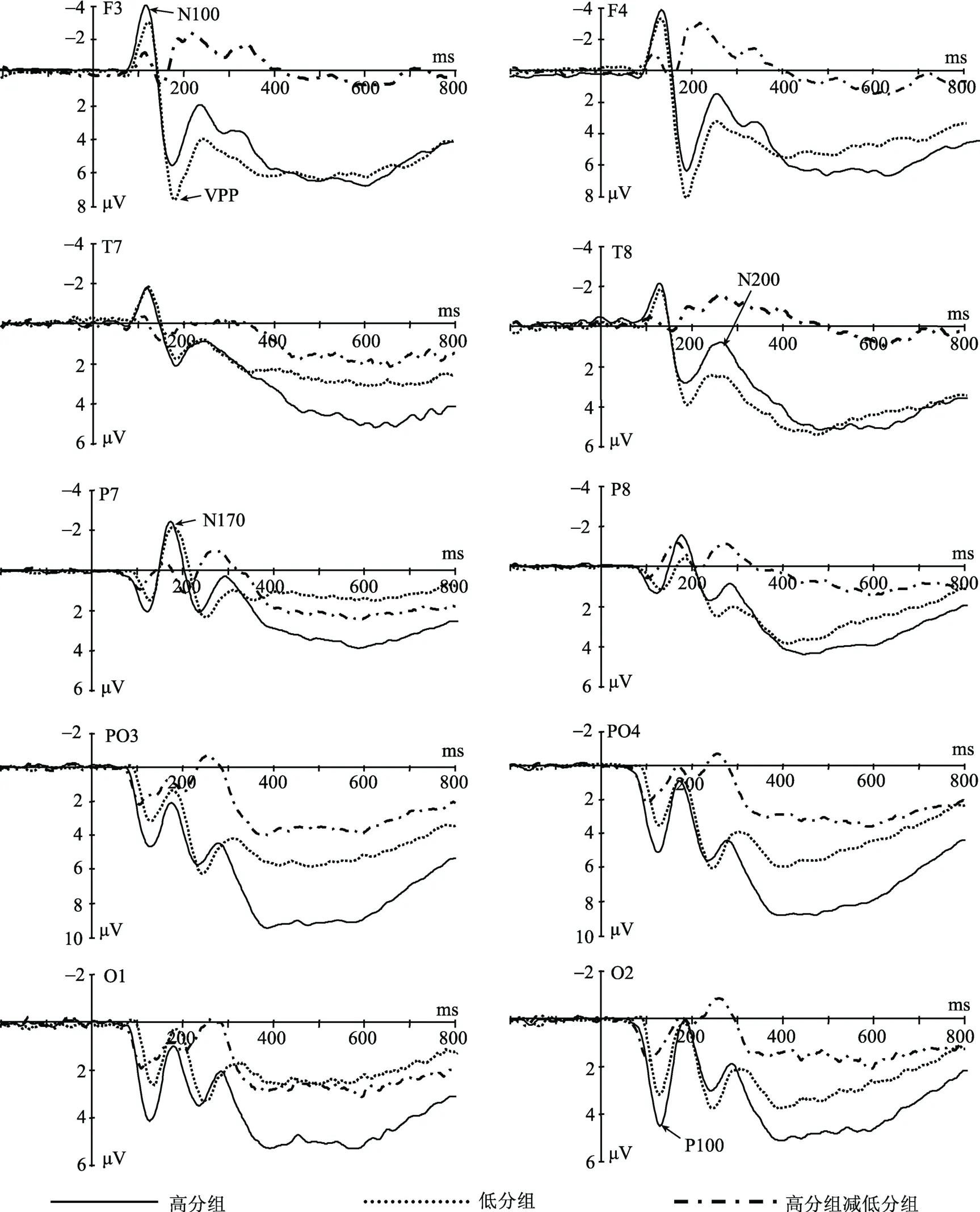

图2 不同情绪觉察能力组的总平均波形图比较

关于VPP的幅值, 结果显示电极、情绪类别和组别的主效应以及电极和组别的交互效应显著[F(5,175) = 19.04, p < 0.001, η= 0.35; F(3,105) =9.57, p < 0.001, η= 0.22; F(1,35) = 16.58, p < 0.001,η= 0.32; F(5,175) = 2.46, p = 0.035, η= 0.07]。事后多重比较发现, 电极的主效应表现为:FCZ的幅值(9.49 μV)显著高于其他5个电极(p < 0.05)、FZ的幅值(8.67 μV)显著高于 F3 (7.93 μV)和 F4 (8.23 μV)(p < 0.05)、FCZ 的幅值(9.49 μV)显著高于 FC3 (7.92 μV)和 FC4 (8.50 μV) (p < 0.05); 情绪类别的主效应表现为:悲伤的幅值(9.24 μV)显著高于其他三种情绪的幅值(p < 0.05)、愉快的幅值(7.53 μV)显著低于其他三种情绪的幅值(p < 0.05), 但愤怒(8.37 μV)和恐惧(8.68 μV)之间的差异不显著(p > 0.05); 组别的主效应表现为低分组的幅值(10.30 μV)均显著高于高分组(6.61 μV) (p < 0.001)。关于VPP的潜伏期,结果显示电极和情绪类别的主效应显著[F(5,175) =2.67, p = 0.024, η= 0.07; F(3,105) = 5.01, p = 0.003,η= 0.13]。电极的主效应表现为:F4的潜伏期(181.11 ms)显著短于FC4(183.80 ms) (p < 0.05); 情绪类别的主效应表现为愉快的潜伏期(179.64 ms)显著短于恐惧(184.11 ms)和悲伤(183.67 ms) (p < 0.05)。

(4) N170

关于 N170的幅值, 结果显示电极的主效应、情绪类别和组别的交互效应显著[F(3,105) = 2.68, p= 0.038, η= 0.07; F(3,105) = 3.68, p = 0.014, η=0.09], 但电极和情绪类别的主效应、电极和情绪类别、电极和组别以及电极、情绪类别和组别的交互效应均不显著(p > 0.05)。事后多重比较发现, 电极的主效应表现为P7的幅值(‒3.02 μV)显著高于PO7(‒1.88 μV) (p < 0.001); 情绪类别和组别的交互作用表现为:在愉快和愤怒情绪下, 高低情绪觉察能力组的差异不显著(p > 0.05), 而其他情绪类别上,高低组在 N170幅值上的差异均显著, 且均是高分组(‒3.57 μV)显著高于低分组(‒1.19 μV) (p < 0.001)。关于 N170的潜伏期, 结果显示电极、组别和情绪类别的主效应及交互效应均不显著(p > 0.05)。

(5) P200

关于 P200的幅值, 结果显示情绪类别和组别的主效应、情绪类别和组别的交互效应显著[F(3,105) = 7.43, p < 0.001, η= 0.17; F(1,35) =10.43, p = 0.003, η= 0.22; F(3,105) = 5.52, p =0.001, η= 0.17]。情绪类别的主效应表现为:愉快的幅值(2.95 μV)显著低于愤怒(4.00 μV)、恐惧(4.04 μV)和悲伤(4.15 μV)的幅值(p < 0.05); 低分组的幅值(4.80 μV)显著高于高分组(2.74 μV) (p < 0.05);情绪类别和组别的交互效应表现为:在愉快情绪下,低分组的幅值(3.33 μV)与高分组(2.58 μV)之间差异不显著(p > 0.05)。关于P200的潜伏期, 结果显示, 电极、组别和情绪类别各自的主效应及交互效应均不显著(p > 0.05)。

(6) N200

关于 N200的幅值, 结果显示情绪类别和组别的主效应显著[F(3,105) = 4.75, p = 0.004, η= 0.114;F(1,35) = 6.27, p = 0.017, η= 0.145], 但电极的主效应、电极和情绪类别、电极和组别以及电极、情绪类别和组别的交互效应均不显著(p > 0.05)。多重事后比较发现, 情绪类别的主效应表现为愉快的幅值(‒0.26 μV)显著低于愤怒(0.93 μV)和恐惧(1.11 μV) (p < 0.001); 组别的主效应表现为:高分组的幅值(‒0.25 μV)显著低于低分组(1.21 μV) (p < 0.001)。关于N200的潜伏期, 结果显示, 电极、组别和情绪类别各自的主效应及交互效应均不显著(p > 0.05)。

(7) LPP

关于LPP的幅值, 结果显示电极、情绪类别和组别的主效应[F(14,490) = 51.27, p < 0.001, η= 0.58;F(3,105) = 10.57, p < 0.001, η= 0.23; F(1,35) = 10.41,p = 0.003, η= 0.22]。电极的主效应表现为:头皮后部电极(PZ、P3、P4、POZ、PO7和PO8)的幅值显著高于头皮前部电极(FC3、FCZ和FC4)的幅值(p <0.001或p < 0.05), 但左右半球电极幅值之间的差异不显著(p > 0.05); 情绪类别的主效应表现为:愉快的幅值(9.16 μV)显著低于愤怒(11.35 μV)和恐惧(10.98 μV)的幅值(p < 0.001); 组别的主效应表现为:高分组的幅值(11.85 μV)显著高于低分组(8.99 μV)。关于LPP的潜伏期, 结果显示, 电极、组别和情绪类别各自的主效应及交互效应均不显著(p > 0.05)。

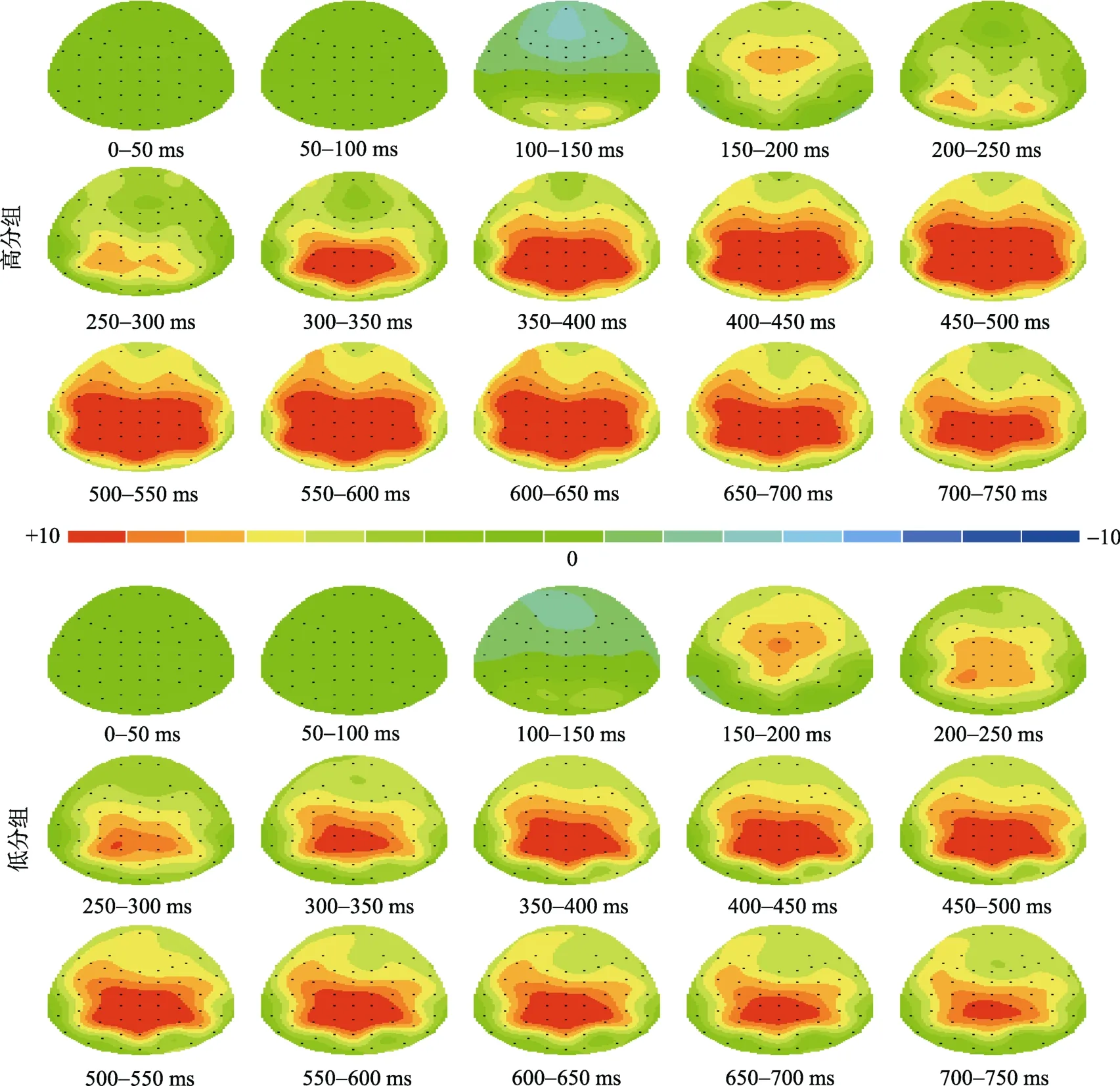

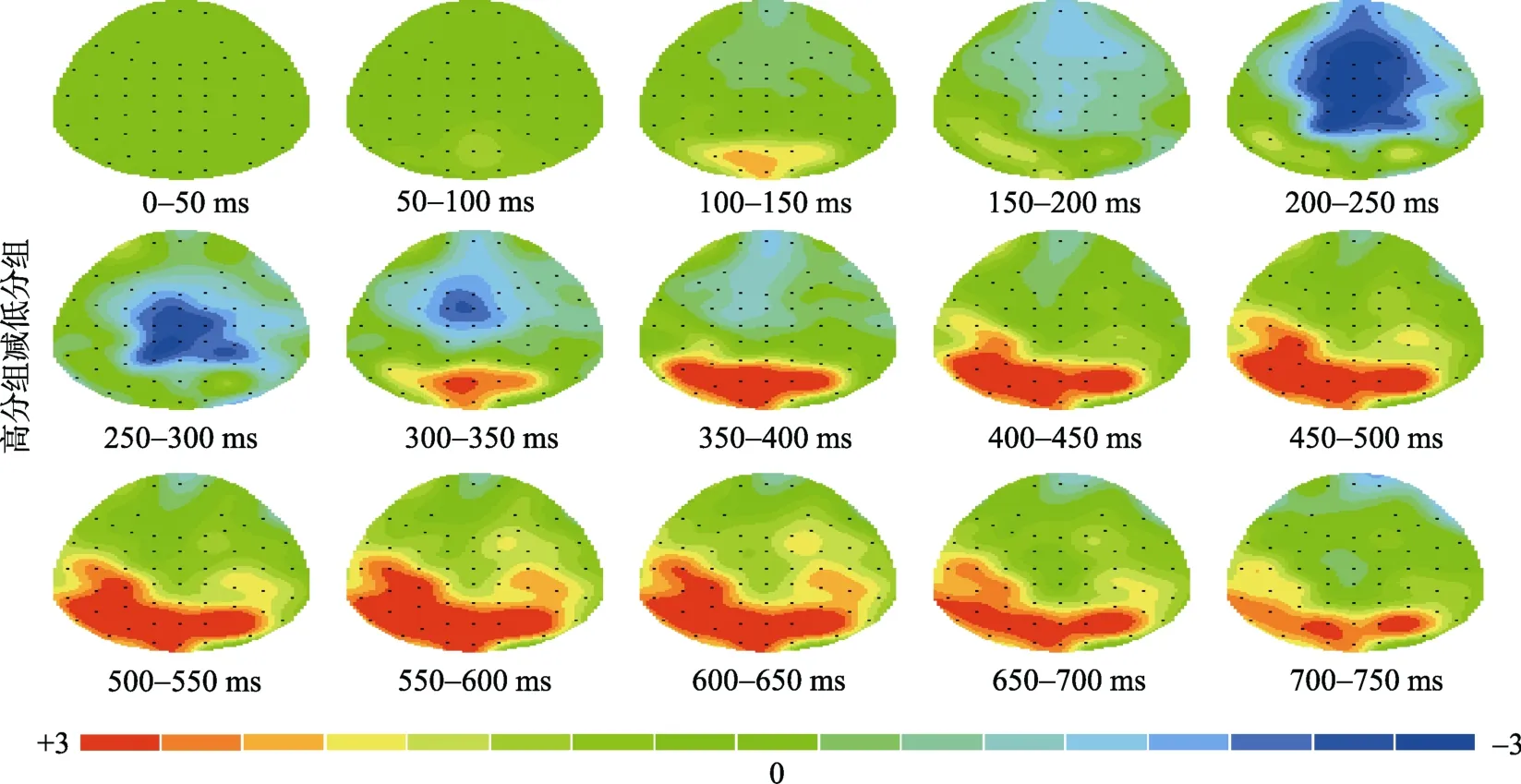

(8)二维地形图

以50 ms为间隔, 对高低情绪觉察能力组在0~800 ms进行二维地形图分析, 从高低组总的二维地形图(见图 3)可以发现, 不同情绪觉察能力组在情绪面孔加工过程中的模式大体一致:首先在0~150 ms时间窗口, 头皮后部脑区先激活, 然后在150~200 ms时间窗口, 头皮中前部开始激活, 并在200 ms以后逐渐呈从前部向后部脑区激活的趋势;从高低情绪觉察能力组相减的二维地形图(见图 4)可以发现, 在早期阶段(100 ms~200 ms), 高情绪觉察能力组在头皮后部脑区的激活高于低情绪觉察能力组; 在中期阶段(200 ms~300 ms), 高情绪觉察能力组在头皮前部脑区的激活低于低情绪觉察能力组; 在晚期阶段(300 ms以后), 高情绪觉察能力组在头皮后面脑区的激活高于低情绪觉察能力组。

图3 不同情绪觉察能力组的二维地形图

图4 高情绪觉察能力减低情绪觉察能力的二维地形图

3 研究 2:职前教师情绪复杂性对情绪面孔加工的影响——来自行为和眼动的证据

3.1 方法

3.1.1 研究对象

采用研究 1中的情绪觉察水平问卷(LEAS)测查另400名职前教师, 然后依据被试的问卷得分按照由高到低的顺序排列, 取得分在前27%的被试为高分组, 得分在后 27%的被试为低分组, 在兼顾男女的前提下, 最后得到高低分组各30人, 男女各半,60名被试平均年龄为 21.74±2.48岁。所有被试均身心健康, 右利手, 视力正常或矫正后达到正常水平, 实验前均签署了被试知情同意书。因其中4名被试(其中男生 2人)记录数据的途中出现移动, 未能保证有效校准注视点而予以剔除, 高低分组的LEAS得分差异显著[t(54) = ‒17.92, p < 0.001, d =0.86], 高分组的LEAS得分(M = 3.58, SD = 0.24, n =29)显著高于低分组(M = 2.39, SD = 0.26, n = 27 )。

3.1.2 测量工具

同研究1

3.1.3 实验材料

从中国化面孔情绪图片系统(CFAPS) (王妍,罗跃嘉, 2005)中挑选出愉悦、愤怒、悲伤和恐惧图片各 8张(男女各半), 4类情绪的唤醒度一致(平均值:愉悦 = 6.02, 愤怒 = 6.02, 悲伤 = 6.02, 恐惧 =6.01; F(3,28) = 0.00, p > 0.05)。

3.1.4 实验任务和程序

采用德国SMI公司生产的RED 250遥测眼动追踪系统中自带的 Experiment Center试验中心软件来控制和呈现所用刺激。采用2(被试间变量:EA:高/低)×4(被试内变量:情绪类别:愉悦/愤怒/悲伤/恐惧)设计。实验共32个trail。要求被试判断呈现面孔的情绪类别。每个 trail中, 首先呈现 500 ms“+”注视点, 随后呈现面孔3000 ms后消失。之后出现一个选项界面, 让被试对呈现的面孔作既准又快的情绪类别判断(按键消失)。一个trail完成, 1500 ms ±500 ms空屏后开始下一个trail。被试以点击鼠标做出反应, 在呈现的选项界面用鼠标点击相应的答案。

3.1.5 眼动数据采集与分析

实验采用德国SMI公司生产的RED 250遥测眼动追踪系统记录和分析。采样率为250 Hz, 双眼1点校准。确定为注视结果在1度视角内注视持续100 ms, 否则重新校准。分析的眼动指标主要包括两个方面, 一个是眼动的基本指标, 主要包括注视和眼跳两个方面, 注视主要包括注视点个数、注视时间、注视频率和瞳孔直径等, 而眼跳指标则包括眼跳数目、眼跳频率、眼跳时间和眼跳幅度等; 第二是兴趣区指标, 也主要有注视点和注视时间构成。采用重复测量的方差分析对眼动指标进行分析,其中组别(两个水平:高分组、低分组)为组间变量、情绪类别(4个水平:愉悦、愤怒、恐惧和悲伤)和眼动指标为组内变量。所有数据分析由SPSS 16.0完成, 采用Greenhouse-Geisser法矫正P值。

3.2 结果

3.2.1 行为数据分析

结果显示:在正确率上, 组别和情绪类别的主效应以及组别和情绪类别的交互效应显著[F(1,54) =12.31, p = 0.001, η= 0.18; F(3,162) = 57.13, p < 0.001,η= 0.51; F(3,162) = 7.23, p < 0.001, η= 0.12]。事后多重比较发现, 组别的主效应表现为, 高情绪觉察能力组在总的正确率上显著高于低情绪觉察能力组(p < 0.001); 情绪类别的主效应表现为:愉快的正确率最高, 且显著高于其他三种情绪(p <0.001)、恐惧的正确率最低, 且显著低于愉快和悲伤(p < 0.001); 组别和情绪类别的主效应表现为:高低组在愉快的正确率差异不显著(p > 0.05), 但在其他三种情绪上均是高分组显著高于低分组(p <0.01或 p < 0.05) (见表 3)。

表3 不同情绪觉察能力分组在4类情绪上的正确率比较

3.2.2 眼动总体特征

(1) 注视数目

结果显示组别和情绪类别的主效应均显著[F(1,54) = 6.16, p = 0.016, η= 0.10; F(3,162) =17.59, p < 0.001, η= 0.22], 但情绪类别和组别的交互效应则不显著(p > 0.05)。事后多重比较发现,组别的主效应表现为:除恐惧面孔(M= 7.75, M=7.03)外, 高情绪觉察能力组在其他三种情绪面孔的注视点个数(M= 7.15, M= 7.67, M= 7.39)均多于低分组(M= 6.43, M= 6.79, M= 6.44)(p < 0.01或p < 0.05); 情绪类别的主效应表现为:愉快的注视点个数最小(M= 6.89), 但仅显著少于恐惧面孔(M= 7.38) (p < 0.05), 而其他之间的差异不显著(p > 0.05)。

(2) 注视频率

结果显示组别和情绪类别的主效应显著[F(1,54) = 6.10, p = 0.016, η= 0.10; F(3,162) =17.30, p < 0.001, η= 0.23], 但情绪类别和组别的交互效应则不显著(p > 0.05)。事后多重比较发现,组别的主效应表现为, 除恐惧情绪(M= 3.23, M=2.93)外, 高情绪觉察能力组在其他三种情绪面孔的注视频率(M= 2.98, M= 3.20, M= 3.08)均高于低分组(M= 2.68, M= 2.83, M=2.69) (p < 0.01或p < 0.05); 情绪类别的主效应表现为:愉快的注视频率最低(M = 2.82), 恐惧的注视频率最高(M= 3.13), 且愉快(M= 2.82)和悲伤(M= 2.88)的注视频率均显著小于恐惧(M=3.13)和愤怒(M= 3.02)的注视频率(p < 0.05), 而其他之间的差异不显著(p > 0.05)。

(3) 注视时间

结果显示组别和情绪类别的主效应及组别和情绪类别的交互效应不显著(p > 0.05)。

(4) 瞳孔直径

结果显示组别和情绪类别的主效应显著[F(1,54) = 9.58, p < 0.001, η= 0.13; F(3,162) = 7.15,p < 0.001, η= 0.12], 但情绪类别和组别的交互效应则不显著(p > 0.05)。事后多重比较发现, 组别的主效应表现为, 高情绪觉察能力组在4种情绪面孔的眼球直径(M= 16.01, M= 16.31, M= 15.94,M= 16.09)均高于低分组(M= 15.53, M=15.97, M= 15.58, M= 15.67) (p < 0.01); 情绪类别的主效应表现为:愤怒的眼球直径最大(M=16.14), 且显著高于其他三类情绪(M= 15.77, M= 15.75, M= 15.88) (p < 0.05或 p < 0.001), 而其他之间的差异不显著(p > 0.05)。

(5) 眼跳数目

结果显示情绪类别的主效应显著[F(3,162) =13.27, p < 0.001, η= 0.19], 但组别的主效应、情绪类别和组别的交互效应则不显著(p > 0.05)。事后多重比较发现, 愉快的眼跳数目最少(M= 10.78),显著少于其他三种情绪(M= 12.76, M= 12.28,M= 12.60) (p < 0.05或p < 0.001), 而其他之间的差异不显著(p > 0.05)。

(6) 眼跳频率

结果显示情绪类别的主效应显著[F(3,162) =13.05, p < 0.001, η= 0.18], 但组别的主效应、情绪类别和组别的交互效应则不显著(p > 0.05)。事后多重比较发现, 情绪类别的主效应表现为:愉快的眼跳频率最少(M= 3.43), 显著少于其他三种情绪(M= 4.26, M= 4.09, M= 4.20) (p < 0.05或p < 0.001), 而其他之间的差异不显著(p > 0.05)。

(7) 眼跳时间

结果显示:组别和情绪类别的主效应显著[F(1,54) = 6.81, p = 0.012, η= 0.11; F(3,162) = 7.20,p < 0.001, η= 0.11], 但情绪类别和组别的交互效应则不显著(p > 0.05)。事后多重比较发现, 组别的主效应表现为, 高情绪觉察能力组在眼跳时间上(M= 53.25)均短于低分组(M= 55.10) (p < 0.01或p < 0.05); 情绪类别的主效应表现为:愉快的眼跳时间最短(M= 53.83), 且显著短于恐惧(M=55.44)和悲伤(M= 56.44)两种情绪(p < 0.01或p <0.05), 而其他之间的差异不显著(p > 0.05)。

(8) 眼跳幅度

结果显示组别和情绪类别的主效应显著性[F(1,54) = 5.74, p = 0.017, η= 0.16; F(3,162) = 4.32,p = 0.016, η= 0.07], 但情绪类别和组别的交互效应则不显著(p > 0.05)。事后多重比较发现, 组别的主效应表现为, 除愉快情绪外, 高情绪觉察能力组在愤怒(M= 4.75, M= 6.22)、悲伤(M= 4.95, M= 6.55)和恐惧面孔(M= 4.61, M= 6.34)上的眼跳幅度上均小于低分组(p < 0.05); 情绪类别的主效应表现为:愉快的眼跳幅度最短(M= 5.30),且显著短于悲伤(M= 5.75) (p < 0.05), 而其他之间的差异不显著(p > 0.05)。

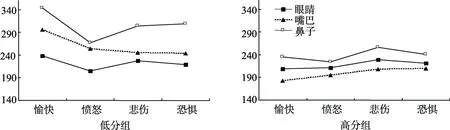

3.2.3 兴趣区特征分析

(1) 注视时间

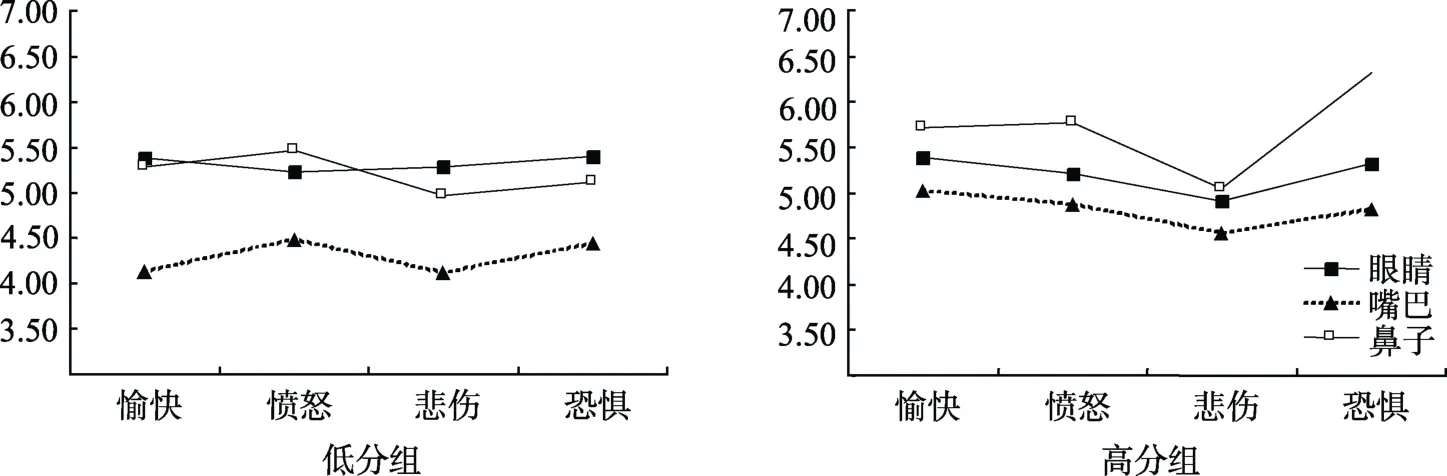

结果显示:组别、情绪类别和区域的主效应以及组别和情绪类别的交互效应、组别和区域的交互效应均显著[F(1,54) = 5.35, p = 0.026, η= 0.12;F(3,162) = 4.01, p = 0.01, η= 0.10; F(2,108) =13.57, p < 0.001, η= 0.26; F(3,162) = 6.38, p =0.001, η= 0.14; F(2,108) = 5.01, p = 0.012, η=0.12], 但情绪类别和区域的交互效应以及组别、情绪类别和区域的交互效应均不显著(p > 0.05)。事后多重比较发现, 组别的主效应表现为, 高情绪觉察能力组的注视时间(M= 655.66)显著短于低情绪觉察能力组(M= 788.15) (p < 0.05); 情绪类别的主效应表现为:愤怒的注视时间(M= 678.66)显著短于愉快(M= 751.71)和悲伤(M= 735.75)(p < 0.05), 而其他情绪类别之间的差异不显著(p >0.05); 区域的主效应表现为:嘴巴区域的注视时间(M= 272.27)显著长于眼睛(M= 219.94)和鼻子(M= 229.33) (p < 0.001), 但眼睛和鼻子之间的差异不显著(p > 0.05); 组别和情绪类别、组别和区域的交互效应表现为:低分组加工愉快(M= 235.36,M= 343.60)和恐惧(M= 240.79, M= 309.00)时嘴巴区域的注视时间显著长于高分组(p < 0.05或p < 0.01), 在加工愉快(M= 182.35, M= 295.34)和愤怒(M= 195.18, M= 254.07)情绪时鼻子区域的注视时间显著长于高分组(p < 0.05或p < 0.01),但其他之间的差异不显著(p > 0.05) (见图5)。

(2) 注视数目

结果显示情绪类别和区域的主效应以及组别和情绪类别的交互效应、组别和区域的交互效应显著[F(3,162) = 11.12, p < 0.001, η= 0.20; F(2,108) =28.06, p < 0.001, η= 0.38; F(3,162) = 3.35, p =0.021, η= 0.07; F(2,108) = 4.11, p = 0.028, η=0.08], 但组别的主效应、情绪类别和区域的交互效应以及组别、情绪类别和区域的交互效应均不显著(p > 0.05)。事后多重比较发现, 情绪类别的主效应表现为:悲伤的注视点个数最少(M= 14.44), 且显著小于其他三种情绪(M= 15.46, M= 15.52,M= 15.70) (p < 0.05), 但其他三种情绪之间的差异不显著(p > 0.05); 区域的主效应表现为:鼻子区域的注视点个数最少(M= 4.55), 且显著少于眼睛(M= 5.27)和嘴巴(M= 5.46) (p < 0.001),但眼睛和嘴巴之间的差异不显著(p > 0.05); 组别和情绪类别、组别和区域的交互效应表现为:低分组在加工悲伤情绪时眼睛区域的注视点个数(M=4.92, M= 5.29)显著多于高分组(p < 0.05), 在加工恐惧情绪嘴巴区域的注视点个数(M= 6.32, M=5.11)显著少于高分组(p < 0.01), 而其他情绪类别和区域的差异均不显著(p > 0.05) (见图6)。

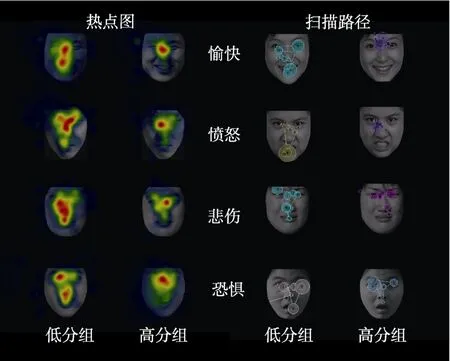

(3) 热点图和扫描路径

为直观展示不同情绪觉察能力在不同情绪面孔的加工模式, 随机选取高低情绪觉察能力职前教师各一名和四类情绪面孔各一张, 进行热点图和扫描路径分析, 热点图和扫描路径的结果显示(见图7), 低分组在不同情绪面孔上均存在眼睛和嘴巴两个注视焦点, 而高分组则主要存在眼睛这一焦点;低分组在不同情绪面孔上的加工模式一致, 均同时关注眼睛和嘴巴两个兴趣区, 而高分组对不同情绪面孔的加工模式则不一致, 在加工愉快、愤怒情绪时以眼睛区域为主, 而在加工悲伤和恐惧时, 尤其是恐惧面孔时, 则同时关注眼睛和嘴巴区域。

图5 不同情绪觉察能力分组在4类情绪面孔兴趣区上的注视时间

图6 不同情绪觉察能力分组在4类情绪面孔兴趣区上的注视点个数

图 7 不同情绪觉察能力职前教师在 4类情绪上的热点图和扫描路径

4 讨论

结合两个研究的结果发现, 不同情绪复杂性的职前教师在情绪面孔加工过程中存在行为、ERP和眼动三方面的差异:首先, 在行为结果方面, 高情绪觉察能力组在4类情绪面孔的正确率上均高于低情绪觉察能力组, 但仅愤怒、恐惧和悲伤差异显著,而高情绪觉察能力组在4类情绪的反应时上均显著短于低情绪觉察能力组, 这从行为层面表明高情绪觉察能力组在情绪加工中更快、更准。第二, ERP结果方面, 高分组在P100、N170和LPP三个成分的幅值上显著高于低分组, 而在VPP、P200和N200三个成分的幅值上显著低于低分组, 在早期阶段(100 ms~200 ms)和在晚期阶段(300 ms以后), 高分组在头皮后部脑区的激活高于低分组; 在中期阶段(200 ms~300 ms), 高分组在头皮前部脑区的激活低于低分组。第三, 在眼动方面, 结果发现在眼动总体特征上, 高分组的注视点个数、注视频率和瞳孔直径显著高于低分组, 但眼跳时间和眼跳幅度上显著低于低分组; 在眼动区域特征上, 低情绪觉察能力组在不同情绪面孔上的加工模式一致, 同时关注眼睛和嘴巴两个兴趣区, 而高分组对不同情绪面孔的加工模式则不一致, 在加工恐惧面孔时更关注嘴巴这一兴趣区。这一结果与 Lane提出情绪觉察能力的高低反映了个体在情绪信息加工时所采用的情感图式在分化和整合程度上的差异(Torrado et al., 2012)的假设是一致的:高情绪觉察者拥有更为丰富的情感图式可以促使个体在前注意阶段就更加有效和优先对情绪性信息进行注意(高分组在P100、N170幅值更高), 并使得他们在情绪知觉加工更简单(高分组在N200、P200的幅值更低), 最后还促使个体能对情绪信息做进一步精加工, 以丰富情感图式(高分组LPP的幅值更高); 同时这种更为丰富的情感图式还能提高了个体情绪加工效率(高分组的注视时间更短、注视频率更快), 并采用更为专家化的情绪加工模式(高分组的眼跳时间更短、眼跳幅度更小), 正是基于上述的优势, 才促使高情绪复杂性个体在情绪加工中有更优的行为表现——正确率更高且反应时更短。以下将具体进行说明。

4.1 行为结果方面

行为研究结果发现, 在正确率方面, 组别和情绪类别主效应以及它们的交互效应均显著, 事后多重比较结果发现, 在除愉快外的其他三种情绪上均表现为, 高情绪觉察能力高于低情绪觉察能力组;愉快的正确率最高, 并显著高于其他三种情绪, 而恐惧的正确率最低, 并显著低于愉快和悲伤。这一结果与以往研究显示高情绪觉察能力在正确率上显著高于低情绪觉察能力组的结论较为一致(Lane et al., 1996)。在反应时方面, 高情绪觉察能力组在4类情绪上均显著短于低情绪觉察能力组, 并且组别与情绪类别存在交互作用, 表现为低分组愉快的反应时显著短于其他三种情绪类, 悲伤显著高于愤怒和恐惧, 但愤怒和恐惧之间差异不显著; 高分组则是愉快的反应时显著短于其他三种情绪类别, 而其他三种情绪类别的反应时之间的差异则不显著,这一结果也与以往研究较为一致(Lane et al., 1996),并且也符合 Lane等人关于情绪觉察能力高低的理论解释:高情绪觉察能力个体的情感图式更为分化和整合(Torrado et al., 2012), 这就使得其在情绪面孔的加工过程中更为熟练, 更为专家化, 因此在行为实验上表现出正确率更高、反应时更短的结果。然而, 这种更为分化和整合的情感图式是如何促使高分组在情绪信息加工趋于专家化的呢?这还有待ERP和眼动研究的进一步探讨。

4.2 ERP结果方面

ERP成分根据潜伏期可以划分为3个阶段:早期阶段(100~200 ms)包括 N100、P100、N170 和 VPP等、中期阶段(200~300 ms)包括N200和P200等、以及晚期阶段包括P300和LPP等(Olofsson, Nordin,Sequeira, & Polich, 2008)。早期阶段(100 ms~200 ms)受到早期知觉加工和注意加工的影响(Luo et al.,2010), 有关研究表明当进行刺激辨别任务时,P100、N100反映了对目标刺激的选择性注意(Vogel& Luck, 2000), P100波幅还被认为与快速提取情绪信息有关(Vuilleumier & Pourtois, 2007)。N170和VPP的幅值也受到情绪效价的调节, 恐惧面孔比中性面孔诱发更大的N170波幅, 恐惧面孔的VPP波幅大于愉悦和中性面孔, Williams 等(2006)认为这种效应可能在某种程度上归于识别情绪的正确率。最近, N170和VPP也被认为可以区分情绪和中性面孔(Luo et al., 2010), 并得到单次提取分析结果的验证(Zhang, Luo, & Luo, 2013)。中期阶段(200 ms ~300 ms)反映了对刺激的早期辨别和选择加工过程(Olofsson et al., 2008)。P200被认为可能与视觉信息的早期语义加工有关(Zhao & Li, 2006), N200则被认为与物体的分类加工密切相关, 受视觉刺激分类的因素以及分类区分加工难度的调控, 表现为难度越大, 其幅值越大(Philiastides, Ratcliff, & Sajda,2006)。晚期阶段主要反映了高水平的认知加工阶段, 如对刺激的评价和选择, 涉及注意和记忆存贮等(Polich, 2007), 其幅值受任务关联性、动机意义,唤醒水平等因素的影响(Olofsson et al.,2008)。

二维地形图结果发现, 高分组头皮后部脑区的激活在早期阶段(100 ms ~ 200 ms)和在晚期阶段(300 ms以后)高于低分组, 但其头皮前部脑区的激活在中期阶段(200 ms ~ 300 ms)低于低分组; 具体ERP成分上表现为:高分组的P100、N170和LPP幅值显著高于低分组, 而其VPP、P200和N200的幅值显著低于低分组, 这一结果与二维地形图的结果大致一致, 但 VPP的幅值却是低分组高于高分组, 这与以往研究表明 VPP的幅值可能受到正确率的影响是一致的(Williams, Palmer, Liddell, Song,& Gordon, 2006), 行为结果也的确发现高分组的正确率高于低分组, 并且这一结果也得到情绪类别在VPP幅值和正确率上主效应显著的佐证:愉快的VPP幅值显著低于其他三种情绪的幅值, 愉快的正确率显著高于其他三种情绪。在P100、N170、P200、N200和 LPP其他五个成分上, 高低分组的差异与以往相关研究基本一致:如一项情绪觉察能力不足个体(述情障碍患者)的研究发现述情障碍患者在P100、N400和P300上的波幅更小(Taitano, 2001);另一项不同情绪技能的ERP新近研究也发现, P200的幅值与情绪技能得分呈负相关, 并认为这是由于高情绪技能个体由于其对情绪识别的专家化水平,在依据以往经验去确认情绪时耗费较少努力, 从而诱发较小的 P200幅值(Meaux, Roux, & Batty,2014)。另外, 有趣的是, 高低情绪觉察能力组的这种差异与一项有关大中学生的情绪加工差异类似(蒋长好, 2006), 初中生的N200的波幅大于大学生,但 P300的波幅则小于大学生。因此, 结合情绪觉察能力高低的本质在于情感图式的分化和整合程度、上述不同阶段反映心理意义及本研究的实验任务是区分各种情绪, 我们认为高情绪觉察能力个体更为分化和整合情感图式促使其在情绪识别中更趋于专家化水平, 这种情绪识别的专家化水平在任务的驱动下能有效引导他们对目标情绪信息的优先注意和早期知觉加工, 从而表现为 N100、P100和 N170的幅值高于低情绪觉察能力组; 同样由于这种情绪识别的专家化水平, 使得他们在中期阶段对刺激的早期辨别和选择加工过程中, 耗费更少的认知努力去确认情绪, 表现为P200和N200的幅值更低; 最后还是由于这种情绪识别的专家化水平,使得高情绪觉察能力组对情绪信息进行进一步精细加工, 甚至改进长时记忆中存贮的情感图式, 由此表现为LPP的幅值更高。总之, ERP结果表明高情绪复杂性个体更为分化和整合的情感图式促使其在情绪加工过程中的各个阶段对情绪信息更敏感, 以趋于达到情绪加工的专家化水平。

4.3 眼动结果方面

依据以往研究, 注视时间和注视频率是信息加工效率的重要指标, 而注视次数、眼跳幅度及各个注视点组成的注视轨迹则反映了个体在注视图片时所采用的信息搜索方式或注视模式(张运亮, 李宗浩, 孙延林, 杨晓晨, 阎国利, 2004)。相关研究也表明, 对情绪面孔的加工, 是个体通过眼睛运动来搜集对不同情绪识别所需的情绪性信息。因此, 结合本研究, 我们也从情绪加工的效率和情绪加工的模式两个方面分析情绪复杂性对情绪加工的影响。

首先, 在情绪加工的效率上。结果发现, 在注视时间上, 虽然高低情绪觉察能力组在总的注视时间差异不显著, 但在兴趣区上差异显著, 表现为高情绪觉察能力组的注视时间显著短于低情绪觉察能力组; 而在注视频率上, 高情绪觉察能力组显著高于低情绪觉察能力组, 这表明高分组的情绪加工速度更快。再结合上述情绪觉察能力组的正确率更高的行为结果, 不言而喻, 高情绪觉察能力组的情绪加工效率更高。此外, 瞳孔直径的结果也显示,高情绪觉察能力组在4类情绪上的瞳孔直径均显著高于低情绪觉察能力组。以往研究发现, 表情的效价影响情绪面孔的识别, 表现为负性情绪的瞳孔直径更大(Marsh, Ambady, & Kleck, 2005), 对其的解释有人认为是这可能由于负偏向导致个体需要耗费更多的注意资源所致, 由此, 瞳孔直径可能与注意和加工水平有关。这就不难解释高分组情绪加工更高效率的原因了。高情绪觉察能力个体在其更为分化和整合情感图式的指导下, 对情绪信息更为敏感, 可以快速有效投入注意资源, 从而在情绪加工过程中表现出更高的效率, 而低分组则没有相应情感图式的指导, 不能快速有效的投入注意资源, 因此加工效率更低。

第二, 在情绪加工的模式上。结果发现, 虽然高低情绪觉察能力组在眼跳数目、眼跳频率上的差异不显著, 但是在眼跳时间和眼跳幅度上的差异显著, 表现为低情绪觉察能力组的眼跳时间和眼跳幅度均显著高于高情绪觉察能力组。这可能与上述低情绪觉察能力组的加工效率低下有关。低情绪觉察能力没有更为分化和整合情感图式的指导, 在注视图片需要把每个情绪特征信息都关注到, 然后再做出判断, 这从热点图和扫描路径可以直观看出, 低情绪觉察能力组存在两个注视焦点, 并且在两个焦点间来回多次扫描, 这自然导致其眼跳的幅度增加、眼跳时间增长。结果还发现, 高低情绪觉察能力组在注视点个数的主效应显著, 并且还与情绪类别和区域的交互效应显著, 表现为低情绪觉察能力组对于不同情绪的注视点个数差异不显著, 而高情绪觉察能力组对不同情绪的注视点个数差异显著,并且高情绪觉察能力组在恐惧面孔的嘴巴区域显著高于低情绪觉察能力组, 但在悲伤面孔的眼睛区域显著小于低情绪觉察能力组。这表明高分组对于不同情绪类别有不同的注视兴趣区, 即对于不同情绪有不同的加工模式(在加工愉快、愤怒情绪时以眼睛区域为主, 而在加工悲伤和恐惧时, 尤其是恐惧面孔时则同时关注眼睛和嘴巴区域)。而低分组对于不同情绪加工模式大体类似, 即对不同情绪均同时关注眼睛和嘴巴两个兴趣区。可见, 对于不同情绪的加工, 高分组的情绪加工模式更具针对性,且眼动轨迹较为简单, 而低分组的情绪加工模式则缺乏针对性, 且眼动轨迹较为复杂和分散, 这一结果不仅与情绪觉察能力不足的身心疾患——自闭症儿童的研究结果一致(陈顺森, 白学军, 沈德立,闫国利, 张灵聪, 2011), 而且还与专家与新手篮球后卫运动的眼动差异较为一致(张运亮等, 2004)。总之, 眼动结果表明高情绪复杂性个体更为丰富的情感图式促使其在情绪加工过程中的加工效率更高,加工模式更优, 以趋于达到情绪加工的专家化水平。

5 结论

本研究采用行为、ERP和眼动技术考察了命题性情绪复杂性(情绪觉察能力)对情绪加工的影响,实验验证了 Lane等人关于情绪觉察能力高低的本质在于情感图式分化和整合程度的理论假设(Torrado et al., 2012)。高情绪觉察能力职前教师在情绪加工过程中更趋于专家化水平, 表现为正确率更高, 反应时更快, 这是因为高情绪复杂性职前教师从无意识阶段、注意阶段到决策阶段都对情绪类别信息更敏感, 且具有更高的加工效率和更优的加工模式。

致谢:感谢Lane教授、Carolyn博士、宣宾教授、罗俊龙博士给予的无私指导和帮助, 感谢评审专家对本文提出的宝贵建议!

Baslet, G., Termini, L., & Herbener, E. (2009). Deficits in emotional awareness in schizophrenia and their relationship with other measures of functioning. The Journal of Nervous and Mental Disease, 197(9), 655–660.

Beaman, A. (2008). The role of emotional awareness, and positive and negative social support in predicting well-being in recent retirees (Unpublished doctorial dissertation). Concordia University, Montreal.

Boden, M. T., Gala, S., & Berenbaum, H. (2013). Emotional awareness, gender, and peculiar body-related beliefs.Cognition and Emotion, 27(5), 942–951.

Boroş, S., & Curşeu, P. L. (2013). 'Would you like to talk about that?' How and when group emotional awareness enhances effectiveness of gender diverse teams. Psihologia Resurselor Umane, 11(2), 45–56.

Chen, S. S., Bai, X. J., Shen, D. L., Yan, G. L., & Zhang, L. C.(2004). Emotional faces detection and processing of individuals with autism spectrum disorder aged 7–10.Psychological Development and Education, 27(5),449–458.

[陈顺森, 白学军, 沈德立, 闫国利, 张灵聪. (2011). 7~10岁自闭症谱系障碍儿童对情绪面孔的觉察与加工. 心理发展与教育, 27(5), 449–458.]

Cole, P. M., Llera, S. J., & Pemberton, C. K. (2009).Emotional instability, poor emotional awareness, and the development of borderline personality. Development and Psychopathology, 21(4), 1293–1310.

Davis, M. C., Zautra, A. J., & Smith, B. W. (2004). Chronic pain, stress, and the dynamics of affective differentiation.Journal of Personality, 72(6), 1133–1160.

Downey, J. A. (2003). Emotional awareness as a mediator of community college student satisfaction ratings. Community College Journal of Research & Practice, 27(8), 711–720.

Eastabrook, J. M., Flynn, J. J., & Hollenstein, T. (2014).Internalizing symptoms in female adolescents: Associations with emotional awareness and emotion regulation. Journal of Child and Family Studies, 23(3), 487–496.

Fantini-Hauwel, C., Boudoukha, A. H., & Arciszewski, T.(2012). Adult attachment and emotional awareness impairment: A multimethod assessment. Socioaffective Neuroscience& Psychology, 2, 10744.

Frewen, P. A., Dozois, D. J. A., Neufeld, R. W. J., & Lanius, R.A. (2012). Disturbances of emotional awareness and expression in posttraumatic stress disorder: Meta-mood,emotion regulation, mindfulness, and interference of emotional expressiveness. Psychological Trauma: Theory,Research, Practice, and Policy, 4(2), 152–161.

Frewen, P., Lane, R. D., Neufeld, R. J., Densmore, M., Stevens,T., & Lanius, R. (2008). Neural correlates of levels of emotional awareness during trauma script-imagery in posttraumatic stress disorder. Psychosomatic Medicine, 70(1),27–31.

Gençoğlu, C., & Yılmaz, M. (2014). The effect of emotional awareness education, based on emotion focused therapy, on young adults’ levels of optimism. The Journal of Happiness& Well-Being, 2(1), 51–62.

Gu, X. S., Hof, P. R., Friston, K. J., & Fan, J. (2013). Anterior insular cortex and emotional awareness. Journal of Comparative Neurology, 521(15), 3371–3388.

Herbert, B. M., Herbert, C., & Pollatos, O. (2011). On the relationship between interoceptive awareness and alexithymia:Is interoceptive awareness related to emotional awareness?Journal of Personality, 79(5), 1149–1175.

Jiang, C. H. (2006). The event-related potentials studies of facial expression processing of students in secondary schools and universities (Unpublished doctorial dissertation).Capital Normal University, Beijing.

[蒋长好. (2006). 大中学生面部表情加工的事件相关电位研究 (博士学位论文). 首都师范大学, 北京.]

Jobe-Shields, L., Parra, G. R., & Buckholdt, K. E. (2013).Perceptions of parental awareness of emotional responses to stressful life events. The Family Journal, 21(4), 408–416.

Kamel, N. M. F. (2013). The relationship between emotional awareness and empathetic response among psychiatric hospital staff. Life Science Journal, 10(3), 1272–1284.

Kang, S. M., & Shaver, P. R. (2004). Individual differences in emotional complexity: Their psychological implications.Journal of Personality, 72(4), 687–726.

Kerns, C. E., Comer, J. S., & Zeman, J. (2014). A preliminary psychometric evaluation of a parent-report measure of child emotional awareness and expression in a sample of anxious youth. Cognitive Therapy and Research, 38(3), 349–357.

Kim, G. M., & Cha, S. (2013). Influence of emotional awareness, emotional expressiveness, and ambivalence over emotional expressiveness on college student adjustment in freshman nursing students. The Journal of the Korea Contents Association, 13(1), 322–332.

Koçoğlu, Z. (2011). Emotional intelligence and teacher efficacy: A study of Turkish EFL pre-service teachers. Teacher Development, 15(4), 471–484.

Lane, R. D. (2000). Levels of emotional awareness: Neurological, psychological, and social perspectives. In R. E.Bar-On & J. D. A. Parker (Eds.), The handbook of emotional intelligence: Theory, development, assessment, and application at home, school, and in the workplace (pp.171–191). San Francisco, CA US: Jossey-Bass.

Lane, R. D. (2006). Theory of emotional awareness and brain processing of emotion. In C. Kubo, T. Kuboki, C. Kubo, &T. Kuboki (Eds.), Psychosomatic medicine: Proceedings of the 18th World Congress on Psychosomatic Medicine (pp.116–121). New York: Elsevier Science.

Lane, R. D., & Schwartz, G. E. (1987). Levels of emotional awareness: A cognitive-developmental theory and its application to psychopathology. American Journal of Psychiatry,144(2), 133–143.

Lane, R. D., Kivley, L. S., Du Bois, A., Shamasundara, P., &Schwartz, G. E. (1995). Levels of emotional awareness and the degree of right hemispheric dominance in the perception of facial emotion. Neurophychologia, 33(5), 525–538.

Lane, R. D., Sechrest, L. Reidel, R., Weldon, V., Kaszniak, A.,& Schwartz, G. E. (1996). Impaired verbal and nonverbal emotion recognition in alexithymia. Psychosomatic Medicine,58(3), 203–210.

Lane, R. D., Quinlan, D. M., Schwartz, G. E., Walker, P. A., &Zeitlin, S. B. (1990). The Levels of Emotional Awareness Scale: A cognitive-developmental measure of emotion.Journal of Personality Assessment, 55(2), 124–134.

Lane, R. D., Reiman, E. M., Axelrod, B., Yun, L. S., Holmes,A., & Schwartz, G. E. (1998). Neural correlates of levels of emotional awareness: Evidence of an interaction between emotion and attention in the anterior cingulate cortex.Journal of Cognitive Neuroscience, 10(4), 525–535.

Lichev, V., Rufer, M., Rosenberg, N., Ihme, K., Grabe, H. J.,Kugel, H., … Suslow, T. (2013). Assessing alexithymia and emotional awareness: Relations between measures in a German non-clinical sample. Comprehensive Psychiatry,55(4), 952–959.

Lindquist, K. A., & Barrett, L. F. (2008). Emotional complexity. In Handbook of emotions (3rd ed., pp. 513–530).New York, NY US: Guilford Press.

Luo, W. B., Feng, W. F., He, W. Q., Wang, N. Y., & Luo, Y. J.(2010). Three stages of facial expression processing: ERP study with rapid serial visual presentation. NeuroImage,49(2), 1857–1867.

Maliken, A. C., & Katz, L. F. (2013). Fathers’ Emotional awareness and children’s empathy and externalizing problems: The role of intimate partner violence. Journal of Interpersonal Violence, 28(4), 718–734.

Marsh, A. A., Ambady, N., & Kleck, R. E. (2005). The effects of fear and anger facial expressions on approach-and avoidance-related behaviors. Emotion, 5(1), 119–124.

McRae, K., Reiman, E. M., Fort, C. L., Chen, K. W., & Lane,R. D. (2008). Association between trait emotional awareness and dorsal anterior cingulate activity during emotion is arousal-dependent. Neuroimage, 41(2), 648–655.

Meaux, E., Roux, S., & Batty, M. (2014). Early visual ERPs are influenced by individual emotional skills. Social Cognitive and Affective Neuroscience, 9(8), 1089–1098.

Ni, X. M. (2010). Practice-oriented: Reconstruction of initial teacher education model. Teacher Education Research,22(1), 22–27.

[倪小敏. (2010). 实践取向:职前教师教育模式的重构. 教师教育研究, 22(1), 22–27.]

Olofsson, J. K., Nordin, S., Sequeira, H., & Polich, J. (2008).Affective picture processing: An integrative review of ERP findings. Biological Psychology, 77(3), 247-265.

Parling, T., Mortazavi, M., & Ghaderi, A. (2010). Alexithymia and emotional awareness in anorexia nervosa: Time for a shift in the measurement of the concept? Eating Behaviors,11(4), 205–210.

Philiastides, M. G., Ratcliff, R., & Sajda, P. (2006). Neural representation of task difficulty and decision making during perceptual categorization: A timing diagram. Journal of Neuroscience, 26(35), 8965–8975.

Pimpas, I. (2013). A psychological perspective to dramatic reality: A path for emotional awareness in autism. Taylor &Francis Online, 35(1), 57–63.

Polich, J. (2007). Updating P300: An integrative theory of P3a and P3b. Clinical Neurophysiology: Official Journal of the International Federation of Clinical Neurophysiology,118(10), 2128–2148.

Racine, S. E., & Wildes, J. E. (2013). Emotion dysregulation and symptoms of anorexia nervosa: The unique roles of lack of emotional awareness and impulse control difficulties when upset. International Journal of Eating Disorders, 46(7), 713–720.

Raucher-Chéné, D., Cuervo-Lombard, C., & Kaladjian, A.(2013). Could emotional awareness influence drinking outcomes in an alcohol dependent population? European Psychiatry, 28(S1), 1.

Sang, G. Y. (2011). Paradigm transformation and program innovation of pre-service teachers’ educational practice.Teacher Education Research, 23(4), 16–21.

[桑国元. (2011). 职前教师教育实践的范式变迁与模式革新.教师教育研究, 23(4), 16–21.]

Shouse, S. H., & Nilsson, J. (2011). Self-silencing, emotional awareness, and eating behaviors in college women.Psychology of Women Quarterly, 35(3), 451–457.

Silani, G., Bird, G., Brindley, R., Singer, T., Frith, C., & Frith,U. (2008). Levels of emotional awareness and autism: an fMRI study. Social Neuroscience, 3(2), 97–112.

Subic-Wrana, C., Beutel, M. E., Brähler, E., Stöbel-Richter, Y.,Knebel, A., Lane, R. D., & Wiltink, J. (2014). How is emotional awareness related to emotion regulation strategies and self-reported negative affect in the general population? PloS One, 9(3), e91846.

Szczygieł, D., Buczny, J., & Bazińska, R. (2012). Emotion regulation and emotional information processing: The moderating effect of emotional awareness. Personality and Individual Differences, 52(3), 433–437.

Taitano, E. K. (2001). Individual differences in emotional awareness and the lateralized processing of emotion (Unpublished doctorial dissertation). University of Illinois at Urbana-Champaign, Champaign.

Torrado, M., Ouakinin, S., & Lane, R. (2012). Measuring emotional awareness from a cognitive-developmental perspective: Portuguese adaptation studies of the levels of emotional awareness scale. Acta Medica Portuguesa, 26(2),145–153.

Torrado, M. V., Ouakinin, S. S., & Bacelar-Nicolau, L. (2013).Alexithymia, emotional awareness and perceived dysfunctional parental behaviors in heroin dependents. International Journal of Mental Health and Addiction, 11(6),703–718.

Tugade, M. M., Fredrickson, B. L., & Barrett, L. F. (2004).Psychological resilience and positive emotional granularity:Examining the benefits of positive emotions on coping and health. Journal of Personality, 72(6), 1161–1190.

Vogel, E. K., & Luck, S. J. (2000). The visual N1 component as an index of a discrimination process. Psychophysiology,37(2), 190–203.

Vuilleumier, P., & Pourtois, G. (2007). Distributed and interactive brain mechanisms during emotion face perception: Evidence from functional neuroimaging. Neuropsychologia, 45(1), 174–194.

Wang, H. B., Chen, N., & Chen, F. (2013). Changes in teachers’ mental health: A cross-temporal meta-analysis.Shanghai Research on Education, (2), 41–45.

[汪海彬, 陈宁, 陈峰. (2013). 中小学教师心理健康状况的横断历史研究. 上海教育科研, (2), 41–45.]

Wang, H. B., Lu, J. M., & Chen, N. (2013). The foundation of emotional intelligence: The present and the future of emotional awareness researches. Journal of Psychological Science, 36(3), 748–752.

[汪海彬, 卢家楣, 陈宁. (2013). 情绪智力的基础: 情绪觉察的研究现状与展望. 心理科学, 36(3), 748–752. ]

Wang, Y., & Luo, Y. J. (2005). Standardization and assessment of college students’ facial expression of emotion. Chinese Journal of Clinical Psychology, 13(4), 396–398.

[王妍, 罗跃嘉. (2005). 大学生面孔表情材料的标准化及其评定. 中国临床心理学杂志, 13(4), 396–398. ]

Williams, L. M., Palmer, D., Liddell, B. J., Song, L., &Gordon, E. (2006). The ‘when’and ‘where’of perceiving signals of threat versus non-threat. Neuroimage, 31(1),458–467.

Zhang, D. D., Luo, W. B., & Luo, Y. J. (2013). Single-trial ERP analysis reveals facial expression category in a threestage scheme. Brain Research, 1512, 78–88.

Zhao, L., & Li, J. (2006). Visual mismatch negativity elicited by facial expressions under non-attentional condition.Neuroscience Letters, 410(2), 126–131.

Zhang, Y. L., Li, Z. H., Sun, Y. L., Yang, X. C., & Yan, G. L.(2004). Eye movements of the novice and the expert of basketball guards. Studies of Psychology and Behavior, 2(3),534–538.

[张运亮, 李宗浩, 孙延林, 杨晓晨, 阎国利. (2004). 专家与新手篮球后卫运动员的眼动研究. 心理与行为研究, 2(3),534–538.]