基于小世界网络的Hopfield联想记忆模型

2014-09-13张瑞成胡绪磊

张瑞成,胡绪磊

(河北联合大学 电气工程学院,河北 唐山 063009)

联想记忆神经网络是人工神经网络的一个重要组成部分,但网络复杂度过高,硬件难以实现等问题严重地制约着联想记忆网络的研究和发展[1]。近年来,在生物学背景下提出的Watts-Strogatz小世界网络模型为联想记忆网络的研究提供了一种新的途径[2]。J.W.Bohland等率先将Watts-Strogatz小世界网络引入传统全互联Hopfield模型中,提出了一种基于WS小世界网络的联想记忆模型(WSAM)[3]。随后,在此基础上进行了相关研究[4-6],然而从研究结果分析发现,WS小世界网络在构造过程中进行“断键重连”,可以降低网络的连接数量,因此将其引入到联想记忆网络中确实可以解决复杂度过高的问题,但同时“断键重连”也会造成重要信息的丢失,使网络性能变差。

针对WS小世界网络的这一问题,Newman和Watts提出了Newman-Watts小世界网络模型[7],用“随机加边”代替了“断键重连”,从而有效地保护了连接权上的信息,同时还可以避免产生孤立节点[7]。鉴于以上分析,提出了一种基于NW小世界网络的联想记忆模型(NWAM),借鉴现有小世界联想记忆模型的思想给出该模型的生成方法和相应的理论算法,并设计实验对比NWAM与WSAM的联想和记忆性能以及抗干扰能力。

1 NW小世界网络模型

Newman和Watts在WS小世界的基础上提出NW小世界模型,用“随机加边”来代替WS模型中的“断键重连”,从而保证了网络的整体连通性。其实质是在规则网络的基础上以概率p随机化加边,从而形成稀疏的长程连接和稠密的短程连接。

NW小世界模型的构造算法[8-9]如下:

1)从一个包含N个节点的规则网络出发,网络围成环形且每个节点只与它相邻的K个节点相连;

2)从某一节点出发,按照概率p随机地选择新的节点进行连接,节点自身和已连接节点除外;

3)重复2),直到遍历所有节点,最终形成NW小世界模型。

NW模型是在规则网络中增加了“长程”连接,通过变化概率p,可以得到从规则网络(p=0)到随机网络(p=1)的一个变化过程,如图1。

图1 NW网络体系结构演化Fig.1 The diagram of regular networks, NW small world network and random network

在模型中每个节点将其输出反馈给它的K=cN个最近的相邻节点,c=K/N表示网络的全局连接度。与WS模型相比,NW小世界模型的构造更加方便,而且不会破坏原网络的连接,从而保证了网络的连通性。虽然NW模型中的连接边有少量的增加,但是由于小世界网络的特殊性质,概率p保持在很小范围内,增加的连接边数也很少,对网络整体复杂度影响不大。而合理地添加捷径,使信息更加完整地进行传递,模型的性能更加完善。在NW小世界网络模型中,用少量连接代价换取了性能上的显著提高。

2 基于NW型小世界网络Hopfield

联想记忆模型

2.1 模型的生成

联想记忆模型具有良好的联想记忆功能,但是网络结构复杂,且复杂度较高。将NW小世界网络引入联想记忆模型中可以在保证网络性能的前提下,降低网络的复杂度,化简网络结构,而且与WS小世界模型相比,性能更完善、更稳定。

基于NW小世界网络的联想记忆模型的构造流程如下:

1)按照第1节中介绍的方法从一个平均度为K的规则网络开始,按照概率p随机地选择新的节点进行连接,构建出一个NW小世界网络模型。

2)定义连接矩阵C表示NW小世界网络的连接情况,若神经元i,j存在连接,则cij=1;若不存在连接,则cij=0。

3)根据传统Hopfield网络构建方法构建一个与NW网络神经元个数相同的全互联结构联想记忆网络,并使用传统联想记忆网络学习规则得到其连接权值矩阵W={wij}。

4)将W与C做点乘得到W*,通过NW网络的连接矩阵C对Hopfield网络连接权值矩阵W进行优化,W*为基于NW小世界网络的联想记忆模型的连接权矩阵。

5)根据W*为连接权值矩阵,建立基于NW小世界网络的联想记忆模型。

该模型保留了联想记忆的功能,又具有小世界特性,在保证网络性能的前提下,运用小世界思想将全连接结构很大程度上地进行了稀疏化,从而大大地减小了模型的复杂度,由于神经元之间的平均连接规模被有效降低,更有利于网络的硬件实现,在运算速度上也更快。

2.2 模型的算法

模型的工作过程与传统联想记忆相似,也分为记忆阶段和联想阶段。记忆阶段就是根据网络结构,设计或学习网络的连接权值,使模型具有若干个稳定状态;联想阶段就是根据给定输入模式,通过动力学演化到稳定状态,回想起已存储模式的过程[10]。

2.2.1 记忆阶段

记忆阶段就是一个对权值学习和确定的过程,记忆阶段的完成应该形成网络的连接权值矩阵。假设基于NW小世界网络的联想记忆模型中有N个神经元,它的连接矩阵可以用C={cij}来表示,如果神经元i到j之间存在一个连接,那么cij=1,如果不存在连接,cij=0,最终得到表示模型存在连接关系的矩阵C:

cii=0,cij=cji

(1)

假设模型为全互联Hopfield网络,使用Hebb学习规则来确定模型的权值矩阵W={wij},且wii=0,wij=wji,权值可以表示为

(2)

由式(1)、(2),通过重连概率p确定NW小世界网络的连接矩阵,进一步利用其对模型的权值矩阵W={wij}进行化简,可得出基于NW小世界网络的联想记忆模型的连接权值矩阵W*:

(3)

2.2.2 联想阶段

联想阶段就是在已知权值矩阵的基础上构建网络模型,然后将给定的模式输入到模型中进行处理,通过动力学演化最终达到稳定状态,回想起已存储的模式。

假设有一组待记忆的N维模式列向量ξμ,μ={1,2,…,M},ξu为任意输入模式,ξu′为ξu的下一个状态,网络的动力学演化方程为

ξμ′=sgn(W*ξμ)

(4)

当网络状态按照式(4)不断演化到达稳定状态时,定义参数R为

(5)

式(5)表示得到的输出模式ξ′与已存储模式ξ的相似度,可以用来作为衡量模型联想记忆性能和抗干扰能力的指标。

3 仿真与分析

为了验证引入NW小世界网络来代替WS小世界网络后模型的性能得到了提高,给出如下 2个实验进行分析。分别讨论NWAM 与WSAM关于不同参数联想记忆性能的对比,以及2种模型同时用于含噪交通标志图像识别时的效果对比。

为了表示理解,将原始交通图像作为以存储模式ξ,最终识别图像为输出模式ξ′,因此参数R可以表示图像的相似程度,定义为图像的重复度。

实验1 NWAM与WSAM 联想记忆性能对比分析。

1)考察模型在其他条件相同,重连概率p不同的情况下模型的联想记忆性能。

为了便于判断和分析,模型取神经元个数N=2 500,模式M=10,平均度K=50,全局连接度c=0.02。比较NWAM和WSAM对随机加噪 30% 模式的联想记忆能力。实验结果如图2所示。

图2 不同重连概率下,2种模型记忆性能比较Fig.2 Simulation results of NWAM and WSAM with different probabilities

实验结果显示,在其他条件相同的情况下,当重连概率p不断增加时,2种模型的联想记忆性都能得到极大的改善,但是NWAM的性能提高的程度要明显高于WSAM,在任意相同概率p下,NWAM对加噪模式联想记忆的性能都要优于WSAM,而且NWAM 最终达到的性能状态也明显优于WSAM。

2)考察2种模型的网络性能与网络全局连接度c之间的关系。

模型取神经元个数N=2 500,模式M=10,重连概率p=0.4,加噪程度为30%。结果如图3。

图3 不同全局连接度下模型回忆性能比较(加噪 30% )Fig.3 Simulation results of NWAM and WSAM with different connection degree c with 30% noise

实验结果显示,当网络全局连通度c不断增加时,2种模型的网络性能都得到提高,但是,在任意相同全局连接度c下,NWAM对加噪模式联想记忆的性能都要优于WSAM,而且当c的值很小时,模型的性能就可以达到一个很高的水平。

3)考察噪音干扰下的网络性能。

取相同的网络环境,N=2 500,M=10,p=0.4,K=50,噪音选用常见的椒盐噪声,对比2种模型在噪音干扰下的网络性能,结果如图4所示。

图4 不同加噪程度下2种模型回忆性能比较Fig.4 Simulation results of NWAM and WSAM with different levels of noise

随着加噪程度的不断增加,2种模型的性能都受到影响,但是NWAM性能始终要优于WSAM,而且当噪音较大时,NWAM依然可以维持很好的网络性能,表现出较强的抗干扰能力。

实验2 应用实例对比研究。

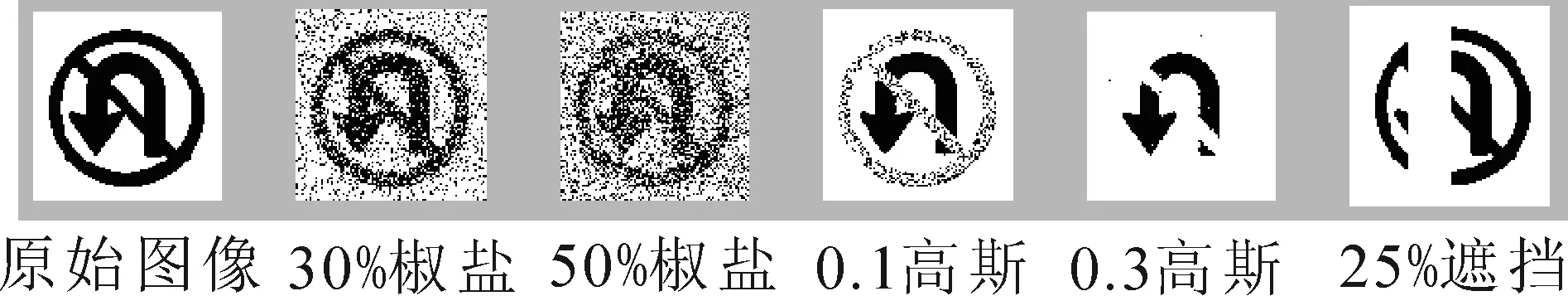

为验证新模型对加噪图像识别的实际效果,文中引入了一个二值化交通标志图像,分别对其添加30%、50%椒盐噪声;均值为0,方差为0.1、0.3的高斯噪声;25%遮挡处理,然后分别用2种模型分别对含有噪音的交通图像进行识别,取相同的网络环境:重连概率p=0.4,平均度K=50,所取样本图像像素为50×50,迭代次数为1。其效果图如图5所示。

(a)原始记忆图像及加噪图像

从图5对比结果可以看出,这2种模型都可以在噪音干扰下对图像进行识别,但NWAM的识别效果始终要比WSAM好。特别是对30%、50%椒盐噪音时,效果明显要优于WSAM的识别效果,总体来说, NWAM用于模式记忆和加噪模式识别的性能优于WSAM,体现出更强的鲁棒处理能力。

4 结束语

本文对NW小世界网络进行了分析,将其引入到联想记忆网络中,构建基于NW小世界网络结构的联想记忆模型,借鉴现有小世界联想记忆模型的思想给出模型的生成方法以及相应的理论算法。实验结果表明,网络模型的性能主要与重连概率p、全局连接度c和加噪指数有关。当加噪指数相同时,2个模型的联想和记忆性能都随着重连概率p和全局连接度c的增加而得到改善,而且NWAM的性能始终要优于WSAM;当重连概率p和全局连接度c相同时,模型的网络性能随着加噪指数的增加都发生了不同程度的降低,但与WSAM相比,NWAM降低很慢且平缓,表现出更强的抗干扰能力。最终,将模型应用于含噪交通图像识别中,识别结果显示,在不同形式、程度的噪声和遮挡干扰下,NWAM的识别准确率要高于WSAM,识别结果更清晰,表现出良好的容错性和鲁棒性。通过仿真结果发现,基于NW小世界网络结构的联想记忆模型具有以下优点:

1)将NW小世界网络引入到联想记忆网络中,简化了网络结构,减小了网络的时间和空间复杂度,使网络的硬件实现也变得更容易。

2)与WSAM相比,有效地保护连接权上的信息,同时避免了孤立节点的产生,使模型对模式的记忆和联想能力都得到了很大提高,对加噪模式识别时抗干扰能力也更强。

3)通过对比2个模型对含噪音交通图像的识别结果发现,NWAM识别结果要比WSAM更准确,与原图像的误差更小,从而证明其具有更好的鲁棒性。

参考文献:

[1]EGUILUZ V M, CHIALVO D R, CEEHI G A, et al. Seale-free brain functional networks[J].Phys Rev Lett, 2005, (94) 5: 18-22.

[2]AGUIRRE C, HUERTA R, CORBACHO F, et al. Analysis of biologically inspired small-world networks[J].Artificial Neural Networks, 2002, 15(4): 27-32.

[3]BOHLAND J W, MINAI A A. Efficient associative memory using small-world architecture[J]. Neurocomputing, 2001, 38(9): 489-496.

[4]陈蕾,张道强,周鹏,等. 基于SWA的核自联想记忆模型及其人脸识别应用[J]. 应用科学学报, 2005, 23(5): 497-501.

CHEN Lei, ZHANG Daoqiang, ZHOU Peng, et al. Small-world architecture based kernel auto-associative memory model and its application to face recognition[J]. Journal of applied Sciences, 2005, 23(5): 497-501.

[5]金燕晖,陈贤富. 基于小世界体系的投影学习联想记忆模型研究[J]. 计算机仿真, 2009, 26(4): 207-210.

JIN Yanhui, CHEN Xianfu. A projection learning rule associative memory model based on small-world architecture[J]. Computer Simulation, 2009, 26(4): 207-210

[6]陈蕾,陈松灿,张道强. 小世界体系的多对多联想记忆模型及其应用[J]. 软件学报, 2006, 17(2): 223-231.

CHEN Lei, CHEN Songcan, ZHANG Daoqiang. Small world structure inspired many to many kernel associative memory models and their application[J]. Journal of Software, 2006, 17(2): 223-231.

[7]NEWMAN M E J, WATTS D J. Scaling and percolation in the small-world network model[J]. Phys, 1999, 60(8): 7332-7342.

[8]张瑞成,李冲. 小世界人工神经网络模型及其应用研究[J]. 计算机仿真,2011, 28(10): 95-98.

ZHANG Ruicheng, LI Chong. Model of NW multilayer feedforward small-world artificial neural networks and it’s applied[J]. Computer Simulation, 2011, 28(10): 95-98.

[9]NEWMAN M E, WATTS D J. Renormalization group analysis of the small-world network model[J]. Physics Letters A, 1999, 263(4): 341-346.

[10]杨静,高隽,谢昭,等. 一种新的小世界体系联想记忆模型[J]. 仪器仪表学报, 2009, 30(10): 2057-2063.

YANG Jing, GAO Jun, XIE Zhao, et al. Novel associative memory model based on small-world adaptive structure[J]. Chinese Journal of Scientific Instrument, 2009, 30(10): 2057-2063.