系统事故建模方法演进研究

2014-05-23罗建原

□罗建原 程 琦 罗 帆

[1.武汉理工大学 武汉 430070;2.天安财产保险股份有限公司 上海 200000]

在现代社会技术系统中,事故不再是单个组件意外故障或人为错误的结果,故传统事故建模方法不足以分析新环境下的意外事件。新技术环境让事故致因发生根本变化,并推动了事故模型及其建模方法的演进[1~2]。当今,高新技术快速发展并广泛应用于工业、商业和国防等各个领域,使得事故环境发生巨大变化,主要包括:(1)科技创新加速:科技发展速度超过了其在工程领域的应用速度。(2)改变事故性质:数字技术静悄悄地再造了工艺流程和控制系统等工程领域的各个方面,而相关的安全工程技术并没有与之保持同步。数字系统引入了事故的新“失败模式”。(3)复杂性增加:复杂性涵盖许多方面,特别是在互动复杂系统中,大部分复杂性日益增强。(4)耦合性增强:紧耦合将系统某部分的中断或紊乱交互传送到远方,并产生波及效应。上述几种因素往往交织在一起,共同影响着社会技术系统。

总之,日益复杂的社会技术系统日益挑战现有事故分析方法,也为新方法的诞生提供了机遇。本文主要从系统角度梳理事故建模方法,并指出其发展趋势。

一、复杂社会技术系统

社会技术理论认为,人主体和社会机构是技术系统的组成部分,实现组织目标不仅需要通过技术体系的优化,也通过技术和社会方面的联合优化[3]。因此,现代复杂系统的研究需要理解系统各方面,如技术、人力、社会和组织之间的交互和关系。

复杂系统是由许多以线性和复杂方式彼此交互的组件构成。线性相互作用一般是那些处于生产或维修的序列的简单活动,或能看到的活动;而复杂非线性的相互作用产生于不熟悉的序列、无计划的和意想不到的序列,或是不能立刻理解的序列。两个或多个离散的故障能够以设计人员无法预测的方式进行交互,从而让操作人员无法理解或控制,除非无穷尽地建模或测试。

近年来,“系统系”(System of systems,SOS)成为日益流行术语,用于描述由各种异构、互操作的协作系统构成的大规模系统[4]。系统系由多个甚至上百或上千本身独立的组件系统构成。每个组件系统有不同治理结构,不同的技术,不同的目标;优化方式也各有不同,但是他们所执行的任务相互重叠。毫无疑问,系统系的运行存在多种不确定性、潜在风险和故障。

二、系统性建模方法

(一)系统理论方法

事故建模的新方法应从整体上考虑系统性能。系统性模型是指,当几个偶然因素(如人力,技术和环境)巧合地存在于特定的时间和空间时,意外发生了[5]。系统性模型将事故视为由系统组件之间复杂相互作用所导致的突发现象,可能导致系统性能下降或意外事故。

系统性模型根植于系统理论。在系统理论的建模方法中,系统由通过信息和控制反馈回路保持平衡的交互组件构成。系统不是静态设计,而是不断地自适应以实现其目标、应对本身和环境变化的动态过程。意外被视为是有缺陷过程的结果,涉及到人、社会和组织结构、工程物理活动和软件系统等诸多组件之间的交互[6]。

(二)认知系统工程方法

科技改变了人的工作性质,从以手工操作为主任务转向以知识密集及认知为主任务,并影响着分析失误模型和联合人-机系统事故建模的方法发展。

认知系统工程作为一个框架,用于工作环境下构建人-机系统的行为模型。传统的观点认为,“人因差错”代表事后分析的合理化[7],是基于逆向因果关系原则:“如果有影响,那么就必须有一个原因”。而认知系统工程认为,如果我们不理解事情正常运行的原理,那么无法理解事情出错的原因[8]。Hollnagel和Woods为联合认知系统引入一个新范例,描述人类和技术作为一个联合系统如何发挥功能,而不是人与机器如何交互。他们提倡,安全工作始于理解人类和联合认知系统性能的正常变化,而不是关于特定的、高度推理性的“错误机制”。

用于安全和分析的两个系统性事故模型都是基于认知系统工程原则:认知可靠性、误差分析方法(CREAM)和功能性共振事故模型(FRAM)。

CREAM 是基于对人行为认知的建模,以评估人为错误对系统安全所造成的后果。CREAM 有两个版本:DREAM(Driver Reliability and Error Analysis Method)用于交通事故分析,BREAM 用于海上事故。

FRAM是定性分析模型,描述系统组件的功能如何产生共振、失去控制和导致事故危险[5]。FRAM的前提是,性能变化、内部变化和外部的变化都是正常的;且从这个意义上讲,在复杂社会技术系统中,如航空系统,性能是永远不稳定的。

(三)社会技术系统分析框架

社会技术系统运行在高度可变和动态环境下,如市场竞争、经济和政治压力、立法和社会安全意识,以及快速发展的复杂性科学技术。他们促进高风险社会技术系统的形成与发展。Rasmussen假设,这些因素改变现代社会的动态性,并持续影响运行在复杂系统中的操作准则和人的行为。确定性因果模型(如事件顺序链)无法胜任对高度适应性社会技术系统中故障和事故的研究。Rasmussen采用基于控制理论的系统导向分析,提出了构建组织、管理和运作结构的框架,创建了意外事件的先决条件。Rasmussen的社会风险管理框架包括结构和动力学两部分[9]。

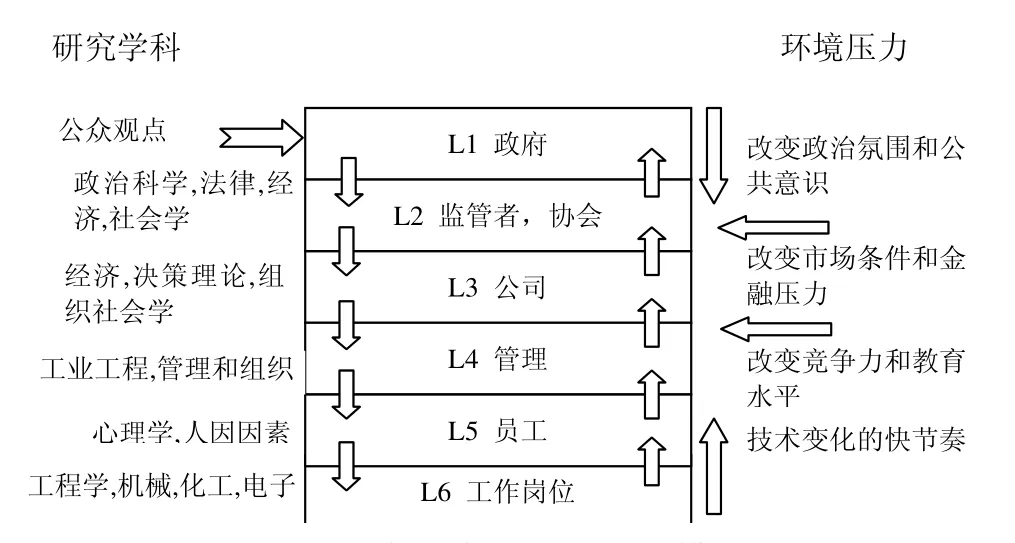

1.结构层次

Rasmussen将风险管理视为社会技术系统中的控制问题,其中人员伤亡、环境污染和金融灾难起因于物理过程失控。在环境压力和约束背景下,安全取决于工作流程的控制。

图1 社会技术系统的层级模型

用于风险管理的社会技术系统包括几个层级,如图1所示。顶层L1描述通过立法控制政府在社会安全习惯的活动;第二层L2描述监控者、行业协会和联合会(如医疗和工程委员会)的活动,其中联合会负责促进各部门的执法;L3描述了公司活动;L4描述公司的领导、管理和控制工作人员的管理活动;L5描述各个员工直接地与技术或工艺进行互动的控制活动;底层L6描述工程学科的应用,包括应用于有潜在危险的设备和过程控制操作程序的设计。

传统上,每个层级由特定的学科分别地进行研究。例如,顶层风险管理研究不涉及较低层级上的细节内容。这个框架提出曾被所有水平研究工作忽视的关键因素,即纵向穿越水平层级的“垂直”联合。上级所做出的组织和管理决策应传达给下级层次,而低层级的进程信息应传送给上级。这种信息垂直流动形成了闭环反馈系统,它在整体社会技术系统的安全中发挥重要作用。在各个层面上,决策及决策者的行动也可导致事故,而不是仅限于控制层面上工人所导致事故。

如图1右侧所示,复杂社会技术系统的各层日益受到外部破坏性力量的影响。这种外部力量快速变化和不可预测。当不同层级上的系统正经受不同的压力及每个系统接收不同时间上的操控时,通过强调施加于各个层面上不断变化约束的协调一致,提高每个层面的安全性,这才是管理意外事件或不确定性的重点。

2.系统动力

在复杂动态环境中,特别是在紧急、高风险和非预期情况下,无法建立适合每种条件下的程序[9]。在核电站运行中,任务和程序都有严格规定,违反指令的应给予监管[10]。然而,Vicente认为,考虑到实际工作量和时间的限制,运营商违反正式程序的行为似乎相当理性(理智)。经营者的行为依赖于情景关系,并形成于动态工作环境下。

决策和人类活动应限制在由行政、功能和安全约束所定义的工作边界内。Rasmussen指出,在分析工作区域安全时,重要的是识别安全操作界限和导致社会技术系统朝着边界迁移或跨越边界的动态力量[9],如图2所示。动态力量能影响复杂社会技术系统,让其随着时间变化改变其行为。安全行为空间是指主体能随意操作的区域,是由三个边界线合围而成:个人不可接受工作量,财政和经济的制约,以及安全规章和程序。财政压力产生成本梯度,促进个人行为采取更经济有效的工作方法;而工作量压力导致努力梯度,激励个人改变自己工作习惯,以减少认知或体力的劳动。这些梯度诱导人们改变行为,类似于气体分子的“布朗运动”。

图2 安全操作边界

在经过一段时间后,这种适应性行为使人们跨越安全工作法规的边界和朝着功能上可以接受行为的边界进行系统迁移。如果失去控制边界权,这可能会导致意外。Rasmussen声称,这些适应环境压力的不协调企图发展缓慢而稳步地“为事故做准备”。切尔诺贝利核电站事故表明,几个事故不是由巧合的独立故障和人为失误引起的,而是由于组织在侵略性竞争环境中承受着成本效益压力,迫使组织行为向着事故进行系统性迁移[9]。

因此,为提高社会技术系统安全性,必须定义安全操作界限,使得参与者能看到边界,从而有机会控制行为的波动范围。

(四)STAMP方法

1.事故的系统理论模型

事故的系统理论模型(System-theoretic model of accidents,STAMP)假设,系统理论是分析事故的有效途径,特别是系统性事故[6]。当控制系统不能充分处理外部干扰、组件故障或系统组件之间的紊乱相互作用时,事故就发生了。安全被认为是一个控制问题,并由嵌入在自适应社会技术系统的控制结构来实施管理或约束。如果要理解为何会发生事故,就要确定为什么控制结构是无效的。为防止未来发生意外,就需要设计一个执行必要约束的控制结构。系统被视为相互关联的组件,是由信息和控制的反馈回路来保证系统处在动态的平衡状态。于是,STAMP使用反馈控制系统作为特定因果模型:(1)在有目的系统中,各子系统维持着防止事故发生的约束;(2)如果发生了意外,这些约束就已无效了;(3)STAMP通过调查所涉及的系统,特别是人力组织子系统,找出缺失或不适当功能(那些未能维持约束的功能);(4)通过分析反馈和控制操作,STAMP保持工作状态。

STAMP所关注的最基本对象不是事件,而是强制制约。因此,风险和事故被视为是由违反系统安全约束的组件之间的相互作用所致的结果。强制执行这些约束的控制流程必须将系统行为变化限制在安全范围内和适应所施加约束的调整。控制不力可能源自缺少安全约束,不适当的通讯约束,或者源自强制约束处在较低水平,或无法达到约束要求。

三、形式化方法和事故分析

(一)事故分析的逻辑形式体系

许多事故调查报告的结构、内容、质量和有效性一直受到质疑。他们不能准确地反映事件,或无法确定因果关系的关键因素,有时结论含有不正确事故原因。报告中的遗漏、含糊或不准确信息可能导致不安全系统设计和误导立法[11]。因此,迫切需要提高传统事故调查报告中信息准确性。

通过强调定义和精确描述的重要性,并提供描述和推理事故的某些符号,形式化方法可以改善事故分析效果。形式化方法是以数学为基础的技术,提供了严格和系统的框架,以规范、设计和验证计算机系统(包括软件和硬件)。形式化方法本质上是由三个主要部分所构成的正式规范语言:确认句子语法结构良好的规则(语法);在所考虑范畴内,以精确、有意义的方式解释句子的规则(语义);并从规范推断出有用信息的规则(证明)[12]。形式化分析方法提供了这样一种手段:证明规范可实现,证明系统已正确执行,证明系统的性能,而不必通过系统运行来确定其行为。在工业和研究领域中,使用形式化方法需要大量综合经验[13]。具体应用形式化方法的实例,可以参见有关文献[14~16]。

形式化方法已成功地应用于设计和验证关键安全系统。但是,为进一步洞察事件和事故报告中的诸多方面,该方法仍需要扩展。单一的建模语言不太可能模拟事故中的所有因素及各个方面。同样,扩大形式化方法在模拟完整的社会技术系统时也有局限性,这需要更多的数学专家参与解决,但不是任何因素或过程都可以形式化的。

1.内陆开放高地建设为重庆市现代农业探索国际化路径提供条件。在“一带一路”倡议下,长江黄金水道、中欧班列、“南向通道”、江北国际机场等国际大通道建设初见成效,两江新区、中新互联互通项目和自贸试验区等国家级开放平台初步成型,为现代农业探索国际化新路径提供必要条件。

(二)因果关系概率模型

到目前为止,所讨论的事故建模方法是基于因果关系的确定性模型。这些模型聚焦于确定性因果关系序列的识别,但是其结果是难以验证的[17]。例如,它不能保证一组效果将会产生,尽管在某个特定时刻存在所谓的充分必要条件。而因果关系概率模型则重点关注在给定情景中让效果更可能出现的条件,以支持事故分析。概率因果关系是指一组哲学理论,其目的是利用概率理论工具来表征因果效应之间的关系[17]。理论背后的核心思想是,原因提高了其影响的概率。若要了解因果关系概率模型的应用,可阅读相关文献[18~20]。

四、社会学和组织分析方法

重大事故的调查都强调,在寻求复杂系统的事故原因时,必须考虑技术和组织系统之间的交互与依存关系。Shrivastava认为,工业事故能确认其原因,即人力、组织和技术[21]。这些事故后果呼吁设计新的政策,以防止未来发生此类危机。

一些关于航空和海运意外事故的研究表明,人因和组织是事故和事故征候的主要致因因素。Johnson和Holloway分析了北美在1996~2006年的主要航空和海上事故并得出结论,组织因素的比例超过了人为错误的比例[22]。例如,美国航空事故中的因果关系表明:48%的组织因素,37%的人为原因,12%的设备原因,3%其他原因;海上事故的分析归类显示:53%的组织因素,24~29%的人为差错,10~19%为设备故障,2~4%为其他原因。

从文化和组织的角度,Hopkins研究了英国皇家委员会关于朗福德埃索气厂爆炸的事故报告。认为,事故主要成因都与一系列的组织失败有关:警示标志问题、通信问题、不重视重大危险源、敷衍了事的审核,以及没能从以前故障中汲取教训[23]。

Sagan从关于核武器组织研究中发现,政治影响组织,许多利益冲突起因于指挥和控制、以及军事和文职领导人之间矛盾。权力和政治必须受到重视,不仅在寻找组织事故的原因过程中,而且在组织设计和变革的艰难过程中,以提高组织的安全性和可靠性[24]。

2011年3月11日,日本福岛第一核电站爆炸。福岛核事故独立调查委员会经过6个月的调查,向参众两院提交了事故正式调查报告,认为“事故并非自然灾害,明显是人祸”。报告认为,福岛第一核电站事故是由于政府、监管机构和东京电力公司的一些串通行为以及缺乏明确指导所造成的。

五、讨论和结论

系统建模方法将事故视为一种突发现象,起因于诸多系统组件之间的复杂非线性相互作用。这些互动和事件很难理解,仅通过安全工程的标准技术来分析是不够的,它们不能充分洞察无故障运行的诸多组件之间的不正常交互。

Rasmussen的框架应用于埃索气厂爆炸等事故的分析。这些案例研究表明,Rasmussen的框架在解释事故原因后验方面的有效性。此外,要进一步地研究这个框架并扩展至事故的预测,并探讨将其应用于关键社会技术系统中的风险和安全性分析。

同样,STAMP应用到诸多事后事故分析的案例研究[26]。现在,应从方法上发展STAMP模型,包括开发适应于有缺陷的分类控制模型和解释指南。STAMP模型在系统设计早期阶段的主动事故调查方面进行了拓展。Leveson和Dulac讨论使用STAMP模型进行危害分析,安全(风险)评估,并作为综合风险管理体系的基础[27]。

组织社会学家在理解复杂社会技术系统中的事故方面做出了显著贡献。他们强调事故的组织方面,而往往忽视了技术问题。针对社会技术系统,系统的理论方法提供了安全分析框架,适用于包括技术、人力、社会和组织因素及系统组件之间交互的建模。社会技术系统必须视为一个整体,强调并行和系统地考虑社会和技术层面,包括社会结构和文化、社会互动过程[28]。

在新的系统性事故模型进展方面,基于认知系统工程的FRAM模型应进行深入的研究,并应用于复杂的社会技术系统的建模,以理解人类和系统性能的可变性,以及变化如何与事故的因果关系相关。

虽然形式化方法成功地应用于关键安全系统的设计和验证,但是他们需要扩展以洞察许多因素,包括事故中人的行为和组织因素。所开发的语言和语义仍需进一步地研究,以适应针对现代复杂系统事故各个方面的建模,如组织、文化、社会属性和人的表现。

未来的研究需要综合地分析新系统模型在广泛社会技术系统类型中的适用性,特别是在安全关键领域,如交通、核电、海洋、国防和航空航天。进一步的研究应关注新的系统性事故模型在各种复杂社会技术领域的比较和对比。

复杂系统具有动态特性,为应对环境波动而不断调整自己的行为。系统的这种适应性无法在系统设计期间编入预定程序[29]。系统可能会在安全法规的边界处变得不稳定或失去控制。因此,应变能力是组织保持控制的能力,以阻止区域内发生事故。韧性工程是阻止这种情况发生的有效方法、原则和工具。系统性事故模型支持对韧性工程的分析。STAMP已应用到面临高风险和高性能要求的组织韧性分析[29]。

现代社会技术系统的复杂性,对新的安全分析及模型提出了跨学科研究挑战,因此,迫切需要研究人员走出自己的传统边界,在更广泛的系统观点下洞察现代社会技术系统的复杂性,以便从安全的多个维度进行理解和构建系统事故模型。

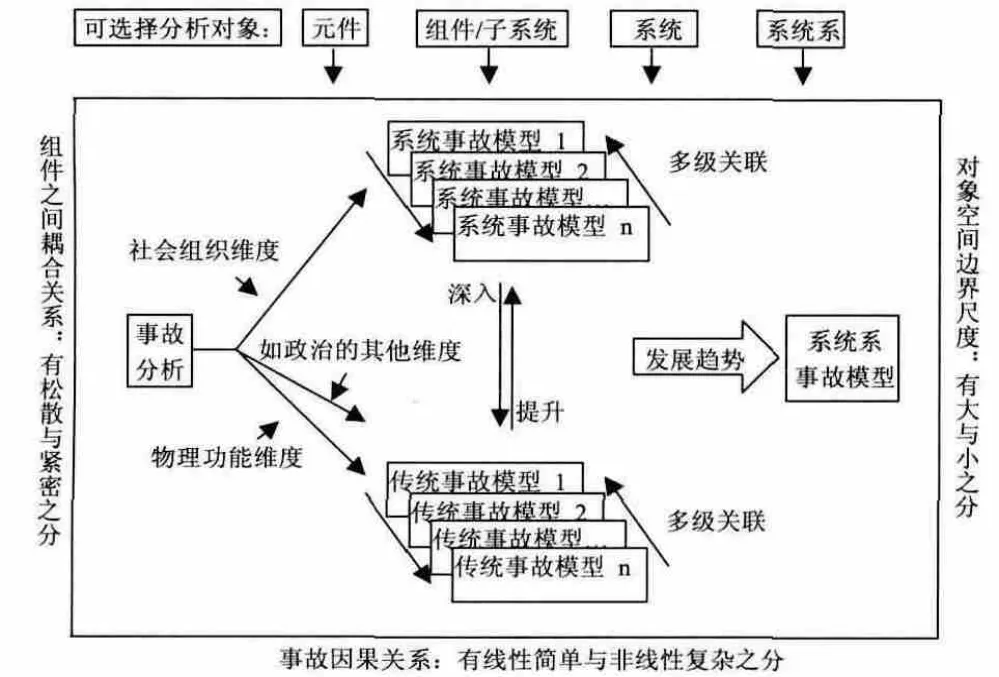

基于上述分析,本文提出综合视角下的事故分析框架,如图3所示。

图3 基于复杂社会技术系统的事故分析框架

(1)在具体分析时,可以选择元件、组件、系统或系统系作为分析对象,并界定对象边界;(2)从选择维度上,选择物理功能维度,或选择社会组织维度,或政治等其他维度,或多种维度的组合。一般地,关于简单事故的分析,选择基于物理功能维度的传统事故模型,还可进一步地关联多个事故模型进行分析。关于复杂事故的分析,可基于社会组织维度选择系统事故模型。(3)从组件之间耦合关系上,有松散和紧密耦合之分。(4)从事故因果关系上,有线性简单与非线性复杂之分。(5)从模型拓展及趋势来看,传统事故模型需要拓展或提升,以适应在复杂社会技术系统中的事故分析的需要。同样,系统事故模型要避免忽视技术因素的不足,通过深化分析内容,兼顾更多的技术分析因素。

随着复杂社会技术系统的发展,系统系的概念或模式为分析不确定性事件提供了更广阔视角。系统系旨在通过控制约束或组件之间的协调来实现未来特定目标。系统系事故模型关注未来情景下正常运行组件之间交互所导致的不确定性分析,突出以尽可能预测未知的方式分析不确定性,也是事故分析的一种新挑战。

[1]郭文晶,刘祖德,蒋畅和.事故致因理论和研究方法分析研究[J].现代商贸工业,2012,23:207-208.

[2]陈宝智,吴敏.事故致因理论与安全理念[J].中国安全生产科学技术,2008,01:42-46.

[3]TRIST E L,BAMFORTH K W.Some Social and Psychological Consequences of the Long wall Method of Coal-Getting[J].Human Relations,1951,4:3-39.

[4]罗建原,罗帆.西方系统系理论初探[J].当代经济管理,2014,04:6-9.

[5]HOLLNAGEL E.Barriers and Accident Prevention[M].Hampshire:Ashgate,2004.

[6]LEVESON N.A New Accident Model for Engineering Safer Systems[J].Safety Science,2004,42(4):237-270.

[7]WOODS D D,JOHANNESEN L J,COOK R I,SARTER N B.Behind Human Error:Cognitive Systems,Computers and Hindsight[C].SOAR Report 94-01,Wright-Patterson Air Force Base,Ohio,CSERIAC,1994.

[8]HOLLNAGEL E,WOODS D D.Joint Cognitive Systems:Foundations of Cognitive Systems Engineering[M].New York:Taylor &Francis,2005.

[9]RASMUSSEN J.Risk Management in a Dynamic Society:A Modeling Problem Safety [J].Science,1997,27(2/3):183-213.

[10]VICENTE K J,MUMAW R J,ROTH E M.Operator monitoring in a complex dynamic work environment:A qualitative cognitive model based on field observations [J].Theoretical Issues in Ergonomics Science,2004,5(5):359-384.

[11]LEVESON N G.Software:System Safety and Computers[M].Reading,MA:Addison-Wesley,1995.

[12]LAMSWEERDE A V.Formal Specification:A Roadmap.Proceedings of the Conference on The Future of Software Engineering [M].Limerick,Ireland:ACM Press,2000:147-159.

[13]HINCHEY M G,BOWEN,J P.Applications of Formal Methods[C].International Series in Computer Science,Herts,UK:Prentice Hall,1995.

[14]吴建安,吴雪莲,孙丙宇.自然灾害应急预案形式化表示技术[J].计算机系统应用,2012,09:133-136+26.

[15]崔琳琳,柴跃廷.企业群体协同机制的形式化建模及存在性研究[J].清华大学学报(自然科学版),2008,04:486-489.

[16]闫仕宇,胡义香,蒋辉,申君.形式化方法在核事故评价系统中的应用[J].南华大学学报(自然科学版),2012,03:73-78.

[17]JOHNSON C W.Failure in Safety-Critical Systems:A Handbook of Accident and Incident Reporting.Glasgow [M].Scotland:University of Glasgow Press,2003.

[18]陆宁云,何克磊,姜斌,吕建华.一种基于贝叶斯网络的故障预测方法[J].东南大学学报(自然科学版),2012,S1:87-91.

[19]赵金宝,邓卫,王建.基于贝叶斯网络的城市道路交通事故分析[J].东南大学学报(自然科学版),2011,06:1300-1306.

[20]李东宁,尚云龙,郑中义.浅议贝叶斯网络应用于海上交通事故致因分析的可行性[J].交通建设与管理,2009,05:140-144.

[21]SHRIVASTAVA P B.Anatomy of a Crisis [M].Second Edition,London:Paul Chapman,1992.

[22]JOHNSON C W,HOLLOWAY C M.A Longitudinal Analysis of the Causal Factors in Major Maritime Accidents in the USA and Canada (1996-2006)[C].Bristol,UK:Proceedings of the 15th Safety-Critical Systems Symposium,2007.

[23]HOPKINS A Lessons from Langford:The Esso Gas Plant Explosion[C].Sydney:CCH,2000.

[24]SAGAN S.Limits of Safety.Organizations,Accidents,and Nuclear Weapons[M].Princeton,NJ:Princeton University Press,1993.

[25]伍浩松,王海丹.福岛核事故独立调查委员会公布调查报告 福岛核事故被认定“明显是人祸”[J].国防科技工业,2012,10:77.

[26]JOHNSON C,Holloway C M.The ESA/NASA SOHO Mission Interruption:Using the STAMP Accident Analysis Technique for a Software Related‘Mishap’[J].Software:Practice and Experience,2003b,33:1177-1198.

[27]LEVESON N G,DULAC N.Safety and Risk Driven Design in Complex Systems-of-Systems[C].Orlando:1st NASA/AIAA Space Exploration Conference,2005.

[28]MARAIS K,DULAC N,LEVESON N.Beyond Normal Accidents and High Reliability Organizations:The Need for an Alternative Approach to Safety in Complex Systems[C].Cambridge,MA:ESD Symposium,Massachusetts Institute of Technology,2004.

[29]HOLLNAGEL E,WOODS D D,LEVESON N.Resilience Engineering:Concepts and Precepts[M].Alders hot:Ash gate,2006.