多目立体视觉三维重建系统的设计

2013-10-22章秀华白浩玉

章秀华,白浩玉,李 毅

(武汉工程大学图像处理与智能控制研究室 湖北 武汉 430205)

0 引 言

随着现代工业生产制造加工工艺的不断进步,产品加工过程的智能化和自动化程度进一步提高.自动化生产线上的产品加工时,待加工完成进入下一个工序,都需要对产品进行基于视觉图像的检测.目前在一些工业生产领域,基于图像二维视觉检测技术已初步应用在生产线上产品的视觉检测和自动监控过程中,但二维视觉检测只能对产品的相对位置、形态、产品标记等二维投影特征进行判别和检测,是有限的局部的单视点投影视觉检测,无法对产品的三维特征和表面参数进行高精度的测量和三维形态识别,因此二维视觉检测技术还远远不能满足现代工业生产发展过程中数字制造与智能制造和检测的需要[1].研究基于三维重建的非接触测量技术是产品数值化制造及自动化加工过程的迫切需要.基于计算机视觉的三维重建技术[2],是指由两幅或多幅二维图像来恢复出空间物体的几何信息.于是基于双目立体视觉的三维重建系统的研究得以发展,但是双目仅是用两个相机从不同角度进行采图,在成像过程中,一些有用的三维信息由于投影而丢失了,使重建结果不够完整.

针对上述问题,笔者设计了一套基于多目的立体视觉三维重建系统,以八个相机为例从不同的角度采图,采用Harris角点及高斯差分检测算法实现特征点提取和立体匹配,结合泊松表面重建方法对物体进行三维重建.研究结果表明,本文方法有着较好的稳定性和准确性.

1 三维表面重建原理

1.1 图像获取

三维重建的基础是平面图像的获取,通过获取图像来得到图像的基本数据,如深度、物体相对位置等.获取图像的途径有很多,主要根据实验的场合和目的、光照条件、相机性能等因素来进行选择.

1.2 图像预处理

计算机视觉方法很少考虑基于成像物理过程的预处理,一般假定成像条件是理想的[3].然而采集的原始图像中通常含有多余的图像信号,所以对图像进行预处理是必要的.通过预处理,使得图像数据的信噪比得以提高、背景得到抑制,后续处理的压力也将减小.根据处理图像像素的方法,图像预处理可以分为以下几种形式:点运算、邻域运算、并行运算、串行运算和迭代运算等.图像预处理的主要过程是:灰度化及平滑化.

1.3 相机标定

通过相机的图像坐标系与空间物体的三维坐标系之间的关系,得到相机的参数的过程就是相机标定.根据标定过程是否需要控制场将相机标定分为传统标定方法和自标定方法[4].传统标定方法成本低,稳定性好,精度较高,但在某些情况下难以实现,如高危地区监测等,而自标定方法虽然解决了这个问题,但是存在着计算量大、稳定性差的缺点.

1.4 特征提取与立体匹配

通过选择合适的图像特征并进行匹配,来确定场景中同一物点在不同图像中的对应关系,从而实现多视点视差确定信息.特征点主要是指图像中特征较为明显的点,如角点、圆点等.通过运用不同算法从图像中提取感兴趣的或有利于某种目的的点.常用的特征点提取算法有三类,即基于轮廓的算法、基于亮度的算法和基于参数模型的算法[5].

在提取特征点之后,进行特征匹配,将不同图像中的同一个空间点对应起来,建立多幅图像之间特征的对应关系.通常情况下,一幅图像中的某个特征点在另一幅图像中可能会有许多的匹配对象,另外场景中还存在诸如光照条件、景物形状、干扰噪声和畸变等不利因素,也会引起歧义匹配[6].因此,准确地对图像进行无歧义匹配是十分重要的.

1.5 三维重建

物体在空间上是以三维形式存在的,而多视点图像采集系统获取的图像都是二维的,这就需要运用三维重建技术从多视点二维图像中恢复出空间物体的几何信息.根据空间一点在多幅图像中的对应坐标,结合相机参数矩阵,就可以对空间点进行重建.当确定物体表面的所有点三维坐标时,该物体的三维形状和位置也就唯一确定了.因此,三维重建的基础是空间点的重建.

2 系统设计与实现

2.1 图像采集模块

基于实验的需要,采用加拿大Point Grey公司提供的FL2-20S4C-C工业相机,Sony公司电荷耦合元件(Charge-coupled Device,以下简称CCD)和IEEE1394b接口标准,将八个相机按直线排列,从八个不同角度采集图像.采用IEEE1394b接口标准,使得数据速率高速,避免了其他标准数据传输速率低.图像采集系统由Flea系列1/1.8英寸 Sony CCD IEEE1394b相机、FWB-PCIE-02图像采集卡和计算机组成,将CCD传来的模拟图像信号,通过图像采集卡转换为数字图像信号并传送给计算机处理.

2.2 图像的预处理

要把目标物体从图像场景中提取出来,需要将复杂背景除掉.首先采用多级滤波对背景进行逐级抑制,把不相关的背景图像内容剔除掉,同时将一些背景区域进行合并.然后,再根据图像特征建立合适的加权值计算模型以及找到合适的最优化算法来得到能量函数的最小值.最后在完成最小化后,即得到了图像的最优化分割.

2.3 相机标定模块

实验采用张正友标定方法,用模板标定板取代了三维标定物.张正友标定算法[7]的基本原理可用式(1)表示.

式(1)中:假定在世界坐标系中,模板平面在Z=0上,K为相机的内部参数,=[X Y1]T为模板上点的齐次坐标,=[u v 1]T为模板上点投影到图像平面上对应点的齐次坐标,[r1,r2,r3]和t分别是相机坐标系对应于世界坐标系的旋转矩阵和平移向量.具体实现步骤如下[8]:

①打印一张10×10棋盘方格图(模板)贴在一个平板上;

②从八个不同角度对模板平面进行拍摄;

③检测出八幅图像中的特征点;

④计算出相机的内外参数.

2.4 特征提取与立体匹配

采用两种特征检测滤波类型,即Harris角点检测及高斯差分检测对各视点的图像进行特征提取.Harris算子[9]是一种基于信号的点特征提取算子,通过计算所在位置的梯度来检测角点.当像素所在位置沿任意方向的曲率都比较大时,则判定该像素点为角点.

Harris算子只涉及图像的一阶导数,其具体步骤如下[10]:

①计算各像元的兴趣值IV:

其中gx为x方向的梯度,gy为y方向的梯度,G()为高斯模版,Det M 和tr M 分别表示矩阵M的行列式和迹,k为默认常数;

②选取局部极值点:根据计算完的兴趣值,提取原始图像中所有局部兴趣值最大的点;

③根据需要提取一定数目的特征点.

再利用高斯差分[11]确定最终特征点,具体算法如下:

①利用高斯卷积构建金字塔结构的尺度空间;

②对金字塔中间各层图像求Harris角点;

③对所提取的Harris角点与其上下层图像对应的像素点计算高斯差分,高斯差分取得极值并大于阈值的Harris角点被选为特征点[12].

两两取图像对的特征点(f,f′),运用三角形法则重建出空间点的三维坐标.经过该空间点作指向相机光心的射线,从而得出物体表面的小长方形块及其经过该表面中心点的单位法向量.

2.5 三维重建

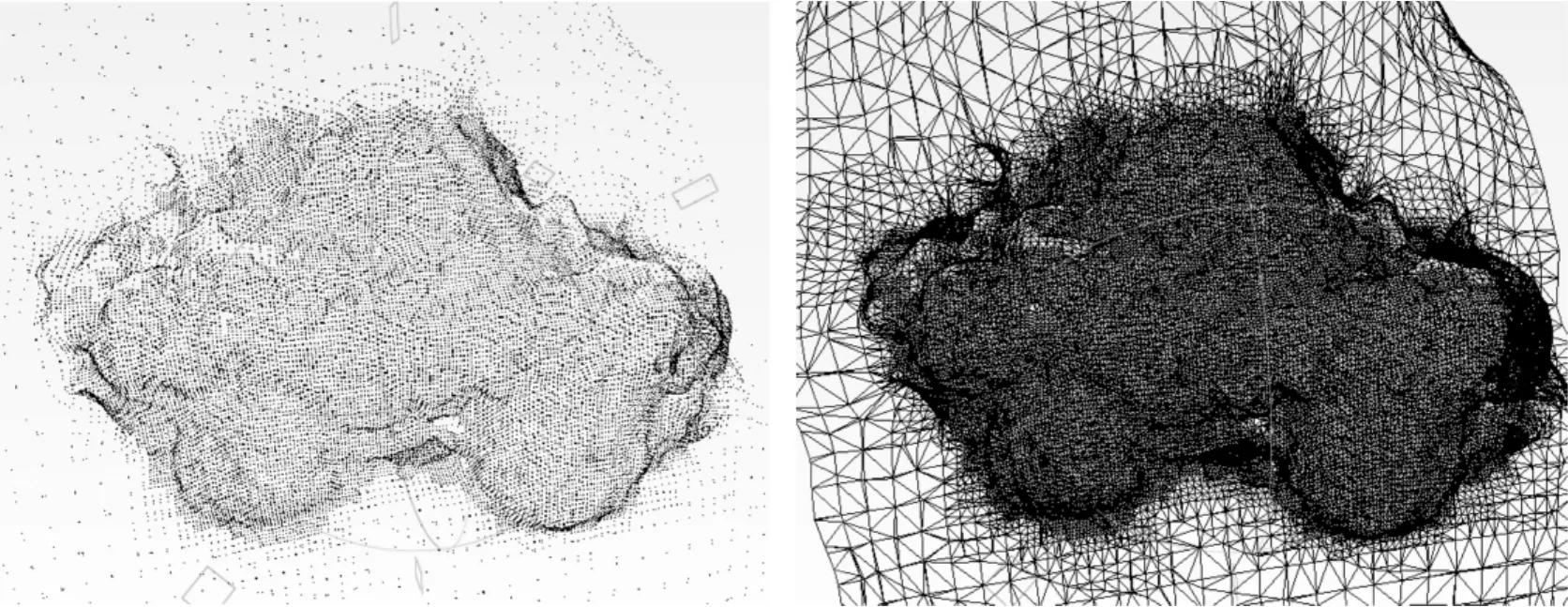

在特征点的匹配和相机标定的基础上进行三维重建,利用泊松表面重建方法[13],可以较准确地获取和优化角点,并找到角点特征的匹配点,从而能够获得被重建物体的精确表面.

泊松表面重建的步骤如下:(a)将模型表面采样的有向样点转换为模型指示函数梯度的样点;(b)使用隐函数框架的方法进行表面重建,计算指示函数;(c)通过指示函数提取对应的等值面,从而获得重建表面;(d)采用八叉树法,将细节点所在面的等值线段投影到粗节点所在面上,从而避免产生裂纹.

3 实验结果与分析

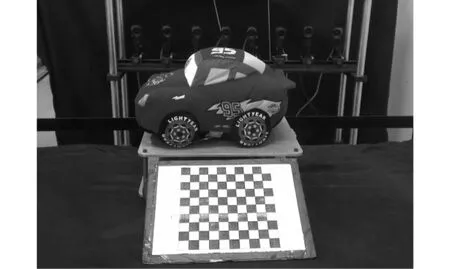

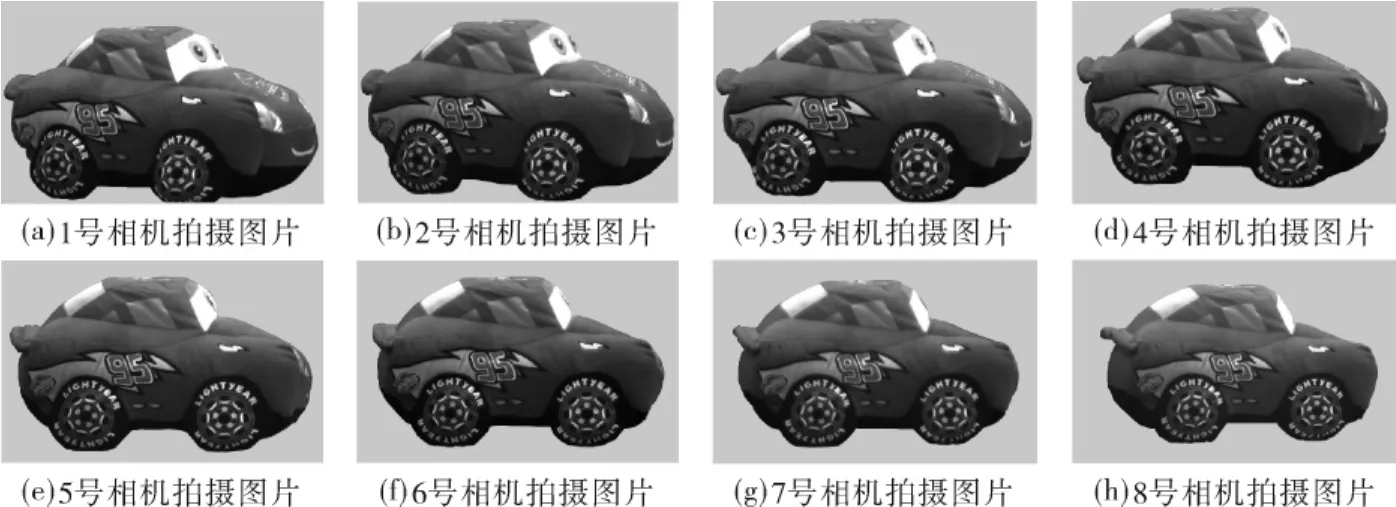

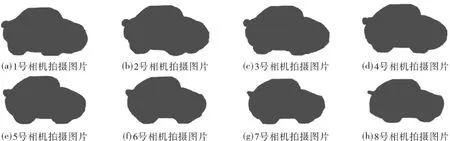

本文所采用的方法在计算机(3.09GHz,3.16GB)通过编程实现,对毛绒汽车抱枕从八个不同角度进行拍摄.图1是本实验平台,包括可在计算机控制下获取图像的CCD相机、水平平台、移动机器人、标定板;图2和图3是经过预处理所得到的图片;图4是特征点提取与匹配示意图;图5是三维表面重建结果,其中汽车车身(红色),汽车车窗(白色),车身上数字(95),汽车轮毂(咖啡色)都很好的重建出来.

图1 用于重建的实验平台Fig.1 Experimental platform for reconstruction

图2 图像背景抑制Fig.2 Suppression of image back ground

图3 目标物体分割Fig.3 Target object segmentation

图4 特征点提取与匹配示意图Fig.4 Feature points extraction and matching schematic diagram

图5 基于多视点图像的重建结果(三维图像数据)Fig.5 Result of multi-view images reconstruction (3Dimage data)

由图5可知,在上述系统的基础上进行实验,结果显示该系统能对目标物体进行较好的三维重建.但由于采用基于特征点的重建方法,因此对特征点的依赖较明显,如果某个区域表面获取信息较少,反光比较明显或者与背景颜色比较接近,则提出的特征点很少或者提不出有效的特征点.

4 结 语

本文讨论了基于多目立体视觉的三维重建方法,将Harris角点及高斯差分检测算法运用到特征点提取和立体匹配中,结合泊松表面重建方法设计了一套稳定可靠的系统,以八个镜头为例,通过多视点图像恢复出物体的三维表面,为后续改进和完善系统做好准备.本系统可以用于对工业领域生产线上产品的三维表面重建,能够对产品表面特征质量参数进行自动化检测,从而提高产品的生产效率.

[1]洪汉玉.现代图像图形处理与分析[M].武汉:中国地质大学出版社,2011.

[2]王新字.基于计算机立体视觉的三维重建[D].长沙:中南大学,2004.

[3]张天序.成像自动目标识别[M].武汉:湖北科学技术出版社,2005.

[4]邱茂林,马颂德,李毅.计算机视觉中摄像机定标综述[J].自动化学报,2000,26(1):43-55.

[5]苏小红,李东,唐好选,等.计算机图形学实用教程[M].北京:人民邮电出版社,2010.

[6]于勇,张晖,林茂松.基于双目立体视觉三位重建系统的研究与设计[J].计算机技术与发展,2009,19(6):127-130.

[7]Zhang Z Y.A Flexible New Technique for Camera Calibration[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2000,22(11):1330-1334.

[8]Zhang Z Y.Flexible Camera Calibration By Viewing a Plane From Unknown Orientations [C]// Proceedings of the 7th IEEE International Conference on Computer Vision,20-27September,1999,Kerkyra,Greece.[S.l.]:IEEE Computer Society,1999,1:666-673.

[9]Harris C,Stephens M.A Combined Comer and Edge Detector[C]//Proceedings of the 4th Alvey Vision Conference,University of Manchester,31August-2 September,1988Manchester:[s.n.],1988:147-151.

[10]张永军.基于序列图像的视觉检测理论与方法[M].武汉:武汉大学出版社,2008.

[11]Lowe D G.Distinctive image features from scale invariant key-points[J].International Journal of Computer Vision,2004,60(2):91-110.

[12]高健,黄心汉,彭刚,等.基于Harris角点和高斯差分的特征点提取算法[J].模式识别与人工智能,2008,21(2):171-176.

[13]Kazhdan M,Bolitho M,Hoppe H.Poisson Surface Reconstruction[C]// Dieter Fellner,Spencer S.Proceedings of the Fourth Eurographics Symposium on Geometry Processing,June 26-28,2006,Cagliari,Sardinia,Italy.Ariela-Ville,Switzerland:the Eurographics Association,2006,61-70.