基于智能相机的混合交通流检测方法

2013-08-16李志慧赵永华曲昭伟柴婷婷

魏 巍,李志慧,赵永华,曲昭伟,江 晟,柴婷婷

(1.吉林大学 交通学院,长春 130022;2.吉林大学 计算机公共教学中心,长春 130022)

0 引 言

目前,交通视频监控通常利用道路两侧的摄像头获取道路图像信息,传输到交通监控中心集中分析处理,形成了巨大的通信量,增加了多路图像信息集中并发处理的困难。混合交通是我国交通的重要组成部分,但目前尚缺乏混合交通流参数检测的方法和设备。为了降低交通监控过程巨大通讯量和满足高效便捷的混合交通流参数检测的需要,研发面向混合交通流检测的智能相机分布式设备,实现单点摄像机图像信息处理,直接应用于交通信号控制的设备或交通监控中心尤为重要。

嵌入式设备具有高效、便捷、低能耗等优点,近年来国内外研究人员开展了将嵌入式技术应用在交通监控领域的研究。如:Bramberger等[1-2]采用LM-9618CMOS传感器与双TMS320DM642DSP芯片等构建智能相机硬件框架体系与原型,利用高斯背景差分和前景阈值分割检测车辆;Arth[3]等利用三个TMS320C6414DSP芯片与外置摄像头构建智能相机框架体系与原型,通过中值背景估计、前景差分分割、摄像机参数映射、Viola-Jones检测、CAMShift预处理和Kalman跟踪等算法检测与跟踪运动车辆;Wei等[4]利用图像捕获单元、FPGA视频分析处理单元、图像显示单元构建智能相机框架体系与原型检测车辆信息,其中FPGA视频分析处理单元由Harris交点检测、局部二进制模式分类与分析等构成;Houben[5]等利用CMOS传感器、FPGA和嵌入式工业PC构建智能相机原型,采用Harris交点和边缘信息进行3D重构、聚类和跟踪检测运动车辆;Macesic[6]等利用OMAP平台,通过Kalman滤波器跟踪车辆,获取物体的轨迹,检测异常轨迹,实现交通事件预警。上述相关研究促进了嵌入式智能相机技术在交通监控领域的发展,但这些研究仍局限于交通车辆单一交通流形态的检测,缺乏混合交通流检测的研究,无法满足我国混合交通的应用需要。

针对目前缺乏混合交通视频检测智能设备的问题,本文利用CCD传感器与DSP芯片构建了智能相机框架体系和硬件原型系统,采用背景初始化、背景模型与前景获取、物体分割、特征提取、多目标识别分类、摄像机参数标定等视频图像处理技术,构建了混合交通流检测软件方法体系,开发了相应的嵌入式算法系统,实现了混合交通流参数检测。

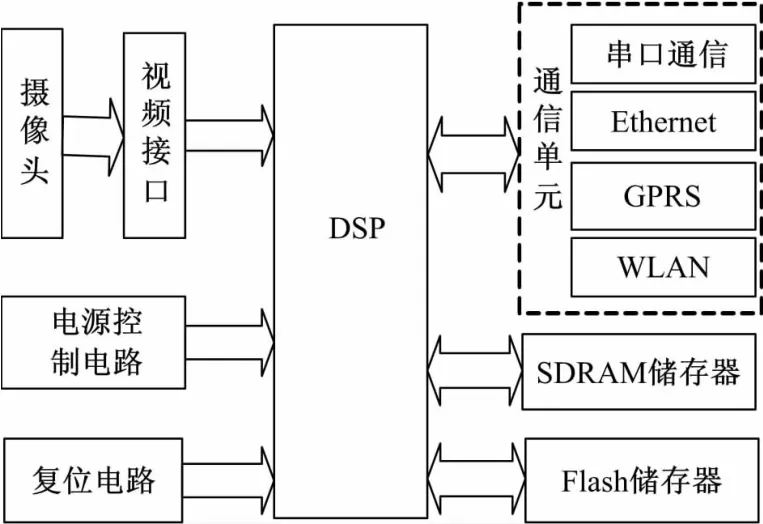

1 智能相机硬件架构

为降低道路监控摄像头向监控中心传输的数据量,实现图像采集后直接分析处理,处理数据传输至监控中心或交通信号控制机等。本文构建了图1所示的混合交通流智能相机硬件体系结构。图2为智能相机硬件原型系统。

图1 混合交通视频检测智能相机硬件体系结构框图Fig.1 Block diagram of the hardware architecture

图2 混合交通视频检测智能相机硬件系统原型Fig.2 Prototype of the embedded DSP vision platform

2 混合交通流检测软件框架体系

混合交通流智能检测设备软件系统的体系结构框图,如图3所示。

2.1 背景模型

通常利用背景差分获取视频场景中的运动前景,即实现行人、自行车、机动车检测,如式(1)所示:

式中:Ft为当前时刻前景;It为当前视频帧;Bt-1为前一时刻背景。

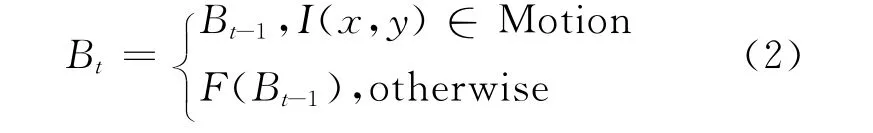

背景模型作为前景物体检测的关键,受外界光照、环境等变化影响明显。为有效获取混合交通背景,本文采用了基于对象选择更新的混合高斯背景模型[7],如式(2)所示:

图3 混合交通视频智能检测设备检测算法框图Fig.3 Software Framework of Smart Device on Mixed Traffic Detection

其中F(Bt-1)为混合高斯背景模型更新过程,参见文献[8]。该模型对存在感兴趣运动物体的区域不更新,否则参照混合高斯背景模型选择性更新。由式(2)可以看出,背景模型需要初始背景作为其零启动,为获取零启动背景,本文采用基于聚类识别的背景初始化方法[9]获取初始背景,该方法可满足场景内包括运动前景物体或前景物体静止遮挡率大于50%的应用环境。

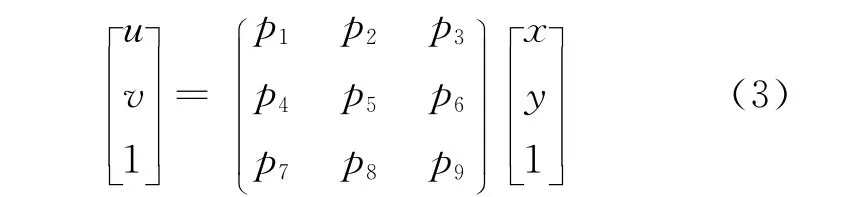

2.2 摄像机参数标定

摄像机参数实现了图像坐标与交通场景位置坐标的映射变换。为方便获取摄像机内外参数,本文采用了黑箱摄像机标定方法[10]计算映射关系。通常图像坐标与空间位置关系可表达为

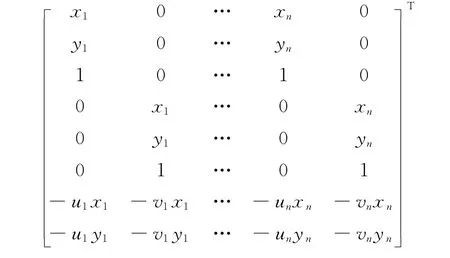

式中:p矩阵表示摄像机内外参数。根据已知图像坐标与空间位置坐标点对,利用最小二乘法估计求解映射变换p矩阵。为简化p矩阵求解,令p9=1,则需要n(n≥4)对 {(xi,yi) ,(ui,vi)}对应点对构成2n个线性方程求解p矩阵,该方程组表达为

根据式(4),可利用最少4对参照点计算求解映射变换p矩阵,获取空间坐标与图像坐标之间的映射关系。该方法与传统方法相比,仅需一幅模板图像,降低了特征点与模板个数,简化了计算,且具有稳定性强、计算精度高的特点。

2.3 前景物体识别分类

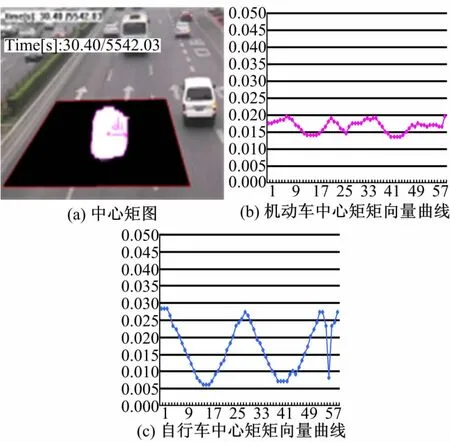

由于混合交通个体运动过程受形变、遮挡等影响,根据行人、机动车、自行车的几何轮廓特点,本文构建了交通个体中心距向量特征表达方法,该方法具有较好的旋转、伸缩、平移不变性。

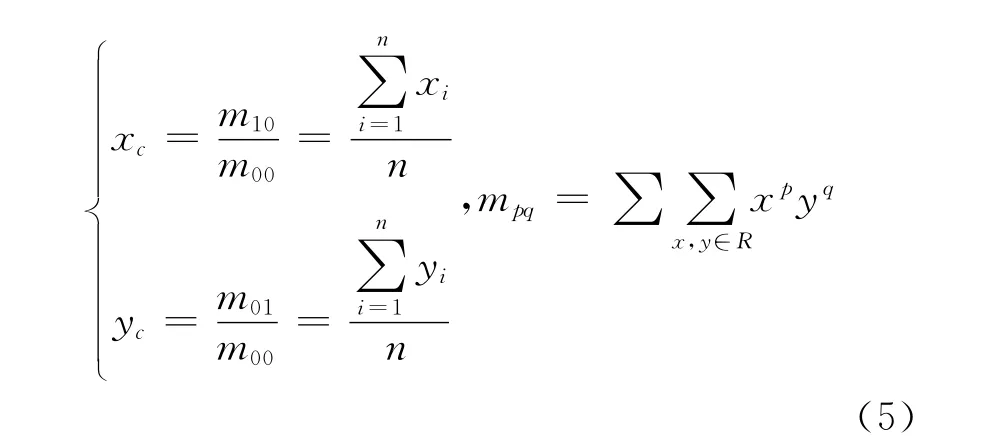

为构建交通物体旋转、伸缩、平移不变的特征,首先获取物体重心G(xc,yc),其表达式为

式中:mpq为区域的pq阶矩。

其次,选取区域边缘上距离重心最远点作为区域主方向,令重心作为极坐标中心,在[0,2π]范围内按照逆时针方向旋转,在每间隔θ角的方向上选取区域外边缘点,获取相应点与极坐标中心的距离,作为中心距li,则构成N维中心距向量l= [l1,l2,…,ln];最后,令中心距向量l除以中心距最大值l1,获取归一化的中心距向量l′=,实现混合交通个体特征提取与表达。

支持向量机(SVM)[11-13]作为基于统计学习的经验风险最小化原则的一种监督式机器学习,其分类模式中利用相应的分类核函数将输入向量映射到一个高维空间,然后根据最优化理论寻求分类器的范化误差最小,获取最优分类超平面,实现不同模式的分类识别。在训练学习阶段,本文选取行人、自行车、机动车与非交通个体样本图像训练学习,训练过程采用Ado boosting算法[14]对SVM的强、弱分类器分配不同权重系数加快样本空间学习,建立其分类超平面,实现混合交通物体的分类识别。

3 实验结果

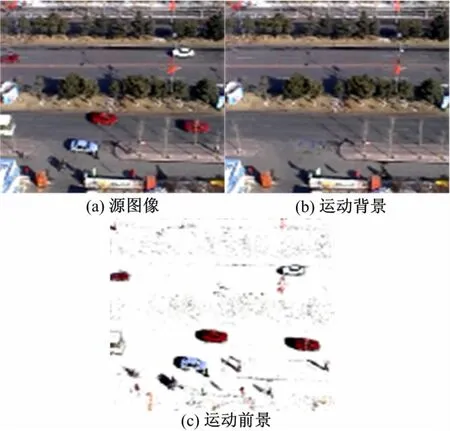

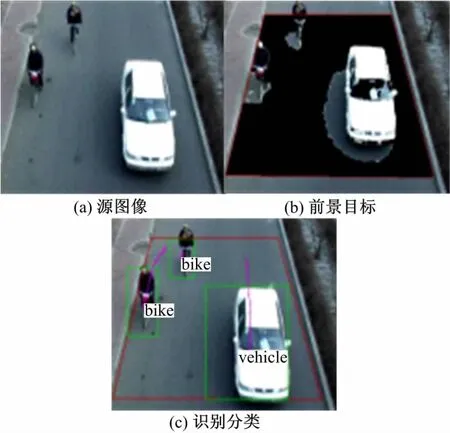

本文利用图2所示的智能相机原型系统采集交通视频图像,采用本文构建的软件算法对不同交通状况下的混合交通流进行检测实验,其中图4给出了运动背景与前景物体的检测结果。图5给出了不同混合交通物体的矩向量特征表示曲线形式,图6给出了混合交通物体分类识别结果。从给定的实验结果图像可以看出,本文算法可以较好地获取交通视频的运动背景、前景、混合物体特征表达与识别分类。同时,为了检验本文算法的检测性能,对不同交通状态下的1400个混合交通物体识别分类准确度进行了测试,本文算法的识别准确度大于95%,反映了本文构建的混合交通流智能检测相机具有较好的性能,可应用于混合交通流检测。

图4 长春市人民大街交通视频处理结果Fig.4 Processing Result at Renmiing street site in Changchun

图5 混合交通个体矩向量表达曲线图Fig.5 Moment Vector Represent Curves of Mixed traffic object

图6 混合交通个体识别分类结果Fig.6 Classification Results of Mixed Traffic Object

4 结 论

针对目前缺乏混合交通视频检测智能设备的问题,本文利用CCD传感器与DSP芯片构建了智能相机框架体系和硬件原型系统,采用背景初始化、背景模型与前景获取、物体分割、特征提取、多目标识别分类、摄像机参数标定等视频图像处理技术,构建了混合交通流检测软件方法体系,开发了相应的嵌入式算法系统,实现了混合交通流参数检测。不同交通状态下的测试结果反映了该系统具有良好的性能,可实现混合交通流参数检测。本方法可为混合交通流智能相机的研发提供借鉴和参考。

[1]Bramberger M,Brunner J,Rinner B,et al.Real-time video analysis on an embedded smart camera for traffic surveillance[C]∥In:Real-Time and Embedded Technology and Applications Symposium,2004Proceedings RTAS 200410th IEEE,2004:174-181.

[2]Bramberger M,Roman P Pflugfelder,Maier Arnold,et al.A smart camera for traffic surveillance[C]∥Proceedings of the First Workshop on Intelligent Solutions in Embedded Systems;2003;Vienna University of Technology,Austria;2003:153-164.

[3]Arth C,Bischof H,Leistner C.TRICam-an embedded platform for remote traffic surveillance[C]∥Computer Vision and Pattern Recognition Workshop,2006 CVPRW'06Conference on,2006:125.

[4]Wei Bei-na,Shi Yu,Ye Ge-tian ,et al.Developing a smart camera for road traffic surveillance[C]∥Multimedia Signal Processing,2008IEEE 10th Workshop on,2008:826-831.

[5]Houben Q,Czyz J,Diaz J C Tocino,et al.Featurebased stereo vision using smart cameras for traffic surveillance[C]∥Fritz M,Schiele B,Piater JH,eds.Computer Vision Systems,Proceedings;2009:144-153.

[6]Macesic M,Jelaca V,Nino-Castaneda J O.et al.Realtime detection of traffic events using smart cameras[C]∥In:Proceedings of SPIE-IS and T Electronic Imaging-Intelligent Robots and Computer Vision XXIX:Algorithms and Techniques,Burlingame,CA,United states,2012.

[7]李志慧,张长海,曲昭伟,等.交通流视频检测中背景模型与阴影检测算法[J].吉林大学学报:工学版,2006,36(6):993-997.Li Zhi-hui,Zhang Chang-hai,Qu Zhao-wei,et al.Background extraction model and shadow detection algorithm in traffic flow video detection[J].Journal of Jilin University(Engineering and Technology Edition),2006,36(6):993-997.

[8]Stauffer Chris,Grimson W E L.Adaptive background mixture models for real-time tracking[J].Proceedings of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition,1999,2(Compendex):246-252.

[9]李志慧,张长海,曲昭伟,等.交通流视频检测中背景初始化算法[J].吉林大学学报:工学版,2008,38(1):148-151.Li Zhi-hui,Zhang Chang-hai,Qu Zhao-wei,et al.Background initialization algorithm in traffic flow video detection[J].Journal of Jilin University(Engineering and Technology Edition),2008,38(1):148-151.

[10]曲昭伟,陈红艳,李志慧,等.基于单模板的二维场景重建方法[J].吉林大学学报:工学版,2007,37(5):1159-1163.Qu Zhao-wei,Chen Hong-yan,Li Zhi-hui,et al.2D view reconstruction method based on single calibration pattern[J].Journal of Jilin University(Engineering and Technology Edition),2007,37(5):1159-1163.

[11]Cortes Corinna,Vapnik Vladimir.Support-vector networks[J].Machine Learning,1995,20(3):273-297.

[12]Scholkopf B,Smola A J,Williamson R C,et al.New support vector algorithms[J].Neural Computation,2000,12(5):1207-1245.

[13]Scholkopf B,Platt J C,Shawe-Taylor J,et al.Estimating the support of a high-dimensional distribution[J].Neural Computation,2001,13(7):1443-1471.

[14]Rangel Pedro,Lozano Fernando,Garcia Elkin.Boosting of support vector machines with application to editing[C]∥ICMLA 2005:4th International Conference on Machine Learning and Applications,Los Angeles,CA,United States:Inst of Elec and Elec Eng Computer Society,2005:374-379.