基于视觉显著性和图分割的高分辨率遥感影像中人工目标区域提取

2013-07-25李苓苓刘庆杰樊文锋林月冠孙俊格

温 奇,李苓苓,刘庆杰,樊文锋,林月冠,孙俊格

1.中华人民共和国民政部 国家减灾中心,北京 100124;2.中华人民共和国民政部 减灾和应急工程重点实验室,北京 100124;3.北京航空航天大学 计算机学院,北京 100191;4.国家测绘地理信息局 卫星测绘应用中心,北京 101300;5.华东计算技术研究所,上海 200233

1 引 言

高空间分辨率遥感影像可以更加精确地分析地物覆盖类型、提取感兴趣目标。然而,空间分辨率的提高在带来便利的同时也带来了挑战。高分辨率遥感图像中场景复杂、目标类型多样,即便是同一类型的目标,也会呈现出多种形态,给目标的检测识别带来极大的困难。近年来,注意力选择机制被广泛的应用到模式识别领域中,并且在自然图像的目标识别方面已经收到了很好的效果,在遥感图像处理与解译中也受到广泛关注[1]。

自从文献[2]提出第一个可计算的视觉显著性区域检测方法以来,显著性检测方法得到了快速的发展[3-6],在很多图像处理领域得到了成功的应用,并很快被引入到遥感图像处理与解译中。文献[7]将显著性计算应用到船只检测与识别中。文献[1]将基于HSI颜色空间的视觉注意力模型应用到海上船只检测中,该模型可以较为有效地消除海浪杂波的干扰,提取到的显著性区域能够比较紧凑地包含目标。同样为减少海线上杂波的干扰,文献[8]利用局部和全局显著性融合的方法来计算显著性目标。文献[9]首先利用频域差值的方法[5]获得图像的全局显著图,然后再利用Gabor滤波器组得到图像的能量子图,最后融合以得到目标。文献[10]在高分辨率全色图像中应用基于视觉注意显著性计算模型,用以提取显著性目标。这些方法对干净背景的场景,如海面上的显著目标有较好的结果,但对复杂场景的不能得到理想的显著性图像,难以精确提取有用目标。为了克服这一缺点,文献[11-12]将显著性特征与概要特征相结合并利用支持向量机来检测图像中的目标。文献[13]通过引入局部能量通道来改进传统的显著性检测方法,得到了更好的显著性目标轮廓;同时该方法引入了最大熵准则自适应地分割图像,并以熵作为标准来选取最优目标检测结果。受文献[13]启发,本文提出了一种结合显著性分析与图分割的面向对象目标自动提取方法。该方法采用自底向上的视觉显著性模型分析图像的显著性,结合图分割的结果,自适应地选取其中显著性较高的分割块,可自动地获取图像中显著目标。

2 基于显著性和图分割的目标提取

2.1 基于GBVS和LDVS融合的显著性计算

遥感影像中包含房屋、道路、桥梁、舰船等人造目标的区域是人视觉注意停留最多的区域,也是显著性较强的区域。在灾害评估、城市监测、城区制图等应用中,这些区域也是需要检测、提取的感兴趣区域。然而,在复杂的地面场景中,由于“同物异谱”、“异物同谱”的影响,目标与背景的特征差异并不明显,而且遥感影像不存在景深,前景目标与背景区域相比并不“突出”。因此单纯的基于差异计算的显著性检测方法难以检测出精确的感兴趣区域。为了有效利用感兴趣区域的特点提取显著目标,本文提出了一种融合“基于图的视觉显著性(graph based visual saliency,GBVS)”[3]和“基于边线密度的视觉显著性(line density based visual saliency,LDVS)”[15]的显著性模型。综合利用遥感图像中各种特征以及目标具有丰富的边缘这一先验知识,可以有效地提取高分辨率遥感图像中的显著性目标。同时,采用面向对象的分析方法,利用Graph Cut图像分割算法获得影像中的“同质”对象块,利用Otsu自动阈值方法[14]自适应地提取具有较为精确轮廓的目标。本文的目标提取算法流程如图1所示。

2.1.1 GBVS显著性模型

GBVS方法是在Itti模型基础上引入了图论方法计算图像显著性的一种方法。与Itti模型不同,GBVS方法将图像的每一个像素(当需要提高计算效率时,可以用图块代替像素)看做图的一个节点。节点之间的边代表任意两个节点之间的差异性。这个差异性度量可以取决于颜色、纹理等特征。GBVS模型具有计算效率较高和比直接求差的方法能更好表示不同特征层区别的特点。

本文中,输入为多光谱图像和全色图像。多光谱图像包括红(R),绿(G),蓝(B)和红外波段(NIR)4个波段。在4个波段特征图像上建立高斯金字塔R(σ)、G(σ)、B(σ)、NIR(σ)计算特征差异图。图像的方向特征在全色图像上用Gabor滤波提取实现。

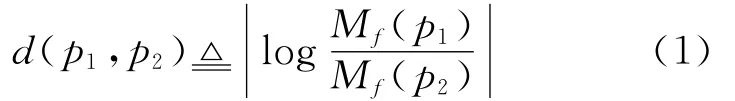

给定一个特征图Mf,(下标f表示某一特征)定义点p1(i1,j1)与p2(i2,j2)的差异为

由此,可以建立一个全联通图G,每一个像素点为图的一个节点,点p1(i1,j1)与p2(i2,j2)的边的权值被赋予

式中,F(·)为一高斯核函数。通过G图建立马尔科夫链,这个马尔科夫链的均衡分布为每一个点的差异值的大小,以此可获取到差异图像A。

最后,获取得到的差异图像A上建立另一个全联通有向图G′,点p1(i1,j1)与p2(i2,j2)的边的权值为

再次建立马尔科夫链,起均衡分布为每一个点的显著性得分。经过分值的归一化处理,可以得到GBVS方法的显著性图像SGBVS。

2.1.2 基于边线密度的显著性模型

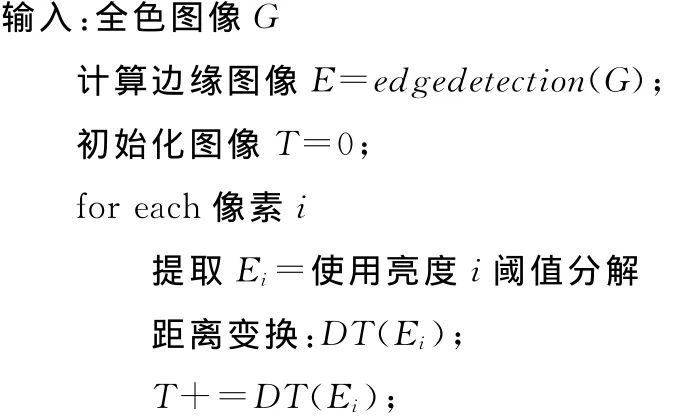

在高分辨率遥感图像中,建筑物或者人工物体的结构或者轮廓特征很明显,特别是在这些物体聚集的区域,边缘信息非常丰富。在目标区域检测过程中边缘是很有用的目标特征。边缘信息分布密集的区域往往也是在后续图像分析中需要关注的区域。基于这种观察,本文引入基于边缘密度的显著性计算模型[15]。LDVS方法简单且输入参数少,可对图像中显著性区域进行有效提取。具体的算法流程如算法1所示。

图1 基于显著性和图像分割的目标提取流程图Fig.1 The flow chart of the proposed target extraction method based on saliency detection and image segmentation

将此模型应用于高分辨率遥感图像,过程如下:输入图像I,使用边缘检测方法可得到边缘信息图像E。本文选取Sobel边缘检测算子。在图像的任何一点使用此算子,将会产生对应的梯度矢量或是其法矢量。因此在边缘信息图E中每一个像素值的亮度值代表了其边缘强度值。然后,通过距离变换(distance transform,DT),可获取图像中的边缘密度信息。

基于边缘线密度的显著性检测方法如下:

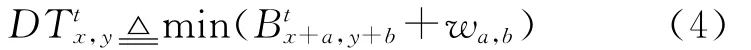

DT图像是通过对边缘图像进行阈值分解得到的。其定义如下:

式中,a,b∈{-1,0,1};Bt为通过使用t进行阈值分割得到的图像;wa,b是一个3×3的权重模板卷积。通过DT变换,将一个点的边缘强度值可分解到每个邻居像素点。若某一个像素点离高强度的边缘近,显著性值会越高。

针对高分辨率遥感图像,由于一些纹理会被检测为边缘信息(如森林中林木分布),这些边缘虽然强度不高,不过密度很高,会影响检测精度。因此,在预处理阶段,对图像进行边缘增强,然后对检测得到的边缘图像阈值分割,保留高强度的边缘,过滤掉强度低的边缘。

最后将所有的DT图像线性叠加,叠加结果图S中,离高边缘密度或高边缘强度区域越近的点,显著性得分会越高。最后通过下式可将其归一化。

归一化叠加后的图像可得到基于边缘密度信息的显著性图像Sedge。

2.1.3 融合GBVS和LDVS的显著性模型

在遥感图像的自动解译过程中,由于目标的多样性与地物分布的复杂性,需要综合考虑各种情况,将不同的特征有机的结合,才有可能取得较好的效果。通过检测结果的分析,基于边缘密度信息的显著性计算方法可以很好地保留物体的边界(边界为较强的边缘),基于图论的显著性计算方法能够均匀化表示物体内部的显著性分布[3]。因此,为了提高显著性区域的提取精度,本文将两种方法获取得到的显著性图融合。分析两种显著性图像中显著性大小的分布,本文使用2D的高斯型混合函数对其融合。函数定义如下

式中,Sedge和SGBVS都被线性归一化,归一化方法参见式(5)所示。参数σ决定了融合函数的形状。若某一点的显著性得分分别在Sedge和SGBVS一致时,融合后其显著性分数会很高,也表示其在图像中很显著。

2.2 基于显著性的面向对象的目标提取方法

面向对象影像分析可以表达和应用语义信息特征[17],把影像分割成有意义的影像区域(对象)不仅能够表达影像区域的光谱特征,还能表达丰富的空间和上下文特征等语义信息,从而使区分光谱相似的地类成为可能[18]。本文在显著性检测的基础上,利用面向对象的分析方法来提取高分辨率遥感图像中感兴趣的目标。

2.2.1 基于GraphCut的对象块分割

Graph Cut是近年来兴起的一种基于图论的分割方法[19],具有鲁棒性强、全局最优等特点,用这种方法分割得到的结果可以更好地分割出不同质区域的轮廓并且同质区域内部更为紧凑。

图像分割可以转换为求能量函数最优化问题。一个分割S可以表示为一个二元向量A=[a1a2…aN],其中ai∈{0,1}表示第i个像素是“目标”还是“背景”。则分割A的能量为

式中,R(A)为数据项或区域项,表示分配一个像素p到“目标”或“背景”的个体惩罚;B(A)为光滑项或边界项,用来表示两个像素p和q之间不连续的惩罚。

文献[19]证明,如果图像用图模型来表示,那么式(7)可以用最大流/最小割算法[20]求得最优解。具体算法可参考文献[20]。

本文在显著性区域检测的基础之上,利用Graph Cuts图像分割方法得到不相连的片状区块提取较为准确的目标轮廓。对于多光谱图像,将其每一个通道作为输入,并将结果进行加法融合,可得到多光谱图像的基于图论的分割结果。这种方法获取到的分割结果既不太粗糙也不过分细腻,而且此算法的时间复杂度O(nlogn),n为图像边的数量。在实际应用中,此方法比较快速得到较为有效的分割结果。通过定义输出图像的分割系数以及最小分割块的大小,可以获取到较为理想的分割结果。

2.2.2 基于平均显著度的目标提取

利用2.1节所述方法得到的显著性图像中,每一个像素点的亮度为其显著性得分的大小,得分越高,说明其越显著。图像分割方法将各个像素点分割为一些内部特征比较类似的图像块。显著性目标为显著性得分很高的分割块的集合。因此,需要剔除像素点很少却显著性很高分割块和面积很大却显著性低的分割块。首先,通过控制分割的最小块(例如,包含至少100个像素点)可剔除像素点很少却高显著性的区域。其次,通过阈值选取平均显著性的大小可剔除面积很大却显著性低的分割块。图像块Si(i=1,2,…,m)的平均显著性AvgSaliency(Si)定义如下

式中,m为分割结果中包含的分割块的数量;Saliency(i,j)为点(i,j)的显著性得分。本文通过Otsu方法[14]来自动选取合适的阈值。通过阈值选取平均显著性高的分割块,可将图像分为两类:目标类与背景类。显著度大于阈值的为目标类,反之则为背景类。本文所述面向对象目标提取方法不再需要计算每个对象中复杂的特征,降低了计算复杂度,提高了提取效率。

3 试验结果与分析

3.1 试验区选取

本文设计了两组试验来评估所提方法的性能。两组试验都选取了Quickbird高分辨图像作为试验数据。试验1用于验证基于GBVS和LDVS融合的显著性方法计算高分辨率遥感影像中显著性区域的有效性,所使用的数据如图2所示,拍摄地点为中国郑州某地,时间为2002年4月6日,大小为300像素×300像素,左边为原始图像RGB真彩色显示,右边为手工标注基准图像。图像中显著性目标为一个工厂,其内部的白色柱状建筑在图像中十分突出,为“显著性”区域。由于现在还没有公开的用于显著性检测的遥感图像数据库,采用了文献[6]所使用的评价方法,通过人工标注一个多边形区域,其中包含了图像中最为显著的目标,作为基准图像。

图2 试验1数据和基准数据Fig.2 Data set used in experiment 1and ground truth

试验2所使用的数据如图3所示。图4数据拍摄于2011年4月19日,地点为北京市,区域大小分别为1280像素×768像素和1442像素×789像素。两块区域都包含了大量的人工建筑物,且较为分散,尤其是第2幅图像,建筑区域极为分散,检测的难度也更大。在图3中,用Photoshop软件手工标定了基准图像,验证算法的准确率。在试验过程中笔者在预处理阶段将所有影像数据各个波段的强度值规则化到[0,255]。

图3 试验2数据和基准图像(显示为RGB真彩色图像)Fig.3 Data sets used in experiment 2and ground truth(these images are displayed in true color)

图4 显著性计算结果对比Fig.4 Comparisons of saliency detection results

3.2 试验分析

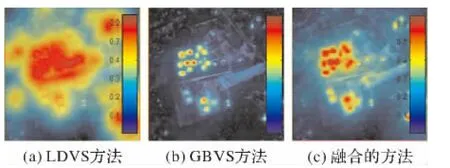

试验1:分别用GBVS、LDVS和融合后方法计算试验数据的显著性图像,试验结果如图5所示。试验结果显示,3种显著性计算方法得到的显著性图像在目标区域显著性分数很高,但是融合后的显著性图像比另外两种效果要更好。因为融合后的显著性图像既能保持目标区域内部显著性分数分布均匀,而且也能保留更好的区域边界。

图5 选取前75%显著区域的提取结果Fig 5 Extraction results by selecting top 75%saliency

通过选取阈值可以分割出目标区域。计算不同的阈值T对应的precision和recall,最终的精度/回收曲线如图5(d)所示。精度/回收曲线显示出在高精度的时候,GBVS和融合后的方法能够有比较小的回收率,也就是说,这两种方法可以有效地将目标区域计算为显著性较高的区域。当回收率不断增高时,尤其是超过0.75时候,融合后的显著性区域计算方法可得到最高的精度,这是由于GBVS方法中,显著性大的区域比较集中在图像中的圆环的中心区域,而在目标区域的边缘显著性较低。因此,当使用较大的阈值对显著性图像分割时,融合后的图像可以提取包含目标最为全面的区域。

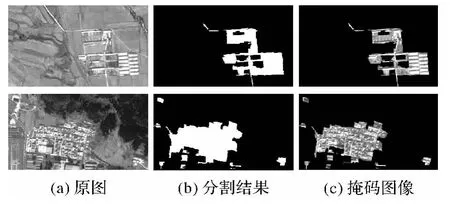

试验2:目标检测的目的是从复杂的遥感场景中提取出一些“突出”的目标物体。这些目标往往区域标记较大,因此,在图像分割阶段,控制其最小分割块的面积为10像素×10像素,以减少检测阶段的误检率。采用本文的基于GBVS和LDVS融合的显著性模型来计算图像的显著性图。首先建立8级的高斯金字塔,在多尺度下,提取多光谱遥感图像中的特征,包括颜色特征、灰度纹理特征、方向特征。试验中发现引入近红外特征,对显著性模型改进甚微。为了不增加计算量,选择数据的红绿蓝3个波段作为试验数据。然后,计算全色图像的基于线密度的显著性图。最终输出的显著性图中显著性分数归一化到[0,1]。GBVS和LDVS融合的显著性图像如图6所示。

图6 目标分割结果对比Fig.6 Comparisons of target segmentation results

在目标检测阶段,分割阶段生成的分割块可计算得到其平均显著性。通过对分割块阈值分割,检测结果如图6和图7所示。在图7中可以看到用LDVS提取到的结果范围更广一些,而GBVS检测到的结果面积更小,而且有些地方存在空洞,而本方法则综合了这两者,即能保持目标的形状而又不存在空洞。这个结果也与试验1的相吻合。从表1中可以看出,基于视觉显著模型的显著性目标检测方法的检测结果可以获取93%以上的检测精度,其误检率在8%~12%,说明检测结果可用于后期的图像智能处理,包括物体特征提取、物体识别等。

图7 目标提取结果Fig.7 Targets extraction results

从图7中可以看到,两幅图中较为显著的地方均为建筑物或者区域。从第1幅图像上可以看到使用本方法可以提取到比较完整的建筑物。从图上可以看到,在左边及上边的建筑区域仍然有一些“空洞”存在,这是因为这两部分的房屋间隔较远,中间的地貌以土地为主,与非建筑区域较为接近,显著性较低,更接近于背景而与目标相差较大,因此在提取过程中将此部分划为背景。从图上可以看到,图中的两条路非常明显,显著性较高与前景非常接近,因此误检率稍高。相比于第1幅图像,第2幅图像上的建筑物尺度更小,分布也更密集,因此以提取建筑区域来代替单个建筑物。从掩码图像上可以看到,本方法在较大的图像上也能够比较精确地提取出建筑区域。

表1 目标提取评价结果Tab.1 Quality assessments of target extraction

本文算法在 Matlab R2011b平台(Dual-Core CPU i3,4GB RAM,win7 32bit)下实现,部分算法进行了优化。程序运行时间21±0.5s。程序中所有算法均顺序执行,其中GBVS算法运行时间约为17s,LDVS算法运行时间约0.5s,Graph Cut分割算法运行时间在3s以下,提取目标的时间小于0.05s。

4 结 论

本文将视觉显著性模型与图像分割相结合,提出自适应的显著目标分割方法,实现了高分辨率遥感图像中目标精确的分割提取。在视觉显著性模型中,通过GBVS与LDVS融合,综合利用多光谱图像与全色图像中的颜色、方向、纹理以及边缘等特征,使显著目标提取的更加完整。同时,通过利用图论分割方法,获取特征相似的图像块,然后以图像块为单位分析其显著性大小,利用Otsu方法自动获取阈值并提取显著性目标。选取Quickbird多光谱数据作为试验数据集,试验结果表明此方法能够在较高检测精度的同时有效降低的冗余检测率,是可用于遥感图像全自动的显著性目标提取和高分辨率遥感图像自动分析的一种有效手段。

[1] YE Congying,LI Cuihua.HSI Based Visual Attention Model and Its Application in Ship Detection[J].Journal of Xiamen University :Natural Science,2005,44(4):484-488.(叶聪颖,李翠华.基于HSI的视觉注意力模型及其在船只检测中的应用[J].厦门大学学报:自然科学版,2005,44(4):484-488.)

[2] ITTI L,KOCH C,NIEBUR E.A Model of Saliency-based Visual Attention for Rapid Scene Analysis [J].IEEE Transaction PAMI,1998,20(11):1254-1259.

[3] HAREL J,KOCH C,PERONA P.Graph-based Visual Saliency[C]∥ Proceedings of NIPS.[S.l.]:NIPS,2006:545-552.

[4] GAO D,MAHADEVAN V,VASCONCELOS N.The Discriminant Center-surround Hypothesis for Bottom-up Saliency[C]∥ Proceedings of NIPS.[S.l.]:NIPS,2007:1-8.

[5] HOU X,ZHANG L.Saliency Detection:A Spectral Residual Approach[C]∥ Proceedings of CVPR.[S.l.]:CVPR,2007:1-8.

[6] ACHANTA R,HEMAMI S,ESTRADA F,et al.Frequency-tuned Salient Region Detection[C]∥ Proceedings of CVPR.[S.l.]:CVPR,2009:1597-1604.

[7] ANTELO J.Ship Detection and Recognition in High-resolution Satellite Images[C]∥ Proceedings of IGARSS.Cape Town:IEEE,2009:2894-2897.

[8] REN Lei,SHI Chaojian,RAN Xin.Small Target Detection in Ocean Environment Using Local and Global Saliency [J].Journal of Shanghai Maritime University,2012,33(2):1-5.(任蕾,施朝健,冉鑫.结合局部和全局显著性的海上小目标检测[J].上海海事大学学报,2012,33(2):1-5.)

[9] AO Huanhuan,YU Nenghai,LI Weihai,et al.Ship Detection Algorithm Based on Vision Attention Allocation Mechanism[C]∥Proceedings of International Conference Remote Sensing.[S.l.]:IEEE,2010:583-587.

[10] XU Gang.Extracting Salient Object from Remote Sensing Image Based on Guidance of Visual Attention[C]∥Proceedings of SPIE-The International Society for Optical Engineering.[S.l.]:SPIE,2007:6790-6794.

[11] LI Zhicheng,QIN Shiyin,LTTI L Extraction of Saliency-Gist Features and Target Detection for Remote Sensing[J].Journal of Beijing University of Aeronautics and Astronautics,2010,36(6):659-662.(李志成,秦世引,Itti Laurent.遥感图像的显著-概要特征提取与目标检测[J].北京航空航天大学学报,2010,36(6):659-662.)

[12] LI Zhicheng,ITTI L.Saliency and Gist Features for Target Detection in Satellite Images[J].IEEE Transaction Image Process,2011,20(7):2017-2029.

[13] ZHAO Hongwei,CHEN Xiao,LIU Pingping,et al.Adaptive Segmentation for Visual Salient Objects [J].Optics and Precision Engineering,2013,21(2):531-538.(赵宏伟,陈霄,刘萍萍,等.视觉显著性目标的自适应分割[J].光学精密工程,2013,21(2):531-538.)

[14] NOBUYUKI OTSU.A Threshold Selection Method from Gray-level Histograms [J].IEEE Transactions on Systems,Man and Cybernetics,1979,9(1):62-66.

[15] ROSIN P L.A Simple Method for Detecting Salient Regions[J].Pattern Recognition,2009,42(11):2363-2371.

[16] TAN Qulin.Urban Building Extraction from VHR Multispectral Images Using Object-based Classification [J].Acta Geodaetica et Cartographica Sinica,2010,39(6):618-623.(谭衢霖.高分辨率多光谱影像城区建筑物提取研究[J].测绘学报,2010,39(6):618-623.)

[17] TAO Chao,TAN Yihua,CAI Huajie,et al.Objectoriented Method of Hierarchical Urban Building Extraction from High-resolution Remote-Sensing Imagery [J].Acta Geodaetica et Cartographica Sinica,2010,39(1):39-45.(陶超,谭毅华,蔡华杰,等.面向对象的高分辨率遥感影像城区建筑物分组提取方法[J].测绘学报,2010,39(1):39-45.)

[18] SONG Z.A Region-based Approach to Building Detection in Densely Build-up High Resolution Satellite Image[C]∥ Proceedings of ICIP.Atlanta:IEEE,2006:3225-3228.

[19] BOYKOV Y,JOLLY M P.Interactive Graph Cuts for Optimal Boundary and Region Segmentation of Objects in ND Images[C]∥ Proceedings of CVPR.[S.l.]:CVPR,2001:105-112.

[20] YURI BOYKOV,VLADIMIR KOLMOGOROV.An Experimental Comparison of Min-Cut/Max-Flow Algorithms for Energy Minimization in Vision[J].IEEE Transaction of PAMI,2004,26(9):1124。