基于高低频分量融合的人脸识别方法

2013-04-24张智斌赖剑煌谢晓华郑伟诗

张智斌,赖剑煌,谢晓华,郑伟诗

(1.中山大学数学与计算科学学院,广东 广州 510275;2.华南理工大学数学系,广东 广州 510641;3.中山大学信息科学与技术学院,广东 广州 510275;4.中国科学院深圳先进技术研究院,广东 深圳 518055)

人脸识别技术在安检、智能监控等多个领域具有广泛的应用。在众多人脸识别应用中,光照变化问题是其中一项最具挑战性的难题。Adini[1]指出在人脸识别中,同一对象人脸上光照变化对识别的影响比不同对象之间本质差别对识别的影响更大。FRVT2002[2]和FRVT2006[3]中的人脸识别方法测试都表明,光照的剧烈变化会严重影响到人脸识别方法的性能。很多现有的人脸识别方法,如PCA、ICA和LDA等,都对光照变化具有敏感性。因此,脸部光照正则化是人脸识别和人脸图像处理中有待解决的核心问题。

现有的光照正则化方法大致可以分成两大类:提取对光照不敏感的光照不变特征的方法,以及重建人脸在正面均匀光照条件下的人脸图像的方法。

提取光照不变特征的方法:在较早期的文献,研究者提出用简单的描述子去进行人脸识别,例如对数变换、边缘图像、图像梯度等。这些算法易于执行,但是在提升识别率方面空间非常有限。近年,Zhang[4]梯度脸方法从梯度域提取光照不敏感度量。基于时频分析的研究,很多研究者提出在频率域上提取光照不变特征。通常高频成分被用作识别特征,因为高频成分对光照变化不敏感。具有代表性的研究包括:基于小波变换的Waveletface方法[5]、提取Gabor特征的方法[6]、基于离散余弦转换的方法[7]、基于离散傅里叶变换的Spectroface方法以及基于二元树复小波变换的方法[8-9]。

在图像空间中,一个固定姿势的对象在任意光照方向下的所有图像的集合构成一个光照锥[10]。一个凸的兰伯特对象的光照锥可被一个低维线性子空间逼近。因此,很多基于子空间的方法相继提出,例如商图像[11]、球谐函数表示的方法[12]、拉普拉斯算子特征脸[13]。基于子空间的方法可以有效地应用到处理光照变化问题上,但是这些方法通常需要大量的训练样本。

人脸图像的小尺度特征被认为是对光照变化不敏感的光照不变特征。对于人脸图像,我们将其小的本质结构称为小尺度特征,例如人脸、眼睛、鼻子等的轮廓,小尺度特征表示的是人脸的高频成分,并将大的本质结构例如光照和人脸区域的阴影称为大尺度特征,大尺度特征表示的是人脸的低频成分。许多现有的方法仅仅将人脸的高频成分小尺度特征提取来用于人脸识别,以此来避免光照变化。这些方法主要包括Land[14]的Retinex模型及其改进。基于Retinex理论,人脸图像可以分解成其平滑部分和光照不变特征部分。分别使用全变分模型、高斯滤波、加权高斯滤波和小波变换等技术可得到基于Retinex理论的不同分解结果。相关的主要方法有对数全变分模型(LTV)[15]、本质图像方法(IntrinsicImage)[16]、自商图像(SQI)[17]和对数小波变换方法(LWT)[18]。在提取光照不变特征的方法中,基于Retinex理论的方法通常比其他方法效果更好。然而,这些方法都舍弃了人脸图像的大尺度特征,人脸的低频成分大尺度特征往往包含着大量有用信息。此外,缺少了人脸的低频成分大尺度特征,也很难生成有良好视觉效果的正面光照图像。

重建人脸在正面均匀光照条件下的人脸图像的方法:另外一些方法目标在于重建在正面均匀光照下的人脸图像,这些方法往往直接在原始图像上进行光照修正。最早的方法对人脸图像做简单的灰度值调整,例如Gamma校正的方法,直方图均衡化方法(HE)和直方图匹配方法(HM)。这些算法中并未考虑到获得人脸图像时的光照条件,因此很难用其取得满意效果。与之相反,有研究者研究人脸在不同光照条件下获得的人脸图像之间的关系,而这些关系被运用到一些后期的方法中,用于做人脸光照正则化。典型的方法包括形变脸(Morphing Face)[19]、由人脸区域阴影恢复人脸形状的方法SFS[20]、基于线性光照模型的光照补偿方法[21]、阴影补偿方法[22]和通过在对数域截断DCT低频系数的光照补偿方法[23]。这些方法可以获得良好的人脸光照恢复结果,但这些方法都需要事先对人脸图像做好严格的对齐,但是在不同光照条件下的人脸图像之间做到严格的对齐是极具挑战性的。基于光照子空间理论,相关研究提出了很多光照重建方法,例如基于商图像的光照重建方法[11]、基于球谐函数的形变模型(SHBMM)[24]、张量脸(TensorFace)[25]、双线性光照模型[26]、谐波光照重建[27]以及基于像素相关性的光照重建模型[28]。通过这些光照重建方法,可以生成人脸在任意光照条件下的图像。

本文提出的方法是一种基于人脸图像高频成分和低频成分重建的方法。LTV方法和SQI等方法可获得人脸图像的高频成分和低频成分,高频成分描述了人脸图像细节成分,高频成分可作为光照不变特征进行人脸识别,低频成分描述的是人脸图像光照成分。在正面均匀光照射下的人脸图像得到的高频成分人脸细节信息清晰可见,低频成分描述均匀的光照成分;但在非正面均匀光照射下的人脸图像,人脸区域会分为光照明亮区域和光照阴影区域,光照阴影区域内的高频成分会被破坏,不能清晰地得到阴影区域内的人脸细节信息,低频成分内会有明显的光照阴影成分。Xie[29]指出丢弃低频成分,只使用高频成分作为光照不变特征做人脸识别会导致用于识别的信息不足。高频成分主要描述的是人脸各部分的细节例如轮廓,高频成分细微的变化都会影响特征的对准从而影响识别率,而低频成分描述的光照信息变化是缓慢的,低频成分对人脸特征对齐具有一定的鲁棒性。本文对在非正面均匀光照射下的人脸图像,使用LTV获得人脸图像的高频成分和低频成分,本文的方法利用人脸光照明亮区域的高频成分重建人脸阴影被破坏的高频成分,利用局部的明亮区域的光照成分重建全局的人脸在正面均匀光照射下的光照成分,最后高频成分和低频成分进行融合得到人脸在正面均匀光照下的人脸图像,去除原图像光照阴影区域的影响,实现人脸光照恢复。

1 人脸图像高频、低频成分分解

本文的方法使用LTV方法得到人脸图像中描述人脸细节信息的高频成分和描述光照成分的低频信息。对于在任意光照环境下获得的人脸图像F(x,y),根据Lambertian反射原理,F(x,y)可以分解为

F(x,y)=ρ(x,y)S(x,y)

其中ρ(x,y)是反射图像,描述的是人脸表面的反射率,S(x,y)是光照图像,描述的是获得人脸图像的光照环境,ρ(x,y)与S(x,y)互相独立。ρ(x,y)表述的是人脸图像内在的本质特征,可以作为光照不变特征进行人脸识别,但是对于单一图像F(x,y)根据Lambertian反射原理求解ρ(x,y)是一个病态问题,难以实现。Chen等[16]在Lambertian反射原理的基础上提出了LTV方法。

F(x,y)=ρ(x,y)S(x,y)=(ρ(x,y)/ρl(x,y))·

(ρl(x,y)S(x,y))=ρ′(x,y)S′(x,y)

其中ρl(x,y)是人脸平滑区域和背景区域的反射率。ρ′(x,y)=ρ(x,y)/ρl(x,y)描述的是人脸细节信息,是人脸图像的高频成分,S′(x,y)=ρl(x,y)S(x,y)描述的是人脸图像的光照信息,是人脸图像的低频信息。

对人脸图像F做对数变换得到

f=log(F)=log(ρ′)+log(S′)=v+u

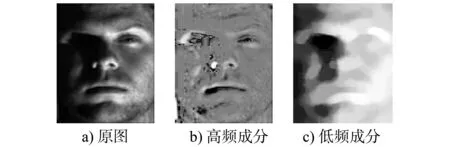

本文实验中选取LTV算法的参数λ=0.4。图1中a)是在正面光均匀照射下的人脸图像,b),c)是a)通过LTV算法提取的高频成分和低频成分,可见在正面光均匀照射下的人脸图像,高频成分中人脸的细节信息(轮廓信息等)清晰可见,低频成分描述了正面光照射的光照信息。

图1 正面均匀光照照射下的人脸图像Fig.1 Frontal illuminated face image

图2中a)是在任意非正面均匀光照射下的人脸图像,b),c)是a)的高频成分和低频成分,可见在任意光照条件下的人脸图像,人脸区域分成光照明亮区域和光照阴影区域,在光照阴影区域中,高频成分人脸的细节信息被损坏,低频成分内会有明显的光照阴影信息。

图2 非正面均匀光照照射下的人脸图像Fig.2 Non-frontal illuminated face image

2 人脸图像阴影区域高频、低频成分的重建、融合

本文的方法利用人脸光照明亮区域的高频成分,使用最小二乘法估计出光照阴影区域高频成分最优的重建系数,从而重建光照阴影区域内被破坏的高频成分。用同样的方法利用局部的明亮区域的光照成分重建全局的人脸在正面均匀光照射下的光照成分。重建后的高频人脸细节信息和低频光照成分进行融合得到人脸在正面均匀光照下的人脸图像,去除原图像光照阴影区域的影响,实现人脸光照恢复。Hwang[30]提出基于Morphable Face Model的方法根据人脸没被损坏区域的轮廓、纹理重建人脸被损坏区域的轮廓和纹理。本文将Hwang的方法推广应用在高频、低频成分重建。

在任意光照条件下的待光照恢复的正脸图像记为F,选择m张在正面光均匀照射的正脸图像作为训练图像分别记为Ti,i=1,…,m,图像的尺寸均为M×N。

使用LTV方法得到图像F的高频成分V,低频成分U,得到训练图像Ti,i=1,2,…,m的高频成分Vi,低频成分Ui。将图像V,U,Vi,Ui,i=1,2…m的像素按列排序得到各自的列向量仍然用符号V,U,Vi,Ui,i=1,…,m表示。

根据PCA待光照恢复的人脸图像F的高频成分的列向量V可以表示为

(1)

待光照恢复的人脸图像F的像素点可分为两个集合:光照明亮区域的像素点集合X={x1,…,xn}和光照阴影区域的像素点集合Y={y1,…,yk},n+k=M×N。本文的方法就是通过集合X上的高频成分来估计式(1)最优的系数α=(α1,…,αm)′,再由式(1)根据最优系数α=(α1,…,αm)′重建集合Y上的高频成分。

所求的最优系数α=(α1,…,αm)′要满足

(2)

其中xj∈X,j=1,…,n,可以假设n远大于m,式(2)是一矛盾方程组。一般不能找到合适的系数α=(α1,…,αm)′刚好满足式(2),我们选择α*满足最小平方误差,即

根据最小二乘法可求得最优系数α*,得到α*后根据式(1)可以重建光照阴影区域的高频成分。

其中yj∈Y,j=1,…,k。

用同样的方法可根据光照明亮区域的低频成分重建光照阴影区域的低频成分。

重建后的高频成分记为V*,重建后的低频成分记为U*。重建后的高频人脸细节信息和低频光照成分进行融合得到人脸在正面均匀光照下的人脸图像F*

F*=exp(a×V*+(1-a)×U*)

融合系数a,0≤a≤1,实验中选取a=0.7。

图3中a)为待光照恢复人脸图像F,b)为F的高频成分V,c)为重建后的高频成分V*,d)为F的低频成分U,e)为重建后的低频成分U*,f)为V*和U*融合得到的光照恢复人脸图像F*。

图3 人脸图像高频、低频成分重建、融合Fig.3 The reconstruction and fusion of high-frequency components and low-frequency components

3 人脸光照阴影区域的估计

本文的人脸图像高频、低频成分重建方法需要预先把人脸图像F的像素点分为两个集合:光照明亮区域的像素点集合X={x1,…,xn}和光照阴影区域的像素点集合Y={y1,…,yk}。本文的实验图像是灰度图像,可通过人脸图像像素点的灰度值大致判断是否属于光照明亮区域。

本文实验中选择的经验阈值δ范围为50≤δ≤120,特别地指出,本文的方法并不需要精准地判断人脸的光照明亮区域,只需大致地判断出光照明亮区域就可使得方程组式(2)的方程数目n远大于未知量的数目m,使得方程组式(2)是矛盾方程,通过最小二乘法可求得方程组式(2)满足最小平方误差的解α*=(α1,…,αm)′。

4 实 验

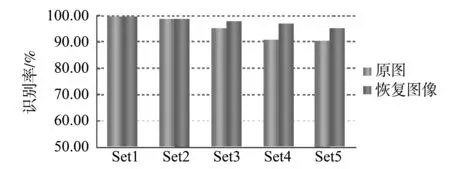

实验中使用的正脸人脸图像来自Yale B人脸数据库。Yale B数据库包括10个人,9种姿势在65种光照条件下的人脸图像,实验使用的是正脸人脸图像。Yale B数据库根据采集时光源与摄像头方向的夹角大小,Yale B数据库被分为Set1到Set5五个子集,Set1中的人脸图像基本上可看做是正面光均匀照射,从Set1到Set5人脸图像的光照环境逐渐恶劣,Set5中的人脸图像上有大范围的阴影区域。

实验中对Yale B正脸人脸图像,和使用本文方法光照恢复后的人脸图像,分别使用梯度脸(GF),PCA,LDA随机49次选取训练样本做识别,49次的平均识别率见图4-图6。在光照环境恶劣的三个子集Set3、Set4、Set5使用本文的方法做光照恢复后的识别率比未做光照恢复前有显著提高。本文方法得到的光照恢复图像上的人脸细节信息比未做恢复前的人脸细节信息丰富,光照恢复图像中的光照环境比未做恢复前有明显的改善,光照恢复图像结合了改善后的人脸细节信息和光照信息,丰富的识别信息更有利于提高识别率,图4中可见选用梯度脸的方法就可达到最佳的识别结果。

5 结 论

本文提出了一种人脸图像光照恢复方法,利用人脸光照明亮区域的人脸细节信息、光照信息重建人脸光照阴影区域内的人脸细节信息和光照信息,然后融合重建后的人脸细节信息和光照信息,去除原图像光照阴影的影响,实现人脸光照恢复。实验结果表明本文的人脸光照恢复方法具有良好的视觉效果和识别结果。

图4 原图,恢复图像GF识别率Fig.4 Recognition rates of GF using original and restored face images

图5 原图,恢复图像PCA识别率Fig.5 Recognition rates of PCA using original and restored face images

图6 原图,恢复图像LDA识别率Fig.6 Recognition rates of LDA using original and restored face images

参考文献:

[1] ADINI Y, MOSES Y, ULLMAN S. Face recognition: The problem of compensating for changes in illumination direction [J]. IEEE Trans Pattern Anal Mach Intell, 1997, 19(7): 721-732.

[2] PHILLIPS P J, GROTHER P, MICHEALS R J, et al. FRVT 2002: Evaluation Report Mar. 2003[R/OL]//[2003-03-15]. http://www.frvt.org/FRVT2002/.

[3] PHILLIPS P J, SCRUGGS W T, TOOLE A J O, et al. FRVT 2006 and ICE 2006 large-scale results [R]//In National Institute of Standards and Technology, NISTIR, 2007, 7408.

[4] ZHANG T, TANG Y Y, FANG B, et al. Face recognition under varying illumination using gradientfaces [J]. IEEE Trans Image Process, 2009, 18(11): 2599-2606.

[5] GARCIA C, ZIKOS G, TZIRITAS G. A wavelet-based framework for face recognition [C]// Eur Conf Comput Vis, Freiburg, 1998: 84-92.

[6] OKADA K, STEFFENS J, MAURER T, et al. The bochum/USC face recognition system [C]// In Face Recognition: From Theory to Applications. Berlin: Springer-Verlag, 1998:186-205.

[7] HAFED Z, LEVINE M. Face recognition using the discrete cosine transform [J]. Int J Comput Vis, 2001, 43(3): 167-188.

[8] LAI J, YUEN P C, FENG G. Face recognition using holistic Fourier invariant features [J].Pattern Recognit, 2001, 34: 95-109.

[9] LIU C C, DAI D Q. Face recognition using dual-tree complex wavelet features [J]. IEEE Trans Image Process, 2009, 18(11): 2593-2599.

[10] GEORGHIADES A, BELHUMEUR P, KRIEGMAN D. From few to many: Illumination cone models for face recognition under variable lighting and pose [J]. IEEE Trans Pattern Anal Mach Intell, 2001, 23(6): 643-660.

[11] SHASHUA A, RIKLIN-RAVIV T. The quotient image: Class-based re-rendering and recognition with varying illuminations [J]. IEEE Trans Pattern Anal Mach Intell, 2001, 23(2): 129-139.

[12] BASRI R, JACOBS D. Lambertian reflectance and linear subspaces [J]. IEEE Trans Pattern Anal Mach Intell, 2003, 25(2): 218-233.

[13] HE X, YAN S, HU Y, et al. Face recognition using laplacianfaces [J]. IEEE Trans Pattern Anal Mach Intell, 2005, 27(3): 328-340.

[14] LAND E H, MCCANN J J. Lightness and retinex theory [J]. J Pot Soc Amer, 1971, 61(1): 1-11.

[15] CHEN T, YIN W, Zhou X S, et al. Total variation models for variable lighting face recognition [J]. IEEE Trans Pattern Anal Mach Intell, 2006, 28(9): 1519-1524.

[16] CHEN C P, CHEN C S. Lighting normalization with generic intrinsic illumination subspace for face recognition [C]//IEEE Int Conf Comput Vis, Beijing, China, 2005: 1089-1096.

[17] WANG H, LI S Z, WANG Y. Face recognition under varying lighting conditions suing self quotient image [C]//Conf Autom Face Gesture Recognit, Seoul, 2004: 819-824.

[18] ZHANG T, GANG B, YUAN Y, et al. Multiscale facial structure representation for face recognition under varying illumination [J]. Pattern Recognit, 2009, 42(2): 251-258.

[19] BLANZ V, VETTER T. Face recognition based on fitting a 3D morphable model [J]. IEEE Trans Pattern Anal Mach Intell, 2003, 25(9): 1063-1074.

[20] ZHAO W, CHELLAPPA R. Symmetric shape-from-shading using self-ratio image [C]// IEEE Int Conf Comput Vis, Vancouver, BC, 2001: 55-75.

[21] XIE X, LAM K. Face recognition under varying illumination based on a 2D face shape model [J]. Pattern Recognit, 2005, 38(2): 221-230.

[22] CHOI S, KIM C, CHOI C H. Shadow compensation in 2D images for face recognition [J].Pattern Recognit, 2007, 40: 2118-2125.

[23] CHEN W, MER, WU S. Illumination compensation and normalization for robust face recognition using discrete cosine transform in logarithm domain [J]. IEEE Trans Syst, Man,Cybern B,Cybern,2006,36(2):458-466.

[24] ZHANG L, Wang S, SAMARAS D. Face synthesis and recognition under arbitrary unknown lighting using a spherical harmonic basis morphable model [C]//IEEE Int Conf Comput Vis Pattern Recognit, San Diego, CA, 2005, II: 209-216.

[25] VASILESCU M A O, TERZOPOULOS D. Multilinear analysis of image ensembles: Tensorfaces [C]//IEEE Eur Conf Comput Vis, Copenhagen, Denmark, 2002: 447-460.

[26] LEE J, MOGHADDAM B, PFISTER H, et al. A bilinear illumination model for robust face recognition [C]//IEEE Int Conf Comput Vis, Beijing, China, 2005: 1177-1184.

[27] QING L, SHAN S, GAO W, et al. Face recognition under generic illumination based on harmonic relighting [J]. Int J Pattern Recognit Artif Intell, 2005, 19(4): 513-531.

[28] SHIM H, LUO J, CHEN T. A subspace model-based approach to face relighting under unknown lighting and poses [J]. IEEE Trans Image Process, 2008, 17(8): 1331-1341.

[29] XIE X H, ZHENG W S, LAI J H, et al. Normalization of face illumination based on large-and small-scale features [J]. IEEE Trans Image Process, 2011, 20(7): 1807-1821.

[30] HWANG B W, LEE S W. Reconstruction of partially damaged face images based on a morphable face model [J]. IEEE Trans Pattern Anal Mach Intell, 2003, 25(3): 365-372.