利用自适应组合模型实现车辆跟踪

2010-03-06曲巨宝

曲巨宝

(武夷学院数学与计算机系,福建武夷山 354300)

运动车辆跟踪一直是道路交通管理和肇事逃逸追踪关注的焦点。利用城市道路监控摄像机,如何准确而有效地定位视频序列中待跟踪车辆目标的位置,一直是计算机图像处理、视觉计算领域中的一个热门课题。其中车牌自动识别也是智能交通系统一个重要的部分[1],但其前提是要对视频图像进行提取后获得车牌信息。绝大多数应用场合中要求目标跟踪算法对遮挡、光线变化以及目标缩放、旋转具有鲁棒性,且跟踪算法耗时少,实时性高。目前,常用的MeanShift算法、CamShift算法和粒子滤波被广泛应用于目标跟踪领域中。MeanShift以其无需参数、快速模式匹配的特性而受到广泛关注。但该算法无法更新跟踪窗核宽,当目标发生明显的尺寸变化时,容易造成目标的丢失[2]。粒子滤波是通过随机样本的状态和权值来计算后验概率分布,是一种简单、有效的由非高斯、非线性的观测数据计算后验概率的方法。但是计算量较大,尤其是随着状态空间的维数的增加计算量增加更快[3]。CamShift算法通过H分量方向投影图中目标区的一阶矩计算获得目标尺度和跟踪窗,依靠连续迭代计算,获取目标形心位置[4]。该算法可以对人脸等具有特定颜色的目标进行跟踪,但在复杂背景中、运动目标色彩丰富或者当目标与背景颜色接近时,跟踪结果往往难以令人满意。为此,本文在深入研究了CamShift算法之后,提出了基于自适应颜色识别、倾角旋转、信息识别的改进CamShift算法,以应用于复杂场景情况下车辆目标的精确跟踪。

1 CamShift算法

CamShift算法是一个基于随机颜色概率模型的跟踪算法,它通过聚类的方式搜寻运动目标,而与跟踪对象的具体模型无关,利用区域内的颜色信息实现快速可变核窗宽跟踪。它由反向投影、MeanShift算法和CamShift跟踪三个主要部分构成[5-6]。

1.1 反向投影图

1.2 CamShift算法

CamShift算法是在颜色概率分布图中执行MeanShift算法,MeanShift算法根据反向投影和初始搜索窗口位置,利用迭代方法寻求质心,当搜索窗口中心的移动小于某个给定值或者函数已经达到最大迭代次数时,认为收敛条件满足,停止迭代。设I(x,y)是反向投影图中(x,y)处的像素值,x和y的变化范围为搜索窗的范围。

CamShift算法流程如下:

2 改进CamShift算法

2.1 存在的问题

由于CamShift算法使用单一的HSV颜色模型,很难适应物体大范围运动或场景背景变化和大幅度光照变化[4];其以HSV模型中H分量作为目标建模特征,当S或者V值较小或者较大时势必降低灰色、黑色等色调模糊的目标模型与背景模型的可分度,导致跟踪失败[7-8];其次是当目标发生倾斜、角度变化时无法正确识别目标,当目标被遮挡、瞬间消失等情况发生时都无法正确跟踪。如图1的a列所示。在a1和a2两图中目标能被CamShift算法准确跟踪,在a3和a4两图中天空突然变晴朗,亮度增大,可以看到此时的跟踪已经发生偏离。

2.2 自适应颜色组合识别

图1 两种算法实验结果比较

2.3 车辆倾角识别

当车辆在运动中与摄像机间的视角发生变化时,其目标图像内的像素组成就发生了变化,仅靠一阶CamShift是无法正确识别目标的,为此进一步利用二阶矩阵求取车辆目标倾角和搜索窗[9]构造目标二阶矩分别为

2.4 车辆状态信息识别

为能更好地预测车辆目标在下一时刻可能出现的位置和运动特性,为运动目标建立状态信息模型和加速度位移方程[10]:

其中:α,β是一个介于0≤α,β≤1的常数。

3 算法实现与效果分析

利用VC6.0及MATLAB7.0为平台,在P4 3.0GHz 512M的机器上开发了本算法的实验系统,对各种场景下的车辆视频序列进行连续跟踪实验。在实验中,首先利用自适应HSV颜色组合模型对场景中H,S,V三分量进行凸组合建模,通过多目标规划法求取最优组合系数,实现自适应CamShift跟踪识别;为确保当车辆发生旋转、倾斜时也能够正确识别,采用二阶矩进行倾角预测;通过构造车辆状态信息方程,预测车辆在下一时刻可能出现的位置和运动特性,避免因车辆遮挡、瞬间消失、重现时给跟踪系统带来的扰动,同时对系统跟踪效率也有很大提高。其算法实现流程如图2所示。

图2 自适应组合CamShift算法流程图

图3 深色度车辆超车时两种算法跟踪结果比较

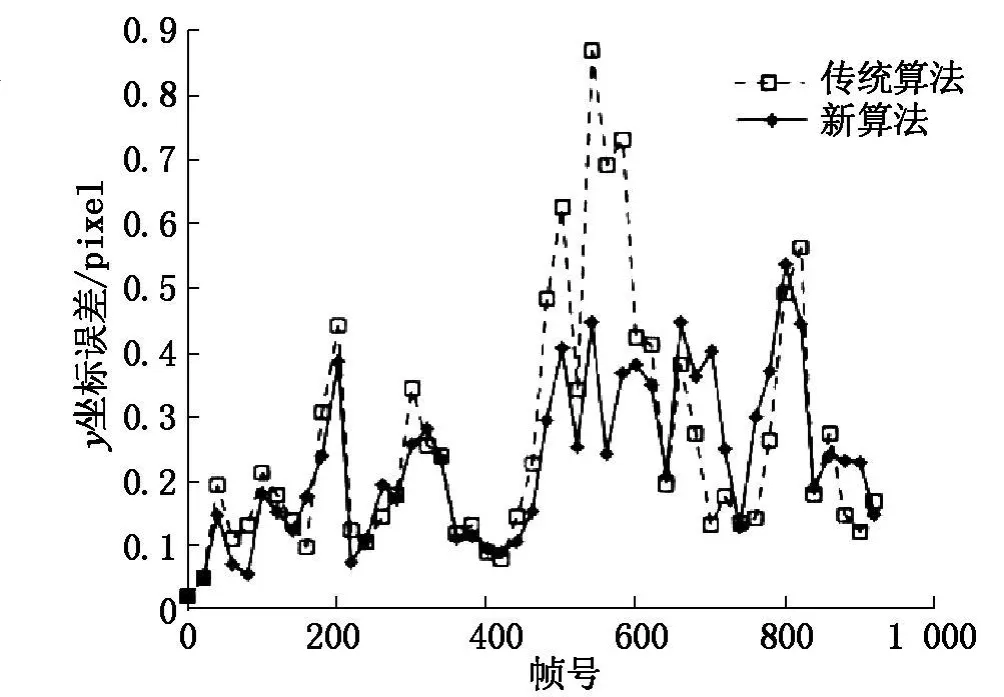

为验证本算法的有效性,对道路上的实际车辆视频进行了大量的跟踪测试实验。图1是使用本算法前后的实验结果比对。其中a列图像是利用传统CamShift算法进行目标跟踪的结果,b列是本文算法。尽管在b3和b4两图中目标快速地移向摄像机,且天空光照增强,本文算法依然可以很好地跟踪到目标,而传统的CamShift算法已经丢失了目标。图3是一辆深色轿车超车过程视频跟踪过程。从第1帧标定了该车辆到第53帧,传统CamShift算法(图a)都能很好地跟踪到目标,但当进入到第68帧超车后,由于H分量的作用,使得搜索窗将两部色度相近的车都框入跟踪区,到第97帧时已经完全失去了目标车辆;图b是利用本文算法进行的跟踪。在第68帧时由于运用了车辆状态信息识别算法,对车辆质心、加速度等信息做了很好的预测,因此保证了跟踪质量和效率。图4是两种算法在跟踪时的车辆质心状态仿真图,在第 420帧至 620帧时亮度增大,传统CamShift算法明显偏离目标,而本算法却没有受到干扰,能够正常跟踪。

图4 车辆质心跟踪仿真图

4 结论

针对CamShift算法只适于跟踪H分量等特定颜色目标的不足,本文采用HSV空间的H,S,V三个分量建立目标的三维直方图,并利用凸函数和多目标规划最优求解法获得自适应颜色识别最佳组合算法,提高了算法适应场景变化的能力。进一步提高车辆目标跟踪过程的识别率,建立了多变量状态模型和旋转的跟踪和预测,提高了目标跟踪的准确性和鲁棒性。经大量的现场实验表明,本文算法跟踪效果好,识别率高,实时性强,易于工程实现,有很好的应用前景。

[1]石晓瑛,许智榜.车牌自动识别系统设计与实现[J].华东交通大学学报,2009,26(3):48-51.

[2]CRISAN D,DOUCET A.A survey of convergence results on particle filtering methods for practitioners[J].IEEETransSpeech and Audio Proc,2002,10(3):173-185.

[3]李静,陈兆乾.基于颜色的粒子滤波非刚性目标实时跟踪算法[J].郑州大学学报:理学版,2006,38(4):60-63.

[4]JINMAN K,COHEN I,MEDIONI G.Continuous Tracking within and across Camera Streams[C]//2003 IEEE Computer Society Conference on Computer Vision and Pattern Recognition.2003:267-272.

[5]BOYLE M.The Effects of Capture Conditions on the CAMSHIFT Face Tracker[R].Alberta,Canada:Department of Computer Science,University of Calgary,2001:45-47.

[6]NOUAROULD-DRIS,ALI GANOUN,RAPHAEL CANALS.ImprovedObjectTracking withCamShiftAlgorithm[C]//IEEE International Conference on Acoustics,Speech and Signal Procession,2006:165-167.

[7]NUMMIAR O K,KOLLER-MEIER E,VAN GOOL L.An adaptive color-based particle filter[J].Image and Vision Computing,2003,21(1):99-110.

[8]COMANICIU D,RAMESH V,MEER P.Kernel based object tracking[J].IEEE Trans Pattern Analysis Machine Intelligence,2003,25(5):564-575.

[9]ALLEN J G.Object tracking using CamShift algorithm and multiple quantizedfeature space[C]//Proceedingsof 2003 Pan-Sydney Area Workshop onVisual Information Processing.Darlinghurst,Australia:Australian Computer Society,2004:3-7.

[10]COMANICIU D,RAMESH V,Meer P.Kernel-based object tracking[J].PAMI,2003,5:564-577.