基于雷视融合的ADB灯控系统设计与实现

2024-09-25李辉郭得岁梁梦颢王朝阳李靖

【摘 要】针对传统基于相机的ADB灯控系统单目摄像头在雨、雪、雾天气存在识别不清和检测率低的问题,文章设计一种基于雷视融合的车载ADB灯控系统。该系统可以实现夜晚自适应控制远光灯的开闭,减少交通事故的发生,并且雷达数据的引入增强了数据源的可靠性,使得该系统在雨、雪、雾等不良天气下亦可正常工作,增强了系统的鲁棒性。

【关键词】雷视融合;ADB;目标检测;场景识别;智能控制

中图分类号:U463.675 文献标识码:A 文章编号:1003-8639( 2024 )09-0037-04

The Design and Implementation of the ADB Lamp Control System Based on Radar and Vision Fusion

LI Hui1,GUO Desui1,LIANG Menghao1,WANG Chaoyang1,LI Jing2

(1. Industrial Research Institute of Henan Tianhai Electric Appliance Co.,Ltd.,Hebi 458031,China;2. College of Communication Engineering,Xidian University,Xi′an 710071,China)

【Abstract】In response to the problems of unclear recognition and low detection rate of monocular cameras in traditional camera based ADB light control systems in rainy,snowy,and foggy weather,this paper designs an onboard ADB light control system based on lightning vision fusion. With this system,it is possible to achieve adaptive control of the high beam lights at night,reducing the occurrence of traffic accidents. The introduction of radar data enhances the reliability of the data source,allowing the system to operate normally in adverse weather conditions such as rain,snow,and fog,enhancing the robustness of the system.

【Key words】rayleigh fusion;ADB;target detection;scene recognition;intelligent control

1 引言

自适应远光灯系统(Adaptive Driving Beam,ADB)是一种能够根据行驶场景变换远光光束开关与投影的远光灯控制系统。它在保证自车驾驶员视野良好的前提下,通过控制远光灯来减少对其他道路使用者造成的眩目。

ADB系统能够根据自车行驶状态以及道路车辆状态,智能开启和关闭远光灯,根据摄像头等传感器识别出现的车辆、行人等目标,单独控制(开闭或亮度调节)灯珠矩阵中的灯珠,自适应变换光形,以避免对道路上行人或对向来车驾驶员造成眩目,实现实时动态调节[1-2]。ADB的主要解决方案可以分为遮光板式、LED矩阵熄灭式和反射面矩阵式3种[3]。反射面矩阵式通过每个LED光源反射不同部分的光形,从而在道路上形成组合叠加的光束投影[4]。本文采用的LED矩阵熄灭式依靠控制高分辨率LED灯珠的亮灭来实现光束分区照明。当前最流行并呈现出持续快速增长趋势的汽车照明光源是LED前照灯[5]。2018年左右,LED已经超越氙气灯得到更广泛的应用,逐渐成为主流。LED车灯模组可以为道路照明提供适合远近光的各种光型[6]。

保障夜间以及雨雾天气的驾驶安全一直都是汽车前照灯的根本任务。不仅要提供高效、充足的照明,也要防止对其他道路使用者造成眩目。因此,深入研究ADB系统以及提升ADB系统的可靠性和鲁棒性在交通安全建设方面具有重要意义。

针对传统车载ADB系统存在的问题,本文引入毫米波雷达,并设计一种基于雷视融合的数据采集处理系统,该系统主要特点如下。

1)该系统采用摄像头和毫米波雷达分别采集数据,在视觉数据的基础上增加雷达提供的世界坐标数据作为辅助,从源头上大大增加了数据的可靠性和稳定性。

2)该系统对图像数据采用先进深度学习算法进行行人检测,并对相机进行标定,将真实世界坐标转换至图像坐标,为雷达数据和图像数据提供了有效的融合前提。

3)该系统对雷达数据和图像数据进行了对比、匹配和融合,分别排除了摄像头误检和雷达误检的目标,提高了目标检测的准确率,在效果上提升了系统的可靠性和灯控决策信息的精确度。

系统在设计时以实现对灯珠的准确控制为目标,以数据信息采集、转换和融合为核心,实现一种能实时采集数据、检测目标并控制LED灯珠矩阵的车载ADB灯控系统,为夜间安全驾驶提供可靠支撑。

2 系统总体设计

ADB系统分为数据采集、数据处理和数据发送3个模块,如图1所示。

1)数据采集模块:由摄像头和毫米波雷达构成,分别采集视频图像数据和毫米波雷达数据。

2)数据处理模块:NVIDIA Jetson Xavier NX处理器处理来自摄像头的图像数据和雷达的三维空间数据。这两种数据的结合为系统提供了一个全面的视角,确保在各种周边环境条件下都能准确检测到行人和车辆。

标定是ADB灯控系统的关键步骤。通过标定,数据处理模块能够理解摄像头和雷达数据与实际物理世界之间的关系。这确保了当数据采集模块检测到行人时,它能够准确计算出行人与车辆之间的距离和角度。基于这些计算,灯控模块可以自动调整车辆的灯光角度和强度,确保行人被正确照亮,同时避免对其他驾驶员造成眩光。为了确保系统的稳定性和可靠性,数据处理模块还包括了专门的CAN设备驱动和摄像头驱动。这些驱动确保所有的硬件组件都能够无缝地与处理器协同工作。ADB灯控系统标定的解决方案是一个结合了最新技术和创新设计的系统,它为现代交通安全提供了一个重要的工具,确保在夜间或低光照环境下行人的安全。

3)数据显示和发送模块:由NVIDIA Jetson Xavier NX处理器处理完数据之后通过CAN总线发送给下级灯控模块来控制灯珠矩阵的开闭,图像通过HDMI传输至显示器。

3 系统硬件设计

基于雷视融合的ADB系统硬件方案架构如图2所示。该架构通过雷达和相机采集数据,雷达数据通过CAN总线将位置信息传给ADB决策模块,摄像头采集的图像数据通过同轴线传给ADB决策模块。ADB决策模块将雷达获取的信息流与相机摄像头获取的视频流进行融合匹配,提高目标信息的准确性。NVIDIA Xavier处理器计算其他车辆与自身的相对物理位置信息,包括真实距离、相对角度。根据距离和角度计算矩阵灯珠灯控信息,并通过CAN总线发给ADB灯控模块,控制模块通过相应的操作实现矩阵灯珠的部分区域开闭。

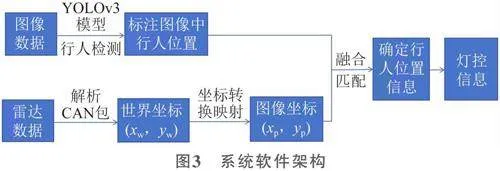

4 系统软件设计

系统软件架构如图3所示。设计一个先进的雷视融合行人检测框架,主要包括图像数据处理、雷达数据处理和雷达视频数据融合。

如图3所示,相机采集的图像数据通过YOLOv3算法检测出图像中存在的车辆和行人,通过对CAN包进行解析获取雷达数据,将雷达数据通过坐标系的转换映射到图像数据上,在图像上对雷达数据和视频数据进行匹配融合实现更精确定位,根据定位数据下发灯控信息,实现ADB自适应开闭。

4.1 雷达数据处理模块

该模块主要完成雷达数据的接收和雷达数据CAN包解析。毫米波雷达返回的CAN报文中包含目标序列号、目标与雷达之间的相对径向距离(Range)、相对运动速度(Verl)、方位角(Azimuth)、反射截面积(RCS)和信噪比(SNR)等信息,但CAN报文中的各字段并不直接表示所需信息的真实值,需要对各字段进行解析才可获得真实数值。解析公式见表1。

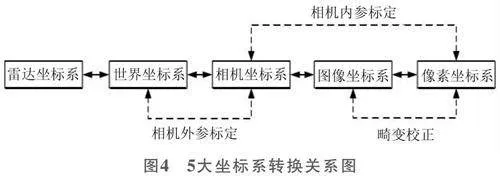

4.2 相机标定模块

为了实现将雷达扫描数据点投影到像素坐标系中,促进雷达和相机信息融合,需实现如图4所示5大坐标系之间的转换关系。

在这个模块,参照张正友黑白棋盘格[7]标定算法完成相机标定,实现5大坐标系之间的相互转换,雷达扫描数据点与像素坐标系的映射。

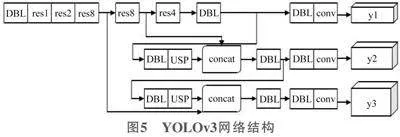

4.3 图像数据处理模块

YOLOv3[8]是一个经过YOLOv1、YOLOv2改进的基于回归的网络,并且在保证精度的前提下,运行的速度也很快,可以达到实时检测的要求,而且还增强了对尺寸比较小的物体的识别检测能力。YOLOv3的先验检测系统重复使用分类器或定位器来执行检测任务。YOLOv3的网络结构如图5所示。

通过相机采集图像,利用YOLOv3网络输出检测物体在图像上的位置信息以及类别信息,根据以上信息在图像上进行画框展示,实现实时目标检测。

4.4 毫米波雷达数据与视觉数据时间同步算法

毫米波雷达和摄像头数据在进行空间上的标定之后,由于这2个传感器工作在不同的时间频率,并且在传感器间数据通信的过程中存在延迟情况,毫米波雷达的采样帧频率为20帧/s,而摄像机的采样帧频率为30帧/s,所以不一致的采样频率导致传感器采集到的数据并非每一帧都能有效对应,因此将同一目标的雷达坐标和视频检测数据进行时间同步是提高目标融合跟踪精度的关键。

采用最近邻帧匹配算法实现时间同步。首先分别获取带有时间戳的毫米波雷达数据和图像帧数据,提取其时间戳并减去相对应的平均时延,然后进行雷达数据与图像帧数据的最近邻匹配,如图6所示。

设图像数据帧集合定义为:

(1)

雷达数据帧集合定义为:

(2)

其中,图像数据帧和雷达点云帧集合时间戳分别为:

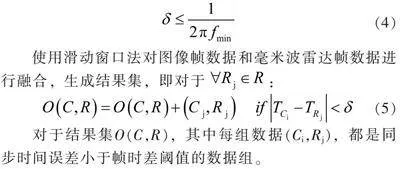

由于摄像机时钟和毫米波雷达时钟与主机时钟并非完全同步,存在延时。因此,设摄像机时钟与主机时钟平均延时为δC,毫米波雷达时钟与主机时钟平均延时为δR。由于图像数据帧率fc和毫米波雷达帧率fr的差异,选取较低帧率传感器,其帧率记为fmin,设置帧时差阈值Tth表示帧同步时间精确度,满足

使用滑动窗口法对图像帧数据和毫米波雷达帧数据进行融合,生成结果集,即对于 :

对于结果集O(C,R),其中每组数据(Ci,Rj),都是同步时间误差小于帧时差阈值的数据组。

4.5 毫米波雷达与视觉信息融合模块

由于需要对相机获得的目标类别信息和毫米波雷达获得的目标距离和速度信息进行融合,二者数据类型不一样,且考虑到检测实时性的要求,数据融合时的计算量不能太高,所以采用决策层融合。

在完成5大坐标系的关联、相机标定和数据时间同步之后,即可将毫米波雷达扫描点投影至像素坐标系中,而相机检测结果可以输出其包围框4个角点的像素坐标信息,因此可根据雷达扫描点在像素坐标系中的投影点是否在目标包围框内来对毫米波雷达检测结果与相机检测结果进行匹配。设某一目标包围框4个角点的像素坐标分别为(u1,v1)、(u1,v2)、(u2,v1)和(u2,v2),雷达扫描点投影至像素坐标系的坐标为(ur,vr),由于雷达安装位置相较于相机而言偏低,因此其扫描点在像素坐标系中的投影点一般不会位于目标包围框中心,但其一定位于包围框内部,因此可设定判定规则为:u1<ur<u2且v1<vr<v,对符合判定规则的目标进行信息融合处理,同时输出其类别、速度和距离信息。对不符合上述判定规则的目标,不进行融合处理。在像素坐标系中,若目标包围框内部未匹配到雷达投影点,则雷达漏检该目标,仅输出其类别信息;若雷达投影点未在其周围匹配到目标包围框,则相机漏检该目标,仅输出其速度和距离信息。

4.6 下发灯控信息模块

在完成前5步的基础上,已经实现了毫米波雷达与相机信息流的交互融合,对符合判定规则的目标获取其原始雷达数据与视频数据用来计算与自车的夹角,设相机设备在图像像素上的坐标为(x0,y0),以雷达数据为标准,雷达数据在图像像素上的坐标为(xr,yr),夹角θ=arctan,依次计算出毫米波雷达与相机视频流每帧匹配上的物体对应的夹角θ,最后对所有物体对应的夹角θ求并集,得到这一帧数据对应的夹角θfinal=U(θ1,θ2,…,θn),其中U()表示求并集,例如θ1是10°~20°,θ2是15°~30°,那么U(θ1,θ2)为10°~30°。

通过上文模块计算得到了车辆与自车的夹角,根据预先设置好的夹角与ADB矩阵灯珠控制信息之间的对应关系,选择相应的ADB矩阵灯珠控制信息,通过CAN总线发给ADB灯控模块,该模块执行相应的操作实现ADB矩阵灯珠远近光切换控制。

5 系统运行及分析

本系统在走廊、空旷地带和实际车道中进行了多次测试。具体测试中,在走廊进行了行人检测测试,相机和毫米波雷达采集相应数据,通过HDMI在显示器上进行显示,没有增加毫米波雷达数据,如图7所示,其中红色方框表示经过YOLOv3算法检测的结果,可以看出存在误检的情况,会下发给灯控模块错误信息,导致灯珠关闭不精确。增加毫米波雷达数据的结果如图8所示,其中红色方框表示经过YOLOv3算法检测的结果,绿色小点(图中行人图像双腿之间膝盖高度处)表示毫米波雷达数据映射到图像上的结果,通过将毫米波雷达数据与视频数据融合,能够剔除掉误检的椅子,提高系统定位的精确性,进而下发准确的灯珠关闭信息。在多次测试中,考虑到灯珠关闭的准确性和实时性,从测量结果可以看出基于雷视融合的ADB灯控系统相比传统ADB灯控系统具有更高的精准度,同时也能满足实时性要求。

6 结束语

相对于传统的ADB灯控系统,本文提出基于雷视融合的ADB自适应灯控系统,从系统架构出发,在传统架构上增加了毫米波雷达。通过雷达和相机对道路路况进行数据采集和数据融合处理,不仅能够实现灯光自适应,而且在之前的基础上提高了目标定位精度,进而使得灯珠开闭更加精确。同时也克服了传统ADB灯控系统在雨雾天气下由于相机采集图像数据存在模糊,导致灯珠自适应开闭不精确的问题。

参考文献:

[1] 朱光欢. 一种智能前大灯控制系统[J]. 科技视界,2015(34):113,116.

[2] 黄连生. ADB自适应远光灯系统简介[J]. 轻工科技,2019,35(8):59-60.

[3] 杨三伟. ADB在汽车前大灯上的应用[J]. 科技资讯,2019,17(1):105,111.

[4] Luo Chengming,Xin Gaifang,Xu Han,et al. Glare-free high-beam control for oncoming vehicle safety in night time[J]. IEEE consumer electronics magazine,2020,10(2):8-15.

[5] Joseph Notaro. 汽车照明从昏暗而遥远的过去到光明、智慧的未来[J]. 传感器世界,2021,27(2):34-35.

[6] 文醉,赵斌,何云堂,等. 几种典型汽车前照灯用光源的性能试验研究[J]. 照明工程学报,2014,25(5):116-119.

[7] Zhengyou Zhang. A Flexible New Technique for Camera Calibration[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,22(11):1330-1334,2000.

[8] Redmon J,Farhadi A. YOLOv3: An incremental improvement[DB/OL]. arXiv e-prints,2018.(2018-04-08).https://arxiv.org/abs/1804.02767.

(编辑 杨凯麟)

作者简介李辉(1982—),男,工程师,硕士,主要从事汽车电子电器系统(连接与传输)零部件研发及新型电子电气架构下汽车电子电器新技术研究与新产品开发工作。