基于NSCT结合显著图与区域能量的红外与可见光图像融合

2024-02-02牛振华邢延超林英超王晨轩

牛振华,邢延超,林英超,王晨轩

基于NSCT结合显著图与区域能量的红外与可见光图像融合

牛振华,邢延超,林英超,王晨轩

(青岛理工大学 信息与控制工程学院,山东 青岛 266520)

针对传统的红外与可见光图像融合出现的清晰度和对比度偏低,目标不够突出的问题,本文提出了一种基于Non-subsampled Contourlet(NSCT)变换结合显著图与区域能量的融合方法。首先,使用改进的频率调谐(Frequency-tuned, FT)方法求出红外图像显著图并归一化得到显著图权重,单尺度Retinex(Single-scale Retinex, SSR)处理可见光图像。其次,使用NSCT分解红外与可见光图像,并基于归一化显著图与区域能量设计新的融和权重来指导低频系数融合,解决了区域能量自适应加权容易引入噪声的问题;采用改进的“加权拉普拉斯能量和”指导高频系数融合。最后,通过逆NSCT变换求出融合图像。本文方法与7种经典方法在6组图像中进行对比实验,在信息熵、互信息、平均梯度和标准差指标中最优,在空间频率中第一组图像为次优,其余图像均为最优结果。融合图像信息量丰富、清晰度高、对比度高并且亮度适中易于人眼观察,验证了本文方法的有效性。

图像融合;Non-subsampled Contourlet变换;区域能量自适应加权;拉普拉斯能量和

0 引言

为了应对不同拍摄场景的需求,发展出了多种多样的图像传感器。虽然传感器种类众多,但是只能使用单一的图像传感器拍摄一种类型的图像,例如红外图像中不具备可见光图像的特征。对于此种局限性科研工作者开始研究多传感器图像融合技术,从而得到包含多种显著特征信息的图像,丰富了使用单一传感器所成图像的信息。近年来学者们对红外图像和可见光图像融合技术的研究越来越多,特别是在环境感知和视频监控领域[1]。

红外传感器的成像原理是捕获物体散发红外线的辐射量,目标物体辐射量越大所成的图像就越明亮。由于环境背景的温度较低,根据红外传感器的特性,背景图像较暗存在分辨率低和信息丢失的问题。可见光传感器的成像原理与光照强度有关,光线越强所成的图像就越清晰,具有高分辨率、纹理信息和细节信息丰富的特点。缺点是照明条件不良时图像质量较差。所以迫切需要将两种图像的优点进行融合,得到信息丰富、特征显著的融合图像,利于人类视觉感知与分析处理[2]。

目前图像融合的方法可以分为:变换域方法[3]、空间域方法[4]、深度学习方法[5]和其他方法[6]。基于多尺度变换的方法是变换域中的经典算法,如拉普拉斯金字塔(Laplacian pyramid, LP)[7]和离散小波变换(Discrete Wavelet Transform, DWT)[8]。近年来涌现了一些新的方法,如双树复小波变换(Dual-Tree Complex Wavelet Transform, DTCWT)[9]、曲波(Curvelet Transform, CVT)[10]、轮廓波变换(Contourlet Transform)[11]和非下采样轮廓波变换(Non-subsampled Contourlet Transform, NSCT)[1,12-13]被引入图像融合。

金字塔变换易模糊,而小波中存在的共同缺点是不能有效地表示曲线和边缘。为了更准确地表示图像中的空间结构,研究者提出了用曲波基来表示图像[14]。除了曲波,轮廓波是另一种可以捕捉图像内在几何结构的变换,更适合处理二维信号[15]。Contourlet涉及下采样过程,没有移位不变性。NSCT解决了Contourlet的问题,具有良好移位不变性和方向选择性。

Zhai等[16]提出了一种以亮度为特征的全局对比度显著性检测算法(Luminance Contrast, LC),Achanta等人[17]提出了在频率域基于全局对比度的显著性检测方法(Frequency-tuned, FT)方法。同时视觉显著性检测也被成功应用在图像融合领域,并取得了较好的结果[18-19]。LC算法容易将非显著性区域判定为显著区域,FT算法使用了高斯差分滤波器,提取出的显著图像边缘保持能力下降,容易使融合图像产生伪影。

针对上述小波出现的问题,本文选择NSCT作为分解方法,并且利用双边滤波器(Bilateral Filter , BF)[20]的平滑功能和保边作用,对FT算法进行了优化。使用单尺度Retinex[21-23](Single-Scale Retinex, SSR)算法对可见光图像进行增强,提高图像的细节特征和亮度。针对区域能量权重易引入其他信息的问题,提出了一种结合显著图与区域能量权重的融合规则。

1 改进的FT算法与Retinex理论

1.1 Frequency-tuned算法

FT[17]显著性检测算法是一种基于频率调谐的方法。FT算法采用高斯差分(Difference of Gaussian, DoG)带通滤波的方法,高斯核大小选取为5×5,频率范围为(0,p/2.75]。获取红外图像显著图公式定义为:

式中:m为(,)平均值;whc(,)是(,)的高斯模糊;||×||为欧氏距离。

1.2 双边滤波器

双边滤波是一种非线性滤波器[20],由空间域滤波和值域滤波组成,同时考虑了像素间的空域信息和灰度相似性,达到了良好的平滑和保持边缘的效果。其数学定义式为:

式中:(,)为双边滤波后的图像;(,)为输入图像;(,)为以(,)为中心(2+1)×(2+1)的区域,为滤波半径;(,,,)是权重系数。通常将(,,,)定义为:

(,,,)=(,,,)(,,,) (3)

式中:(,,,)表示定义域核;(,,,)表示值域核:

式中:和为标准差,在灰度平坦区域进行高斯滤波,在边缘处值域核用来保持边缘。

1.3 红外显著图检测

由于FT算法使用高斯滤波,边缘信息会丢失,造成融合结果出现伪影和细节丢失的问题。本文提出采用双边滤波器来代替FT算法中的高斯差分滤波器,双边滤波器不仅保留了高斯平滑的作用还增强了边缘保持的能力,保留了原图像更多的细节信息。改进后的FT算法获取的显著图为:

式中:BF(,)表示输入图像经过双边滤波后在(,)处的灰度值;BF(,)表示红外图像的显著图。图1为LC算法[16]、FT算法[17]和本文算法得到的红外显著图。通过观察LC方法也会将很多背景信息判断为显著部分,FT方法要优于LC方法,本文方法既提取出了图1(a)中原图像目标人物的信息,又降低了背景的干扰保留了目标的边缘信息。并对显著图BF(,)进行归一化处理:

式中:BF|min是BF(,)最小值;BF|max是BF(,)最大值;norm(,)表示归一化后的值。

(a) 原图(a) Original image(b) LC方法(b) LC method (c) FT方法(c) FT method(d) 改进FT方法(d) Improved FT method (e) 归一化改进FT(e) Normalization of improved FT method

1.4 单尺度Retinex算法

由于可见光图像的质量与光照有关,雨天、雾天和光线不足时造成分辨率较低、细节轮廓不明显、图像质量较差。所以在图像融合中为了能获得质量较高的融合图像,需要对可见光图像预处理达到增强的效果。Retinex算法是Land等人[21]提出的,图像(,)由两个分量组成:反射分量(,)和照度分量(,)。图像(,)可以表示为:

(,)=(,)×(,) (8)

式中:(,)表示了图像的本质属性,可以通过(,)来估计(,)的值消除(,)对图像的影响,从而实现图像增强,通过两边取自然对数,单尺度Retinex可以表示为:

(,)=ln[(,)]-ln[(,)] (9)

式中:(,)表示SSR后的图像;(,)由(,)经过高斯平滑得到:

(,)=(,)*(,) (10)

式中:*表示卷积运算;(,)表示高斯滤波函数:

式中:表示高斯环绕尺度;是一个尺度,必须满足式(12):

实验中设为85,设为1。图2表示经过SSR增强后的可见光图像。

(a) 原图(a) Original image(b) SSR增强后的图像(b) SSR-enhanced image

从图2可以清楚地观察到经过SSR增强后的图像比原图像更加清晰,并且不会产生过度明亮的区域影响人眼的观察。

2 NSCT域图像融合

2.1 非下采样轮廓波变换

图3 NSCT分解示意图

2.2 算法流程和融合规则

2.2.1 算法流程

本文提出的基于NSCT变换结合显著图与区域能量自适应加权的红外图像与Retinex增强的可见光图像融合方法流程如图4所示,输入图像为红外图像IR(,)和可见光图像IV(,),输出为融合图像IF(,)。具体可以分为6步:

1)使用SSR获得增强的IVSSR(,)。

2)使用BF改进的FT计算红外图像的BF(,),对BF(,)归一化得到显著图的权重系数norm(,)。

4)低频系数融合:使用区域能量自适应加权算法计算IR(,)和IV(,)的权重,与norm(,)构建联合权重,根据新的权重计算IFlow(,)。

2.2.2 低频系数融合规则

低频系数代表了图像的整体轮廓,保留了大部分能量。因此,低频图像的融合结果对整幅图像的融合效果起到决定性的作用,效果好的低频图像的融合策略既能够保留图像的近似信息又保留了其中的细节信息。

图4 本文图像融合方法流程框图

基于低频部分包含有大量能量信息,所以低频融合规则选取区域能量自适应加权方法。又因为只需要提取红外图像中显著部分进行图像融合,尽可能多地去除背景信息的影响,能量高的地方可能是红外图像需要融合的地方,也有可能是某处背景信息,若引入到后面的融合过程,可能会造成最终的融合图像出现伪影或噪声,从而影响后续的观察与图像处理。因此,使用1.3节提出的改进FT算法计算红外图像显著图,排除大部分背景噪声的影响,并对红外显著图进行归一化处理,从而计算出显著部分占原始图像的比例是多少。再结合区域能量自适应加权方法计算出的红外图像与可见光图像每部分的权重,组成联合权重系数矩阵。

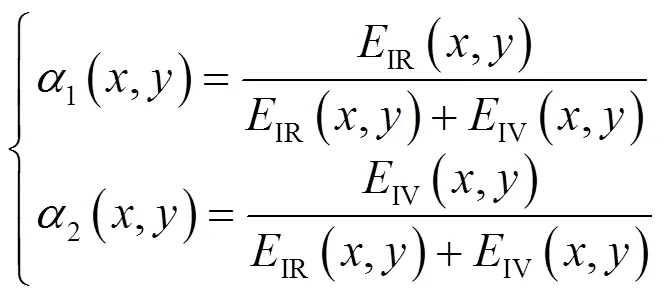

区域能量定义为:

式中:IR(,)和IV(,)代表IR和IV的能量;(,)为权重矩阵,窗口大小一般为3×3,(,)为:

定义1(,)和2(,)为区域能量自适应权重:

定义联合权重为IR(,)和IV(,),其数学公式定义为:

式中:分别定义1¢(,)=norm(,)+1(,)和2¢(,)=1-norm(,)+2(,)。

低频融合规则可以表示为:

IFlow(,)=IR(,)IRlow(,)+IV(,)IVlow(,) (18)

且IR(,)+IV(,)=1。本文提出的融合规则综合考虑了红外图像和可见光图像的显著性和区域能量的差异性,通过归一化红外图像的显著图得到显著图的概率分布,显著图的概率与红外图像的区域能量自适应权重组成联合权重,1-norm(,)则表示红外图像的非显著部分。两部分概率相互平衡,抑制了因单一融合规则引入的无效背景甚至噪声信息。

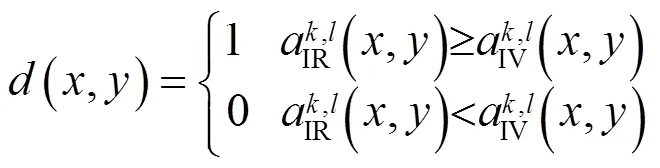

2.2.3 高频系数融合规则

高频子带图像表示边缘和纹理信息。高频融合一般用绝对值取大的策略。这种方案对噪声比较敏感,同时也有可能丢失一些重要信息。因为系数选择是基于绝对值,只比较单个系数而不考虑相邻系数。本文选择拉普拉斯能量和(Sum Modified Laplacian, SML)作为活动水平度量参数,SML是一种表征图像边缘特征的参数,能够反映图像的边缘信息。传统的修正拉普拉斯算子(Modified Laplacian, ML)只能计算邻域内水平和垂直方向上的系数,忽略了对角线上像素对图像的影响,本文选择ML算子局部窗口大小为3×3,由于对角线像素与中心点的距离之比为21/2,因此改进后的ML算子数学公式定义为:

式中:(,)表示源图像,改进的加权拉普拉斯能量和的数学定义为:

手机用户规模不断扩大。根据中国工商业研究所(China Business Industry Research Institute)2017-2022年发布的《中国第三方移动支付产业市场前景和投资机会研究报告》(Research Report)显示,截至2017年12月,中国移动电话用户总数已达到7.53亿。与2016相比,人群的比例增加了2.4%。

式中:ML是窗口加权系数矩阵,因为局部窗口中心灰度值对图像边缘起主要作用,定义ML为:

WSML计算每个高频子带的系数:

对(,)进行一致性校验得到最终的融合决策图F(,),通过在3×3窗口中的一致性验证使用多数过滤操作。也就是说,在每个3×3窗口,如果更多数量的系数来自图像A,而中心系数来自B,那么中心系数也来自图像A。否则它是保持原样,反之亦然。融合的高频子带如下所示:

3 实验分析

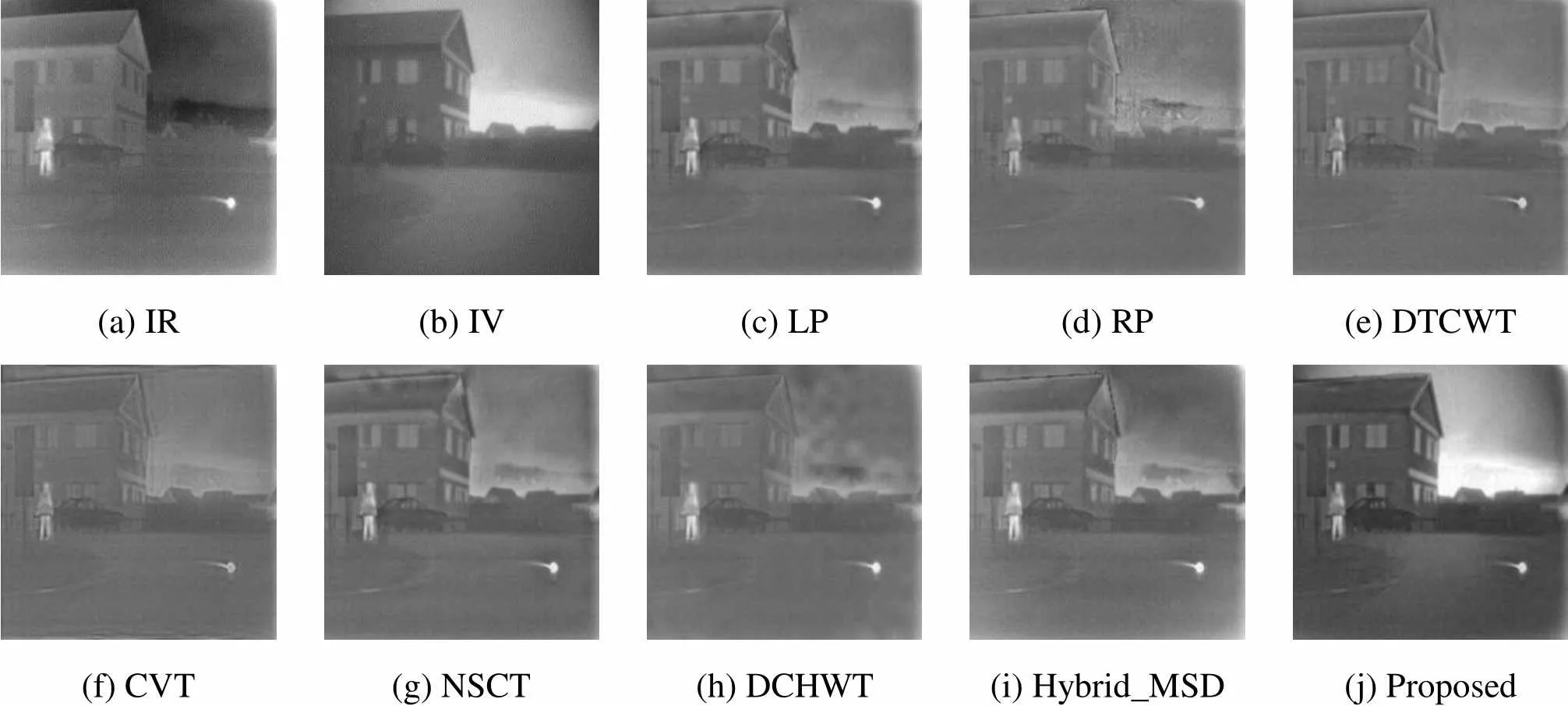

为了验证本文提出方法有效性,本文将与7种较经典的方法进行比较,其中包括文献[24]提到的5种方法:LP、RP(ratio of low-pass pyramid)、DTCWT(dual-tree complex wavelet)、CVT(curvelet transform)和NSCT,DCHWT[25]和Hybrid-MSD(hybrid multi-scale decomposition)[26]。选择TNO数据集[27]中的6组图像进行实验,其中的图像经过严格配准,6组图像分别记为:Nato_camp、Tree、Duine、APC_4、Kaptein_1654和Movie_18。

实验平台为:处理器是11th Gen Intel(R) Core(TM) i5-11400H @ 2.70GHz,16GB内存,Windows11操作系统。软件环境平台为MATLAB R2021b。改进FT算法中参数设为:窗口大小为5、d=3和r=0.2。SSR中设为85,设为1。NSCT分解层数设为4层,每一层的方向分解数为[2, 3, 3, 4],NSP滤波器设置为“pyrexc”,NSDFB设置为“vk”。图像全部调整为200×200像素。融合结果如图5~10所示。

(a) IR(b) IV(c) LP(d) RP(e) DTCWT (f) CVT(g) NSCT(h) DCHWT(i) Hybrid_MSD(j) Proposed

(a) IR(b) IV(c) LP(d) RP(e) DTCWT (f) CVT(g) NSCT(h) DCHWT(i) Hybrid_MSD(j) Proposed

(a) IR(b) IV(c) LP(d) RP(e) DTCWT (f) CVT(g) NSCT(h) DCHWT(i) Hybrid_MSD(j) Proposed

(a) IR(b) IV(c) LP(d) RP(e) DTCWT (f) CVT(g) NSCT(h) DCHWT(i) Hybrid_MSD(j) Proposed

(a) IR(b) IV(c) LP(d) RP(e) DTCWT (f) CVT(g) NSCT(h) DCHWT(i) Hybrid_MSD(j) Proposed

(a) IR(b) IV(c) LP(d) RP(e) DTCWT (f) CVT(g) NSCT(h) DCHWT(i) Hybrid_MSD(j) Proposed

3.1 主观评价

从图5~10中可以看出,7种对比方法和本文提出的方法都基本提取出了红外目标并完成了图像融合的目标。从6组融合图像整体效果中,融合图像的对比度、亮度和清晰度都有提升,其中,Tree、Duine、APC_4和Movie_18提升尤为明显。

在Nato_camp中本文方法融合图像红外目标比LP、RP、DTCWT、CVT和NSCT亮度更强,比DCHWT和Hybrid_MSD的分辨率更高,树木草丛的纹理更加明显。在Tree中树木轮廓与地面差异明显,能够清楚分辨出树与地面的位置关系,保留了可见光图像的特征且增强了可见光图像的亮度、对比度和清晰度。Duine的融合结果与Tree的结果类似,都提高了融合图像的亮度、对比度和清晰度。在APC_4中亮度和清晰度得到提升,较其他方法保留了更多可见光图像的细节信息,土地和灌木比其他方法要清晰和明亮,提高了图像的分辨率。在Kaptein_1654中本文方法比其他方法红外目标更明显,左下角植物细节明显好于其他方法的融合图像。在Movie_18中房子侧面和正面都要比其他方法的结果更清晰,对比度更高,车子更加明显,虽然红外目标亮度低于Hybrid_MSD方法,但是本文方法的融合图像整体的亮度、清晰度和对比度更高,地面轮廓分明。

综上,本文方法的融合图像清晰度和对比度更高,整体亮度适中,更加适合人眼的观察。

3.2 客观评价

本文选用文献[28]中的5种客观评价标准作为本文方法的综合评价指标,其中包括:信息熵(Information Entropy, IE)[28]、空间频率(Spatial Frequency, SF)[28]、互信息(Mutual Information, MI)[28]、平均梯度(Average Gradient, AG)[28]和标准差(Standard Deviation, SD)[28]。文献[28]指出信息熵、空间频率和互信息值越大包含的信息量越多。平均梯度表征细节信息,值越大图像边缘和细节融合效果越好。标准差体现了某一点灰度值对于整体的分布性,值越大图像容纳的信息越丰富,图像的质量越好。

综上,这5种评价指标值越大融合效果越好。6组融合图像的客观评价结果如表1~6所示,并将最好的结果加粗显示。由表1~6可知,相比于其他对比的方法,本文方法的结果均在所有评价结果中有所提升,其中,本文提出的方法在后5组图像的评价结果均为最优。在Tree、Duine、APC_4和Movie_18图像中,5项指标的提升尤为明显,在Kaptein_1654图像中,在SF指标中较次优值略有提升,对比其他方法提升幅度较大,在IE、MI、AG和SD中提升幅度较大。在Nato_camp图像中本文方法的SF值低于Hybrid_MSD方法,但其他结果仍是最优的。

通过主观评价和分析表1~6中的评价结果,表明了本文方法得到的融合图像纹理和细节信息量更丰富,清晰度和对比度更高,而且比单一的NSCT方法性能均有提升,验证了本文所提方法的有效性和正确性。

表1 Nato_camp客观评价结果

表2 Tree评价结果

表3 Duine客观评价结果

表4 APC_4客观评价结果

表5 Kaptein_1654客观评价结果

表6 Movie_18客观评价结果

4 结语

本文提出了一种基于NSCT变换的图像融合方法。首先使用SSR增强可见光图像。在FT方法的基础上,使用了边缘保持效果更好的双边滤波器计算红外图像显著图,抑制了融合边缘产生的伪影,并结合区域能量自适应加权设计了新的低频融合规则构造新的融合权重,显著图的加入可以抑制由区域能量自适应加权所引入的红外图像的背景和噪声。高频系数融合采用改进的“加权拉普拉斯能量和”,该方法增加了水平与对角线像素的权重,而传统的拉普拉斯能量和只有水平垂直方向,改进的方法边缘细节保持能力更强。实验结果表明,在主观评价和客观评价方面,本文提出的方法显著优于其他7种方法,融合图像具有亮度适中、清晰度高和对比度高的特点,说明了本文方法正确和有效。

[1] 杨孙运, 奚峥皓, 王汉东, 等. 基于NSCT和最小化-局部平均梯度的图像融合[J]. 红外技术, 2021, 43(1): 13-20. YANG Sunyun, XI Zhenghao, WANG Handong, et al. Image fusion based on nsct and minimum-local mean gradient[J]., 2021, 43(1): 13-20.

[2] 肖中杰. 基于NSCT红外与可见光图像融合算法优化研究[J].红外技术, 2017, 39(12): 1127-1130.

XIAO Zhongjie. Improved infrared and visible light image fusion algorithm based on NSCT[J]., 2017, 39(12): 1127-1130.

[3] ZHANG B, LU X, PEI H, et al. A fusion algorithm for infrared and visible images based on saliency analysis and non-subsampled Shearlet transform[J]., 2015, 73: 286-297.

[4] ZHOU Z, WANG B, LI S, et al. Perceptual fusion of infrared and visible images through a hybrid multi-scale decomposition with Gaussian and bilateral filters[J]., 2016, 30: 15-26.

[5] MA J, YU W, LIANG P, et al. Fusion GAN: A generative adversarial network for infrared and visible image fusion[J]., 2019, 48: 11-26.

[6] ZHANG Y, ZHANG L, BAI X, et al. Infrared and visual image fusion through infrared feature extraction and visual information preservation[J]., 2017, 83: 227-237.

[7] Mertens T, Kautz J, Reeth F V. Exposure fusion[C]//, 2007: 382-390.

[8] ZHANG Z, Blum R S. A categorization of multiscale-decomposition-based image fusion schemes with a performance study for a digital camera application[C]//, 1999, 87(8): 1315-1326.

[9] Lewis J J, Callaghan R J O, Nikolov S G, et al. Pixel- and region-based image fusion with complex wavelets[J]., 2007, 8(2): 119-130.

[10] Nencini F, Garzelli A, Baronti S, et al. Remote sensing image fusion using the curvelet transform[J]., 2007, 8(2): 143-156.

[11] YANG S, WANG M, JIAO L, et al. Image fusion based on a new contourlet packet[J]., 2010, 11(2): 78-84.

[12] Cunha A L, ZHOU J P, DO M N. The nonsubsampled Contourlet transform: theory, design, and applications [J]., 2006, 15(10): 3089-3101.

[13] 郭明, 符拯, 奚晓梁. 基于局部能量的NSCT域红外与可见光图像融合算法[J]. 红外与激光工程, 2012, 41(8): 2229-2235.

GUO Ming, FU Zheng, XI Xiaoliang. Novel fusion algorithm for infrared and visible images based on local energy in NSCT domain[J]., 2012, 41(8): 2229-2235.

[14] Cands E J, Donoho D L. Curvelets and curvilinear integrals[J]., 2001, 113(1): 59-90.

[15] DO M N, Vetterli M. Contourlets: a directional multiresolution image representation[C]//, 2002, 1: I-357-I-360.

[16] ZHAI Y, SHAH M. Visual attention detection in video se-quencesusing spatiotemporal cues[C]//14, 2006: 815-824.

[17] Achanta R, Hemami S, Estrada F, et al. Frequency-tuned salient region detection[C]//, 2009: 1597-1604.

[18] 叶坤涛, 李文, 舒蕾蕾, 等. 结合改进显著性检测与NSST的红外与可见光图像融合方法[J]. 红外技术, 2021, 43(12): 1212-1221.

YE Kuntao, LI Wen, SHU Leilei, LI Sheng. Infrared and visible image fusion method based on improved saliency detection and non-subsampled shearlet transform[J]., 2021, 43(12): 1212-1221.

[19] 唐中剑, 毛春. 基于显著导向的可见光与红外图像融合算法[J]. 太赫兹科学与电子信息学报, 2021, 19(1): 125-131

TANG Zhongjian, MAO Chun. Visible and infrared image fusion algorithm based on saliency guidance[J]., 2021, 19(1): 125-131.

[20] 王惠琴, 吕佳芸, 张伟. 基于双边滤波-BM3D算法的GPR图像去噪[J]. 兰州理工大学学报, 2022, 48(1): 91-97.

WANG Huiqin, LYU Jiayun, ZHANG Wei. GPR image denoising based on bilateral filtering BM3D algorithm[J]., 2022, 48(1): 91-97.

[21] Edwin H Land. The retinex theory of color vision [J]., 1977, 237(6): 108-129.

[22] 程铁栋, 卢晓亮, 易其文, 等. 一种结合单尺度Retinex与引导滤波的红外图像增强方法[J]. 红外技术, 2021, 43(11): 1081-1088.

CHENG Tiedong, LU Xiaoliang, YI Qiwen, et al. Research on infrared image enhancement method combined with single-scale retinex and guided image filter[J]., 2021, 43(11): 1081-1088.

[23] 翟海祥, 何嘉奇, 王正家, 等. 改进Retinex与多图像融合算法用于低照度图像增强[J]. 红外技术, 2021, 43(10): 987-993.

ZHAI Haixiang, HE Jiaqi, WANG Zhengjia, et al. Improved Retinex and multi-image fusion algorithm for low illumination image enhancemen[J]., 2021, 43(10): 987-993.

[24] LIU Y, LIU S, WANG Z. A general framework for image fusion based on multi-scale transform and sparse representation[J]., 2015, 24: 147-167.

[25] Kumar B. Multifocus and multispectral image fusion based on pixel significance using discrete cosine harmonic wavelet transform[J]., 2013, 7: 1125-1143.

[26] ZHOU Z, BO W, SUN L, et al. Perceptual fusion of infrared and visible images through a hybrid multi-scale decomposition with Gaussian and bilateral filters[J]., 2016, 30: 15-26.

[27] Toet Alexander. TNO image fusion dataset[EB/OL]. 2014, https://doi.org/10.6084/m9.figshare.1008029.v1.

[28] 张小利, 李雄飞, 李军. 融合图像质量评价指标的相关性分析及性能评估[J]. 自动化学报, 2014, 40(2): 306-315.

ZHANG Xiaoli, LI Xiongfei, LI Jun. Validation and correlation analysis of metrics for evaluating performance of image fusion[J]., 2014, 40(2): 306-315.

Infrared and Visible Image Fusion Based on NSCT Combined with Saliency Map and Region Energy

NIU Zhenhua,XING Yanchao,LIN Yingchao,WANG Chenxuan

(School of Information and Control Engineering, Qingdao University of Technology, Qingdao 266520, China)

To address the problems of low clarity and contrast of indistinct targets in traditional infrared and visible image-fusion algorithms, this study proposes a fusion method based on non-subsampled contourlet transform (NSCT) combined with a saliency map and region energy. First, an improved frequency-tuning (FT) method is used to obtain the infrared image saliency map, which is subsequently normalized to obtain the saliency map weight. A single-scale retinex (SSR) algorithm is then used to enhance the visible image. Second, NSCT is used to decompose the infrared and visible images, and a new fusion weight is designed based on the normalized saliency map and region energy to guide low-frequency coefficient fusion. This solves the problem of region-energy adaptive weighting being prone to introducing noise, and the improved "weighted Laplace energy sum" is used to guide the fusion of high-frequency coefficients. Finally, the fused image is obtained by inverse NSCT. Six groups of images were used to compare the proposed method with seven classical methods. The proposed method outperformed others in terms of information entropy, mutual information, average gradient, and standard deviation. Regarding spatial frequency, the first group of images was second best, and the remaining images exhibited the best results. The fusion images displayed rich information, high resolution, high contrast, and moderate brightness, demonstrating suitability for human observation, which verifies the effectiveness of this method.

image fusion, Non-subsampled Contourlet Transform, adaptive weight of regional energy, sum modified Laplacian

V271.4;TP391

A

1001-8891(2024)01-0084-10

2022-03-22;

2022-05-11.

牛振华(1996-),男,硕士研究生,主要从事图像处理方面的研究。E-mail: 2215176247@qq.com。

邢延超(1973-),男,博士,副教授,研究方向为数字信号处理,水声通信技术。E-mail:9609891@qq.com。

山东省自然科学基金(ZR2021MF101)。