基于智能进化算法的可见水印对抗攻击*

2024-01-24季俊豪张玉书赵若宇温文媖

季俊豪,张玉书,赵若宇,温文媖,董 理

(1.南京航空航天大学计算机科学与技术学院,江苏 南京 211106; 2.江西财经大学信息管理学院,江西 南昌 330032;3.宁波大学信息科学与工程学院,浙江 宁波 315000)

1 引言

近年来,神经网络在许多领域取得了巨大的成功,引起了广泛的关注。然而,最近的一些研究成果[1-8]表明,神经网络容易受到对抗样本中的攻击,这种攻击通过对模型输入进行细微的扰动,导致神经网络分类错误。水印对抗样本[7,8]是对抗样本中的一种特例,它将特定的水印作为扰动嵌入到图像中误导神经网络模型,这对神经网络的普及和应用造成了巨大的威胁。如图1所示,在德牧图像中添加透明度为0.3的伯克利分校校徽,ResNet 101(Residual Neural Network with 101 layers)将生成的图像错误地分类为枪口。

Figure 1 An example of neural network classification misled by watermarking(top confidence score)图1 神经网络分类被水印误导的示例(最高置信度)

水印是添加在不同图像上的文本或图案。根据视觉效果的不同,水印分为可见水印和不可见水印。可见水印是一种在数字媒体上直接可见的水印,通常包括文字、图像或标志等,用于声明图像来源或者美化图像,并且已被证明可见水印对压缩、旋转等防御措施具有鲁棒性[8]。不可见水印通常由一些不可察觉的数字信号组成,常用于验证数字内容的来源和完整性。随着公民版权意识的提高,含有水印的图像在日常生活中越来越多。如何使神经网络分类器对这些图像具有鲁棒性成了一大难题。

对抗训练是解决这个问题最有效的防御措施之一。这种方法通过不断输入水印对抗样本并执行对抗训练,从而不断提升神经网络的鲁棒性。然而,对抗训练的成本较高,为了保证有效性,需要使用大量高强度的水印对抗样本。现有的方法[7,8]使用可见水印对抗攻击来生成高强度的水印对抗样本。但是,这些方法无法自动地设置约束条件,且没有考虑生成样本的视觉效果。为此,本文提出了一种基于智能进化算法的可见水印对抗攻击方法。该方法将可见水印对抗攻击问题转化为求解约束非凸优化问题,不仅能快速地生成水印对抗样本,而且还能使生成的水印对抗样本最大程度地攻击神经网络。具体来说,本文主要采用遗传算法来生成水印对抗样本。首先对水印进行图像变换(缩放、旋转等),之后采用Alpha-blending技术将变换后的水印嵌入到原始图像中,最后使用神经网络对生成的图像进行预测,并进行迭代优化,选择出能最大程度影响预测结果的参数。为了控制水印对抗样本的视觉效果,本文方法还引入了图像质量评价指标来约束图像的视觉损失。值得注意的是,本文提出的方法是一种基于置信度的方法,属于黑盒攻击,只需获取神经网络分类器输出的类别和置信度就能生成水印对抗样本。相较于现有的方法,本文提出的方法能够根据设定的视觉损失约束,自动地调整嵌入水印的参数,不需要人工设定参数的约束边界,具有更高的效率。

水印对抗攻击生成的水印对抗样本不仅适用于对抗训练,而且在现实场景中具有广泛的应用和意义。例如,一些恶意软件可能会使用神经网络模型来获取特定类别的图像。由于本文方法属于黑盒攻击,通过在图像中嵌入可见水印,可以在一定程度上阻止恶意软件的识别,且生成的图像具有可见水印的一些特性。

2 相关概念

2.1 对抗攻击与防御

对抗攻击指的是针对深度学习模型的攻击,通过对输入样本添加一些微小的扰动,使模型产生分类错误或误判的结果。这些扰动通常是不可见或人类难以察觉的,但足以改变模型的输出。与之相对应的是对抗防御。对抗防御是指对抗攻击的一种应对措施,其目的是提高深度学习模型的鲁棒性,使其能够在受到对抗攻击时仍能够输出正确的结果。对抗攻击和对抗防御的研究,对于提高深度学习模型的鲁棒性、可靠性和安全性具有重要意义。

2.1.1 对抗攻击

对抗攻击可以根据攻击者所拥有的信息分为白盒攻击和黑盒攻击。白盒攻击[2-5]是指攻击者拥有目标模型的全部信息,包括模型结构、权重参数和训练数据等。黑盒攻击[6-8]是指攻击者只能通过输入和输出来了解目标模型的行为,无法直接获取模型的内部信息。在实际应用中,黑盒攻击是比较常见的攻击方式,因为攻击者通常无法获得完整的模型信息。对抗功击还可以根据攻击者的目标分为目标攻击[2-4]和无目标攻击[5-8]。目标攻击是指攻击者有一个特定的目标,例如将一幅被分类为猫的图像误导成被分类为狗的图像。无目标攻击是指攻击者没有明确的目标,只是试图使得模型出现误分类。

Szegedy等人[2]发现神经网络很容易受到对抗攻击的影响。2014年,Szegedy等人[2]提出了对抗样本的概念,他们的研究表明,即使是精心设计的神经网络,在输入中添加微小扰动后,也容易出现判断错误的情况。此外,他们还首次将神经网络误分类问题转化为求解非线性优化问题。随后,Goodfellow等人[3]提出了快速梯度符号方法FGSM(Fast Gradient Sign Method)来生成对抗样本,该方法利用神经网络的梯度信息,用一定程度的扰动来改变输入数据,导致神经网络做出错误分类。迭代快速梯度符号方法I-FGSM(Iterative Fast Gradient Sign Method)[4]是FGSM的改进版本。该方法通过多次执行FGSM来生成对抗样本,能够在保持高效性的同时提高攻击的成功率。接着,Moosavi-Dezfooli等人[5]提出了一种基于线性近似的对抗攻击方法DeepFool,该方法每次迭代都添加一个非常细微的扰动向量,直到图像偏离原分类的决策边界,这些扰动叠加后作为最终的扰动向量。此外,Su等人[6]提出了单像素攻击方法,通过修改图像的单个像素,利用遗传算法生成对抗样本。

可见水印对抗攻击是一种特殊的对抗攻击,其目的是在保留图像视觉质量的同时,将水印作为扰动嵌入到图像中,并使得嵌入的水印对神经网络分类结果产生影响。为了将可见水印作为扰动来生成水印对抗样本,Jia等人[7]首次将盆地跳跃进化BHE(Basin Hopping Evolutionary)算法应用到对抗攻击中。BHE算法能够选择水印的透明度,并在原始图像中的某个位置嵌入水印,这样得到的攻击性能具有较好的适用性。接着,Jiang等人[8]进一步提出了类似于补丁攻击的快速可见水印对抗攻击FAWA(Fast Adversarial Watermark Attack)算法。该算法在原始图像上附加半透明的水印,并调整水印大小和嵌入角度来攻击神经网络分类器。相比于BHE算法,FAWA算法增加了对水印大小和嵌入角度的选择。这2种可见水印对抗攻击都对水印透明度进行了约束,但是这种约束都是基于经验总结出来的,最后生成的对抗样本在视觉效果表现上让人难以接受。因此,研究一种能约束视觉损失并能够自适应调整水印参数的可见水印对抗攻击方法有重要意义的。

2.1.2 对抗防御

目前,在对抗防御研究上存在3个主要方向:在学习过程中修改训练过程或修改输入样本、修改网络结构和使用外部模型作为附加网络。其中,通过修改输入样本进行对抗防御的方法被称为对抗训练。对抗训练被广泛应用于提高模型的鲁棒性和通用性,特别是针对水印对抗攻击。将生成的水印对抗样本添加到训练集中并重新训练模型可以使模型具有更优的鲁棒性和通用性。Xie等人[9]还发现将随机重缩放引入训练图像可以减弱对抗攻击的强度,其它方法还包括随机填补、训练过程中的图像增强等。此外,Papernot等人[10]提出了一种基于防御蒸馏的对抗防御方法,通过训练一个模型来预测先前训练的另一个模型的输出,可以获得鲁棒性更高的模型。Wang等人[11]使用单独的数据转换模块对输入数据进行转换,来消除图像中可能的对抗性扰动。

2.2 水印嵌入算法

水印嵌入算法是指嵌入的水印可以被看到或感知,而不需要额外的解码或特殊设备。在可见水印嵌入领域,Braudaway等人[12]首次将可见水印引入图像,使用自适应非线性像素域技术将水印添加到图像中,这种技术在保留图像细节的同时,还能使添加的可见水印难以移除。在该算法中,水印和原始图像具有相同大小,即水印和原始图像的每个像素都一一对应,可以独立进行运算。之后,Kankanhalli等人[13]使用块离散余弦变换技术来提取每个块的频域特征,从而确定每个块的水印嵌入系数和位置。在嵌入时,根据每个块的特性来调整嵌入系数和位置,以最大限度地保留图像的质量和感知性。最后,Shen等人[14]建议使用Alpha-Blending技术来生成可见水印。Alpha-Blending技术将水印融入到图像中,可以快速地嵌入水印,并且具有很好的普适性。在嵌入时,将水印与原始图像的Alpha通道进行合成,可以在保持图像质量的同时,使嵌入的水印更加稳定和难以移除。

2.3 参数优化算法

参数优化算法大体上可以分为梯度下降算法[15-17]和智能进化算法[18-21]2类。梯度下降算法是一种基于数学优化的方法,其核心思想是通过计算函数的梯度来沿着函数最陡峭的方向寻找最小值,从而达到优化的目的。智能进化算法是一种基于仿生学的方法,其核心思想是通过模拟自然界中的一些现象,基于自然进化原理的优化算法来寻找最优解,如蚁群优化ACO(Ant Clony Optimization)算法[18]、遗传优化GA(Genetic Algorithm)算法[19]和粒子群优化PSO(Particle Swarm Optimization)算法[20]等。本文方法在水印嵌入过程中无法获得神经网络参数,属于黑盒攻击,因此可以选择遗传算法来进行参数优化。

Figure 2 Flow chart of adversarial visible watermark attack based on intelligent evolutionary algorithm图2 基于智能进化算法的可见水印对抗攻击流程图

3 问题形式化

本文提出了一种基于智能进化算法的可见水印对抗攻击方法。该方法包含2个主要部分:水印嵌入模块和对抗攻击模块。水印嵌入模块采用Alpha-Blending技术来快速生成含有可见水印的图像。对抗攻击模块采用智能进化算法里的遗传算法,能够从多个由Alpha-Blending生成的图像中选择出高强度的水印对抗样本,从而最大程度地误导神经网络分类器。如图2所示,图像和水印经过遗传算法计算出透明度系数α、缩放比例β和旋转角度γ等参数;然后对水印进行旋转和缩放操作;接着根据透明度系数α使用Alpha-Blending技术将水印嵌入到图像中;最后将生成的图像传入到预训练好的神经网络分类模型,根据神经网络计算出的分类概率来修改遗传算法中的参数。通过不停地迭代更新参数,获得一个效果较好的水印对抗样本。

3.1 Alpha-Blending

图像在计算机中以数字矩阵形式存储。一般的图像有3个通道,表示每个像素有R、G、B 3个颜色分量。在一幅带有Alpha通道的图像中,每个像素包含3个颜色分量和1个Alpha分量。Alpha通道是图像中的第4个通道,用于衡量每个像素的透明度。Alpha分量取值一般从0~255, 0表示是该像素完全透明,颜色不会显示;255表示该像素完全不透明,颜色显示正常。图像最终显示的颜色取决于每个像素点的3个颜色分量及其Alpha分量值。如图3所示,通过修改所有Alpha分量值可以影响一幅图像的透明度。此外,当一幅图像从RGB颜色模式转为RGBA颜色模式时,默认所有像素的Alpha分量值为255。

Figure 3 Images with different Alpha values图3 不同Alpha值的图像

Alpha-Blending是一种混合像素值并产生半透明效果的图像合成技术,可以在原始干净图像中快速嵌入彩色可见水印[21]。其基本思想是将前景图像和目标图像按照一定比例进行混合,产生一幅新的图像。其中,混合比例由前景图像的Alpha分量值控制,Alpha值越高,前景图像在混合后的图像中占比越大,该像素点越不透明。在这个混合过程中,每个像素的Alpha值(透明度值)都会影响其在最终图像中的颜色。

在水印嵌入模块中,本文利用Alpha通道值控制水印的透明度,从而实现可见水印的嵌入,使其既能显示又不过度影响原图视觉效果。

Alpha-Blending的一般化计算如式(1)所示:

output=(sc*Alpha+dc*(255-Alpha))/255

(1)

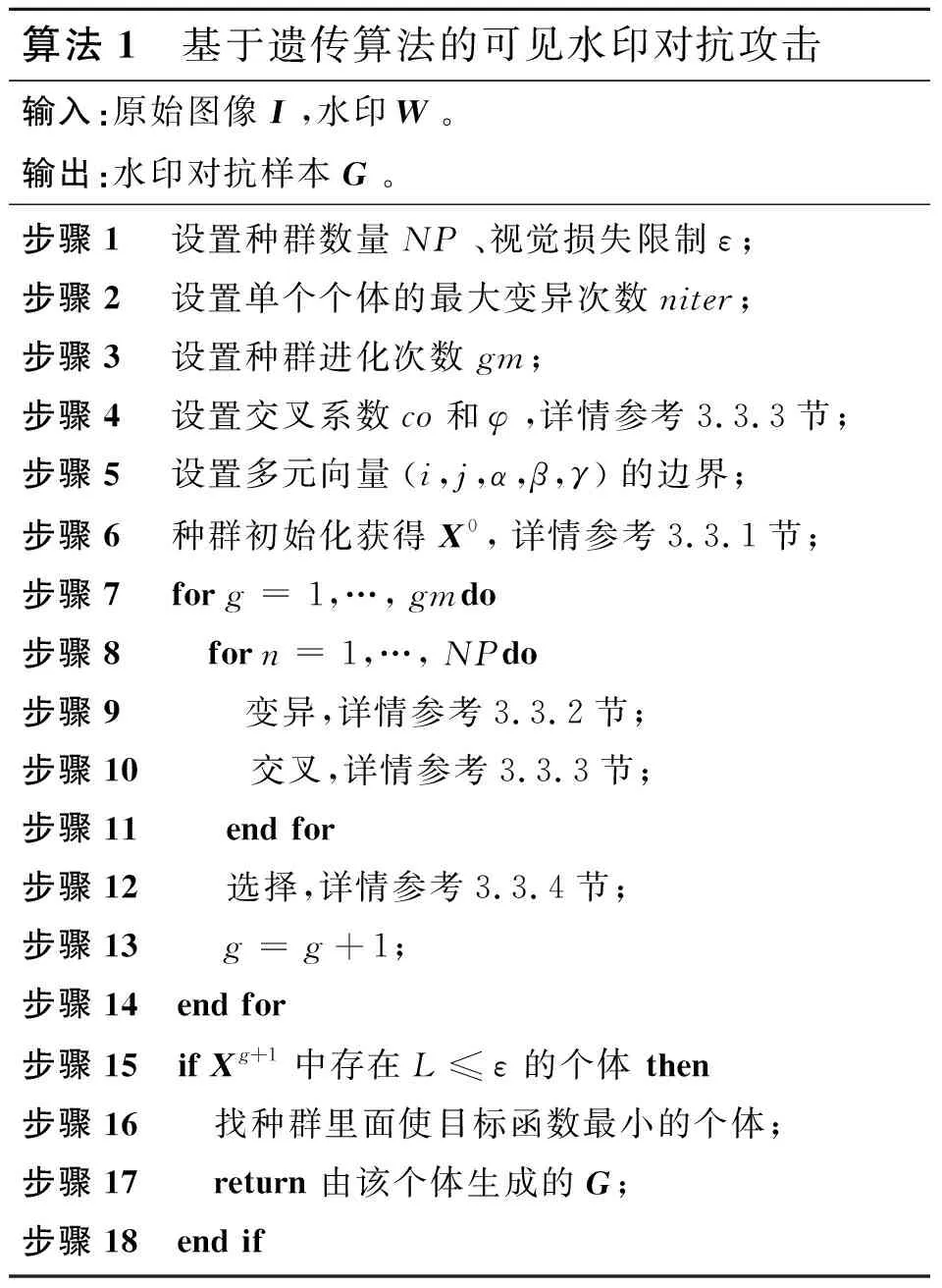

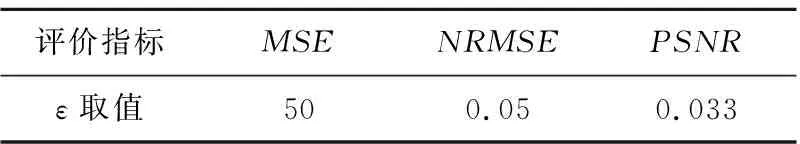

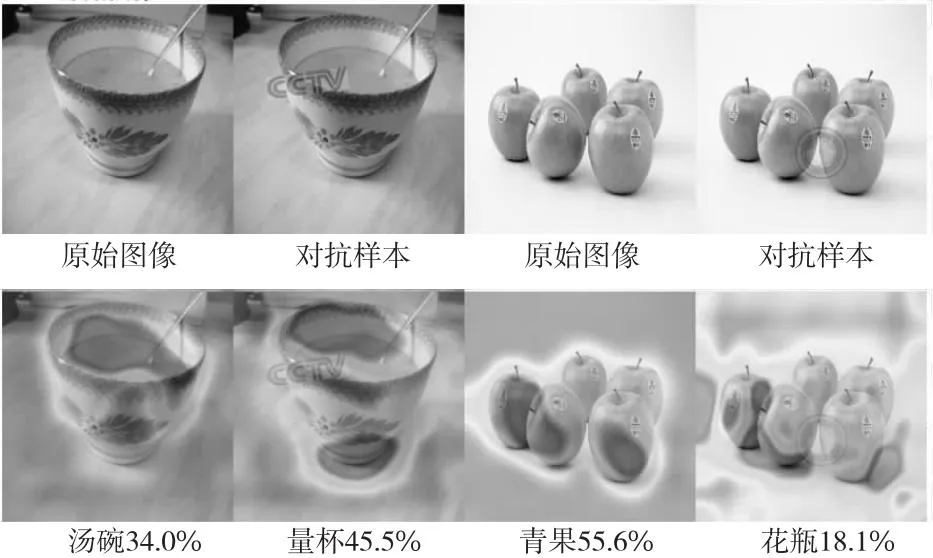

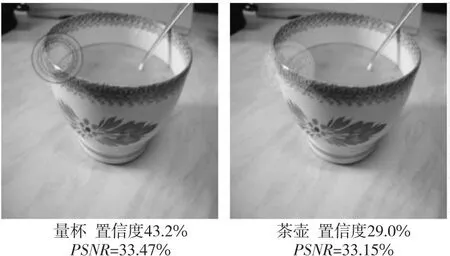

其中,sc和Alpha是前景图像(即嵌入图像)的像素值及其对应的Alpha分量值;dc是背景图像的像素值;output是输出图像的像素值。式(1)表示,混合后的颜色是由前景图像和背景图像的颜色加权平均得到的,权重由前景图像的Alpha分量值决定。如果Alpha为0,则表示前景图像完全透明,背景图像保持不变;如果Alpha为255,则表示前景图像完全不透明,覆盖在背景图像上;如果0 在本文中,假设原始图像为I∈RM×N×3,M和N分别表示图像的高度和宽度。原始水印为W∈Rm×n×3,其中m和n分别表示原始水印的高度和宽度。经过β放缩、γ旋转等变换后的水印为W′∈Rm′×n′×3,其中m′和n′分别表示变换后水印的高度和宽度。进一步假设,如果W′存在Alpha通道,将这个通道记作A;如果不存在,则认为W′完全不透明,即矩阵A中的值都为255。I和W′经过Alpha-Blending生成的图像为G∈RM×N×3,其大小与I的一致。 当2幅图像进行Alpha-Blending处理时,分别对叠加区域的各像素进行线性加权求和,得到混合后新的像素。一般情况下I和W′大小不一致,需要分区域讨论,具体如下所示: 当i∈(p,p+m′),j∈(q,q+n′)时,嵌入公式如式(2)和式(3)所示: α′=α·Ai-p,j-q (2) Gi,j=(Ii,j*α′+W′i-p,j-q*(255-α′))/255 (3) 其中,p和q表示W′嵌入到I的具体位置;α表示自定义的透明度系数,取值在[0,1];Ii,j表示原始图像I第i行、第j列像素向量;W′i,j表示变换后的水印图像W′第i行、第j列像素向量。 若W′完全不透明,式(2)可以简化为式(4): Gi,j=Ii,j*α+W′i-p,j-q*(1-α) (4) 当i∉(p,p+m′),j∉(q,q+n′)时,嵌入公式如式(5)所示: Gi,j=Ii,j (5) 值得注意的是,在实际操作中,由于图像旋转会改变图像大小,先对水印图像采取旋转操作,再按照特定比例因子进行缩放操作。缩放水印的时候需要满足max(m′,n′) m′=int(m*β),n′=int(n*β) (6) (7) 其中,scale是缩放系数,表示W′长宽占I长宽的比例;int(·)是向下取整函数;β表示缩放比例因子。 具体操作如图4所示,从ImageNet数据集中任选一幅图像嵌入腾讯文字水印。 Figure 4 An example of watermark embedding图4 水印嵌入示例 本文的目标是生成高强度的水印对抗样本。水印的位置(i,j)、透明度系数α、缩放比例β和旋转角度γ均会影响水印对抗样本的生成。生成水印对抗样本的过程可以形式化为求解多元约束非凸优化问题。为了控制水印对抗样本的视觉效果,本文还考虑了图像的视觉损失。具体而言,优化目标是在设定的图像损失里面,让生成的水印对抗样本在原始的分类标签上的概率尽可能小。 假设有一个经过良好训练的神经网络分类器f(·),原始图像I的真实分类标签为t,ft(·)表示I被模型f(·)分类为t的概率。图像水印生成器g(I,W,i,j,α,β,γ)表示先将水印逆时针旋转γ,再按照缩放因子β进行缩放,最后将处理好的水印嵌入到原始图像的(i,j)位置。 在进行非目标攻击时,问题的一般表述如式(8)和式(9)所示: (8) (9) 其中,ε代表视觉损失上界,即最多允许图像改变的程度,ε的取值随着评价方法的变动而变动;L表示水印对抗样本生成后的视觉损失。可以采用图像质量评价指标来衡量图像G的损失,例如均方误差MSE(Mean Square Error)、归一化均方根误差NRMSE(Normalized Root Mean Square Error)、峰值信噪比PSNR(Peak Signal to Noise Ratio)等。其中,峰值信噪比较为特殊,一般来说,PSNR越大,代表图像失真越少。因此,当作为视觉损失函数使用时,需要将L设定为PSNR的倒数,如式(10)所示,PSNR计算如式(11)所示: (10) (11) 遗传算法作为一种新型、高效的启发式并行搜索算法,具有收敛速度快、控制参数少等优点,本文采用遗传算法求解上述优化问题。如图5所示,遗传算法主要包括种群初始化、变异、交叉和选择。在每次迭代期间,当前解决方案(父级)使用搜索策略进行变异和交叉操作,生成一组新的候选解决方案(子项)。然后在选择操作中,子项与相应的父项进行比较,如果子项更适合种群进化(具有较小的多元函数值),则子项生存下来成为下一次迭代的父级。 Figure 5 Framework of genetic algorithm图5 遗传算法框架 算法1介绍了遗传算法的具体流程。原始图像I和原始水印图像W是算法的输入。对抗样本G是算法的输出。首先,需要设置算法的超参数并且进行种群初始化。然后,使用搜索函数对上一代个体进行变异操作。在g=1的情况下,上一代个体就是初始化的种群个体。接着,进行交叉和选择操作。最后,找出最后一代种群里能最大程度攻击神经网络的参数。如果该参数生成的对抗样本满足视觉损失约束且能够使神经网络错误分类,则将这个对抗样本作为算法的输出。 算法1 基于遗传算法的可见水印对抗攻击输入:原始图像I,水印W。输出:水印对抗样本G。步骤1 设置种群数量NP、视觉损失限制ε;步骤2 设置单个个体的最大变异次数niter;步骤3 设置种群进化次数gm;步骤4 设置交叉系数co和φ,详情参考3.3.3节;步骤5 设置多元向量(i,j,α,β,γ)的边界;步骤6 种群初始化获得X0,详情参考3.3.1节;步骤7 for g= 1,…,gmdo步骤8 for n= 1,…,NPdo步骤9 变异,详情参考3.3.2节;步骤10 交叉,详情参考3.3.3节;步骤11 end for步骤12 选择,详情参考3.3.4节;步骤13 g=g+1;步骤14 end for步骤15 if Xg+1中存在L≤ε的个体 then步骤16 找种群里面使目标函数最小的个体;步骤17 return 由该个体生成的G;步骤18 end if 3.3.1 种群初始化 由于每个基因变量都有上界和下界,可以采用式(12)进行最大值最小值种群初始化: (12) 其中Xmax,q、Xmin,q分别表示q基因变量的上、下界,rand(0,1)表示服从[0,1)均匀分布的随机值。 3.3.2 变异 在本文中,变异是以当前个体为起始点,采用任意一种多元函数优化搜索策略进行搜索,搜索到的结果比初始个体有更低的函数值。为了降低算法的时间复杂度,可以将搜索策略的迭代次数设定为1。 随机更新策略是一种迭代次数为1的快速更新策略,即在原来的个体周围随机生成一个个体,如式(13)所示: (13) 3.3.3 交叉 (14) 其中,CO=co×cos(φπg/2),co表示交叉因子的交叉系数,取值在[0,1],φ是频率。 3.3.4 选择 选择是指种群进化时,选择拥有更低函数值的个体,以便更容易进化下去。在本文的算法中存在这样一种情况,如果父项满足视觉约束条件,子项经过优化后,有着更低的函数值,但不满足视觉约束条件,那么父项保留下来。在每次种群迭代中,将当前种群Xg和经过变异、交叉后的种群Ug进行比较,选择优化目标值较好的个体生成Xg+1。具体公式如式(15)所示: (15) 4.1.1 数据集 本文从ImageNet数据集中随机选择100幅图像进行相关实验。此外,为保持一致性,本文将所有图像的尺寸都调整为224×224,即M=N=224。 在整个实验过程中,考虑的水印包括2大类:文字水印和图像水印。文字水印为CCTV水印;图像水印为伯克利分校(Berkeley)校徽和麻省理工(MIT)校徽,两者的最大区别是水印是否镂空。 4.1.2 实验环境及参数设置 本文基于PyTorch深度学习框架,采用NVIDIA GeForce RTX 3080 Ti GPU进行计算,操作系统为Ubuntu 20.04。 实验参数分为超参数和训练参数。对于超参数,需要考虑种群数量、遗传次数、交叉概率因子和搜索半径。种群数量NP设置为50,搜索半径a设置为0.05。考虑到算法的时间复杂度,遗传迭代次数越小,训练时间越短,交叉因子系数越大,越有可能进行交叉操作,训练会变得更快。本文参数设置如下:co=0.9,φ=1,gm=3。 训练参数包括透明度上下界、缩放上下界和视觉损失上界ε。在本文提出的方法中,透明度和缩放比例等的范围都是由ε自动控制的,不需要特别设定。在现实生活中,可根据实际应用需求调整上下界。根据图像质量评价指标的特性:图像失真越严重,MSE和NRMSE越大,PSNR越小,表1给出了采用各种图像质量评价指标进行对抗攻击时ε合适的取值。本文使用的图像质量评价指标为PSNR。通常,当PSNR>30时,被认为图像质量较好,即图像的失真可以被接受。视觉损失L是PSNR的倒数,当L≤1/30时,PSNR>30,因此,本文设置视觉损失上界ε为1/30。 Table 1 ε values under different image quality evaluation metrics表1 ε在不同图像质量评价指标下的取值 为了衡量算法的时间复杂度,对单独一幅图像进行可见水印对抗攻击,并与其他基准可见水印对抗攻击方法(BHE和FAWA)进行比较,测试所用的神经网络是ResNet101,结果如表2所示。从表2可以看出,本文提出的方法攻击单一图像所用的时间远低于其他基准水印攻击方法的。这主要是由于对抗攻击问题对优化的要求并不高,不需要完全找到最小值点。因此,算法在变异阶段只采用了一次迭代优化,并没有采用复杂的多元函数优化策略。 Table 2 Time complexity of different adversarial watermarking attack algorithms表2 不同可见水印对抗攻击算法的时间复杂度 为了可视化地评估对抗样本对神经网络的攻击效果,本文绘制了水印对抗样本及其神经网络观测热力图,该热力图能够有效地反映神经网络在图像上的关注点。如图6所示,第1行是在Image- Net数据集上对ResNet101攻击生成的结果,第2行是分数加权激活热力图可视化Score-CAM(Score-weighted Class Activation Mapping)。可以看到,与原始图像相比,生成的水印对抗样本改变了神经网络的激活区域和图像中主体的轮廓,从而改变了最高分类置信度。此外,汤碗对抗样本上PSNR值达到了33.22,此时,L≈0.0301<ε,青果对抗样本上PSNR值达到了34.94,此时L≈0.0286<ε。两者都接近设定的图像损失上界。这表明优化问题的解会落在由ε控制的定义域边界上。 Figure 6 Examples of different watermarking attack effects图6 不同水印攻击效果热力图 为了更好地解释视觉损失上界ε的作用,在汤碗图像上分别使用大小相同的Berkeley校徽和MIT校徽进行水印对抗攻击,结果如图7所示。可以看到,2幅对抗样本的PSNR值接近,但是2种水印的嵌入大小和透明度完全不一致,麻省理工校徽水印更大、更透明。ε只限制图像的视觉损失,即让生成的水印对抗样本在视觉损失上不超过设定的上界,具体的嵌入参数(如位置、透明度、缩放比例和旋转角度)由程序根据不同水印自适应调整。 Figure 7 Examples of different watermarking attack effects图7 不同水印攻击效果示例图 为了全面验证本文方法的有效性,测试了3种在ImageNet数据集上预训练好的神经网络分类器:AlexNet(Alex’s neural Network)、VGG16(Visual Geometry Group’s neural network with 16 layers)和ResNet101。表3给出了不同徽标或文字水印在各种神经网络分类器上的平均攻击成功率。可以看到,Berkeley校徽水印在神经网络上的攻击成功率最高能达到60%。 Table 3 Attack success rates of different watermarks on neural networks表3 不同水印在神经网络上的攻击成功率 % 此外,为了定量评估本文方法的性能,还将其与边界攻击[22]、单像素攻击[6]等黑盒攻击进行了比较,测试网络为AlexNet和ResNet101。不同黑盒攻击在神经网络上的平均攻击成功率如表4所示。为了更加公平地实验,本文选择PSNR作为图像评价指标,将模型限定在ε=0.028的损失条件下与边界攻击进行对比,将模型限定在ε=0.022的损失条件下与单像素攻击进行对比。很明显,与这2种基准黑盒攻击相比,本文方法对神经网络的攻击成功率更高。 Table 4 Attack success rate of different black-box attacks on neural networks表4 不同黑盒攻击在神经网络上的攻击成功率 % 本文提出了基于智能进化算法的可见水印对抗攻击方法。该方法将可见水印对抗攻击问题转化为求解约束非凸优化问题。与以往的工作相比,本文提出的方法增加了图像质量评价指标来约束图像的视觉损失,不仅能快速生成高强度的水印对抗样本,还能使生成的对抗样本拥有更好的视觉效果。该方法生成的对抗样本可以成功地攻击神经网络分类器,具有很好的适用性。实验结果表明,该方法相比于基准水印攻击方法时间复杂度更低,同时相比于基准黑盒攻击对神经网络攻击成功率更高。 对于水印对抗样本的防御,除了进行对抗训练外,如何精准有效地规避可见水印对抗攻击是研究的下一个重点。此外,由于本文方法改变了图像主体的轮廓信息,未来的工作将进一步在其他领域应用可见水印对抗攻击和防御,例如目标检测等。

3.2 问题形式化

3.3 遗传算法

4 实验结果与分析

4.1 实验设置

4.2 时间复杂度评估

4.3 攻击效果评估

4.4 对比实验分析

5 结束语