利用边缘条件的多特征融合图像修复算法

2023-12-11文志诚邓文贵张姝婷

欧 静,文志诚,邓文贵,张姝婷

湖南工业大学 计算机学院,湖南 株洲 412000

图像修复是图像处理领域的重要研究方向,它为图像语义信息缺失、物体遮挡和内容损坏等问题提供了解决思路和方法。对于数字图像的修复任务,通过对缺失区域周围有效像素及特征信息的提取和学习或从外部数据库中搜索相匹配的语义数据,修复算法可以生成与原始图像内容近似的填充信息[1-3]。图像修复在现实生活中的广泛应用体现了相关技术的重要研究意义,例如老照片裂纹修复、色彩重建[4]、图像水印去除等。在专业领域常用于刑侦安全[5]、航空卫星轨道图像绘制[6]和老电影补帧[7]等。在医学研究领域可利用真实的解剖信息生成肿瘤图像[8]。

图像修复工作发展至今经历了从传统机器学习算法到运用深度神经网络推理的发展和优化,在修复能力和效果上均取得了突破性进展。近年来,基于变分自编码器结构和生成对抗网络(generative adversarial network,GAN)的深度学习算法解决了传统机器学习无法在低级图像信息和高级语义之间建立紧密联系的问题,但修复后的纹理容易出现过度平滑和模糊的纹理特征。为解决上述问题,本文提出一种基于边缘条件的多特征融合图像修复方法——MEGAN。

MEGAN 遵循先结构再细节的修复思路,在Nazeri等人[9]提出的EdgeConnect算法基础上进行了改进。针对边缘修复阶段,MEGAN 引入门控卷积[10-11]以动态地学习输入图像中有效像素和掩码之间的关系。门控的使用使网络在修复缺损边缘信息时可以有效避免因受无效像素影响而引入的结构歧义,提高边缘信息生成的准确度。

在细节纹理生成网络的特征提取阶段,MEGAN结合门控和阿特劳斯空间金字塔池(ASPP)[12-13]思想,提出带门控的多扩张卷积模块——GMBlock。在GMBlock中并行工作的多扩张率空洞卷积既不会丢失特征图谱中的有效像素信息,也可以在扩大网络感受野的同时从多个尺度上进行特征提取和融合。GMBlock 中的门控机制使细节纹理网络更加有效地利用边缘信息指导结构纹理的生成,同时,门控卷积能够在网络深层保留当前像素的相对位置信息。

最后,MEGAN使用在不同图像尺度上共同工作的谱归一化[14]马尔可夫判别器结构[15-16],多尺度判别器结构可以在稳定训练的过程中生成更准确清晰的纹理信息和全局一致性的语义结构。

1 相关工作

1.1 传统修复方法

传统的图像修复方法多为基于概率统计的机器学习算法,主要为基于扩散或基于纹理块匹配的方法。

基于扩散的修复方法利用传播机制,从有效区域边界向缺失区域中心对像素值逐步进行计算。该方法主要包括基于偏微分的合成算法和基于集合图模型的变分修复技术,典型算法有BSCB 算法(Bertalmio Sapiro-Caselles Ballester)[17]、全变分修复模型[18]和基于曲率扩散强度的CDD(curvature-driven diffusions)模型[19]等。

基于纹理块匹配的修复思想认为,缺失区域的内容可用已知的纹理样本进行填充。Criminisi 等人[20]提出的基于示例的图像修复算法通过迭代地进行计算待补全区域边界像素的补全的优先度、填充像素中的纹理结构信息、更新置信度值来修复图像的缺损区域。然而,迭代次数的增加使置信度水平和优先度计算结果的有效性降低,最终形成错误的纹理填充顺序,造成图像结构混乱。

Darabi 等人[21]则通过计算补丁之间的相似度分数在输入图像的有效区域中搜索与缺失部分匹配度最高的纹理补丁进行填补修复。当缺损区域中含有独立个体或非结构化的局部损伤时,该方法修复的结果中会生成不符合逻辑的语义内容。

为避免上述情况,Hays等人[22]采用数据驱动思想在百万级数据库中搜索与目标最相似图像,并在搜索结果的对应区域提取纹理信息进行修补。该方法可以在图像中存在大面积缺失时生成合理的纹理内容,但算法本身受外部数据资源限制,计算量巨大。

1.2 基于深度学习的修复方法

自2014 年以来,基于卷积神经网络的编码器结构和生成对抗网络的迅速发展为图像修复工作提供了新的解决思路和方法。基于卷积的编码-解码网络不仅拥有捕获全局结构和上下文信息的能力,而且可以通过在大规模数据集上训练以获得对图像信息的动态学习推理能力。

Pathak 等人[23]首次提出一个基于GAN 思想的无监督特征学习算法——上下文编码器算法(contextencode,CE)。CE 算法以生成对抗网络为基础结构,采用自编码器结构作为图像生成器。上下文编码器可以在一定程度上理解图像的语义信息并根据孔洞周围信息预测生成内容。但该算法对远距离信息的感知提取能力较弱,在处理存在大面积缺失的图像时的修复时存在结构信息丢失和纹理模糊的现象。

为获取图像中的全局信息,Iizuka 等人[24]使用4 层堆叠排放的扩张卷积(dilated convolution)来扩大网络感受野,实验证明,该网络的感受野范围只能达到307×307个像素,面对大尺度损失和复杂结构纹理合成时依旧受到限制。Yu 等人[25]在传统两阶段网络中添加注意力机制获取待填补区域和图像较远区域之间的信息联系。Zeng 等人[26]提出的金字塔式上下文编码器方案(pyramid-context encoder network,PENnet)摒弃了庞大的传统两阶段式网络体系结构,在单阶段GAN 生成网络上运用注意力机制,使得生成图像质量的提高不再单纯依靠GAN 网络数量的叠加,而归结为对多尺度特征的充分利用。

针对修复结果中容易出现纹理过度平滑模糊和结构信息丢失的现象,EdgeConnect 算法开创性地利用先验边缘信息对缺失区域进行精确的纹理信息推理。近年来,各种基于该算法思想的模型变体在人脸修复[27-29]等领域的广泛应用充分说明了EdgeConnect模型的有效性。MEGAN网络模型在EdgeConnect网络优越的结构合成能力上引入了多特征融合思想,可以有效促进生成图像与真实图像间的纹理一致性与连续性。

2 MEGAN的网络结构

现有的主流图像修补方法往往难以兼顾修复结果在语义结构上的一致性和细节纹理层面的高清晰度。为更好地处理上述问题,本文提出一种结合边缘条件和多特征融合图像修复模型——MEGAN。

整体修复网络由边缘生成网络和纹理细节生成网络两部分组成,两个网络各包括一组生成器和判别器。在生成器结构中堆叠排放的多扩张卷积块(GM Block)可以使图像能够在生成过程中拥有多尺度感受野,从而捕获更多远距离下的上下文有效信息和不同感受野下的图像特征。在两种尺度上工作的谱归一化马尔可夫判别器可以有效鉴别尺寸大小为70×70 的生成图像块是否接近真实图像,并且通过迭代对抗博弈训练进一步优化网络内部参数。

2.1 生成网络结构

图像生成任务包含三个阶段。

(1)对缺损图像进行预处理。首先,将带有缺损的RGB 输入图像Iin转化为通道数为1 的灰度图Igray,再用Canny检测算法提取图像的边缘信息,得到带有缺损的边缘图像Ede。

(2)生成完整边缘图像。将含有缺损的灰度图Igray,边缘图像Ede和二进制掩码图像M(缺损区域像素值为1,有效像素值为0)在通道维度上进行拼接得到Einput。如公式(1)所示,Einput将作为边缘生成器Gedg的联合输入。

如公式(2)所示,经过与边缘判别器Dedg的对抗性训练后,边缘生成器输出图像的完整边缘信息Eco。

(3)纹理细节生成网络生成最终的修复图像。如公式(3)所示,表示输入到纹理细节生成网络中的完整边缘图像。中缺损区域的边缘信息为第一阶段的边缘生成结果,有效区域将保持原图中的边缘信息。如公式(4)所示,纹理细节生成器Gim的输入由缺损图像和边缘图像共同组成,记作Iinput。

如公式(5)所示,当多尺度判别器Dim-1,Dim-2无法有效区分真实图像和经过纹理细节生成器Gim修复的图像时,判定纹理细节生成器可以生成具有合理的结构和色彩纹理修复结果Ifin。图像补全网络最终输出的修复结果用表示,保留了原图中未缺损区域的有效信息以及修复结果Ifin中缺损区域的图像信息,表达式如公式(6)所示:

网络整体结构如图1所示,两个生成器由一层归一化层、两层下采样、8个特征提取层和两层上采样组成。归一化层中使用了64 个大小为7×7 的卷积滤波核对输入图像进行处理以防止训练过程中发生梯度爆炸。两层下采样中分别包含有128和256个大小为4×4的卷积核,在降低输入图像特征维度的同时保留有效信息,增大卷积感受野。

图1 MEGAN网络结构Fig.1 Network structure of MEGAN

同时,MEGAN模型在边缘生成网络的特征提取阶段设置8 层连续的门控残差结构。在纹理细节生成网络的特征提取阶段,用带门控的多扩张卷积块GM Block 代替原网络中的传统残差结构。生成器的最后3 层包括2 层上采样层和1 层图像输出层。2 层上采样层分别使用128 和64 个大小为4×4 的卷积核进行转置卷积操作,将特征图的分辨率恢复到初始大小。最后使用7×7 的卷积核对经过上采样后的特征图像进行卷积并输出具有相应通道数的输出图像。在两个生成网络的生成器结构中均使用谱归一化和实例归一化两种归一化方式。

2.2 多尺度判别器结构

通过对抗地训练纹理细节生成网络的生成器和判别器可以促进生成器生成合理的像素信息对缺失区域进行填充。当网络中仅设置一个全局判别器时,生成的图像虽然具备一定的全局一致性,但生成的图像像素信息非常模糊,在错误边缘信息的影响下甚至会出现结构模糊混乱的现象。

为促进缺失区域图像的细节处理能力,Iizuka 等人在判别器结构中增加了一个局部判别器以监控生成图像的准确率。但传统的局部鉴别器却具有严格的作用区域和大小限制,例如仅在以填充区域为中心的原图像四分之一大小区域上观测,因此这种设置在处理含有不规则缺损的图像时效果并不理想。

为解决以上问题,纹理细节生成网络的判别器结构采用了2 个具有相同网络结构且在不同尺度上运行的马尔可夫判别器结构,分别用Dim-1和Dim-2表示。由真实图像和修复的输出图像共同组成的图像对在模型中进行2倍下采样,经过下采样后的修复图像和原分辨率修复图像共同形成一个含有2 个尺度比例的图像金字塔。在最小图像尺寸上运行的马尔可夫判别器具有最大的感受野,即具有更具全局性的图像视图,可以指导生成器生成全局一致的图像。同样,在最大图像尺寸上运行的判别器可以指导生成器产生更精细的纹理细节,整幅图像的修复效果在视觉上更加合理。

多尺度判别器在不同分辨率的图像上进行训练从而区分真实图像和合成图像,因此,补全网络的训练过程在结合多尺度判别器思想后可以转化为一个多任务的学习问题,如公式(7)所示:

判别器的网络结构由五个卷积层构成,其中卷积核尺寸均为4×4,各层包含的卷积核数目分别为64,128,256,512 和1。同时,谱归一化可以按各自最大奇异值缩小权重矩阵进而有效地将网络的Lipschitz 常数限制为1,从而进一步稳定生成对抗网络的训练。因此,网络将谱归一化设置在判别器除最后一层外的每一层卷积之后,通过抑制参数和梯度值的变化来使训练过程更加稳定。

2.3 带门控的多扩张卷积块(GMBlock)

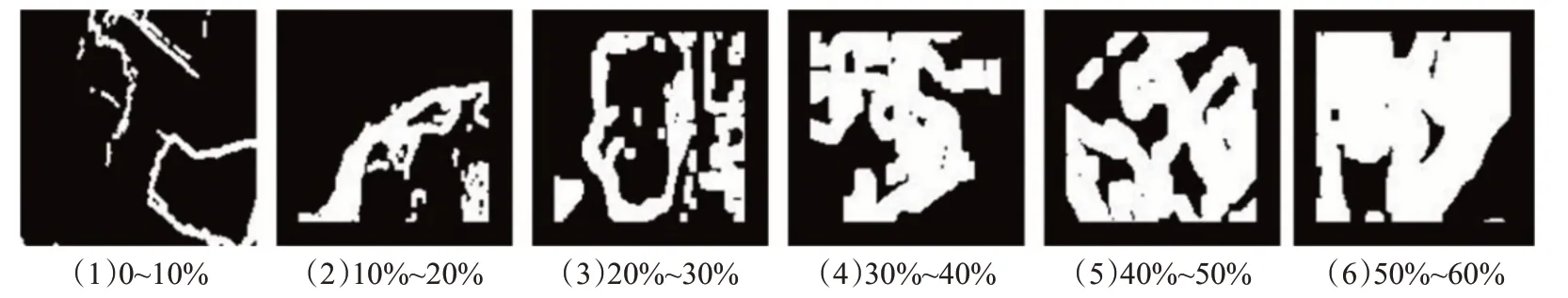

为了生成具有结构一致性的修复结果,以往方法常将具有同一扩张率的扩张卷积按照序列化的方式进行堆叠以获取更大的感受野,以此来获取远距离下的上下文信息,如图2所示。但序列化的扩张卷积在获得高级语义特征的同时也会受到“网格化”影响。

图2 堆叠扩张卷积感受野分析Fig.2 Receptive field analysis of stacked dilated convolutions

例如扩张率为2且尺寸为3×3的扩张卷积核等效于一个5×5大小的普通卷积,在执行3次卷积操作后的感受野可以达到15×15。因此,采用扩张卷积可以在不增加卷积核参数的同时有效达到扩大感受野的效果。但这种排列方式会避免在特征提取时丢弃大部分有效像素信息。如图2所示,图中绿色和黄色的点表示在操作过程中实际参与运算的像素,其排列呈现出明显的“棋盘”特征。且当扩张率为2时被丢弃的像素点在整体图像中的占比大于75%。因此,通过堆叠单扩张卷积来扩大感受野的方式会导致细节信息缺失以及获取的远距离信息与当前位置信息可能并不相关,从而破坏像素排列的连续性和局部信息的一致性,弱化修复网络对图像细节纹理的学习和推理。

为避免像素丢失和“网格化”问题,MEGAN网络模型采用一种结合空间金字塔池和门控卷积的多尺度特征提取模块,即带门控的多扩张卷积块(gated multiextension convolution block,GM Block)。模块结构如图3 所示。受阿特劳斯空间金字塔池(ASPP)思想影响,采用多种扩张率卷积核[30-31]对给定特征层进行采样等同于用多个不同尺寸的卷积核提取原始图像特征,以此来获得来自不同感受野下的像素信息。ASPP结构图如图4所示。同时,GM Block中增加的扩张率为1的扩张卷积可以弥补扩张卷积存在的像素信息丢失的问题。

图3 GM Block模块结构图Fig.3 GM Block module structure diagram

图4 ASPP空间金字塔池结构图Fig.4 ASPP spatial pyramid pool structure diagram

GM Block在通道维度上将卷积核拆分为5个子内核,每个子内核对应的扩张率分别为1、2、4、8和16。经LeakyReLU函数激活后,来自不同感受野的特征信息在通道维度上聚合并通过标准卷积进行特征融合。由于使用较大的膨胀率可以让子内核捕捉到图像的更大区域的信息特征,而较小的扩张率的子内核会专注于较小感受野的局部纹理,因此,GM Block可以使网络能够以多个视角聚合图像远距离上下文的特征,增强网络进行上下文推理的能力且不会引入过多的模型参数和计算成本。

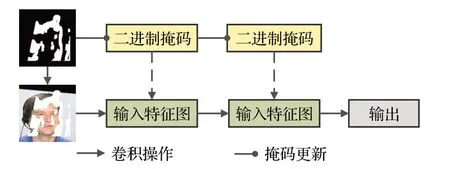

原EdgeConnect修复算法使用普通卷积进行特征提取,普通卷积的滑动窗口在计算时默认当前视野中的所有元素有效,在处理非规则掩膜时会干扰对掩膜外有效像素的学习进而对图像生成结果的准确率产生消极影响。为避免以上原因造成的修复结果模糊,颜色不一致等问题,部分卷积[32]提出使用一种掩膜更新的方法使无效像素在网络深层结构中会随着图像的修复逐渐被转化为有效像素,其工作原理如图5(a)所示,具体实现如公式(8)所示:

图5 (a)部分卷积示意图Fig.5 (a)Illustration of partial convolution

图5 (b)门控卷积示意图Fig.5 (b)Illustration of gated convolution

其中,M是二进制掩码图像Mask,⊙表示两矩阵逐元素相乘。部分卷积操作每执行一次会更新一次掩码值,并以此为根据使滤波器仅对有效像素区域进行卷积,掩码更新规则为:

对于边缘引导的图像修复任务而言,部分卷积存在以下弊端,首先,网络无法真正发挥边缘信息的指导作用。由于掩码更新规则只用0 或1 区分像素,网络无法对第一阶段产生的边缘像素进行有效区分(判断边缘信息所在位置为缺损区域以外或以内),因而难以正确更新下一层的掩码信息。其次,随着网络层数的深入,掩码中的所有像素全部更新为1 使深层网络无法获取当前区域像素的原始信息(是否位于缺损区域),从而弱化网络的学习推理能力。

为避免部分卷积带来的边缘信息利用率不高和网络深层缺乏相对位置信息的问题,门控卷积为所有层中的每个空间位置的每个通道提供一个可学习的动态特征选择机制来泛化部分卷积,如图5(b)所示。门控卷积允许网络自动学习到最佳的掩码形态。即使经过多次特征提取和掩码更新,网络依旧可以根据边缘草图信息及当前像素在特征图像中是否位于掩码区域为每个空间位置分配不同的软掩码值。实现方法如公式(9)所示,其中,Ifm表示在网络中下采样后的特征图输入。

具体而言,网络首先根据公式g=σ(Gy,x)计算输入特征图的门控值g。σ(·)为sigmoid 激活函数,输出介于0 和1 之间的门控值,Wg作为用于计算门控值的卷积滤波器为可学习的参数,Wm为对输入图像进行特征提取的多扩张卷积核。ϕ(·)为LeakyReLU激活函数,门控卷积结构最终输出特征图像Fy,x和门控值的乘积。经实验验证,在GM Block中运用门控卷积可以增强生成网络对输入图像中有效元素和边缘像素的利用,提高对缺失区域图像的推理合成能力。

2.4 损失函数设计

2.4.1 边缘生成网络损失函数

在边缘生成网络中采用由L1 损失、特征匹配损失和生成网络的铰链损失组成的联合损失函数规范网络权值的训练更新过程。联合损失函数如公式(10)所示:

其中,λG-edg、λfm和λ1为加权超参数。L1损失函数代表最小绝对值误差,用于衡量真实图像和生成图像间的像素级差异。公式(11)定义了边缘生成器损失LG-edg,边缘判别器损失定义如公式(12)所示:

其中,Eco表示生成器输出的边缘修复结果。由于边缘图像的像素分布十分稀疏,判别器在判断生成图像是否接近于真实图像时能利用的有效像素信息较少,若仅仅将边缘数据输入判别器会使对抗性损失的优化难度增加甚至导致训练失败。因此,轮廓鉴别器的输入被调整为真实图像灰度图和边缘图像对,用真实图像灰度图作为判别器的附加条件不仅可以促进生成器生成与真实边缘相似的条件信息,也使判别器能够获得足够的先验信息对图像进行区分。

公式(10)中的Lfm为特征匹配损失。通过取判别器中间层的特征图和来自预训练VGG网络中对应的中间层的特征图对比得到损失值,再反向传播回生成网络以促进生成器生成与真实图像在感知上相接近的边缘结果,其定义如公式(13)所示:

其中,Ni是第i层特征图中的元素数,是鉴别器中第i层的特征图。

2.4.2 纹理细节生成网络损失函数

针对纹理细节生成网络,采用在两个尺度上共同工作的马尔可夫判别器(Dim-1和Dim-2)指导生成器生成清晰且与有效区域信息具有高度一致性的图像纹理。由于网络最终的输出图像中包含大量语义结构及色彩纹理信息,因此,联合损失函数中引入了感知损失函数Lperc和风格损失函数Lstyle提高图像感知重建的准确性和合理性。以上两种损失函数在图像修复和风格迁移上的有效性已经得到广泛验证,感知损失旨在最小化修复图像和真实图像的激活映射之间的L1 距离,其定义如公式(14)所示:

其中,ϕi是预训练网络VGG_19第i层的激活图,Ni是第i层的激活图中的元素个数。

与感知损失相似,风格损失用于衡量生成图像和真实图像第i层深度特征的Gram矩阵间的L1距离。假定第i层特征图尺寸为Ci×Hi×Wi,(·)是由特征图像ϕj构造的尺寸为Cj×Cj的Gram矩阵,风格损失函数的定义如公式(15)所示:

公式(16)定义了边缘生成器损失LG-edg,边缘判别器损失定义如公式(17)所示:

纹理细节生成网络的整体联合损失函数表达式如公式(18)所示:

在纹理细节生成网络的联合损失中,对抗损失可以提高生成图像在纹理色彩上的保真度,风格损失和感知损失用于提高生成图像在视觉感官上的整体一致性,最后,L1损失确保图像间的像素级重建精度。

3 实验结果与分析

3.1 实验设置

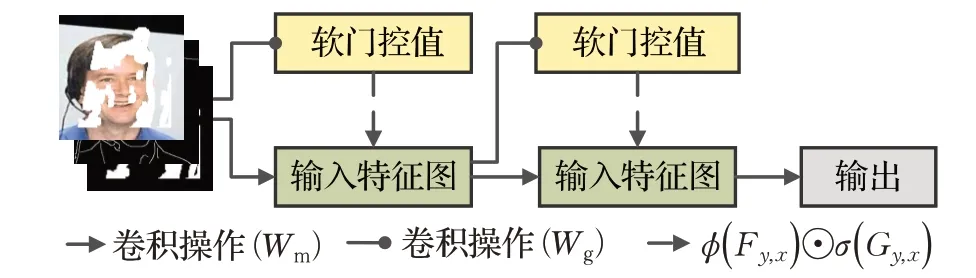

实验硬件设施为15核AMD EPYC 7543处理器及一块NVIDIA RTX 3090显卡,在Ubuntu18.04.5系统下搭配python3.8.10,cuda11.1和Pytorch 1.8.1深度学习框架运行。实验分别在Places2(small images with easy directory structure 版本)和CelebA(CelebFaces attribute)数据集上对MEGAN 网络模型的有效性进行验证。图6展示了实验所用数据集的部分样本。

图6 (a)Places2及CelebA数据集示例Fig.6 (a)Examples of Places2 and CelebA datasets

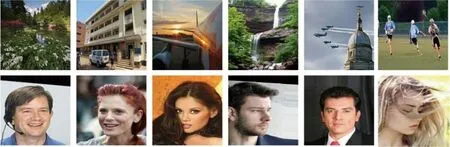

图6 (b)不规则掩码数据集示例Fig.6 (b)Examples of irregular mask dataset

CelebA 是由香港中文大学开放提供的人脸数据集,其中包含有202 599 张人脸照片。由于官方数据集中没有训练集和测试集划分,实验选择数据集中的前190 000 张片人脸图像作为训练数据集,剩余12 599 张图像用于测试。Places2 数据集中包含有来自365 个场景的180万张图像,实验按照官方默认训练集和测试集进行训练。

掩码数据集采用由Liu等人[32]贡献的不规则掩码数据集。不规则数据集中包括6 组,共12 000 张掩码图像,掩码区域占比从10%到60%以10%的增量递增。为增加掩码数量,提高MEGAN网络模型的泛化能力避免过拟合,实验过程中将每个掩码随机旋转0°、90°、180°或270°并在垂直或水平方向随机翻转来达到数据增强的目的。实验中使用到的三种数据集样本如图6所示。

所有图像包括相对应的掩码图像在输入进网络之前统一将尺寸大小调整为256×256,经过对实验效果的对比最终将Batchsize 设置为4。网络学习率在训练初始阶段设置为10-4,当趋于收敛时将学习率调整为10-5。网络在优化训练过程时使用Adam 优化器,根据经验值将一阶动量β1 和二阶动量β2 分别设置为0.5和0.9。在设置联合损失函数的平衡参数时,首先借鉴EdgeConnect 网络参数及经验值进行初始参数值设置,经过多次实验调参后确定边缘损失网络的损失函数参数为λG-edg=1,λ1=1,λfm=10。对于纹理细节生成网络中的加权超参数则分别赋值为λl1=1,λperc=0.1,λstyle=250,λG-im=0.1。

3.2 实验结果与分析

实验将Pconv、EdgeConnect、Contextual Attention(CA)和本文算法进行对比测试,并就各自修复结果进行定量和定性分析比较。其中,CA模型是由Yu等人提出的经典两阶段修复网络,网络在第二阶段引入基于缺失区域的上下文注意力模块,用于同远距离有效像素之间建立相关性。Pconv模型是由Liu等人首次针对非规则缺损区域修复提出的解决方案,用带有自动掩膜更新步骤的部分卷积层替代普通卷积。

3.2.1 定量分析

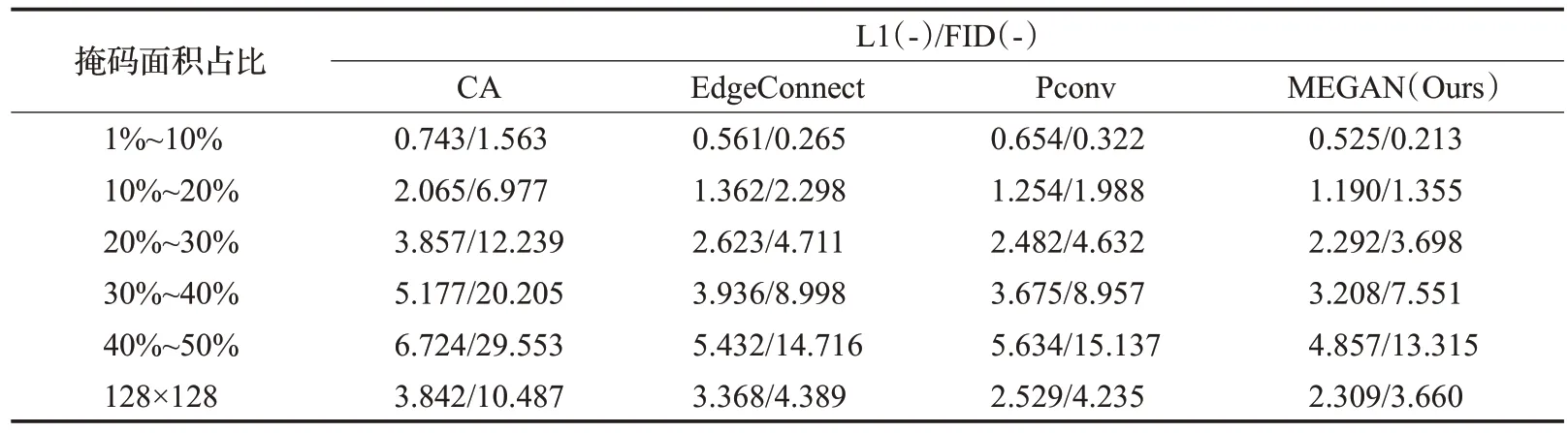

实验在Places2测试集中对四种修复方法进行定量分析比较。测试时将随机抽样的样本图像调整大小至256×256,在五组不规则掩码和一组大小为128×128 的固定矩形掩码下对图像的修复结果进行统计对比。为了测试的公平性,实验使用在Places2 测试集中随机抽样10 000张图片进行修复测试,对不同的算法在测试时均使用相同的图像掩码对。定量分析采用的统计指标分别为峰值信噪比(peak signal-to-noise ratio,PSNR)、L1损失、结构相似度(structural similarity,SSIM)和FID距离(fréchet inception distance,FID)。其中,峰值信噪比通过图像之间最大可能像素值Z和均方误差MSE来定义,测量了真实图像Igt和修复图像Ifin之间的相似度。一般而言,峰值信噪比数值越大,重建图像失真越小,重建效果越好。L1 损失展现了模型在像素级别下对图像的重建能力。SSIM 通过估计亮度,对比度和结构信息的感知变化可以更准确地表示人的主观感受。FID计算真实图像和生成图像之间特征分布的距离,分值越低即两张图像在感知上更加接近。定量比较结果如表1和表2所示。

表1 在Places2上各修复算法对应结果的PSNR/SSIM值Table 1 PSNR/SSIM values of inpainting results of each inpainting method on Places2 dataset

表2 在Places2上各修复算法对应结果的L1/FID值Table 2 L1/FID values of inpainting resultsof each inpainting method on Places2 dataset

根据数据分析显示,MEGAN在复原准确度和视觉舒适度上都取得了最优的效果。MEGAN 的修复结果相较于原始EdgeConnect算法在FID衡量指标上平均降低0.96,尤其当修复区域占比大于30%时效果更明显。其原因主要在于门控卷积的引入减少了在边缘修复时不合理边缘信息的产生,从而表现出更为真实的修复效果。当缺损区域小于10%时,各算法都能表现出较高的结构相似性和峰值信噪比。但当待修复区域的面积增大时,相较于EdgeConnect 算法,EMEGAN 算法在峰值信噪比上平均提高4.8%。同时,MEGAN 修复的图像在感官上表现出更合理的语义结构和清晰的纹理特征,尤其当修复区域占比为20%~50%时表现出最优的修复效果。

综上所述,PSNR、SSIM 指标的增加及FID 指标的降低说明MEGAN网络的修复结果更接近于真实图像,表现更加自然。L1 损失的降低说明MEGAN 可在像素级别上输出更加准确的色彩信息。

3.2.2 定性分析

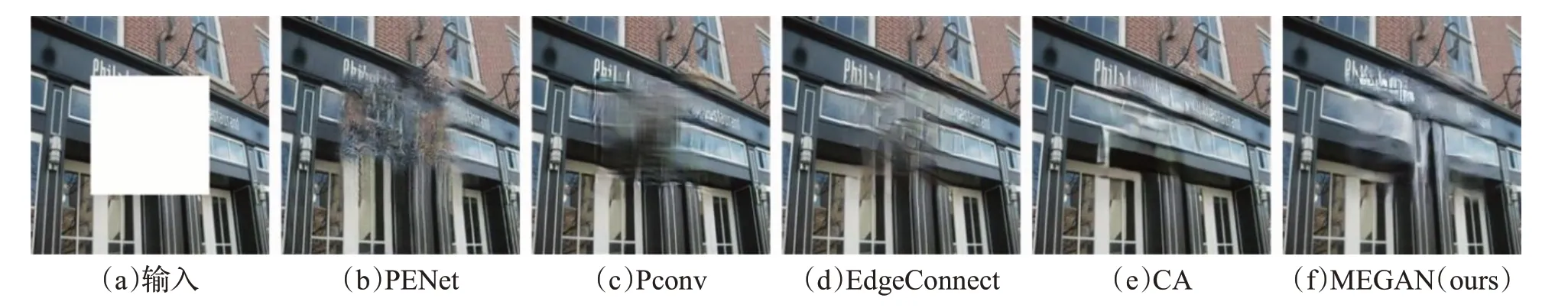

图7 展示了MEGAN 网络模型和对比算法在Places2 数据集中的修复结果。图中第一列为原图,第二列为添加了随机掩码的输入图像,第三列为部分卷积算法的修复结果,第四列和第五列分别为EdgeConnect和CA算法的修复结果,第六列为MEGAN的修复结果。

图7 各算法结果对比Fig.7 Comparison of results of each algorithm

根据对比图可以看出本文提出的方法在结构表现上更加明显,纹理更加符合视觉观感。由于MEGAN网络模型及其基本模型EdgeConnect都基于边缘条件修复思想,因此第一阶段的边缘修复结果对第二阶段的修复起着决定性作用。基本模型只通过序列化地堆叠具有单一扩张率的扩张卷积实现特征提取且没有使用门控卷积处理非规则掩码,因此存在丢失大量有效信息的情况。同时,无效像素在训练过程中产生的歧义会影响正确边缘信息的生成,产生不合理甚至杂乱的边缘信息。因此,EdgeConnect 网络在最终的补全结果中会出现明显的视觉伪影、方块状纹理和元素丢失,在掩码边缘也会产生颜色差异和模糊的纹理信息,如图7 和图8 第四列所示。

图8 128×128矩形遮挡下的修复结果Fig.8 Inpainting result under 128×128 rectangle occlusion

部分卷积算法采用的硬掩码更新的方法虽然在一定程度上减少了掩码对修复结果影响,但在迭代后期算法会将所有掩码区域都视为有效像素,因此越靠近掩码中心的区域就越会丢失结构特征进而产生模糊平滑的纹理信息,如图7 第三列所示。为缓解以上问题,MEGAN 在两个阶段中都使用门控卷积代替原本的单扩张卷积,旨在最大程度上弱化无效像素对生成结果的影响。如图7 第五列所示,CA 算法由于利用上下文注意力机制从有效的区域中选择出与缺损区域匹配度最高的纹理块进行填充,因此修复结果中显示出明显的纹理重复特征。

图8展示了以上4种修复算法及金字塔上下文编码器[24](PENnet)在128×128 固定矩形掩码下的修复结果。可以看出MEGAN 的修复结果在窗子和墙壁之间的结构处理上表现出色,PENnet、EdgeConnect 和Pconv生成了扭曲失真的结构和纹理。CA算法生成了在视觉上看似合理的纹理特征,但缺失了重要的结构特征。

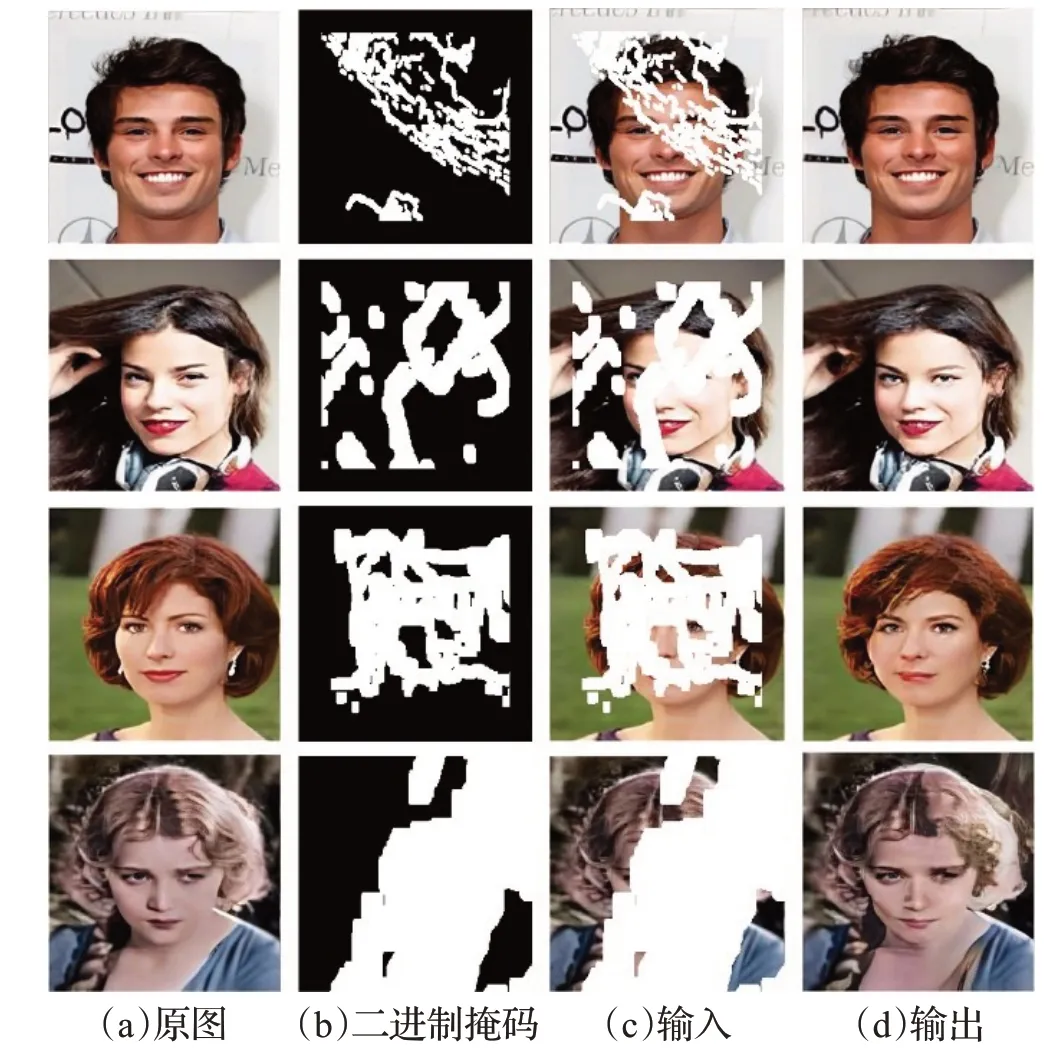

为验证MEGAN 在人脸重建上的表现力,模型在CelebA 数据集上进行了训练和测试,修复结果如图9所示。与真实图像相比,MEGAN 可以产生与原图基本一致的修复效果。当图像中有大面积缺失或缺少有效边缘信息的情况下,MEGAN 生成的面部图像虽然与实际情况有所差距,但依旧可以根据有限的像素信息推理出结构合理,纹理清晰的面部特征。图10 列举部分大面积面部信息缺失的修复实例,第一,二行中人物面部表情和细节特征产生了明显变化,第三行图中女士发型修复结果明显受到边缘信息的影响。在处理第四行的图像时,由于边缘修复网络忽略了“贝雷帽”的结构信息,因此在最终的修复结果中没有体现这一特征。

图9 在CelebA数据集上的修复结果示例Fig.9 Examples of inpainting results on CelebA dataset

4 结论及展望

本文提出一种基于边缘条件的多特征融合图像修复方法——MEGAN。通过边缘信息的指导,MEGAN网络模型中的多尺度特征提取方法可以有效捕捉图像中的上下文结构信息。门控残差结构使网络模型动态地学习有效区域与掩码区域之间的关系,尤其当缺失区域较小时可以有效提高纹理修复质量减少边缘模糊,解决了图像修复时面临的对图像损失区域内部深层结构的合理性推理问题。由于在处理不规则掩码或大面积掩码时局部判别器的作用受到限制,MEGAN使用的双谱归一化马尔可夫判别器结构可以帮助网络生成更具全局一致性的语义结构和更加准确清晰的纹理信息。

在CelebA和Places2数据集上的训练和测试结果证明,MEGAN在重建图像结构合理性和细节清晰度方面具有优秀的表现能力。由于边缘信息推理的完整度和合理性严重影响了第二阶段的图像修复效果,且边缘信息具有的稀疏性特点使其在补全方法上与图像纹理有所不同,MEGAN的后续工作将针对图像边缘的生成能力做进一步研究,以及对判别器结构做出进一步优化,提高图像修复精度和高分辨率表示。