基于无人机桥梁表观病害巡检与三维数字孪生

2023-11-17吴华勇赵荣欣余威镭贾鹏飞

王 枫,吴华勇,赵荣欣,余威镭,贾鹏飞,余 力

(1.上海市建筑科学研究院有限公司 上海市工程结构安全重点实验室,上海市 200023;2.上海大风技术有限公司,上海市 200082)

0 引言

截至2022 年底,我国仅公路桥梁的数量就已超过103 万座,其中40%在役桥梁服役年限超过20 a。随着桥梁服役年限的增长,在结构材料自身老化退化等内部因素,以及车辆荷载、地震、台风、洪水等自然灾害的外部因素综合作用下,桥梁结构运营逐渐进入高维修高风险阶段。传统桥梁检测主要由检测人员采用纸笔对桥梁病害直接识别、记录,其具有重复性强、中断交通、需高空作业等特点,导致桥梁巡检工作成本高、效率低及结果不准确。

随着物联网、近景摄影测量与机器视觉等技术的快速发展,采用无人机辅助视觉技术取代人工视觉完成桥梁检测工作逐渐成为可能[1]。目前,研究人员已采用无人机技术在沿海腐蚀环境桥梁病害巡检[2]、大跨桥梁病害图像采集[3]、公路桥梁日常与应急巡检[4]、铁路桥梁巡检[5-6]等诸多桥梁检测工作中进行了尝试。然而,因桥梁现场环境复杂多变,存在多处信号盲区,无人机无法自动采集桥梁全部信息,如梁底、盖梁及桥墩关键部位,导致无人机在桥梁自动化巡检中的应用推广受到诸多限制。

本文采用商用无人机对城市桥梁表观信息进行自动化采集与三维建模,基于机器视觉算法对桥梁表观病害信息进行分类识别与定位,通过病害与三维模型关联匹配算法实现了桥梁表观病害的三维孪生,提高了桥梁巡检的自动化程度,实现了无人机进行桥梁巡检的数字化交付。

1 基于无人机的桥梁表观信息采集

小型商用无人机具有机动、灵活、快速、经济等特点,以无人机为飞行平台,挂载多类型高性能传感器,如高像素相机,激光雷达等,构建桥梁检测图像自动化采集系统,从而实现桥梁表观信息的高效采集。相较与植保无人机、电线巡检无人机等,桥梁巡检无人机对于信息采集的要求更高,主要体现在:(1)桥梁结构空间立体尺寸复杂;(2)桥梁病害巡检需要贴近拍摄;(3)无人机易受桥梁周围树木、路灯杆、电线、建筑等的干扰。基于此,目前无人机桥梁巡检以飞手人工手动控制为主,且对飞手具有一定飞行经验与桥梁病害检测经验要求,这限制了无人机桥梁巡检人工效率的提高。

针对无人机桥梁巡检贴近拍摄的特点,提出了无人机桥梁巡检航线规划方案如图1(a)至图1(d)所示,具体包括:桥梁主体,以环绕拍摄为主;桥梁路面,保持一定高度蛇形航线飞行拍摄;桥梁侧面,保持一定距离竖向锯齿航线贴近拍摄;桥梁梁底,采用上置云台摄像头仰视巡线飞行拍摄;桥塔,采用超高清矩阵拍摄;桥梁拉索等特殊构件,采用阶梯形航线拍摄。通过多种飞行模式的组合,获得桥梁全息图像。

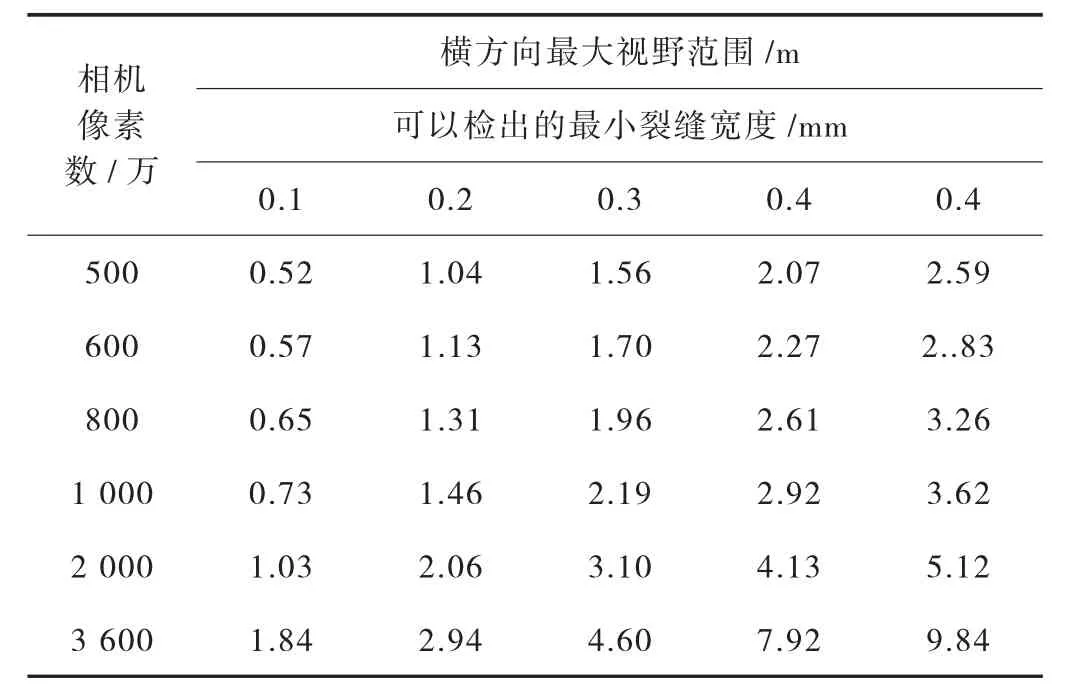

无人机采集桥梁表观病害需根据拍摄精度要求,对相机像素、焦距、拍摄距离等参数进行设置。表1 展示了相机焦距为35 mm 时,相机像素数与横视野范围、可以检出的最小裂缝宽度之间的关系。由表1 可知,当需要识别出0.1~0.2 mm 宽度的裂缝时,采用3 600 万的相机像素数,横方向最大视野范围为2.94 m,换算得到相机至拍摄物体的距离为5.03 m。因此,对于需要检测出桥梁裂缝病害的需求,需对无人机与桥梁的距离为5 m 左右时贴近拍摄。

表1 相机像素与最小裂缝宽度之间的关系

2 桥梁表观图像实景三维建模

无人机外业采集桥梁表观图像后,采用测量测量技术进行建模,将桥梁外观图像信息转化为三维数字模型。武汉大学张祖勋院士团队针对五相机倾斜摄影中有效照片比例低、成果在某些方面不可用的问题,提出了“贴近摄影测量”(nap-of-the-object photogrammetry)概念[7],贴近摄影测量技术利用无人机贴近目标物获取超高分辨率影像,通过三维地理信息提取,高度还原物体的精细结构。

本文基于倾斜、贴近两种摄影测量技术,采用自主研发的建模软件对桥梁表观信息进行实景三维建模,如图2(a、b)所示,其为上海某大桥实景三维模型。

3 基于深度学习的桥梁表观病害识别与定位

桥梁表观病害识别与定位可将其视为目标检测任务,通过目标检测算算法识别出图像是否有病害、病害的类别,病害在图像中的位置以及病害的大小。近年来,随着图像采集设备的普及,目标检测算法在人脸识别、车牌识别、工业产品缺陷检测等场景得到了较多应用,从而使计算机视觉等相关技术得到应用与发展,目标检测算法也从基于人工特征的传统算法转向了基于深度神经网络算法的检测技术。当前,最为先进的深度学习目标检测算法框架YOLOv8,它是最新的SOTA(State of the arts)技术,可以在大型数据集上进行训练,在各种硬件平台上运行,在检测精度与检测速度之间寻找到了较好的平衡点。

3.1 YOLOv8 神经网络

YOLOv8 基础输入仍然为640×640,其网络结构主干网络(Backbone)部分使用C2f 模块,检测头(Head)部分使用了无锚框(Anchor-free)及解耦合头(Decoupled-head),损失函数使用了分类BCE、回归CIOU+VFL(新增项目)的组合,框匹配策略由静态匹配改为了对齐分配器(Task-Aligned Assigner)正样本分配策略、最后10 个迭代(epoch)关闭马赛克增强(Mosaic)的操作、训练总epoch 数从300 提升到了1000。YOLOv8 神经网络架构参见参考文献[8]。

3.2 YOLOv8 模型配置与训练

本文采用了网络公开数据集与人工收集的桥梁现场工程检测图像作为样本。本次研究主要以桥梁裂缝与露筋两种病害作为研究对象,人工筛选了238张图像数据,包含裂缝照片116 张、露筋照片122 张。为了与工程应用场景接近,这些图像未经过图像的缩放、裁剪、亮度和对比度调整等。采用Labelme 工具对病害进行实例分割标注,共标注裂缝病害150处,露筋病害331 处。将这些标注好的图像按照7∶2∶1 的比例被分为训练集、验证集和测试集,用于模型训练、性能验证和测试。

在训练过程中,本文使用了预训练的yolov8n.pt模型作为初始权重,以加速模型的训练过程。YOLOv8 类别损失采用的是交叉熵损失,边框回归损失采用的是分布焦点损失(DFL Loss)加上完整的交并比损失(CIOU Loss)。本文在YOLOv8 的基础上,使用了谷歌强势推出的优化器Lion,相较与主流优化器AdamW,优化器Lion 使用参数更少,减少了复杂运算,具有更省显存与速度更快的优势。

模型训练的所有工作都是用Windows 的Pytorch框架[10]上进行的,并在配置有图形处理单元(GPU)的工作站上进行(CPU:INTEL I9-9900X,内存:16GB×6,GPU:NVIDIA GeForce RTX 2080TI×4)。模型参数设置与调优是深度学习中最为关键的一步,选择合适的模型参数对模型推理结果的准确性产生较大影响,且影响模型训练与推理时间。本文通过对训练样本的优化调整与不同参数设置组合设置,在验证集上评估其识别的准确率。在参数设置方面,最大的训练周期(epoch)设为1 000,图像的输入尺寸调整为640×640,根据工作站性能及图像样本数量设定批次大小(batch)为16。参数patience 设为50,当在最新训练的50 次后模型性能无提升时会停止训练。在超参设置方面,初始学习率与最终学习率均设为0.01,优化器的动量(momentum)设为0.937,优化器的权重衰减(weight decay)设为0.000 5。最后训练得到的YOLOv8s-seg 模型具有261 层,11 790 870 个参数及11 790 854 个梯度,每张图像的处理时间为9.9 ms。

3.3 训练结果与测试分析

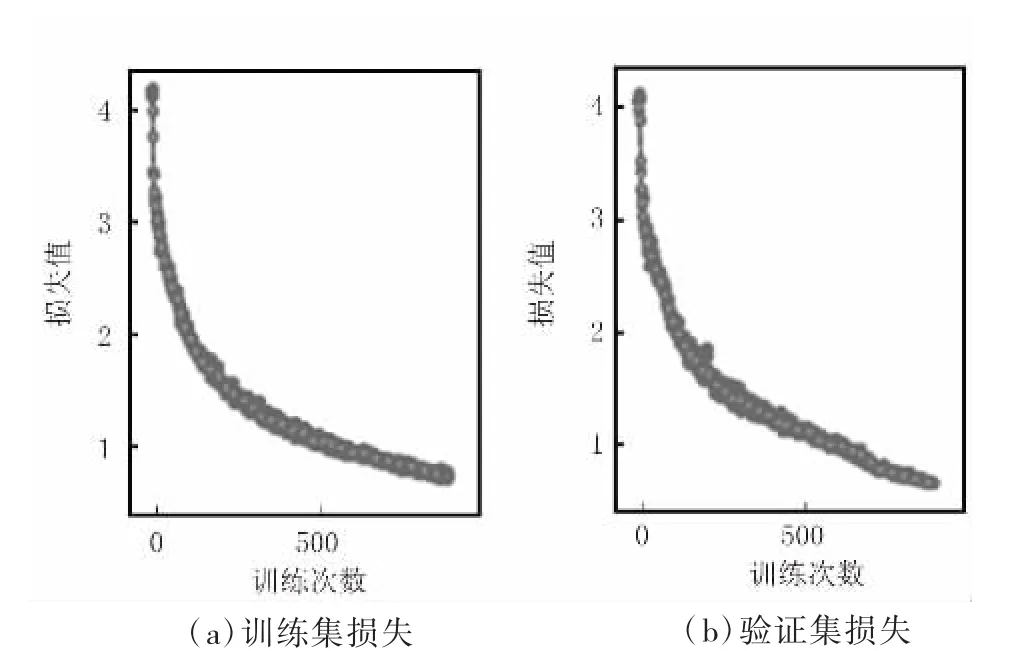

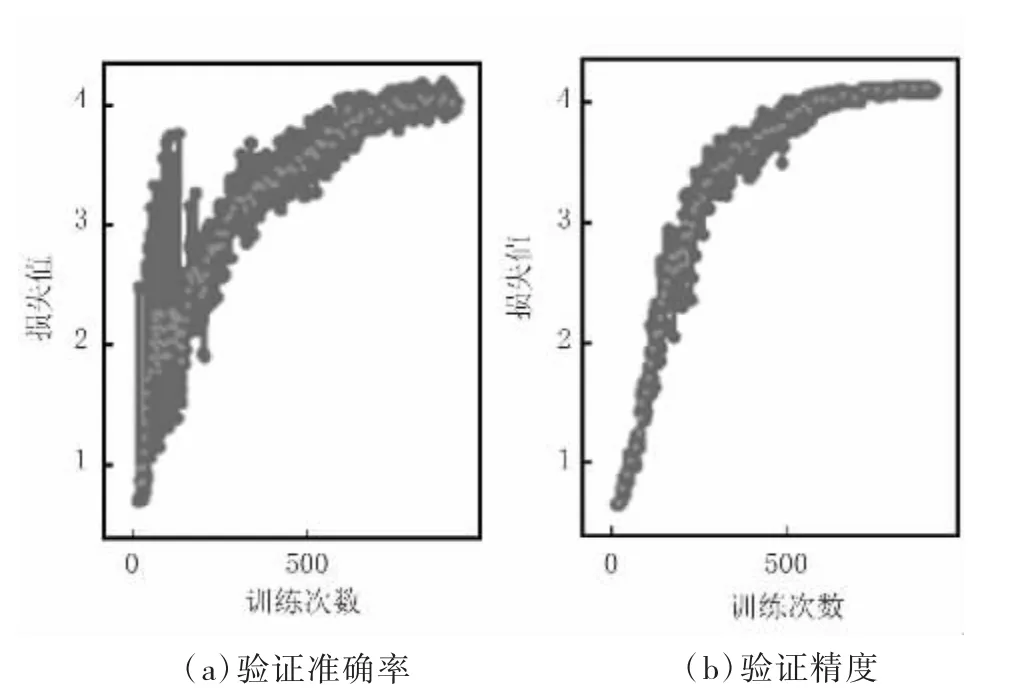

根据上节3.2 介绍的参数设置,随着随着损失函数值的逐渐下降,模型预测准确率逐步上升,当epoch为937 时,结束训练,总共用时1.24 h,训练过程中损失值与精度值的变化如下图3 与图4 所示。图5给出了测试集的混淆矩阵,可以看到预测的正样本集中于矩阵的对角线上,不同类别病害之间无混淆,仅病害与背景之间的混淆,说明该模型其在桥梁裂缝与露筋病害分类中的具有较高的准确性。此外,从该混淆矩阵可以看出,背景被识别为病害的概率较低,而病害被识别为背景的概率较高,且裂缝相较于露筋病害更易造成识别混淆,这可能与不同病害之间的图像特征的差异以及露筋样本数量高于裂缝样本数量有关。

图3 训练过程中损失值

图4 训练过程中模型精度值

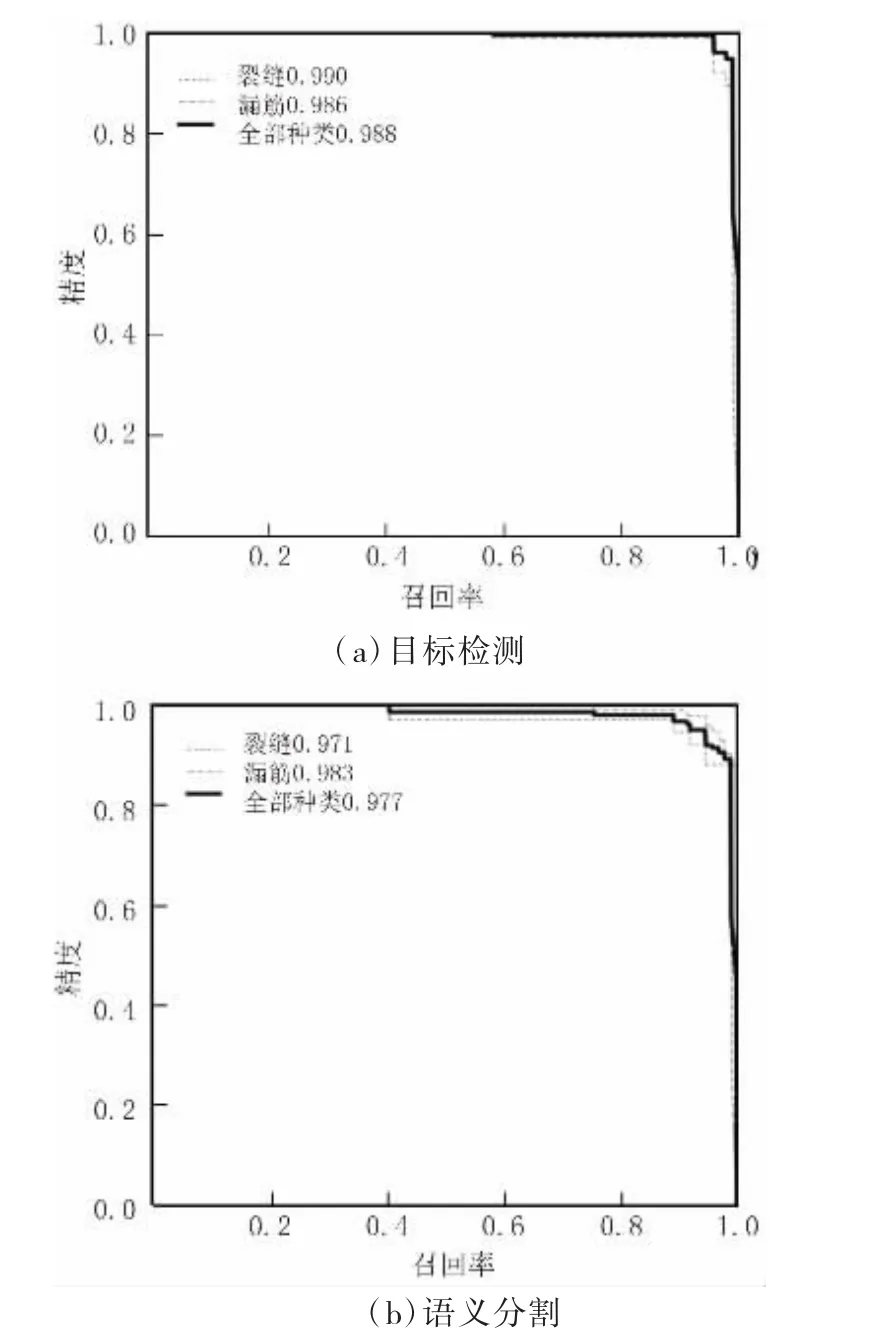

图6 所示为训练结果的准确率与召回率曲线(P-R 曲线)。图6(a)为裂缝与露筋病害的目标检测框的P-R 曲线,裂缝病害的精准率为0.990,露筋病害的精准率为0.986,平均精准率为0.988。图6(b)为裂缝与露筋病害的示例分割结果的P-R 曲线,裂缝病害的精准率为0.971,露筋病害的精准率为0.983,平均精准率为0.977。图6 结果表明,本文训练的YOLOv8s-seg 模型在目标检测任务与实例分割任务中均具有大于97%的准确率。

图6 准确率与召回率曲线(P-R 曲线)

4 桥梁表观病害三维数字孪生

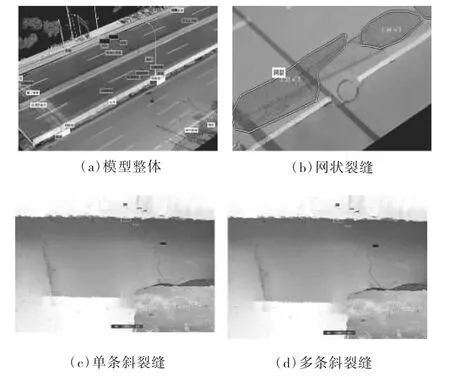

本文在第二部分桥梁实景三维建模的基础上,结合第三部分病害识别与定位算法,将识别的病害与三维实景模型关联起来以实现桥梁表观病害的三维数字孪生。桥梁病害三维数字孪生模型可以真实还原的病害在桥梁上的具体位置,病害表观纹理、病害类别与病害大小,在浏览过程中模型可以放大、缩小、移动、多角度查看纹理细节,同时可以测量病害的尺寸与面积。桥梁表观病害三维数字孪生模型建立后,检测单位可根据裂缝、露筋等病害的自动提取结果,进行进一步的量化计算,辅以桥梁模型对病害位置、尺寸信息进行汇总,最终出具检测报告。原本难以检测的桥梁梁底,可通过模型确定桥底缺陷类别、大小及位置。检测单位完成检测任务后,不仅可提交纸质或电子版的检测报告,而且可以实现检测结果的数字化交付。图7 所示为上海某大桥病害三维数字孪生模型,管养人员、业主单位人员不用去桥梁现场即可获得全面真实的桥梁病害信息及对桥梁的技术状态有清晰的认识。

图7 上海某大桥病害三维数字孪生模型

5 结语

为了实现无人机桥梁检测的自动化,本文提出了一套基于无人机桥梁自动化检测的方法与流程,并通过工程案例实践并验证了该方法的有效性。首先,采用无人机进行桥梁表观信息的采集,通过合理的航线规划与拍摄模式设置,提高表观信息的有效性与完整性。通过倾斜摄影测量与贴近摄影测量技术对无人机采集的图像信息三维建模。然后,采用深度学习算法对桥梁表观病害进行模型训练与病害识别与定位,本文采用的改进的YOLOv8 算法训练的YOLOv8s-seg 模型对于桥梁裂缝与露筋病害的识别与定位准确度可达97%以上。最后,通过三维模型与病害关联实现桥梁表观病害的三维数字孪生,该方法提高了在实际无人机桥检中的自动化操作程度,提高桥梁检测的效率和精度,实现了检测结果的数字化交付。

本文提出的无人机桥梁检测方法也存在一些潜在的限制,例如对于桥下净空较小的桥梁,无人机难以自动化采集梁底照片,数据集的质量与规模对病害自动化检测结果可能产生较大影响,桥梁三维实景建模与模型训练对硬件设备有一定要求等。未来的研究可以考虑进一步优化无人机自动化采集策略,提高桥梁病害数据集的质量与规模,同时将本文方法迁移到其它设施的表观病害检测中,如建筑外立面、大坝、烟囱等。