基于空间注意力残差网络的图像超分辨率重建模型

2023-11-14邢世帅刘丹凤王立国潘月涛孟灵鸿岳晓晗

邢世帅,刘丹凤,王立国,潘月涛,孟灵鸿,岳晓晗

(大连民族大学信息与通信工程学院,辽宁 大连 116600)

0 引 言

图像超分辨率重建的任务是将退化的低分辨率图像映射为高分辨率图像。但由于高分辨率图像会因不同类型的细节损失退化成不同的低分辨率图像,且相同的低分辨率图像可以由多个高分辨率图像退化而来,导致图像超分辨率重建较为复杂。为了解决这个问题,研究者们已经提出许多图像超分辨率重建方法,主要包括基于插值[1-2]的方法、基于重建[3-4]的方法和基于学习[5-7]的方法等。

近年来,基于深度卷积神经网络的方法在图像超分辨率重建领域表现优异。Dong 等人[8]进行了首次成功尝试,提出带有3 个卷积层的SRCNN,并且取得了优于传统算法的性能。后来,Dong 等人[9]对SRCNN 进行改进,进而提出FSRCNN,在网络的后端引入了反卷积,减少了计算量。Kim等人[10]首次提出了残差网络,并将其引入图像超分辨率重建领域中,他们提出了深度为20 层的VDSR 网络,取得了比SRCNN 更好的性能,这表明更深层次的网络可以有效地提升图像的质量。后来,Kim 等人[11]在DRCN 中引入残差学习从而减轻模型训练的难度。盘展鸿等人[12]将残差中的残差思想与空间、坐标注意力结合提出了FFAMSR 网络。Lim 等人[13]对深度残差网络进行改进,进而提出EDSR,EDSR 将残差单元中的批归一化层(Batch Normalization,BN)去掉,极大地提升了模型训练的速度。Tai 等人[14]提出了DRRN,该网络将递归思想与残差网络结合,将递归模块中的权重进行共享,从而减轻了深层网络的训练难度,取得了比VDSR 更好的结果。在这些开创性的工作之后,人们提出了许多基于卷积神经网络的方法,并且在单幅图像超分辨率中取得了不错的成果。

尽管单幅图像超分辨率已经取得了相当大的提升,但是现有的一些基于卷积神经网络的模型仍面临一些限制。随着网络深度的增加,层次特征逐渐集中于输入图像的不同方面,这对于重建图像的空间细节非常有用。然而,现有的大多数基于卷积神经网络的方法无法充分利用网络的层次特征。

为了解决大多数基于卷积神经网络的方法无法充分利用网络的层次特征的问题,本文提出一种基于空间注意力残差网络的模型(Residual Network Based on Spatial Attention,SARN)。首先设计一个空间注意力残差模块(Spatial Attention Residual Block,SARB),将增强型空间注意力模块(Enhanced Spatial Attention,ESA)[15]融入残差块中,使网络更加充分地学习图像的关键空间信息,增强特征选择能力,得到更有效的高频信息;其次,针对无法充分利用层次特征的问题,采用层次特征融合机制,对每个空间注意力残差模块提取的特征信息进行全局融合,提高网络对层次特征的利用率;最后,通过重建网络得到最终的超分辨率图像。

1 相关工作

1.1 卷积神经网络

Dong等人在2014年首先提出了一种用于图像超分辨率的浅三层卷积神经网络SRCNN,并且优于以往传统方法的性能。受此启发,众多学者相继提出许多基于深度学习的方法。Kim 等人设计了一个基于残差网络的DRCN,其中DRCN 网络层数是20层。后来,Tai 等人将递归模块引入DRRN 中,在MemNet[16]中引入记忆模块。这些方法从插值之后的低分辨率图像中提取特征,不仅占用大量内存,也耗费了很多时间,效率低。为了解决这个问题,Shi 等人[17]基于ESPCN 提出了一种高效的亚像素卷积层,其中低分辨率的特征图可以被放大到网络末端,得到高分辨率输出。此外,研究者们基于亚像素卷积层提出了许多深度网络以得到更好的性能。Ledig 等人[18]在SRGAN 中引入了SRResNet。Zhang等人[19]在RDN中通过密集连接利用所有卷积层的层次特征。Hui 等人[20]提出了一种轻量化的网络,在内存占用和网络性能之间实现最优。Wang 等人[21]提出了一种非监督退化表示学习的方法来处理未知退化模型的情况,通过引入对比学习来学习不同图像的退化表示,引入退化感知(Degradation-Aware SR,DASR)灵活适应不同退化网络。

1.2 注意力机制

目前,注意力机制[22-23]已经广泛应用于计算机视觉任务中,比如图像分类、视频分类等。其被用于解释可用资源的分配偏向于输入信号中信息量最大部分的原因。注意力机制首先是出现在Hu 等人[24]提出的SENet 网络中,这是一种全新的“特征权重标定”策略,通过注意力机制判定不同特征通道的重要程度。

近些年来,一些基于注意力机制的网络模型也开始应用于图像超分辨领域。Zhang 等人[25]将残差网络和通道注意力机制结合提出了残差通道注意力网络RCAN,通过抑制低分辨率图像中的低频信息,尽可能将网络作用在高频信息上,恢复更多的高频信息以达到更好的重建效果。实验结果表明RCAN 的重建效果优于大多数基于卷积神经网络的重建方法。Dai 等人[26]提出了一种深度二阶注意力网络SAN,该网络提出了一种新的可训练的二阶通道注意力模块SOCA 进行相关性学习,通过一个非局部增强的残差组结构捕获远距离上下文的信息。Niu 等人[27]提出了一种整体注意力网络HAN,该网络引入层次注意模块LAM,利用多尺度层次间的相关性来学习层次特征的权值,提出了通道-空间相结合的模块CSAM学习每层特征的通道和空间的相关性。

2 本文方法

本文提出一种基于空间注意力残差网络的图像超分辨率重建模型,如图1 所示,该模型由3 部分组成:浅层特征提取模块、特征映射模块、重建模块。

图1 基于空间注意力残差网络的图像超分辨率模型

2.1 浅层特征提取模块

浅层特征提取部分主要是卷积层对输入图像的初始特征提取。具体来说,采用1 个3×3 卷积层提取低分辨率图像ILR的浅层特征。计算公式为:

式中,ILR表示低分辨率图像,H3×3表示浅层特征提取,F0表示提取出来的特征,作为后续模块的输入。

2.2 特征映射模块

在特征映射模块中,首先设计了一种空间注意力残差模块SARB,将增强型空间注意力模块融入残差模块中,使网络更加专注于关键的空间信息;接着对SARB中不同层次特征进行局部特征融合(Local Feature Aggregation,LFA),增强层次特征的流动性,最后对每个SARB 的输出进行全局特征融合,充分利用不同网络的层次特征,提高层次特征的利用率,增强网络表达能力。

在特征映射模块中,SARB 支持SARB 之间的连续记忆(Continuous Memory,CM),允许前一个SARB 的输出和当前SARB 中卷积层的输出通过局部特征融合连接在一起。该模块包含20 个SARB、1 个特征融合模块、1 个1×1 卷积和1 个长跳跃连接。假设特征映射模块由D个SARB 构成,那么第d(d=1,2,…,D)个SARB块的输出Fd可以表示为:

式中,βSARB表示使用空间注意力残差模块提取特征,Fd-1、Fd表示SARB提取的特征。

接着对每个SARB 提取的特征进行全局特征融合,且使用1 个1×1 卷积层进行降维,去除冗余信息,然后通过跳跃连接和浅层特征F0构成残差学习。具体计算公式如下:

式中,Concat 表示拼接融合操作,H1×1表示1×1 卷积层,Fm表示特征映射模块的输出特征。

1)空间注意力残差模块。

EDSR 去掉了卷积模块中的BN 层以构成如图2所示的残差块,受其启发,本文提出将空间注意力机制融入残差块中,构成更强的空间注意力残差模块SARB,如图3 所示。与普通残差块相比,SARB 可以使网络更加专注于图像的关键空间信息,学习更多的高频信息。首先输入特征依次经过卷积层、ReLU 激活、卷积层和ESA 模块,然后和经过ESA 模块提取的输出进行融合、降维,最后与输入特征Fd-1跳跃连接相加实现全局残差学习。具体计算公式如下:

图3 空间注意力残差模块

式中,Fd表示第d个SARB 的输出特征,HCon1×1表示先进行局部特征融合,再进行1×1 卷积;HESA表示使用增强型空间注意力提取特征;H3×3表示3×3 卷积层,Fd-1表示第d-1 个SARB 的输出特征。σ(·)表示ReLU激活函数。

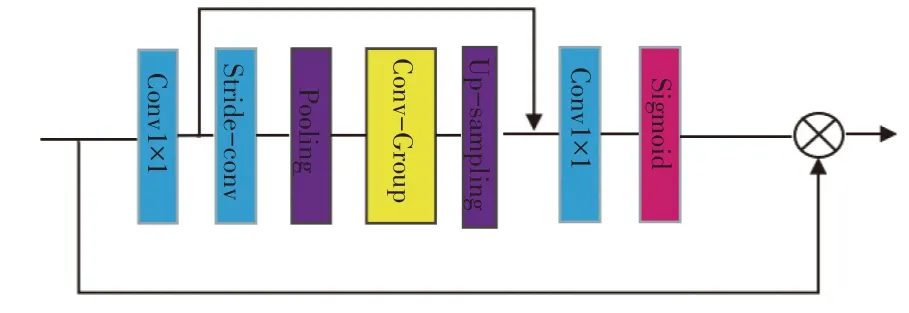

2)增强型空间注意力模块。

为了使层次特征更加专注于关键的空间信息,本文选择使用增强型空间注意力块ESA,它比普通空间注意力块更强大。设计该模块时,必须仔细考虑几个因素。首先,它将被插入网络的每个模块中,所以模块必须轻量。其次,注意力块需要一个大的感受野才能很好地完成图像超分辨率重建任务。

如图4 所示,引入的ESA 模块从1×1 卷积层开始,可以减少通道维度,从而使整个模块轻量化。为了扩大感受野范围,使用步长为2 的卷积,然后是一个最大池化层。常规的2×2 最大池化带来的感受野非常有限,因此,研究者选择使用7×7大小和步长为3的最大池化层。此外,增加上采样层恢复空间维度,并使用1×1卷积层恢复通道维度。最后特征经过Sigmoid层,与输入点乘,得到ESA的输出特征。

图4 ESA模块的结构

忽略计算量,利用非局部模块可以更好地实现空间注意力块。实际上,已经有研究者试图将非局部注意力块应用于图像超分辨率领域了。虽然它可以提升性能,但计算量较大,不符合本文引入ESA 模块的初衷。

2.3 重建模块

特征映射模块的输出特征作为重建模块的输入,利用亚像素卷积对图像进行上采样,得到最终的超分辨率图像。具体计算公式如下:

其中,Hup表示亚像素卷积操作,H3×3表示3×3卷积层,ISR表示重建的超分辨率图像。

2.4 损失函数

本文将N个低分辨率图像块ILR及其对应的高分辨率图像块IHR作为训练集,选择使用L1损失函数来优化网络,使网络具有更好的收敛性。其具体计算如下:

式中,G表示本文网络的功能,θ表示整体网络的参数集合。

3 实验与结果分析

3.1 实验环境与数据集

3.1.1 实验数据集

本文选择DIV2K[28]作为实验训练集,该数据集在超分辨率重建领域应用较为广泛。DIV2K 数据集中含有1000 张高分辨图像,其中800 张用作训练集,其余的200 张等比例构成验证集和测试集,实际上很少选择该数据集作为测试集。该数据集由多种类型的图像构成,如动物、人和建筑物等。在训练期间,通过随机旋转90°、180°、270°和随机水平翻转进行数据扩充,并使用双三次下采样得到低分辨率图像。

为了进行测试,选择Set5[29]、Set14[30]、BSD100[31]、Urban100[32]、Manga109[33]作为为本实验的测试集。数据集后的数字表示其包含图片的数量,Set5、Set14 数据集属于中小型数据集,其分辨率一般在500 左右。BSD100 数据集中包含植物、人、食物等类型的图像,该数据集为固定分辨率数据集,其包含的图像的分辨率是481×321 或321×481。Urban100属于城市建筑物数据集,该数据集中的图像含有复杂的建筑纹理。Manga109 数据集是由日本漫画家绘制的109张漫画组成。

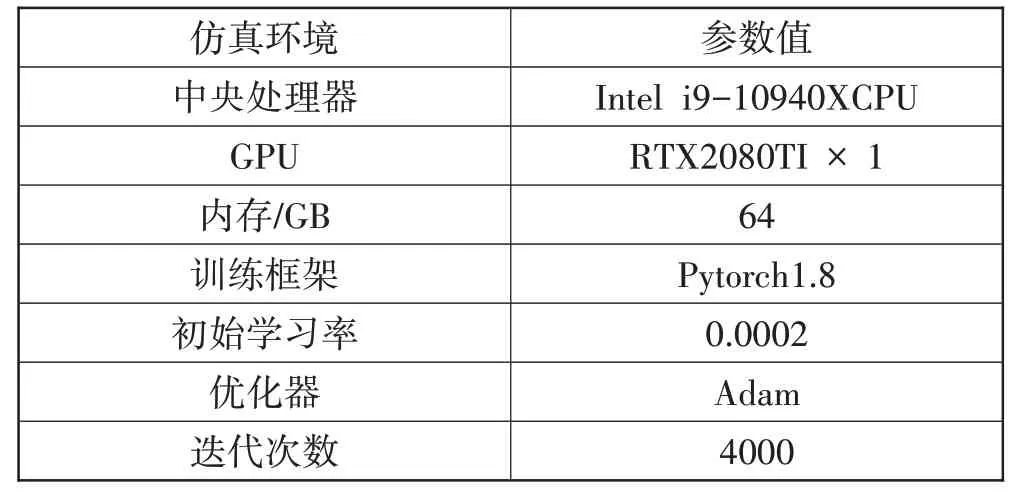

3.1.2 实验环境

实验过程中使用的设备仿真环境和相关参数设置如表1所示。

表1 仿真环境及其参数设置

3.2 实验评价指标

本文选用峰值信噪比PSNR 和结构相似度SSIM[34]作为客观评价指标,所有值都是在变换后的YCbCr通道的Y通道上计算的,介绍如下:

1)PSNR 表示图像的失真程度,其单位是dB,数值越大则表示失真越小。PSNR的计算公式如下:

式中,MSE(Mean Square Error)表示大小为m×n的当前图像I和参考图像K的均方误差,MAXI为图片的最大像素值。

2)SSIM是从图片的亮度、对比度、结构3个方面度量图像之间的相似性。SSIM 取值范围是(0,1),SSIM 的值越大表示图像失真越小,越接近于原图像。SSIM的计算公式如下:

式中,μX表示图像X的均值,μY表示图像Y的均值,σX表示图像X的方差,σY表示图像Y的方差,σXY表示图像X、Y的协方差,C1、C2、C3是常数。l(X、Y)表示图像在亮度上的相似性,c(X、Y)表示图像在对比度上的相似性,s(X、Y)表示图像在结构上的相似性。

3.3 消融实验

3.3.1 不同网络结构对模型的影响

在本小节中,研究连续记忆CM、局部残差学习LRL 和全局特征融合GFA 对实验结果的影响。表2展示了不同网络模块在Set5 测试集×2 上的PSNR 值,这8 个网络的SARB 数相同,即D=16。在实验过程中需要局部特征融合LFA来正确训练这些网络,因此默认情况下不会删除LFA。基准模型(SARN_CM0LRL 0GFA0)在没有CM、LRL、GFA 下获得,性能非常差(PSNR=34.63 dB),这表明当网络的深度达到一定时,网络的性能不再变化。

表2 连续记忆CM、局部残差学习LRL和全局特征聚合GFA在Set5测试集×2上的消融实验结果

之后,继续将CM、LRL、GFA 中的1 个添加到基准模型中,分别得到SARN_CM1LRL0GFA0、SARN_CM0LRL1GFA0、SARN_CM0LRL0GFA1(表2中第2到第4个组合)。经验证,每个组件都可以有效地提高基准模型的性能,这主要是因为每个组件都有助于网络中信息流和梯度的传输。

然后,进一步向基准模型中添加2 个组件,分别得到SARN_CM1LRL1GFA0、SARN_CM1LRL0GFA1、SARN_CM0LRL1GFA1(表2 中第5 到7 个组合),从表2 中可以看出2 个组件的性能优于1 个组件,当同时使用3个组件时,可以得到SARN_CM1LRL1GFA1(表2 中第8 个组合),从表2 中可以看出使用3 个组件的性能是最好的。

上述定量分析表明CM、LRL 和GFA 可以进一步稳定训练过程,同时可以证明本文所提的CM、LRL和GFA的有效性。

3.3.2 SARB模块数量对模型的影响

为了研究SARB 模块对模型的影响,选择数量为12、16、20、24个SARB 模块进行实验。在保证其他参数保持一致的条件下,仅控制模块的数量。表3 展示了在Set5 测试集×2 上不同数量的SARB 对模型的影响结果。从表3 中可以看出当SARB 为20 时,PSNR/SSIM 值最高,模型特征提取能力最好,因此本文实验设置SARB数量为20。

表3 SARB模块数量对模型的影响

3.3.3 ESA模块的有效性

为了研究ESA 模块的有效性,将添加ESA 模块的网络与未添加ESA模块的网络进行对照实验,其他参数保持一致,得到如表4显示的在Set5测试集×3上的PSNR/SSIM 值。实验结果表明,虽然添加ESA 模块的网络的FLOPs、Params比未添加ESA 的网络分别多15.3G,0.21M,但其PSNR、SSIM 值相比未添加ESA模块的网络有显著提升,特征提取能力更强。

表4 ESA模块有效性对比

3.4 实验结果与分析

3.4.1 客观指标分析

本文将提出的SARN 模型与8 种方法进行对比:Bicubic[1]、SRCNN[8]、VDSR[10]、DRRN[14]、Mem-Net[16]、IMDN[20]、LESRCNN[35]、SMSR[36]。 使用PSNR、SSIM 作为评估超分辨率图像质量的指标。使用5 个常用的基准数据集作为测试集,实验结果如表5 所示。

表5 数据集在不同缩放因子下超分辨率重建图像的PSNR/SSIM(PSNR的单位为dB)

本文选取一些经典的算法模型及与本文模型相关度较高的模型进行对比实验。具体对比结果如表5 所示。表5 展示了缩放因子×2、×3、×4 的定量结果比较。具体而言,对于缩放因子×2,本文的SARN 网络在所有的测试集中表现最好。当缩放因子为×3,在Urban100 测试集中,IMDN 网络的PSNR 比本文算法高0.02 dB,本文算法的SSIM 比IMDN 网络高0.002;SMSR 网络的PSNR 比本文算法高0.06 dB,但本文算法的SSIM 比SMSR 高0.001。当缩放因子为×4,本文算法在Set5、Set14、BSD100测试集中取得了最好的评估结果。在Urban100 测试集中,本文算法的PSNR 比SMSR 网络低0.03 dB,二者SSIM 一致;在Manga109 测试集中,本文算法的PSNR 比SMSR 网络高0.02 dB,SMSR网络的SSIM比本文算法低0.002。

由上述分析可知,与其他算法相比,本文算法在基准数据集上几乎能够取得最好性能。

3.4.2 感知质量评估

为了进一步衡量图像重建质量,本文引入学习感知图像块相似度LPIPS[37]与无参考图像评价指标NIQE[38]。LPIPS、NIQE 值越小,表示性能越好。表6给出了不同对比算法在Set5 测试集×4 上的对比结果。从表6 可以看出,本文算法相比其他算法表现出了最好的感知性能。

表6 不同方法在Set5测试集×4上的LPIPS、NIQE对比结果

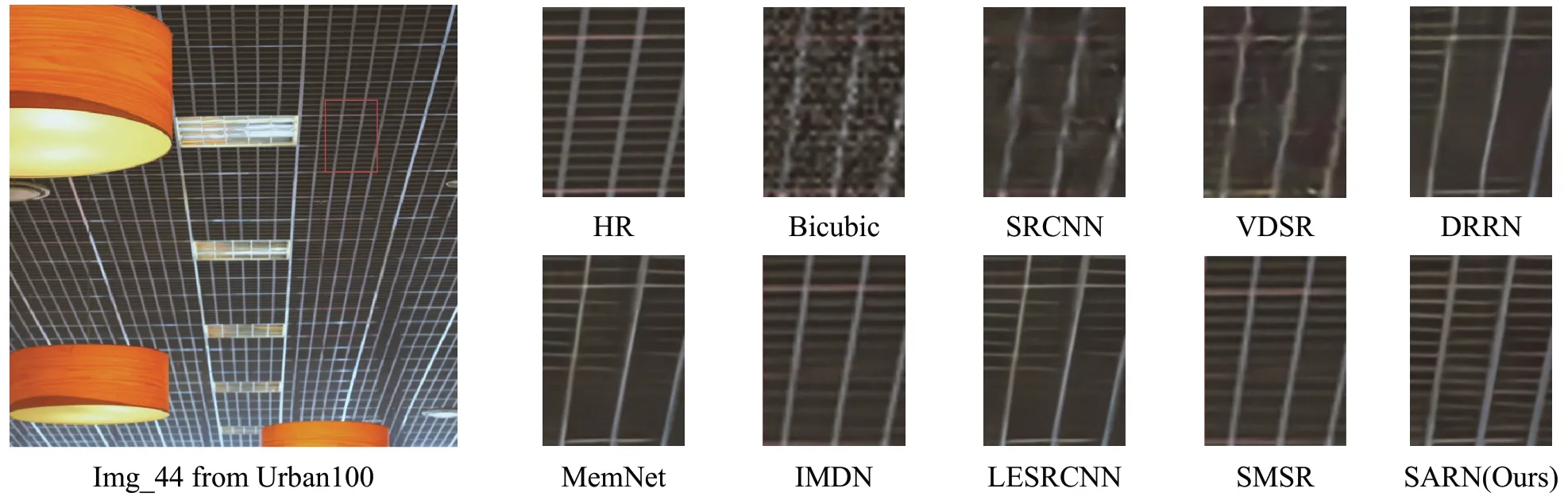

3.4.3 主观视觉分析

为了进一步验证本文算法相比其他方法更具有优越性,本文进行算法实验可视化对比,实验对比的可视化结果如图5~图7 所示。图5 是Urban100 数据集中的Img_44,图6 是Set5 数据集中的Butterfly,图7是Urban100 中的Img_34。与其他方法相比,经过本文网络模型重建后,图5 天花板窗纹理比其他图像更加清晰;图6蝴蝶翅膀上的纹理更清晰;图7从局部放大图可以看出,本文算法与SMSR 相比几乎无差别,与其他算法相比,玻璃纹理更加清晰,线条边缘更加分明、锐化。这些对比结果表明,本文提出的网络模型无论在客观评价指标上,还是主观视觉上几乎均优于其他算法,这说明本文算法可以更好地重建出图像的细节纹理和边缘。

图5 Urban100_Img_44缩放因子为×2时本文算法与其他方法的定性比较

图6 Set5_Butterfly缩放因子为×3时本文算法和其他方法的定性比较

3.4.4 模型复杂度分析

为了比较不同算法的复杂度,本文统计了各个算法的计算量(FLOPs)、参数量(Params)、运行时间(Running Time)、GPU 内存消耗(Memory Footprint)。表7 给出了不同算法在Set5 测试集×2 上的结果。从表7 可以看出,虽然本文算法的参数量、GPU 内存占用较大,但是本文算法的运行时间在毫秒级别,可以实时进行图像超分辨率重建。综合考虑表5 的客观评价指标,表6的LPIPS、NIQE对比结果和表7的各指标结果,可以看出本文算法在各项指标上相比其他算法更具有优势。

表7 算法复杂度对比

4 结束语

针对现有的一些卷积神经网络无法充分利用网络的层次特征问题,本文提出了一种基于空间注意力残差网络的图像超分辨率重建算法。该算法结合特征融合机制和注意力机制,并将其应用到SR任务中。在空间注意力残差模块中,利用特征融合有效利用网络的层次特征,进行局部特征融合,形成更具代表性的特征,并将其传输到下一个空间注意力残差模块。然后,利用全局特征融合对空间注意力残差模块的输出实现有效利用,将经过全局特征融合后的输出特征与浅层特征结合,实现全局残差学习。最后,通过重建模块即可得到最终的超分辨率图像。本文提出空间注意力残差模块作为空间注意力残差网络的构建模块,该模块结合增强型空间注意力模块和特征融合机制,可以更充分地利用网络中的层次特征。在几个基准测试集上的实验结果表明,与其他超分辨率重建算法相比,本文提出的算法在大部分客观评价指标上均有良好的表现。