基于改进显著图和局部特征匹配的copy-move窜改检测

2023-10-18赵鸿图周秋豪

赵鸿图 周秋豪

摘 要:检测整幅窜改图像的方法增加了许多非必要的计算量,为了降低计算复杂度和进一步提高检测精确率,提出了一种基于改进显著图和局部特征匹配的copy-move窜改检测方法。首先,结合图像梯度改进显著图,分离出包含图像高纹理信息的局部显著区域;其次,只对该局部区域采用SIFT(scale invariant feature transform)算法提取特征点;然后,对显著性小的图像采用密度聚类和二阶段匹配策略,对显著性大的图像采用超像素分割和显著块特征匹配的策略;最后,结合PSNR和形态学操作来定位窜改区域。在两个公开数据集上进行实验,该方法的平均检测时间小于10 s,平均检测精确率大于97%,均优于所对比的方法。实验结果表明,该方法能够大幅缩减检测时间、有效提高检测精确率,并且对几何变换和后处理操作也都具有较好的鲁棒性。

关键词:copy-move窜改检测;图像显著性;局部特征;SIFT算法;密度聚类;超像素分割

中图分类号:TP391.41 文献标志码:A

文章编号:1001-3695(2023)09-044-2838-07

doi:10.19734/j.issn.1001-3695.2023.01.0012

Copy-move forgery detection based on improved saliency map and local feature matching

Zhao Hongtu,Zhou Qiuhao

(School of Physical & Electronic Information,Henan Polytechnic University,Jiaozuo Henan 454003,China)

Abstract:The method of detecting the whole tampered image increases many unnecessary calculations.In order to reduce the computational complexity and further improve the detection accuracy,this paper proposed a copy-move forgery detection method based on improved saliency map and local feature matching.Firstly,it combined the gradient of image to improve the saliency map,and separated the local salient regions containing high texture information of the image.Secondly,it only used SIFT(scale invariant feature transform) algorithm to extract feature points in this local area.Then,it adopted density clustering and two-stage matching strategy for images with low saliency,and adopted the strategy of superpixel segmentation and salient block feature matching for images with high saliency.Finally,it combined PSNR and morphological operations to locate the tampered area.Experiments on two public datasets show that the average detection time of this method is less than 10 s,and the average detection accuracy is greater than 97%,which are better than the compared methods.The experimental results show that this method can greatly reduce the detection time,effectively improve the detection accuracy,and has good robustness to geometric transformation and post-processing operations.

Key words:copy-move forgery detection;image saliency;local feature;SIFT algorithm;density clustering;superpixel segmentation

0 引言

近年來,Photoshop和Gimp等图像编辑软件的应用日益广泛,这使得图像窜改的成本和门槛都在变低。如今,图像窜改在新闻报道、司法取证、军事领域和学术研究中均有运用,并且这些窜改后的图像能以一种近乎完美的方式呈现出来,以至于肉眼难以发觉窜改区域。这也导致许多不法分子利用这类图像进行违法犯罪活动,如在法庭上作伪证、社交网络上传播误导性信息等,由此产生的负面影响引起了社会的广泛关注。因此,有关图像真实性和完整性的取证技术变得尤为重要。

copy-move窜改是图像窜改的一种常见操作[1],它将图像中的一个或多个区域粘贴到同一幅图像的其他位置来隐藏或者复制感兴趣的图像内容,并且在窜改过程中通常会伴随着几何变换和后处理操作。几何变换包括旋转和缩放等,后处理操作包括高斯模糊处理、添加高斯白噪声等。为了检测copy-move窜改区域,学者们提出了许多copy-move窜改检测(copy-move forgery detection,CMFD)的方法,这些方法一般可以分为三种,即基于块的方法、基于特征点的方法以及基于特征点和块的方法。其中,前两种方法有相似的流程,包括图像特征提取、特征匹配、消除假匹配和定位窜改区域。

基于块的方法是将图像划分为重叠的圆形或方形的块,并从这些块中提取特征。文献[2]采用极性复指数变换(polar complex exponential transformation,PCET)和奇异值分解(singular value decomposition,SVD)对圆形块进行特征提取和降维处理,通过相似阈值估计进行块匹配。文献[3]采用离散余弦变换(discrete cosine transform,DCT)和细胞自动机(cellular automata,CA)进行特征提取,通过补丁匹配算法(patch math,PM)进行块匹配。虽然分块方法精度很高,但大量的块特征导致了较高的计算复杂度,并且该方法对几何变换的鲁棒性不强。而基于特征点的方法通过提取图像高纹理区域的特征点和描述局部特征来弥补块方法的不足。文献[4]采用尺度不变特征变换(scale-invariant feature transform,SIFT)提取特征点,通过双级过滤进行特征匹配。文献[5]将加速鲁棒特征(speeded up robust features,SURF)应用于特征提取。文献[6]采用AKAZE(accelerated KAZE)提取特征点和相应特征,通过密度聚类(density-based spatial clustering of applications with noise,DBSCAN)消除错误匹配。文献[7]通过改进SIFT算法得到增强型的RootSIFT算法,再结合相似性度量来标记窜改区域。与分块方法相比,虽然基于特征点的方法检测精度会降低,但由于它避开了穷举搜索,从而降低了运算的复杂度。基于特征点和块的方法则结合了两者的优点,为特征提取提供了新的思路。文献[8]首先提取Harris角点,再利用角点周围五个均值生成特征向量来实现窜改检测。文献[9]应用RANSAC(random sample consensus)算法消除误匹配,通过生成仿射变换矩阵来获取可疑窜改区域。文献[10,11]采用简单线性迭代聚类(simple linear iterative clustering,SLIC)将图像分成不规则和不重叠的超像素块,通过对每个块提取特征点来进行检测。文献[12,13]利用SLIC超像素分割和聚类分析将图像划分为复杂区域和平滑区域进行检测。文献[14]使用自适应形态重建(adaptive morphological reconstruction,AMR)算法结合密度聚类算法自适应划分超像素,再在多个子区域提取密集特征点,然后结合128维SIFT特征和7维局部四元数Hu矩特征来描述特征点,使得算法具有较好的鲁棒性。

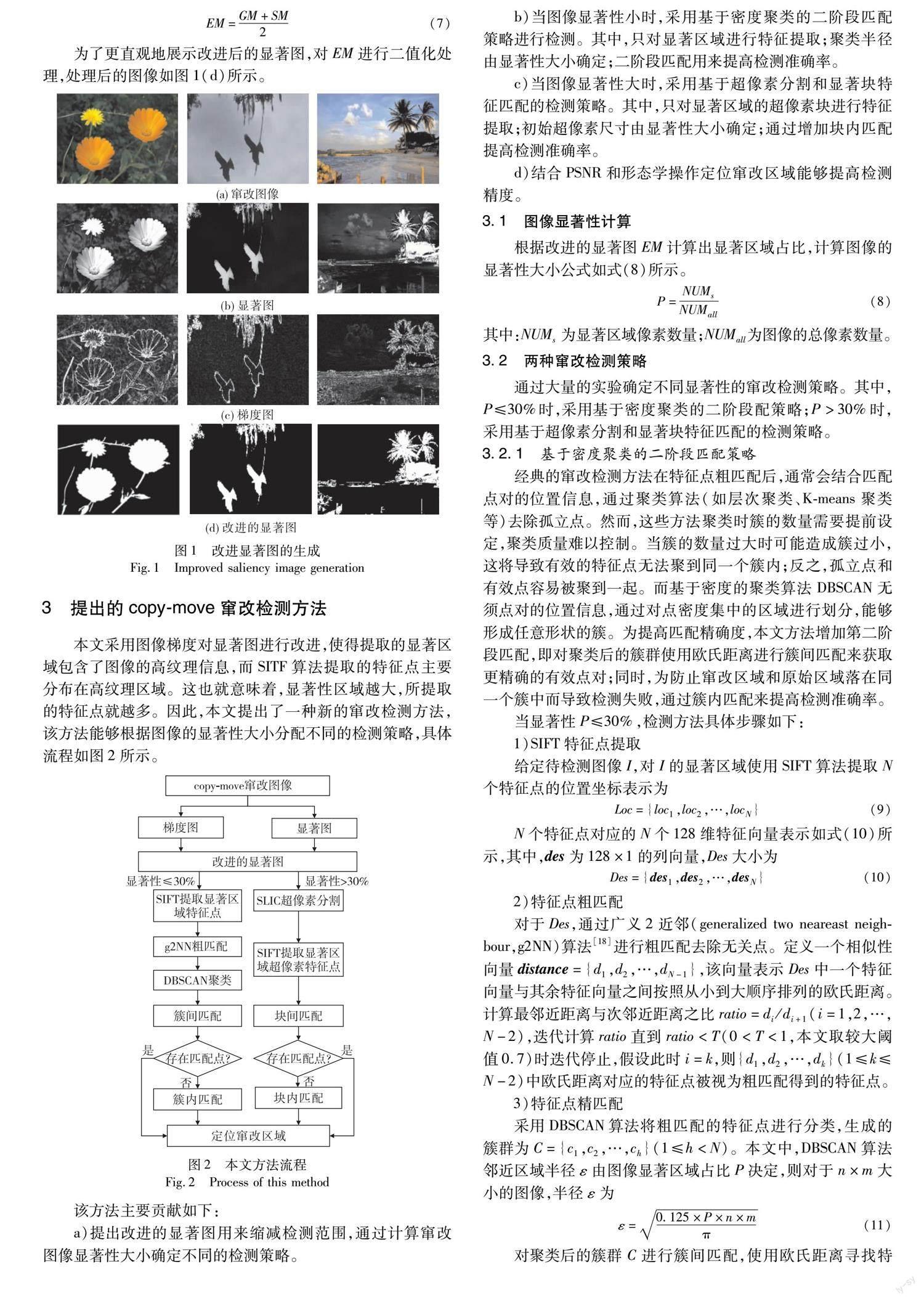

然而,copy-move窜改通常是对局部区域进行窜改,但目前的诸多算法在检测时都是对整幅图像进行特征提取,这增加了许多不必要的计算量。并且,密度聚类和超像素分割结果受参数影响较大,当窜改区域和原始区域相距较近或部分重叠时,算法可能会失效。针对上述问题,本文提出了一种结合图像显著性的窜改检测方法。该方法首先结合图像梯度对显著图进行改进,使其更好地提取图像的高纹理和显著性区域,然后根据显著性大小来分配不同的检测策略。当显著性小时,只提取显著区域特征点,然后进行粗匹配和密度聚类,再对聚类结果使用簇间匹配或簇内匹配获取匹配对;当显著性大时,先采用超像素分割获取不规则块,然后只對显著区域所在的块进行特征点提取,再通过块间匹配或块内匹配获取匹配对。其中,聚类半径和超像素块初始尺寸均由显著性大小确定。最后根据匹配对采用峰值信噪比(peak signal to noise ratio,PSNR)和形态学操作定位窜改区域。该方法通过缩减检测区域,能够大幅降低计算复杂度,并且通过簇间匹配和块间匹配能够提高检测的准确率。

4 实验仿真及分析

4.1 数据集和实验环境

实验测试样本选取文献[20]提出的Dataset数据集和文献[21]中提出的CMH数据集。Dataset数据集共有90张大小约为1 000×700或700×1 000的窜改图像,CMH数据集共有108张大小从845×634像素(最小)到1 296×972像素(最大)不等的窜改图像,两个数据集均包含了旋转和缩放攻击的copy-move窜改图像。所有实验仿真以MATLAB 2019b为实验平台,在Intel Core i5-6300HQ CPU @ 2.30 GHz,运行内存8 GB的个人电脑中运行。

4.2 方法复杂度与合理性实验

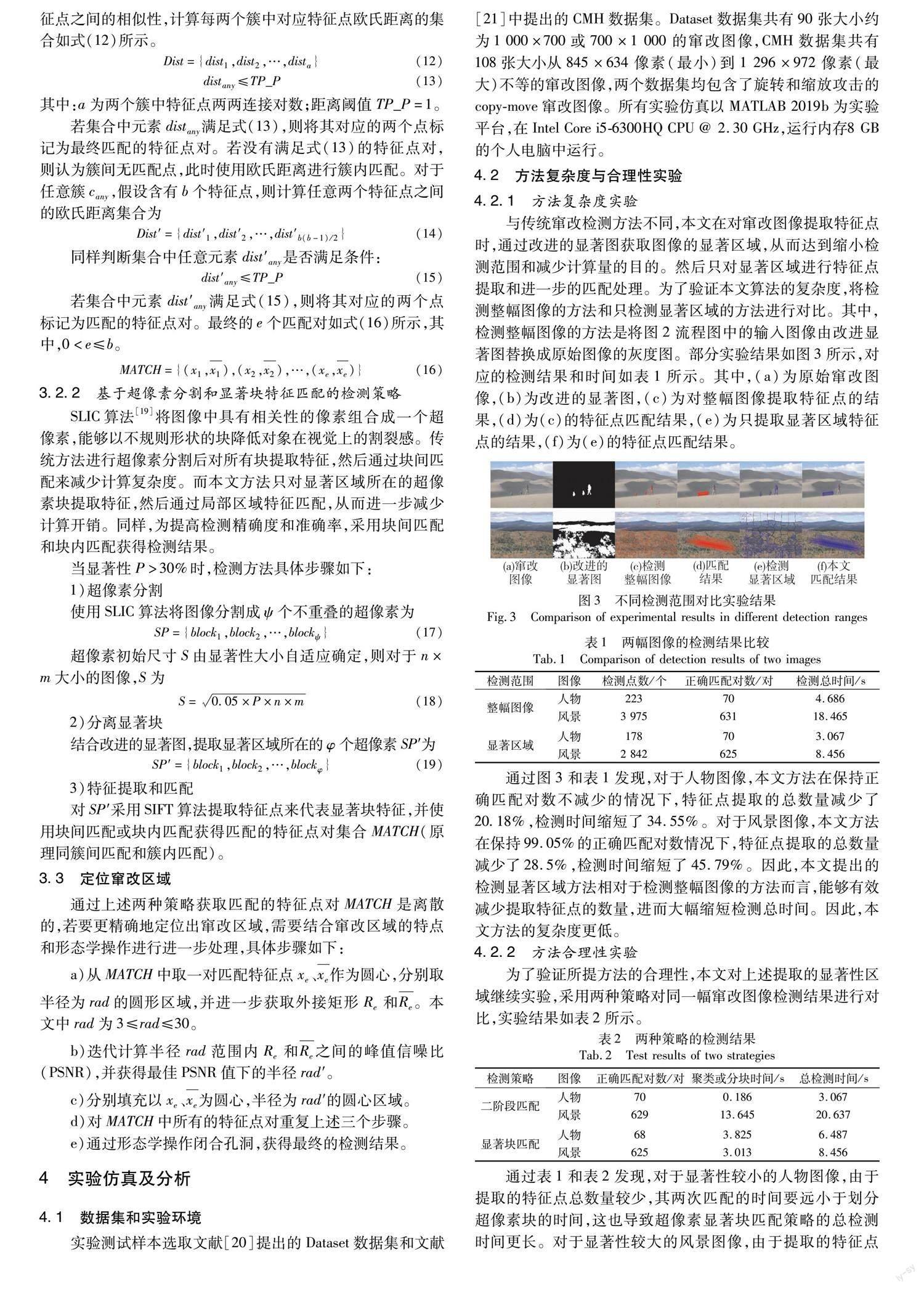

4.2.1 方法复杂度实验

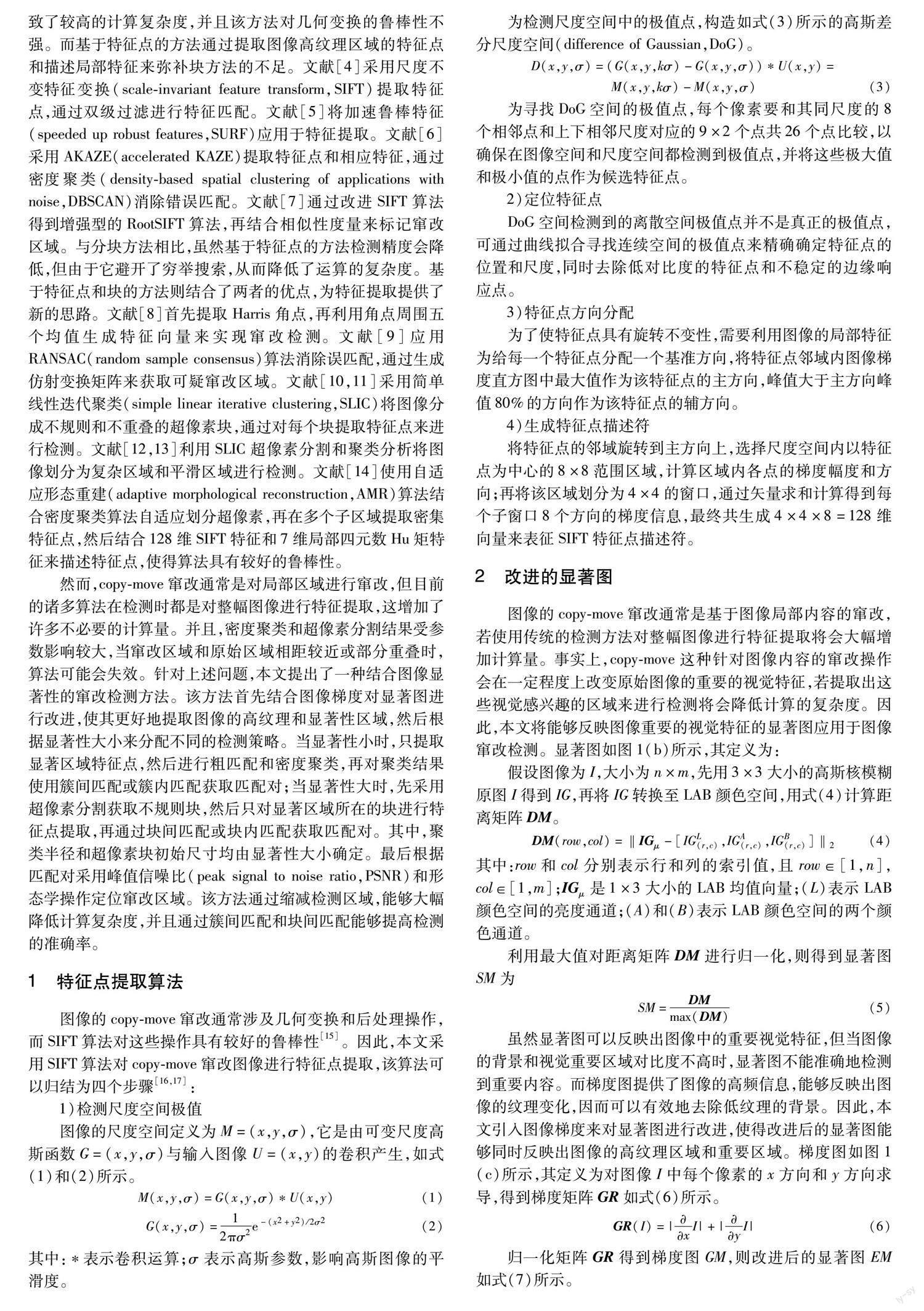

与传统窜改检测方法不同,本文在对窜改图像提取特征点时,通过改进的显著图获取图像的显著区域,从而达到缩小检测范围和减少计算量的目的。然后只对显著区域进行特征点提取和进一步的匹配处理。为了验证本文算法的复杂度,将检测整幅图像的方法和只检测显著区域的方法进行对比。其中,检测整幅图像的方法是将图2流程图中的输入图像由改进显著图替换成原始图像的灰度图。部分实验结果如图3所示,对应的检测结果和时间如表1所示。其中,(a)为原始窜改图像,(b)为改进的显著图,(c)为对整幅图像提取特征点的结果,(d)为(c)的特征点匹配结果,(e)为只提取显著区域特征点的结果,(f)为(e)的特征点匹配结果。

通过图3和表1发现,对于人物图像,本文方法在保持正确匹配对数不减少的情况下,特征点提取的总数量减少了20.18%,检测时间缩短了34.55%。对于风景图像,本文方法在保持99.05%的正确匹配对数情况下,特征点提取的总数量减少了28.5%,检测时间缩短了45.79%。因此,本文提出的检测显著区域方法相对于检测整幅图像的方法而言,能够有效减少提取特征点的数量,进而大幅缩短检测总时间。因此,本文方法的复杂度更低。

4.2.2 方法合理性实验

为了验证所提方法的合理性,本文对上述提取的显著性区域继续实验,采用两种策略对同一幅窜改图像检测结果进行对比,实验结果如表2所示。

通过表1和表2发现,对于显著性较小的人物图像,由于提取的特征点总数量较少,其两次匹配的时间要远小于划分超像素块的时间,这也导致超像素显著块匹配策略的总检测时间更长。对于显著性较大的风景图像,由于提取的特征点数量较多,导致其密度聚类的时间大幅增加,而划分超像素块的时间反而减少。这是因为图像显著性越大,划分后的每个块尺寸越大,总块数就越少,分割时间也越短。此外,二阶段匹配策略的正确匹配对数也要略高于超像素显著块匹配策略。

综上,本文对于显著性小的窜改图像采用二阶段匹配策略能够在提高匹配对数的情况下同时缩短检测时间;对于显著性大的窜改图像,采用超像素显著块匹配策略能够在对检测精确度影响很小的情况下大幅缩短检测时间。因此,本文方法具有合理性。

4.3 算法有效性实验

本文对CMH数据集中23张和Dataset数据集中50张只经过简单平移copy-move窜改检测的图像进行实验,部分实验结果如图4所示。其中,(a)为原始窜改图像,(b)为改进的显著图,(c)为两种策略的聚类结果和提取显著区域超像素特征点结果,(d)为特征点匹配结果,(e)为通过形态学操作定位出窜改区域位置,(f)为窜改图像真实的窜改区域位置。

根据图4可知,由于两个公开数据集中的窜改区域和原始区域位置相距较远,使得检测策略均为簇间匹配和块间匹配。而只有当窜改区域和原始区域有部分重叠或相距较近时,才会采用簇内匹配和块内匹配的策略。所以,为进一步体现算法的有效性,本文在dataset数据集中选取20张原始图像进行近距离或部分重叠窜改,并对这些窜改图像进行实验,部分检测结果如图5所示。

通过图4和5的检测结果发现,本文方法能够根据窜改图像的显著性大小使用不同的检测策略,并对所测试的简单平移copy-move窜改的图像具有很好的检测性能。

4.4 算法鲁棒性实验

4.4.1 几何变换窜改检测

为验证本文方法对几何变换窜改的鲁棒性,对CMH数据集中25张经历缩放窜改变换的图像(缩放因子在0.8~1.54)、25张经历旋转窜改变换的图像(旋转方向在-90°~180°)以及35张同时经历缩放和旋转的图像进行实验,部分实验结果如图6所示。

通过对比图6中真值图像发现,本文检测结果边缘部分有少数像素缺失,但是基本能够还原出窜改区域的形状和具体位置。因此,本文算法对缩放和旋转变换的窜改图像能够保持较好的检测性能。

4.4.2 后期处理窜改检测

为验证本文方法对后期处理窜改的鲁棒性,本文对两个数据集中的83张简单平移窜改图像进行高斯模糊处理和添加高斯白噪声处理。其中,高斯模糊处理的滤波窗口为3×3,模糊因子分别为f=0.5和f=2;添加噪声的均值为0,方差分别为v=0.000 5和v=0.001。部分实验结果如图7所示。

通过对比图7中真值图像和本文检测结果发现,在检测高斯模糊处理的图像时,本文检测方法对边缘细节的还原能力略微不足,使得边缘较为平滑,但即使面对模糊因子较大的高斯模糊处理仍能检测出窜改区域的基本轮廓。此外,在检测添加高斯白噪声的图像时,对于方差较大的加噪处理,本文检测结果的边缘部分会出现细微程度的漏检,存在少量像素缺失的现象,但同样基本可以检测出窜改区域的形状和具体位置。综合来说,本文方法对后期处理窜改检测能够保持良好的检测性能,具有较好的鲁棒性。

4.5 算法性能对比实验

为了更好地研究本文方法的性能,将本文方法与同样基于特征点的新兴趣点检测方法[22]、采用SLIC超像素分割和聚类分析的检测方法[13]以及基于密度聚类的AMR超像素分割检测方法[14]进行对比。采用TRP和FPR来衡量方法的检测性能,其中,TPR是窜改区域被正确检测的概率,FPR是窜改区域被检测为真实区域的概率。

TPR=正确检测出来的窜改像素数量窜改区域总像素数量

FPR=窜改像素被检测为真实像素的数量真实像素总数量

在本文采用的两个公开数据集上进行验证,并绘制简单copy-move、几何变换与后期处理操作的ROC曲线分别如图8~10所示。

通过图8发现,四种方法的TPR都在90%以上,并且FPR都小于10%,这表明四种方法对简单copy-move窜改检测均有良好的表现。而本文方法在密度聚类前后采用的二阶段匹配策略能够更好地消除误匹配,因此具有更高的TPR和更低的FPR。

通过图9发现,旋转和缩放变换都会导致检测性能降低,但TPR也都保持在85%以上,原因是四种方法提取的特征点特征都是利用它们周围领域内稳健、不变的特征来描述的,因此对几何变换都有较好的鲁棒性。本文增加的簇内匹配和块内匹配策略能够提高检测精确率,因此TPR也高于其余三种方法。

通过图10发现,后处理操作会稍大程度地降低检测性能,原因是高斯模糊和添加白噪声都会影响特征点提取的数量和位置,从而增大了定位时产生的误差。文献[22]方法检测性能下降最多,原因是过滤阶段未被移除的误匹配点会导致迭代扩展可疑区域兴趣点过程的误差增大。而本文方法在定位时通过获取矩形领域最佳PSNR来扩展可疑区域,因此具有更好的鲁棒性。

为了验证本文方法在时间复杂度上的优势,将数据集拆分为显著性小于等于30%的图像和显著性大于30%的图像,并分别使用四种方法对同一幅图像进行实验。各算法的平均检测时间如图11所示。

通过图11发现,由于本文只对显著性区域进行特征提取,并针对显著性大小分配不同的检测策略,所以大幅缩减了检测时间。文献[13]虽然也采用了时间上具有优势的超像素分割策略,但需要计算每个超像素块的像素均值、标准差以及特征点与块总像素的比率,并根据这些参数利用K-means聚类将图像的超像素划分为复杂区域和平滑区域分别进行检测,因此大幅增加了时间开销。文献[14]的方法在多个步骤中通過增加时间开销来换取检测精度,首先在区域划分时使用了密度聚类来对超像素的颜色矩进行聚类,其次为得到均匀特征点,通过反复计算特征点密集度来动态调整对比度阈值,然后在窜改区域定位时通过比较匹配点10×10领域的零均值归一化互相关系数来去除孤立点,最后再次对原图使用SLIC超像素分割和K-means聚类进一步去除孤立点,因此该方法的时间复杂度较高。文献[22]提取的新兴趣点数量较大,并且需要经过四次迭代才获得最终的检测结果,因此在时间开销上最不具优势。

综上可知,通过对比其他三种方法,本文方法对几何变换和后期处理的鲁棒性更好,并且在检测时间上也更具有优势。

5 结束语

本文提出了一种基于改进显著图和局部特征匹配的copy-move窜改检测方法。该方法首先利用梯度图改进显著图,通过获取图像的显著性区域来缩减检测范围。为减小时间开销,对显著性小的图像采用基于密度聚类的二阶段匹配策略,对显著性大的图像采用基于超像素分割和显著块特征匹配的检测策略,并通过增加簇内匹配和块内匹配来提高方法的检测精度,再利用PSNR和形态学操作来定位窜改区域。最后,在两个公开数据集上进行实验仿真。结果表明该方法的检测精度较高、时间复杂度较低,并对几何变换和后处理操作都具有较好的鲁棒性。然而,虽然本文方法对窜改视觉重要区域的图像具有较好的检测性能,但当窜改区域位于图像低纹理的平滑区域时,该方法可能无法有效定位出完整的窜改区域。因此,如何进一步提高图像平滑区域copy-move窜改的检测精确度是今后研究工作的方向。

参考文献:

[1]Fridrich A J,Soukal B D,Luká A J.Detection of copy-move forgery in digital images[C]//Proc of Digital Forensic Research Workshop.Washington DC:IEEE Computer Society,2003:55-61.

[2]Wang Yilan,Kang Xiaobing,Chen Yanjun.Robust and accurate detection of image copy-move forgery using PCET-SVD and histogram of block similarity measures[J].Journal of Information Security and Applications,2020,54(21-23):102536.

[3]Gani G,Qadir F.Copy move forgery detection using DCT,PatchMatch and cellular automata[J].Multimedia Tools and Applications,2021,80:32219-32243.

[4]Yang Jixiang,Liang Zhiyao,Gan Yanfen,et al.A novel copy-move forgery detection algorithm via two-stage filtering[J].Digital Signal Processing,2021,113(4):103032.

[5]Xu Bo,Wang Junwen,Liu Guangjie,et al.Image copy-move forgery detection based on SURF[C]//Proc of International Conference on Multimedia Information Networking & Security.Washington DC:IEEE Computer Society,2010:889-892.

[6]Zhou Xuehua,Shi Qingjie.Multiple copy-move forgery detection based on density clustering[J].Pattern Recognition and Image Analysis,2021,31(1):109-116.

[7]Sujin J S,Sophia S.Copy-move geometric tampering estimation through enhanced sift detector method[J].Computer Systems Science and Engineering,2023,44(1):157-171.

[8]趙洁,武斌,张艳.基于Harris兴趣点和空域均值信息的图像复制粘贴窜改检测算法[J].计算机应用研究,2013,30(9):2791-2794.(Zhao Jie,Wu Bin,Zhang Yan.Detection algorithm of image copy-move forgery based on Harris and spacial average information[J].Application Research of Computers,2013,30(9):2791-2794.)

[9]王任华,霍宏涛,蒋敏.RANSAC算法在同图复制鉴定中的应用研究[J].计算机应用研究,2014,31(7):2209-2212.(Wang Renhua,Huo Hongtao,Jiang Min.Application research of RANSAC algorithm on copy-move forgery detection[J].Application Research of Computers,2014,31(7):2209-2212.)

[10]Pun Chiman,Yuan Xiaochen,Bi Xiuli.Image forgery detection using adaptive over segmentation and feature point matching[J].IEEE Trans on Information Forensics and Security,2015,10(8):1705-1716.

[11]Narayanan S S,Gopakumar G.Recursive block based keypoint ma-tching for copy move image forgery detection[C]//Proc of the 11th International Conference on Computing,Communication and Networking Technologies.Washington DC:IEEE Computer Society,2020:1-6.

[12]Liu Yong,Wang Hongxia,Wu Hanzhou,et al.An efficient copy-move detection algorithm based on superpixel segmentation and Harris key-points[C]//Proc of International Conference on Cloud Computing and Security.Berlin:Springer,2017:61-73.

[13]Liu Yong,Wang Hongxia,Chen Yi,et al.A passive forensic scheme for copy-move forgery based on superpixel segmentation and K-means clustering[J].Multimedia Tools and Applications,2020,79(1-2):477-500.

[14]魏偉一,王婉茹,赵毅凡,等.基于区域划分和四元数的彩色图像复制粘贴窜改检测[J].计算机工程与科学,2022,44(7):1256-1264.(Wei Weiyi,Wang Wanru,Zhao Yifan,et al.Color image copy-move forgery detection based on region division and quaternion[J].Computer Engineering and Science,2022,44(7):1256-1264).

[15]独智序,王晓峰.基于稳健特征点的图像copy-move窜改检测算法[J].云南大学学报:自然科学版,2019,41(1):61-67.(Du Zhixu,Wang Xiaofeng.Image copy-move tampering detection algorithm based on robust feature points[J].Journal of Yunnan University:Natural Science Edition,2019,41(1):61-67).

[16]Amerini I,Ballan L,Caldelli R,et al.A SIFT-based forensic method for copy-move attack detection and transformation recovery[J].IEEE Trans on Information Forensics and Security,2011:1099-1110.

[17]Mohamed A B,Gunasekaran M,Fakhry A E,et al.2-levels of clustering strategy to detect and locate copy-move forgery in digital images[J].Multimedia Tools and Applications,2018,6(3):1-19.

[18]Prakash C S,Panzade P P,Om H,et al.Detection of copy-move forgery using AKAZE and SIFT keypoint extraction[J].Multimedia Tools and Applications,2019(7):23535-23558.

[19]Achanta R,Shaji A,Smith K,et al.SLIC superpixels compared to state-of-the-art superpixel methods[J].IEEE Trans on Pattern Analysis & Machine Intelligence,2012,34(11):2274-2282.

[20]Ardizzone E,Bruno A,Mazzola G.Copy-move forgery detection by matching triangles of keypoints[J].IEEE Trans on Information Forensics and Security,2015,10(10):2084-2094.

[21]Ewerton S,Tiago C,Anselmo F,et al.Going deeper into copy-move forgery detection:exploring image telltales via multi-scale analysis and voting processes[J].Journal of Visual Communication and Image Representation,2015,29:16-32.

[22]Zandi M,Mahmoudi-Aznaveh A,Talebpour A.Iterative copy-move forgery detection based on a new interest point detector[J].IEEE Trans on Information Forensics and Security,2016,11(11):2499-2512.

收稿日期:2023-01-03;修回日期:2023-02-14 基金项目:河南省科技厅科技攻关和软科学项目(192102310446);河南省高校基本科研业务费专项资金资助项目(NSFRF210406)

作者简介:赵鸿图(1965-),男(通信作者),河南长垣人,副教授,硕导,博士,主要研究方向为智能信息处理、数字信号处理等;周秋豪(1997-),男,河南信阳人,硕士,主要研究方向为图像处理、智能信息处理等(hao1142055898@163.com).