人体异常坐姿识别方法研究进展

2023-09-15杨观赐李林翰罗可欣何玲赵天逸孟子力卢明朗

杨观赐 李林翰 罗可欣 何玲 赵天逸 孟子力 卢明朗

摘 要:日常生活中,久坐往往会出现异常坐姿,频繁的异常坐姿导致人们患上骨骼肌肉疾病的现象愈发普遍,及时识别异常坐姿并进行提醒对人们的健康具有重要意义。文章综述了人体异常坐姿识别方法研究进展。从数据采集角度出发,将识别方法分为基于接触式传感器的人体异常坐姿识别方法,基于射频信号的人体异常坐姿识别方法,基于机器视觉的人体异常坐姿识别方法,并对这3类方法进行综述,分析各方法的特点。其中,采用接触式传感器的方法,分别从可穿戴设备和压力传感器两个角度阐述;而基于机器视觉的方法,分别从所使用的前景图像和人体骨骼关键点两个方面进行综述。最后,总结并分析了代表性人体异常坐姿数据集,统计并分析了代表性人体异常坐姿识别算法的性能表现,总结并展望了人体异常坐姿识别方法的发展趋势。

关键词:人体异常坐姿识别;传感数据理解;特征提取;机器学习;分类算法

中图分类号:TP18

文献标志码:A

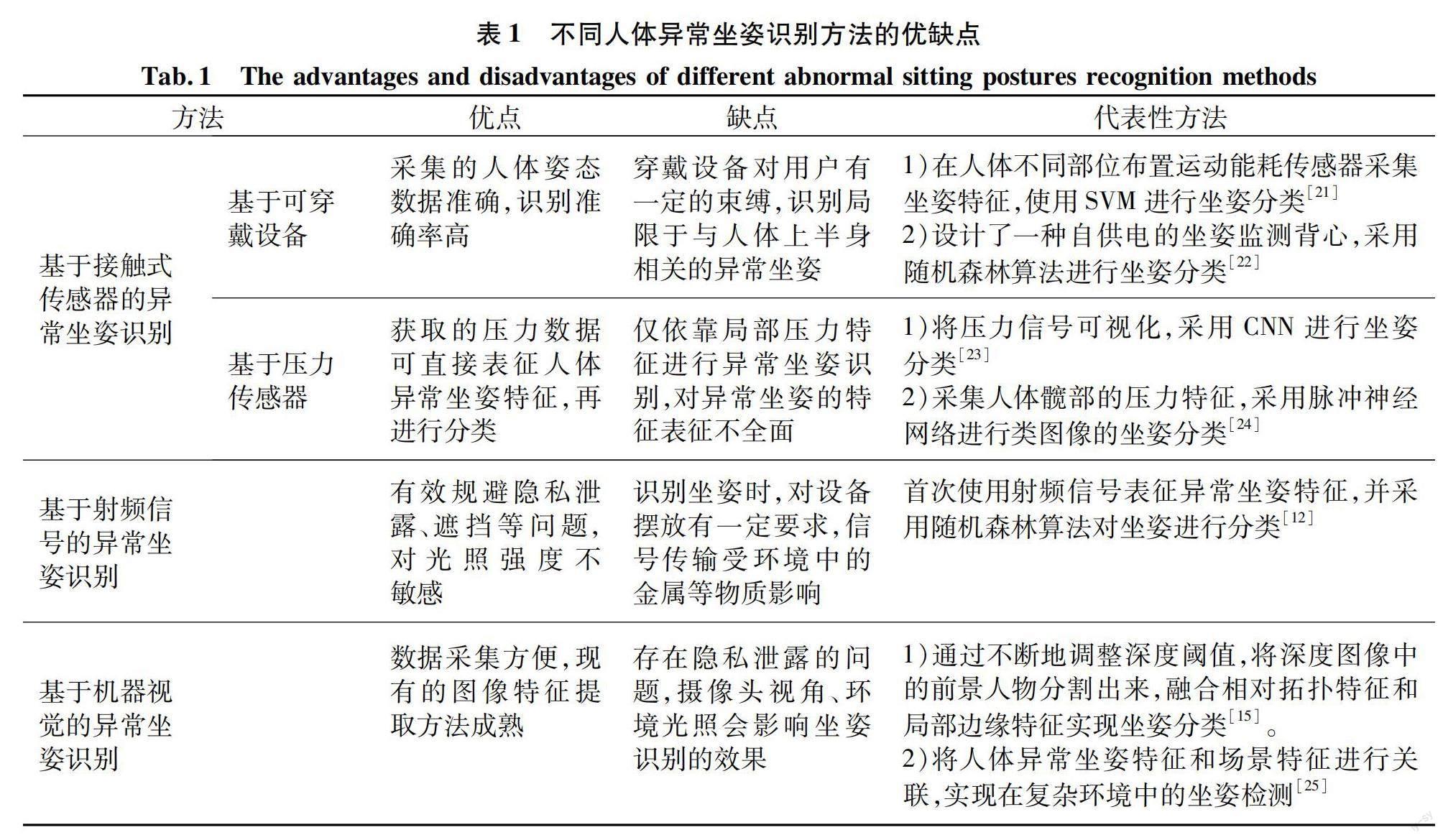

坐姿是最常见的人体姿态,在久坐的过程中,人体极易出现异常坐姿,导致患上骨骼与肌肉疾病[1-2]的风险增加,全球每年大约有200万人因长期坐姿不标准而引发相关的肌肉骨骼疾病[3]。实现异常坐姿的分类识别对人们的健康生活具有重要意义。目前,根据人体异常坐姿信息的采集方式可将坐姿识别方法分为3类:基于接触式传感器的识别方法、基于射频信号的识别方法以及基于机器视觉的识别方法。

基于接触式传感器的人体异常坐姿识别方法中,一种是通过可穿戴设备采集人体处于异常坐姿状态下的运动学数据[4-6],构建时序特征提取模型或者机器学习分类模型提取数据特征并完成分类;另一种方法则采用压力传感器收集人体异常坐姿状态下的臀部或背部压力数据,将压力数据转化为压力分布图或直接使用压力数据实现异常坐姿的特征提取与分类[7-11]。该方法能够捕获更精准的人体异常坐姿特征数据,但存在特征冗余或者缺失的问题,同时接触式传感器长时间使用会造成数据误差,影响异常坐姿识别效果。

当前采用射频信号进行人体异常坐姿识别的研究较少,该方法通常使用FRID标签和射频天线记录人体异常坐姿的射频信号[12-13],再借助现有的信号滤波器对射频信号进行平滑等预处理,最后使用分类算法提取射频信号特征并完成分类。

基于机器视觉的人体异常坐姿识别方法中,通常先对RGB/RGBD图像进行预处理,得到人体异常坐姿的前景图像[14-16]或者骨骼关键点数据[17-20],再通过现有的机器学习或深度学习方法,设计分类模型并进行异常坐姿特征的提取,最后完成坐姿的识别与分类。该方法采集的数据通常需要较大的存储空间,且图像在大部分情况下仅包含人体上半身特征。画面采集的视角、光照变化会直接影响分类器的识别性能。

表1总结了各方法的优缺点。上述3类有关异常坐姿的分类识别方法,以不同的方式采集有关异常坐姿特征的数据,在进行特征提取的阶段,主要以机器学习或者深度学习模型作为特征提取器,最终完成异常坐姿的识别与分类。本文旨在从不同人体异常坐姿识别方法的角度,对该领域当前的研究现状进行论述,重点针对各类方法的数据采集方式和分类算法进行了归纳和总结,对具有代表性的人体异常坐姿数据集和分类识别算法进行了论述,最后对未来的研究趋势进行了探讨。

1 基于接触式传感器的人体异常坐姿识别方法

1.1 基于可穿戴设备的人体异常坐姿识别

为了识别人体异常坐姿,采用可穿戴设备时,主要借助各类传感器(如加速度计、陀螺仪等),采集坐姿变化过程中的运动学参数数据,通过机器学习方法提取坐姿特征,完成人体异常坐姿的识别。基于可穿戴设备的人体异常坐姿识别流程如图1所示。该类方法的识别准确率往往较高,但这些方法多以识别与人体上半身相关的坐姿为主,没有考虑和下半身特征关联的坐姿,且一些可穿戴设备的舒适性较差。

Tang等[4]为了识别日常生活中的7种异常坐姿,首先自制了包含4个IMU(international measurement unit)惯性单元的可穿戴设备,该设备用于采集人体动静状态交替期间背部的运动学特征,包括速度、加速度等。其次,通过LSTM网络提取相关数据中的特征并完成异常坐姿的分类与识别,实验结果显示该方法对7种异常坐姿的平均识别准确率达到了99%以上。但该方法采用的特征提取器LSTM存在参数量大、计算资源消耗多的问题,无法达到实时检测坐姿的效果。为了能够实时检测到异常坐姿,Riandy和Petropoulos[26]将IMU放置在人体脊柱处采集异常坐姿数据,通过惯性传感器单元记录的数据计算脊柱倾角,并使用蓝牙与移动应用程序通信,当程序发现脊柱傾角不在正常范围内时,系统会通过可穿戴设备或应用程序进行提醒。该方法实现了实时检测坐姿并进行反馈的效果。

为了验证传感器数量以及人体坐姿特征类型对坐姿识别的影响,Tang等[21]在人体7个不同部位(包括脚踝、手腕、臀部以及大腿处)布置人体运动能耗传感器采集人体坐姿的加速度数据,采用支持向量机模型对坐姿特征进行分类。该方法表明在使用两个传感器时识别效果优于使用单个传感器,当模型采用基于方向的坐姿特征进行识别时表现最佳。Ko等[6]则使用内置了4个MEMS(micro electro mechanical systems)传感器的可穿戴设备,采集人体左右肩膀和左右盆骨在人体不同坐姿状态下的关节旋转角和位置数据,构建k-means算法实现对不同坐姿特征的聚类,判定坐姿是否异常,但该方法易受传感器采集的异常数据的影响。

Jiang等[22]基于摩擦电纳米发电机设计并制作了一种自供电的坐姿监测背心,该背心通过采集不同坐姿的电压信号数据,分析电压特征,实现坐姿的分类。对比3种不同的机器学习分类器的识别效果,结果表明随机森林算法的分类性能最佳。该方法能够识别包括正常坐姿在内的6种坐姿,但背心的束缚较强,且无法检测与人体下半身相关的异常坐姿。Gupta等[27]使用无线Trigno IM传感器(内含加速度计和陀螺仪)采集人体分别处于5种异常坐姿状态下颈部、肩部以及腰部的加速度和周转率数据,对比支持向量机等4种算法的分类识别效果,结果表明随机森林算法的识别效果最优。Sinha等[28]为了识别人体异常坐姿,使用手机内置的惯性传感器采集5类人体异常坐姿的运动学数据。再通过基于粒子群优化模型的相关性特征选择算法进行特征的筛选,最后使用支持向量机分类器达到了最优的特征分类效果。

借助可穿戴设备,能够实现较高准确率的异常坐姿识别。此类方法将特征选择的重心放在与人体上半身相关的异常坐姿上,后续工作可考虑采用人体全局的坐姿特征,在丰富识别特征的同时,扩增可识别的异常坐姿种类。

1.2 基于压力传感器的人体异常坐姿识别

采用压力传感器识别人体异常坐姿的方式主要分为两种:将压力特征转换为图像,采用图像分类的方法识别异常坐姿;直接使用压力特征进行识别的方式。表2是相关方法的总结。

在基于压力传感器的人体姿势识别方法中,Fan等[23]和Liu等[29]使用分布式压力传感器获取人体在异常坐姿状态下的臀部压力数据,并将其可视化为压力热图。其次,基于CNN对压力热图进行分类,完成人体异常坐姿的识别。基于该方法集成的异常坐姿识别系统可以嵌入到坐垫中并实现实时检测。但对于与压力热图相似的坐姿,系统会出现误判的问题。为了避免压力数据采集的偶然性,Yuan等[31]进行多次人体异常坐姿压力图像的采集,并用CNN网络提取图像特征完成坐姿分类。实验证明使用该种采集数据的方式比连续采集数据方式的分类准确率高出11.61%。但该方法能够识别的异常坐姿种类仅有4种。Wang等[24]则使用由力敏电阻器集成的传感器采集人体处于异常坐姿状态下的髋部压力数据,并将压力分布图编码成余弦秩稀疏数据,然后使用液体状态机和逻辑回归分类器构建了脉冲神经网络,用于对15种坐姿进行分类。该方法证明了SNN(spiking neural network)可以解决类图像的分类问题,但在异常坐姿识别领域,该方法的分类精度较低。为了在识别坐姿的过程中尽可能地减少算力资源并降低功耗,Licciardo等[32]基于改进的全卷积网络(fully convolutional networks[36])提取人体处于异常坐姿状态下的臀部压力数据特征并进行分类,采用二基数的量化策略限制映射的物理资源量。

为了提高压力传感器在采集人体异常坐姿时的灵敏度以及感测范围,Huang等[33]基于纤维素和纳米纤维的复合材料设计一种瞬态双型传感器用于采集相关人体异常坐姿的压力数据。再采用深度神经网络对异常坐姿进行分类,实验结果显示该方法的识别准确率高达97%,且支持多人的坐姿识别。Wan等[30]在识别人体异常坐姿时,通过阵列压力传感器系统采集人体臀部的压力图像,再采用基于模板卷积的方法实现对压力图像的定位和角度矫正,最后采用基于多项式核函数的支持向量机模型实现对异常坐姿的分类。该方法在进行坐姿分类前,设计了一种臀部定位算法对臀部压力图片进行预处理,该算法具有较好的数据处理效果。但此方法检测的坐姿种类较少,系统的泛化性较差。在仅使用压力传感器采集异常坐姿压力数据的情况下,分类器易于错分具有相同躯干状态的坐姿。为了解决该问题,Zhang等[34]采用压力传感器和红外传感器相结合的方式采集人体处于异常坐姿时的臀部压力分布图和红外图像,采用双流卷积神经网络的结构,每个分支采用ResNet残差连接。该模型提取两种数据中不同的特征,最后将特征进行融合,实现坐姿的分类。该方法在识别具有相似压力分布的坐姿的同时,还起到了保護用户隐私的作用。

为了识别人体异常坐姿,上述方法将人体局部的压力进行可视化,通过机器学习算法对图像进行分类,完成异常坐姿的识别。而压力可视化后因图像相似导致分类器对坐姿误判的问题,仅依靠压力的相关特征往往难以解决问题,而随着传感器技术的发展,借助多种传感器采集不同模态数据已经成为了解决此类问题的突破口之一。

采用压力可视化的图像进行异常坐姿识别时,可用的图像特征分类器较多。但压力可视化的过程间接增加了异常坐姿识别的工作量。为了简化识别流程,直接利用有关人体异常坐姿的压力特征。Ran等[35]使用阵列压力传感器采集有关人体异常坐姿的臀部压力数据,并对比测试了7种机器学习算法的分类性能,结果表明ANN的分类效果最佳,随机森林算法的实用性最佳。该方法集成到树莓派上实现了实时检测的效果。Ahmad等[8]使用丝网印刷压阻传感器收集了4种坐姿的压力数据,经数据统计获取了臀部压力的平均值、和值等统计特征,基于决策树算法完成了坐姿的分类。为了更高效地识别人体异常坐姿,Arshad等[9]设计了两组基于压力传感器的数据采集方案,分别使用6个压力传感器和2个压力传感器外加1个超声波传感器采集数据。基于采集的相关数据,使用KNN等4种机器学习算法进行对比测试,结果表明在采用第2种数据采集方案的情况下,使用随机森林算法识别异常坐姿时,效果最优。分析可知超声波传感器采集的前倾和后倾坐姿数据相比于仅采用压力传感器进行数据的采集,坐姿特征更明显,有利于算法进行特征提取和分类。但该方法识别的坐姿较少,应采集更多的坐姿数据进行测试。Shen等[10]自主设计了一种可以识别并提醒用户纠正异常坐姿的智能座椅——SeatPlus,该座椅基于使用内嵌在坐垫里的压力传感器采集人体的坐姿压力数据,通过WiFi将数据传输至云端,采用MLP模型提取压力数据的特征,完成坐姿的识别,系统再将识别结果返回到App上,提醒用户调整坐姿,该系统的坐姿识别准确率超过90%,纠正坐姿的有效性超过70%,但是系统的纠正频率对用户使用舒适度有影响。

Gelaw等[7]使用2块32×32的压力阵列传感器分别采集受控和真实场景下人体臀部和背部的压力数据,通过手动选取特征,将80维的坐姿特征压缩至64维,使用K折交叉验证的方法,对比随机森林等5种分类器的性能,实验结果显示在使用受控数据集时,深度神经网络的性能最优。该方法虽然取得了较好的分类结果,但能够识别的坐姿种类较少,且在特征选择的过程中存在偶然性。杜英魁等[11]使用端云结合的技术设计了一种基于电阻式薄膜压力传感器的坐姿识别系统,该系统采集人体臀部和腿部的压力数据,使用复合限幅滤波方法对数据进行预处理,再结合倾轴系数对数据进行降维。将终端的压力特征数据传输至云端,最后经过云端的二层结构支持向量机算法实现坐姿的分类,可以有效识别4种异常坐姿,但系统缺少对异常坐姿的预警和提醒功能。

上述基于压力传感器进行人体异常坐姿识别的方法中,通过采集人体局部压力(臀部、背部等)数据,再使用各类机器学习分类器提取坐姿特征,可以完成异常坐姿识别任务。而坐姿变化时,人体其他部位通常也会出现压力的变化,如颈部、腿部等,仅依靠局部位置的压力特征进行异常坐姿的分析不够充分。

2 基于射频信号的人体异常坐姿识别方法

射频信号是一种高频交流变化电磁波。当前,射频技术已经在人体行为识别、人体姿态识别等领域得到了广泛的应用。针对使用机器视觉技术识别人体行为存在隐私保护[37]、暗光和遮挡时识别效果差等问题[38],许多研究逐渐关注如何使用射频技术来解决这些问题。Li等[39]将有关人体行为的射频信号转换为人体3D骨架,如图2所示,再将人体3D骨骼信息与视频流中的信息融合进行识别。Wang等[40]基于射频信号进行人体连续的行为识别,在对射频信号进行去噪后,采用双窗口的方式减少连续行为分割时的累计误差,在两类行为上的活动识别准确率达到了90%。Huang等[41]则将FRID接收信号进行可视化,如图2中的射频信号热图,将图像输入时空卷积神经网络进行行为识别。使用射频信号进行人体姿态识别时,Hu等[42]基于可重构的智能平面设计了一套射频感知系统进行人体姿态识别,该系统可以根据环境提供合适的信号传播途径和多样化的传输信道,进而改善识别的效果。Chen等[43]为了识别头部姿态,使用FRID采集并识别头部姿态信息,并基于独立成分分析方法提取微弱的反射射频信号,识别准确率达到了91%。Chen等[44]使用FRID采集的连续手势信息,通过结合基于k均值的矢量量化器和字符串匹配算法,能够实时识别顺序手势,在识别交警指挥手势时准确率达到了96.2%。异常坐姿作为一种人体姿态,有越来越多的工作开始使用射频信号进行人体异常坐姿识别。

基于射频信号进行人体异常坐姿识别时,使用射频卡(标签)和射频天线记录不同坐姿的射频信号,再基于滤波等信号处理方法提取相关特征,最后使用机器学习方法实现异常坐姿的分类。图3是异常坐姿射频信号数据采集方式的示意图。

Feng等[12]首次采用射频信号实现了对不同坐姿的分类。根据不同坐姿状态下标签和天线之间的距离不同,该方法首先将3个FRID标签贴在人体背部脊柱处的外衣上,由射频天线传递信号,通过相位移动校准算法去除相位序列数据中的噪声,最后经过手动选取相位序列中的特征,进行坐姿的分类测试,结果显示使用随机森林算法的平均识别准确率达到了98.83%。该方法识别准确率高,在不同场景下算法鲁棒性较好,且该方法可以有效保护用户隐私。而由于FRID标签贴在外衣上,衣服的厚度和褶皱会对识别结果产生影响,同时长期监测异常坐姿对于该系统是一个考验。Li等[13]基于不同坐姿的射频信号,对坐姿进行分类。首先,将标签和天线放在用户的两侧以采集异常坐姿的射频信号数据,由于不同的坐姿的呼吸幅度有差异,通过计算射频信号的相位差获取不同坐姿的呼吸幅度信息,再基于PCA对数据进行降维处理,最后使用BP神经网络提取数据特征完成分类。该方法能识别的异常坐姿种类较少,对标签和天线的摆放位置有一定的要求。且FRID的标签成本高于普通标签,数据加密的安全性不够高。

使用射频信号记录人体异常坐姿相关信息并进行坐姿识别可以有效保护用户隐私,且不受遮挡、光线等环境因素的影响,实用性强,但对于设备摆放位置要求严格,且环境中的金属等物质会影响射频信号的传输。

3 基于机器视觉的人体异常坐姿识别方法

得益于机器学习在视觉领域的快速发展[45-46],基于机器视觉的图像分类方法在人体异常坐姿识别领域中得到应用。为了识别异常坐姿,此类方法通常使用各类视觉传感器采集人体异常坐姿的图像信息,对图像进行预处理后,使用机器学习算法识别图像特征并进行坐姿分类。根据数据预处理方式的不同,可以分为两类不同的坐姿识别方法,表3总结了不同方法的特点。

3.1 基于前景图像的异常坐姿识别方法

基于机器视觉识别人体异常坐姿,图像的背景会影响识别效果。如何去除背景、提取图像前景中的人体特征对坐姿的识别至关重要。

Zeng等[16]使用Kinect深度摄像头采集14类异常坐姿的深度图像,基于笛卡尔平面投影的方法,得到相关的投影图像,再对投影图像进行PCA降维处理,得到最终的投影特征。将投影特征与前视图的HOG特征进行融合得到新的姿态特征向量,最后基于随机森林算法对特征向量进行分类。武松林等[47]则采用背景轮廓消减法提取运动前景,通过投影的方式提取人体运动前景的肤色区域,再采用PCA算法提取肤色灰度图中的坐姿特征,完成了8类坐姿的分类。Sun等[15]使用Kinect深度摄像头采集9类异常坐姿的深度图像,为了提取前景中的人体坐姿,基于平滑滤波和高斯模型不断调整深度阈值,再使用最终的深度阈值提取前景人体坐姿图像,根据人体坐姿图像获取人体上半身6个关节点的信息,基于关节点信息提取坐姿的相对拓扑特征和局部边缘特征,将这些特征进行融合,使用KNN算法实现坐姿的分类。Sun等[14]為了识别人体异常坐姿,使用Kinect摄像头采集8类人体异常坐姿的深度图像,基于人体索引采样函数捕捉图像中的人体区域,去除背景,最后使用基于宽度学习的神经网络框架提取人体坐姿图像特征,完成分类。

由于型体、坐姿差异性以及摄像头角度变化等因素会影响坐姿识别的准确性,黄安义等[48]提出了一种多输入多输出的CNN模型。首先对采集的RGBD图像进行直方图均衡化、中值滤波等预处理,经预处理的图像在三维坐标上进行投影,之后将得到的3种视图作为MIMO(多输入多输出)-CNN的输入,从前后和左右两个方向对坐姿进行分类。刘敏等[49]通过对人脸的检测实现了异常坐姿的识别,该方法首先通过MTCNN[50]算法检测出人脸的5个关键点,再采用背景差分方法提取人体轮廓,基于图像中肩膀的ROI区域,使用轮廓多边形近似算法定位肩膀上的2个关键点,最后将人脸关键点和肩膀关键点组合成高维向量,采用SVM进行坐姿分类。为了减少背景对坐姿识别时的影响,丰婧等[51]同样采用背景减法分离人体异常坐姿图像的前景和背景,提取出人体坐姿信息,基于多尺度金字塔结构分层构建了9种坐姿的PHOG特征,采用随机数森林算法实现了9种坐姿的分类。

3.2 基于人体骨骼关键点的异常坐姿识别方法

在提取人体异常坐姿的前景图像时,需要处理的图像数据量较大。为了减少计算量并提取特征丰富的坐姿数据,越来越多的研究关注如何采用人体骨骼关键点实现异常坐姿的识别[52]。当前,获取人体骨骼关键点的方式主要有两种:基于深度相机获得拥有三维坐标信息的骨骼关键点[53]和基于姿态估计算法捕获RGB图像中的人体骨骼关键点[25,54]。通过对骨骼关键点进行图像化或直接利用骨骼点坐标特征进行异常坐姿的识别。

Yao等[17]使用Kinect2.0深度相机获取人体关节点坐标信息,根据颈部和躯干处的关节点坐标计算颈部夹角和躯干夹角,并与正常坐姿下的夹角信息进行对比,以此判断坐姿是否正常。该方法对于标准夹角的设定缺乏依据,需要进一步验证。Min等[55]为了能在复杂环境下识别人体异常坐姿,提出了一种用于在屏幕前阅读时的坐姿检测方法,该方法首先使用Kinect摄像头提取人体骨骼关键点信息,再使用Faster R-CNN[56]模型检测场景中的物体并提取相关特征,将人体骨骼关键点信息和物体相关特征进行融合,基于高斯混合行为聚类方法进行坐姿的识别和场景的理解。与其他方法相比,该方法能够在复杂环境下实现异常坐姿识别。基于同样的数据采集方法,邹芳园等[18]利用人体与屏幕之间的空间方位关系提取与坐姿强相关的特征,并使用浅层CNN网络提取时空信息,完成异常坐姿分类。

相比使用姿态估计算法获取人体骨骼关键点进行异常坐姿识别的方法,基于深度摄像头直接获取人体骨骼关键点的方式更为便捷,但相比于普通摄像头,深度摄像头造价昂贵。随着深度学习的发展,基于姿态估计算法识别人体坐姿的方法愈发成熟。图4总结了基于人体骨骼关键点的异常坐姿识别流程。

为了能在嵌入式平台上开发出识别异常坐姿的系统,房志远等[19]通过自适应批量归一化层候选评估模块对OpenPose算法[57]进行剪枝优化处理,达到快速估计人体姿态的目的,再将人体上半身骨骼关键点特征与通过卷积神经网络提取的RGB图像特征进行融合,最后采用ANN实现了坐姿特征的分类。同样使用OpenPose算法提取人体上半身的骨骼关键点信息,郑佳罄等[58]则采用双目视觉系统采集人体异常坐姿图像,再使用改进的半全局匹配算法计算双目图像视差,得到骨骼关键点的深度信息,最后计算头部倾角,根据设定的阈值判断坐姿是否正常。而陈锦涛等[59]则通过人脸关键点检测的方法,计算头部倾角,基于OpenPose算法估计人体肩部姿态,根据头部和肩部的组合方案,最后可以识别12种不同的异常坐姿。但根据阈值进行坐姿判定的方法缺少人体工学和医学依据,相关研究需要在人体医学证明基础上重新衡量判定的阈值。

Chen[60]为了识别学生的异常坐姿,使用OpenPose姿态估计算法提取人体姿态,并将图像背景去除,仅剩人体骨架信息,基于Keras搭建19层卷积神经网络进行特征提取,完成分类。Liu等[20]构建了一种基于人体骨骼关键点的3D-CNN模型用以实现人体姿态识别,首先基于采集的RGBD图像提取人体骨骼关键点,采用边界框的方法对关键点坐标进行归一化,再对人体骨骼关键点进行高斯体素建模,最后使用3D-CNN[61]模型对建模数据进行特征提取和分类。该方法实现了对各种坐姿的识别,但对人体骨骼关键点建模时计算量大且耗时长。考虑到CNN不能有效地捕捉长期依赖关系,Fang等[62]采用改进的Vision Transformer[63]模型提取坐姿特征,由于原模型需要大量数据进行预训练并且忽视样本之间潜在的关系,该方法在原模型的基础上引入了Convolutional Stem[64]以及外部注意力[65]模块克服上述问题,之后在分割片段(segmented patch)前后加入位置嵌入层获取更多有关坐姿的位置信息。该方法以带有人体骨骼关键点信息的图像作为输入,证明了改进模型的有效性。

总体上而言,为了识别人体异常坐姿,多数方法仅关注与人体上半身特征相关联的坐姿,尽管图像数据中包含了大量有关异常坐姿的特征,但仍然缺少能够识别和全身相关的异常坐姿特征。同时基于图像进行异常坐姿识别时,涉及到用户隐私保护问题[66],虽然使用人体骨骼关键点数据进行识别在一定程度上可以规避这类问题,但提取人体骨骼关键点的过程易受遮挡、光照变化等因素的干扰,导致识别无法达到良好的效果。

4 人体异常坐姿数据集与识别算法性能分析

4.1 人体异常坐姿数据集

根据当前主要的人体异常坐姿识别方法中使用到的数据采集传感器类型,可将人体异常坐姿数据集分为3类,表4总结了文献中的异常坐姿识别数据集。

数据集D1—D3使用压力传感器阵列获取人体异常坐姿的静态压力分布热图,其中,在数据集D1中,采集到19名志愿者的15类异常坐姿数据,种类最为丰富;而在数据集D2和D3中,采集到的异常坐姿种类和使用的志愿者数量较少。当基于压力传感器收集人体异常坐姿数据时,往往只关注获得人体臀部或背部的压力特征,而导致其他部位的特征缺失。数据集D4使用可穿戴设备采集人体异常坐姿发生时的运动学特征参数,如加速度、速度等,该数据集采集了6名志愿者的5类异常坐姿数据,数据量达到了16万。然而,该种方式采集的数据往往存在特征冗余的问题,需要在使用分类器提取特征之前进行预处理。上述这些数据集的构建均使用了接触式传感器。由于长期使用,这些传感器的精度会下降,导致收集的数据出现误差,进而影响异常坐姿的识别效果。在数据集D8—D12中,均使用视觉传感器(Kinect深度摄像头等)获取人体异常坐姿的RGB或者RGBD图像数据,同时基于图像数据可以获取人体骨骼关键点信息[19,62]。这些数据集的规模较大,采集到的异常坐姿种类和数据采集对象较多,占用存储空间大,且只采集到人體上半身静态的异常坐姿信息,而有些异常坐姿的形成与人体下半身相关,因此,目前通过视觉传感器构建的人体异常坐姿数据集,存在占用空间大、特征不全的问题。

4.2 人體异常坐姿识别算法分析

随着机器学习技术在智能家居、健康医疗等领域的应用和发展以及人们对健康生活愈发的重视,越来越多的机器学习分类算法开始应用到人体异常坐姿识别上,表5总结了代表性人体异常坐姿识别算法性能。

使用传统机器学习分类算法进行异常坐姿分类识别时,多数研究会关注随机森林分类算法,该算法对数据量要求不大,训练容易,且可以处理具有高维度特征的数据,虽然该算法对具有相似特征的数据敏感,但通过主成分分析等特征预处理方法可剔除相似特征。使用深度学习分类算法进行异常坐姿识别的研究中,多以卷积神经网络模型作为特征分类器。由于平移不变性和参数共享等特点,卷积神经网络十分适合提取异常坐姿压力热图以及RGB图像中的信息。近年来,随着ViT[63]等基于Transformer[68]进行改进的图像分类算法的兴起,出现了使用此类算法进行异常坐姿识别的研究,但该类算法需要大量的数据进行预训练。

5 结束语

近年来,得益于传感器技术和机器学习的发展,基于不同类型传感器采集人体异常坐姿数据并进行坐姿识别的方法取得了长足的进展,本文从数据采集角度出发对现有的人体异常坐姿识别方法进行了分类,并对各类识别方法采用的数据采集方式、特征提取与分类方法进行了归纳总结。采用接触式传感器识别人体异常坐姿时,由于能采集到精确的坐姿数据,误差较小,因此该方法普遍采用较为简单的机器学习分类模型,但当前的工作多采用人体上半身的坐姿特征为研究对象;基于射频信号的人体异常坐姿识别方法通常先对采集的数据进行去噪等预处理,再进行特征的提取与识别,该方法可以保护用户隐私,且可以有效处理遮挡的问题,但在设备的使用有严格要求;深度学习在视觉领域的广泛应用[69],促进了使用机器视觉技术识别人体异常坐姿的发展,基于各类神经网络模型提取图像坐姿特征能提升识别准确率,但容易受摄像头角度、光照等因素影响。最后,从数据集和分类算法的角度出发,对具有代表性的人体异常坐姿数据集和坐姿分类算法进行了综述。总体上而言,人体异常坐姿识别领域取得了一定的进展,但在数据集构建、数据特征融合以及实际应用方面仍然值得进一步研究。

1)人体异常坐姿数据集构建。人体异常坐姿识别方法的检测效果与丰富的数据特征密切相关。然而,当前工作构建的数据集仅包含人体局部的坐姿特征[24,32-33]。然而,一些异常坐姿的识别通常与全身的特征相关,因此在采集异常坐姿数据时,考虑人体全身的特征[70]是有必要的。

2)多模态数据融合。特征的提取对于异常坐姿的识别至关重要,多种特征融合能发挥多种模态数据的优势。采用多类型传感器数据融合的方式进行异常坐姿识别,可以弥补单一传感器采集的坐姿特征缺失的问题,提升异常坐姿的识别效果,同时能克服一些传感器本身存在的问题[71-72]。

3)多人异常坐姿识别。当前,多数工作主要关注单人异常坐姿识别问题,而在现实生活中存在多人处于异常坐姿状态的问题,在群体行为识别领域[73],依然缺少针对多人异常坐姿识别问题的数据集以及高效的识别方法。

参考文献:

[1]HU Y F, HUANG T Q, ZHANG H J, et al. Ultrasensitive and wearable carbon hybrid fiber devices as robust intelligent sensors[J]. Acs Applied Materials & Interfaces, 2021,13(20): 23905-23914.

[2] BUCKLAND A J, BEAUBRUN B M, ISAACS E, et al. Psoas morphology differs between supine and sitting magnetic resonance imaging lumbar spine: implications for lateral lumbar interbody fusion[J]. Asian Spine Journal, 2018,12(1): 29-36.

[3] GEBREYESUS T, NIGUSSIE K, GASHAW M, et al. The prevalence and risk factors of work-related musculoskeletal disorders among adults in Ethiopia: a study protocol for extending a systematic review with meta-analysis of observational studies[J]. Systematic Reviews, 2020, 9(1). DOI: 10.1186/s13643-020-01403-9.

[4] TANG H Y, TAN S H, SU T Y, et al. Upper body posture recognition using inertial sensors and recurrent neural networks[J]. Applied Sciences-Basel, 2021,11(24). DOI: 10.3390/app112412101.

[5] RIANDY R, MICHRANDI N S, ASTUTI N R. The development of a wearable biofeedback trainer to increase quality of sitting posture[C]//The 2nd International Conference on Data and Information, Bandung, Indonesia, 2019. Bristol, England: IOP Publishing, 2019.

[6] KO K R, CHAE S H, MOON D, et al. Four-joint motion data based posture classification for immersive postural correction system[J]. Multimedia Tools and Applications, 2017,76(9): 11235-11249.

[7] GELAW T A, HAGOS M T. Posture prediction for healthy sitting using a smart chair[C]//Advances of Science and Technology, Bahir Dar, Ethiopia, 2021. Cham: Springer International Publishing, 2022.

[8] AHMAD J, ANDERSSON H, SIDEN J. Screen-printed piezoresistive sensors for monitoring pressure distribution in wheelchair[J]. IEEE Sensors Journal, 2019,19(6): 2055-2063.

[9] ARSHAD J, ASIM H M, ASHRAF M A, et al. An intelligent cost-efficient system to prevent the improper posture hazards in offices using machine learning algorithms[J]. Computational Intelligence and Neuroscience, 2022, 2022: 7957148.

[10]SHEN Z Y, WAN X, JIN Y C, et al. Seatplus: a smart health chair supporting active sitting posture correction[C]//International Conference on Human-Computer Interaction, 2021. Berlin, German: Springer, 2021.

[11]杜英魁, 姚俊豪, 劉鑫,等. 基于电阻式薄膜压力传感器组的人体坐姿感知终端[J]. 传感器与微系统, 2020,39(1): 78-81.

[12]FENG L, LI Z, LIU C, et al. Sitr: sitting posture recognition using RF signals[J]. IEEE Internet of Things Journal, 2020,7(12): 11492-11504.

[13]LI M Y, JIANG Z H, LIU Y T, et al. Sitsen: passive sitting posture sensing based on wireless devices[J]. International Journal of Distributed Sensor Networks, 2021,17(7). DOI:10.1177/15501477211024846.

[14]SUN W T, ZHOU Z, LI H J. Sitting posture recognition in real-time combined with index map and BLS[C]//Proceedings of the 2019 3rd International Conference on Innovation in Artificial Intelligence, Suzhou, China, 2019. New York, NY: Association for Computing Machinery, 2019.

[15]SUN B, ZENG X, LIU T C, et al. Sitting posture detection using adaptively fused 3D features[C]//IEEE 2nd Information Technology, Networking, Electronic and Automation Control Conference (ITNEC), Chengdu, China, 2017. IEEE, 2017.

[16]ZENG X, SUN B, WANG E L, et al. A method of learners sitting posture recognition based on depth image[C]//Proceedings of the 2017 2nd International Conference on Control, Automation and Artificial Intelligence (CAAI 2017), 2017. Paris, France: Atlantis Press, 2017.

[17]YAO L, MIN W, CUI H. A new kinect approach to judge unhealthy sitting posture based on neck angle and torso angle[C]//International Conference on Image and Graphics, Shanghai, China, 2017. Berlin, German: Springer, 2017.

[18]鄒芳园, 闵卫东, 崔浩, 等. 基于多关联特征的屏幕阅读坐姿健康性判别[J]. 图学学报, 2019,40(5): 892-899.

[19]房志远, 石守东, 郑佳罄, 等. 基于神经网络的骨骼特征融合下坐姿快速识别[J]. 传感技术学报, 2022,35(5): 613-620.

[20]LIU J B, WANG Y, LIU Y C, et al. 3D posturenet: a unified framework for skeleton-based posture recognition[J]. Pattern Recognition Letters, 2020,140: 143-149.

[21]TANG Q, JOHN D, THAPA-CHHETRY B, et al. Posture and physical activity detection: impact of number of sensors and feature type[J]. Medicine & Science in Sports & Exercise, 2020,52(8): 1834-1845.

[22]JIANG Y, AN J, LIANG F, et al. Knitted self-powered sensing textiles for machine learning-assisted sitting posture monitoring and correction[J]. Nano Research, 2022,15(9): 8389-8397.

[23]FAN Z, HU X, CHEN W M, et al. A deep learning based 2-dimensional hip pressure signals analysis method for sitting posture recognition[J]. Biomedical Signal Processing and Control, 2022,73. DOI: 10.1016/j.bspc.2021.103432.

[24]WANG J Q, HAFIDH B, DONG H W, et al. Sitting posture recognition using a spiking neural network[J]. IEEE Sensors Journal, 2021,21(2): 1779-1786.

[25]李丽, 张荣芬, 刘宇红, 等. 基于多尺度注意力机制的高分辨率网络人体姿态估计[J]. 计算机应用研究, 2022, 39(11): 3487-3491.

[26]PETROPOULOS A, SIKERIDIS D, ANTONAKOPOULOS T. Spomo: IMU-based real-time sitting posture monitoring[C]//IEEE 7th International Conference on Consumer Electronics-Berlin (ICCE-Berlin), Berlin, Germany, 2017. New York, NY: IEEE, 2017.

[27]GUPTA R, GUPTA S H, AGARWAL A, et al. A wearable multisensor posture detection system[C]//International Conference on ENT Computing and Control Systems, Madurai, India, 2020. New York, NY: IEEE, 2020.

[28]SINHA V K, PATRO K K, PLAWIAK P, et al. Smartphone-based human sitting behaviors recognition using inertial sensor[J]. Sensors, 2021,21(19). DOI: 10.3390/s21196652.

[29]LIU W J, GUO Y F, YANG J, et al. Sitting posture recognition based on human body pressure and CNN[C]//3rd International Conference on Advances in Materials, Machinery, Electronics(AMME 2019), Wuhan, China, 2019. Melville, NY: AIP Publishing LLC, 2019.

[30]WAN Q L, ZHAO H M, LI J, et al. Hip positioning and sitting posture recognition based on human sitting pressure image[J]. Sensors, 2021,21(2). DOI: 10.3390/s21020426.

[31]YUAN L Q, LI J. Smart cushion based on pressure sensor array for human sitting posture recognition[C]//IEEE Sensors, Sydney, Australia, 2021. New York, NY: IEEE, 2021.

[32]LICCIARDO G D, RUSSO A, NADDEO A, et al. A resource constrained neural network for the design of embedded human posture recognition systems[J]. Applied Sciences-Basel, 2021,11(11). DOI: 10.3390/app11114752.

[33]HUANG H Z, DONG Y D, WAN S, et al. A transient dual-type sensor based on MXene/cellulose nanofibers composite for intelligent sedentary and sitting postures monitoring[J]. Carbon, 2022,200: 327-336.

[34]ZHANG X Y, FAN J M, PENG T, et al. A privacy-preserving and unobtrusive sitting posture recognition system via pressure array sensor and infrared array sensor for office workers[J]. Advanced Engineering Informatics, 2022,53. DOI: 10.1016/j.aei.2022.101690.

[35]RAN X, WANG C, XIAO Y, et al. A portable sitting posture monitoring system based on a pressure sensor array and machine learning[J]. Sensors and Actuators A:Physical, 2021,331. DOI: 10.1016/j.sna.2021.112900.

[36]SHELHAMER E, LONG J, DARRELL T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017,39(4): 640-651.

[37]杨观赐, 杨静, 苏志东, 等. 改进的YOLO特征提取算法及其在服务机器人隐私情境检测中的应用[J]. 自动化学报, 2018,44(12): 2238-2249.

[38]杨观赐, 李杨, 赵乐, 等. 基于传感器数据的用户行为识别方法综述[J]. 包装工程, 2021,42(18): 94-102.

[39]LI T H, FAN L J, ZHAO M M, et al. Making the invisible visible: action recognition through walls and occlusions[C]//IEEE/CVF International Conference on Computer Vision (ICCV 2019), Seoul, Korea (South), 2019. Los Alamitos, CA: IEEE, 2019.

[40]WANG L, SU X, SU H C, et al. Contactless continuous activity recognition based on meta-action temporal correlation in mobile environments[J]. Mobile Networks & Applications, 2020,25(6): 2174-2190.

[41]HUANG W Q, LIU Y, ZHU S Y, et al. TSCNN: a 3D convolutional activity recognition network based on RFID RSSI[C]//International Joint Conference on Neural Networks (IJCNN), Glasgow, UK, 2020. New York, NY: IEEE, 2020.

[42]HU J Z, ZHANG H L, DI B Y, et al. Reconfigurable intelligent surface based RF sensing: design, optimization, and implementation[J]. IEEE Journal on Selected Areas in Communications, 2020,38(11): 2700-2716.

[43]CHEN K, WANG F W, LI M Y, et al. Headsee: device-free head gesture recognition with commodity RFID[J]. Peer-to-Peer Networking and Applications, 2022,15(3): 1357-1369.

[44]CHEN B, MANG Q, ZHAO R, et al. SGRS: a sequential gesture recognition system using COTS RFID[C]//IEEE Wireless Communications and Networking Conference (WCNC), Barcelona, Spain, 2018. New York, NY: IEEE, 2018.

[45]周瑋, 门耀华, 辛立刚. 基于机器视觉的柔性包装袋喷码缺陷检测研究[J]. 包装工程, 2022,43(9): 249-256.

[46]陈东亮, 师素双, 房立庆, 等. 基于机器视觉的金属丝网缺陷识别方法[J]. 包装工程, 2023,44(3): 164-171.

[47]武松林, 崔荣一. 基于PCA的坐姿行为识别[J]. 计算机应用研究, 2010,27(7): 2786-2788.

[48]黄安义, 沈捷, 秦雯, 等. 基于MIMO-CNN的多模态坐姿识别[J]. 计算机工程与设计, 2021,42(3): 770-775.

[49]劉敏, 潘炼, 曾新华, 等. 基于MTCNN的坐姿行为识别[J]. 计算机工程与设计, 2019, 40(11): 3293-3298.

[50]CAI Z N, LIU Q S, WANG S M, et al. Joint head pose estimation with multi-task cascaded convolutional networks for face alignment[C]//24th International Conference on Pattern Recognition, Beijing, China, 2018. New York, NY: IEEE, 2018.

[51]丰婧, 程耀瑜, 贺磊. 基于PHOG特征的坐姿识别方法研究[J]. 国外电子测量技术, 2021, 40(5): 83-87.

[52]LI L H, YANG G C, LI Y, et al. Abnormal sitting posture recognition based on multi-scale spatiotemporal features of skeleton graph[J]. Engineering Applications of Artificial Intelligence, 2023,123: 106374.

[53]赵威, 李毅. 基于Kinect的人体姿态估计优化和动画生成[J]. 计算机应用, 2022,42(9): 2830-2837.

[54]马敬奇, 雷欢, 陈敏翼. 基于AlphaPose优化模型的老人跌倒行为检测算法[J]. 计算机应用, 2022, 42(1): 294-301.

[55]MIN W D, CUI H, HAN Q, et al. A scene recognition and semantic analysis approach to unhealthy sitting posture detection during screen-reading[J]. Sensors, 2018, 18(9). DOI: 10.3390/s18093119.

[56]REN S Q, HE K M, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[57]CAO Z, HIDALGO G, SIMON T, et al. Openpose: realtime multi-person 2D pose estimation using part affinity fields[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2021, 43(1): 172-186.

[58]郑佳罄, 石守东, 胡加钿,等. 基于双目视觉的实时坐姿检测研究[J]. 传感器与微系统, 2022, 41(6): 33-36.

[59]陈锦涛, 石守东, 郑佳罄, 等. 基于神经网络的坐姿下头部肩部姿态估计[J]. 传感器与微系统, 2021, 40(1): 9-12.

[60]CHEN K H. Sitting posture recognition based on openpose[J]. IOP Conference Series: Materials Science and Engineering, 2019, 677(3): 32056-32057.

[61]TRAN D, BOURDEV L, FERGUS R, et al. Learning spatiotemporal features with 3D convolutional networks[C]//Proceedings of the IEEE International Conference on Computer Vision (ICCV 2015), Santiago, Chile, 2015. New York, NY: IEEE, 2015.

[62]FANG Y, SHI S D, FANG J S, et al. SPRNet: sitting posture recognition using improved vision transformer[C]//International Joint Conference on Neural Networks (IJCNN), Padua, Italy, 2022. New York, NY: IEEE, 2022.

[63]DOSOVITSKIY A, BEYER L, KOLESNIKOV A, et al. An image is worth 16×16 words: transformers for image recognition at scale[J]. Arxiv, 2020, abs/2010. 11929. DOI: 10. 48550/arXiv. 2010. 11929.

[64]XIAO T, SINGH M, MINTUN E, et al. Early convolutions help transformers see better[J]. Advances in Neural Information Processing Systems, 2021, 36: 30392-30400.

[65]王越, 杨观赐. 基于多通道卷积注意力机制的精神状态识别方法[J]. 贵州大学学报(自然科学版), 2023, 40(1): 79-87.

[66]李中益, 杨观赐, 李杨, 等. 基于图像语义的服务机器人视觉隐私行为识别与保护系统[J]. 计算机辅助设计与图形学学报, 2020, 32(10): 1679-1687.

[67]KULIKAJEVAS A, MASKELIUNAS R, DAMASEVICIUS R. Detection of sitting posture using hierarchical image composition and deep learning[J]. PeerJ Computer Science, 2021. DOI: 10. 7717/peerj-cs. 442.

[68]VASWANI A, SHAZEER N, PARMAR N, er al. Attention is all you need[C]//Advances in Neural Information Processing Systems 30 (NIPS 2017), Los Angeles, USA, 2017. La Jolla, California: Neural Informatiion Processing Systems (NIPS), 2017.

[69]朱書德, 李少波, 王铮, 等. 基于机器视觉的胶囊缺陷检测装置设计[J]. 贵州大学学报(自然科学版), 2020, 37(3): 42-48.

[70]KAPPATTANAVAR A M, DA CRUZ H F, ARNRICH B, et al. Position matters: sensor placement for sitting posture classification[C]//IEEE International Conference on Healthcare Informatics (ICHI), Oldenburg, Germany, 2020. Los Alamitos, CA: IEEE, 2020.

[71]RAMALINGAM M, PUVIARASI R, CHINNAVAN E, et al. Alarming assistive technology: an IoT enabled sitting posture monitoring system[C]//International Conference on Software Engineering & Computer Systems and 4th International Conference on Computational Science and Information Management, Pekan, Malaysia, 2021. New York, NY: IEEE, 2021.

[72]ZHANG X Y, FAN J M, PENG T, et al. A privacy-preserving and unobtrusive sitting posture recognition system via pressure array sensor and infrared array sensor for office workers[J]. Advanced Engineering Informatics, 2022, 53. DOI: 10. 1016/j. aei. 2022. 101690.

[73]吴建超, 王利民, 武港山. 视频群体行为识别综述[J]. 软件学报, 2023, 34(2): 964-984.

(责任编辑:曾 晶)

Review of Abnormal Sitting Postures Recognition

YANG Guanci*1,2,3,4, LI Linhan1, LUO Kexin1,4, HE Ling1, ZHAO Tianyi1, MENG Zili1, LU Minglang1

(1.Key Laboratory of Advanced Manufacturing Technology of the Ministry of Education, Guizhou University, Guiyang 550025,

China; 2.State Key Laboratory of Public Big Data, Guizhou University, Guiyang 550025, China; 3.Guizhou Provincial Key Laboratory of

“Internet+” Collaborative Intelligent Manufacturing, Guizhou University, Guiyang 550025, China; 4.School of Mechanical Engineering, Guizhou University, Guiyang 550025, China)

Abstract: In daily life, sitting for a long time often leads to abnormal sitting postures and frequent abnormal sitting postures lead to an increasingly common phenomenon of skeletal muscle diseases. Therefore, recongizing abnormal sitting postures and reminding people of them are of great significance for peoples health. In this paper, the approaches of abnormal sitting postures recognition are summarized. Approaches are divided into three methods by data acquisition, abnormal sitting postures recognition methods based on the contact sensors, on radio frequency signals, and on machine vision respetively. These three methods are summarized and the characteristics of each method are analyzed. Among them, the methods based on contact sensors are reviewed from the perspectives of wearable devices and pressure sensors. The methods based on machine vision are reviewed from the perspectives of applied foreground image and the key points of human skeleton. Finally, the representative dataset of abnormal sitting postures is summarized and analyzed, and the performance of typical abnormal sitting postures recognition algorithm is analyzed, and the development trend of abnormal sitting postures recognition is summarized and prospected.

Key words: abnormal sitting postures recognition; sensing data understanding; feature extraction; machine learning; classification algorithm

楊观赐,男,1983年10月生,工学博士,教授,博士生导师,主要从事自主无人系统与机器人、多源数据融合与认知研究。贵州省委教育工委“优秀共产党员”,贵州省省管专家,贵州省高层次创新型人才(百层次),贵州省优秀青年科技人才。主持国家自然科学基金、国家科技支撑计划子课题、国家外专局重点项目、贵州省科技计划项目等20余项。在《Information Fusion》《自动化学报》等刊物上发表SCI/EI收录论文60余篇(其中累计ESI高被引论文5篇,热点论文1篇)。曾获贵州省科技进步二等奖4次、三等奖1次。