基于改进YOLOv5网络的疏果前苹果检测方法

2023-08-27姜国权杨正元霍占强罗军伟赵翠君

姜国权 杨正元 霍占强 罗军伟 赵翠君

摘要:为了实现自然环境下疏果前苹果的快速识别和精确定位,满足果园智能化种植需求,提出了一种基于改进的YOLOv5深度学习的检测模型。首先,为了解决苹果的尺度大小不一带来的问题,改进目标检测层,在YOLOv5的第17层之后对特征图进行上采样,在第20层将网络提取到的特征图与Backbone网络中的第2层特征图进行融合操作,以生成不同尺寸的检测层。其次,为了克服复杂环境的影响,改进特征融合网络,使用BiFPN(Bidirectional Feature Pyramid Network))进行特征融合,来更有效地提取目标信息。最后,将采集到的苹果图像进行不同网络模型检测效果对比试验。试验表明,改进的模型经过8 274幅图像训练,在2 759幅测试集上的检测准确率为94.2%,召回率为95.2%,F1值为94.7%;相比YOLOv3、YOLOv4、原YOLOv5网络,准确率分别提高了4.4%、7.0%、2.3%,F1值分别提高6.1%、6.5%、2.6%;相比YOLOv3、YOLOv4网络,图像的检测速度分别提高了13.5、21.4 ms/幅。结果表明,在保证检测实时性的情况下,该方法可以有效识别复杂环境下的苹果。

关键词:改进YOLOv5;疏果前;目标检测;苹果检测;特征融合

中图分类号:TP391.41文献标志码:A

文章编号:1002-1302(2023)14-0205-10

苹果是世界四大水果之一,中国是世界上最大的苹果生产国和消费国。我国的苹果树种植主要集中在北方,苹果主要产区分布在甘肃、陕西、河南、山东等地,其中甘肃省天水市的花牛苹果肉质细且松脆,得到了中外专家和营销商的认可[1]。随着科技的发展,苹果种植也朝着规模化、机械化、精准化的方向发展[2-4]。苹果的检测问题在国内外已有较多的研究,但研究对象大都是成熟期的苹果,对于疏果前苹果的识别研究尚不多见。实现疏果前苹果检测,对自动化疏果、喷洒农药、施肥以及果实生长情况的监测等智能化管理具有重要意义。

目前,国内外对水果检测进行了广泛研究,所使用的传统方法主要有色差法[5-6]、模糊C均值方法[7]、K最近邻(K-Nearest Neighbor,KNN)方法[8]、支持向量机(Support Vector Machine,SVM)[9-10]、K-means聚类方法[11]等。以上方法虽然可以将图像中的果实识别出来,但是受外部环境条件影响较大,例如当光照条件不同、有物体遮挡或者水果重叠的情况发生的时候,果实的检测效果会受到影响。

目前深度学习技术在水果检测中得到了广泛应用,国内外学者对此进行了大量研究[12-15]。与传统方法相比,基于深度学习的方法可以自动提取图像的特征,利用提取到的特征来获得检测目标的类别和位置信息,具有检测速度更快、精度更高、鲁棒性更强的特点。深度学习目标检测算法主要分为双阶段和单阶段2种类型。双阶段算法的核心思想是,首先在图像中产生候选区域,然后对候选区域进行检测,回归确定出目标的类别和位置信息,以RCNN[16]、Mask-RCNN[17]、Fast-RCNN[18]、Faster-RCNN[19]等为代表。王辉等提出一种基于Mask-RCNN的单株柑橘树冠识别与分割的方法,在复杂的果园图像中具有良好的识别与分割效果[20]。宁政通等提出一种基于Mask-RCNN的葡萄果梗识别与最优采摘定位的方法,提高了葡萄采摘机器人的采摘效率[21]。Yu等提出一种基于Mask-RCNN的草莓采摘机器人,与传统方法相比,该方法具有更好的普遍性和鲁棒性[22]。闫建伟等提出了一种基于改进Faster-RCNN刺梨果实识别方法,试验表明VGG16网络模型对自然条件下刺梨果实的识别具有较高的准确率和实时性[23]。Gao等提出一种基于Faster-RCNN的多分类苹果目标检测方法,可以有效检测出所有不同种类的果实目标[24]。单阶段算法不需要进行中间层的候选区域提取,而是直接把特征提取、目标分类、位置信息回归放在一个流程,相较于双阶段算法,单阶段算法在保证检测准确率的情况下,检测速度也有了一定的提升。较为经典的单阶段目标检测算法主要有(Single Shot MultiBox Detector,SSD)和(You Only Look Once,YOLO)系列等。彭红星等提出一种通用改进 SSD 模型用于实现多种类水果的精准检测,为农业自动化采摘提供了新的方案[25]。张恩宇等提出一种基于SSD算法的青苹果识别方法,该方法将SSD深度学习算法和图像处理算法相结合[26]。王昱潭等提出一种基于改进SSD的灵武长枣目标检测方法,可以很好地完成靈武长枣的目标检测任务[27]。薛月菊等提出一种未成熟芒果的YOLOv2识别方法,设计了一个基于密集连接的Tiny-yolo模型,该网络结构能够实现多层特征的复用和融合,利用样本的前景区域来训练YOLOv2结构,以此来减小外界环境对检测效果的干扰[28]。唐熔钗等提出一种基于改进YOLOv3网络的百香果实时检测方法,具有良好的检测效果,为百香果实时检测提供了有效方法[29]。张兆国等提出一种基于改进YOLOv4模型的马铃薯检测方法,该模型具有很强的鲁棒性,可以在各种复杂环境下完成对马铃薯的检测[30]。Fan等提出一种基于YOLOv4深度学习算法的实时苹果缺陷检测方法,该方法和初始的YOLOv4模型相比,具有更好的时效性和更高的准确率[31]。王卓等提出一种改进YOLOv4的轻量级苹果实时检测方法,该方法简化了网络的复杂程度,提高了模型的响应速度[32]。高芳芳等设计了一种基于轻量级目标检测网络YOLOv4-tiny和卡尔曼滤波跟踪算法的苹果检测与视频计数模型,该模型可以帮助果农掌握苹果的数量,有助于科学化种植[33]。

相较于成熟期的苹果,疏果前的苹果检测存在目标较小、颜色与背景相似的挑战。本研究以果园中自然环境的苹果为研究对象,构建一个疏果前苹果数据集,提出一种基于改进YOLOv5网络的果实检测方法。首先,为了解决目标尺寸大小不一的问题,改进目标检测层,将尺度不同的特征图输入不同的检测层进行多尺度检测,进而提高目标的检测效果;其次,为了解决复杂背景的影响,采用EfficientDet中提出的BiFPN特征融合网络替换原网络中的PANet特征融合网络,显著提高了目标特征信息的提取效果[34]。

1 试验数据

1.1 图像采集

本研究中的图像采集于甘肃省天水市甘谷县大石镇花牛果园,采集时间是2021年5月12日(晴)、5月13日(晴)、5月16日(阴)的08:30—12:00及14:00—18:00。此时苹果的横径在30 mm以下,使用iphone X手机多角度近距离(2 m以内)进行拍摄,共采集花牛苹果原图像1 668幅,样本如图1所示。

1.2 数据增强处理

少量的训练图像可能会导致深度学习算法的过度拟合或者不收敛,而使用数据增强来增加训练图像的数量可以用来克服这一缺陷。因此,从拍摄的1 668幅苹果图像中筛选出862幅,使用MATLAB软件、Photoshop图像处理工具实现数据集增强,增强方法有多角度旋转、水平镜像、垂直镜像、亮度变化、模糊处理,数据增强效果如图2所示。

通过上述方法增强以后,训练数据集增加了15倍,从862幅图像变为了13 792幅图像。然后,借助LabelImg软件对图像进行标签制作,使用POSCAL VOC2007数据集格式制作,生成“xml”文件。最终,数据被分为训练集(60%)、验证集(20%)、测试集(20%),如表1所示。

2 改进YOLOv5网络模型

2.1 YOLOv5网络模型

YOLOv5有4种不同的网络结构:YOLOv5s、YOLOv5m、YOLOv5l、YOLOv5x,它们的不同之处在于网络的深度和宽度不同。为了保证网络轻量化,本研究选用YOLOv5s结构,该网络结构主要由4个部分组成:Input端、Backbone端、Neck端、Head端,网络结构如图3所示。首先,该网络的输入图像大小为640×640,该阶段通常包含1个图像预处理阶段。其次,对图像进行特征提取。然后,对提取到的特征进行融合,经过在Neck端的进一步特征提取,可以得到3种不同尺度的特征图,进一步提升特征的多样性和鲁棒性。最后,将生成的特征图送入不同的检测层,对目标图像生成相应的预测框并对其进行非极大值抑制(Non-Maximum Suppression,NMS)处理,抑制掉得分低的预测框,检测出目标。

YOLOv5的损失函数,由分类损失(Classification Loss)、置信度损失(Confidence Loss)、定位損失(Localization Loss)3个部分组成。其中采用二元交叉熵损失函数(BCE Loss)来计算检测物体的置信度损失和分类损失,定位损失函数采用完全交并比损失函数(Complete Intersection over Union Loss,CIOU Loss),如公式(1)所示。

其中“CIOU”表示网络中预测框和真实框之间的交并比,ρ表示真实框和预测框2个框中心点之间的欧氏距离,b、bgt表示预测框、真实框的中心点,h、w分别表示预测框的高度、宽度,ht、wt分别表示真实框的高度、宽度。公式“IOU”计算如公式(2)所示。公式(1)中的v如公式(3)计算,用来表示预测框和真实框之间的高宽比差异,如果高宽比一致,v=0;v越大,差距越大。公式(1)中的系数α表示权重,系数α的计算如公式(4)所示。

2.2 改进YOLOv5网络模型

2.2.1 改进目标检测层 原始的YOLOv5网络中,head端有3个检测层,对应3组初始化的anchor值,输入分辨率为640×640像素的图像,经过特征提取最终提取到尺度分别为80×80、40×40、20×20的特征图,可以用来检测尺寸为8×8、16×16、32×32以上的目标。3个检测层的模型对于较大的目标检测效果较好,但对于较小尺寸的苹果目标,检测率有所降低。因此,本研究对原来检测层做如下改进:(1)在YOLOv5的第17层之后,继续对特征图进行上采样,这样可以使得特征图扩大,有助于提取不同尺度果实的特征信息;(2)在第20层,将网络提取到的大小为160×160的特征图与Backbone网络中的第2层特征图进行Concat融合操作,获得尺寸为64×64的特征图。这样,模型最终会生成4个不同尺度的特征图,送入不同检测层能够进行多尺度检测,提高了检测效果。

2.2.2 改进特征融合网络 FPN(Feature Pyramid Networks)主要分为以SSD为代表使用的无融合网络(图4-a);以Faster RCNN、Mask RCNN、YOLOv3为代表使用的自上而下的单向融合网络(图4-b);以YOLOv5为代表使用的简单双向融合网络(图 4-c)。PANet的提出证明了双向融合的有效性,但PANet的双向融合将其他层的信息直接进行融合,会融入一些非目标的特征信息,因此出现了更复杂的双向融合网络。各种融合网络结构如图4所示。

本研究使用的BiFPN特征融合网络属于复杂双向融合网络(图4-d),用它来代替YOLOv5中的PANet特征融合网络。特征融合网络用来聚合不同分辨率的特征,PANet网络在特征融合阶段时所有输入节点的权重都是均等的,在进行融合时只是简单的相加。实际情况是特征的分辨率不同,对融合后的输出特征贡献值是不一样的,这就需要对不同特征节点的输入赋予不同的权重。BiFPN一方面使用快速归一化融合,针对融合的各个尺度特征增加一个权重,调节每个尺度的贡献度;另一方面,由于单边输入的结点没有进行特征融合,对于最后的融合贡献少,因此,移除了单边输入的结点。BiFPN结构如5所示。

BiFPN特征融合网络集成了双向跨尺度连接和快速归一化融合,以BiFPN的第6层的特征融合为例,其中公式(5)中的Ptd6是自顶向下路径上第6级的中间特征;w1、w2是得到的权重参数;Resize操作是下采样操作;是一个小值,以避免数值不稳定;

Pin7是自顶向下路径上第7级的输入特征。公式(6)中Pout6是自底向上路径上第6级的输出特征;w1′、w2′、w3′是对权重值w1、w2、w3求导;Ptd6是自顶向下路径上第6级的中间特征;Resize操作是下采样操作。所有其他特征都以类似的方式构建。使用BiFPN特征融合网络可以有效抑制与疏果前绿色苹果颜色相近的背景信息,可以提取更多有用信息进行融合,从而提高检测效果。

改进目标检测层的基础上,用BiFPN特征融合网络代替YOLOv5中的原始PANet特征融合网络,改进后的YOLOv5结构如图6所示。

3 模型训练

3.1 试验时间和地点

试验于2021年9月至2022年7月在河南理工大学软件学院图像视觉研究所完成。

3.2 试验平台

本试验条件为:Ubuntu18.04、64位操作系统,采用Pytorch框架。计算机配置:台式计算机,GeForce GTX 2080ti显卡,12 G显存;IntelCoreTMi9-9900K处理器,主频3.60 GHz,内存64 GB,编程语言是Python语言。

3.3 试验设计

试验中,造成苹果检测结果比预期低的原因主要是检测距离变化导致目标尺度大小不一样;目标颜色与背景颜色相近,容易造成误检或漏检。针对上述问题,本研究通过以下几组试验来提升模型的检测效果:(1)将YOLOv5模型从3个检测层变为4个,多尺度检测不同尺度的苹果;(2)将YOLOv5中的PANet特征网络替换为BiFPN特征网络分别进行识别对比。

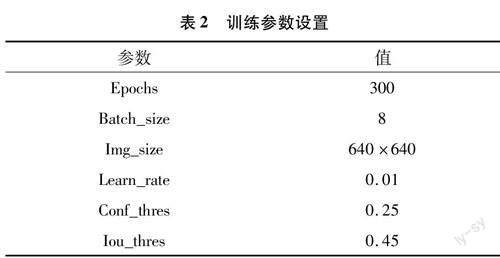

3.4 试验参数设置

在试验中,特征提取网络初始权重使用预训练好的yolo5s.pt,可以减少模型训练的计算成本和时间。试验按照表2所示初始化模型训练参数,模型的训练次数Epochs设为300;训练批次大小设为8;输入图片的大小按照初时的640×640;学习率为0.01;置信度阈值Conf_thres设为0.25,IOU阈值设为0.45。

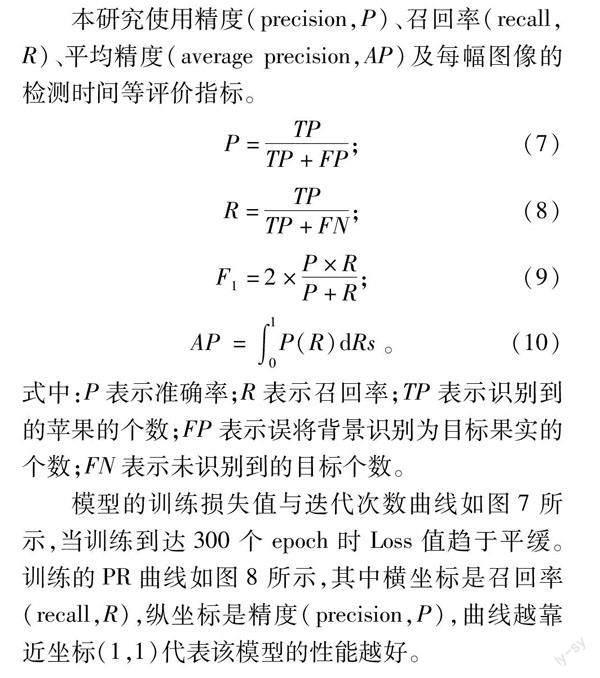

3.5 试验指标

本研究使用精度(precision,P)、召回率(recall,R)、平均精度(average precision,AP)及每幅图像的检测时间等评价指标。

式中:P表示准确率;R表示召回率;TP表示识别到的苹果的个数;FP表示误将背景识别为目标果实的个数;FN表示未识别到的目标个数。

模型的训练损失值与迭代次数曲线如图7所示,当训练到达300个epoch时Loss值趋于平缓。训练的PR曲线如图8所示,其中横坐标是召回率(recall,R),纵坐标是精度(precision,P),曲線越靠近坐标(1,1)代表该模型的性能越好。

4 结果与分析

4.1 不同模型训练结果分析

为了分析改进后模型与不同检测模型的检测性能,验证改进后YOLOv5网络模型的优越性,采用相同的数据集和配置对改进前后的YOLOv5算法和主流的一阶段目标检测算法YOLOv3、YOLOv4进行对比试验,各模型检测效果如图9所示,试验结果对比如表3所示。可以看出,本研究方法在自制数据集上的检测精度(precision,P)为94.2%,相比 YOLOv3、YOLOv4、原YOLOv5算法,精确度分别提高了4.4%、7.0%、2.3%。从检测精度来看,该方法的精度均优于其他方法。同时,从检测速度上来看,本研究算法比YOLOv3、YOLOv4算法分别快了13.5、21.4 ms/幅;与原YOLOv5算法相比,虽然检测速率慢了5.7 ms/幅,检测精度却提升了2.3百分点。这表明,本研究提出的方法在检测速率未有很大降低时,精确度有一定的提升。综合考虑,改进后的方法在速度和精度上可以达到很好的平衡。

4.2 不同距离下检测结果与分析

实际检测过程中,采集距离的不同会造成待检测目标比例大小不一样。为了分析目标比例大小不一对识别检测精度的影响,选取部分数据进行测试。果园中的果实按照果树与拍摄相机的距离可分为近距离、中距离、远距离目标。其中近距离目标以0.2 m距离拍摄,中距离目标以0.5~0.8 m距离拍摄,远距离目标以1.0~1.2 m距离拍摄。

为了更详细地对比不同拍摄距离下改进后的YOLOv5模型与其他模型的检测效果,准备近距离、中距离、远距离目标各20幅非训练集的图片,60幅图片的待测目标数量如表4所示,使用YOLOv3、YOLOv4、原YOLOv5、YOLOv5_4Anchors_BiFPN这4种模型对不同光照条件下的目标进行检测,检测效果如图10所示(注:黄色框代表未检测到的目标)。各模型的P、R、F1指标如表5所示。

试验数据显示,距离的不同会对果实识别产生影响,近距离情况下采集图像目标的识别准确率为98.5%,而远距离情况下采集图像目标的识别准确率为90.3%。分析原因可能是拍摄距离、角度等因素造成待检测目标比例变小,而模型在进行特征提取后生成的特征图尺寸较小,影响目标检测效果。

由于改进了目标检测层,对原模型17层之后的特征图进行上采样,同时在第20层时,将网络提取到的特征图与Backbone网络中的第2层特征图进入BiFPN融合网络,获得更大的特征图,这样就可以改善尺度大小不一造成识别精度降低的问题。改进后的模型在中、近距离对于目标的检测效果均比原模型和其他模型要好。在远距离目标检测上,改进后的YOLOv5的检测效果相较于原YOLOv5也有改善,但是检测速度有所下降,这是由于改进目标检测层以后,多生成1个特征图,特征提取耗费更多时间。在实际应用中,农业机器人的移动速度一般较慢,所以检测速度的少许下降对于目标检测几乎没有影响。

4.3 不同光照条件检测结果与分析

实际应用场景中会遇到不同的光照环境,为了分析不同光照条件对目标识别的影响,以3种不同光照情况下采集的数据为研究对象进行分析。选取的图像分为正常光、过曝光、逆光3种情况。

为了更具体地对比不同光照条件下改进后的YOLOv5模型与其他模型的检测效果,准备正常光、过曝光、逆光图片各20幅,这60幅图片的待测目标数量如表6所示。为直观展示不同光照条件下的识别效果,使用YOLOv3、YOLOv4、原YOLOv5、YOLOv5_4Anchors_BiFPN这4种模型对不光照条件下的目标进行检测,检测效果如图11所示,各模型的P、R、F1指标如表7所示。

试验结果显示,光照不均匀的情况下要比正常光照下的识别效果差一些,分析原因可能是在光照不均图像中,由于目标区域的过曝或曝光不足,目标与背景界限不明显或出现黑色区域,会造成部分特征信息丢失,提取果实边缘特征信息的难度增加,影响该区域部分果实的识别效果。

为了改善复杂环境对检测结果的影响,本研究提出的模型在改进目标检测层以后,将原始的PANet特征网络改为BiFPN特征网络。BiFPN网络在进行特征融合对特征节点的输入赋予不同的权重,针对融合的各个尺度特征增加1个权重,更有效地提取目标的特征信息。从图11可以看出,改进后的网络模型在正常光照和过曝光条件下的检测效果是优于原YOLOv5与其他模型的。在逆光条件下,改进后的网络模型检测效果强于原YOLOv5模型,但偶尔也会出现漏检的情况。因此从试验数据分析可知,改进后的YOLOv5模型更适合疏果前的苹果检测任务。

5 结论

为了解决疏果前苹果的目标尺度不一和复杂检测环境导致的果实检测效果不好的问题,本研究自制数据集,在YOLOv5网络的基础上改进目标检测层,使用BiFPN特征网络替换PANet特征网络,生成多个特征图,利用多尺度检测进行大量试验。结果表明,改进后的YOLOv5算法比原来的YOLOv5在准确度、召回率、平均精度上分别提升了2.3、2.9、2.3百分点,与现有一阶段检测网络相比,该方法可以更有效地检测自然场景下的苹果。

但是该方法依然存在一定的局限性,目前只是针对花牛苹果数据进行了试验,品种单一,缺乏普遍性。在未来的工作当中,将采集更多品种、更多高分辨率的苹果数据进行训练,进一步优化网络模型,提高苹果目标的检测效率与速度,同时进一步解决树枝、树叶遮挡等复杂环境下的果实检测问题。

参考文献:

[1]常 倩,李 瑾. 2000年以来中国苹果产业发展趋势分析[J]. 北方园艺,2021(3):155-160.

[2]任碧峰. 中国苹果产业发展趋势分析与建议[J]. 农村经济与科技,2019,30(19):8-9,15.

[3]霍学喜,刘天军,刘军弟,等. 2020年度中国苹果产业发展报告(精简版)[J]. 中国果菜,2022,42(2):1-6.

[4]慕海涛. 中国苹果产业发展现状及趋势探究[J]. 农村科学试验,2019(9):75-77.

[5]Arefi A,Motlagh A M,Mollazade K,et al. Recognition and localization of ripen tomato based on machine vision[J]. Australian Journal of Crop Science,2011,5(10):1144-1149.

[6]Zhou R,Damerow L,Sun Y,et al. Using colour features of cv.‘Galaapple fruits in an orchard in image processing to predict yield[J]. Precision Agriculture,2012,13(5):568-580.

[7]Zhu A,Yang L. An improved FCM algorithm for ripe fruit image segmentation[C]//2013 IEEE International Conference on Information and Automation. 2013:436-441.

[8]Linker R,Cohen O,Naor A. Determination of the number of green apples in RGB images recorded in orchards[J]. Computers and Electronics in Agriculture,2012,81:45-57.

[9]Lü Q,Cai J R,Liu B,et al. Identification of fruit and branch in natural scenes for citrus harvesting robot using machine vision and support vector machine[J]. International Journal of Agricultural and Biological Engineering,2014,7(2):115-121.

[10]Zhao C Y,Lee W S,He D J.Immature green citrus detection based on colour feature and sum of absolute transformed difference (SATD) using colour images in the citrus grove[J]. Computers and Electronics in Agriculture,2016,124:243-253.

[11]Wachs J P,Stern H I,Burks T,et al. Low and high-level visual feature-based apple detection from multi-modal images[J]. Precision Agriculture,2010,11(6):717-735.

[12]彭紅星,李 荆,徐慧明,等. 基于多重特征增强与特征融合SSD的荔枝检测[J]. 农业工程学报,2022,38(4):169-177.

[13]李国进,黄晓洁,李修华. 基于改进YOLOv3的树上成熟芒果检测方法[J]. 沈阳农业大学学报,2021,52(1):70-78.

[14]熊俊涛,郑镇辉,梁嘉恩,等. 基于改进YOLO v3网络的夜间环境柑橘识别方法[J]. 农业机械学报,2020,51(4):199-206.

[15]Fu L S,Majeed Y,Zhang X,et al. Faster R-CNN-based apple detection in dense-foliage fruiting-wall trees using RGB and depth features for robotic harvesting[J]. Biosystems Engineering,2020,197:245-256.

[16]Girshick R,Donahue J,Darrell T,et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2014:580-587.

[17]He K M,Gkioxari G,Dollár P,et al. Mask R-CNN[C]//Proceedings of the IEEE International Conference on Computer Vision. 2017:2980-2988.

[18]Girshick R. Fast R-CNN[C]//2015 IEEE International Conference on Computer Vision. 2016:1440-1448. [HJ2mm]

[19]Ren S Q,He K M,Girshick R,et al. Faster R-CNN:towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,2017,39(6):1137-1149.

[20]王 輝,韩娜娜,吕程序,等. 基于Mask R-CNN的单株柑橘树冠识别与分割[J]. 农业机械学报,2021,52(5):169-174.

[21]宁政通,罗陆锋,廖嘉欣,等. 基于深度学习的葡萄果梗识别与最优采摘定位[J]. 农业工程学报,2021,37(9):222-229.

[22]Yu Y,Zhang K L,Yang L,et al. Fruit detection for strawberry harvesting robot in non-structural environment based on Mask-RCNN[J]. Computers and Electronics in Agriculture,2019,163:104846.

[23]闫建伟,赵 源,张乐伟,等. 改进Faster-RCNN自然环境下识别刺梨果实[J]. 农业工程学报,2019,35(18):143-150.

[24]Gao F F,Fu L S,Zhang X,et al. Multi-class fruit-on-plant detection for apple in SNAP system using Faster R-CNN[J]. Computers and Electronics in Agriculture,2020,176:105634.

[25]彭红星,黄 博,邵园园,等. 自然环境下多类水果采摘目标识别的通用改进SSD模型[J]. 农业工程学报,2018,34(16):155-162.

[26]张恩宇,成云玲,胡广锐,等. 基于SSD算法的自然条件下青苹果识别[J]. 中国科技论文,2020,15(3):274-281.

[27]王昱潭,薛君蕊. 改进SSD的灵武长枣图像轻量化目标检测方法[J]. 农业工程学报,2021,37(19):173-182.

[28]薛月菊,黄 宁,涂淑琴,等. 未成熟芒果的改进YOLOv2识别方法[J]. 农业工程学报,2018,34(7):173-179.

[29]唐熔钗,伍锡如. 基于改进YOLO-V3网络的百香果实时检测[J]. 广西师范大学学报(自然科学版),2020,38(6):32-39.

[30]张兆国,张振东,李加念,等. 采用改进YoloV4模型检测复杂环境下马铃薯[J]. 农业工程学报,2021,37(22):170-178.

[31]Fan S X,Liang X T,Huang W Q,et al. Real-time defects detection for apple sorting using NIR cameras with pruning-based YOLOV4 network[J]. Computers and Electronics in Agriculture,2022,193:106715.

[32]王 卓,王 健,王枭雄,等. 基于改进YOLOv4的轻量级苹果实时检测方法[J/OL]. 农业机械学报.[2022-10-01]. https://kns.cnki.net/kcms/detail/11.1964.S.20220520.1636.008.html.

[33]高芳芳,武振超,索 睿,等. 基于深度学习与目标跟踪的苹果检测与视频计数方法[J]. 农业工程学报,2021,37(21):217-224.

[34]Tan M X,Pang R M,Le Q V.EfficientDet:scalable and efficient object detection[C]//2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2020:10778-10787.

收稿日期:2022-10-12

基金项目:国家自然科学基金(编号:61972134);河南省计算机视觉与图像处理创新团队项目(编号:T2014-3)。

作者简介:姜国权(1969—),男,河北唐山人,博士,副教授,硕士生导师,主要从事图像处理及模式识别研究。E-mail:jguoquan@163.com。

通信作者:霍占强,博士,教授,硕士生导师,主要从事机器视觉及模式识别研究。E-mail:hzq@hpu.edu.cn。