深度学习在乳腺超声中的研究进展

2023-05-25包凌云张华

包凌云 张华

据2020年全球肿瘤年报统计数据显示乳腺癌已超过肺癌成为全球最常见的恶性肿瘤,在所有癌症中占比高达11.7%,发病率和死亡率在全球大多数国家中均排名第一位[1]。早期乳腺癌临床治愈率可高达90%以上[2],因此乳腺癌的早期发现、早期诊断及治疗至关重要。影像学检查是乳腺癌筛查及诊断的重要手段,超声检查具有实时、无辐射、低成本、便携、不受致密腺体影响等优点,在我国是首选检查方法[3]。乳腺超声包括二维(2D)手持超声(handheld ultrasound,HHUS)和三维(3D)自动乳腺容积超声(automated breast ultrasound,ABUS)。HHUS 是最主要的检查方法,但由于其依赖操作者的经验,扫查不完整易造成漏诊,不同年资医师的诊断差异较大。ABUS 是一种新型的乳腺超声成像,采用自动扫描、3D 重建技术,具备标准化和可重复等优点,便于进行随访比较,在远程诊断及乳腺癌筛查体现一定优势,但同时存在图像采集及阅片时间长等不足[4]。近年来,随着计算机的快速发展,计算机辅助诊断和检测(computer-aided diagnosis,CADx;computer-aided detection,CADe)越来越多地应用于乳腺超声中[2,5]。运用算法对图像进行处理和分析,涉及的方法可分为传统的机器学习和深度学习,而深度学习是算法模型研究的热门,尤其是卷积神经网络(convolutional neural network,CNN)。深度学习与超声成像融合主要用于病灶的检测识别以及精确分类,为提升超声医师诊断效能、缩短诊断时间等提供有效的帮助。本文对深度学习在2D 和3D 乳腺超声中的研究进展作一述评并报道如下。

1 深度学习概述

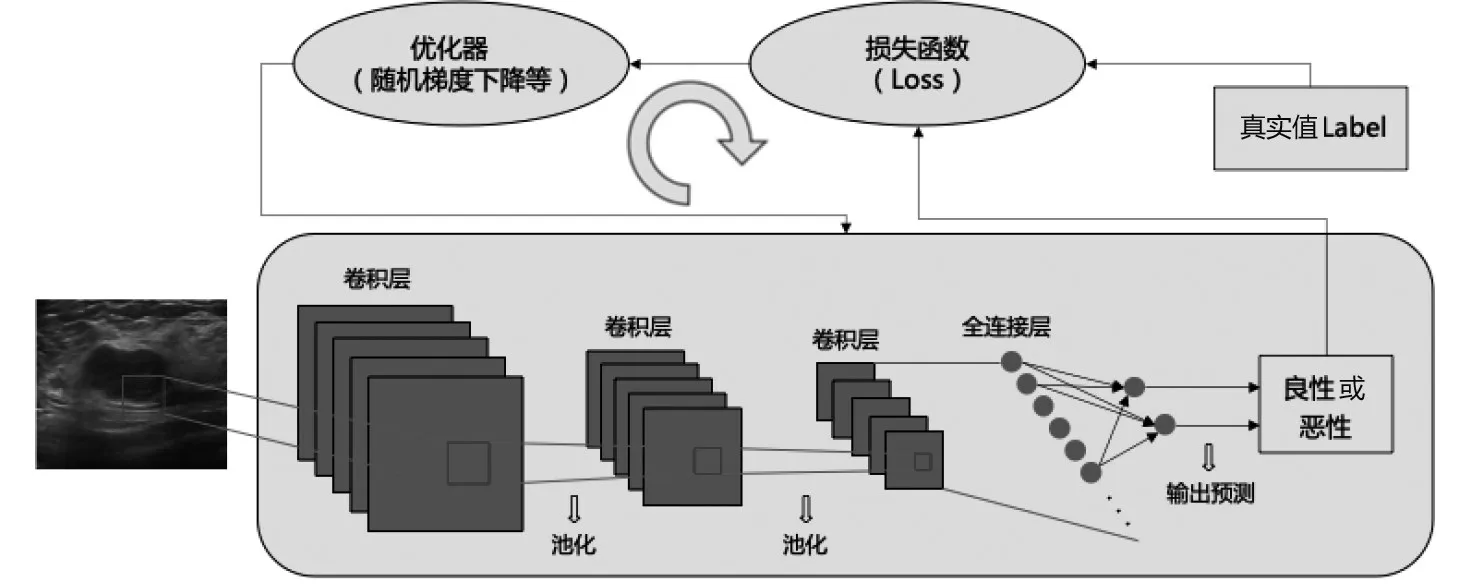

深度学习和机器学习都是人工智能的子集,均可用于医学图像的分类处理,传统的机器学习模型需要手工提取图像特征,操作流程复杂且无通用的标准,拟合能力较差,而深度学习模型模拟人脑机制,使用神经网络“端到端”模式完成图像特征提取并分类[6]。CNN 是医学图像中最常用的深度学习算法,自1989年问世以来被广泛应用于病灶的检测和诊断[6-8]。一个典型的CNN 架构包含输入层、卷积层、激活层、池化层及全连接层[5,9]。利用输入层进行图像预处理,卷积层进行特征提取,池化层压缩网络参数后发送至全连接层完成图像分类。此外,通过优化器降低预测值与真实值(Label)之间的损失实现整体网络参数学习。CNN 工作流程见图1。

图1 CNN 工作流程图

2 深度学习在乳腺超声中的应用

2.1 乳腺病灶分割与检测 准确分割乳腺超声病灶有助于乳腺癌的早期诊断和后期治疗评估。手动勾画感兴趣区(region of interest,ROI)需要消耗大量时间和精力,随着深度学习在医学影像的应用,许多研究聚焦在乳腺病灶自动分割。由于2D 灰阶图像散斑噪声高、信噪比低、病灶形态不规则、回声不均匀等因素给图像自动分割带来巨大挑战[10]。Kumar 等[11]提出了一种基于CNN 的Multi U-net 算法,对258 例女性乳腺超声图像进行了分割,实现了图像的实时分割达13~55 ms/张,分割效果明显优于传统U-net 算法,平均相似系数(Dice 相似系数)高达82.0%,假阳性率仅为1.0%,表明该算法模型具有潜在的临床应用价值。Hu等[12]又将全卷积神经网络模型(dilated fully convolutional network,DFCN)与基于相位信息的动态轮廓模型(phase-based active contour,PBAC)相结合分割了170 幅乳腺超声图像,该模型自动分割效果和手工分割相当,平均Dice 系数高达88.97%,证实该方法在医学图像分析中可部分替代手工分割。随后,一种由全局引导模块和肿块边界检测模块组成新的神经网络模型(GG-Net)被开发[10],进一步改善了乳腺病变分割效能,较其他分割模型效能更佳,尤其提高了不典型病灶分割的准确性。目前半自动分割方法被广泛用于2D 超声图像,即先由计算机系统自动勾画病灶ROI轮廓,操作者进一步微调,提高病灶分割效率。

ABUS 通过一个宽幅探头自动扫描实现全乳腺检查,单次扫描可生成数百张2D 超声图像并重建3D 图像,在致密型乳腺患者中ABUS 具有比乳腺X 线更高的癌症检出率[13-14]。然而,观察大量乳腺超声图像,检出可疑病灶不仅是个耗时的过程,而且对读片者的专业要求更高,容易产生视觉疲劳导致漏诊。因此,一些研究构建了用于ABUS 的CADe 系统,早期研究多是以手工提取图像特征或从3D 图像切取出的2D 超声图像作为输入构建CNN 模型[15-18],忽略了乳腺肿块的3D 立体空间信息,为克服这一局限性,有研究者提出了基于3D 图像的CNN 概念。Chiang 等[19]首次应用3D-CNN开发ABUS 病灶检测系统,提高了病灶的检出率和效率,在获得同样灵敏度(0.950)时,该模型每例患者的平均假阳性数量为14.52,所需检测时间为121 s,明显优于其他模型,证明了3D-CNN 在ABUS 病灶检测的可行性。Moon 等[14]采用类似的方法比较3D VGG-16模型、3D DenseNet 模型及两者集成模型的检测效能,并引入损失函数解决了数据不平衡的问题,最终集成模型ROC 曲线的AUC 最高(0.967),能有效减少乳腺癌误检率,灵敏度高达0.953,可减少56.8%的假阳性病例。Wang 等[20]利用优化的3D U-Net 建立检测模型进一步提高了ABUS 的病灶检出率,降低了误诊率,当灵敏度为0.910 时,单次扫描假阳性数量仅为1.92。虽然采用深度学习可有效自动提取深度特征来检测乳腺癌,但3D 卷积网络所需要的数据量相对2D 往往是巨大的,在少量数据训练时容易发生过拟合现象,造成网络的鲁棒性和泛化性差。

2.2 乳腺肿瘤分类诊断 乳腺影像报告和数据系统(breast imaging reporting and data system,BI-RADS)已被临床广泛采用[21],将乳腺病灶超声特征描述和分类诊断进行标准化,提高超声对乳腺病灶的诊断效能。但良恶性肿瘤特征存在一定的交叉性和共性,凭操作者经验的主观判断容易造成误诊[22]。深度学习算法通过自身的学习能力抽取图像复杂层次特征,不受主观因素干扰,在乳腺肿块良、恶性分类中具有潜在应用价值[23]。

现有大量研究基于不同类型的CNN 模型构建乳腺超声CAD 系统用于良恶性分类,提高诊断效能,其灵敏度和准确度均>0.900[24-27],并证实了CNN 模型的诊断效能和经验丰富的超声医师相当[28],优于缺乏经验的初级医师,诊断相同数量病例时比超声医师明显耗时更少。一款商用CAD 软件(S-detect)可根据BIRADS 词典进行病灶分割、特征分析和描述,并进行良恶性分类[29]。将诊断阈值设置为BI-RADS 4A 类时,Sdetect 独立诊断的特异度(0.908)、阳性预测值(0.867)均高于超声医师[30]。其他研究也发现在使用S-detect后,超声医师的特异度、阳性预测值和准确度得到显著提升[29,31],特别是低年资阅片者的诊断灵敏度、特异度均得到显著提高,而高年资阅片者灵敏度没有改善,但特异度明显提高[32-33]。此外,有研究尝试对乳腺病灶的组织学分类进行识别,Hizukuri 等[34]开发了用于区分浸润性癌、非浸润性癌、纤维腺瘤、囊肿4 种乳腺病变的CAD 系统,其准确率约83.9%~87.6%,首次实现了基于深度学习的乳腺病灶的组织学分类,相较于使用手工提取纹理特征的分类效能得到显著提升[35]。于腾飞等[36]比较了2D 图像和彩色多普勒图像对乳腺良性肿瘤、恶性肿瘤、炎症、腺病的分类效能,训练模型在此4 种分类中均取得较高的准确度,说明多模态超声图像的分类准确度更高。深度学习模型通过自动学习对乳腺病灶进行更细致的分类,能够有效指导临床决策,降低了超声医师的工作强度,但是目前的研究样本量较少,仍需要大样本、多中心研究进行验证。

3D乳腺超声的冠状面特征对病灶良恶性分类有重要鉴别诊断价值。Tan 等[37]从冠状面中提取“汇聚征”提高了模型对乳腺病灶良恶性分类效能,说明“汇聚征”是乳腺癌重要特征。Zhang 等[38]通过改进的Inception V3模型提取3D 乳腺超声图像纹理特征,成功使低年资和高年资医师组的准确率分别提高了12.76%、6.47%。但是传统分类方法流程复杂,特征的提取和选择没有通用的标准,泛化能力较差。近年来,有学者开始尝试将2D 图像分类的深度学习模型用于3D 乳腺病灶分类。孔小函等[9]设计了可融合冠状面、横断面图像和文本信息的新型网络结构,探究不同信息组合对分类性能的影响,多信息融合的神经网络结构省去人工设计融合方法等步骤,提升了分类效率和准确性。Wang 等[20]使用优化的3D U-Net 模型对ABUS 中的病灶进行检测,并构建多层CNN 模型对检测到的结节进行良恶性分类,该模型诊断灵敏度、特异度和准确度均大于0.85,AUC 为0.922。Wang 等[39]将用于形态学分析的自动分割网络(automatic segmentation network,ASN)搭建一个新型CNN 模型,评价ABUS 对乳腺癌的诊断效能,并与两位不同经验的影像医师进行比较,该模型诊断效能不如经验丰富的高年资医师,但优于低年资医师。尽管目前深度学习在3D 乳腺超声分类中的相关研究并不多,但深度融合人工智能技术和ABUS用于提升阅片准确度和诊断效率是未来发展趋势。

2.3 乳腺癌腋窝淋巴结转移的预测 早期乳腺癌患者5年生存率约98.8%,当发生腋窝淋巴结转移时5年生存率降至85.8%,是否存在腋窝淋巴结转移、阳性淋巴结的数量和位置决定了乳腺癌的病理分期,是乳腺癌患者复发和生存期的重要预测指标[40]。淋巴结活检是一项有创检查,术后并发症较多,如何采用安全有效的影像学方法和人工智能方法来评估腋窝淋巴结状态一直是研究的热点。Zhou 等[41]选取临床腋窝淋巴结阴性乳腺癌2D 超声图像训练3 种常用的CNN 模型,将模型的预测效能与5 位经验丰富的影像医师进行比较,其中Inception V3 模型预测效能最佳,灵敏度高达0.85,AUC 为0.90,3 个模型预测效能均优于影像医师,其原因可能是淋巴结微转移状态缺乏典型的影像学表现导致影像医师漏诊。Zheng 等[42]应用多模态融合开展研究,将2D 超声图像与剪切波弹性成像结合,在加入临床信息后,鉴别腋窝淋巴结阴性和阳性时效果最显著,鉴别腋窝淋巴结低负荷、高负荷转移也有良好表现。有研究提取肿瘤内部和肿瘤边缘区域的深度特征,构建基于瘤内、瘤周、瘤内联合瘤周的深度学习模型,并与传统的影像组学模型进行比较,发现深度学习模型的预测效能优于影像组学模型,尤其是基于瘤内联合瘤周区域的深度学习模型预测效果最佳,说明深度学习模型可提取更丰富、更深层次的影像学特征,获取肿瘤周边微环境信息,从而提高了预测效能[43]。另有研究提取不同厚度瘤周区域的特征来分析对模型预测效能的影响,当瘤周厚度约3 mm 时模型预测效能最佳,进一步证实了肿瘤边缘区域信息对预测的重要性[44]。Guo 等[45]开发了一种多中心深度学习模型,该模型可将前哨淋巴阳性患者划分为不同风险级别,灵敏度高达0.984,阴性预测值高达0.97,并成功的将研究队列中51%过度治疗患者分配到低风险组,能有效避免过度医疗。以上研究多是基于2D 超声图像构建预测模型,且以单模态成像为主,使用3D图像来进行预测或融合不同模态、不同维度的图像信息构建预测模型有待进一步的研究。

2.4 乳腺癌分子分型的预测 乳腺癌是一种高度异质性疾病,根据雌激素受体(estrogen receptor,ER)、孕激素受体(progesterone receptor,PR)、人表皮生长因子受体2(human epidermal growth factor receptor,HER2)和Ki-67 表达水平,将乳腺癌分为Luminal A 型、Luminal B 型、HER2 过表达型和三阴性乳腺癌,不同分子分型乳腺癌具有不同组织病理学改变和生物学行为,其治疗方案和预后差异有统计学意义[46]。例如,Luminal A型属于内分泌治疗敏感的肿瘤亚型,预后最好;三阴性乳腺癌常见于年轻的女性,对化疗敏感,易复发转移,预后最差[47]。临床需要通过肿瘤穿刺活检进行免疫组化检测获得术前乳腺癌的分子分型,这是一项侵入性检查,而且获得的组织不能代表整个肿瘤的分子亚型。乳腺癌超声影像学特征可以从全局描述肿瘤,与分子分型具有一定的相关性[48-50],因此具有强大图像特征分析能力的深度学习算法所得出的判断可以作为一个参考依据。Zhang 等[51]首次运用深度学习模型预测乳腺癌分子分型取得良好的预测效果,对三阴性、HER2 阳性和激素受体阳性3 种分子亚型的预测AUC 分别为0.864、0.811 和0.837。一项多中心研究用2D 超声图像来预测乳腺癌4 种分子亚型,该模型对4种分子亚型预测均具有较高的准确度,特别是对鉴别Luminal 型和非Luminal 型的阳性预测值高达0.933[47],该研究的意义在于预测模型能够通过影像学方法为乳腺癌分子分型提供补充诊断信息,当预测结果与病理检查结果一致时会增加诊断信心,当两者结果不一致时,则可以考虑重新进行活检。有学者开发了多模态深度学习模型将2D 超声图像和乳腺X 线图像融合来预测乳腺癌的分子亚型,具有比单模态成像更高的诊断效能,区分Luminal 型和非Luminal 型的AUC 为0.855,计算机注意力机制的引入进一步提高了该模型对分子分型的预测诊断效能[52]。乳腺超声图像与深度学习算法的结合为乳腺癌患者术前评估分子亚型提供了一种无创、节约成本的新方法,但目前的研究还处于初步探索阶段,需要更多高水平的研究证明其安全性才能用于临床指导决策。

2.5 新辅助化疗(neoadjuvant chemotherapy,NAC)治疗反应的评估 NAC 是乳腺癌局部治疗前进行全身药物治疗,其目的为缩小病灶,降低肿瘤分期,使不能手术的患者获得手术机会,增加保乳成功率;可以作为药敏试验,评估肿瘤对化疗药物的敏感性,有助于术后辅助化疗药物的选择;消除微转移病灶,降低复发转移风险。病理完全缓解(pathologic complete response,PCR)被用来评估NAC 治疗疗效,能达到PCR的患者具有更好的预后和更长的生存期。乳腺癌患者中只有7%~38%能达到PCR 的治疗效果,因此,在NAC 治疗前能预测患者PCR 效果是至关重要的,这对难以达到PCR 的患者而言及时地调整治疗方案,可以避免不必要的化疗毒性[53-54]。Byra 等[55]采集乳腺肿瘤NAC 前和第一、二期NAC 后超声图像,通过计算NAC前后肿瘤神经特征向量的差值构建预测模型,与基于肿瘤形态学特征模型相比,该模型预测效能更好,表明NAC 导致的肿瘤内部回声的变化比形态的变化敏感性更高。Xie 等[56]利用一种双输入的新型CNN 模型提取乳腺肿块NAC 第一期化疗前后的超声图像,并引入特征融合和权重分配机制构建了PCR 预测模型,取得了良好的预测效能,其准确度、灵敏度和特异度分别为0.875、0.907、0.857,有望成为早期预测的监测工具。Jiang 等[57]使用深度学习和机器学习提取肿瘤NAC 前、后的超声图像,并融入临床信息构建预测PCR 模型,与临床专家和单一的模型相比,该模型取得最好的预测效能,AUC 高达0.94。尽管深度学习模型在预测乳腺癌NAC 反应取得了一定的进展,但乳腺癌肿瘤组织对化疗反应的程度和速度很大程度上取决于癌症的分子分型,后续研究应该将每种癌症的分子亚型纳入模型来提高预测效能或用分组分析来区分分子分型的影响。

3 小结

人工智能以其计算速度快、重复性好等优点可以为医师提供客观有效的信息,减少医师的工作量,降低漏诊、误诊率。尤其是深度学习可以有效识别和分割乳腺病变,提取特征并分类,评估治疗效果和预后,预测乳腺癌腋窝淋巴结转移风险。目前深度学习研究仍然存在一些局限性:大多数研究都是小样本、回顾性,容易产生偏倚,需要大量高质量前瞻性数据;目前深度学习只能针对一项任务进行训练,无法同时高效率、高准确率地解决多项任务;训练和测试模型所需图片数量庞大,缺乏大规模的公共数据集及统一的使用标准或指南,收集和标注图像过程仍然很费力。目前以3D 乳腺超声为基础的人工智能研究逐渐开展,但是主要集中在肿瘤的检测和分类,对于预测腋窝淋巴结转移、分子分型和NAC 治疗反应评估方面研究甚少,这也将成为未来的探索方向。