结合前景分割的多特征融合行人重识别

2023-05-20张红颖王徐泳彭晓雯

张红颖,王徐泳,彭晓雯

中国民航大学电子信息与自动化学院,天津 300300

0 引 言

行人重识别(person re-identification,ReID)是利用计算机视觉技术判断图像或视频序列中是否存在特定行人的跨镜头识别技术,对嫌疑人追踪和失踪人员检索等有重大意义(Deng 等,2021;Liu 等,2022)。基于深度学习的行人重识别方法能够获取更具判别性的特征,成为行人重识别领域的主要研究方法(沈庆 等,2020;李擎 等,2022)。但由于背景变化、局部遮挡和光照变化等问题,如何从行人图像中学习更有效的特征从而实现高精度的行人重识别仍然是一个挑战(郑鑫 等,2020)。

在早期,大多数方法将整个行人图像作为ReID模型的输入,将图像中的每一个像素特征都作为识别的依据。然而,在最近的研究中,Tian等人(2018)发现,如果行人图像中的背景发生变化,ReID 模型将会出现过拟合、可迁移能力下降等问题。Huang等人(2019)通过对训练和测试数据的处理发现,如果训练和测试数据的背景差异很大,ReID 方法的鲁棒性会受到极大影响,在实际应用时性能会出现明显下降。刘志刚等人(2022)指出行人图像中前景和背景之前存在隐含关系,当同一行人的背景变化较大时,ReID 模型可能会出现误识别的现象。由此可见,行人图像中背景变化产生的差异会对ReID 的识别结果产生影响。

为了解决背景变化导致的误识别问题,一些方法将前景分割技术与ReID 结合,利用前景分割提取行人图像中的前景部分。龚毓秀(2020)将提取的前景图像与原始图像拼接的结果作为ReID 网络的输入,提高了识别的准确性。Gong 等人(2021)通过前景分割方法,直接删除行人图像中的背景部分,建立了一个新的数据集。但是,直接使用前景分割方法删除背景会存在以下缺点:1)利用身体掩膜进行处理可能会破坏原始图像的结构化信息和平滑度;2)前景图像可能会丢失身体的某些部位,从而丢失部分细节信息;3)虽然身体掩膜可用于滤除背景干扰,但可能会丢失一些能够作为判别信息的背景线索。所以,为了缓解直接删除背景导致的信息丢失,本文在现有前景分割的方法中,加入了注意力机制和多损失融合的思想,通过注意力机制和损失函数的双重作用约束前景分割模块,在提取前景部分的同时,保持原始图像的结构信息和平滑度。

此外,除了通过前景分割方法提取前景,还有一些方法通过提取不同特性的特征缓解背景变化导致的误识别问题。李艳凤等人(2020)在使用监督网络提取有用的前景特征的同时,构建了一个多池融合网络来描述全局特征与局部特征,并实现多个细粒度的特征表达。宋晓茹等人(2022)通过对不用尺度的特征进行融合,在保留高维特征中的语义信息的同时,结合了低维特征中更多的位置与细节信息。Gong 等人(2021)在直接删除背景的基础上,利用联合对齐信息驱动网络从原始图像中学习对齐特征,加强局部和全局特征的结合。种衍文等人(2022)在实现图像对齐的基础上,进行多粒度特征的融合,避免小粒度信息的丢失。以上方法通过特征融合,提取了更具鉴别性的行人特征,取得了较好的识别效果,但存在以下缺陷:1)很多方法直接将高维特征进行反卷积的结果作为低维特征并进行融合,会忽视反卷积过程中出现的特征信息变化问题;2)通过不同分支分别提取全局特征与局部特征,导致局部特征在提取过程中会因为图像分块出现特征丢失,而且不同分支的特征提取能力存在差别,直接将两种特征融合将会影响特征融合的有效性;3)大多数方法没有同时关注多尺度特征和多粒度特征,丢失了部分具有鉴别性的信息。针对这些问题,本文首先在多粒度特征提取中,提出了一种注意力共享策略,通过全局特征引导局部特征的提取,提高局部特征的有效性,使其能更好地与全局特征融合。其次,在多尺度特征提取中,将特征提取过程各个阶段的结果作为多尺度特征融合的输入,并提出了一种多尺度非局部运算方法进行尺度融合,避免特征丢失。

综上所述,本文将前景分割与行人重识别相结合,并通过特征融合获取更具有判别力的特征,提高网络的特征表示能力,从而缓解背景变化的影响。本文主要有以下贡献:1)通过对图像中语义信息的分析,提出了一种基于注意力机制的前景分割模块,并设计了一种前景分割损失函数,优化了前景分割模块对前景的提取能力,同时保留部分有用的背景信息;2)在多尺度特征融合时,提出了一种多尺度非局部运算方法进行尺度融合,缓解了由高维特征在反卷积过程中以及卷积下采样操作中的特征丢失问题;3)在多粒度特征提取时,提出了一种基于注意力共享策略的多粒度特征引导方法,通过注意力机制引导局部特征的提取,不仅利用注意力机制聚焦网络关注点的特性,提高特征的有效性,而且将全局与局部联系起来,得到了对图像中行人的判别性表达。

1 结合前景分割的多特征融合网络

结合前景分割方法和特征融合对ReID 任务的有效性,本文提出了一种结合前景分割的多特征融合行人重识别方法(multi-feature fusion person re-identification method combined with foreground segmentation,MFSNet),网络结构如图1 所示,包括骨干网络、前景分割模块(foreground segmentation module,FSM)、多粒度特征引导分支(multi-granularity feature-guided branch,MFGB)和多尺度特征融合分支(multi-scale feature fusion branch,MFFB)4 个部分。

图1 结合前景语义分割的多特征融合网络Fig.1 Multi-branch joint network based on foreground semantic segmentation

1.1 网络结构

MFSNet 网络首先在主干网络进行特征提取之前,通过前景分割模块提取前景,然后将提取结果作为特征提取的输入。在特征提取中,主干网络采用ResNet50(residual network 50),并 且 将 经 过ResNet50 后的网络划分成3 个分支。第1 个分支沿用原始ResNet50 相同的网络形式,提取行人图像的全局特征。对于第2 个分支,为了实现全局特征引导局部特征,MFGB 将ResNet50 第5 个模块block res_conv5_1 及之后的部分分离出来,并且去除了全连接层。随后将分离出来的部分作为MFGB 模块的输入,实现全局特征对局部特征的引导提取,并获取融合特征。对于第3 个分支,为了缓解多尺度融合过程中的特征丢失,MFFB 采用了逐级分离融合结构,在特征提取过程中分离出尺度信息并进行融合,即在ResNet50的第2,3,4,5层进行分离特征并进行融合。同时,为了进一步提升特征的有效性,在特征融合之前先使用金字塔注意力聚焦网络的特征提取能力,然后通过特征融合得到最后的多尺度融合特征。

1.2 前景分割模块

由于跨摄像头的特殊性,ReID 任务中不可避免地存在背景变化的情况,当相同身份ID 行人的背景差异较大时,会出现误识别的现象。因此,本文提出一种前景分割模块提取图像中的有效前景,该模块分为掩膜提取和掩膜融合两部分,首先利用掩膜提取网络生成二值掩膜图像,然后利用哈达玛积将原始图像与其掩膜的融合,并将融合结果作为行人重识别特征提取网络的输入。前景分割模块的结构如图2所示。

图2 前景分割模块Fig.2 Foreground segmentation module

在现有的掩膜提取网络中,Mask R-CNN(region based convolutional neural network)方 法(He 等,2017)采用特征金字塔(feature pyramid network,FPN)结构,并且通过ROI Align (region of interest align)解 决 了Faster R-CNN (faster region proposal convolutional neural network)中ROI Pooling(region of interest pooling)两次取整产生误差的问题,能够较好地分割出有用信息,但其无法保持原始图像的结构信息和平滑度,会造成行人部分的细节信息丢失。因此,本文在Mask R-CNN 网络的基础上,将ReID 损失与原Mask 损失结合,提出了前景分割损失函数,并通过注意力机制使前景分割网络在提取前景时更关注与ReID 相关的有效信息,避免硬性地将图像中的前后景分割,造成信息丢失,改进后的网络结构如图3所示。

图3 行人掩膜提取网络结构图Fig.3 Pedestrian mask extraction network structure diagram

1.3 多粒度特征引导分支

在行人重识别任务中,全局特征与局部特征的融合能够使网络联合图像全局信息和各个粒度的局部信息,增强图像中信息的利用率和有效性,从而提高网络的鲁棒性。为了更有效地利用局部信息,减少特征丢失,本文提出了多粒度特征引导分支(MFGB),结构如图4所示。

图4 多粒度特征引导分支Fig.4 Multi-granularity feature-guided branch

多粒度特征引导分支主要由3 个分支堆叠构成。每一个分支都采用分块—注意力机制—特征提取—融合的模式。其中,分块是对特征图进行切分处理,分块的数目越多,越能使网络关注到局部的特征信息。注意力机制和特征提取则是在聚焦网络的特征提取能力的同时,利用如图5 所示的特征提取残差块(每个残差块都有3 层结构)提取更深层次的特征。最后,通过融合将局部的特征转化成与原输出特征大小一致,在得到每一分支的最终特征的同时,为实现特征引导打下基础。

图5 特征提取残差块Fig.5 Feature extraction residual blocks

对于其中的注意力机制,本文在CBAM(convolutional block attention module)的基础上新增了两个维度交互分支,提出了三分支注意力机制,其结构如图6 所示。在新分支1 和新分支2 中,首先对特征进行重排列操作,将原本输入的特征(结构是C×H×W)通过Permute函数进行通道维度C和空间维度H、W的交换,得到H×C×W和W×H×C的特征结构形式。然后对重排列之后的特征进行池化、卷积和正则化操作,进一步加深维度之间的融合,并重排列至原始C×H×W形式(其中,Z变换代表同时使用平均池化和最大池化)。最后将3 个分支的输出特征进行融合处理,得到注意力信息。这样做的好处是,空间信息和通道信息两个维度之间的信息进行了交互,缓解了CBAM 中将空间注意力和通道注意力进行串并联造成的信息丢失(张红颖和包雯静,2022;Misra等,2021)。

图6 三分支注意力Fig.6 Three-branch attention

在3 个分支对不同粒度特征进行提取的基础上,本文提出的MFGB 中的特征引导过程主要由残差堆叠策略和注意力共享策略实现。具体地,在MFGB 的第2 分支和第3 分支中,分别使用两种策略将前一分支中的关键性信息(包括粗粒度的特征和注意力关注点信息)结合到细粒度特征的提取过程中,达到通过粗粒度的信息引导细粒度特征提取的目的。

残差堆叠策略是使用残差结构将3 个分支堆叠结合,其结构为

式中,Xi-1表示前一分支的特征,Xi表示原始输入,Yi表示现分支的特征,G(x)表示特征引导过程,包含了注意力机制。

注意力共享策略是通过权重共享,将粗粒度分支中的注意力信息共享到细粒度分支中,其结构为

式(1)表示将前一分支的输出与本分支的输入结合作为本分支的新输入;式(2)表示将本分支的注意力替换为上一分支的注意力,即将粗粒度分支的注意力权重作为本分支注意力机制的初始权重。将式(1)(2)结合可得,MFGB 的特征引导机制主要实现过程为

式中,G′(x)表示细粒度分支中的特征引导过程,不包含注意力机制。

由式(3)可以看到,首先,残差堆叠策略将更粗粒度的信息与原输入结合,作为细粒度特征提取的输入。然后,注意力共享策略将粗粒度特征中注意力机制的关注点信息引入细粒度特征中,通过粗粒度特征约束细粒度特征的提取。由此,通过残差堆叠策略和注意力共享策略能够以粗粒度特征为蓝本进行细粒度特征的提取,一方面能够用粗粒度特征弥补细粒度特征提取过程中的信息丢失,另一方面能够用注意力机制的关注点信息约束细粒度特征的提取,提高细粒度特征的有效性。

1.4 多尺度特征融合分支

在行人重识别任务中,多尺度特征中的低维特征大多由高维特征经过上采样得到,但是上采样得到的低维特征不一定能真实地代表原始图像中的特征,会出现特征信息丢失。针对此问题,本文提出了多尺度特征融合分支(MFFB),将骨干网络特征提取中的特征直接作为多尺度特征融合的输入,减少特征信息丢失,并在融合模块前使用金字塔注意力结构对特征进行处理,提高特征的表达能力,其主要结构如图7所示。

图7 多尺度特征融合分支Fig.7 Multi-scale feature fusion branch

在图7所示的结构中,本文利用单尺度非局部运算考虑全局信息的思想(Wang等,2018),提出了一种多尺度非局部运算方法,直接将不同尺度的信息进行融合,以获得更有效的特征,其结构如图8所示。

图8 融合模块Fig.8 Fusion module

式中,i和j分别是输入x和输出y的索引,s是尺度因子;φ是系数函数,用来计算两个特征之间的相似性;θ表示特征转换函数;σ(x)代表归一化参数。

经过尺度因子的缩放操作后,不同尺度的信息达到了统一尺度。因此,在系数函数φ的选取中,仍使用嵌入高斯函数,计算为

最后,将式(5)代入式(4),得到最终多尺度非局部运算方法的表达式,具体为

1.5 联合损失函数

为了更好地优化网络的训练过程,本文设计了前景分割损失,并联合难样本采样三元组损失和softmax损失对网络进行约束训练。

前景分割网络能够得到图像中的行人掩膜,但是由于前景分割任务和行人重识别任务的差异性,直接将前景分割的结果作为输入并不一定能取得良好效果。为了有机地将前景分割与行人重识别结合,本文在Mask R-CNN 网络mask 损失LM的基础上,通过行人重识别任务的识别结果约束掩膜预测的结果,提出了前景分割损失函数,计算为

式中,A和B分别表示原始损失LM中的有效特征对应损失和非掩膜部分的特征对应损失。对于A的权重系数,n为类别数,xi为第yi类中第i个样本的特征向量,W为权值,b为偏置量。A和B计算为

式中,N表示一个预测掩膜中的像素总数,σ表示sigmoid函数,Pi表示掩膜中的一个像素,则为其相应的真值像素(ground truth)。

难样本采样三元组损失是在三元组损失的基础上,将简单随机抽样改为一种基于训练批量的在线难样本采样方法,计算为

式中,α为预设的阈值参数,表示距离间隔;P为随机挑选的行人个数,K为每个行人对应的照片数,P×K的值表示每批次训练的样本数量;a,p,n分别为目标样本、正样本和负样本;batch表示每个训练步骤中选择的样本数;C和D分别对应相同身份和不同身份的图像集;dap(η) 和dan(η)分别表示目标样本与正负样本之间的距离。

softmax 损失是使用了softmax 函数的交叉熵损失,计算为

式中,W为权值参数,b为偏置量,n为训练的类别数,xi为第yi类中对应于第i个样本的特征向量,N为每一批次训练样本的总数。

为了提高前景分割模块与行人重识别的结合效果,本文采用多损失函数联合策略,将以上3 种损失函数结合,作为总体的行人重识别网络的训练损失,其表达式为

2 实验结果及分析

2.1 数据集设置及评价标准

为了验证本文方法的效果,使用ReID 常用的数据集Market1501(Zheng 等,2015)、DukeMTMC-reID(Duke multi-tracking multi-camera re-identification)(Ristani 等,2016)和MSMT17(multi-scene multi-time person reid dataset)(Wei 等,2018)进行实验,并与相关的行人重识别算法进行对比。每个数据集划分为训练集和测试集两部分。Market1501分为训练图像12 936 幅、测试图像19 732 幅,共包含6 个摄像头拍摄的1 501 个行人的图像。DukeMTMC-reID 分为训练集16 522幅、测试集17 661幅和query集2 228幅,共包括1 404 个行人在8 个摄像头下的36 411 幅行人图像。MSMT17 数据集分为训练集32 621 幅,测试集93 820 幅,共包含15 个摄像头拍摄的4 101 个行人的126 441幅图像。

同时,本文使用Rank-1 和平均精度均值(mean average precision,mAP)两个行人重识别任务中常用的评价指标作为对比的依据。其中,Rank-1 是指被查询图像中行人与识别结果中第1 位图像中行人是同一行人的概率。mAP 的值则是一个求和平均数,代表了整体的识别水平,计算为

2.2 实验环境及参数设置

实验基于一台Ubuntu18.04 的戴尔工作站,其CPU参数为Intel®Xeon(R)Silver4112CPU@2.6 GHz,内存为64 GB,并使用双GeForce RTX 2080Ti显卡加速运算。算法使用Pytorch1.7.1 深度学习框架。网络实现分为前景分割和行人重识别两部分。前景分割部分采用预训练过的Mask R-CNN 进行行人掩膜提取;行人重识别部分的骨干网络采用ImageNet 预训练过的ResNet50 作为基础模型,其他部分的权重的初始化主要通过Kaiming 初始化完成。模型总共训练160 个epoch,采用Adam 优化器对模型的训练进行优化,初始学习率设置为0.000 4,并在每经过40个epoch后缩小为原来的1/10,直到网络收敛。

2.3 消融实验

本文提出的MFSNet 首先利用前景分割模块获取行人图像中的前景(行人)部分,然后通过两个分支分别融合图像中的局部与全局信息、高维与低维信息,获得分辨力更强的行人特征表达。因此,消融实验主要是验证前景分割模块、多粒度特征引导分支和多尺度特征融合分支的有效性,实验结果如表1所示。其中,Baseline 表示只包含图1 网络结构中的ResNet50 主干网络和全局分支,直接通过残差网络的特征提取结果进行行人重识别;Baseline+MFGB、Baseline + MFFB 和Baseline + FSM 分别是在Baseline 的基础上单独加入3 个结构,用以证明所提出网络结构的有效性。Baseline + MFGB + MFFB 和Baseline + MFGB + MFFB + FSM 是在多粒度特征引导的基础上逐步添加网络结构,用以证明3 个模块之间的耦合效果。

从表1 可以看出,在3 个数据集中,本文所提出的MFGB 和MFFB 结构均能对Baseline 起到一定的提升效果。原因在于,在MFGB 和MFFB 中,本文考虑到了不同特性的特征内蕴含的独特信息,并通过构建注意力共享策略和多尺度非局部运算方法,对不同特性的特征采取了针对性的方式,减少特征丢失,实现特征之间相互补充。

表1 在Market-1501、DukeMTMC-reID和MSMT17上的消融实验结果Table 1 Results of ablation experiments on Market-1501,DukeMTMC-reID and MSMT17 dataset/%

同时,在加入FSM 模块后,网络的精度也获得一定提升。原因在于,前景分割方法提取前景后,能够降低同一行人在不同摄像头拍摄的图像之间的背景差异,缓解Baseline 中同一行人背景差异导致的特征相似度下降问题。并且,随着背景被消除,同一摄像头下,不同行人之间背景相似性被消除,其特征相似度下降,也对识别效果的提升起到了促进作用。

2.4 对比实验

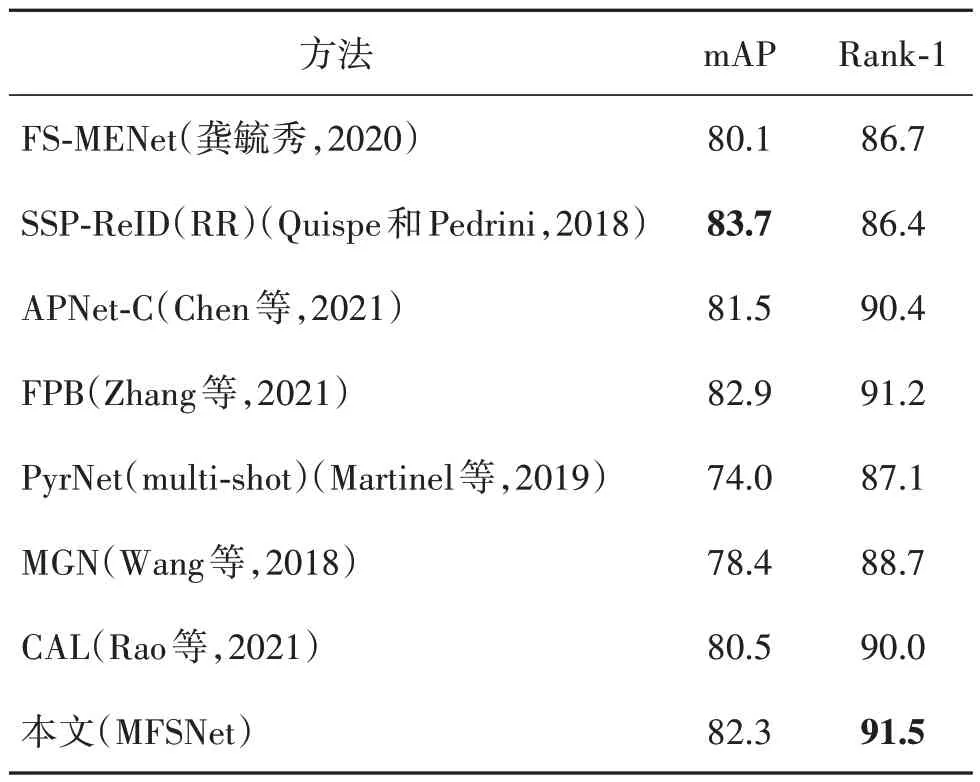

为了验证本文方法的有效性,在 Market-1501和DukeMTMC-reID 数据集上进行对比实验,对比方法包括基于语义信息前景分割的ReID 方法SSP-ReID(saliency-semantic parsing ReID)(Quispe 和Pedrini,2018)和 FS-MENet(foreground fegmentation and multi-loss ensemble network)(龚毓秀,2020);基于多特征融合的ReID 方法CAL(counterfactual attention learning method)(Rao 等,2021)、FPB(feature pyramid branch)(Zhang 等,2021)、MGN(multiple granularity network)(Wang 等,2018)和PyrNet(aggregating deep pyramidal representations)(Martinel 等,2019);基于注意力机制的ReID 方法APNet-C(attention pyramid network)(Chen 等,2021)。实验结果如表2和表3所示。

表2 在Market-1501上与相关方法的比较Table 2 Comparison with mainstream related method on Market-1501 dataset/%

表3 在DukeMTMC-reID上与相关方法的比较Table 3 Comparison with related method on DukeMTMC-reID dataset/%

同时,为了进一步验证所提模型对背景变化问题的效果,在MSMT17 数据集上与部分主流方法进行比较。在对比方法中新增了MPN(multi-task partaware network)(Ding 等,2022)、ABD-Net(attentive but diverse network)(Chen 等,2019)、Deep Miner(a deep and multi-branch network which mines rich and diverse features)(Benzine 等,2021)等3 种与本文结构相似的方法。实验结果如表4所示。

表4 在MSMT17上与相关方法的比较Table 4 Comparison with related methods on MSMT17 dataset/%

从表2—表4可以看出,在Market1501、DukeMTMCreID 和MSMT17 数据集上,本文方法均优于目前已有的一部分算法。原因在于,本文方法在现有方法的基础上加入了不同尺度不同粒度特征的信息,增加了特征信息量。同时,通过模型结构的设计,提高了行人特征信息的利用率,减少了特征丢失,并在此基础上加入了前景分割部分,通过提取前景缓解了背景信息对ReID模型识别精度的影响。

2.5 可视化结果

2.5.1 前景分割可视化结果

为了更好地展示本文方法在提取前景上的效果,在Market1501 数据集上随机选择行人图像进行前景分割,并进行可视化。图9 展示了身份ID 为0041 和0001 的两位行人前景提取效果图。其中,第1 行是数据集中的原始图像,第2 行是Mask RCNN 网络生成的行人掩膜图像,第3 行是提取前景后的图像。

图9 Market-1501数据集上部分行人图像前景提取效果图Fig.9 Result of partial pedestrian image foreground extraction on the Market-1501 dataset ((a)ID 0041;(b)ID 0001)

可以看到,本文使用的前景分割模块能够较好地实现前景部分的提取。同时,能够保留部分行人轮廓边缘的图像信息,保持了前景图像中行人部分图像的完整性和平滑性。

2.5.2 结合前景分割的多特征融合行人重识别方法识别结果可视化

为了更好地展示本文方法的识别效果,在Market1501 数据集上随机选择行人进行识别结果可视化,如图10 所示。因为前景分割模块是加入到特征提取网络之中的,所以最终的结果呈现都有背景。

图10 在Market-1501数据集上部分查询结果可视化Fig.10 The visualization of partial query results on the Market-1501 dataset

3 结 论

行人重识别作为一种跨镜头任务,摄像头的数量多,覆盖的范围大,同一行人在不同摄像头拍摄到的图像中会存在较大的背景差异,使得同一行人特征相似度下降。对此,本文提出了一种结合前景分割的多特征融合行人重识别方法。首先通过损失函数的设计和注意力机制的应用增强前景分割与行人重识别任务的耦合效果,在提取前景同时保持前景图像的平滑性和完整性;然后通过多粒度特征引导分支和多尺度特征融合分支提取更有鉴别性的特征;最后通过联合损失函数促进网络的训练优化。在3 个主流数据集上的实验结果表明,本文方法在一定程度上缓解了背景变化导致的误识别问题,提高了识别效果。与其他ReID 方法相比,本文方法通过前景分割的方式删除掉了行人图像中差异较大的背景部分,提高了同一行人特征的相似性;并联合行人图像中的多尺度、多粒度特征得到了更具判别力的行人特征表达。但是,本文方法直接将前景分割网络作为模块添加到ReID 任务中,极大增加了模型的参数量和训练时间,会影响ReID 任务的时效性。并且,前景分割与行人重识别作为两种任务,如何更好地结合是一个巨大挑战。下一步将着眼于二者的结合,一方面通过网络结构的优化,在保持网络模型轻量化的同时保持较好的识别效果;另一方面通过对结合两种任务的研究以取得更好的耦合效果。