军事任务中基于手势的交互技术研究

2023-03-11郭曌阳龚安民

郭曌阳,龚安民

(武警工程大学,西安 710086)

0 引言

近年来,随着科技高速发展,远程操控、侵入式(VR)课堂、新模式(AR)会议、无人运输车等新型交互技术的出现,生活与工作方式随即发生着巨大的变化。同时,在军事领域中,武器装备技术与战术战法都愈发向机器、无人、信息、智能化方向发展。根据未来战场构想,作战员可在距离战区相对遥远且安全的地方,完成对前线作战无人机器的实时远程遥控,使其完成作战指令。由此,作战员对无人机器的有效控制将极大影响任务的完成度,从而影响战事的胜败与走向。另外,根据观察-判断-决策-行动(OODA)循环理论,OODA 运作的速度将对战场结局产生较为重要的作用。因此,拥有一个高时效,低时延、稳定安全的无人机器交互控制系统显得至关重要,对作战员与无人机器交互技术的研究与设计是具有现实意义与实际价值的。

目前,在人机交互领域,手势识别一直是研究的热点与难点,识别技术主要有两种研究方向:基于传感器数据设备的体感类手势识别与基于计算机视觉的视觉类手势识别技术[1]。随着近几年深度神经网络的快速发展,目前基于计算机视觉的识别技术是当下的新方向。基于视觉类的手势识别技术与理论来源于目标检测与物体识别技术方法,其早期大多采用人工特征提取和分类器结合的技术方案,如使用HOG 提取图中目标特征,用SVM 完成对目标的分类与识别。而近几年普遍参用深度神经网络(如CNN、RNN 等网络结构),如CNN 网络利用卷积核提取图中目标的浅层特征,而后通过激活函数完成非线性的变换[2],进而得到深层抽象的目标特征,最后通过softmax 层完成分类。本研究中体感类和视觉类手势技术都将涉及,最终提出一种手指信息检测技术(视觉类)与交互系统的设计原型(包含体感类与视觉类)。在体感类方面采用阈值法对手势信号进行分析,得出特定手势对应的运动规律,完成手势识别分类;视觉类方面根据手势的表观特征,如肤色[3]、手指个数等,采用人工特征加分类器的组合实现手势的识别与分类。

1 国内外研究现状

国外关于交互相关技术研究起步较早,出现一些较为成熟的技术和产品。如基于视觉类的交互技术包括微软公司早年间推出的Kinect 外设,与NASA 合作推出的全息眼镜HoloLens,以及基于双目摄像头进行对用户交互行为识别与分类的Leap Motion 等。传感类交互技术如Myo,其通过实时将肌肉活动产生的电信号转化为数字信号,开发者利用分析不同动作的信号特征,从而识别与分类使用者的不同动作;任天堂则推出的wii 利用惯性传感器捕捉手势信息;同时在传感类交互技术中关于手势识别的方法也有很多,如文献[4]使用支持向量机(SVM)作为手势分类器,将手势的加速度信号作为特征;文献[5]则利用慢特征分析法对手势进行分类;文献[6]研究者利用手势与Wi-Fi 信号产生的特普朗效应,通过特定算法识别出用户的不同动作,从而完成手势交互操作。

与国外相比,国内目前还没有与Leap motion,Kinect 市场规模相当的交互产品,但交互相关技术方面也已具备较强的实力。在基于传感类交互技术研究方面,文献[7]将手势的识别问题转化为一个隐形马尔可夫链问题,不同手势对应不同状态;文献[8]完成了约70 种不同手势的识别研究,通过增加随机噪点来增大输入量,减少了收集原始数据的工作量。基于视觉信息的交互技术方面,文献[9]通过将3D 空间映射为2D 空间手势,降低了数量维度,其次,通过对比发现,手部的指尖可通过曲率完成定位与检测,最后文中利用指尖这一特征进行后续的手势识别,该研究提出的关于手指指尖定位的方法对手势识别技术的研究具有一定启发性;文献[10]利用凸包进行手势的识别与分类,该方法已较为成熟,在处理多数非刚性物体时具有较好的效果。此外,近年来也出现了基于设备Leap Motion 或Kinect 等硬件外设,进行手势识别相关的研究,文献[11]通过定义关于4 个指间的几何特征,进行手指的骨架拟合,完成对指尖部分识别与检测;文献[12]利用人眼与指尖的两点连线,完成不同的交互在动作,以此完成用户的交互作业;文献[13]基于智能手机的内置传感器,分析交互手势的信号特征,从而实现识别与交互;文献[14]通过背景差法,建立自适应肤色模型,降低画面中肤色噪点,提高识别精度;文献[15]将手势跟踪与手势识别结合,并基于Camshift 算法,实现多目标跟踪与双手识别;文献[16]利用Xtion 深度设备,获取手势的深度信息从而完成识别。

2 目前存在的问题与不足

2.1 手势定义的二义性与识别技术的低适用性

一般情况下,对于手势种类的定义存在多义性,一种手势在此类技术、方法为A 类手势,在另一种方法中则可能为B 类手势;对使用者产生的有效交互手势有较为严格的规范、要求。如基于视觉信息类的手势识别技术存在光线、背景等环境要求;有的手势种类定义过于多,一个手势过多的交互系统对使用者来说学习成本较高,对于人机交互系统本身来说降低了交互的适用性。

2.2 基于视觉的手势识别依靠肤色特征较明显

多数利用肤色模型进行手部位置定位与检测的方法,如文献[3,13,19-21],虽在最终识别达到的预先设想,并满足交互技术要求,但在最初手势检测与提取时都以肤色模型为主,甚至作为发现画面中手势信息的唯一特征,同时强调了其方法的作用环境与使用者的交互规范。若当使用环境无法准确获取肤色信息(环境较暗,背景复杂,使用者为黑色皮肤人种),或使用者交互行为有所偏差,画面中手部信息提取的精度与最终手势识别准确度将会有所偏差。

2.3 未考虑其他学科已有的研究成果

人机交互作为一门交叉学科,包含计算机、心理、机械等理工与人文学科,若单纯在提升设备硬件、软件设计、识别算法、交互逻辑没有考虑到人体工效学、认知心理学等学科的知识,设计出的交互技术对于使用者不能友好,学习成本高,从而会影响无人机器战争中的作战效率。

3 改进的措施与方法

3.1 利用新技术新平台,进行手势识别的技术研究

对于基于视觉类的交互技术,不单只利用单目摄像头、双目摄像头,也可尝试在可穿戴设备中装备深度视觉传感器,该设备与普通摄像头相比,不仅可提供传统的RGB 颜色信息,还可提供图像中物体的深度信息,因此,可获取较多的信息,增加手势信息获取的信道,从而识别手势的种类与精度比以往更多,更高。同时,基于增加的手势信息,可对目前的交互技术进行业务功能拓展,即适用更多的作战任务。

3.2 利用多个特征进行手部检测与提取,增强方法的适用性

考虑不单只依靠肤色特征,进行手部的检测与提取,考虑增加手部的其他特征如梯度、轮廓、曲率、表观特征等。因为存在某些作战环境中,作战人员手部无法显示肤色(佩戴战术手套、光线昏暗等),因此,在最初设计时可采取模块化、接口化的模式进行交互系统的开发设计,为后期因任务需求而变换检测技术留下拓展接口(如将摄像头更换红外摄像头)。在环境允许的情况下,利用普通摄像头或深度摄像头;反之,可采用红外摄像头。为提高系统鲁棒性,可分析利用Hu 矩、手部轮廓的傅里叶算子、整个手部的HOG 梯度直方图等信息与肤色模型相结合的多维度方法,对手部完成检测与提取。如文献[18]基于图像边缘信息与椭圆肤色模型相结合的方法进行手部检测与提取。文献[19]中利用脸部、手部、手臂部三者的位置关系,完成了手部的检测与提取。文献[20]中利用深度摄像头,获取手部的骨骼信息,进而完成手部检测。文献[21]甚至利用指尖为半圆这一特征,通过改进的径向对称算法完成手部定位,进而实现识别。

3.3 简化手势种类,设计便于系统设计的识别技术

设计便于快速响应任务指令的交互手势。在军事任务下的交互,不仅强调交互系统的实时性,更需交互手势的可识别性。军事任务下的交互手势,不能单纯只考虑交互的人机工效与自然性以及认知心理学,更多的需要系统快速对操作员的指令进行精准识别,完成相应作业。因此,在最初设计时,设计的交互手势特征应明显可识别,在定义层面可尽量避免二义性,并具有较强的可拓展性。可参考文献[22]中基于手指个数与HOG 信息的分层识别策略,其思路是:第1 步按手指个数分类,第2 步再将手势(已按指数分类)的HOG 信息放入相应的SVM 分类器(按指数训练若干分类器),最后完成手势的识别与分类。

4 交互系统原型的设计与实现

从交互手势设计上来看,一般情况下,手势种类可分为静态与动态两大类,为提高系统的适用性,定义静态类交互行为(交互行为由若干大致相同单元手势[7]连续组成),动态类交互行为(交互行为由若干不同元手势组成)。静态类交互行为:使用者做出连续的单一元手势,一般可进行简单的指令、数据信息交互,完成相应的作业。动态类交互行为:使用者做出连续的多种类元手势,一般可对较为复杂的指令、数据信息进行交互作业。

因军事任务中环境与需求作业的多样性,系统在最初设计时应提供多种交互模式以应对不同场景作业。使用者根据当前任务类型选择合适的交互方式(后期可将该工作自动化,由计算机完成),若当前环境较为恶劣、光线昏暗,为保障任务顺利完成,可选择按键式的可穿戴设备。若当前环境较好,使用者可选择按键方式、体感、视觉类的可穿戴设备进行作业。

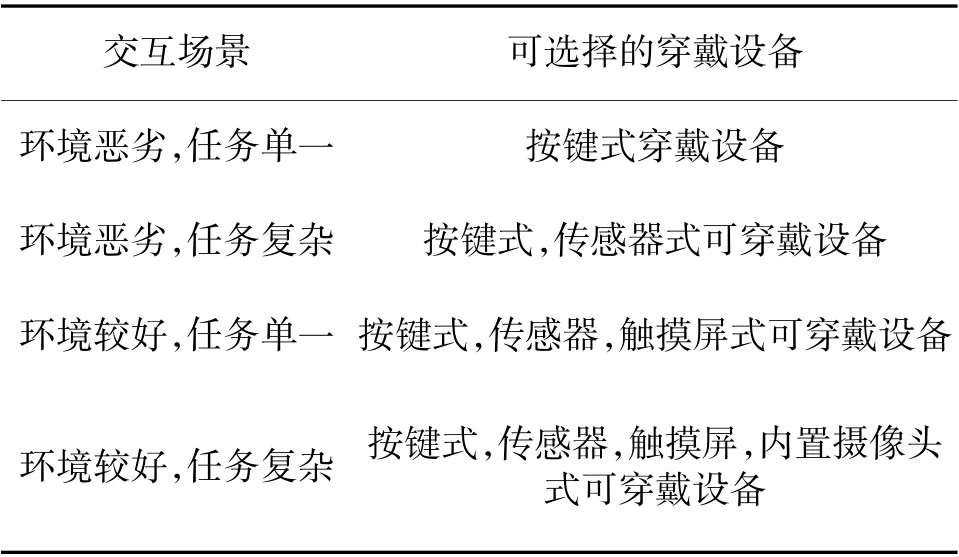

如表1 所示,为了应对复杂多变的战场情况,提供4 种交互实施方案(可拓展)。当战场环境恶劣,如夜间,极寒或极热,或使用者行动空间受限,可选择按键式穿戴式设备进行任务性质较为单一的作业;若环境依旧恶劣,任务性质较为复杂式时,因任务作业所需的交互手势在种类与数量上的增加,需重新进行系统的交互手势定义与增加获取其手势信息的信道,可选择具有传感器(如加速度传感器,角速度传感器等)的可穿戴设备,增加手势信息提取的信道,从而增加交互手势,完成作战任务;若所处战场环境较好(如远离战场环境且光线环境良好等),可选择具有触摸屏穿戴设备进行交互操作(如控制无人机进行录像等),当任务复杂时,因视频流可承载的信息最为丰富,因此,可选具有内置摄像头的可穿戴设备进行手势交互操作,完成相应的作战任务。

表1 任务场景Table 1 Task scenarios

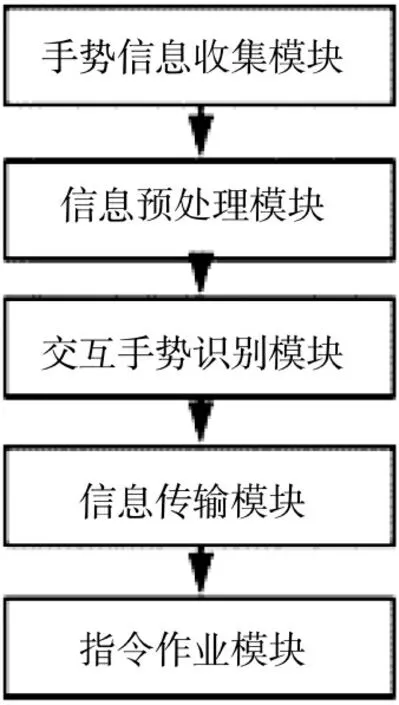

如下页图1 所示,系统由5 个子模块组成:手势信息获取模块、信息预处理模块、交互手势识别模块、信息传输模块、指令作业模块。交互系统可采取C-S 或B-S 架构,在网络拓扑结构上也可采取多对一对一或一对多模式,具体可根据任务需求与系统硬件以及通信带宽来决定。

图1 系统模块图Fig.1 System module picture

手势信息获取模块:周期获取使用者的手势数据。手势数据通过两个数据源获取数据,一个是体感类数据,加速度与角速度传感器可用来获取交互手势数据;视频类手势数据通过提取视频流中帧画面获取,考虑到系统的实时性,采集数据的频率可为(次/0.1 s)、或更高,具体根据系统需求与识别算法速度而定。信息预处理模块:主要完成对交互信息的去噪(视频流的图像噪点问题,EMES 传感器的数值漂移等问题)。其中,基于视频类的手势信息可通过阈值法、中值滤波、图像形态学(膨胀、腐蚀、开运算、分水岭法)等方法完成信息去噪。需要注意的是,用高斯法处理图像,虽可平滑去掉多数噪点,但其加权平均的思想会模糊化边缘信息,进而使手部边缘梯度下降,不利于后续手部的检测与提取。可考虑小波、傅里叶变换等方法,此类方法都可将图像高频中噪点信息去除(一般噪点在高频,通过逆变换便达到去噪的效果)但当检测目标在高频也存在信息时,如何有效区别噪点与目标就成了一个值得研究的问题。另外,体感类手势信息也会出现数据噪点,所以获得原始数据后需进行去噪处理,处理方法可采用位置测定标定法,即预先将设备静止放置,得出其被测物体静止时传感器误差值并求其平均值,然后将原始数据中噪点去除[2]。交互手势识别模块:该模块为整个交互系统的核心模块。参考文献[17]可解决基于传感器类可穿戴设备的手势识别的姿态设计问题,即通过手势行为所产生不同的加速度、角速度特征信息,对不同手势进行分类识别,从而完成作战任务。一般情况下,可选择滑动窗口先获取可穿戴设备中EMES(加速度、角速度)传感器的信息,然后通过阈值法判断当前数据是否含有潜在交互手势信息;而后根据结果,对有效的潜在手势信息进行数据预处理,反之数据丢弃;最后利用预先训练好的手势分类器进行手势分类,完成相应交互作业。参考文献[3,13]完成基于视频流信息为主的手势识别姿态设计,手势分类器可选择多变量决策树[3],支持向量机等。信息传输模块:负责整个系统的信息传输功能,可采用有线、无线等通讯介质。指令作业模块:一般由两部分构成,无人机器与系统服务器构成。系统服务器将交互指令通过信息传输模块发送至无人机器,无人机器根据预先编写的程序代码完成相应作业,在此处可将作业情况对系统服务器进行返信,以便使用者及时了解实际作业情况,开展下步作业。

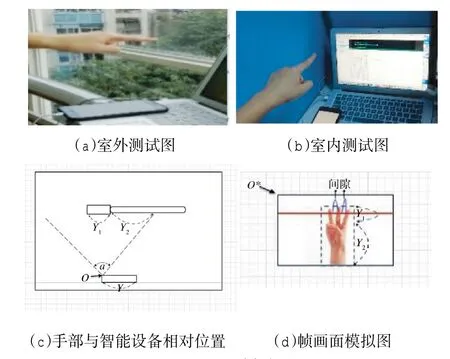

本文提供一种基于识别手势的表观特征- 手指信息的交互技术。如图2 所示,完成识别姿态调整与部署,其图2(d)中,O*表示智能终端Y 摄像头O 捕获的帧画面(模拟),本文利用指间出现的非肤色区域信号(即手指间隙)特征,完成对画面中手势的手指数的识别。完成姿态调整后对帧画面去噪。首先,将帧画面分为若干子画面,对子画面利用如式(1)判断是否为噪点。

图2 识别姿态图Fig.2 Posture recognition picture

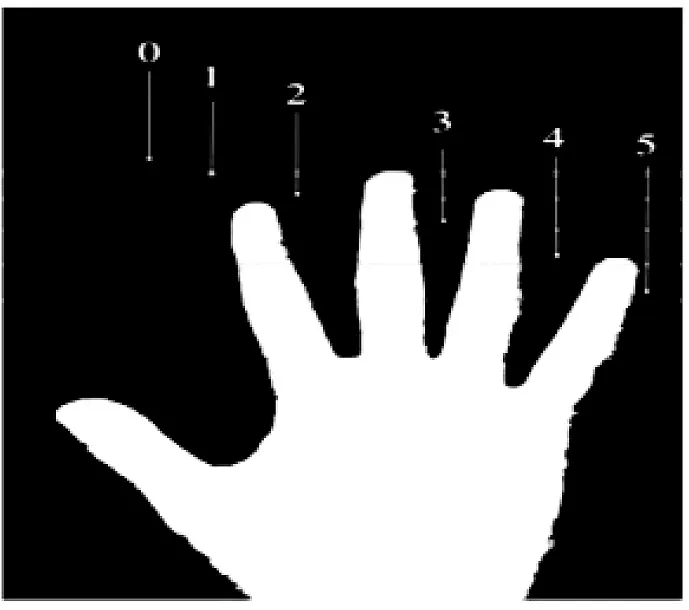

式中,pm 为子画面中肤色像素数;x*x 为子画面像素总数。之后,对帧画面进行手指个数的识别。如下页图3 所示,利用滑动窗口技术从帧画面的上至下、左至右方向进行检测,同时考虑算法时效性,窗口在上下移动的距离会根据当前获取手指信息(手指平均宽度)动态变化。如图4 所示,通过设置合适阈值YN、窗口大小(此时YN=5、窗口:宽=img_width,高=1),完成对手指的检测,标号0 线为初次检测到手部位置窗口(不含手指宽度信息)、标号1 线为初次检测到手指信息(含指宽信息)、标号2 线为二次检测到手指信息窗口(注意此时窗口移动的距离变化),标号3、4、5 以此类推。注意到对大于阈值fathreshold的子画面未去噪。

图3 手势识别流程图Fig.3 Flow chart of gesture recognition

图4 实际效果图(未去噪)Fig.4 Actual effects picture(not denoised)

一般噪点具有随机,难预测特点,有效信息像素点(如肤色像素点,非肤色点)一般不会单独出现,即有效信息像素点周围存在若干属性相似的像素点。因此,利用此特性进行此类子画面的去噪。如式(2)所示,对当前像素点xji进行分析与判断:它为肤色点则满足式(2)[1];若它为非肤色点,则满足式(2)[2];若当前像素xji为噪点,则满足式(2)[3]。

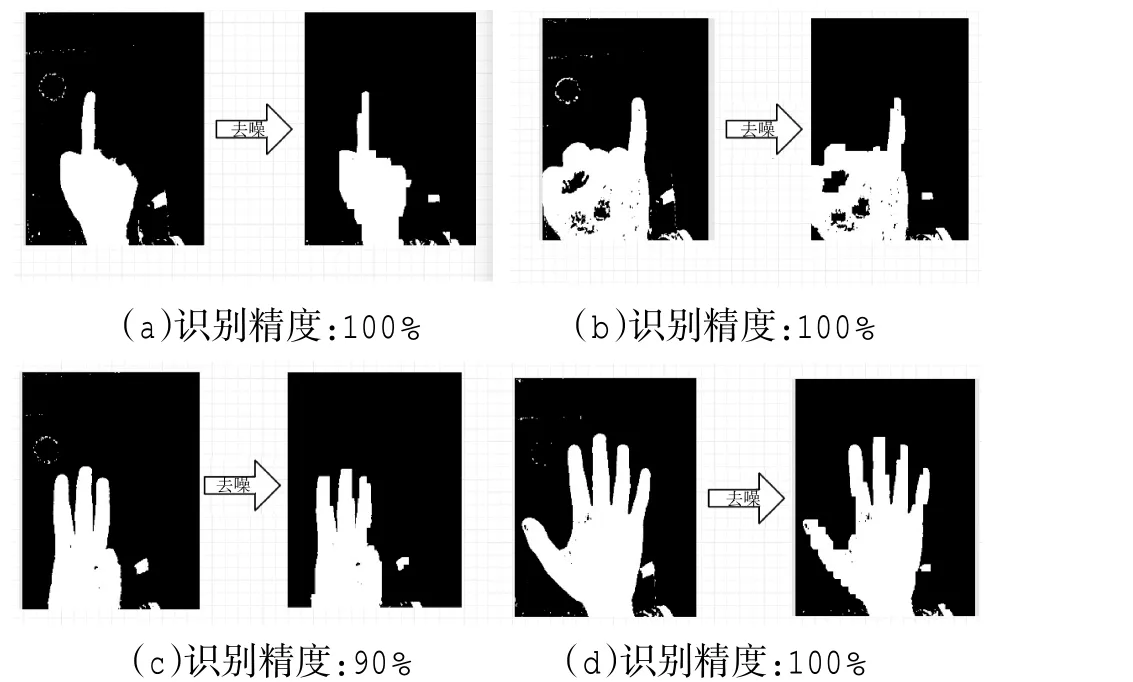

最后,进行仿真实验。详细实验参数如下,皮肤颜色特征:YCbCr 颜色空间,肤色椭圆边界模型,YN=5,fathreshold=0.25,imgy*imgx=640*480,imgx*1=480*1,n=3,每组手势实验20 帧,识别效果为20 帧中准确检测次数所占百分比,如图5(a)与图5(b)是手指为1 的静态手势,图5(c)是手指为3 的静态手势,图5(d)是手指为4 的静态手势(因大拇指活动范围较广、本文未对大拇指进行检测与识别)。

图5 静态手势测试图Fig.5 Static gesture test results

5 结论

本文对军事任务中手势交互系统研究的背景与意义进行了简要介绍;将近年手势交互技术进行了简要介绍,并总结出3 个方面的不足与问题,同时给出了相应的改进措施与方法;提出一种基于手势表观特征-手指信息的检测技术,给出军事任务中手势交互系统原型。