基于深度学习的卷包设备清洁保养质量判别系统设计

2023-01-13陈天丽江志凌邵力波毛新彦石德伦姜军刘西尧谢茜柳盼

陈天丽,江志凌,邵力波,毛新彦,石德伦,姜军,刘西尧,谢茜,柳盼

烟草设备

基于深度学习的卷包设备清洁保养质量判别系统设计

陈天丽1,江志凌1,邵力波1,毛新彦1,石德伦1,姜军2,刘西尧1,谢茜1,柳盼1

1 湖北中烟工业有限责任公司武汉卷烟厂,武汉市东西湖区金银湖办事处环湖路51号 430040;2 华中科技大学人工智能与自动化学院,武汉市洪山区珞喻路1037号 430074

为解决烟草行业设备保养人工检查效率低、标准不一等问题,设计了一种基于深度学习的卷包设备清洁保养质量判别系统。系统主要包括三个模型,基于深度学习的保养部位识别模型,判别采集到的图像是否是正确的保养部位;基于深度学习的脏物检测模型,从采集到的保养图像中检测出不合格的脏物;融入工艺知识的保养质量判别模块,根据检测到的脏物和保养部位信息,判别保养是否合格。以武汉卷烟厂卷包车间为例进行现场测试,结果表明:系统对卷包设备的清洁保养质量判别准确率达到86.3%,满足实际生产中对卷包设备清洁保养质量的自动化判别需求,具备良好的泛化性能。

烟草;卷包设备;保养质量判别;深度学习

在当前卷烟行业生产过程中,设备保养是一个核心关键的环节。设备保养质量判别是通过具备丰富经验的专业技术人员进行检测、判别和管理的。由人工进行保养的合格判定存在很多的不足,人的主观判断会造成判定标准的不统一,设备多、检查点多,人员有限无法做到设备全覆盖检查,只能以抽查的形式进行且检查记录不易保存。为此,设计和研制一套自动、智能的卷包设备保养质量判别系统就显得很有必要。

卷包设备保养质量判别系统的核心是对卷包车间卷烟和包装设备的脏物目标进行准确的检测和分类。传统的基于图像的目标检测和识别技术,都严重依赖于人工精心设计的特征,特征必须具有平移、尺度、旋转和光照不变性,譬如LBP[1]、HOG[2]和DPM[3]特征。但由于人对视觉机理认识的局限性,手工设计的特征难以准确地描述要识别和检测的目标物体。其次,在目标检测任务中,为检测到一幅图像中各种不同尺度的目标,常常需要采用滑动窗口法,过程非常耗时。上述两个短板,使得传统的目标识别与检测技术在工业界应用受到了很大的限制。近十年来,深度学习技术的引入克服了传统方法的不足,通过深度模型,能够准确地对要检测和识别的图像目标进行特征描述。同时,通过并行计算技术,克服了滑动窗口法耗时的不足,使基于图像的目标检测和识别技术在实际中得到越来越多的应用[4-5],包括烟草行业[6-8]。典型的基于深度学习的目标检测技术分为以YOLO[9-10]和SDD[11-13]系列为代表的单阶段法和以RCNN[14-16]系列为代表的两阶段法,其中两阶段法检测的准确度更高。基于待检测脏物目标的复杂性,本文设计的卷包设备保养质量判别系统选用了性能更高的两阶段方案,采用了代表性的Faster RCNN[16]框架,融入特征金字塔网络[17]、可变形卷积[18]和RoI Align[19]等元素,更好地检测不同尺度和不同形态的脏物目标。同时,本系统在检测脏物之前要对保养部位进行识别,本文采用了基于通道融合的SENet网络[20]技术来实现此功能。

1 总体设计

1.1 系统结构

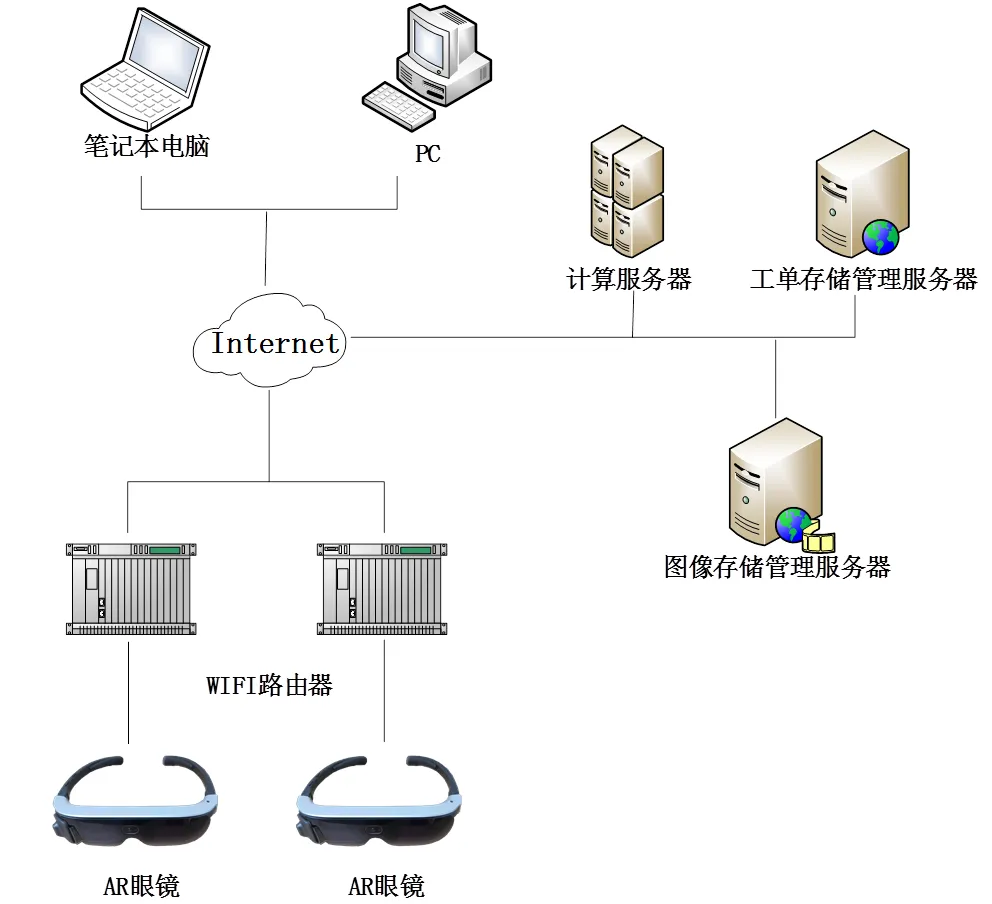

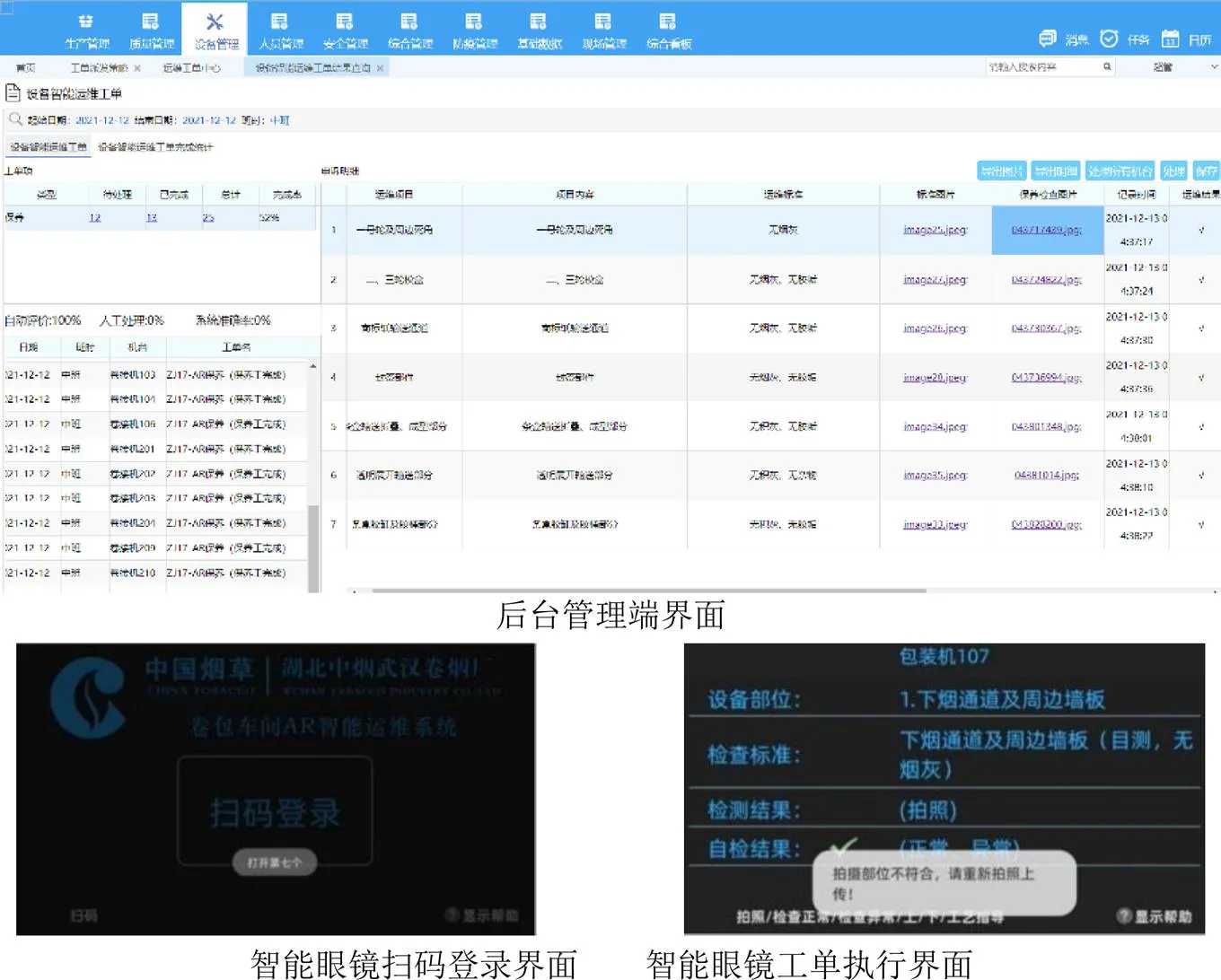

本系统的逻辑框架主要由后台管理端、前台执行端和服务端3部分组成如图1所示。其中,后台管理端主要用于管理人员生成每天的设备保养工单、并对已执行的保养工单进行管理和分析,其搭载在任意PC机或笔记本上。前台执行端主要负责执行保养工单,包括保养图像的采集及上传,其搭载在Rokid Glass 2型智能眼镜上,该眼镜具备良好的语音交互能力,方便一线工人操作。

图1 系统逻辑框图

服务端主要负责整个保养决策模块的计算服务、保养图像的存储管理服务和保养工单的存储管理服务。本系统将这3个服务一并搭载在一台配备Tesla V100 GPU显卡的高性能服务器上,满足深度学习所需要的计算、保养图像的存储管理和保养工单的存储管理需求。系统需要应对更多的工作需求时,这3个服务可分别搭载在3台不同的服务器上。如图2所示,这3种设备(即PC机或笔记本、智能眼镜和服务器)是通过企业内部的网络互连,从而保证了整个系统的安全,其中,智能眼镜是通过无线网络连入的,这样就不用限制一线工人的移动。

图2 系统硬件框图

系统的日常工作流程为:由后台管理端生成当日的设备保养工单,并发送到搭载服务端的服务器和搭载前台执行端的智能眼镜上;一线操作工人领取智能眼镜,到对应的设备执行当日的工单,包括保养图像的采集及上传;服务端接收来自前台执行端的保养图像,进行保养质量的判决,并将结果反馈给前台执行端和后台管理端;前台执行端获取来自服务端的保养判决结果,并将工单执行结果上传给服务端和后台管理端。图3列出了本系统相关软件的部分界面。

图3 系统软件的部分操作界面

1.2 技术路线

如图4所示,本系统的算法部分主要包含保养部位识别、脏物检测及保养质量判别三个模块。保养部位识别模块采用SENet模型,负责判别采集到的当次保养图像是否属于对应的保养部位,如果是对应的部位,则进行后续的脏物检测步骤,否则重新采集图像。脏物检测模块使用融入特征金字塔网络、可变形卷积和RoI元素的Faster RCNN检测模型,负责从采集到的图像中检测出不合格的烟灰、胶垢、烟支、薄膜、废纸和铁屑等六类脏物。保养质量判别模块根据检测到的脏物的预测分数和保养部位信息,并融入专业的经验知识,判别该次的保养是否合格。

图4 系统软件框图

2 算法设计

2.1 保养部位识别模块

卷包设备包括卷烟机和包装机,卷烟机包含VE侧门、VE底部防护门、平准器、VE磁选、VE后部防护罩门、烟枪部分、印刷系统等23个保养部位。包装机包含下烟通道、一号轮、商标传送通道、封签部件、烟包输出部分等13个保养部位,两种机型共有36个部位。上述部位形态复杂,本系统的保养部位识别模块为更准确地识别这些部位,采用了嵌入SENet模块的ResNet50网络模型。

2.1.1 嵌入SE模块的ResNet50

SENet的核心是SE模块,该模块示意如图5所示。给定一个卷积层的输出特征X,通过SE模块的一系列变换操作后得到一个通道加权的与X同维度的特征Xs。SE模块通过三个操作来变换输入的特征X:首先是Squeeze操作Fsq(.),在空间维度来进行特征压缩,将H×W×C的特征图(H和W分别代表特征图的高度和宽度,C为特征图的通道数)变为1×1×C,该操作常通过全局平均池化将每个二维的特征图变成一个实数来实现(图5的右图),该实数在某种程度上具有全局的感受野,从全局表征了该通道的特征;其次是Excitation操作Fex(.),一般使用两个全连接层来实现(图5的右图),第一个全连接层FC1和ReLU函数用于提取不同特征通道之间的相关关系,第二个全连接层FC2和Sigmoid函数用于提取每个特征通道的重要性;最后是一个Scale操作Fscale(.,.),将SE模块计算得到的通道权重和原始的特征进行相乘,实现将不同通道的重要性引入了加权之后的特征图中。

图5 SE模块

SE模块可以用于改造任意卷积网络得到的特征,本系统的保养部位识别模块采用嵌入SE模块的ResNet50网络结构,其结构如图6所示,左图是常规的ResNet单元,右图是嵌入SE模块后的单元。

图6 嵌入SE模块的ResNet

2.1.2 识别模型的训练

为训练保养部位的识别模型,在武汉卷烟厂卷包车间采集了卷包设备的36个保养部位共3025张图像,进行图像翻转、图像旋转和固定尺寸随机裁剪的数据增强操作,以得到更多的数据用于训练识别模型。SENet采用标准的SE模块参数,在ResNet50的基础上进行网络搭建,使用PyTorch平台进行开发。

2.2 脏物检测模块

如图7所示,系统的脏物检测模块使用基于Faster R-CNN框架的网络结构,其主要由以下几个子模块组成:(1)特征提取子模块,用于提取当次输入的保养图像特征供其它两个子模块使用;(2)RPN子模块,用于生成可能包含目标的候选框,并将结果提交给RoI Align单元;(3)分类和回归Head子模块,用于对提取的候选区域进行脏物类别的识别和位置的预测。

图7 脏物检测模块方框图

为提升对脏物的检测效果,在原始Faster R-CNN网络的基础上,系统在特征提取子模块使用了特征金字塔网络和可变形卷积核,在Head子模块使用了RoI Align方法替换原来的RoI Pooling方法,而RPN子模块与原始的Faster R-CNN网络一致。

2.2.1 基于ResNet50的特征金字塔网络

原始的Faster R-CNN网络只使用卷积网络最后一层的特征图来检测目标。卷烟生产过程中产生的烟灰等脏物常常会呈现细小而又稀疏的状态如图8所示,这些小的脏物经过多次池化之后,其信息有可能丢失,导致其检测效果比较差。为解决此类问题,SSD直接使用多个尺度的特征图,根据物体的大小将其分配到不同的层进行预测。但直接使用低层特征来检测小物体的效果并不好,因为浅层网络的卷积数量少,表示能力差,缺乏足够的语义信息来对脏物进行检测。为了改善模型对稀疏烟灰、胶垢等小的脏物的检测性能,本系统使用了基于ResNet50的特征金字塔网络(Feature Pyramid Networks,FPN)。

图8 细小稀疏分布的烟灰

FPN通过特征融合的方式将不同层的信息进行汇集,使得低层的特征也能够拥有丰富的语义信息,能更好地对小的脏物进行检测。基于ResNet50的FPN的结构如图9所示,包含ResNet和FPN两个部分。输入的当次保养图像在ResNet网络的前向传播的过程中由于池化作用,特征图将逐步变小,不同尺度的特征图形成了金字塔结构,上层特征图包含脏物的语义信息,下层特征图则有脏物丰富的细节信息。FPN与ResNet的自下而上的路径相反,是通过构建自上而下的路径,能将高层特征图的语义信息传给低层特征图,使低层的特征图同时具备细节信息和语义信息,能够更好地检测稀疏烟灰、胶垢等小的脏物。FPN的具体过程为:高层特征图先通过2倍上采样的方式使得高层特征图的尺度和低层特征图一致,然后低层特征图通过1x1卷积,得到与高层特征图相同的通道数。最后,上述两个特征图相加,得到新的融合了高层语义信息的低层特征图。这些新的特征图,将用于后面脏物的检测。

图9 基于ResNet50的FPN

2.2.2 可变形卷积

卷烟生产中产生的烟灰、胶垢、烟支、薄膜、废纸和铁屑等脏物往往形状复杂且多变如图10所示。标准的卷积核感受野是标准的矩形,不能表达脏物的复杂结构,因此本系统采用了可变形卷积技术。可变形卷积对每个采样点的位置都增加了一个偏移值,卷积核就可以在标准位置的附近自适应地采样,不局限于标准卷积核中的规则矩形格点位置,能更好地匹配目标物体的形状。如图11所示,灰色的矩形格点为标准卷积核的采样位置,黑色的点为加偏移之后的采样位置。

图10 形状多变的胶垢和烟灰

图11 可变形卷积

可变形卷积的实现是通过在标准的卷积流程中,新建一个卷积分支来专门生成卷积核采样点的偏移位置。对于一个B×C×H×W(B代表一个batch具有的图像数量,C代表通道数,H和W分别代表特征图的高度和宽度)的特征图,假设使用的是3×3的卷积核,因为有9个采样点,每个采样点有x、y两个方向,即对于每个位置而言,需要预测18个值。将特征图送入一个新增加的卷积层,将得到一个(b, 18, h, w)的输出,作为每个位置的采样偏移值。再根据偏移值对标准卷积核的位置进行校准,在校准后的特征图对应位置进行卷积运算,让可变形卷积具有学习目标物体空间几何形变的能力。

2.2.3 RoI Align

图12 RoI Align示例

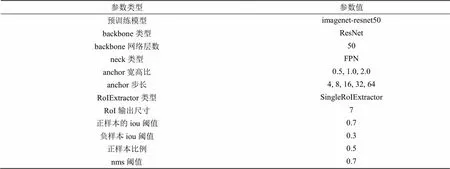

2.2.4 检测模型的训练

为训练检测模型,从用于保养部位识别模型的训练集中选取了2751张带脏物的图像,图像在36个部位均匀分布。采用labelimg工具,对图像中的烟灰、胶垢、烟支、薄膜、废纸和铁屑等六类脏物进行了矩形框标注。对数据采取了图像翻转、图像旋转和固定尺寸随机裁剪等增强手段,得到更多的数据用于训练脏物检测模型。模型是在pytorch框架基础上使用mmdetection深度模型平台进行开发。模型的训练参数设置如表1所示。

表1 脏物检测模型训练参数

Tab.1 Training parameters of dirt detection model

2.3 保养质量判别模块

本系统的保养质量判别模块用于判别当次保养是否合格,其关键是对脏物检测模块输出的各个脏物的预测分数设置合适的阈值,当高于此阈值时,即判别当次保养不合格,否则为合格。在卷烟的生产流程中,由于生产工艺的原因,有些部位只会出现特定的脏物。如在卷烟制作完成后负责运输和封装的部位处,主要的脏物是纸屑封签等,此阶段卷烟已经成盒包装,该部位基本不会出现烟灰类脏物。因此,对于纸屑脏物,可以给一个较低的阈值,而对于烟灰脏物,可以给一个较高的阈值。类似的,对于卷包设备的36个保养部位,可以有针对性地设计各种脏物的阈值。通过融入生产经验知识的调整不同脏物阈值的方法,能够有效地提升本系统对保养质量判别的准确率。

3 应用效果

3.1 材料与方法

为了检测本系统的性能,在武汉卷烟厂卷包车间重新进行图像采集,由Rokid Glass 2智能眼镜分别获取卷包设备的36个不同部位的图像数据。测试服务器配置的CPU型号为i7-8700,GPU型号为Tesla V100,深度学习的平台为PyTorch版本为1.5.0,CUDA的版本为10.2。

按构成本系统算法的3个子模块,整个测试分为3个部分,分别为:

(1)保养部位识别模块测试。测试集记为I1,总共有2856张图像,包含机器36个不同的部位,每张图像包含一个部位,其对应的部位名称在测试前要先进行标注。本系统的保养部位识别模块的任务是判别输入的图像是否是保养正在进行的部位,可采用one vs rest策略计算每一类的准确率,计算36个类别的平均准确率作为最后的测试指标。比如,测试图像为“烟枪部分”,只有识别为“烟枪部分”为正确,识别成其它部位均为错误。平均准确率的计算公式如下:

大学生学习目标不明确,缺乏学习动力,学习兴趣不高,自控能力差 大学相对宽松自由开放的环境,使得大学生有较多的自主时间,与高中高强度的、目标明确的学习形成鲜明的对比,极易产生放松心态。一些大学生没能形成合理的人生规划,没有确定的学习目标,学习动力不足,学习兴趣不高,面对相对闲暇的时光,加之自控能力差,难免会迷失方向。而手机功能日趋丰富,诱惑力大,导致他们用手机打发时间,并自然而然地在课堂上使用手机。

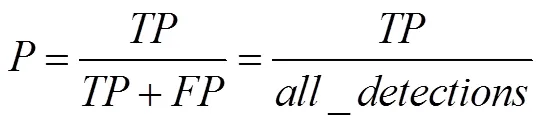

(2)脏物检测模块测试。测试集记为I2,其图像与测试集I1一致。与测试集I1不同的是,测试集I2对其中1628张包含脏物的图像用labelimg工具进行了矩形框标注。本系统关注所检测到的脏物类型是否正确,用平均精度均值mAP(Mean Average Precision)进行评估,这是目标检测最重要的测试指标。为计算mAP,先分别单独计算烟灰、胶垢、烟支、薄膜、废纸和铁屑的平均精度AP(Average Precision),AP的理论公式如下:

其中,为精确率,为召回率,()为以为参数的函数。从公式可以看出,等于P-R曲线下面的面积。实际计算时,需要将在[0,1]区间分成N段,具体公式如下:

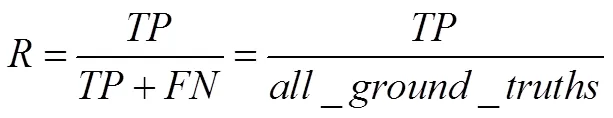

上述定义中,为目标框被正确检测出来的数目,为预测框预测错误的数目,目标框没有被预测出来的数目。从上可以看出,指正确检测出来的目标框数量占所有预测目标框数量()的比例,指正确检测出来的目标框数量占所有标注为目标框数量()的比例。

(3)保养质量判别模块测试。测试集记为I3,在测试集I1的基础上扩张成9748张图像。整个系统是对保养质量的合格与否进行自动判别,每张图像都标注为保养合格或不合格。该任务是一个简单的二分类问题,其测试指标就是采用二分类的准确率,具体计算如下:

假设只有正负两类样本,指正样本图像被识别为正,指负样本图像被识别为负。本系统假设保养不合格的图像为正样本。

3.2 测试结果分析

3.2.1 保养部位识别模块测试结果

在进行保养部位识别性能测试时,将测试集I1的保养部位分为36个部位,每个部位的检测结果如表2所示。

表2 保养部位识别性能表

Tab.2 Table of the identification performance of maintenance module

由表2可以得出,该模型性能在36个部位的准确率均保持在93%以上,表现稳定,且平均正确率也达到了95.7%,表明本模型对保养部位的识别能力较好。

3.2.2 脏物检测模块测试结果

在测试集I2上完成脏物检测模块的测试,测试结果如表3所示。本系统在该测试集上的mAP性能为0.630,考虑到脏物本身的颜色、纹理和形态的复杂性以及脏物背景的复杂性,该结果表明本系统对脏物具有较好的检测能力,图13列举了部分检测实例。从表3中可以得出,模型对于不同脏物的检测性能是不同的,其中薄膜的检测性能远低于其它脏物的检测性能,这是由于薄膜本身的材料是透明的,颜色和纹理的特征都不显著,因此很难检测出来,这也是将来系统要改进的重点。

表3 脏物检测性能表

Tab.3 Table of dirt detection performance

3.2.3 保养质量判别模块测试

保养质量判别模块的测试集I3是按卷包车间的机器编号进行分类的,这些机器包括R101、R102、R103、R104、R105、R106、R201、R202、R203、R204、R205、R206、R207、R208、R209、R210和R211共17个编号,每台机器的样本都是在多个不同的时间段进行采集的,使得测试结果更能代表实际的性能。最终的测试结果如表4所示。

表4 保养质量判别性能表

Tab.4 Table of maintenance quality discrimination performance

由表4可以得出,本系统在17台设备上的保养质量判别准确率均保持在83%以上,说明系统的表现较为稳定,同时在I3测试集上的总体测试准确率达到了86.3%。这些结果表明:本系统的保养质量判别模块在测试集上表现出比较高的判别准确率,其性能已经达到设计要求,能初步满足实际生产中对卷包设备保养质量的自动化判别需求,具备良好的泛化性能。

图13 脏物检测结果示例

4 结论

针对卷包设备保养状态的自动化判别需求,本文提出了一种基于深度学习的卷包设备清洁保养质量判别系统。系统首先设计了一种嵌入SENet单元的ResNet50网络用于构建保养部位识别模型,判别采集到的图像是否属于正确的保养部位;其次设计了一种基于Faster R-CNN框架并引入特征金字塔网络、可变形卷积和RoI Align等元素的脏物检测模型,从采集到的当次保养图像中检测出不合格的脏物;最后设计了一种融入生产经验知识的保养判别决策模块,根据当前的保养部位和脏物检测模块输出的信息,判别该保养是否合格。系统将武汉卷烟厂卷包车间的不同时间段采集到的近万张图像数据集作为检测对象,对实际判别效果进行测试,结果表明:系统对清洁保养质量合格与否的综合判别准确率达到86.3%,是一种性能良好、实用性稳定的判别系统,可满足实际生产中对卷包设备清洁保养质量的自动化判别需求。本系统目前是离线检测,下一步将重点研究卷包设备清洁保养质量在线监测系统,设备重点部位脏污到一定程度提醒操作人员及时处理,提高清洁保养判别的实时性和检测效率。

[1] ZHU C, ZHOU H, WANG R, et al. A novel hierarchical method of ship detection from spaceborne optical image based on shape and texture features[J]. IEEE Transactions on Geoscience and Remote Sensing, 2010, 48(9): 3446-3456.

[2] Dalal N, Triggs B. Histograms of oriented gradients for human detection[C]//2005 Proceedings of the IEEE Conference on Computer Vision. 2005: 886-893.

[3] Felzenszwalb PF, Girshick RB, McAllester D, et al. Object detection with discriminatively trained part-based models[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2010, 32(9): 1627-1645.

[4] 吕帅帅,杨宇,王彬文,等. 基于改进Mask-RCNN的飞行器结构裂纹自动检测方法[J]. 振动、测试与诊断,2021,41(03): 487-494.

LV Shuaishuai, YANG Yu,WANG Binwen,et al. An automatic crack detection method for structure test based on improved mask-rcnn[J]. Journal of Vibration, Measurement & Diagnosis, 2021,41(03):487-494.

[5] 黄尚安. 基于改进YOLO模型的交通标志检测[J]. 科学技术创新,2021, 18:194-196.

HUANG Shangan.Traffic sign detection based on im proved YOLO model[J].Scientific and Technological Innovation, 2021, 18: 194-196.

[6] 陈智斌,农英雄,梁冬,等. 基于深度学习的卷烟牌号识别方法[J]. 烟草科技,2020,53(12):75-82.

CHEN Zhibin, NONG Yingxiong, LIANG Dong, et al. Recognition of cigarette brand based on deep learning[J]. Tobacco Science & Technology, 2020, 53(12):75-82.

[7] 肖雷雨,王澍,刘渊根,等. 基于深度学习技术的烟梗形态分类与识别[J]. 烟草科技,2021,54(06):65-74.

XIAO Leiyu, WANG Shu, LIU Yuangen, et al. Classification and identification of tobacco stem morphology based on deep learning technology[J]. Tobacco Science & Technology, 2021,54(06):65-74.

[8] 洪金华,忻惠琴,陆海华,等. 基于YOLOv3模型的卷烟厂烟虫识别方法[J]. 烟草科技,2020,53(09):77-84.

HONG Jinhua, XIN Huiqin, LU Haihua, et al. Tobacco insect recognition in cigarette factory using YOLOv3 model[J]. Tobacco Science & Technology, 2020, 53(9):77-84.

[9] Redmon J, Divvala S, Girshick R, et al. You only look once: unified, real-time object detection[C]//2016 Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2016:779-788.

[10] Redmon J, Farhadi A. YOLO9000: better, faster, stronger[C]//2017 Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2017:6517-6525.

[11] LIU W, Anguelov D, Erhan D, et al. SSD: single shot multibox detector[C]//2016 European Conference. Proceedings. 2016:21-37.

[12] FU CLIU W, Ranga A, et al. DSSD: deconvolutional single shot detector[EB/OL]. (2017-01-23) https://arxiv.org/pdf/1701.06659.

[13] LI Z, ZHOU F. FSSD: feature fusion single shot multibox detector[EB/OL]. (2018-05-17) https://arxiv.org/pdf/1712.00960.

[14] Girshick R, Donahue J, Darrell T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]// 2014 Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2014:580-587.

[15] Girshick R. Fast R-CNN[C]//2015 Proceedings of the IEEE International Conference on Computer Vision. 2015: 1440-1448.

[16] REN S, HE K, Girshick R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[17] LIN TY, Dollar P, Girshick RB, et al. Feature pyramid networks for object detection[C]//2017 Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2017:936-944.

[18] ZHU X, HU H, LIN S, et al. Deformable convnets v2: more deformable, better results[C]//2019. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition. 2019: 9300-9308.

[19] He K, Park G M, Dollar P, et al. Mask R-CNN[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, 42(2): 386-397.

[20] HU J, SHEN L, Albanie S, et al. Squeeze-and-excitation networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2020, 42(8): 2011-2023.

Deep learning-based discriminant system design of cleaning and maintenance quality of cigarette maker and packer

CHEN Tianli1*, JIANG Zhiling1, SHAO Libo1, MAO Xinyan1, SHI Delun1, JIANG Jun2, LIU Xiyao1, XIE Qian1, LIU Pan1

1 Wuhan Cigarette Factory, China Tobacco Hubei Industrial Co., Ltd., Wuhan 430040;2 School of Artificial Intelligence and Automation, HUST,1037 Luoyu Road, Hongshan District, Wuhan 430074, Hubei Province

Aiming at low efficiency and non-identical standards of manual inspection of equipment maintenance in the tobacco industry, a deep learning-based system for judging the maintenance quality of cigarette maker and packer was designed. The system mainly consists of three models, including the maintenance part recognition model based on deep learning to determine whether the collected image is the correct maintenance part, the dirt detection model based on deep learning to detect unqualified goods from the collected maintenance images, and the maintenance quality judgment module integrated with process knowledge to judge whether the maintenance is qualified according to the detected goods and maintenance part information. On-site test was conducted by taking the Wuhan Cigarette Factory's wrap-up workshop as an example. The results show that the system's accuracy rate of judging maintenance quality of cigarette maker and packer reached 86.3%, which meets the demand for automatic identification of maintenance quality of cigarette maker and packer in actual production and has good generalization performance.

cigarettes; cigarette maker and packer; maintenance quality discrimination; deep learning

. Email:1203627427@qq.com

陈天丽,江志凌,邵力波,等. 基于深度学习的卷包设备清洁保养质量判别系统设计[J]. 中国烟草学报,2022,28(6),CHEN Tianli, JIANG Zhiling, SHAO Libo, et al. Design of cleaning and maintenance quality discrimination system for roll packaging equipment based on deep learning[J]. Acta Tabacaria Sinica, 2022, 28(6).doi:10.16472/j.chinatobacco.2021.177

陈天丽(1990—),工学硕士,工程师,主要研究方向:卷烟在线检测装置和卷烟设备控制系统,Tel:15927264725,Email:1203627427@qq.com

2021-09-08;

2022-06-23