智能技术助推教师课堂教学行为评价的应用框架研究*

2022-12-27鲁圆圆陈增照石雅文郑秋雨

鲁圆圆 陈增照 陈 荣 石雅文 郑秋雨

智能技术助推教师课堂教学行为评价的应用框架研究*

鲁圆圆1,2陈增照1[通讯作者]陈 荣1石雅文1郑秋雨1

(1.华中师范大学 人工智能教育学部,湖北武汉 430079;2.武汉学院 信息工程学院,湖北武汉 430212)

目前,教师课堂教学行为评价主要采用课堂观察的经验描述方式,人力成本较高,且主观性强。随着人工智能技术在教育领域的广泛应用,该评价开始转向数据驱动的研究范式,智能技术赋能的教学行为评价凭借实时分析和可视化评价的优势,逐渐成为帮助教师调控教学行为、提高教学质量的有力手段。然而,目前智能化教师行为评价仍处于初步探索阶段,应用研究还不够深入。基于此,文章从评价数据、手段和结果上解析智能技术在教师课堂教学行为评价中的应用;利用声纹识别技术对课堂视频进行教师身份识别与话语追踪,分割视频片段;再从情感、姿态和位置偏好三个维度,构建教师课堂教学行为评价的应用框架;将评价结果以更加直观、易于理解的可视化方式呈现给教师,帮助教师进行教学反思。文章旨在通过研究,推进教师课堂教学行为评价向着智能、高效、持续的方向变革。

人工智能;教师课堂教学行为评价;教学行为识别;语音情感识别

随着人工智能的发展及智能教学环境的普及,利用智能技术进行课堂教学行为评价已逐渐成为新的趋势。2021年《教育部关于实施第二批人工智能助推教师队伍建设行动试点工作的通知》发布文件,指出要探索人工智能助推教师队伍建设的新模式[1],创建智能化教育环境提升教师素养[2],推动智能技术赋能教师教学行为的精准评测。目前,教师课堂教学行为评价研究主要采用课堂观察、行为对比等经验描述的方式,这导致人力成本高,主观性较强,且无法实现常态化评价。而利用智能技术开展的评价,能对教师行为进行深度挖掘和分析,将过程性行为转化为可视化数据,使教师反思变得有据可依。尽管智能技术在行为识别研究上已有突破,但如何利用技术高效赋能评价还需进一步研究。基于此,本研究从智能技术赋能教师课堂行为评价的视角入手,构建了集教师情感、姿态、位置三维一体的评价体系框架,通过实验进行分析研究,以期为教师的教学行为诊断提供数据支持,以过程性评价促进教师行为的持续发展。

一 智能技术赋能教师课堂教学行为评价

教师课堂教学评价是对教师课堂教学的行为及其效果所进行的价值判断[3],通常包含教学过程评价、学生活动评价和教学效果评价三种方式[4]。智能技术赋能的教师课堂教学行为评价,在此基础上提供了更加多元的过程评价,从而加快了教学行为评价进程,为教师提供更全面的教学行为诊断。接下来,本研究将从评价数据、评价手段、评价结果三个方面介绍智能技术赋能的教师课堂教学行为评价的特点及相关研究。

1 精准采集多维教师评价数据

智能技术可采集多维数据,使用录播系统、脑电、眼动等设备采集高质量、全过程的教师多维行为数据,构建教师行为数据库,为教学行为评价提供客观的数据支持。如孙众等[5]采集多源数据建立教学案例库,利用智能技术进行教学行为分析,帮助教师教学反思;Blikstein等[6]提出在多模态学习分析中将可穿戴传感器、生物传感器、手势感应、红外成像和眼球跟踪等技术用于采集多维数据源,可对复杂的认知能力进行更综合的评估。这些研究表明,利用智能技术采集和挖掘多维数据,可以实现更全面、更高准确度的教师行为评价。

2 智能技术强化行为评价手段

智能技术可识别教学行为,利用人工智能技术对多维教师行为数据进行准确识别和智能分析,可获得评价分析结果。如骆组莹等[7]利用计算机视觉技术进行课堂教学自动评价,并在学生注意力分析、表情识别和情感识别等方面取得初步成果;Ashwin等[8]提出一种混合架构通过识别面部表情、身体姿态和手势行为预测整个课堂的情感状态,结果表明其预测准确率较高。这些研究表明,利用智能技术突破传统评价手段进行多元的智能评价,可使评价更高效准确。

3 可视化呈现行为评价结果

智能技术可进行数据可视化展示,将评价结果以文字、图表、雷达图等形式可视化呈现。如骆祖莹等[9]开发了一套基于课堂言语的可视化的分析软件,能对课堂教学活动过程进行分析,可视化反馈结果以帮助教师进行教学反思;Safsouf等[10]评估了某一针对教师和学生的学习分析仪表盘,该仪表盘可以对课程中的学习进度进行综合可视化,能有效提高学生的参与度。通过这些研究发现,利用仪表盘进行教师行为评价可视化反馈,能帮助教师反思课堂行为表现。

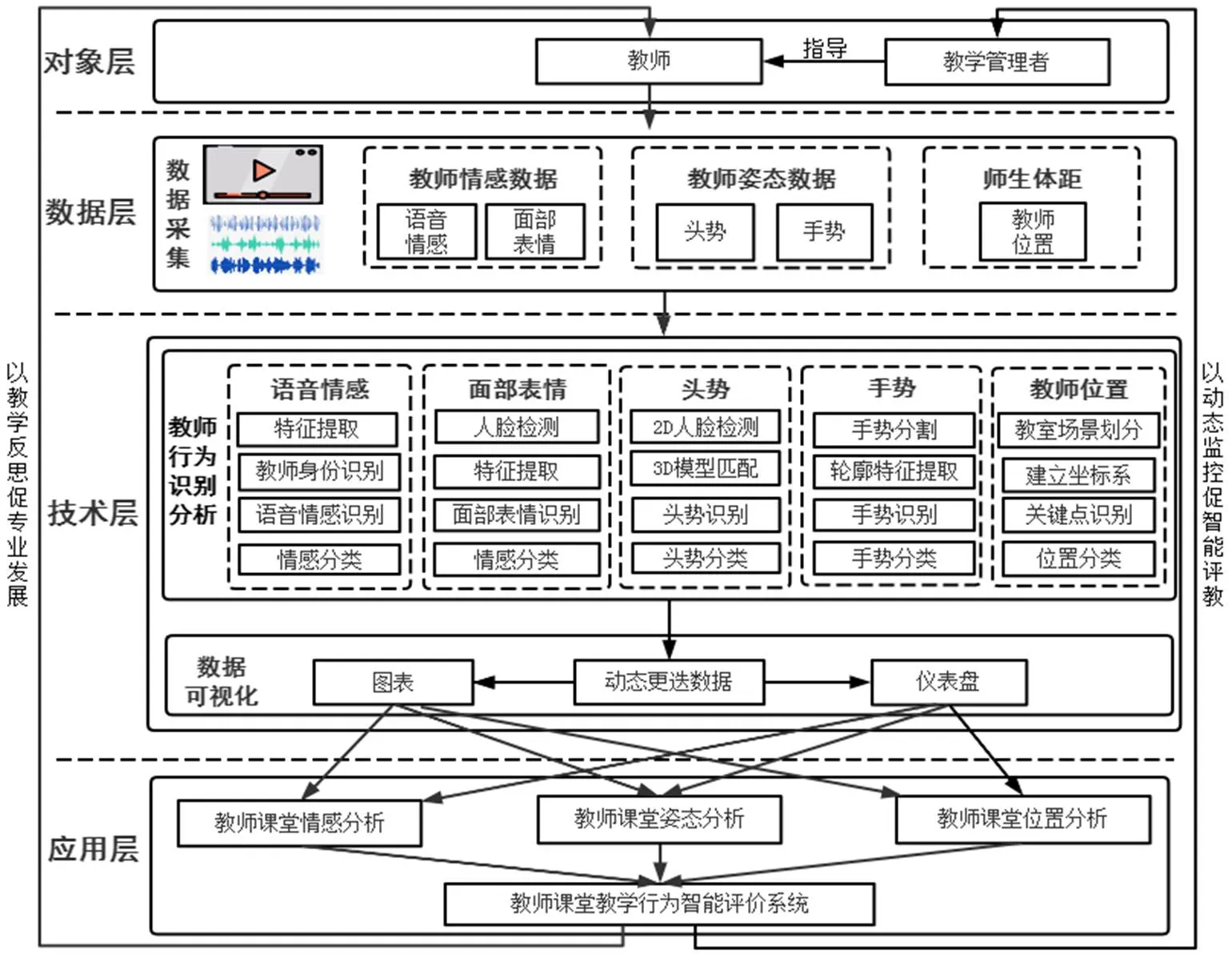

图1 教师课堂教学行为智能评价的应用框架

二 智能技术助推教师教学行为评价的应用框架

虽然智能技术的发展推动教师行为评价向多维数据、智能分析和可视化评价的方向变革,但以往研究往往从单一模态或双模态对言语[11]、情感[12][13]、姿势[14][15]、目光[16]、生理[17]等行为进行分析,不能全面评价。鉴于此,本研究针对多模态,构建了教师课堂教学行为智能评价的应用框架,如图1所示。由于本研究仅需上传常规的课堂视频即可进行评价,故不采用需佩戴仪器采集的目光和生理数据,而是在现有研究的基础上,增加了可提高师生互动的位置分析,构建了集教师情感、姿态、位置三维一体的教师课堂教学行为智能评价系统。

1 对象层:面向教师和教学管理者

对象层面向教师和教学管理者。通过对教师的多维课堂行为数据进行量化分析和评价,既可以为教师提供可视化的行为分析与评价,以教学反思促教师专业发展;又可以为教学管理者提供周期性的评价数据,以动态监控促智能评教,指导教师改进课堂行为,提高教学质量。

2 数据层:数据采集

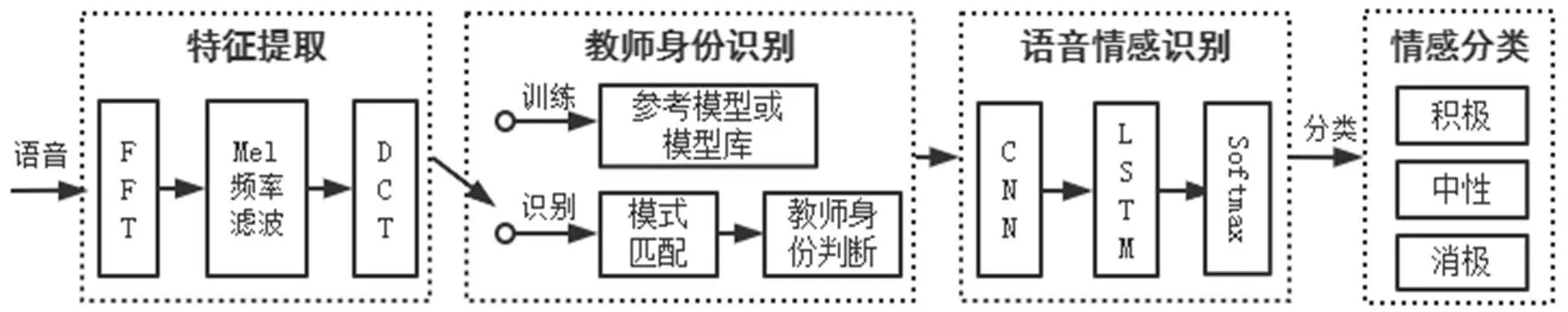

数据层利用深度录播系统采集教师的语音情感、面部表情、头势、手势和教师位置信息,建立教师课堂教学行为测评数据集(如表1所示),帮助开展教师课堂教学行为的过程性评价。

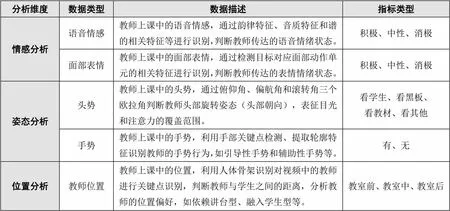

表1 教师课堂教学行为测评数据集

3 技术层:教师行为识别分析和数据可视化

技术层以采集的数据为基础,结合计算机视觉、语音识别、情感计算等技术分析教师的情感状态、姿态行为和位置信息,将评价结果可视化呈现给教师,帮助教师进行教学诊断和反思。

图2 语音情感识别流程

(1)教师行为识别分析

①语音情感。语音是教师课堂传递信息和情感最直接的方式,由于师生行为在时间维度上可以连续采样,因此可将视频按照师生话语切分连续样本数据,并在切分后的时间片段内进行教师的语音情感识别和其他教学行为检测。考虑到语音识别是进行教师行为识别的重要前提和基础,故本研究以语音情感识别为例进行详细技术分析,其流程如图2所示。

第一步,特征提取。首先对采集的语音数据进行预处理,将信号转换为频域上的能量分布,在信号加窗后进行快速傅里叶变换(Fast Fourier Transform,FFT)。然后对对变换后的离散频谱用序列进行Mel滤波处理,经过离散余弦变换(Discrete Cosine Transform,DCT)得到梅尔倒谱系数。最后利用openSMILE工具包和神经网络,使用梅尔倒普系数提取师生的音频声纹特征,所得到的梅尔倒谱系数用于教师身份识别中UBM模型的建立和说话人GMM模型的训练。

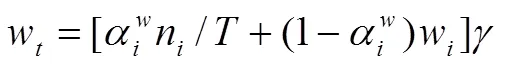

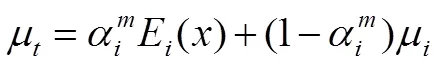

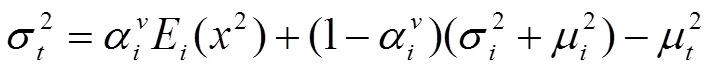

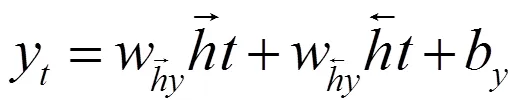

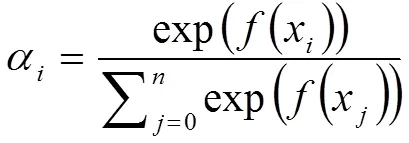

第二步,教师身份识别。本研究采用团队成员陈增照教授的前期研究专利“基于声纹识别的智能S-T分析”中提出的高斯混合—通用背景模型(Gaussian Mixed Model-Universal Background Model,GMM-UBM)对教师进行身份识别,该模型利用UBM拟合说话人的特征,通过极大后验概率算法(Maximum A Posteriori,MAP)将UBM中的每个高斯分量向待识别说话人的GMM进行偏移[18],从而得到GMM模型。教师身份识别的过程如下:首先,建立训练集的参考模型或模型库,训练矢量集为(X,X,,X),其中为训练集中师生语音的帧数。UBM模型中的参数可表示为{w,μ,σ²,,,},其中w、μ、σ²分别为第个高斯分量的权重系数、均值以及方差,为高斯分量个数(本文设为2048个)。然后,计算中的矢量X与UBM模型高斯分量的相似度,通过相似度更新UBM中高斯分量的均值和方差,从而向待识别说话人(教师)的GMM进行偏移。最后,将更新后的各高斯分量和原始UBM的均值及方差进行融合,得到识别教师身份的GMM模型,其权重系数、均值以及方差分别如公式(1)、公式(2)、公式(3)所示。其中,、和是自适应参数,用于调节新参数和UBM参数,n表示训练语音中属于第个高斯分量的帧数,E()表示UBM中高斯分量的均值,E(x)表示高斯分量中的方差,用来调整w。通过这三个参数可得到教师的GMM模型和待识别说话人对应的GMM模型,并进行模式匹配,对GMM模型进行余弦相似度打分,高于一定阈值(本文设为0.5)将判定为同一说话人,否则为不同说话人,以此来实现教师身份判断,并进行教师视频片段分割。

第四步,情感分类。利用注意力层的输出结果,使用Softmax进行情感分类,如公式(7)所示。其中,z为上一层第个节点的输出值,为分类的类别数。

最后,利用模型迭代训练,即可在决策层输出教师语音片段的情感分类。教师的课堂语音情感可分为积极情绪(高兴)、中性情绪(自然)和消极情绪(愤怒、厌恶)三类。

②面部表情。教师的面部表情对学生的学习兴趣和学习效果有重要影响。面部表情识别可以通过人脸检测技术抓取教师面部信息的图像,然后对图像预处理,进行对齐、数据加强和归一化操作。再利用深层神经网络学习人脸的几何特征、统计特征、运动特征等以进行特征提取,最后通过面部表情进行情感分类。教师课堂的面部表情同样分为积极、中性和消极三类。

③头势。教师的头部姿态和目光注视能有效传递教师的注意力焦点。头势识别可以通过2D人脸关键点检测技术获取教师的关键点信息,然后在3D人脸模型中匹配2D人脸关键点的映射,再利用俯仰角、偏航角和滚转角三个欧拉角(Euler Angle)根据旋转矩阵计算头部旋转姿态角,判断教师的面部朝向和注意力范围。教师的头势分为看学生、看黑板、看教材、看其他四类。

④手势。教师在课堂上使用手势行为进行教学引导,可以吸引学生的注意力。手势识别首先对教师图像数据进行手势分割,将图像转换为立体模型,建立手势库。再根据手势形状和指尖特征等进行轮廓特征提取,利用神经网络技术识别教学过程中的教师引导性、辅助性等手势。教师的手势分为有手势和无手势两类。

⑤教师位置。教师的教学位置可以传达远近、亲疏的信息。教师位置识别采用图像分割的方法对教室内部场景进行划分,识别黑板的位置,然后以地面为水平面,黑板中线为轴建立三维坐标系[19]。在体距识别中,利用人体骨架识别对视频图像进行教师关键点识别,将人体关键点与三种区域进行交叉运算以识别教师位置。教师的位置分为教室前、教室中、教室后三类。

(2)数据可视化

在对课堂教学视频进行自动化智能识别与分析后,本研究将教师课堂表现行为分为语音情感、面部表情、头势、手势和教师位置五个方面进行可视化展示,按照表1所示的教师课堂教学行为测评数据指标对教师本节课的表现做出科学、直观的评价,通过动态地更迭数据,以易于理解的图表和仪表盘方式将数据信息呈现给教师感知,强化过程性评价,以帮助教师进行教学反思。

4 应用层:教师课堂教学行为评价系统

应用层在技术层的基础上,搭建教师课堂教学行为评价系统,教师上传授课视频,在线获得课堂分析可视化结果。本团队现已研发一款教师课堂行为评教系统“小雅评教系统”,该评教系统包含课堂分析、教学反思、成长记录和名师帮扶四大功能模块,其中“课堂分析”功能即在应用层实现对课堂视频中教师情感、教师姿态和教师位置的综合智能分析与评价。

(1)教师课堂情感分析

对于教师课堂情感分析,在评价系统的情感分析界面使用图表和仪表盘从语音情感和面部表情两个维度可视化反馈教师的情感分析数据。在心理学领域,情感通常分为高兴、愤怒、厌恶、自然、惊讶、悲伤和恐惧七类,删除后面三类课堂中少见的情绪,可将根据教师语音情感和面部表情识别的“高兴”定义为积极情绪,“愤怒”和“厌恶”定义为消极情绪,“自然”定义为中性情绪。教师的积极情绪有助于提高学生的课堂投入度和专注度,而消极情感流露的越多,课堂氛围就越差。因此,教师可参考课堂情感分析结果调整语音和面部表情的情感表达。

(2)教师课堂姿态分析

对于教师课堂姿态分析,在评价系统的姿态分析界面使用图表和仪表盘,从头势和手势两个维度可视化反馈教师的姿态行为数据。头势分析通过检测教师头部旋转姿态,将其分为看学生、看教材、看黑板、看其他四类。手势分析通过对教师课堂使用的手势进行检测,将常见的手势如引导性手势和辅助性手势定义为“有”手势,将教师自然站立时的姿态定义为“无”手势。课堂中教师头部姿态和手势的使用可引导学生的注意分配,还能提高师生互动[20][21]。因此,教师可根据课堂姿态分析结果调整课堂中头部的目光朝向范围和时长,以及手势的使用频率。

(3)教师课堂位置分析

对于教师课堂位置分析,在评价系统的位置分析界面使用图表和仪表盘可视化反馈教师的位置变化区域,分为“教室前”“教室中”“教室后”。教师的课堂位置能影响学生的学习状态,教师长时间依赖讲台或保持位置不变,会导致部分学生注意力不集中、课堂气氛不活跃等问题发生。教师适度地走进学生的位置范围,有利于监控课堂秩序、了解学生学习情况、增加课堂活力。因此,教师可根据课堂位置分析结果,合理调整自己在课堂上的行走轨迹。

三 智能技术助力教师课堂教学行为评价的应用

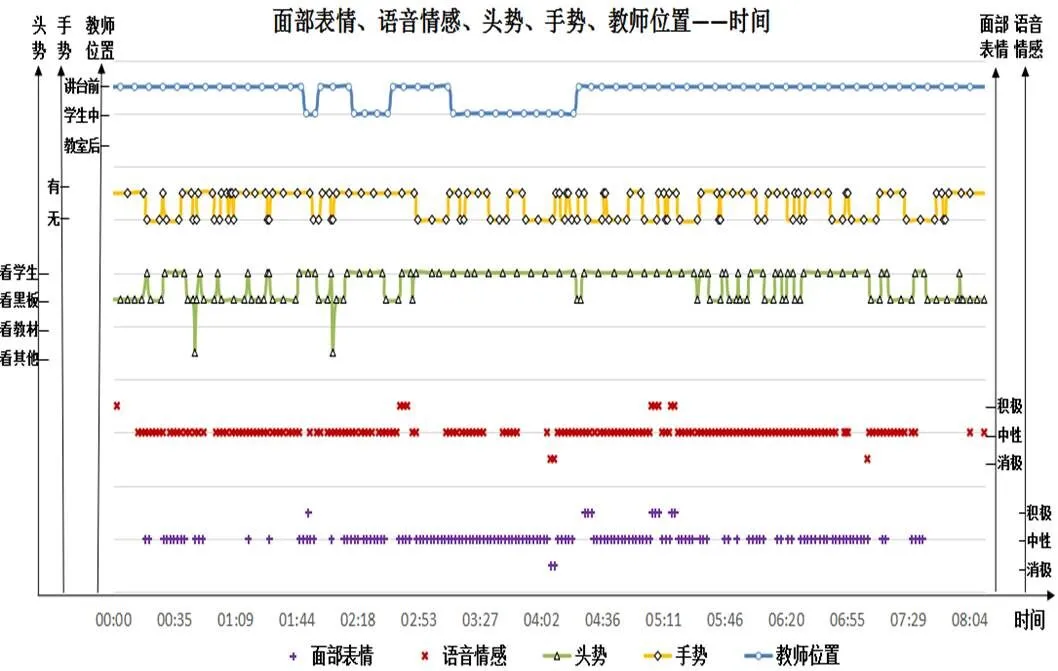

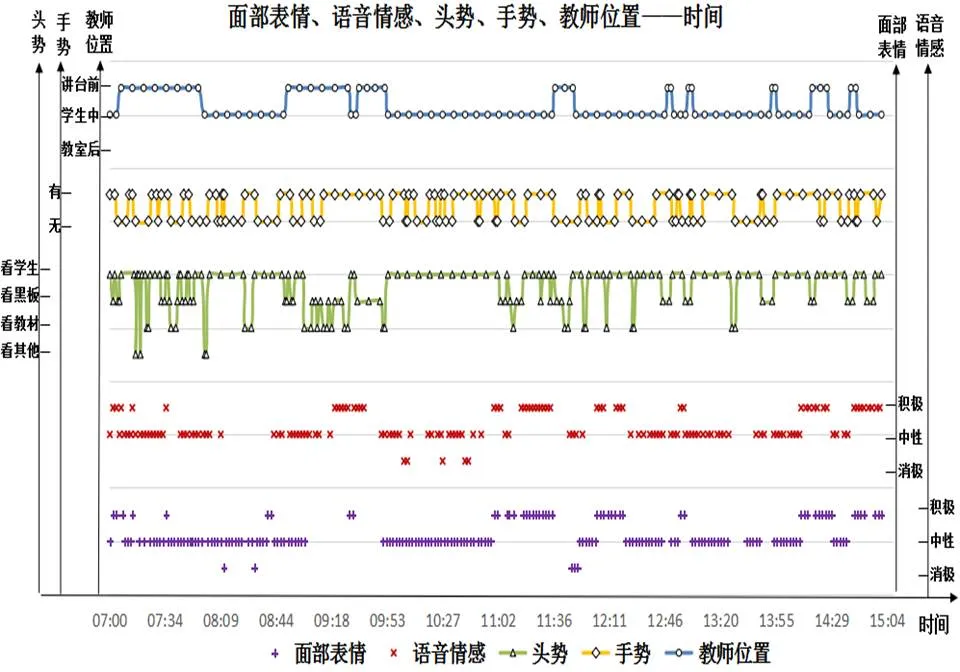

为验证本框架的有效性和应用价值,本研究选择武汉市A大学附属小学五年级某班的语文课堂作为实验对象,在2021~2022学年第一学期开展跟踪实验。前半学期采用常规的人工评价,根据每节课的课堂观察对各项指标、各类行为和总评进行总结性打分;后半学期采用智能评价,每节课利用智能技术应用框架识别各类行为进行自动化评价,每次评价结束后,教师都会根据结果在下一次课堂中进行调整。经过半学期的实验,本研究分别将前半学期的最后一节课(对照组)和后半学期最后一节课(实验组)的课堂视频上传到利用本研究框架构建的评教系统进行在线评价,结合学生反馈,验证教师周期性地使用该框架进行教学反思,能否有效提高教学效果。教师课堂教学行为分析数据如表2所示,节选的部分视频信息展示教师的课堂教学行为时序图,如图3、图4所示。

从分析结果来看:①在教师情感分析方面,受学生发言和课堂静默时间、教师背对学生板书和走动的影响,语音情感和面部表情数据是间断的。对照组中教师面部表情语使用较少,语音情感较平淡,以中性为主的情感表达较多,从语音时长来看讲授较多且互动较少;实验组中应用智能评价改进情感后,教师课堂上面带微笑,语音富有激情,以中性和积极为主的面部表情和语音情感表达明显增多。②在教师姿态分析方面,对照组和实验组中教师在课堂中看向学生的时间较多、交替使用手势的频率较高,教学行为上变化不大,说明教师一直以来比较注重教学姿态的使用,所以提升效果并不明显。③在教师位置分析方面,对照组中教师偏爱站在讲台区(教室前)教学,鲜少走近学生;实验组中教师应用智能评价改进课堂走动位置后,明显较多时间走进学生区(教室中)进行互动。

表2 教师课堂教学行为分析数据

图3 对照组中教师课堂教学行为时序图

图4 实验组中教师课堂教学行为时序图

在实验中,应用本框架持续半学期对课堂视频进行机器智能评价后,教师在本学期后期的教学行为表现上明显增加了语音情感和面部表情的表达,并走进教室中与学生互动。结合学生课堂表现反馈,两节课中学生的抬头率都较高,举手参与率从44%上升到87%,回答问题人次从18次上升到34次,课堂发言时间延长了约6分钟,且后排学生的课堂纪律明显好转,整体上学生的积极性和参与度明显增加。本研究发现,利用智能技术进行教师课堂教学行为评价,可以分析和反馈教师的过程性行为数据,及各类数据在课堂内的分布时间,精确地、可视化地反馈教师的课堂行为和评价结果,能有效帮助教师进行教学反思,提高教学质量。

四 结语

本研究以智能技术助推教师课堂教学行为框架构建为研究目标,提出了一种融合多模态行为分析的教师课堂教学行为评价的应用框架,关注教师的课堂情感变化、姿势引导和课堂位置,以帮助教师及时调整和反思课堂教学行为。本研究的创新性体现在三个方面:①实现了真实课堂多维数据的采集和存储,全过程的课堂教学数据能实时分析教师教学行为的动态变化。②通过实验,验证了本框架下的智能评价能全面准确地反映教师课堂行为表现,以过程性评价数据帮助教师进行教学行为诊断和反思。③将智能技术应用于教师行为评价,能加快评价进程,提高评价结果对教学行为的反馈作用,帮助教师提高教学能力。然而,本研究也存在一些不足,后续还需进一步深入研究师生互动行为在教师教学行为评价中的重要作用,开展大规模优质课程的教师教学行为分析,建立数据常模,为同类课堂分析比较提供依据。通过健全教师教学行为智能评价系统,为智能教学行为评价提供更准确的分析结果和更有价值的评价服务。

[1]教育部.教育部关于实施第二批人工智能助推教师队伍建设行动试点工作的通知[OL].

[2][11][12]吴立宝,曹雅楠,曹一鸣.人工智能赋能课堂教学评价改革与技术实现的框架构建[J].中国电化教育,2021,(5):94-101.

[3][4]张大均.教育心理学(第三版)[M].北京:人民教育出版社,2015:590、665.

[5]孙众,吕恺悦,骆力明,等.基于人工智能的课堂教学分析[J].中国电化教育,2020,(10):15-23.

[6]Blikstein P, Worsley M. Multimodal learning analytics and education data mining: Using computational technologies to measure complex learning tasks[J]. Journal of Learning Analytics, 2016,(2):220-238.

[7]骆祖莹,张丹慧.课堂教学自动评价及其初步研究成果[J].现代教育技术,2018,(8):38-44.

[8]TS A, Guddeti R M R. Automatic detection of students’ affective states in classroom environment using hybrid convolutional neural networks[J]. Education and Information Technologies, 2020,(2):1387-1415.

[9]骆祖莹,赵琦琦,段福庆.基于教师近场语音的课堂教学过程自动分析[J].现代教育技术,2021,(8):76-84.

[10]Safsouf Y, Mansouri K, Poirier F. Experimental design of learning analysis dashboards for teachers and learners[A]. Proceedings of the Eighth ACM Conference on Learners[C]. Germany: ACM, 2021:347-350.

[13][17]张立山,冯硕,李亭亭.面向课堂教学评价的形式化建模与智能计算[J].现代远程教育研究,2021,(1):13-25.

[14][19]陈少辉.智慧教室环境下教师非言语行为量化计算研究及应用[D].武汉:华中师范大学,2020:14-17.

[15][20]杨九民,章仪,李丽,等.教师引导行为与学习者先前知识水平对视频学习的交互影响[J].中国电化教育,2019,(7):74-81.

[16][21]杨九民,皮忠玲,章仪,等.教学视频中教师目光作用:基于眼动的证据[J].中国电化教育,2020,(9):22-29.

[18]Reynolds D A, Quatieri T F, Dunn R B. Speaker verification using adapted gaussian mixture models[J]. Digital Signal Processing, 2000,(1-3):19-41.

Research on the Application Framework of Intelligent Technologies to Promote Teachers’ Classroom Teaching Behaviors Evaluation

LU Yuan-yuan1,2CHEN Zeng-zhao1[Corresponding Author]CHEN Rong1SHI Ya-wen1ZHENG Qiu-yu1

At present, the evaluation of teachers’ classroom teaching behaviors mainly adopts the experience description method of classroom observation, which has high human cost and strong subjectivity. With the wide application of artificial intelligence technology in the field of education, the evaluation began to turn to the data-driven research paradigm. With the advantages of real-time analysis and visual evaluation, intelligent technology-enabled teaching behavior evaluation has gradually become a powerful means to help teachers regulate teaching behaviors and improve teaching quality. However, at present, the evaluation of intelligent teachers’ behaviors is still in the preliminary exploration stage, and the application research is not deep enough. Based on this, this paper firstly analyzed the application of intelligent technology in the evaluation of teachers’ classroom teaching behavior from the evaluation data, methods and results. Next, the voice print recognition technology was used to recognize the teachers’ identities and track the speech of the classroom videos, and the video segments were segmented. Then, the evaluation framework of teachers’ classroom teaching behaviors was constructed from the three dimensions of emotion, posture and location preference. Finally, the evaluation results were presented to teachers in a more intuitive and easy-to-understand visual way to help teachers reflect on teaching. This paper aimed to promote the transformation of teachers’ classroom teaching behaviors evaluation towards an intelligent, efficient and sustainable direction through existing research.

artificial intelligence; teachers’ classroom teaching behavior evaluation; teaching behavior recognition; speech emotion recognition

G40-057

A

1009—8097(2022)12—0076—09

10.3969/j.issn.1009-8097.2022.12.009

本文为国家自然科学基金“教师课堂非言语行为的量化计算与教学效果评价研究”(项目编号:6207020477)、湖北省教育科学规划2021年度重点课题“基于人工智能技术的教师课堂行为动态分析与评价研究”(项目编号:2021GA083)、武汉学院科学研究项目“基于在线学习的学习行为分析及促进策略研究”(项目编号:KYZ202101)的阶段性研究成果。

鲁圆圆,武汉学院副教授,华中师范大学在读博士,研究方向为人工智能、语音情感识别,邮箱为yuanyuan.lu@whxy.edu.cn。

2022年6月8日

编辑:小时