基于深度学习的烟雾与火灾检测算法综述

2022-12-06祝玉华司艺艺李智慧

祝玉华,司艺艺,李智慧

1.河南工业大学 信息科学与工程学院,郑州 450001

2.粮食信息处理与控制教育部重点实验室(河南工业大学),郑州 450001

火的应用,是人类早期伟大的成就之一,在人类文明发展史上极具重要意义。然而,意外发生的火灾对人们的财产安全和生命安全会造成严重危害。在当今工业化时代,工厂及生产车间设备机械化程度高,由于机械设备故障、电路短路等,极易产生火花,若发现不及时,火势极易沿着设备蔓延扩大,从而造成严重火灾。由于火灾具有破坏力强、蔓延速度快等特性,所以应对早期火灾特征快速检测,以减少损失。但当前的火灾探测方式仍以传统的感烟、感温和感光等传感器为主,当它们距离火源较近时,才能通过电离产生的粒子探测到烟和火,然后进一步激活火警和灭火系统。这种方法相当稳健,但存在延迟,这会导致火势迅速蔓延而无法控制。此外,传感器不能提供火灾初始位置、传播方向、规模、增长速度等信息。随着视频监控的大量普及,解决这些问题的方法是使用监控系统的视频图像数据。在视频图像中,火通常被描述为从一边移动到另一边的橙色或黄色火焰,由各种原因引起,如纵火、电火花、化学反应等。通过视频图像检测火灾面临着一系列挑战,所提算法应该能够区分有火焰的图像和有橙色或红色类似火状物体的图像、有烟雾的图像和有云等类似烟雾的图像。此外,使用监控系统需要处理大量的数据,如果手动完成,将对劳动力造成巨大损失。因此,国内外研究学者提出基于视频图像的火灾自动检测算法,主要包括基于传统火灾检测算法和基于深度学习的火灾检测算法。传统烟雾与火灾检测框架主要包含3个阶段,首先采用不同尺度的滑动窗口遍历输入图像,得到可能存在烟雾或火灾的区域;其次使用HOG[1]、SIFT[2]、LBP[3]等人工特征抽取方法提取烟雾或火焰的颜色、边缘、纹理等特征,将候选区域的图像转换为特征向量并传入分类器训练;最后采用SVM、贝叶斯网络、随机森林、BP神经网络等分类器将这些提取的特征与一组现有的标准特征进行比较,以判断图像中是否包含烟雾或火焰。传统烟雾火灾检测算法工作流程如图1所示,在预处理阶段存在大量冗余计算开销,影响算法的运行速度;在特征提取阶段仅能获取图像的低级特征,且提取的特征依赖于先验知识,缺乏普适性。计算机视觉和监督学习领域的新技术,如深度学习,为火灾探测带来了很大的希望。本文重点从目标分类、目标检测、目标分割3个领域分析火灾检测的深度学习方法的优缺点,之后列举了火灾检测数据集,最后分析了火灾检测未来研究方向。

图1 烟雾火灾检测的传统图像处理方法流程图Fig.1 Flow chart of traditional image processing method for smoke fire detection

1 基于深度学习的烟雾火灾检测算法

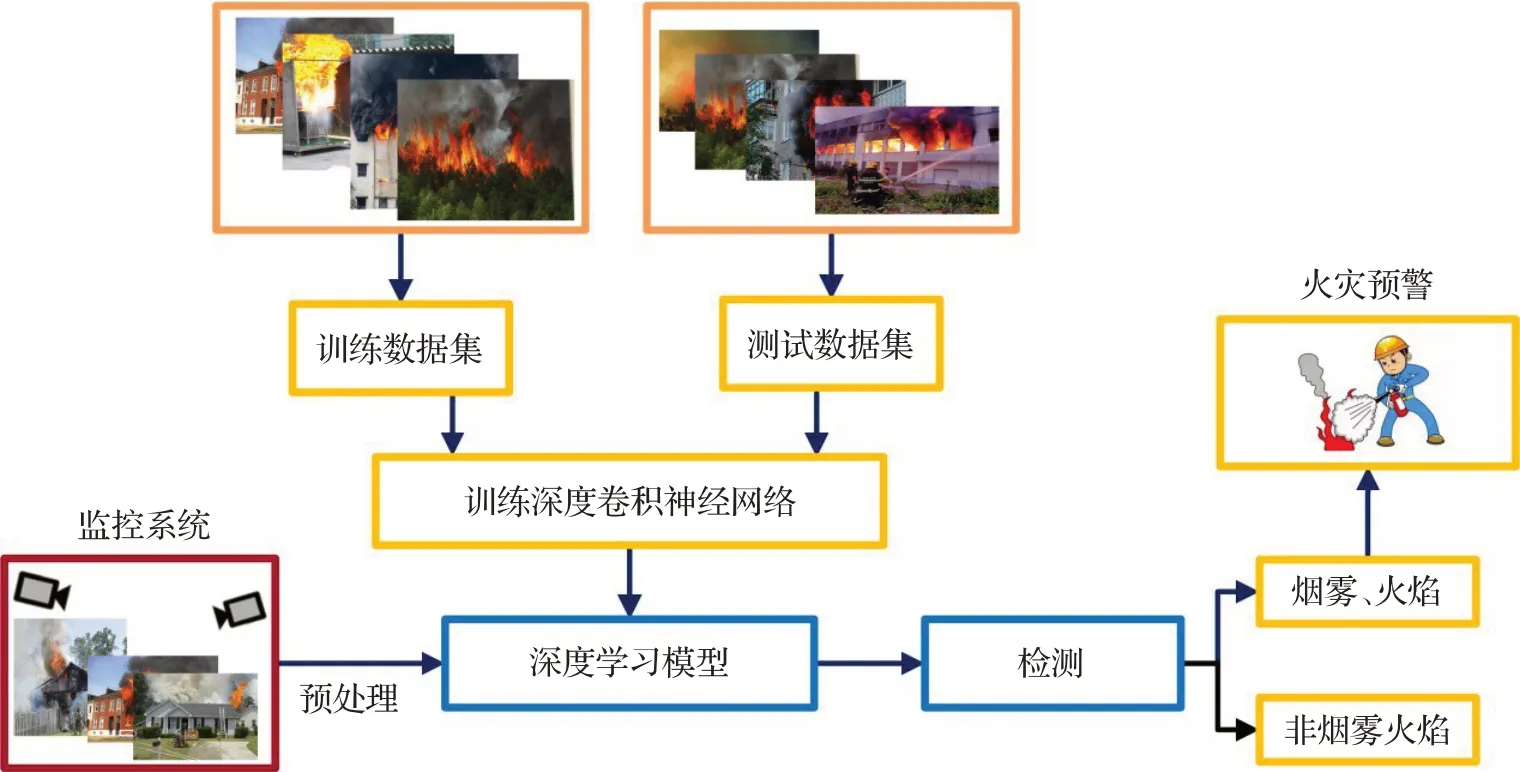

深度学习是一种能够自动学习训练数据集中数据内部结构的多层级神经网络算法,可自动检测和学习特征,图2描述了烟雾火灾检测深度学习方法的框架。与传统的烟雾火灾检测算法相比,基于深度学习的烟雾火灾检测算法可抽取更抽象化、更高阶的特征,具有速度快、准确性强、在复杂环境下鲁棒性更强的优势。其可分为目标分类模型、目标检测模型、目标分割模型3大类方法。目标分类任务是对于给定的图像,只需输出一个类标签,用于判断图像中是否含有目标,经典的分类网络结构有AlexNet[4]、GoogLeNet[5]、VGGNet[6]、ResNet[7]、SENet[8]等。目标检测是对多个目标定位和图像分类,需要在原图像中将目标用矩形框框出,经典的检测网络有Faster RCNN[9]、SSD[10]、RefineDet[11]、YOLOv3[12]等。目标分割是逐像素判断哪些像素属于哪些目标,在检测的基础上,不再使用bounding box框出目标的位置,而是将目标和背景分离,找出目标的轮廓线,经典的分割网络有FCN[13]、U-Net[14]、DeepLab[15]等。目标分类既是计算机视觉的基础问题,也是图像分割、目标检测等高层次视觉任务的基础。分类的数据集不需要手动标注目标位置框,而检测是同时输出类别和位置框,数据集需要手动标注目标,这既复杂又耗时。因此,大多数火灾检测算法倾向于使用分类网络,但检测的实时性要比分类高,而且可以检测出发生火灾的位置。分割网络则是更精确化火灾区域,能够判断火灾的规模,但模型一般较大,工业部署困难。

图2 烟雾火灾检测的深度学习方法框架Fig.2 Deep learning method framework for smoke fire detection

1.1 基于目标分类模型的烟雾火灾检测算法

卷积神经网络(convolutional neural networks,CNN)由一个输入层和一个输出层组成,有多个隐含层,输入层能够处理多维数据,隐藏层通常由卷积层、池化层、全连接层组成,输出层输出一个二维特征图。卷积层提取特征,池化层缩小特征图简化计算复杂图,同时进行特征压缩提取主要特征;全连接层连接所有特征并输出到分类器。卷积神经网络可以自动学习视频图像中的火灾特征,并根据学习到的特征对图像进行分类,不再需要人工构建特征。Frizzi等[16]构建9层的卷积神经网络将视频图像分为烟雾、火灾、正常3类,在由1 427幅火灾图像、1 758幅烟雾图像和2 399幅正常图像组成的测试集上的分类准确率达到97.9%,但是该模型只能检测红色的火焰,对其他颜色的火焰以及烟雾的检测效果不理想。此外,只能对视频帧逐帧处理,没有考虑帧间烟雾与火灾的运动特征。

1.1.1 基于与传统特征相结合的方法

由于早期火灾特征不明显,目标较小且无关区域较大,若仅使用CNN提取的静态特征进行火灾与烟雾识别,会增大计算复杂度,影响模型检测性能,识别精度降低。烟雾的特征之一是可透视性,当烟雾开始扩散时,仍然可以观察到被烟雾覆盖的物体,若只使用静态图像进行特征提取,背景的原始视觉特征将不可避免地干扰烟雾特征的提取。然而,烟雾的移动、闪烁和扩散等动态特征为烟雾检测提供了重要信息,因此,可以根据运动差异来过滤非烟雾区域。为此,研究人员专注多融合方法,将深度特征与传统特征相结合,成为主流思想。冯路佳等[17]构建了基于目标区域的火灾烟雾检测网络,提出MD_CNN结构。首先在目标区域定位层,采用改进的背景差分法的运动检测算法提取出待检测视频中包含的目标烟雾区域并传入烟雾识别层;将烟雾识别层中的Conv3与Conv4中卷积核大小更改为3×3,以提取更详细的烟雾信息;最后将输出传到softmax函数,输出烟雾的概率。MD_CNN模型相较于全CNN模型,能够过滤掉大量无关信息,提高检测效果,但由于场景的复杂性、环境干扰和噪声的存在,使用背景拆分法易受疑似烟雾目标的影响,造成误检。此外,烟雾识别层的网络设计对于不同应用场景泛化性差。

1.1.2 基于多尺度特征融合方法

由于火灾目标尺度变化大,基于单尺度特征图进行火灾分类的方法,对于不同尺度的火灾不稳健。Yuan等[18]构建深度多尺度神经网络,特征提取层由多个并行的卷积层组成,通过多尺度卷积核来实现多尺度特征提取,解决了光照、尺度不变所引起的问题,实现高准确率,但是使用多个卷积块,不可避免地会增大模型复杂度,以致难以部署。Jeon等[19]提出基于卷积神经网络的多尺度火灾预测框架,每个尺度的特征图通过特征挤压块和softmax函数预测火灾,再用投票加权算法综合不同尺度的预测,确定最终结果。采取特征挤压块,首先通过1×1的卷积将多维通道缩减为二维通道,再通过最大池化缩小尺寸,最后采用全连接层输出2×1向量。从空间和通道两方面对特征映射进行挤压,有效提取多尺度特征图信息,且使用1×1卷积核能有效减少模型参数,实现跨通道信息组合,增加了非线性特征,使新特征图的特征表达更佳。基于多尺度特征融合的方法虽一定程度上能够提升模型检测效果,但仅仅融合了烟雾与火灾的静态特征,未融入动态特征。

1.1.3 基于循环神经网络的方法

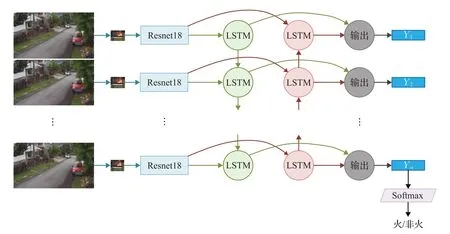

卷积神经网络只能单独地处理每一个输入,即前一个输入与后一个输入不相关。火灾和烟雾检测任务需要关注前后帧之间的关系,以提取动态特征。循环神经网络(recurrent neural networks,RNN)能够更好地处理序列信息,因此得以发展。文献[20]基于卷积和循环神经网络对视频序列中的烟雾进行检测,CNN用来提取特征,RNN用于提取同一目标不同帧中对应特征之间的关系。但只能捕捉短时间尺度上的时空特征,不能代表烟雾与火焰的长期变化。长短期记忆网络(long short-term memory,LSTM)可以在一定程度上解决这个问题,能够有效地为视频序列建模。RNN具有对前面信息进行长时记忆的特点,在此基础上,LSTM通过增加遗忘门避免长期依赖的问题,通过构造三个门来控制信息传递,解决了传统RNN模型中梯度消失的问题。因此,LSTM在序列检测领域得到了广泛的应用,并取得了良好的效果。文献[21]提出基于卷积神经网络和长短期记忆网络的多级火灾检测算法,第一步利用HSV颜色模型和火焰的亮度闪烁频率确定候选区域,用CNN网络提取候选区域的静态特征并输入到Bi-LSTM网络,最后softmax分类器确定目标是火焰还是疑似火焰的运动物体,算法结构如图3所示。该模型利用CNN与双向LSTM网络同时提取火焰的空间域特征以及时间域特征,有较高的F1值,既能实现高准确率及低召回率,又能满足实时要求。但由于数据集的限制,对于蓝色火焰及白色火焰在初期提取候选框时,易造成误判。Bi-LSTM只是拼接了向前的特征与向后的特征,两个特征之间无关联,且向前的神经元在学习过程中只学习向前的特征,并未学习向后的特征,所以可能并不是一个最优的结果。基于LSTM网络的方法加入了时间序列,能够融入烟雾与火灾的动态特征,但网络中全连接层数量较多,时间跨度大、网络深,计算量相当大,难以训练。

图3 CNN-BiLSTM火灾分类模型架构Fig.3 Fire classification model architecture based on CNN-BiLSTM

1.1.4 基于3DCNN的方法

2D CNN对视频中每一帧图像分别利用CNN进行识别,忽略了帧间关系,因此帧间运动信息会丢失。除使用LSTM网络外,3D CNN[22]也能更好地提取视频中的时间和空间的特征信息,提高检测效率,在视频分类、动作识别等领域能够发挥巨大优势。吴凡等[23]提出时空域火灾烟雾检测算法,利用高斯混合模型和四帧拆分法相结合的运动目标检测算法分割图像,过滤掉非烟雾区域,再输入到由二维空间域卷积层与一维时间域卷积层组成的3D卷积网络模型,最后检测出结果后分块标定烟雾区域。相较于原3D模型能够降低计算成本,但是仍难以满足工业实时性需求。并且3DCNN主要用于短期时序建模,适用于短期变化较明显的火灾检测,对于长期的时间特征提取能力并不能与RNN相媲美。

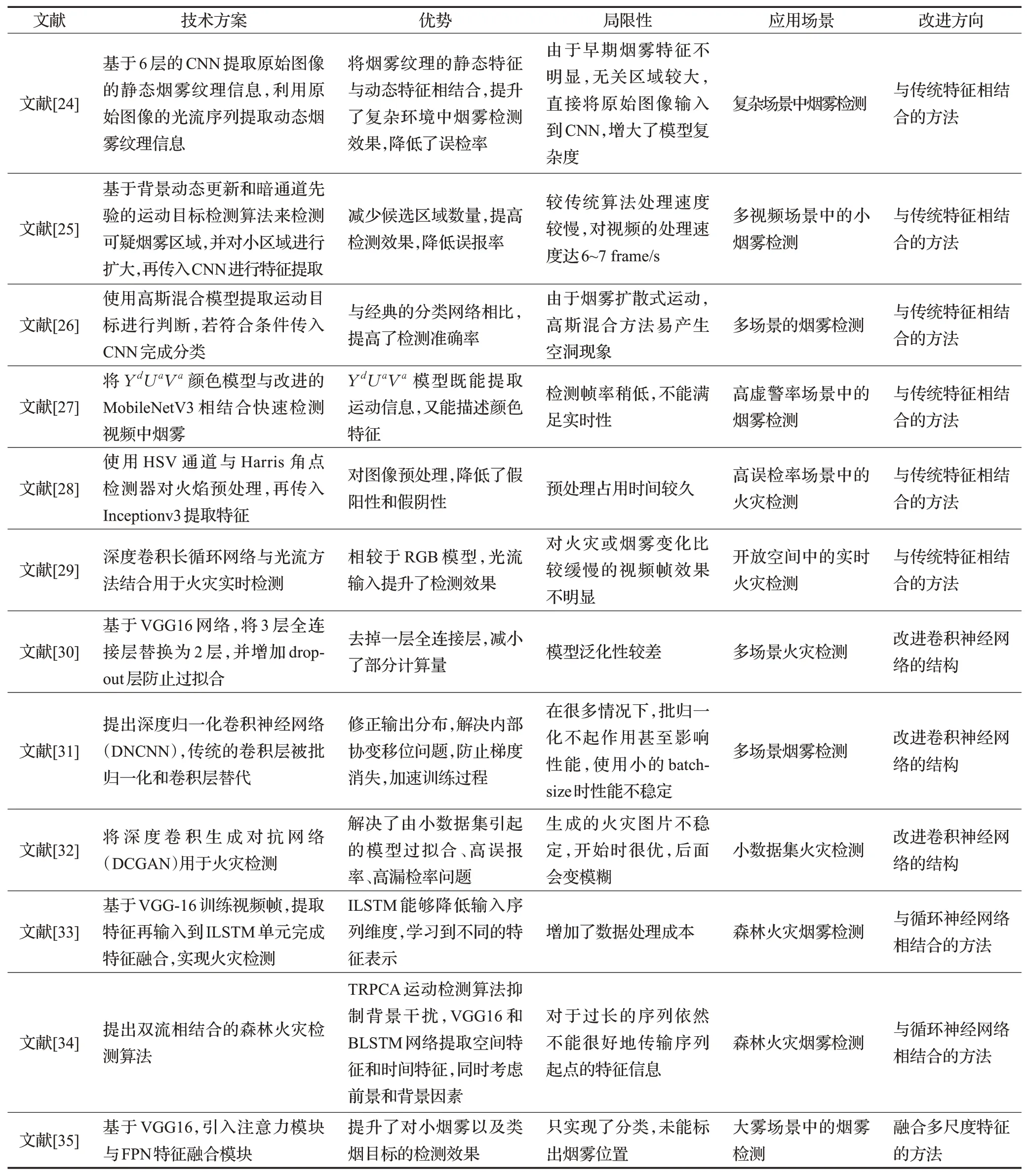

更多更详细的基于目标分类模型的烟雾火灾检测算法如表1所示,从表中可以看出基于目标分类模型的烟雾与火灾检测算法改进方向主要包括与传统特征融合的方法、改进卷积神经网络结构的方法、与循环神经网络相结合的方法,以及融合多尺度特征的方法。与传统特征相结合的方法,能够将烟雾与火灾的纹理、颜色、闪烁、扩散等传统特征与CNN提取的深度特征相结合完成分类,使用传统特征过滤掉图像中大量的无关区域,再传入CNN提取深度特征,提升了模型稳健性,降低CNN运算量,但提取可疑区域的计算成本会增加;改进卷积神经网络结构的方法能够通过改进网络结构使网络更适用于特定场景,提取更多有效特征,提高检测效率,但会影响算法的泛化性;与循环神经网络相结合的方法可以使用烟雾与火灾视频相邻帧间的相关性,更好地捕捉烟雾与火灾的动态特征,减少误检,但是针对烟雾与火灾变化缓慢的视频改进效果不明显,此外,网络模型较深,难以训练,检测速度慢;基于多尺度融合的方法通过融合不同尺度卷积核提取的特征实现,对尺度变化大的烟雾与火灾有较好的检测效果,但是增加多尺度卷积层会增加运算量。

表1 基于目标分类的烟雾火灾检测算法Table 1 Smoke fire detection algorithm based on target classification

1.2 基于目标检测模型的烟雾火灾检测算法

目标分类只能判断是否有火灾发生,却无法定位火灾的位置,因此研究学者开始探索基于目标检测的烟雾火灾检测算法。基于目标检测的烟雾火灾检测算法包括基于区域提取的算法、基于目标回归的算法以及基于Anchor-free的算法。

1.2.1 基于区域提取的检测方法

基于区域提取的烟雾火灾检测算法主要包括从图像中生成候选区域、使用候选区域的特征图判断物体类别以及回归检测框位置两个阶段,因此也称两阶段检测算法。经典的算法有Faster R-CNN、FCN等。对二阶段检测算法的改进方式主要包括改进生成候选区域的过程与提取特征的过程。

文献[36]基于Faster R-CNN改进提取特征的过程实现火灾检测,引入FPN特征融合网络,以融合浅层特征和高层次特征。通过Inception Module结构,使用不同尺寸的卷积核,提取更丰富、多尺寸的特征,并加入注意力机制,抑制无关信息,能够提升网络表达能力,适应火灾多尺度的特性,从而生成更准确的火灾特征图,提升火灾区域定位性能。但使用FPN进行特征融合过程中易造成信息衰减,同时存在跨尺度融合中的混叠效应。二阶段的目标检测算法精度高,定位准确,但是模型较复杂,检测速度慢。因此,基于目标检测模型的烟雾火灾检测算法开始面向高效的端到端的一阶段目标检测算法。

1.2.2 基于回归的检测方法

基于回归的目标检测算法不需要候选区域提取阶段,直接产生物体的类别概率和位置坐标值,经过一个阶段即可直接得到最终的检测结果,因此也称一阶段检测算法。经典的基于回归的目标检测算法有SSD、YOLO。一阶段目标检测算法改进方式有优化主干网络提取特征的过程,优化Neck网络融合特征的过程以及轻量化模型。

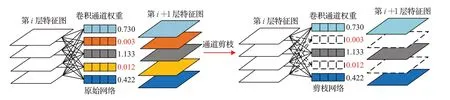

文献[37]使用通道剪枝方法轻量化YOLOv3并用于火灾检测,依据BN层weights的系数来判断通道的重要性,移除掉不重要的通道,达到减少卷积参数的效果,通道剪枝结构图如图4所示。但通道剪枝的过程中,输入和输出维度的改变会引起一些偏差。且使用YOLOv3检测火灾时随着IOU阈值的增加性能会显著下降。

图4 通道剪枝结构图Fig.4 Channel-wise pruning structure diagram

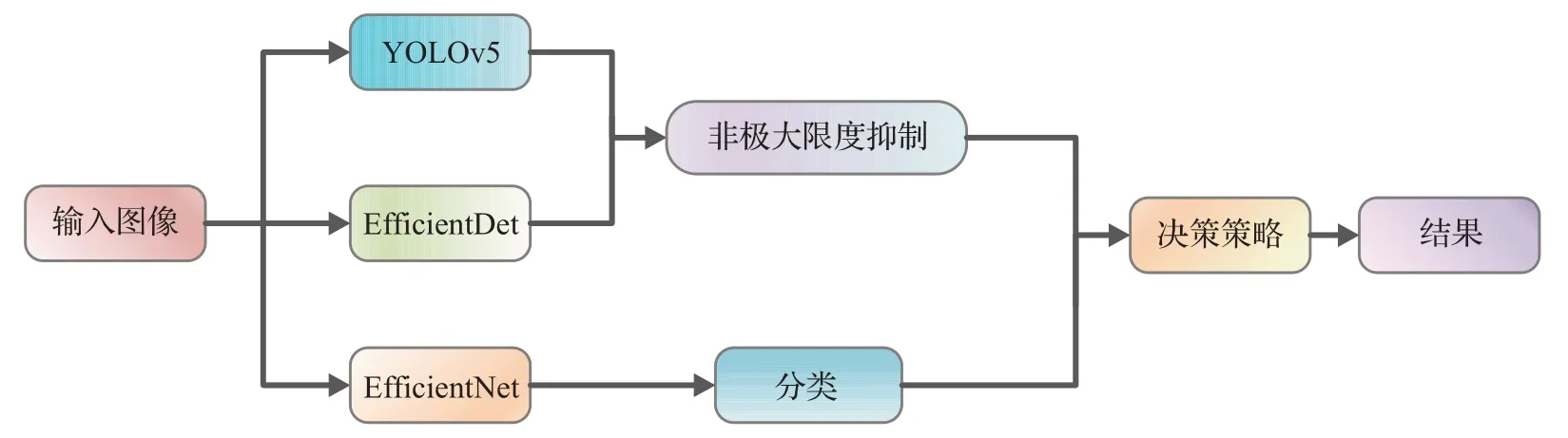

文献[38]指出单个网络模型难以实现多复杂场景中的特征提取,每个单独的网络都能提取出不同的特征,因此设计实现集成3个深度网络的模型改进特征提取过程用于森林火灾检测,网络结构图如图5所示。YOLOv5与EfficientDet两个目标检测器协同工作并行检测火灾,通过生成候选框以及非极大值抑制确定目标火灾区域,引入EfficientNet用于关注全局信息,以降低误报率。集成3个网络的火灾检查模型,改善特征提取方法,能够最大化利用全局特征和局部特征,提升小目标检测精度,提高召回率。但集成模型必定会以速度为代价来完成推理。文献[39]提出将YOLOv2-Tiny检测框架部署到K210开发板实现无人机的火灾检测与跟踪,但是该模型易对类火物体误检。基于一阶段的目标检测方法,直接生成类别概率与回归检测框位置,是一个端到端过程,检测速度快。但是提取到的浅层特征较少,对小目标与重叠目标检测效果不好,位置不精确。

图5 集成网络模型结构图Fig.5 Integrated network model structure diagram

1.2.3 基于Anchor-free的方法

两阶段、单阶段目标检测算法都是基于锚框的,检测性能受锚框的大小、数量、纵横比影响较大,需要人为地根据经验对锚框超参数进行调节以适应不同场景的火灾,并且调整后的锚框尺寸固定,对于多尺度的火灾检测效果不佳,因此无锚框的方法是成为当下研究热点。文献[40]采用Ancho-free网络结构实现火灾检测模型,选用MobileNetv2作为主干网络进行特征提取,在特征选择层加入FSAF特征选择模块选择合适的特征层传入预测层,训练时选择损失和最小的特征层回传梯度,预测时选择目标置信度最高的特征层。在分类子网络中采取可形变卷积模块以解决特征不对齐问题,能够更好地适应各种形状的火焰,但是同时增加了计算量。Anchor-free的方法能够减少锚框的参数量,但是由于只在距离真实框较近的位置预测,导致烟雾与火灾的召回率低。

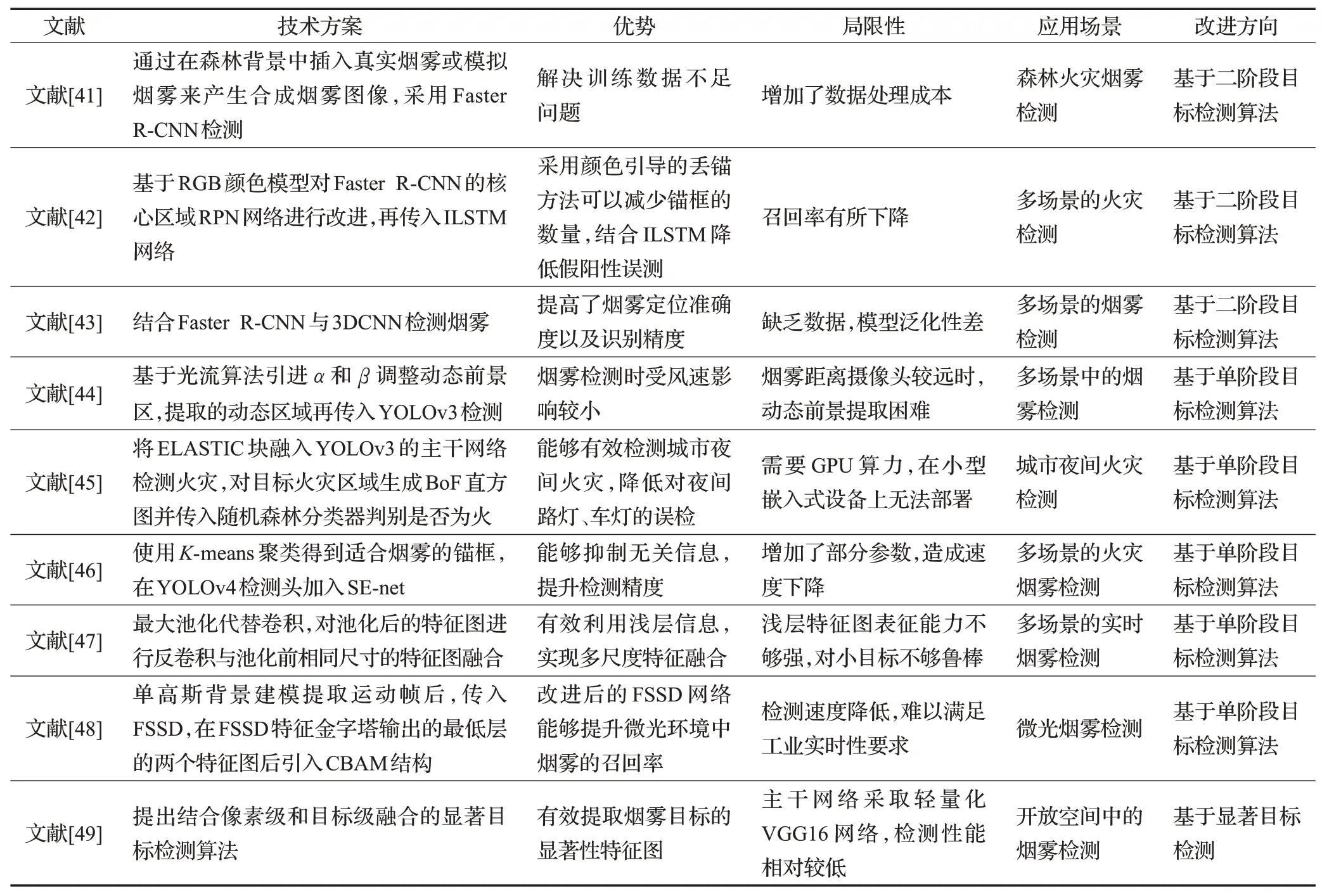

更多更详细的基于目标检测的烟雾火灾检测算法如表2所示,基于目标检测的烟雾火灾检测算法的改进方向主要分为基于两阶段算法的改进、基于单阶段的改进以及基于Anchor-free的改进。基于两阶段目标检测算法的烟雾火灾检测模型先生成候选区域,保证足够的准确率和召回率,再对目标特征图进行分类与定位,首先完成了前景背景筛选,能够选择性地对样本进行分类回归,比一阶段目标检测算法直接分类回归训练难度小,且正负样本也更均衡,因此精度会更高,适用于对精度要求高的场景,但经历两个阶段,模型复杂、速度慢;基于单阶段的烟雾火灾检测模型无需生成候选区域,是一个端到端的模型,运算速度快,适用于对实时性要求高的场景,并且使用focal loss能解决样本不均衡问题,但是容易漏检小目标;基于Anchor-free结构的烟雾火灾检测模型无锚框参数量,有更大更灵活的解空间,可实现实时高精度,但是检测效果不稳定,需要改进调整权重的方法。

表2 基于目标检测的烟雾火灾检测算法对比Table 2 Comparison of smoke fire detection algorithms based on object detection

1.3 基于目标分割模型的烟雾火灾检测算法

目标分类与目标检测的方法只能判断图像中是否有烟雾和火灾及位置信息,不能检测火的更详细信息,如形状、大小等。有时,需要关注火灾的蔓延趋势,解决这一问题的较好方法就是烟雾火灾分割算法。

文献[50]基于Mask RCNN对室内可燃物识别与分割,所得分割物体的尺寸、数量与分布用于预测火灾负荷。文献[51]提出基于卷积神经网络的烟雾检测和分割框架,更适合于朦胧的环境,采用轻量化的卷积神经网络EfficientNet分类;再利用DeepLabv3+网络对烟雾帧分割,能够有效降低误检率。但是像素级标注的数据集需要大量的人力,实际应用时,数据集是问题。在检测火灾时,有时不仅需要判断是否有火灾或烟雾产生,还需要检测火灾位置、形状、大小等更详细的信息,用于评定火灾或烟雾的等级,以便消防员关注火灾烟雾蔓延区域。

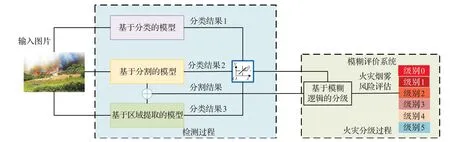

文献[52]开发了森林火灾烟雾的协作区域检测和分级的框架,框架图如图6所示,该框架是一种混合模型,单个模型难以完成复杂的烟雾火灾检测任务,因此通过将几个简单的模型集成为混合模型,以获得更好的性能。每个简单模型完成一部分任务,最后采用某种学习策略汇总输出结果。采用基于分类的模型(ShuffleNet)、基于分割的模型(WSFS)和基于区域的模型(轻量级Faster R-CNN)来预测图像中存在火灾烟雾的概率,能够定位、分割并预测输入图像中火灾烟雾的位置、区域和类别,基于堆积法学习策略确定3个模型的权重并由3个模型的推理结果计算最后的结果。此外还开发了一个模糊评价系统,用于火灾烟雾分级。该框架能够使用图像级标注的数据集完成分割,实现火灾烟雾的早期报警、区域检测、分类和分级。但是模型非常复杂,训练占用显存太大,对硬件设备要求极高。

图6 森林火灾烟雾检测与分级框架Fig.6 Forest fire smoke detection and classification framework

基于目标分割模型的烟雾火灾检测算法可以更精确地定位视频帧中烟雾与火灾的边界,能提供更详细的火灾信息,但模型一般较大,若要应用于现实场景需要更短的响应时间,此外,若是需要大量的像素级标注数据集才能提高网络模型,会耗费大量的人力。

2 常用数据集

由于训练深度学习模型依赖于数据集,下面给出了一些常用的和公开的烟雾与火灾数据集。但由于火的颜色范围从蓝色到红色,背景各不相同,烟也是材料燃烧的指示器,有灰色、白色或黑色,进行火灾探测的场所或位置可能是一个工业、核电站、建筑、住宅或森林,为了满足如此广阔的应用领域的图像特征的分布,将需要非常大和多样化的数据集。目前不存在一个用于烟雾与火灾检测的标准数据集,因此如何定义一个规范化的、多样化的烟雾与火焰数据集成为烟雾火灾检测未来需要完善的方向。

(1)KMU Fire & Smoke Database

KMU Fire & Smoke数据库由4个类别的视频组成,有室内室外短距离火灾、室内室外短距离烟雾、野火烟雾、烟雾状与火状的移动物体等[53]。整个数据集有308.1 MB,视频的帧速率为30 Hz,输入图像大小为320×240像素。

(2)Fire Dunning Dataset

这个数据集包含正常图像和有火的图像,正负样本不均衡,包括强度、亮度、大小等不同场景的火灾图像[54]。

(3)VisFire

这个数据集来自Bilkent大学,采集自监控视频,由4个类别的视频组构成:火、烟雾、森林烟雾、其他。火灾视频组有13段火灾场景视频;烟雾组有21段视频,包含各种环境中的烟雾场景;森林烟雾组有4段森林地区的视频;其他组有2段视频,一个是汽车,一个是火;整个样本数据集总共40个视频片段[55]。

(4)BoWFire

训练集由240幅分辨率为50×50像素的图像组成,其中80张有火,160张无火,非火灾图像中包含红色或黄色类似火的物体。测试集由226幅不同分辨率的图像组成,其中包含119张有火图片和107张无火图片。火灾图像由不同场景的紧急火灾事件组成,如建筑物着火、工业火灾、车祸和骚乱[56]。数据集还对火灾区域分割,可以用于火焰分割任务。

(5)Mivia Fire & Smoke Detection Dataset

由萨勒诺大学的MIVIA实验室创建,火灾数据集由31个视频组成,包含14个火灾视频和17个无火视频,无火视频内含烟雾、云、移动的红色物体等干扰;烟雾数据集包括149个视频。这些视频均来自真实环境,每个视频长达15 min[55]。

(6)State Key Laboratory of Fire Science Dataset

该数据集有30 000个合成图像,3 578个真实图像,能够胜任深度网络的训练。合成烟雾和非烟雾图像的渲染、照明与风的参数在一定范围内随机设置,以实现图像多样性。由于不同的参数集直接影响合成烟雾图像的外观,这些图像将是真实的或非真实的。

(7)火灾科学国家实验室的烟雾数据集

由中国科学技术大学消防科学国家重点实验室创建,该数据集包含4组烟雾和非烟雾图像,其中组1包括552个烟雾和831个非烟雾图像,组2包括668个烟雾和817个非烟雾图像,组3包括2 201个烟雾和8 511个非烟雾图像,组4包括2 254个烟雾和8 363个非烟雾图像[18]。除了这些图像数据集外,还有另外648张黑白烟雾图像和两组非烟雾数据集,每组分别由27 707和28 760张图像组成。

3 总结与展望

对烟雾或火灾的早期精准检测是控制火灾的最佳方法,深度学习以高精度、高速度、强稳定性等优势在烟雾火灾检测领域中表现优异,因此本文从目标分类、目标检测、目标分割3个方面对比分析了烟雾火灾检测算法现状,列举了主流的烟雾火灾检测算法的改进措施、优势以及存在的问题。目前,这些技术还处于发展阶段,深度学习在烟雾火灾检测应用中仍存在一些无法回避的问题亟待解决:(1)火灾探测的地点可能是一个工业、核电站、建筑、住宅或森林,因此烟雾和火焰的形态比较多样,尺度多变,特征变化大。(2)早期火灾目标小,特征不明显,早期火灾检测困难。(3)现有的火灾评估模型大多是依据对环境各方面的分析以评估发生火灾风险的可能性以及火灾隐患,以提前制定预案防止火灾发生[57-59],用于评估火灾发生后火灾等级的模型较少。

针对以上问题,本文经过分析认为烟雾与火灾检测算法还有以下几个方面需深入研究:

(1)制作一个全面合理的数据集

众所周知,深度学习算法依赖大量的数据集,一个全面的数据集能够使模型提取更丰富多样的特征,以大幅提高检测效果。然而火灾检测领域始终没有一个权威且全面的数据集,生成对抗网络[60]可以使用已有的原始数据集生成逼真的人造数据,以丰富数据集。此外,还可以通过裁剪、旋转变换、颜色变换、噪声注入、元学习数据增强等数据增强方法进一步扩充样本数量,优化泛化性弱的检测局限性。

(2)改进网络特征融合模块

现代网络体系结构中特征融合模块通常通过求和或concatenation等简单的线性操作实现不同层或分支的特征组合,但由于输入特征的语义和尺度不一致性,导致这可能并不是最佳选择。构建多尺度通道注意力特征融合模块,以融合更多有效特征,改善烟雾火焰尺度变化大带来的检测困难问题。(3)提升小火焰检测性能

可通过copy pasting方法增加小火焰数量,解决小火焰数据不易采集,本身判别性特征少的问题。在主干网络中引入注意力机制与扩张卷积等模块,加强特征提取能力,使提取到的特征具有更高的辨识度和鲁棒性,提高模型对小火焰的检测性能。

(4)构建更轻量化的模型

选取MobileNetV3[61]等更先进的轻量化网络进行特征提取,采用通道剪枝[62]等方法对模型压缩,使用深度可分离卷积[63]与残差结构等减少参数量,提升模型的检测速度,能够及时发现火灾,减少损失。

(5)有效利用烟雾与火焰的特征

烟雾与火焰具有颜色、纹理、闪烁等特征,使用这些特征在检测模型中添加前处理或后处理,能够降低模型误警率。

(6)开发综合火灾检测系统

目前的研究工作大多是对烟雾和火灾进行识别检测,但是缺乏对火灾形势变化的判断。开发综合火灾检测系统,该系统可识别不同类型、地点、大小和级别的火灾或烟雾,检测到烟雾或火焰时发出警报,并能预估火势变化,以助于消防员根据火势更好地开展救援工作。

4 结束语

通过对基于深度学习的烟雾火灾检测算法当前研究现状的分析可知,深度学习技术为解决传统烟雾火灾检测的问题提供了更好的方法。本文首先围绕基于目标分类、基于目标检测以及基于目标分割3种不同的深度学习方法对烟雾火灾检测算法分析总结;之后介绍了几种公开的烟雾火灾数据集;最后分析现有方法的不足并展望未来研究方向。